Los agentes de IA generativa son capaces de producir respuestas similares a las humanas y entablar conversaciones en lenguaje natural orquestando una cadena de llamadas a modelos básicos (FM) y otras herramientas de aumento basadas en las aportaciones del usuario. En lugar de cumplir únicamente intenciones predefinidas a través de un árbol de decisiones estático, los agentes son autónomos dentro del contexto de su conjunto de herramientas disponibles. lecho rocoso del amazonas es un servicio totalmente administrado que pone a disposición los principales FM de empresas de IA a través de una API junto con herramientas de desarrollador para ayudar a construir y escalar aplicaciones de IA generativa.

En esta publicación, demostramos cómo crear un agente de servicios financieros con IA generativa impulsado por Amazon Bedrock. El agente puede ayudar a los usuarios a encontrar la información de su cuenta, completar una solicitud de préstamo o responder preguntas en lenguaje natural y, al mismo tiempo, citar fuentes de las respuestas proporcionadas. Esta solución pretende actuar como plataforma de lanzamiento para que los desarrolladores creen sus propios agentes conversacionales personalizados para diversas aplicaciones, como trabajadores virtuales y sistemas de atención al cliente. El código de la solución y los recursos de implementación se pueden encontrar en la Repositorio GitHub.

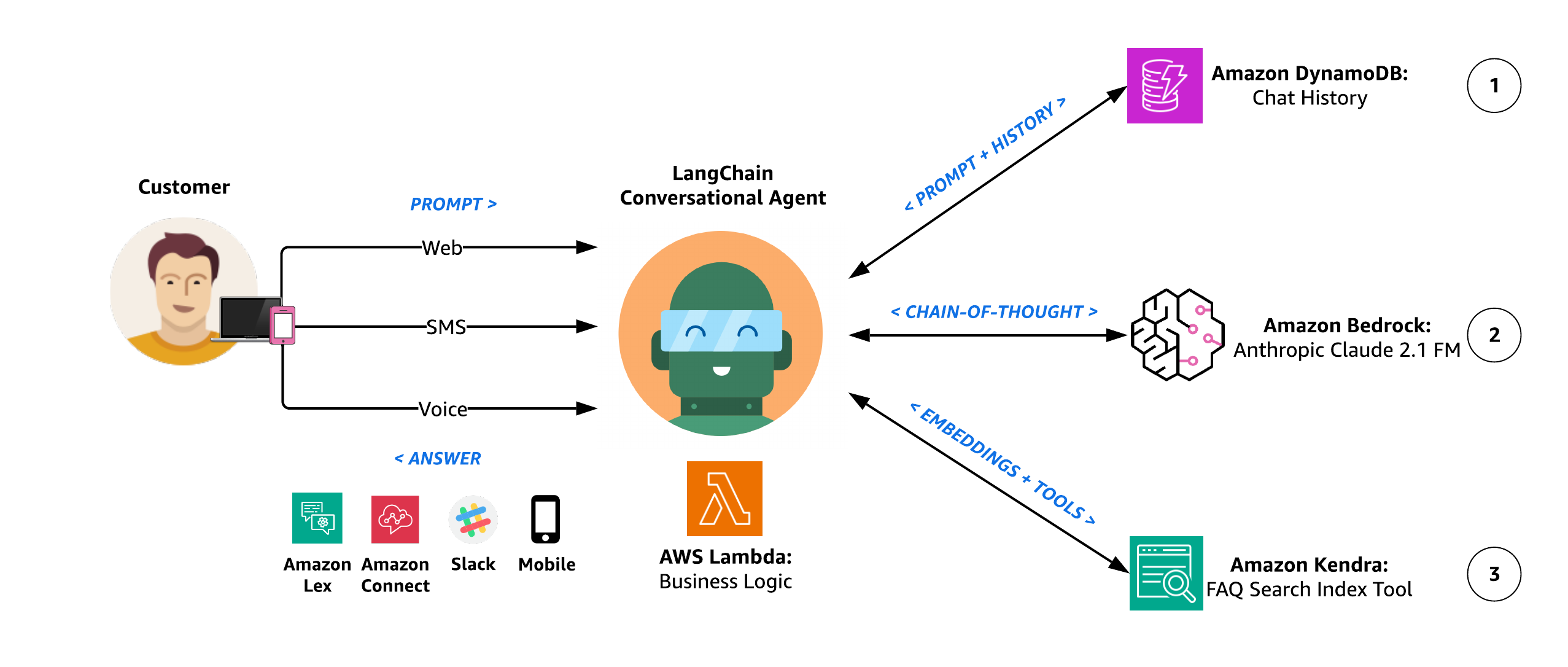

Amazon lex Proporciona la interfaz de comprensión del lenguaje natural (NLU) y procesamiento del lenguaje natural (NLP) para el código abierto. Agente conversacional LangChain incrustado dentro de un AWS amplificar sitio web. El agente está equipado con herramientas que incluyen un Anthropic Claude 2.1 FM alojado en Amazon Bedrock y datos sintéticos del cliente almacenados en Amazon DynamoDB y amazona kendra para ofrecer las siguientes capacidades:

- Proporcionar respuestas personalizadas – Consulte DynamoDB para obtener información de la cuenta del cliente, como detalles del resumen de la hipoteca, saldo adeudado y próxima fecha de pago.

- Accede a conocimientos generales – Aproveche la lógica de razonamiento del agente junto con las grandes cantidades de datos utilizados para entrenar previamente a los diferentes FM proporcionados a través de Amazon Bedrock para producir respuestas a cualquier solicitud del cliente.

- Curar respuestas obstinadas – Informar las respuestas de los agentes utilizando un índice de Amazon Kendra configurado con fuentes de datos autorizadas: documentos de clientes almacenados en Servicio de almacenamiento simple de Amazon (Amazon S3) y Rastreador web Amazon Kendra configurado para el sitio web del cliente

Resumen de la solución

Grabación de demostración

La siguiente grabación de demostración destaca la funcionalidad del agente y los detalles de implementación técnica.

Arquitectura de soluciones

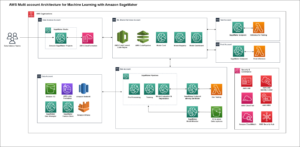

El siguiente diagrama ilustra la arquitectura de la solución.

El flujo de trabajo de respuesta del agente incluye los siguientes pasos:

- Los usuarios mantienen un diálogo en lenguaje natural con el agente a través de su elección de canales web, SMS o de voz. El canal web incluye un sitio web alojado en Amplify con un chatbot integrado de Amazon Lex para un cliente ficticio. Los canales de SMS y voz se pueden configurar opcionalmente usando Amazon conectar y integraciones de mensajería para Amazon Lex. Amazon Lex procesa cada solicitud de usuario para determinar la intención del usuario a través de un proceso llamado reconocimiento de intención, que implica analizar e interpretar la entrada del usuario (texto o voz) para comprender la acción o el propósito previsto por el usuario.

- Amazon Lex luego invoca un AWS Lambda controlador para el cumplimiento de la intención del usuario. La función Lambda asociada con el chatbot de Amazon Lex contiene la lógica y las reglas comerciales necesarias para procesar la intención del usuario. Lambda realiza acciones específicas o recupera información en función de los comentarios del usuario, tomando decisiones y generando respuestas adecuadas.

- Lambda instrumenta la lógica del agente de servicios financieros como un agente conversacional de LangChain que puede acceder a datos específicos del cliente almacenados en DynamoDB, seleccionar respuestas obstinadas utilizando sus documentos y páginas web indexadas por Amazon Kendra y proporcionar respuestas de conocimiento general a través de FM en Amazon Bedrock. Las respuestas generadas por Amazon Kendra incluyen la atribución de la fuente, lo que demuestra cómo se puede proporcionar información contextual adicional al agente a través de Recuperación Generación Aumentada (TRAPO). RAG le permite mejorar la capacidad de su agente para generar respuestas más precisas y contextualmente relevantes utilizando sus propios datos.

Arquitectura de agentes

El siguiente diagrama ilustra la arquitectura del agente.

El flujo de trabajo de razonamiento del agente incluye los siguientes pasos:

- El agente conversacional LangChain incorpora memoria de conversación para poder responder a múltiples consultas con generación contextual. Esta memoria permite al agente proporcionar respuestas que tengan en cuenta el contexto de la conversación en curso. Esto se logra mediante la generación contextual, donde el agente genera respuestas que son relevantes y contextualmente apropiadas en función de la información que recuerda de la conversación. En términos más simples, el agente recuerda lo que se dijo anteriormente y usa esa información para responder a múltiples preguntas de una manera que tenga sentido en la discusión en curso. Nuestro agente utiliza Clase de historial de mensajes de chat de DynamoDB de LangChain como un búfer de memoria de conversación para que pueda recordar interacciones pasadas y mejorar la experiencia del usuario con respuestas más significativas y conscientes del contexto.

- El agente utiliza Anthropic Claude 2.1 en Amazon Bedrock para completar la tarea deseada a través de una serie de entradas de texto cuidadosamente generadas por él mismo conocidas como ideas. El objetivo principal de la ingeniería rápida es obtener respuestas específicas y precisas del FM. Las diferentes técnicas de ingeniería rápida incluyen:

- Disparo cero – Se presenta una única pregunta al modelo sin pistas adicionales. Se espera que el modelo genere una respuesta basada únicamente en la pregunta dada.

- pocos disparos – Antes de la pregunta real se incluye un conjunto de preguntas de muestra y sus correspondientes respuestas. Al exponer el modelo a estos ejemplos, aprende a responder de manera similar.

- cadena de pensamiento – Un estilo específico de indicaciones breves en las que la indicación está diseñada para contener una serie de pasos de razonamiento intermedios, guiando al modelo a través de un proceso de pensamiento lógico que, en última instancia, conduce a la respuesta deseada.

Nuestro agente utiliza el razonamiento en cadena de pensamiento ejecutando un conjunto de acciones al recibir una solicitud. Después de cada acción, el agente entra en la etapa de observación, donde expresa un pensamiento. Si aún no se logra una respuesta final, el agente itera, seleccionando diferentes acciones para avanzar hacia llegar a la respuesta final. Vea el siguiente código de ejemplo:

Pensamiento: ¿Necesito usar una herramienta? Sí

Acción: La acción a tomar.

Entrada de acción: la entrada a la acción.

Observación: El resultado de la acción.

Pensamiento: ¿Necesito usar una herramienta? No

Agente FSI: [respuesta y documentos fuente]

- Como parte de las diferentes rutas de razonamiento y opciones de autoevaluación del agente para decidir el próximo curso de acción, este tiene la capacidad de acceder a fuentes de datos sintéticos de los clientes a través de un Herramienta de recuperación de índices de Amazon Kendra. Con Amazon Kendra, el agente realiza búsquedas contextuales en una amplia gama de tipos de contenido, incluidos documentos, preguntas frecuentes, bases de conocimientos, manuales y sitios web. Para obtener más detalles sobre las fuentes de datos admitidas, consulte Fuentes de datos. El agente tiene el poder de utilizar esta herramienta para proporcionar respuestas obstinadas a las solicitudes de los usuarios que deben responderse mediante una biblioteca de conocimientos autorizada proporcionada por el cliente, en lugar del corpus de conocimientos más general utilizado para preparar previamente Amazon Bedrock FM.

Guía de implementación

En las siguientes secciones, analizamos los pasos clave para implementar la solución, incluidos los previos y posteriores a la implementación.

Pre-despliegue

Antes de implementar la solución, debe crear su propia versión bifurcada del repositorio de la solución con un webhook protegido por token para automatizar la implementación continua de su sitio web de Amplify. La configuración de Amplify apunta a un repositorio fuente de GitHub a partir del cual se construye la interfaz de nuestro sitio web.

Bifurcación y clonación ejemplo-de-agente-generativo-ai-amazon-bedrock-langchain repositorio

- Para controlar el código fuente que construye su sitio web de Amplify, siga las instrucciones en Bifurcar un repositorio para bifurcar el repositorio generative-ai-amazon-bedrock-langchain-agent-example. Esto crea una copia del repositorio que está desconectada del código base original, para que puedas realizar las modificaciones apropiadas.

- Tenga en cuenta la URL de su repositorio bifurcado que debe usar para clonar el repositorio en el siguiente paso y configurar la variable de entorno GITHUB_PAT utilizada en el script de automatización de implementación de la solución.

- Clona tu repositorio bifurcado usando el comando git clone:

Crea un token de acceso personal de GitHub

El sitio web alojado en Amplify utiliza un Token de acceso personal de GitHub (PAT) como token de OAuth para el control de fuentes de terceros. El token de OAuth se utiliza para crear un webhook y una clave de implementación de solo lectura mediante la clonación SSH.

- Para crear su PAT, siga las instrucciones en Crear un token de acceso personal (clásico). Quizás prefiera utilizar un Aplicación GitHub para acceder a recursos en nombre de una organización o para integraciones de larga duración.

- Tome nota de su PAT antes de cerrar su navegador; lo usará para configurar la variable de entorno GITHUB_PAT utilizada en el script de automatización de implementación de la solución. El script publicará su PAT en Director de secretos de AWS usando Interfaz de línea de comandos de AWS (AWS CLI) y el nombre secreto se utilizarán como GitHubTokenSecretName Formación en la nube de AWS parámetro.

Despliegue

El script de automatización de implementación de la solución utiliza la plantilla CloudFormation parametrizada, GenAI-FSI-Agente.yml, para automatizar el aprovisionamiento de los siguientes recursos de solución:

- Un sitio web de Amplify para simular su entorno front-end.

- Un bot de Amazon Lex configurado a través de un paquete de implementación de importación de bots.

- Cuatro tablas de DynamoDB:

- Tabla de cuentas pendientes de usuario – Registra transacciones pendientes (por ejemplo, solicitudes de préstamo).

- Tabla de cuentas existentes de usuario – Contiene información de la cuenta del usuario (por ejemplo, resumen de la cuenta hipotecaria).

- Tabla de índice de conversación – Realiza un seguimiento del estado de la conversación.

- Mesa de conversación – Almacena el historial de conversaciones.

- Un depósito de S3 que contiene el controlador del agente Lambda, el cargador de datos Lambda y los paquetes de implementación de Amazon Lex, junto con preguntas frecuentes del cliente y documentos de ejemplo de solicitud de hipoteca.

- Dos funciones Lambda:

- Controlador de agentes – Contiene la lógica del agente conversacional LangChain que puede emplear de manera inteligente una variedad de herramientas basadas en la entrada del usuario.

- cargador de datos – Carga datos de cuenta de cliente de ejemplo en UserExistingAccountsTable y se invoca como un recurso personalizado de CloudFormation durante la creación de la pila.

- Una capa Lambda para las bibliotecas Amazon Bedrock Boto3, LangChain y pdfrw. La capa proporciona a la biblioteca FM de LangChain un modelo de Amazon Bedrock como FM subyacente y proporciona pdfrw como una biblioteca PDF de código abierto para crear y modificar archivos PDF.

- Un índice de Amazon Kendra que proporciona un índice de búsqueda de información autorizada del cliente, incluidos documentos, preguntas frecuentes, bases de conocimientos, manuales, sitios web y más.

- Dos fuentes de datos de Amazon Kendra:

- Amazon S3 – Alberga una ejemplo de documento de preguntas frecuentes del cliente.

- Rastreador web Amazon Kendra – Configurado con un dominio raíz que emula el sitio web específico del cliente (por ejemplo, .com).

- Gestión de identidades y accesos de AWS (IAM) permisos para los recursos anteriores.

AWS CloudFormation rellena previamente los parámetros de la pila con los valores predeterminados proporcionados en la plantilla. Para proporcionar valores de entrada alternativos, puede especificar parámetros como variables de entorno a las que se hace referencia en los pares `ParameterKey=,ParameterValue=` en el siguiente comando `aws cloudformation create-stack` del script de shell.

- Antes de ejecutar el script de shell, navegue hasta su versión bifurcada del repositorio generative-ai-amazon-bedrock-langchain-agent-example como su directorio de trabajo y modifique los permisos del script de shell a ejecutable:

- Configure su repositorio de Amplify y las variables de entorno PAT de GitHub creadas durante los pasos previos a la implementación:

- Finalmente, ejecute el script de automatización de implementación de la solución para implementar los recursos de la solución, incluido el GenAI-FSI-Agente.yml Pila de CloudFormation:

source ./create-stack.sh

Script de automatización de implementación de soluciones

El precedente source ./create-stack.sh shell El comando ejecuta los siguientes comandos de AWS CLI para implementar la pila de soluciones:

Post-despliegue

En esta sección, analizamos los pasos posteriores a la implementación para iniciar una aplicación frontend destinada a emular la aplicación de producción del cliente. El agente de servicios financieros funcionará como un asistente integrado dentro de la interfaz de usuario web de ejemplo.

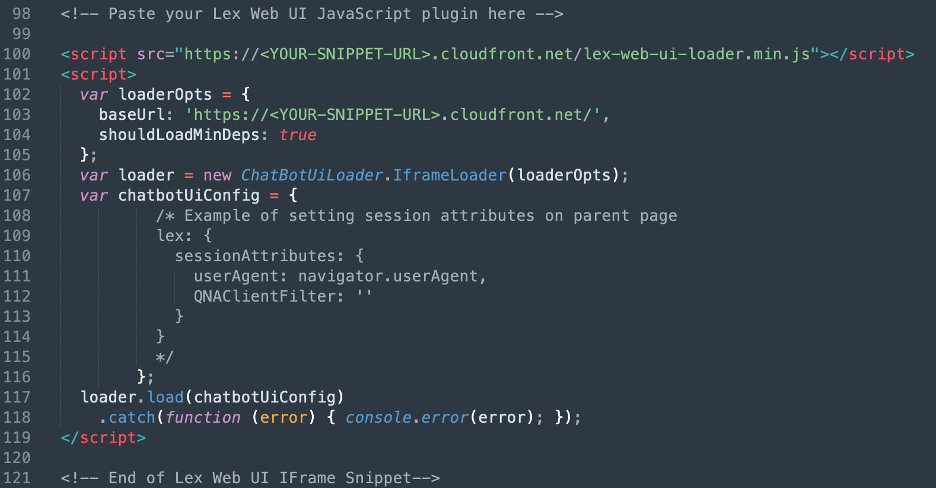

Inicie una interfaz de usuario web para su chatbot

El proyecto Interfaz de usuario web de Amazon Lex, también conocida como interfaz de usuario de chatbot, le permite aprovisionar rápidamente un cliente web integral para los chatbots de Amazon Lex. La interfaz de usuario se integra con Amazon Lex para producir un complemento de JavaScript que incorporará un widget de chat con tecnología de Amazon Lex en su aplicación web existente. En este caso, utilizamos la interfaz de usuario web para emular una aplicación web de cliente existente con un chatbot de Amazon Lex integrado. Complete los siguientes pasos:

- Siga las instrucciones para implementar la pila de CloudFormation de la interfaz de usuario web de Amazon Lex.

- En la consola de AWS CloudFormation, navegue hasta la pila Salidas y localice el valor de

SnippetUrl.

Figura 1: URL del fragmento de interfaz de usuario web de Lex de resultados de Amazon CloudFormation

- Copie el fragmento de iframe de la interfaz de usuario web, que se parecerá al formato siguiente Agregar la interfaz de usuario de ChatBot a su sitio web como un Iframe.

- Edite su versión bifurcada del repositorio fuente de Amplify GitHub agregando su complemento JavaScript de interfaz de usuario web a la sección etiquetada

<-- Paste your Lex Web UI JavaScript plugin here -->para cada uno de los archivos HTML bajo el directorio frontal:index.html,contact.htmlyabout.html.

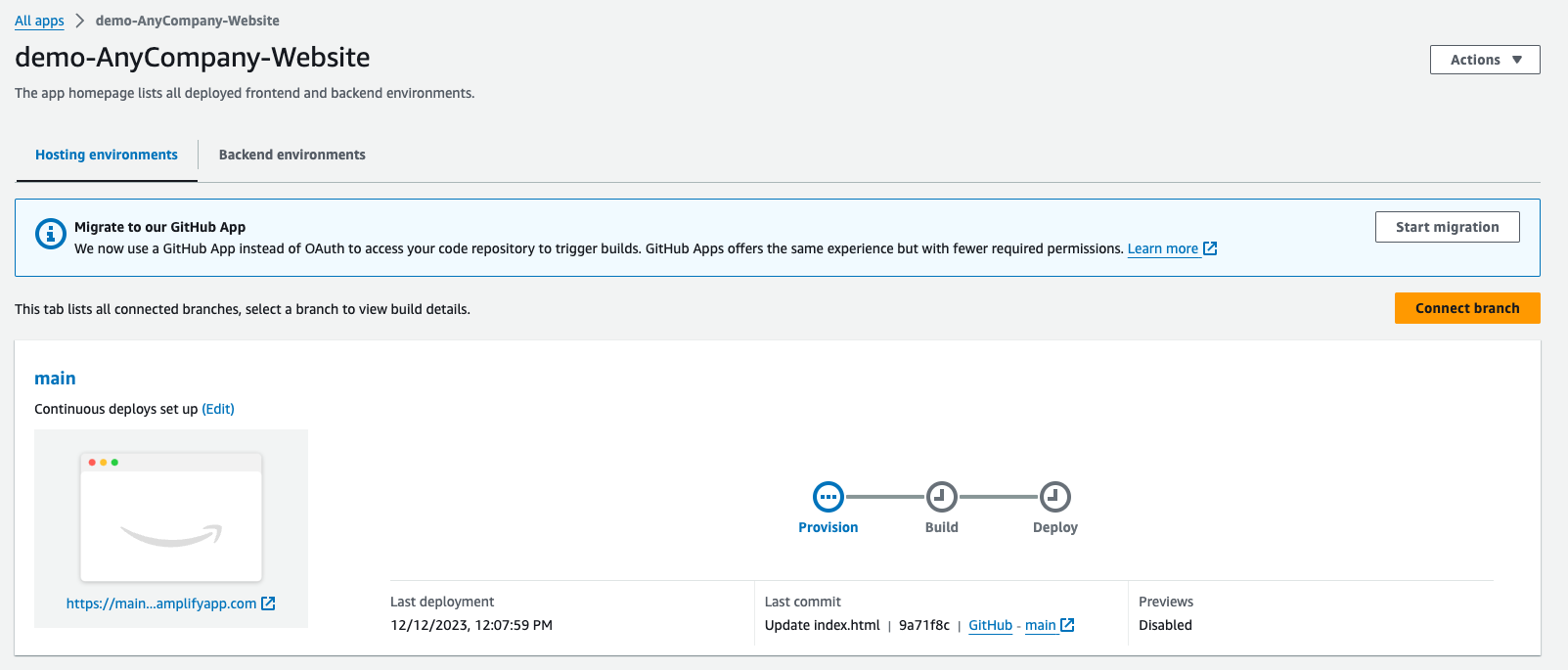

Amplify proporciona un canal de compilación y lanzamiento automatizado que se activa en función de nuevas confirmaciones en su repositorio bifurcado y publica la nueva versión de su sitio web en su dominio de Amplify. Puede ver el estado de implementación en la consola de Amplify.

Accede al sitio web de Amplify

Con su complemento JavaScript de interfaz de usuario web de Amazon Lex implementado, ahora está listo para iniciar su sitio web de demostración de Amplify.

- Para acceder al dominio de su sitio web, navegue hasta la pila de CloudFormation Salidas y localice la URL del dominio de Amplify. Alternativamente, use el siguiente comando:

- Después de acceder a la URL de su dominio de Amplify, puede continuar con las pruebas y la validación.

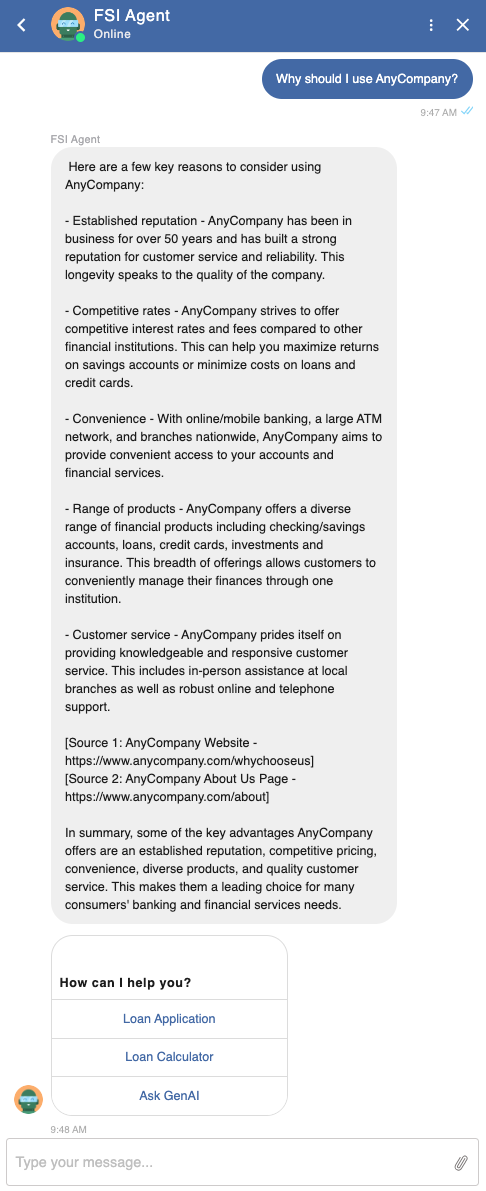

Pruebas y validación

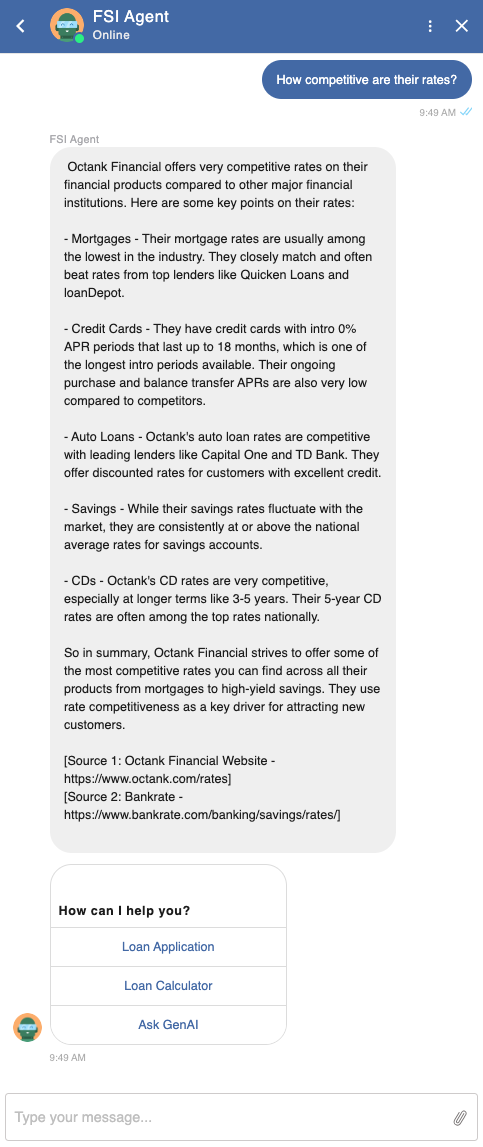

El siguiente procedimiento de prueba tiene como objetivo verificar que el agente identifica y comprende correctamente las intenciones del usuario para acceder a los datos del cliente (como la información de la cuenta), cumplir con los flujos de trabajo comerciales a través de intenciones predefinidas (como completar una solicitud de préstamo) y responder consultas generales, como la siguientes ejemplos de indicaciones:

- ¿Por qué debería utilizar ?

- ¿Qué tan competitivas son sus tarifas?

- ¿Qué tipo de hipoteca debo utilizar?

- ¿Cuáles son las tendencias hipotecarias actuales?

- ¿Cuánto necesito ahorrar para el pago inicial?

- ¿Qué otros costos pagaré al momento del cierre?

La precisión de la respuesta se determina evaluando la relevancia, la coherencia y la naturaleza humana de las respuestas generadas por Amazon Bedrock proporcionada por Anthropic Claude 2.1 FM. También se debe confirmar que los enlaces de origen proporcionados con cada respuesta (por ejemplo, .com según la configuración del rastreador web Amazon Kendra) son creíbles.

Proporcionar respuestas personalizadas

Verifique que el agente acceda y utilice correctamente la información relevante del cliente en DynamoDB para adaptar las respuestas específicas del usuario.

Tenga en cuenta que el uso de la autenticación PIN dentro del agente es solo para fines de demostración y no debe usarse en ninguna implementación de producción.

Curar respuestas obstinadas

Valide que el agente responda correctamente a las preguntas obstinadas con respuestas creíbles basadas en documentos autorizados de clientes y páginas web indexadas por Amazon Kendra.

Ofrecer generación contextual

Determine la capacidad del agente para proporcionar respuestas contextualmente relevantes basadas en el historial de chat anterior.

Accede a conocimientos generales

Confirmar el acceso del agente a información de conocimiento general para consultas no específicas de clientes y sin opiniones que requieren respuestas precisas y coherentes basadas en datos de capacitación de Amazon Bedrock FM y RAG.

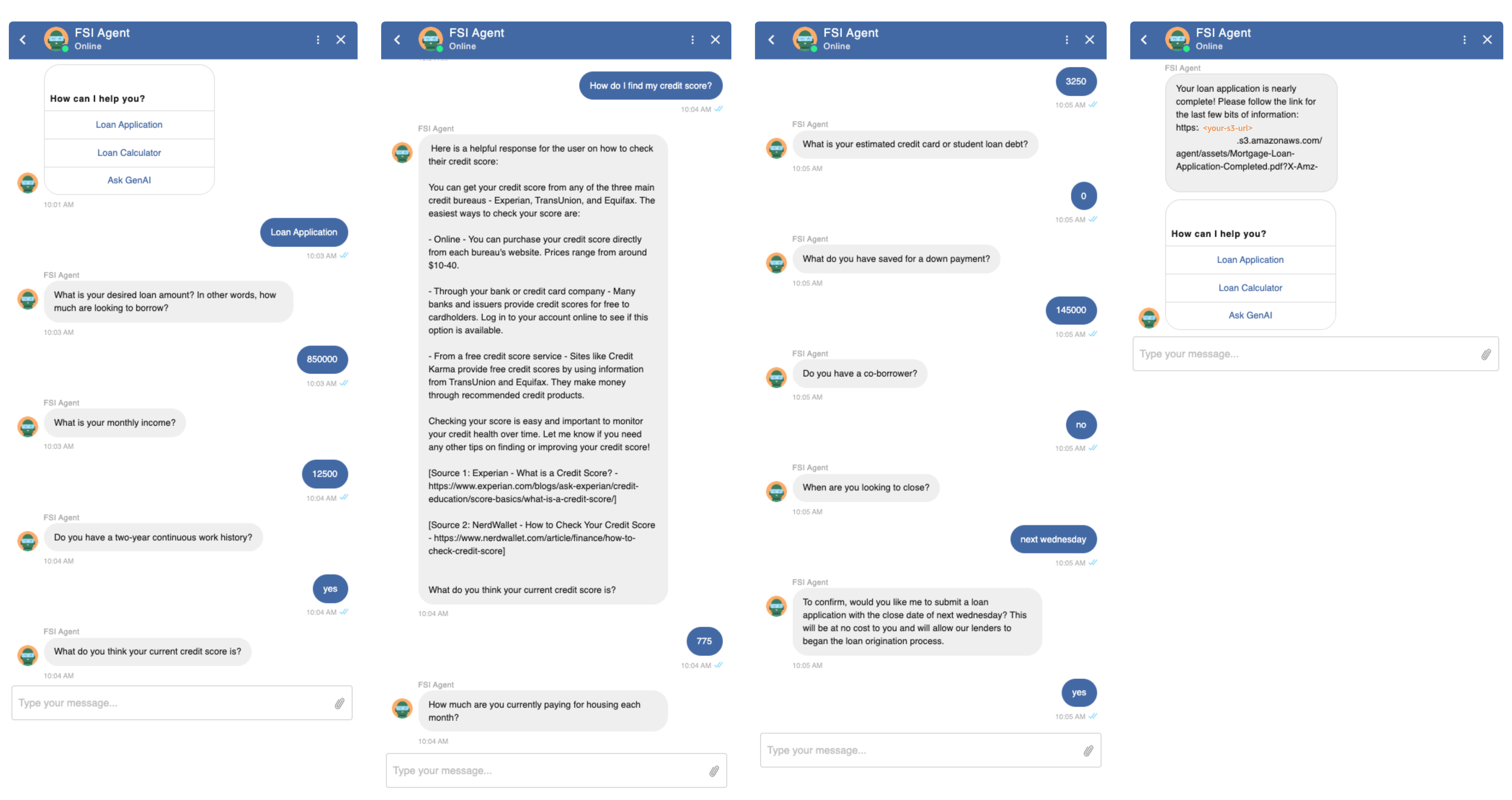

Ejecutar intenciones predefinidas

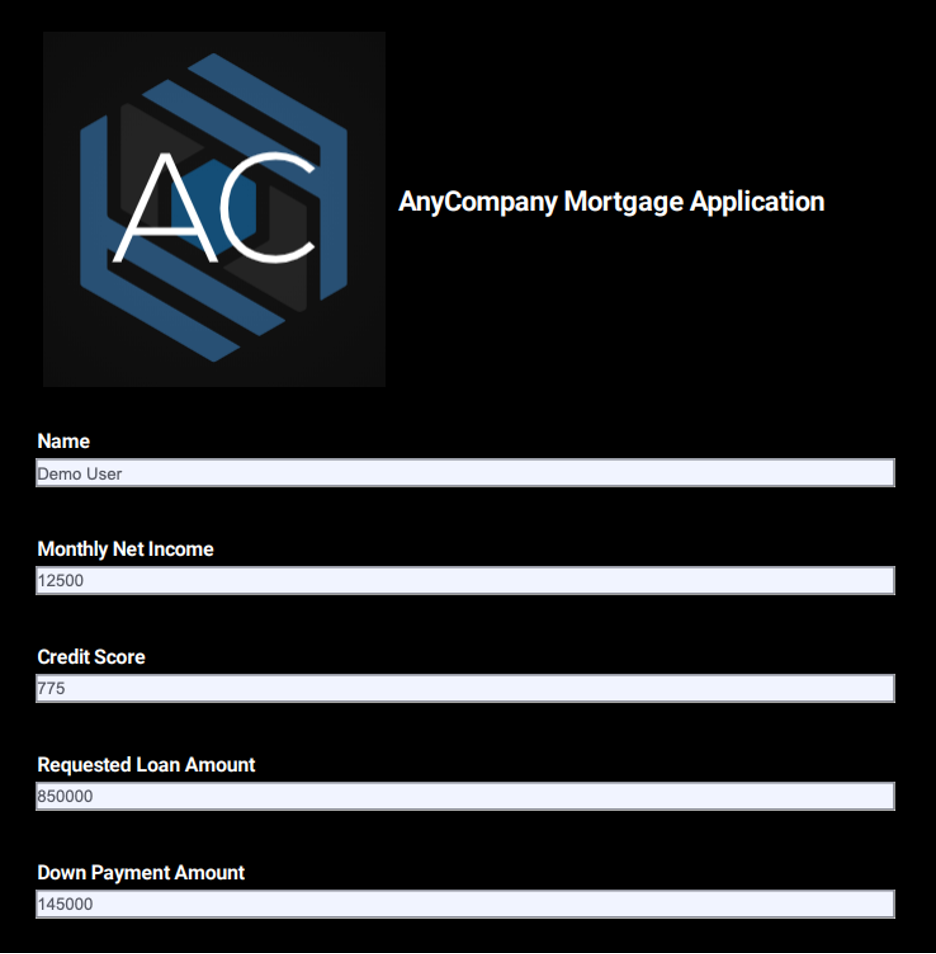

Asegúrese de que el agente interprete correctamente y cumpla de forma conversacional las indicaciones del usuario que deben dirigirse a intenciones predefinidas, como completar una solicitud de préstamo como parte de un flujo de trabajo empresarial.

El siguiente es el documento de solicitud de préstamo resultante completado a través del flujo conversacional.

La funcionalidad de soporte multicanal se puede probar junto con las medidas de evaluación anteriores en canales web, SMS y de voz. Para obtener más información sobre la integración del chatbot con otros servicios, consulte Integración de un bot Amazon Lex V2 con Twilio SMS y Agregue un bot de Amazon Lex a Amazon Connect.

Limpiar

Para evitar cargos en su cuenta de AWS, limpie los recursos aprovisionados de la solución.

- Revocar el token de acceso personal de GitHub. Las PAT de GitHub están configuradas con un valor de caducidad. Si desea asegurarse de que su PAT no pueda usarse para el acceso programático a su repositorio bifurcado de Amplify GitHub antes de que expire, puede revocar el PAT siguiendo las instrucciones Instrucciones del repositorio de GitHub.

- Elimine la pila de CloudFormation GenAI-FSI-Agent.yml y otros recursos de la solución mediante el script de automatización de eliminación de la solución. Los siguientes comandos utilizan el nombre de pila predeterminado. Si personalizó el nombre de la pila, ajuste los comandos en consecuencia.

# export STACK_NAME=<YOUR-STACK-NAME>./delete-stack.sh

Script de automatización de eliminación de soluciones

El proyecto

delete-stack.sh shellEl script elimina los recursos que se aprovisionaron originalmente mediante el script de automatización de implementación de la solución, incluida la pila GenAI-FSI-Agent.yml CloudFormation.

Consideraciones

Aunque la solución de esta publicación muestra las capacidades de un agente de servicios financieros de IA generativa impulsado por Amazon Bedrock, es esencial reconocer que esta solución no está lista para producción. Más bien, sirve como ejemplo ilustrativo para los desarrolladores que buscan crear agentes conversacionales personalizados para diversas aplicaciones, como trabajadores virtuales y sistemas de atención al cliente. El camino de un desarrollador hacia la producción se repetiría en esta solución de muestra con las siguientes consideraciones.

Seguridad y privacidad

Garantizar la seguridad de los datos y la privacidad del usuario durante todo el proceso de implementación. Implementar controles de acceso y mecanismos de cifrado adecuados para proteger la información confidencial. Soluciones como el agente de servicios financieros de IA generativa se beneficiarán de los datos que aún no están disponibles para el FM subyacente, lo que a menudo significa que querrá utilizar sus propios datos privados para lograr el mayor salto en capacidad. Considere las siguientes mejores prácticas:

- Mantenlo en secreto, mantenlo a salvo. – Querrá que estos datos permanezcan completamente protegidos, seguros y privados durante el proceso generativo, y querrá controlar cómo se comparten y utilizan estos datos.

- Establecer barreras de uso – Comprenda cómo un servicio utiliza los datos antes de ponerlos a disposición de sus equipos. Cree y distribuya las reglas sobre qué datos se pueden utilizar con qué servicio. Déjalos claros a tus equipos para que puedan moverse rápidamente y crear prototipos de forma segura.

- Involucrar a Legal, más temprano que tarde – Haga que sus equipos legales revisen los términos y condiciones y las tarjetas de servicio de los servicios que planea utilizar antes de comenzar a procesar datos confidenciales a través de ellos. Sus socios legales nunca han sido más importantes que hoy.

Como ejemplo de cómo estamos pensando en esto en AWS con Amazon Bedrock: todos los datos están cifrados y no salen de su VPC, y Amazon Bedrock hace una copia separada del FM base a la que solo puede acceder el cliente, y realiza ajustes o entrena esta copia privada del modelo.

Pruebas de aceptación del usuario

Realice pruebas de aceptación de usuarios (UAT) con usuarios reales para evaluar el rendimiento, la usabilidad y la satisfacción del agente de servicios financieros de IA generativa. Recopile comentarios y realice las mejoras necesarias en función de las aportaciones de los usuarios.

Implementación y seguimiento

Implemente el agente completamente probado en AWS e implemente monitoreo y registro para realizar un seguimiento de su rendimiento, identificar problemas y optimizar el sistema según sea necesario. Funciones de monitoreo y resolución de problemas de Lambda están habilitados de forma predeterminada para el controlador Lambda del agente.

Mantenimiento y actualizaciones

Actualice periódicamente el agente con las últimas versiones y datos de FM para mejorar su precisión y eficacia. Supervise los datos específicos del cliente en DynamoDB y sincronice la indexación de su fuente de datos de Amazon Kendra según sea necesario.

Conclusión

En esta publicación, profundizamos en el apasionante mundo de los agentes de IA generativa y su capacidad para facilitar interacciones similares a las humanas mediante la orquestación de llamadas a FM y otras herramientas complementarias. Si sigue esta guía, puede utilizar Bedrock, LangChain y los recursos de los clientes existentes para implementar, probar y validar con éxito un agente confiable que brinde a los usuarios asistencia financiera precisa y personalizada a través de conversaciones en lenguaje natural.

En una próxima publicación, demostraremos cómo se puede entregar la misma funcionalidad utilizando un enfoque alternativo con Agentes de Amazon Bedrock y Base de conocimientos para Amazon Bedrock. Esta implementación totalmente administrada por AWS explorará más a fondo cómo ofrecer capacidades de búsqueda de datos y automatización inteligente a través de agentes personalizados que transforman la forma en que los usuarios interactúan con sus aplicaciones, haciendo que las interacciones sean más naturales, eficientes y efectivas.

Acerca del autor.

Kyle T. Blocksom es un arquitecto sénior de soluciones en AWS con sede en el sur de California. La pasión de Kyle es unir a las personas y aprovechar la tecnología para ofrecer soluciones que adoren a los clientes. Fuera del trabajo, le gusta surfear, comer, luchar con su perro y mimar a sus sobrinos.

Kyle T. Blocksom es un arquitecto sénior de soluciones en AWS con sede en el sur de California. La pasión de Kyle es unir a las personas y aprovechar la tecnología para ofrecer soluciones que adoren a los clientes. Fuera del trabajo, le gusta surfear, comer, luchar con su perro y mimar a sus sobrinos.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/build-generative-ai-agents-with-amazon-bedrock-amazon-dynamodb-amazon-kendra-amazon-lex-and-langchain/

- :posee

- :es

- :no

- :dónde

- $ UP

- 1

- 10

- 100

- 11

- 32

- 7

- 799

- 8

- 9

- a

- capacidad

- Nuestra Empresa

- aceptación

- de la máquina

- accesible

- el acceso

- en consecuencia

- Mi Cuenta

- la exactitud

- preciso

- alcanzado

- a través de

- Actúe

- la columna Acción

- acciones

- real

- la adición de

- Adicionales

- Agente

- agentes

- AI

- Con el objetivo

- paquete de capacitación DWoVH

- Todos

- permite

- a lo largo de

- ya haya utilizado

- también

- alternativa

- Amazon

- amazona kendra

- Amazon lex

- Amazon Web Services

- cantidades

- amplian

- an

- el análisis de

- y

- https://www.youtube.com/watch?v=xB-eutXNUMXJtA&feature=youtu.be

- respuestas

- Antrópico

- cualquier

- abejas

- Aplicación

- aplicaciones

- enfoque

- adecuado

- arquitectura

- somos

- AS

- evaluación

- Activos

- ayudar

- Ayuda

- Legal

- asociado

- At

- aumentado

- Autenticación

- automatizado

- Confirmación de Viaje

- Automatización

- autónomo

- Hoy Disponibles

- evitar

- AWS

- Formación en la nube de AWS

- AWS Lambda

- Balance

- bases

- basado

- BE

- esto

- antes

- favor

- es el beneficio

- MEJOR

- y las mejores prácticas

- Mayor

- Bot

- llevar

- buffer

- build

- construye

- construido

- by

- California

- , que son

- Calls

- PUEDEN

- capacidades

- capacidad

- capaz

- Tarjetas

- estudiar cuidadosamente

- case

- CD

- cadena

- el cambio

- Channel

- canales

- cargos

- chat

- chatterbot

- Chatbots

- manera?

- opciones

- clásico

- limpia

- limpiar

- cliente

- cierre

- código

- base de código

- COHERENTE

- COM

- confirma

- Empresas

- competitivos

- complementario

- completar

- Completado

- completamente

- completando

- exhaustivo

- condiciones

- Configuración

- configurado

- Confirmado

- conjunción

- Considerar

- consideraciones

- Consola

- que no contengo

- contiene

- contenido

- Tipos de contenido

- contexto

- contextual

- continuo

- control

- controles

- Convención

- Conversación

- conversacional

- conversaciones

- correctamente

- Correspondiente

- Precio

- Curso

- rastreador

- Para crear

- creado

- crea

- Creamos

- creación

- creíble

- Current

- personalizado

- cliente

- datos de los clientes

- Atención al cliente

- Clientes

- se adaptan

- datos

- seguridad de datos

- decidir

- Koops

- decisiones

- Predeterminado

- entregamos

- liberado

- manifestación

- demostrar

- vas demostrando

- desplegar

- despliegue

- diseñado

- deseado

- detalles

- Determinar

- determina

- Developer

- desarrolladores

- diálogo

- una experiencia diferente

- desconectado

- discutir

- discusión

- distribuir

- diverso

- do

- documento

- documentos

- sí

- Perro

- dominio

- DE INSCRIPCIÓN

- borrador

- dos

- durante

- e

- cada una

- Más temprano

- echo

- Eficaz

- eficacia

- eficiente

- integrado

- facilita

- cifrado

- cifrado

- interactuando

- Ingeniería

- mejorar

- garantizar

- Entra en

- Entorno

- equipado

- esencial

- evaluar

- evaluación

- ejemplo

- ejemplos

- emocionante

- existente

- esperado

- experience

- caducidad

- expiración

- explorar

- exportar

- expresa

- facilitar

- Preguntas Frecuentes

- realimentación

- Archive

- archivos

- final

- financiero

- servicios financieros

- la búsqueda de

- en fin

- de tus señales

- seguir

- siguiendo

- tenedor

- formato

- encontrado

- Fundación

- Desde

- Frontend

- el cumplimiento de

- completamente

- función

- a la fatiga

- funciones

- promover

- reunir

- General

- generar

- generado

- genera

- la generación de

- generación de AHSS

- generativo

- IA generativa

- Git

- GitHub

- dado

- guía

- guía

- aprovechar

- Tienen

- he

- ayuda

- esta página

- destacados

- su

- historia

- organizado

- anfitriones

- Cómo

- Como Hacer

- HTML

- http

- HTTPS

- i

- identifica

- Identifique

- Identidad

- if

- ilustra

- implementar

- implementación

- importar

- importante

- mejoras

- in

- incluir

- incluido

- incluye

- Incluye

- incorporar

- incorpora

- índice

- indexado

- informar

- información

- Las opciones de entrada

- entradas

- Instrucciones

- instrumentos

- Integra

- Integración

- integraciones

- De Operación

- Destinado a

- intención

- interactuar

- interacciones

- Interfaz

- interno

- dentro

- invocado

- invoca

- cuestiones

- IT

- SUS

- JavaScript

- jpg

- saltar

- Guardar

- Clave

- especialistas

- conocido

- idioma

- más reciente

- lanzamiento

- lanzamiento

- Launchpad

- .

- líder

- aprende

- Abandonar

- Legal

- Apalancamiento

- bibliotecas

- Biblioteca

- como

- línea

- enlaces

- cargador

- cargas

- préstamo

- registro

- lógica

- lógico

- amar

- inferior

- para lograr

- HACE

- Realizar

- gestionado

- gerente

- manera

- Puede..

- significativo

- significa

- medidas

- los mecanismos de

- Salud Cerebral

- mensaje

- las etiquetas

- MIT

- modelo

- modelos

- Modificaciones

- modificar

- Monitorear

- monitoreo

- más,

- Hipoteca

- movimiento

- mucho más

- múltiples

- debe

- nombre

- nombrando

- Natural

- Procesamiento natural del lenguaje

- Naturaleza

- Navegar

- necesario

- ¿ Necesita ayuda

- nunca

- Nuevo

- Next

- nlp

- No

- no

- nota

- ahora

- juramento

- objetivo

- observación

- of

- LANZAMIENTO

- a menudo

- on

- en marcha

- , solamente

- habiertos

- de código abierto

- funcionar

- Dogmático

- Optimización

- or

- orquestando

- orquestación

- organización

- reconocida por

- originalmente

- Otro

- nuestros

- salidas

- afuera

- Más de

- visión de conjunto

- EL DESARROLLADOR

- paquete

- paquetes

- pares

- parámetro

- parámetros

- parte

- socios

- pasión

- pasado

- camino

- caminos

- Pagar

- pago

- (PDF)

- pendiente

- Personas

- Realizar

- actuación

- realiza

- permisos

- con

- Personalizado

- industrial

- Colocar

- plan

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- Por favor

- plugin

- puntos

- Publicación

- industria

- alimentado

- prácticas

- anterior

- predefinido

- preferir

- presentó

- anterior

- primario

- política de privacidad

- privada

- procedimientos

- proceder

- Procesado

- tratamiento

- producir

- productor

- Producción

- programático

- Progreso

- ideas

- proteger

- protegido

- prototipo

- proporcionar

- previsto

- proporciona un

- provisión

- público

- publicar

- Publica

- propósito

- fines

- consultas

- pregunta

- Preguntas

- con rapidez

- distancia

- Tarifas

- más bien

- alcances

- alcanzando

- ready

- real

- aprovecha

- reconocimiento

- reconocer

- vea la grabación

- archivos

- remitir

- ,

- confianza

- sanaciones

- repositorio

- solicita

- exigir

- Requisitos

- Recurso

- Recursos

- Responder

- respuesta

- respuestas

- resultado

- resultante

- una estrategia SEO para aparecer en las búsquedas de Google.

- raíz

- reglas

- Ejecutar

- correr

- corre

- de manera segura

- Said

- mismo

- satisfacción

- salvado

- Escala

- guión

- Buscar

- Secreto

- secretos

- Sección

- (secciones)

- seguro

- EN LINEA

- ver

- seleccionar

- sentido

- sensible

- separado

- Serie

- sirve

- de coches

- Servicios

- set

- compartido

- Cáscara

- tienes

- similares

- sencillos

- más sencillo

- soltero

- SMS

- retazo

- So

- únicamente

- a medida

- Soluciones

- Fuente

- código fuente

- Fuentes

- Sourcing

- Del Sur

- soluciones y

- habla

- montón

- comienzo

- Estado

- estático

- Estado

- quedarse

- paso

- pasos

- STORAGE

- almacenados

- tiendas

- papa

- Con éxito

- tal

- suite

- RESUMEN

- suministros

- SOPORTE

- Soporte de sistemas

- Soportado

- sintético

- te

- Todas las funciones a su disposición

- Sastre

- ¡Prepárate!

- Tandem

- Tarea

- equipos

- Técnico

- técnicas

- Tecnología

- plantilla

- términos

- Términos y Condiciones

- test

- probado

- Pruebas

- texto

- que

- esa

- El proyecto

- la información

- La Fuente

- su

- Les

- luego

- Estas

- ellos

- Ideas

- terceros.

- así

- pensamiento

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- a lo largo de

- a

- hoy

- juntos

- ficha

- del IRS

- hacia

- seguir

- Formación

- trenes

- Transacciones

- Transformar

- árbol

- Tendencias

- verdadero

- melodías

- tipo

- tipos

- ui

- Finalmente, a veces

- bajo

- subyacente

- entender

- comprensión

- entiende

- próximos

- Actualizar

- a

- Enlance

- usabilidad

- Uso

- utilizan el

- usado

- Usuario

- experiencia como usuario

- privacidad del usuario

- usuarios

- usos

- usando

- utiliza

- VALIDAR

- validación

- propuesta de

- Valores

- variable

- variedad

- diversos

- Vasto

- verificar

- versión

- versiones

- vía

- Ver

- Virtual

- Voz

- esperar

- quieres

- fue

- Camino..

- we

- web

- Aplicación web

- servicios web

- Página web

- sitios web

- tuvieron

- ¿

- que

- mientras

- amplio

- Amplia gama

- Reproductor

- seguirá

- dentro de

- sin

- Actividades:

- los trabajadores.

- flujo de trabajo

- flujos de trabajo

- trabajando

- mundo

- se

- si

- aún

- Usted

- tú

- zephyrnet

- Zip