Estamos siendo testigos de un rápido aumento en la adopción de grandes modelos de lenguaje (LLM) que impulsan aplicaciones de IA generativa en todas las industrias. Los LLM son capaces de realizar una variedad de tareas, como generar contenido creativo, responder consultas a través de chatbots, generar código y más.

Las organizaciones que buscan utilizar LLM para potenciar sus aplicaciones son cada vez más cautelosas con respecto a la privacidad de los datos para garantizar que se mantenga la confianza y la seguridad dentro de sus aplicaciones de IA generativa. Esto incluye el manejo adecuado de los datos de información de identificación personal (PII) de los clientes. También incluye evitar que se propague contenido abusivo e inseguro a los LLM y verificar que los datos generados por los LLM sigan los mismos principios.

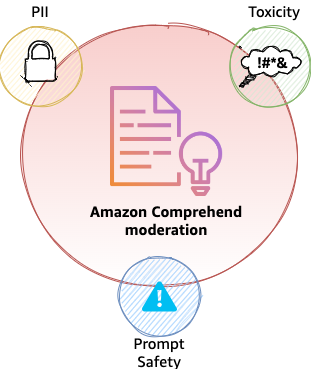

En esta publicación, analizamos las nuevas funciones impulsadas por Amazon Comprehend que permiten una integración perfecta para garantizar la privacidad de los datos, la seguridad del contenido y la seguridad rápida en aplicaciones de IA generativa nuevas y existentes.

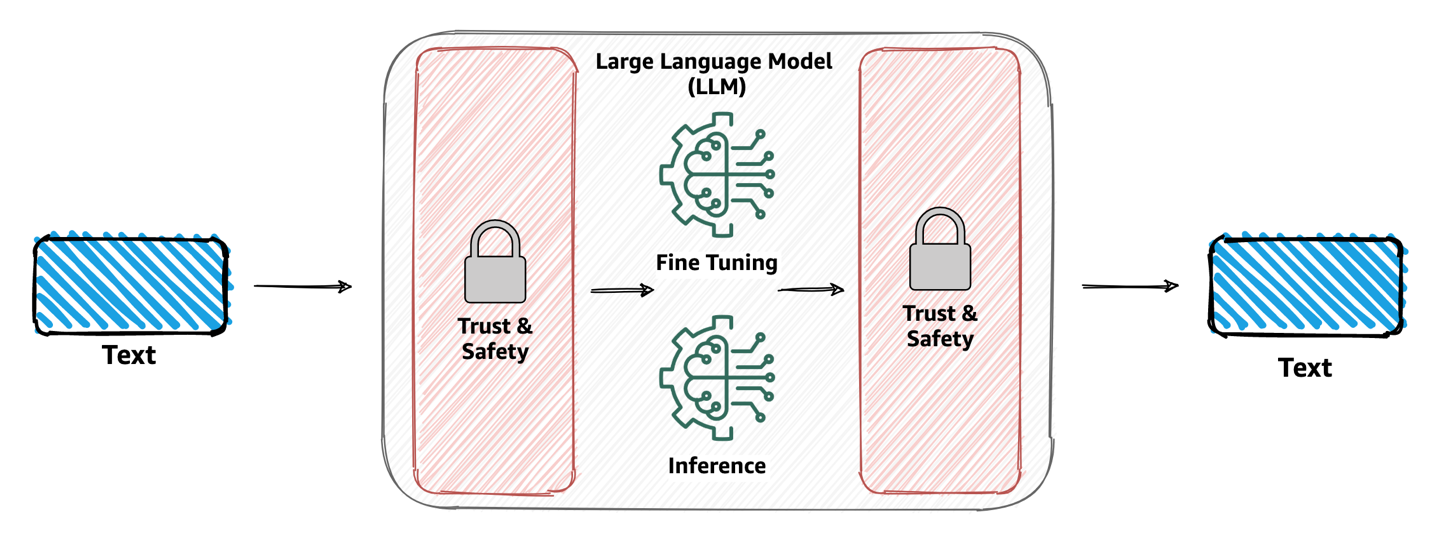

Amazon Comprehend es un servicio de procesamiento de lenguaje natural (NLP) que utiliza aprendizaje automático (ML) para descubrir información en datos y texto no estructurados dentro de documentos. En esta publicación, analizamos por qué la confianza y la seguridad de los LLM son importantes para sus cargas de trabajo. También profundizamos en cómo se utilizan estas nuevas capacidades de moderación con el popular marco de desarrollo de IA generativa. LangChain para introducir un mecanismo de confianza y seguridad personalizable para su caso de uso.

Por qué son importantes la confianza y la seguridad con los LLM

La confianza y la seguridad son primordiales cuando se trabaja con LLM debido a su profundo impacto en una amplia gama de aplicaciones, desde chatbots de atención al cliente hasta generación de contenido. A medida que estos modelos procesan grandes cantidades de datos y generan respuestas similares a las humanas, aumenta el potencial de uso indebido o resultados no deseados. Garantizar que estos sistemas de IA funcionen dentro de límites éticos y confiables es crucial, no solo para la reputación de las empresas que los utilizan, sino también para preservar la confianza de los usuarios finales y clientes.

Además, a medida que los LLM se integran más en nuestras experiencias digitales diarias, crece su influencia en nuestras percepciones, creencias y decisiones. Garantizar la confianza y la seguridad con los LLM va más allá de las simples medidas técnicas; habla de la responsabilidad más amplia de los profesionales y las organizaciones de IA de defender los estándares éticos. Al priorizar la confianza y la seguridad, las organizaciones no sólo protegen a sus usuarios, sino que también garantizan un crecimiento sostenible y responsable de la IA en la sociedad. También puede ayudar a reducir el riesgo de generar contenido dañino y ayudar a cumplir con los requisitos reglamentarios.

En el ámbito de la confianza y la seguridad, la moderación de contenido es un mecanismo que aborda varios aspectos, que incluyen, entre otros:

- Privacidad – Los usuarios pueden proporcionar sin darse cuenta texto que contenga información confidencial, poniendo en peligro su privacidad. Detectar y redactar cualquier PII es esencial.

- Toxicidad – Reconocer y filtrar contenido dañino, como discursos de odio, amenazas o abusos, es de suma importancia.

- Intención del usuario – Es fundamental identificar si la entrada del usuario (mensaje) es segura o no. Los avisos inseguros pueden expresar explícita o implícitamente intenciones maliciosas, como solicitar información personal o privada y generar contenido ofensivo, discriminatorio o ilegal. Las indicaciones también pueden expresar o solicitar implícitamente asesoramiento sobre cuestiones médicas, legales, políticas, controvertidas, personales o financieras.

Moderación de contenido con Amazon Comprehend

En esta sección, analizamos los beneficios de la moderación de contenido con Amazon Comprehend.

Abordar la privacidad

Amazon Comprehend ya aborda la privacidad a través de sus capacidades existentes de detección y redacción de PII a través de la Detectar PIEEntidades y ContienePIIEntidades API. Estas dos API están respaldadas por modelos de PNL que pueden detectar una gran cantidad de entidades de PII, como números de seguridad social (SSN), números de tarjetas de crédito, nombres, direcciones, números de teléfono, etc. Para obtener una lista completa de entidades, consulte Tipos de entidades universales de PII. DetectPII también proporciona la posición a nivel de carácter de la entidad PII dentro de un texto; por ejemplo, la posición del carácter inicial de la entidad NOMBRE (John Doe) en la oración "Mi nombre es Johh hacere”es 12 y la posición del carácter final es 19. Estas compensaciones se pueden utilizar para realizar enmascaramiento o redacción de los valores, reduciendo así los riesgos de propagación de datos privados a los LLM.

Abordar la toxicidad y la seguridad inmediata

Hoy anunciamos dos nuevas características de Amazon Comprehend en forma de API: Detección de toxicidad a través de DetectToxicContent API y clasificación de seguridad rápida a través del ClassifyDocument API. Tenga en cuenta que DetectToxicContent es una nueva API, mientras que ClassifyDocument es una API existente que ahora admite una clasificación de seguridad rápida.

Detección de toxicidad

Con la detección de toxicidad de Amazon Comprehend, puede identificar y marcar contenido que pueda ser dañino, ofensivo o inapropiado. Esta capacidad es particularmente valiosa para plataformas donde los usuarios generan contenido, como sitios de redes sociales, foros, chatbots, secciones de comentarios y aplicaciones que utilizan LLM para generar contenido. El objetivo principal es mantener un entorno positivo y seguro evitando la difusión de contenido tóxico.

En esencia, el modelo de detección de toxicidad analiza el texto para determinar la probabilidad de que contenga contenido de odio, amenazas, obscenidades u otras formas de texto dañino. El modelo se basa en amplios conjuntos de datos que contienen ejemplos de contenido tóxico y no tóxico. La API de toxicidad evalúa un fragmento de texto determinado para proporcionar una clasificación de toxicidad y una puntuación de confianza. Las aplicaciones de IA generativa pueden luego usar esta información para tomar las acciones apropiadas, como detener la propagación del texto a los LLM. Al momento de escribir este artículo, las etiquetas detectadas por la API de detección de toxicidad son HATE_SPEECH, GRAPHIC, HARRASMENT_OR_ABUSE, SEXUAL, VIOLENCE_OR_THREAT, INSULTy PROFANITY. El siguiente código demuestra la llamada API con Python Boto3 para la detección de toxicidad de Amazon Comprehend:

Clasificación de seguridad inmediata

La clasificación de seguridad de mensajes con Amazon Comprehend ayuda a clasificar un mensaje de texto de entrada como seguro o no seguro. Esta capacidad es crucial para aplicaciones como chatbots, asistentes virtuales o herramientas de moderación de contenido donde comprender la seguridad de un mensaje puede determinar las respuestas, acciones o la propagación de contenido a los LLM.

En esencia, la clasificación de seguridad rápida analiza la entrada humana en busca de cualquier intención maliciosa explícita o implícita, como solicitar información personal o privada y generar contenido ofensivo, discriminatorio o ilegal. También señala solicitudes de búsqueda de asesoramiento sobre temas médicos, legales, políticos, controvertidos, personales o financieros. La clasificación rápida devuelve dos clases, UNSAFE_PROMPT y SAFE_PROMPT, para un texto asociado, con una puntuación de confianza asociada para cada uno. La puntuación de confianza oscila entre 0 y 1 y la combinación sumará 1. Por ejemplo, en un chatbot de atención al cliente, el texto "Cómo puedo restablecer mi contraseña?” indica la intención de buscar orientación sobre los procedimientos de restablecimiento de contraseña y está etiquetado como SAFE_PROMPT. De manera similar, una declaración como “Ojalá te pase algo malo”puede marcarse por tener una intención potencialmente dañina y etiquetarse como UNSAFE_PROMPT. Es importante tener en cuenta que la clasificación de seguridad de las indicaciones se centra principalmente en detectar la intención a partir de entradas humanas (indicaciones), en lugar de texto generado por máquina (salidas LLM). El siguiente código demuestra cómo acceder a la función de clasificación de seguridad rápida con el ClassifyDocument API:

Tenga en cuenta que endpoint_arn en el código anterior es un AWS proporcionado Número de recurso de Amazon (ARN) del patrón arn:aws:comprehend:<region>:aws:document-classifier-endpoint/prompt-safety, Donde <region> es la región de AWS de su elección donde Amazon Comprender está disponible.

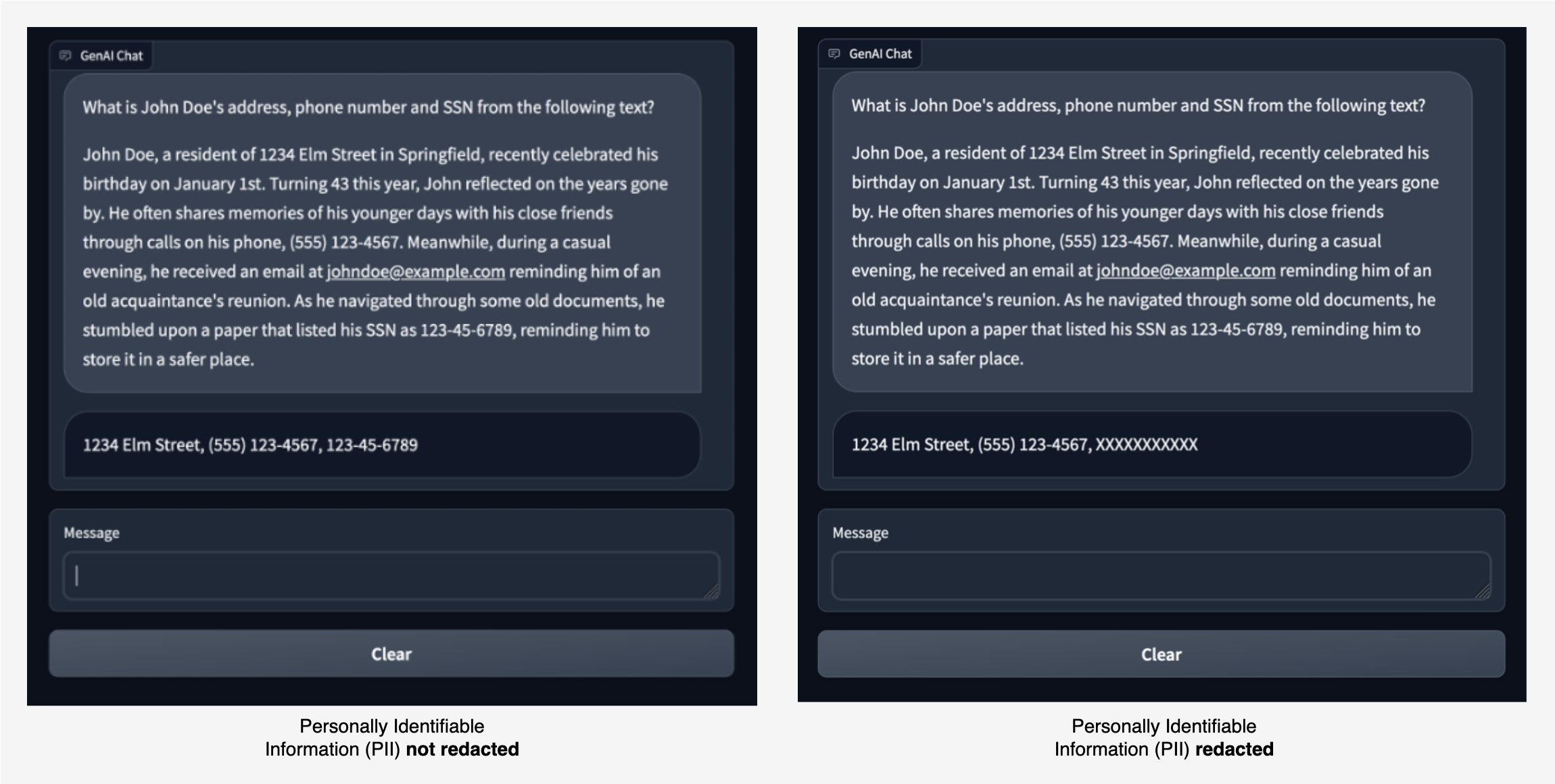

Para demostrar estas capacidades, creamos una aplicación de chat de muestra en la que le pedimos a un LLM que extraiga entidades de PII, como dirección, número de teléfono y SSN, de un texto determinado. El LLM busca y devuelve las entidades PII apropiadas, como se muestra en la imagen de la izquierda.

Con la moderación de Amazon Comprehend, podemos redactar la entrada al LLM y la salida del LLM. En la imagen de la derecha, se permite pasar el valor del SSN al LLM sin redacción. Sin embargo, cualquier valor de SSN en la respuesta del LLM está redactado.

El siguiente es un ejemplo de cómo se puede evitar que un mensaje que contiene información PII llegue al LLM por completo. Este ejemplo muestra a un usuario haciendo una pregunta que contiene información PII. Usamos la moderación de Amazon Comprehend para detectar entidades de PII en el mensaje y mostrar un error al interrumpir el flujo.

Los ejemplos de chat anteriores muestran cómo la moderación de Amazon Comprehend aplica restricciones a los datos que se envían a un LLM. En las siguientes secciones, explicamos cómo se implementa este mecanismo de moderación utilizando LangChain.

Integración con LangChain

Con las infinitas posibilidades de aplicación de los LLM en diversos casos de uso, se ha vuelto igualmente importante simplificar el desarrollo de aplicaciones de IA generativa. LangChain es un marco popular de código abierto que facilita el desarrollo de aplicaciones de IA generativa. La moderación de Amazon Comprehend amplía el marco de LangChain para ofrecer capacidades de identificación y redacción de PII, detección de toxicidad y clasificación de seguridad rápida a través de AmazonComprehendModerationChain.

AmazonComprehendModerationChain es una implementación personalizada del Cadena base LangChain interfaz. Esto significa que las aplicaciones pueden usar esta cadena con sus propios cadenas de llm para aplicar la moderación deseada al mensaje de entrada, así como al texto de salida del LLM. Las cadenas se pueden construir fusionando numerosas cadenas o mezclando cadenas con otros componentes. Puedes usar AmazonComprehendModerationChain con otras cadenas de LLM para desarrollar aplicaciones complejas de IA de forma modular y flexible.

Para explicarlo más detalladamente, proporcionamos algunos ejemplos en las siguientes secciones. El código fuente del AmazonComprehendModerationChain La implementación se puede encontrar dentro del Repositorio de código abierto LangChain. Para obtener la documentación completa de la interfaz API, consulte la documentación de la API de LangChain para Cadena de moderación de Amazon Comprender. Usar esta cadena de moderación es tan simple como inicializar una instancia de la clase con configuraciones predeterminadas:

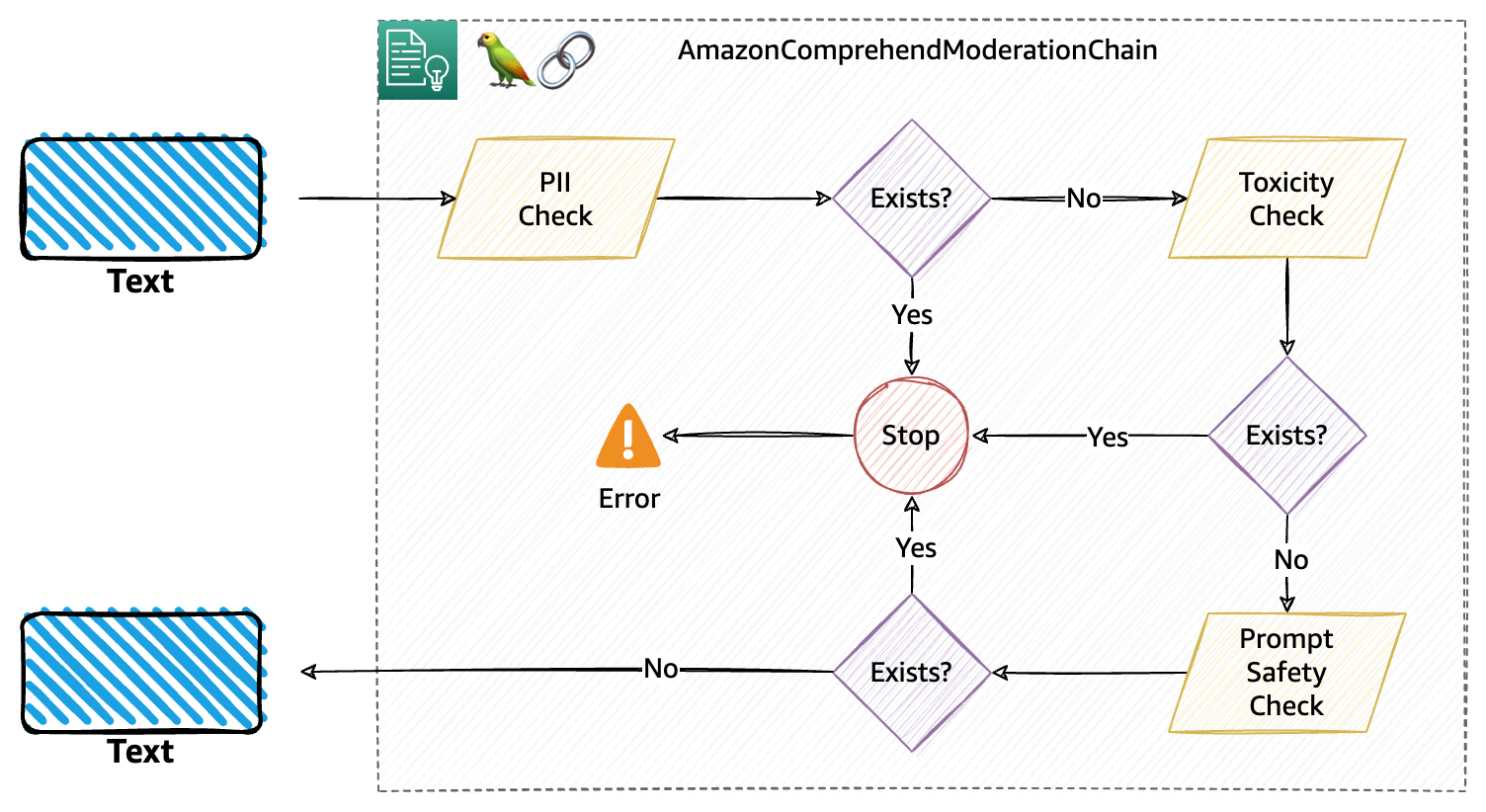

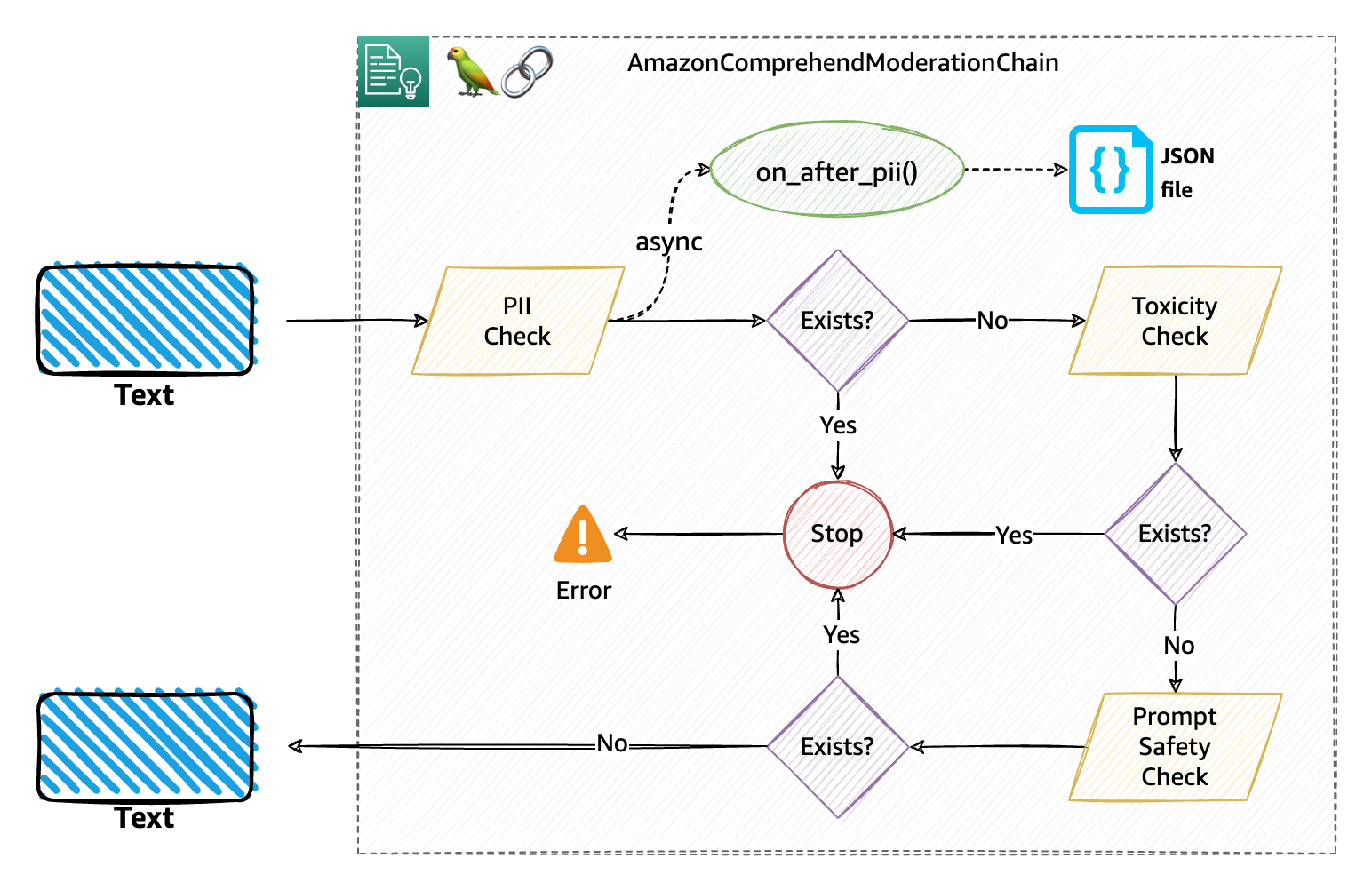

Entre bastidores, la cadena de moderación realiza tres comprobaciones de moderación consecutivas, a saber, PII, toxicidad y seguridad inmediata, como se explica en el siguiente diagrama. Este es el flujo predeterminado para la moderación.

El siguiente fragmento de código muestra un ejemplo sencillo del uso de la cadena de moderación con el Amazon FalconLite LLM (que es una versión cuantificada del Modelo Falcon 40B SFT OASST-TOP1) alojado en Hugging Face Hub:

En el ejemplo anterior, aumentamos nuestra cadena con comprehend_moderation tanto para el texto que ingresa al LLM como para el texto generado por el LLM. Esto realizará una moderación predeterminada que verificará la PII, la toxicidad y solicitará la clasificación de seguridad en esa secuencia.

Personaliza tu moderación con configuraciones de filtros

Puede utilizar el AmazonComprehendModerationChain con configuraciones específicas, lo que le brinda la capacidad de controlar qué moderaciones desea realizar en su aplicación generativa basada en IA. En el centro de la configuración, tiene tres configuraciones de filtro disponibles.

- ModeraciónPiiConfig – Se utiliza para configurar el filtro PII.

- ModeraciónToxicidadConfig – Se utiliza para configurar el filtro de contenido tóxico.

- ModeraciónIntentConfig – Se utiliza para configurar el filtro de intención.

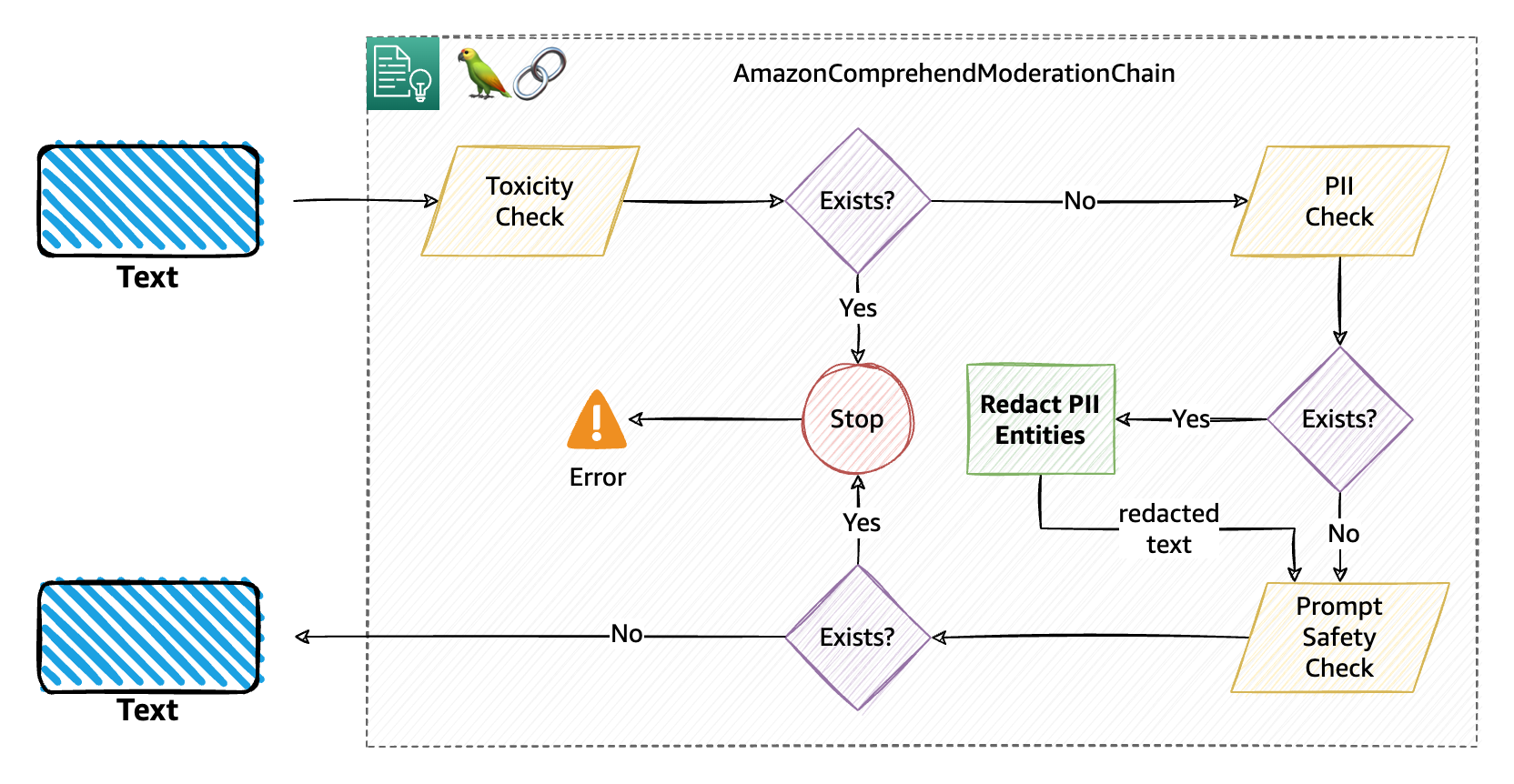

Puede utilizar cada una de estas configuraciones de filtro para personalizar el comportamiento de sus moderaciones. Las configuraciones de cada filtro tienen algunos parámetros comunes y algunos parámetros únicos con los que se pueden inicializar. Después de definir las configuraciones, se utiliza el BaseModerationConfig clase para definir la secuencia en la que se deben aplicar los filtros al texto. Por ejemplo, en el siguiente código, primero definimos las tres configuraciones de filtro y luego especificamos el orden en el que deben aplicarse:

Profundicemos un poco más para comprender qué logra esta configuración:

- Primero, para el filtro de toxicidad, especificamos un umbral de 0.6. Esto significa que si el texto contiene alguna de las etiquetas tóxicas disponibles o entidades con una puntuación superior al umbral, se interrumpirá toda la cadena.

- Si no se encuentra contenido tóxico en el texto, se realiza una verificación de PII. En este caso, nos interesa verificar si el texto contiene valores de SSN. Porque el

redactel parámetro se establece enTrue, la cadena enmascarará los valores de SSN detectados (si los hay) cuando la puntuación de confianza de la entidad de SSN sea mayor o igual a 0.5, con el carácter de máscara especificado (X). Siredactse establece aFalse, la cadena se interrumpirá por cualquier SSN detectado. - Finalmente, la cadena realiza una clasificación de seguridad rápida y evitará que el contenido se propague más abajo en la cadena si el contenido se clasifica con

UNSAFE_PROMPTcon una puntuación de confianza mayor o igual a 0.8.

El siguiente diagrama ilustra este flujo de trabajo.

En caso de interrupciones en la cadena de moderación (en este ejemplo, aplicable para los filtros de clasificación de toxicidad y seguridad rápida), la cadena elevará un Excepción de Python, esencialmente deteniendo la cadena en progreso y permitiéndole detectar la excepción (en un bloque try-catch) y realizar cualquier acción relevante. Los tres posibles tipos de excepción son:

ModerationPIIErrorModerationToxicityErrorModerationPromptSafetyError

Puede configurar un filtro o más de un filtro usando BaseModerationConfig. También puedes tener el mismo tipo de filtro con diferentes configuraciones dentro de la misma cadena. Por ejemplo, si su caso de uso solo se refiere a la PII, puede especificar una configuración que debe interrumpir la cadena en caso de que se detecte un SSN; de lo contrario, debe realizar la redacción de la edad y el nombre de las entidades de PII. Una configuración para esto se puede definir de la siguiente manera:

Usar devoluciones de llamada e identificadores únicos

Si está familiarizado con el concepto de flujos de trabajo, es posible que también esté familiarizado con devoluciones de llamada. Las devoluciones de llamada dentro de los flujos de trabajo son piezas de código independientes que se ejecutan cuando se cumplen ciertas condiciones dentro del flujo de trabajo. Una devolución de llamada puede bloquear o no bloquear el flujo de trabajo. Las cadenas LangChain son, en esencia, flujos de trabajo para LLM. AmazonComprehendModerationChain le permite definir sus propias funciones de devolución de llamada. Inicialmente, la implementación se limita únicamente a funciones de devolución de llamada asincrónicas (sin bloqueo).

Esto significa efectivamente que si usa devoluciones de llamada con la cadena de moderación, se ejecutarán independientemente de la ejecución de la cadena sin bloquearla. Para la cadena de moderación, tiene opciones para ejecutar fragmentos de código, con cualquier lógica empresarial, después de ejecutar cada moderación, independientemente de la cadena.

Opcionalmente, también puede proporcionar una cadena de identificación única arbitraria al crear un AmazonComprehendModerationChain para habilitar el registro y el análisis más adelante. Por ejemplo, si está operando un chatbot impulsado por un LLM, es posible que desee rastrear a los usuarios que son constantemente abusivos o que exponen información personal de manera deliberada o sin saberlo. En tales casos, se hace necesario rastrear el origen de dichas indicaciones y tal vez almacenarlas en una base de datos o registrarlas adecuadamente para tomar medidas adicionales. Puede pasar un ID único que identifique claramente a un usuario, como su nombre de usuario o correo electrónico, o el nombre de la aplicación que genera el mensaje.

La combinación de devoluciones de llamada e identificadores únicos le proporciona una manera poderosa de implementar una cadena de moderación que se adapta a su caso de uso de una manera mucho más cohesiva con menos código y más fácil de mantener. El controlador de devolución de llamada está disponible a través del BaseModerationCallbackHandler, con tres devoluciones de llamada disponibles: on_after_pii(), on_after_toxicity()y on_after_prompt_safety(). Cada una de estas funciones de devolución de llamada se llama de forma asíncrona después de realizar la verificación de moderación respectiva dentro de la cadena. Estas funciones también reciben dos parámetros predeterminados:

- baliza_moderación – Un diccionario que contiene detalles como el texto en el que se realizó la moderación, la salida JSON completa de la API de Amazon Comprehend, el tipo de moderación y si las etiquetas proporcionadas (en la configuración) se encontraron dentro del texto o no.

- Identificación única – El ID único que asignó al inicializar una instancia del

AmazonComprehendModerationChain.

El siguiente es un ejemplo de cómo funciona una implementación con devolución de llamada. En este caso, definimos una única devolución de llamada que queremos que ejecute la cadena después de realizar la verificación de PII:

Luego usamos el my_callback objeto al inicializar la cadena de moderación y también pasar un unique_id. Puede utilizar devoluciones de llamada e identificadores únicos con o sin configuración. Cuando subclases BaseModerationCallbackHandler, debe implementar uno o todos los métodos de devolución de llamada según los filtros que desee utilizar. Para abreviar, el siguiente ejemplo muestra una forma de utilizar devoluciones de llamada y unique_id sin ninguna configuración:

El siguiente diagrama explica cómo funciona esta cadena de moderación con devoluciones de llamada e identificadores únicos. Específicamente, implementamos la devolución de llamada PII que debería escribir un archivo JSON con los datos disponibles en el moderation_beacon y del unique_id pasado (el correo electrónico del usuario en este caso).

En la siguiente Cuaderno de Python, hemos recopilado algunas formas diferentes en las que puede configurar y utilizar la cadena de moderación con varios LLM, como los LLM alojados con JumpStart de Amazon SageMaker y alojado en abrazando la cara hub. También hemos incluido la aplicación de chat de muestra que analizamos anteriormente con lo siguiente Cuaderno de Python.

Conclusión

El potencial transformador de los grandes modelos lingüísticos y la IA generativa es innegable. Sin embargo, su uso responsable y ético depende de abordar cuestiones de confianza y seguridad. Al reconocer los desafíos e implementar activamente medidas para mitigar los riesgos, los desarrolladores, las organizaciones y la sociedad en general pueden aprovechar los beneficios de estas tecnologías y al mismo tiempo preservar la confianza y la seguridad que sustentan su integración exitosa. Utilice Amazon Comprehend ContentModerationChain para agregar funciones de confianza y seguridad a cualquier flujo de trabajo de LLM, incluidos los flujos de trabajo de recuperación de generación aumentada (RAG) implementados en LangChain.

Para obtener información sobre cómo crear soluciones basadas en RAG utilizando LangChain y la tecnología de aprendizaje automático (ML) altamente precisa de Amazon Kendra. busqueda inteligente, ver - Cree rápidamente aplicaciones de inteligencia artificial generativa de alta precisión en datos empresariales utilizando Amazon Kendra, LangChain y modelos de lenguaje grandes. Como siguiente paso, consulte la muestras de código que creamos para usar la moderación de Amazon Comprehend con LangChain. Para obtener documentación completa de la API de la cadena de moderación de Amazon Comprehend, consulte LangChain Documentación de la API.

Sobre los autores

Wrick Talukdar es un arquitecto sénior del equipo de Amazon Comprehend Service. Trabaja con los clientes de AWS para ayudarlos a adoptar el aprendizaje automático a gran escala. Fuera del trabajo, disfruta de la lectura y la fotografía.

Wrick Talukdar es un arquitecto sénior del equipo de Amazon Comprehend Service. Trabaja con los clientes de AWS para ayudarlos a adoptar el aprendizaje automático a gran escala. Fuera del trabajo, disfruta de la lectura y la fotografía.

anjan biswas es un arquitecto sénior de soluciones de servicios de IA con un enfoque en IA/ML y análisis de datos. Anjan es parte del equipo mundial de servicios de IA y trabaja con los clientes para ayudarlos a comprender y desarrollar soluciones a los problemas comerciales con IA y ML. Anjan tiene más de 14 años de experiencia trabajando con organizaciones globales de cadena de suministro, fabricación y venta al por menor, y está ayudando activamente a los clientes a comenzar y escalar en los servicios de IA de AWS.

anjan biswas es un arquitecto sénior de soluciones de servicios de IA con un enfoque en IA/ML y análisis de datos. Anjan es parte del equipo mundial de servicios de IA y trabaja con los clientes para ayudarlos a comprender y desarrollar soluciones a los problemas comerciales con IA y ML. Anjan tiene más de 14 años de experiencia trabajando con organizaciones globales de cadena de suministro, fabricación y venta al por menor, y está ayudando activamente a los clientes a comenzar y escalar en los servicios de IA de AWS.

Nikhil Jha es gerente técnico sénior de cuentas en Amazon Web Services. Sus áreas de enfoque incluyen AI/ML y análisis. En su tiempo libre, le gusta jugar al bádminton con su hija y explorar el aire libre.

Nikhil Jha es gerente técnico sénior de cuentas en Amazon Web Services. Sus áreas de enfoque incluyen AI/ML y análisis. En su tiempo libre, le gusta jugar al bádminton con su hija y explorar el aire libre.

mentón rane es un arquitecto de soluciones especializado en IA/ML en Amazon Web Services. Le apasionan las matemáticas aplicadas y el aprendizaje automático. Se enfoca en diseñar soluciones inteligentes de procesamiento de documentos para clientes de AWS. Fuera del trabajo, le gusta bailar salsa y bachata.

mentón rane es un arquitecto de soluciones especializado en IA/ML en Amazon Web Services. Le apasionan las matemáticas aplicadas y el aprendizaje automático. Se enfoca en diseñar soluciones inteligentes de procesamiento de documentos para clientes de AWS. Fuera del trabajo, le gusta bailar salsa y bachata.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/build-trust-and-safety-for-generative-ai-applications-with-amazon-comprehend-and-langchain/

- :posee

- :es

- :no

- :dónde

- $ UP

- 1

- 100

- 11

- 12

- 14

- 15%

- 17

- 19

- 500

- 7

- 8

- 9

- a

- <del>

- capacidad

- Nuestra Empresa

- abuso

- de la máquina

- Mi Cuenta

- preciso

- Logra

- a través de

- la columna Acción

- acciones

- activamente

- add

- dirección

- direcciones

- direccionamiento

- adherirse

- adoptar

- Adopción

- consejos

- Después

- edad

- AI

- Servicios de IA

- Sistemas de IA

- AI / ML

- Todos

- permitido

- Permitir

- permite

- ya haya utilizado

- también

- en total

- Amazon

- Amazon Comprehend

- amazona kendra

- Amazon Web Services

- cantidades

- an

- Analytics

- análisis

- y

- Anunciando

- https://www.youtube.com/watch?v=xB-eutXNUMXJtA&feature=youtu.be

- cualquier

- abejas

- API

- aplicable

- Aplicación

- aplicaciones

- aplicada

- se aplica

- Aplicá

- adecuado

- adecuadamente

- somos

- áreas

- AS

- contacta

- pidiendo

- aspectos

- asigna

- asistentes

- asociado

- At

- aumentar

- aumentado

- Hoy Disponibles

- AWS

- Respaldados

- Malo

- bases

- basado

- BE

- porque

- a las que has recomendado

- se convierte en

- comportamiento

- "Ser"

- creencias

- beneficios

- entre

- Más allá de

- Bloquear

- bloqueo

- ambas

- límites

- más amplio

- build

- generar confianza

- Construir la

- construido

- negocios

- pero

- by

- llamar al

- devoluciones de llamada

- , que son

- PUEDEN

- capacidades

- capacidad

- capaz

- capital

- tarjeta

- case

- cases

- lucha

- a ciertos

- cadena

- cadenas

- retos

- personaje

- chatterbot

- Chatbots

- comprobar

- comprobación

- Cheques

- barbilla

- manera?

- clase

- privadas

- clasificación

- clasificado

- clasificar

- cliente

- código

- cohesivo

- COM

- combinación

- combinado

- comentario

- Algunos

- integraciones

- componentes

- comprender

- concepto

- preocupado

- Inquietudes

- condiciones

- confianza

- Configuración

- consecutivo

- consecuentemente

- contiene

- contenido

- Generación de contenido

- control

- polémico

- Core

- creado

- Creamos

- Estudio

- crédito

- .

- crítico

- crucial

- personalizado

- cliente

- Atención al cliente

- Clientes

- personalizable

- personalizan

- todos los días

- danza

- datos

- Data Analytics

- privacidad de datos

- Base de datos

- conjuntos de datos

- decisiones

- más profundo

- Predeterminado

- definir

- se define

- ahondar

- demostrar

- demuestra

- Dependiente

- diseño

- deseado

- detalles

- detectar

- detectado

- Detección

- Determinar

- desarrollar

- desarrolladores

- Desarrollo

- una experiencia diferente

- digital

- discutir

- discutido

- distintivamente

- inmersión

- do

- documento

- documentación

- documentos

- gama

- DE INSCRIPCIÓN

- dos

- e

- cada una

- Más temprano

- más fácil

- de manera eficaz

- fácil

- ya sea

- más

- habilitar

- final

- Sin fin

- garantizar

- asegurando que

- Empresa

- entidades

- entidad

- Entorno

- igual

- igualmente

- error

- esencia

- esencial

- esencialmente

- ético

- ejemplo

- ejemplos

- Excepto

- excepción

- existente

- experience

- Experiencias

- Explicar

- explicado

- Explica

- explícitamente

- Explorar

- expreso

- Se extiende

- extraerlos

- Cara

- familiar

- Feature

- Caracteristicas

- pocos

- Archive

- filtrar

- filtración

- filtros

- financiero

- Encuentre

- encuentra

- Nombre

- marcado

- banderas

- flexible

- de tus señales

- Focus

- centrado

- se centra

- siguiendo

- siguiente

- formulario

- formato

- Formularios

- foros

- encontrado

- Marco conceptual

- Francia

- Desde

- ser completados

- funciones

- promover

- generar

- generado

- la generación de

- generación de AHSS

- generativo

- IA generativa

- obtener

- gif

- Donar

- dado

- da

- Buscar

- objetivo

- Va

- va

- candidato

- mayor

- crece

- Incremento

- guía

- Manejo

- que sucede

- perjudicial

- aprovechar

- odio

- Tienen

- es

- he

- ayuda

- ayudando

- ayuda

- altamente

- bisagras

- su

- organizado

- Cómo

- Como Hacer

- Sin embargo

- HTML

- HTTPS

- Bujes

- humana

- humano

- i

- ID

- Identificación

- identificador

- Identificadores

- identifica

- Identifique

- identificar

- if

- ilegal

- ilustra

- imagen

- Impacto

- implementar

- implementación

- implementado

- implementación

- importar

- importancia

- importante

- in

- por inadvertencia

- incluir

- incluido

- incluye

- Incluye

- aumente

- Los aumentos

- cada vez más

- independientes

- independientemente

- industrias

- influir

- información

- posiblemente

- Las opciones de entrada

- entradas

- Consultas

- ejemplo

- COMPLETAMENTE

- integración

- De Operación

- Procesamiento inteligente de documentos

- la intención de

- intención

- interesado

- Interfaz

- interrumpido

- dentro

- introducir

- IT

- SUS

- Juan

- JOHN DOE

- jpg

- json

- solo

- Etiquetas

- idioma

- large

- luego

- aprendizaje

- izquierda

- Legal

- menos

- como

- probabilidad

- Limitada

- Lista

- pequeño

- un poco más profundo

- LLM

- log

- registro

- lógica

- mirando

- máquina

- máquina de aprendizaje

- mantener

- HACE

- gerente

- manera

- Fabricación

- máscara

- matemáticas

- Materia

- Puede..

- me

- significa

- medidas

- mecanismo

- Medios

- servicios

- la fusión de

- las etiquetas

- métodos

- mal uso

- Mitigar las

- Mezcla

- ML

- modelo

- modelos

- moderación

- modulares

- más,

- mucho más

- debe

- my

- nombre

- a saber

- nombres

- Natural

- Procesamiento natural del lenguaje

- necesario

- Nuevo

- Nuevas características

- Next

- nlp

- no

- ahora

- número

- números

- numeroso

- objeto

- of

- ofensiva

- LANZAMIENTO

- compensaciones

- on

- ONE

- , solamente

- habiertos

- de código abierto

- funcionar

- funcionamiento

- Opciones

- or

- solicite

- para las fiestas.

- natural

- Otro

- de otra manera

- "nuestr

- salir

- resultados

- al exterior

- salida

- salidas

- afuera

- Más de

- EL DESARROLLADOR

- parámetro

- parámetros

- supremo

- parte

- particularmente

- pass

- pasado

- apasionado

- Contraseña

- restablecimiento de contraseña

- Patrón de Costura

- Realizar

- realizado

- realiza

- quizás

- con

- Personalmente

- teléfono

- fotografía

- pieza

- piezas

- Plataformas

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- jugando

- político

- Popular

- posición

- positivo

- POSIBILIDADES

- posible

- Publicación

- posible

- la posibilidad

- industria

- alimentado

- poderoso

- conservación

- la prevención

- las cuales

- primario

- principios

- priorización

- política de privacidad

- privada

- información privada

- problemas

- procedimientos

- tratamiento

- un profundo

- Progreso

- correctamente

- proteger

- proporcionar

- proporciona un

- Python

- pregunta

- aumento

- distancia

- rangos

- rápido

- más bien

- alcanzando

- Reading

- reino

- recepción

- reconociendo

- reducir

- la reducción de

- remitir

- región

- regulador

- confianza

- reputación

- solicita

- Requisitos

- Recurso

- aquellos

- respuesta

- respuestas

- responsabilidad

- responsable

- restricciones

- el comercio minorista

- devoluciones

- Derecho

- Riesgo

- riesgos

- Ejecutar

- s

- ambiente seguro

- Safety

- sabio

- mismo

- Escala

- Escenas

- Puntuación

- sin costura

- Sección

- (secciones)

- EN LINEA

- ver

- EL EQUIPO

- AUTO

- mayor

- sensible

- expedido

- sentencia

- Secuencia

- de coches

- Servicios

- set

- ella

- tienes

- Mostrar

- mostrar

- mostrado

- Shows

- señales

- Del mismo modo

- sencillos

- simplificar

- soltero

- Sitios Web

- retazo

- So

- Social

- redes sociales

- Sociedades

- Soluciones

- algo

- algo

- Fuente

- código fuente

- Habla

- especialista

- soluciones y

- específicamente

- especificado

- habla

- estándares de salud

- comienzo

- fundó

- Posicionamiento

- paso

- Detener

- parada

- tienda

- Cordón

- Después

- exitosos

- tal

- suministrada

- suministro

- cadena de suministro

- SOPORTE

- soportes

- sostenible,

- Todas las funciones a su disposición

- ¡Prepárate!

- tareas

- equipo

- Técnico

- Tecnologías

- plantilla

- texto

- que

- esa

- La

- La capital

- La Fuente

- su

- Les

- luego

- Ahí.

- de este modo

- Estas

- ellos

- así

- amenazas

- Tres

- umbral

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- equipo

- a

- seguir

- entrenado

- transformador

- Confía en

- try

- dos

- tipo

- tipos

- descubrir

- innegable

- apuntalar

- entender

- comprensión

- único

- Universal

- Defender

- utilizan el

- caso de uso

- usado

- Usuario

- usuarios

- usos

- usando

- utilizar

- utilizado

- Valioso

- propuesta de

- Valores

- variedad

- diversos

- Vasto

- versión

- vía

- Virtual

- W

- quieres

- fue

- Camino..

- formas

- we

- web

- servicios web

- WELL

- tuvieron

- ¿

- Que es

- cuando

- mientras

- sean

- que

- mientras

- QUIENES

- todo

- porque

- amplio

- Amplia gama

- seguirá

- deseo

- dentro de

- sin

- presenciando

- Actividades:

- flujo de trabajo

- flujos de trabajo

- trabajando

- funciona

- escribir

- la escritura

- X

- años

- Usted

- tú

- zephyrnet