Para compartir la magia de DESDE EL 2 Con una audiencia amplia, necesitábamos reducir los riesgos asociados con modelos de generación de imágenes potentes. Para ello, ponemos varios barandillas para evitar que las imágenes generadas violen nuestros política de contenido. Esta publicación se centra en mitigaciones previas al entrenamiento, un subconjunto de estas medidas de protección que modifican directamente los datos de los que DALL·E 2 aprende. En particular, DALL·E 2 está entrenado en cientos de millones de imágenes con subtítulos de Internet, y eliminamos y volvemos a ponderar algunas de estas imágenes para cambiar lo que aprende el modelo.

Esta publicación está organizada en tres secciones, cada una de las cuales describe una mitigación previa al entrenamiento diferente:

- En la primera sección, describimos cómo filtramos las imágenes violentas y sexuales del conjunto de datos de entrenamiento de DALL·E 2. Sin esta mitigación, el modelo aprendería a producir imágenes gráficas o explícitas cuando se le solicite, e incluso podría devolver dichas imágenes sin querer en respuesta a indicaciones aparentemente inocuas.

- En la segunda sección, encontramos que el filtrado de datos de entrenamiento puede amplificar los sesgos y describimos nuestra técnica para mitigar este efecto. Por ejemplo, sin esta mitigación, notamos que los modelos entrenados con datos filtrados a veces generaban más imágenes de hombres y menos imágenes de mujeres en comparación con los modelos entrenados con el conjunto de datos original.

- En la sección final, pasamos a la cuestión de la memorización, descubriendo que modelos como DALL·E 2 a veces pueden reproducir imágenes en las que fueron entrenados en lugar de crear imágenes novedosas. En la práctica, encontramos que este regurgitación de imagen es causado por imágenes que se replican muchas veces en el conjunto de datos y mitiga el problema eliminando imágenes que son visualmente similares a otras imágenes en el conjunto de datos.

Reducción de datos de entrenamiento gráficos y explícitos

Dado que los datos de entrenamiento dan forma a las capacidades de cualquier modelo aprendido, el filtrado de datos es una herramienta poderosa para limitar las capacidades no deseadas del modelo. Aplicamos este enfoque a dos categorías (imágenes que representan violencia gráfica y contenido sexual) mediante el uso de clasificadores para filtrar imágenes en estas categorías fuera del conjunto de datos antes de entrenar DALL·E 2. Entrenamos estos clasificadores de imágenes internamente y continuamos estudiando el efectos del filtrado de conjuntos de datos en nuestro modelo entrenado.

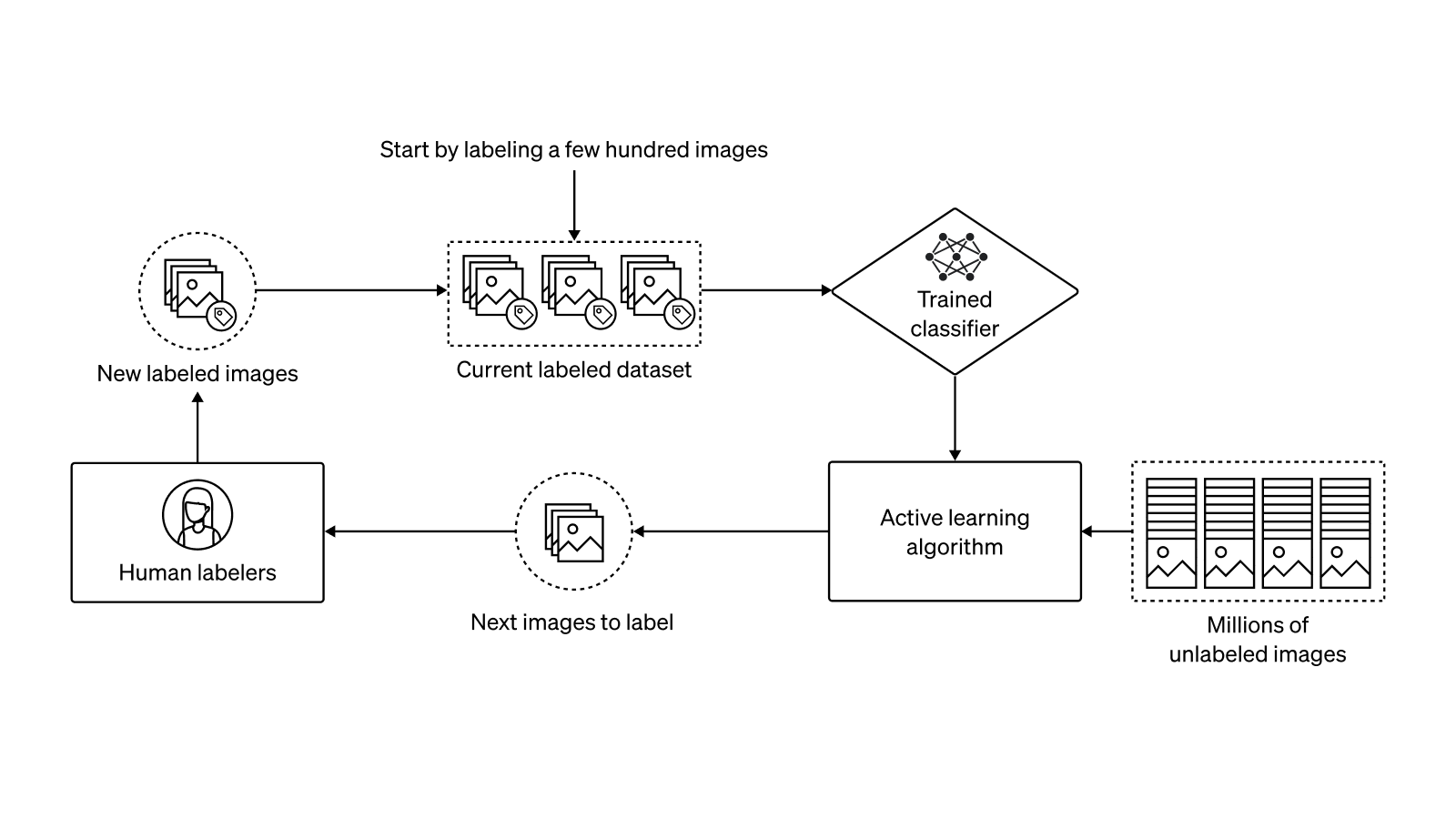

Para entrenar a nuestros clasificadores de imágenes, reutilizamos un enfoque que habíamos empleado anteriormente para filtrar los datos de entrenamiento para PLANEO. Los pasos básicos de este enfoque son los siguientes: primero, creamos una especificación para las categorías de imágenes que nos gustaría etiquetar; segundo, reunimos unos cientos de ejemplos positivos y negativos para cada categoría; tercero, utilizamos un procedimiento de aprendizaje activo para recopilar más datos y mejorar el equilibrio entre precisión y recuperación; y finalmente, ejecutamos el clasificador resultante en todo el conjunto de datos con un umbral de clasificación conservador para favorecer la recuperación sobre la precisión. Para establecer estos umbrales, priorizamos filtrar todos los malos datos sobre la salida en todos los candidato datos. Esto se debe a que siempre podemos ajustar nuestro modelo con más datos más tarde para enseñarle cosas nuevas, pero es mucho más difícil hacer que el modelo olvide algo que ya ha aprendido.

Durante la fase de aprendizaje activo, mejoramos iterativamente nuestros clasificadores reuniendo etiquetas humanas para imágenes potencialmente difíciles o mal clasificadas. En particular, utilizamos dos técnicas de aprendizaje activo para elegir imágenes de nuestro conjunto de datos (que contiene cientos de millones de imágenes sin etiquetar) para presentarlas a los humanos para su etiquetado. En primer lugar, para reducir la tasa de falsos positivos de nuestro clasificador (es decir, la frecuencia con la que clasifica erróneamente una imagen benigna como violenta o sexual), asignamos etiquetas humanas a las imágenes que el modelo actual clasificó como positivas. Para que este paso funcione bien, ajustamos nuestro umbral de clasificación para casi el 100 % de recuperación, pero con una alta tasa de falsos positivos; De esta manera, nuestros etiquetadores etiquetaban en su mayoría casos verdaderamente negativos. Si bien esta técnica ayuda a reducir los falsos positivos y reduce la necesidad de que los etiquetadores observen imágenes potencialmente dañinas, no ayuda a encontrar más casos positivos de los que actualmente no se encuentran en el modelo.

Para reducir la tasa de falsos negativos de nuestro clasificador, empleamos una segunda técnica de aprendizaje activo: la búsqueda del vecino más cercano. En particular, realizamos una validación cruzada múltiple para encontrar muestras positivas en nuestro conjunto de datos etiquetado actual que el modelo tendía a clasificar erróneamente como negativo (para hacer esto, literalmente entrenamos cientos de versiones del clasificador con diferentes divisiones de validación de trenes). Luego escaneamos nuestra gran colección de imágenes sin etiquetar en busca de vecinos más cercanos de estas muestras en un espacio de características perceptuales y asignamos etiquetas humanas a las imágenes descubiertas. Gracias a nuestra infraestructura de cómputo, fue trivial escalar tanto el entrenamiento del clasificador como la búsqueda del vecino más cercano a muchas GPU, lo que permitió que el paso de aprendizaje activo se llevara a cabo durante varios minutos en lugar de horas o días.

Para verificar la efectividad de nuestros filtros de datos, entrenamos dos modelos GLIDE con los mismos hiperparámetros: uno en datos sin filtrar y otro en el conjunto de datos después del filtrado. Nos referimos al modelo anterior como el modelo sin filtrar, y este último como el modelo filtrado. Como era de esperar, descubrimos que el modelo sin filtrar generalmente producía contenido menos explícito o gráfico en respuesta a las solicitudes de este tipo de contenido. Sin embargo, también encontramos un efecto secundario inesperado del filtrado de datos: creó o amplificó los sesgos del modelo hacia ciertos datos demográficos.

Corrección del sesgo introducido por los filtros de datos

Los modelos generativos intentan hacer coincidir la distribución de sus datos de entrenamiento, incluido cualquier sesgo en ellos. Como resultado, filtrar los datos de entrenamiento tiene el potencial de crear o amplificar sesgos en los modelos posteriores. En general, corregir los sesgos en el conjunto de datos original es una tarea sociotécnica difícil que continuamos estudiando y está más allá del alcance de esta publicación. El problema que abordamos aquí es la amplificación de los sesgos causados específicamente por el filtrado de datos en sí. Con nuestro enfoque, nuestro objetivo es evitar que el modelo filtrado sea más, sesgado que el modelo sin filtrar, reduciendo esencialmente el cambio de distribución causado por el filtrado de datos.

Como ejemplo concreto de la amplificación del sesgo debido al filtrado, considere el aviso "un director general". Cuando nuestro modelo sin filtrar generó imágenes para este mensaje, tendió a producir más imágenes de hombres que de mujeres, y esperamos que la mayor parte de este sesgo sea un reflejo de nuestros datos de entrenamiento actuales. Sin embargo, cuando ejecutamos el mismo indicador a través de nuestro modelo filtrado, el sesgo pareció amplificarse; las generaciones eran casi exclusivamente imágenes de hombres.

Nuestra hipótesis es que este caso particular de amplificación del sesgo proviene de dos lugares: primero, incluso si las mujeres y los hombres tienen una representación aproximadamente igual en el conjunto de datos original, el conjunto de datos puede estar sesgado para presentar a las mujeres en contextos más sexualizados; y en segundo lugar, nuestros propios clasificadores pueden estar sesgados debido a la implementación o la definición de clase, a pesar de nuestros esfuerzos para garantizar que este no fuera el caso durante las fases de recopilación y validación de datos. Debido a estos dos efectos, nuestro filtro puede eliminar más imágenes de mujeres que de hombres, lo que cambia la proporción de género que observa la modelo en el entrenamiento.

Para investigar más a fondo el sesgo inducido por el filtro, queríamos una forma de medir cuánto afectaban nuestros filtros de datos al sesgo hacia varios conceptos. En particular, nuestros filtros de violencia y contenido sexual se basan únicamente en imágenes, pero la naturaleza multimodal de nuestro conjunto de datos nos permite medir directamente los efectos de estos filtros en el texto. Dado que cada imagen va acompañada de una leyenda de texto, pudimos observar la frecuencia relativa de las palabras clave seleccionadas a mano en el conjunto de datos filtrado y sin filtrar para estimar cuánto afectaban los filtros a un concepto determinado.

Para poner esto en práctica, usamos Apache Spark para calcular las frecuencias de un puñado de palabras clave (por ejemplo, "padre", "mujer", "niño") sobre todos los subtítulos en nuestros conjuntos de datos filtrados y no filtrados. A pesar de que nuestro conjunto de datos contiene cientos de millones de pares de texto e imagen, calcular estas frecuencias de palabras clave solo tomó unos minutos con nuestro clúster de cómputo.

Después de calcular las frecuencias de las palabras clave, pudimos confirmar que nuestros filtros de conjuntos de datos efectivamente habían sesgado las frecuencias de ciertas palabras clave más que otras. Por ejemplo, los filtros redujeron la frecuencia de la palabra “mujer” en un 14 %, mientras que la frecuencia de la palabra “hombre” solo se redujo en un 6 %. Esto confirmó, a gran escala, lo que ya habíamos observado anecdóticamente al tomar muestras de modelos GLIDE entrenados en ambos conjuntos de datos.

Ahora que teníamos un proxy para medir el sesgo inducido por el filtro, necesitábamos una forma de mitigarlo. Para abordar este problema, nuestro objetivo era volver a ponderar el conjunto de datos filtrados para que su distribución coincidiera mejor con la distribución de imágenes sin filtrar. Como ejemplo de juguete para ilustrar esta idea, supongamos que nuestro conjunto de datos consiste en un 50 % de fotos de gatos y un 50 % de fotos de perros, pero nuestros filtros de datos eliminan el 75 % de los perros, pero solo el 50 % de los gatos. El conjunto de datos final sería ⅔ gatos y ⅓ perros, y un modelo generativo basado en probabilidades entrenado en este conjunto de datos probablemente generaría más imágenes de gatos que de perros. Podemos corregir este desequilibrio multiplicando la pérdida de entrenamiento de cada imagen de un perro por 2, emulando el efecto de repetir cada imagen de perro dos veces. Resulta que podemos escalar este enfoque a nuestros conjuntos de datos y modelos reales de una manera que es en gran parte automática, es decir, no necesitamos seleccionar manualmente las características que queremos volver a ponderar.

Calculamos los pesos de las imágenes en el conjunto de datos filtrados utilizando probabilidades de un clasificador especial, similar al enfoque utilizado por Choi et al. (2019). Para entrenar este clasificador, muestreamos uniformemente imágenes de ambos conjuntos de datos y predecimos de qué conjunto de datos proviene la imagen. En particular, este modelo predice P(sin filtrar|imagen), dada una previa P (sin filtrar) = 0.5. En la práctica, no queremos que este modelo sea demasiado poderoso o, de lo contrario, podría aprender la función exacta implementada por nuestros filtros en primer lugar. En cambio, queremos que el modelo sea más suave que nuestros filtros de datos originales, capturando categorías amplias que se ven afectadas por los filtros sin estar seguros de si una imagen en particular se filtrará o no. Con este fin, entrenamos una sonda lineal en la parte superior de un pequeño CLIP modelo.

Una vez que tenemos un clasificador que predice la probabilidad de que una imagen provenga del conjunto de datos sin filtrar, todavía necesitamos convertir esta predicción en un peso para la imagen. Por ejemplo, supongamos que P(sin filtrar|imagen) = 0.8. Esto significa que es 4 veces más probable que la muestra se encuentre en los datos sin filtrar que en los datos filtrados, y un peso de 4 debería corregir el desequilibrio. Más generalmente, podemos usar el peso P(sin filtrar|imagen)/P(filtrada|imagen).[ 1 ]

¿Qué tan bien mitiga este esquema de reponderación el sesgo amplificado? Cuando ajustamos nuestro modelo filtrado anterior con el nuevo esquema de ponderación, el comportamiento del modelo ajustado coincidió mucho más con el modelo sin filtrar en los ejemplos sesgados que habíamos encontrado anteriormente. Si bien esto fue alentador, también queríamos evaluar esta mitigación más a fondo utilizando nuestra heurística de sesgo basada en palabras clave. Para medir las frecuencias de las palabras clave teniendo en cuenta nuestro nuevo esquema de ponderación, simplemente podemos ponderar cada instancia de una palabra clave en el conjunto de datos filtrado por el peso de la muestra que la contiene. Al hacer esto, obtenemos un nuevo conjunto de frecuencias de palabras clave que reflejan los pesos de muestra en el conjunto de datos filtrado.

En la mayoría de las palabras clave que verificamos, el esquema de reponderación redujo el cambio de frecuencia inducido por el filtrado. Para nuestros ejemplos anteriores de "hombre" y "mujer", las reducciones de frecuencia relativa se convirtieron en 1 % y -1 %, mientras que sus valores anteriores fueron 14 % y 6 %, respectivamente. Si bien esta métrica es solo un indicador del sesgo de filtrado real, es tranquilizador que nuestro esquema de reponderación basado en imágenes en realidad mejore una métrica basada en texto de manera tan significativa.

Continuamos investigando los sesgos restantes en DALL·E 2, en parte a través de evaluaciones más amplias del comportamiento del modelo e investigaciones sobre cómo el filtrado impactó el sesgo y el desarrollo de capacidades.

Prevención de la regurgitación de imágenes

Observamos que nuestros predecesores internos de DALL·E 2 a veces reproducían imágenes de entrenamiento palabra por palabra. Este comportamiento no era deseable, ya que nos gustaría que DALL·E 2 creara imágenes únicas y originales de forma predeterminada y no simplemente "unir" piezas de imágenes existentes. Además, reproducir imágenes de capacitación palabra por palabra puede plantear cuestiones legales sobre la infracción de los derechos de autor, la propiedad y la privacidad (si las fotos de las personas estuvieran presentes en los datos de capacitación).

Para comprender mejor el problema de la regurgitación de imágenes, recopilamos un conjunto de datos de indicaciones que con frecuencia resultaron en imágenes duplicadas. Para hacer esto, usamos un modelo entrenado para muestrear imágenes para 50,000 50 indicaciones de nuestro conjunto de datos de entrenamiento y clasificamos las muestras por similitud perceptiva con la imagen de entrenamiento correspondiente. Finalmente, inspeccionamos las principales coincidencias a mano y encontramos solo unos pocos cientos de pares duplicados verdaderos de los 1 0 avisos totales. Aunque la tasa de regurgitación parecía ser inferior al XNUMX %, consideramos que era necesario reducir la tasa a XNUMX por las razones expuestas anteriormente.

Cuando estudiamos nuestro conjunto de datos de imágenes regurgitadas, notamos dos patrones. Primero, las imágenes eran casi todas gráficos vectoriales simples, que probablemente eran fáciles de memorizar debido a su bajo contenido de información. En segundo lugar, y lo que es más importante, todas las imágenes tenían muchos casi duplicados en el conjunto de datos de entrenamiento. Por ejemplo, podría haber un gráfico vectorial que se parece a un reloj que muestra la hora 1 en punto, pero luego descubriríamos una muestra de entrenamiento que contiene el mismo reloj que muestra las 2 en punto, y luego las 3 en punto, etc. Una vez nos dimos cuenta de esto, utilizamos una búsqueda distribuida de vecinos más cercanos para verificar que, de hecho, todas las imágenes regurgitadas tenían duplicados perceptivamente similares en el conjunto de datos. Otro funciona han observado un fenómeno similar en grandes modelos de lenguaje, encontrando que la duplicación de datos está fuertemente ligada a la memorización.

El hallazgo anterior sugirió que, si deduplicamos nuestro conjunto de datos, podríamos resolver el problema de la regurgitación. Para lograr esto, planeamos usar una red neuronal para identificar grupos de imágenes que se parecían y luego eliminar todas menos una imagen de cada grupo.[ 2 ] Sin embargo, esto requeriría verificar, para cada imagen, si es un duplicado de cualquier otra imagen en el conjunto de datos. Dado que todo nuestro conjunto de datos contiene cientos de millones de imágenes, ingenuamente necesitaríamos verificar cientos de billones de pares de imágenes para encontrar todos los duplicados. Si bien esto está técnicamente al alcance, especialmente en un clúster de cómputo grande, encontramos una alternativa mucho más eficiente que funciona casi igual de bien a una pequeña fracción del costo.

Considere lo que sucede si agrupamos nuestro conjunto de datos antes de realizar la deduplicación. Dado que las muestras cercanas a menudo caen en el mismo grupo, la mayoría de los pares duplicados no cruzarían los límites de decisión del grupo. Luego, podríamos deduplicar las muestras dentro de cada grupo sin buscar duplicados fuera del grupo, mientras solo perdemos una pequeña fracción de todos los pares duplicados. Esto es mucho más rápido que el enfoque ingenuo, ya que ya no tenemos que verificar cada par de imágenes.[ 3 ] Cuando probamos este enfoque empíricamente en un pequeño subconjunto de nuestros datos, encontró el 85% de todos los pares duplicados al usar K = 1024 racimos

Para mejorar la tasa de éxito del algoritmo anterior, aprovechamos una observación clave: cuando se agrupan diferentes subconjuntos aleatorios de un conjunto de datos, los límites de decisión de la agrupación resultante suelen ser bastante diferentes. Por lo tanto, si un par duplicado cruza un límite de clúster para un agrupamiento de datos, el mismo par podría caer dentro de un solo clúster en un agrupamiento diferente. Cuantas más agrupaciones intente, más probable será que descubra un par duplicado determinado. En la práctica, nos decidimos por cinco clusterings, lo que significa que buscamos duplicados de cada imagen en la unión de cinco clusters diferentes. En la práctica, esto encontró el 97 % de todos los pares duplicados en un subconjunto de nuestros datos.

Sorprendentemente, casi una cuarta parte de nuestro conjunto de datos se eliminó mediante deduplicación. Cuando observamos los pares casi duplicados que se encontraron, muchos de ellos incluían cambios significativos. Recuerde el ejemplo del reloj de arriba: el conjunto de datos puede incluir muchas imágenes del mismo reloj en diferentes momentos del día. Si bien es probable que estas imágenes hagan que el modelo memorice la apariencia de este reloj en particular, también pueden ayudar al modelo a aprender a distinguir entre las horas del día en un reloj. Dada la cantidad de datos que se eliminaron, nos preocupaba que la eliminación de imágenes como esta pudiera haber afectado el rendimiento del modelo.

Para probar el efecto de la deduplicación en nuestros modelos, entrenamos dos modelos con hiperparámetros idénticos: uno en el conjunto de datos completo y otro en la versión deduplicada del conjunto de datos. Para comparar los modelos, usamos las mismas evaluaciones humanas que usamos para evaluar nuestro modelo GLIDE original. Sorprendentemente, encontramos que los evaluadores humanos ligeramente preferido el modelo se entrenó con datos deduplicados, lo que sugiere que la gran cantidad de imágenes redundantes en el conjunto de datos en realidad estaba perjudicando el rendimiento.

Una vez que tuvimos un modelo entrenado con datos deduplicados, volvimos a ejecutar la búsqueda de regurgitación que habíamos realizado anteriormente con más de 50 50 indicaciones del conjunto de datos de entrenamiento. Descubrimos que el nuevo modelo nunca regurgitó una imagen de entrenamiento cuando se le dio el aviso exacto para la imagen del conjunto de datos de entrenamiento. Para llevar esta prueba un paso más allá, también realizamos una búsqueda de vecinos más cercanos en todo el conjunto de datos de entrenamiento para cada una de las XNUMXk imágenes generadas. De esta manera, pensamos que podríamos atrapar al modelo regurgitando una imagen diferente a la asociada con un aviso dado. Incluso con esta verificación más exhaustiva, nunca encontramos un caso de regurgitación de imágenes.

Siguientes Pasos

Si bien todas las mitigaciones discutidas anteriormente representan un progreso significativo hacia nuestra meta de reducir los riesgos asociados con DALL·E 2, cada mitigación aún tiene espacio para mejorar:

- Mejores filtros de preentrenamiento podrían permitirnos entrenar DALL·E 2 con más datos y potencialmente reducir aún más el sesgo en el modelo. Nuestros filtros actuales están ajustados para una baja tasa de fallas a costa de muchos falsos positivos. Como resultado, filtramos aproximadamente el 5 % de todo nuestro conjunto de datos, aunque la mayoría de estas imágenes filtradas no infringen en absoluto nuestra política de contenido. Mejorar nuestros filtros podría permitirnos recuperar algunos de estos datos de entrenamiento.

- El sesgo se introduce y se amplifica potencialmente en muchas etapas del desarrollo y la implementación del sistema. Evaluar y mitigar el sesgo en sistemas como DALL·E 2 y el daño inducido por este sesgo es un problema interdisciplinario importante que seguimos estudiando en OpenAI como parte de nuestra misión más amplia. Nuestro trabajo en esto incluye la creación de evaluaciones para comprender mejor el problema, la selección de nuevos conjuntos de datos y la aplicación de técnicas como la retroalimentación humana y el ajuste para crear tecnologías más sólidas y representativas.

- También es crucial que sigamos estudiando la memorización y la generalización en los sistemas de aprendizaje profundo. Si bien la deduplicación es un buen primer paso para evitar la memorización, no nos dice todo lo que hay que aprender sobre por qué o cómo modelos como DALL·E 2 memorizan datos de entrenamiento.

- 000

- 2019

- a

- Nuestra Empresa

- Mi Cuenta

- Lograr

- a través de

- lector activo

- dirección

- afectando

- algoritmo

- Todos

- Permitir

- permite

- ya haya utilizado

- alternativa

- hacerlo

- cantidad

- Otra

- Aparecido

- aplicada

- La aplicación de

- enfoque

- en torno a

- asigna

- asociado

- las ventas

- porque

- antes

- "Ser"

- mejores

- entre

- Más allá de

- build

- Construir la

- capacidades

- subtítulos

- case

- cases

- lucha

- Categoría

- causado

- a ciertos

- el cambio

- comprobación

- Elige

- clase

- clasificación

- clasificado

- Reloj

- --

- en comparación con

- Calcular

- informática

- concepto

- Considerar

- contiene

- contenido

- contextos

- continue

- derechos de autor,

- infracción de derechos de autor

- Correspondiente

- podría

- Para crear

- creado

- Creamos

- crucial

- Current

- En la actualidad

- datos

- día

- Días

- Koops

- profundo

- Demografía

- despliegue

- describir

- A pesar de las

- Desarrollo

- una experiencia diferente

- difícil

- directamente

- descrubrir

- descubierto CRISPR

- distancia

- distribuidos

- DE INSCRIPCIÓN

- duplicados

- durante

- cada una

- efecto

- de manera eficaz

- eficacia

- los efectos

- eficiente

- esfuerzos

- alentador

- especialmente

- esencialmente

- estimación

- etc.

- evaluar

- todo

- ejemplo

- ejemplos

- exclusivamente

- existente

- esperar

- esperado

- más rápida

- Feature

- Caracteristicas

- realimentación

- Figura

- filtración

- filtros

- Finalmente

- la búsqueda de

- Nombre

- Fijar

- se centra

- siguiente

- encontrado

- en

- ser completados

- función

- promover

- reunión

- Género

- General

- en general

- generar

- generado

- generación de AHSS

- generaciones

- generativo

- objetivo

- candidato

- GPU

- gráficos

- Grupo procesos

- Grupo

- garantia

- puñado

- ayuda

- ayuda

- esta página

- Alta

- Cómo

- Sin embargo

- HTTPS

- humana

- Humanos

- Cientos

- idea

- Identifique

- imagen

- imágenes

- implementación

- implementado

- importante

- mejorar

- mejorado

- la mejora de

- incluir

- incluido

- incluye

- Incluye

- información

- EN LA MINA

- ejemplo

- Internet

- investigar

- IT

- sí mismo

- Clave

- Label

- etiquetado

- Etiquetas

- idioma

- large

- mayores

- APRENDE:

- aprendido

- aprendizaje

- Legal

- que otros

- Mira

- miró

- para lograr

- marca

- Match

- significativo

- significa

- medir

- medición

- Hombre

- podría

- Militares

- millones

- Misión

- modelo

- modelos

- más,

- MEJOR DE TU

- multiplicando

- Naturaleza

- necesario

- negativas

- del sistema,

- número

- solicite

- Organizado

- reconocida por

- Otro

- propiedad

- parte

- particular

- actuación

- realizar

- fase

- piezas

- planificado

- política

- positivo

- posible

- posible

- poderoso

- predecir

- predicción

- presente

- la prevención

- anterior

- política de privacidad

- sonda

- Problema

- producir

- producido

- protesta

- apoderado

- Trimestre

- aumento

- en comunicarse

- realizado

- razones

- reducir

- Reducción

- la reducción de

- reflejar

- reflexión

- restante

- la eliminación de

- representar

- representación

- representante

- solicitudes

- exigir

- requiere

- respuesta

- resultante

- volvemos

- riesgos

- Ejecutar

- mismo

- Escala

- esquema

- Buscar

- set

- formas

- Compartir

- Turno

- importante

- similares

- sencillos

- desde

- soltero

- Tamaño

- chica

- So

- RESOLVER

- algo

- algo

- Espacio

- especial

- específicamente

- especificación

- escisiones

- etapas

- comienzo

- dijo

- Sin embargo

- ESTUDIO

- comercial

- te

- Todas las funciones a su disposición

- toma

- técnicas

- Tecnologías

- test

- El

- por lo tanto

- cosas

- a fondo

- Tres

- umbral

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- equipo

- veces

- del IRS

- parte superior

- hacia

- Entrenar

- Formación

- entender

- unión

- único

- us

- utilizan el

- validación

- diversos

- verificar

- versión

- deseado

- ¿

- sean

- mientras

- dentro de

- sin

- Mujeres

- Actividades:

- funciona

- preocupado

- se

- X