La diarioización del hablante, un proceso esencial en el análisis de audio, segmenta un archivo de audio según la identidad del hablante. Esta publicación profundiza en la integración de PyAnnote de Hugging Face para la diarioización de oradores con Amazon SageMaker puntos finales asincrónicos.

Proporcionamos una guía completa sobre cómo implementar soluciones de segmentación y agrupación de altavoces utilizando SageMaker en la nube de AWS. Puede utilizar esta solución para aplicaciones que tratan con grabaciones de audio de varios altavoces (más de 100).

Resumen de la solución

Amazon Transcribe es el servicio de referencia para la registro de oradores en AWS. Sin embargo, para idiomas no compatibles, puede utilizar otros modelos (en nuestro caso, PyAnnote) que se implementarán en SageMaker para realizar inferencias. Para archivos de audio cortos donde la inferencia tarda hasta 60 segundos, puede utilizar inferencia en tiempo real. Durante más de 60 segundos, asincrónico Se debe utilizar la inferencia. El beneficio adicional de la inferencia asincrónica es el ahorro de costos al escalar automáticamente el recuento de instancias a cero cuando no hay solicitudes para procesar.

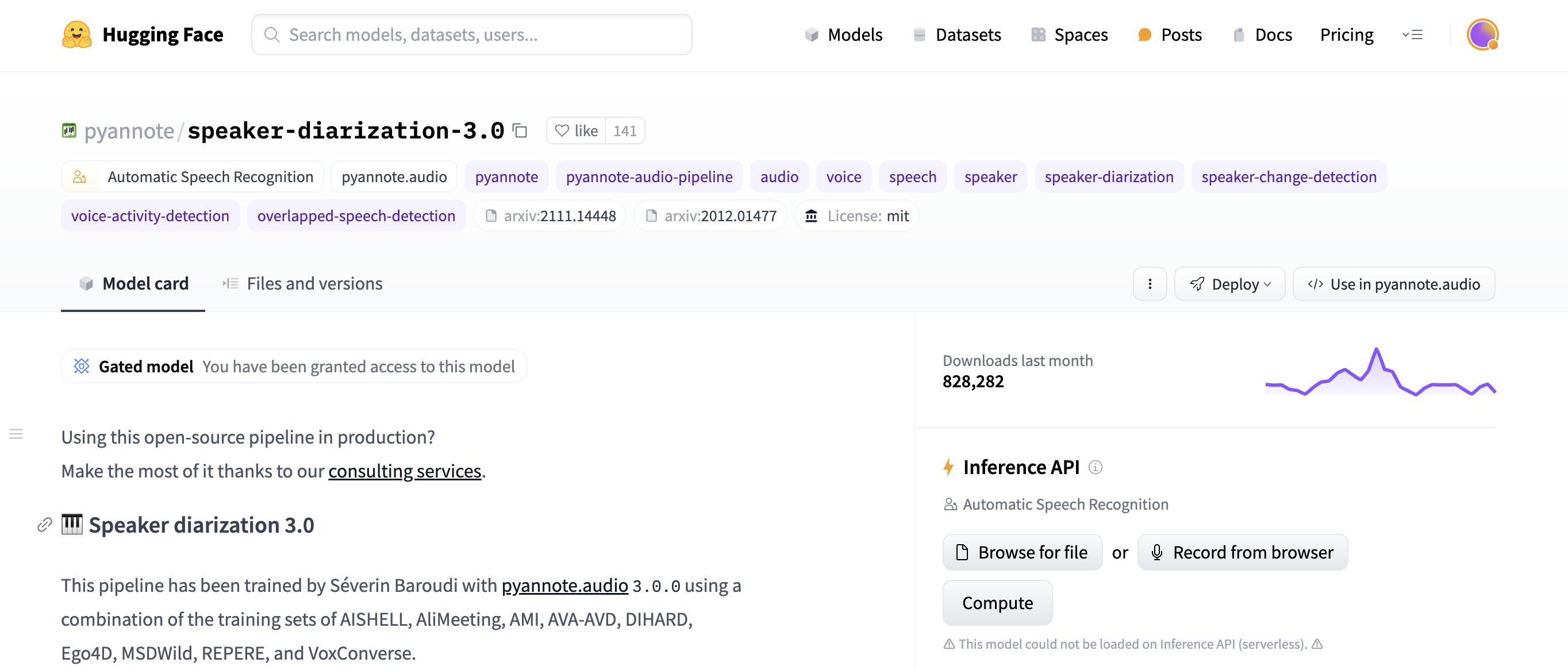

Abrazando la cara es un popular centro de código abierto para modelos de aprendizaje automático (ML). AWS y Hugging Face tienen una asociación que permite una integración perfecta a través de SageMaker con un conjunto de contenedores de aprendizaje profundo (DLC) de AWS para entrenamiento e inferencia en PyTorch o TensorFlow, y estimadores y predictores de Hugging Face para el SDK de Python de SageMaker. Las características y capacidades de SageMaker ayudan a los desarrolladores y científicos de datos a comenzar con el procesamiento del lenguaje natural (NLP) en AWS con facilidad.

La integración de esta solución implica el uso del modelo de registro de oradores previamente entrenado de Hugging Face utilizando el Biblioteca PyAnnote. PyAnnote es un conjunto de herramientas de código abierto escrito en Python para la registro de oradores. Este modelo, entrenado en el conjunto de datos de audio de muestra, permite una partición eficaz de los altavoces en archivos de audio. El modelo se implementa en SageMaker como una configuración de punto final asíncrona, lo que proporciona un procesamiento eficiente y escalable de las tareas de registro.

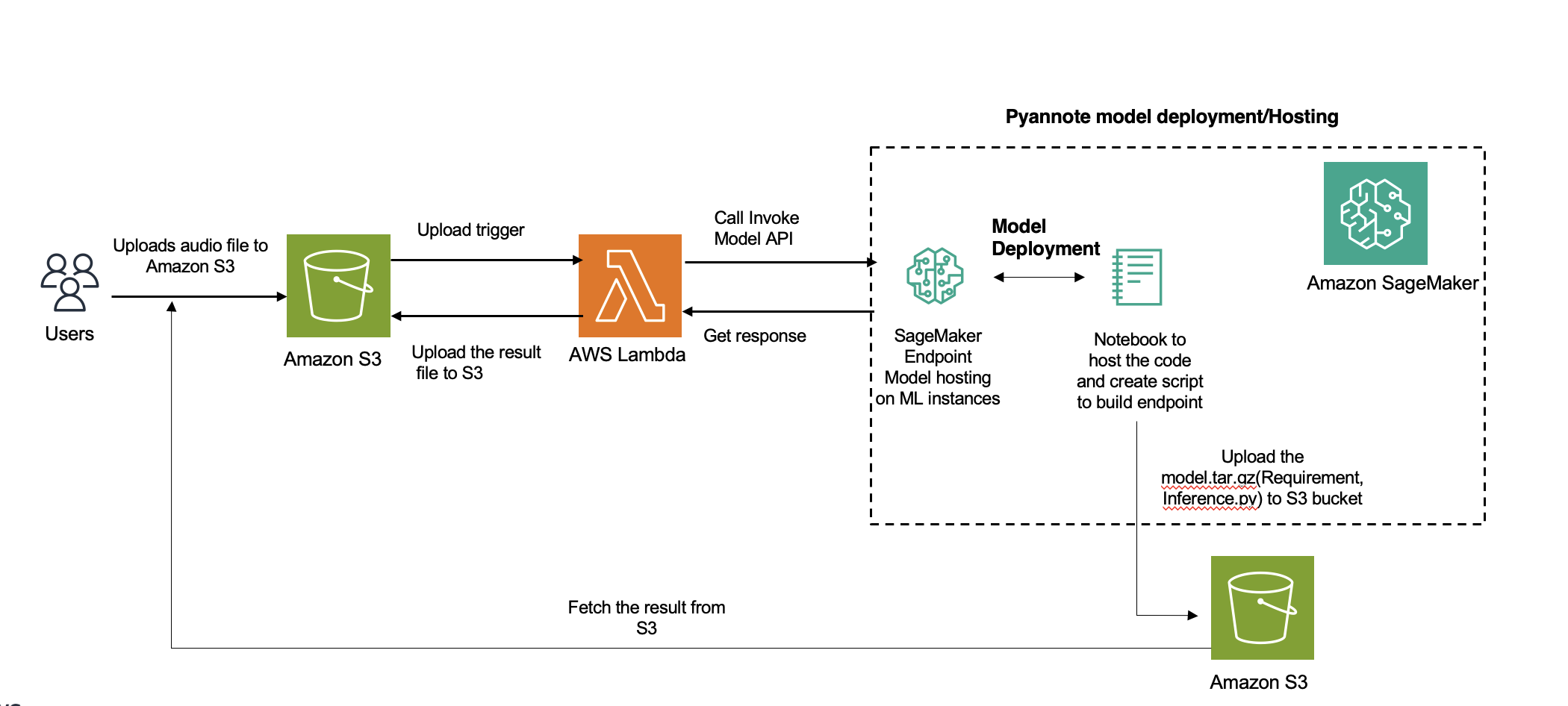

El siguiente diagrama ilustra la arquitectura de la solución.

Para esta publicación, utilizamos el siguiente archivo de audio.

Los archivos de audio estéreo o multicanal se mezclan automáticamente a mono promediando los canales. Los archivos de audio muestreados a una velocidad diferente se vuelven a muestrear a 16 kHz automáticamente al cargarlos.

Requisitos previos

Complete los siguientes requisitos previos:

- Crear un dominio SageMaker.

- Asegúrate de que tu Gestión de identidades y accesos de AWS (IAM) el usuario tiene los permisos de acceso necesarios para crear un Rol de SageMaker.

- Asegúrese de que la cuenta de AWS tenga una cuota de servicio para alojar un punto final de SageMaker para una instancia ml.g5.2xlarge.

Cree una función modelo para acceder a la bitácora de oradores de PyAnnote desde Hugging Face

Puede utilizar Hugging Face Hub para acceder a los elementos previamente entrenados que desee. Modelo de registro de oradores de PyAnnote. Utilice el mismo script para descargar el archivo del modelo al crear el punto final de SageMaker.

Ver el siguiente código:

Empaquetar el código del modelo

Prepare archivos esenciales como inference.py, que contiene el código de inferencia:

Prepara un requirements.txt archivo, que contiene las bibliotecas de Python necesarias para ejecutar la inferencia:

Por último, comprimir el inference.py y requisitos.txt y guárdelo como model.tar.gz:

Configurar un modelo de SageMaker

Defina un recurso de modelo de SageMaker especificando el URI de la imagen y la ubicación de los datos del modelo en Servicio de almacenamiento simple de Amazon (S3) y función de SageMaker:

Sube el modelo a Amazon S3

Cargue el archivo comprimido del modelo PyAnnote Hugging Face en un depósito S3:

Cree un punto final asincrónico de SageMaker

Configure un punto final asincrónico para implementar el modelo en SageMaker utilizando la configuración de inferencia asincrónica proporcionada:

Probar el punto final

Evalúe la funcionalidad del endpoint enviando un archivo de audio para su registro y recuperando la salida JSON almacenada en la ruta de salida S3 especificada:

Para implementar esta solución a escala, sugerimos utilizar AWS Lambda, Servicio de notificación simple de Amazon (Amazon SNS), o Servicio de cola simple de Amazon (Amazon SQS). Estos servicios están diseñados para brindar escalabilidad, arquitecturas basadas en eventos y utilización eficiente de recursos. Pueden ayudar a desacoplar el proceso de inferencia asincrónica del procesamiento de resultados, lo que le permite escalar cada componente de forma independiente y manejar ráfagas de solicitudes de inferencia de manera más efectiva.

Resultados

La salida del modelo se almacena en s3://sagemaker-xxxx /async_inference/output/. El resultado muestra que la grabación de audio se ha segmentado en tres columnas:

- Inicio (hora de inicio en segundos)

- Fin (hora de finalización en segundos)

- Altavoz (etiqueta de altavoz)

El siguiente código muestra un ejemplo de nuestros resultados:

Limpiar

Puede establecer una política de escalado en cero estableciendo MinCapacity en 0; inferencia asíncrona le permite escalar automáticamente a cero sin solicitudes. No es necesario eliminar el punto final, ya que escamas desde cero cuando sea necesario nuevamente, reduciendo los costos cuando no esté en uso. Vea el siguiente código:

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/deploy-a-hugging-face-pyannote-speaker-diarization-model-on-amazon-sagemaker-as-an-asynchronous-endpoint/

- :posee

- :es

- :no

- :dónde

- $ UP

- 1

- 10

- 100

- 11

- 118

- 12

- 13

- 14

- 16

- 17

- 23

- 25

- 26%

- 27

- 28

- 31

- 60

- 7

- 8

- 9

- a

- Nuestra Empresa

- de la máquina

- el acceso

- servicial

- Mi Cuenta

- a través de

- add

- adicional

- ajusta

- avanzado

- de nuevo

- AI

- Servicios de IA

- AI / ML

- Permitir

- permite

- también

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- análisis

- Analytics

- y

- cualquier

- Aplicación

- aplicaciones

- enfoque

- arquitectura

- arquitecturas

- somos

- en torno a

- AS

- At

- Los intentos

- audio

- auto

- automáticamente

- promedio

- AWS

- basado

- BE

- esto

- es el beneficio

- beneficios

- entre

- negocios

- by

- PUEDEN

- capacidades

- case

- cases

- Cambios

- canales

- clase

- cliente

- Soluciones

- clustering

- código

- Columnas

- comentarios

- Algunos

- componente

- exhaustivo

- concepto

- competidor

- Configuración

- Contenedores

- contiene

- controles

- Cost

- ahorro de costes

- Precio

- contar

- Para crear

- Creamos

- Clientes

- datos

- tratar

- profundo

- deep learning

- definir

- entregamos

- profundiza

- la demostración

- desplegar

- desplegado

- Desplegando

- Diseño

- diseñado

- deseado

- desarrollado

- Developer

- desarrolladores

- Desarrollo

- diagrama

- una experiencia diferente

- digital

- Transformación Digital

- directorio

- documentos

- No

- Descarga de

- dinamicamente

- cada una

- facilidad

- Eficaz

- de manera eficaz

- eficiente

- eficiente.

- permite

- final

- Punto final

- error

- esencial

- ejemplo

- Excepto

- experience

- explorar

- Cara

- Caracteristicas

- Archive

- archivos

- siguiendo

- formato

- Desde

- función

- a la fatiga

- generativo

- obtener

- conseguir

- GitHub

- guía

- encargarse de

- Tienen

- he

- ayuda

- ayudado

- ayuda

- su

- hosting

- Cómo

- Como Hacer

- Sin embargo

- HTML

- http

- HTTPS

- Bujes

- AbrazandoCara

- Cientos

- Identidad

- if

- ilustra

- imagen

- implementado

- importar

- in

- independientemente

- India

- ejemplo

- Integración

- integración

- dentro

- implica

- IT

- jpg

- json

- Clave

- Label

- idioma

- Idiomas

- large

- lanzamiento

- aprendizaje

- Permíteme

- bibliotecas

- como

- carga

- carga

- Ubicación

- por más tiempo

- máquina

- máquina de aprendizaje

- significa

- ML

- modelo

- modelos

- más,

- múltiples

- Natural

- Procesamiento natural del lenguaje

- necesario

- ¿ Necesita ayuda

- nlp

- no

- Ninguna

- .

- número

- objeto

- of

- Ofertas

- on

- habiertos

- de código abierto

- Optimiza

- or

- OS

- Otro

- nuestros

- salir

- salida

- Más de

- total

- EL DESARROLLADOR

- Los pandas

- parte

- camino

- permisos

- industrial

- plataforma

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- política

- Popular

- Publicación

- alimentado

- Predicciones

- requisitos previos

- tratamiento

- proyecta

- pruebas

- proporcionar

- previsto

- proporciona un

- proporcionando

- público

- poner

- Python

- piñón

- Preguntas

- Rate

- en comunicarse

- en tiempo real

- vea la grabación

- reduce

- la reducción de

- referencias

- región

- registrarte

- confianza

- reemplazar

- que representa

- solicitudes

- Requisitos

- Requisitos

- Recurso

- Recursos

- respuesta

- resultado

- Resultados

- volvemos

- Función

- Ejecutar

- correr

- sabio

- ventas

- mismo

- muestra

- Guardar

- Ahorros

- Escalabilidad

- escalable

- Escala

- la ampliación

- los científicos

- guión

- guiones

- Sdk

- sin costura

- sin problemas

- segundos

- sector

- ver

- segmentación

- segmentos

- enviando

- separación

- de coches

- Servicios

- Sesión

- sesiones

- set

- pólipo

- Configure

- Varios

- Forma

- En Corto

- tienes

- Shows

- sencillos

- soltero

- Software

- Desarrollo de software ad-hoc

- a medida

- Soluciones

- Fuente

- Speaker

- especialista

- soluciones y

- especificado

- especificando

- pasa

- dividido

- comienzo

- fundó

- STORAGE

- almacenados

- sencillo

- Estratégico

- comercial

- sugieren

- seguro

- te

- toma

- tareas

- tecnología

- tensorflow

- que

- esa

- El

- Ahí.

- Estas

- ellos

- así

- miles

- Tres

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- equipo

- a

- hoy

- caja de herramientas

- tema

- antorcha

- entrenado

- Formación

- transformers

- try

- GIRO

- a

- utilizan el

- usado

- Usuario

- usos

- usando

- Variante

- versión

- Videos

- W

- esperar

- quieres

- we

- web

- servicios web

- cuando

- que

- QUIENES

- seguirá

- trabajando

- escrito

- años

- Usted

- tú

- zephyrnet

- cero

Sanjay Tiwary es un arquitecto de soluciones especializado en IA/ML que dedica su tiempo a trabajar con clientes estratégicos para definir los requisitos comerciales, proporcionar sesiones L300 en torno a casos de uso específicos y diseñar aplicaciones y servicios de IA/ML que sean escalables, confiables y eficientes. Ha ayudado a lanzar y escalar el servicio Amazon SageMaker impulsado por AI/ML y ha implementado varias pruebas de concepto utilizando los servicios de Amazon AI. También ha desarrollado la plataforma de análisis avanzado como parte del viaje de transformación digital.

Sanjay Tiwary es un arquitecto de soluciones especializado en IA/ML que dedica su tiempo a trabajar con clientes estratégicos para definir los requisitos comerciales, proporcionar sesiones L300 en torno a casos de uso específicos y diseñar aplicaciones y servicios de IA/ML que sean escalables, confiables y eficientes. Ha ayudado a lanzar y escalar el servicio Amazon SageMaker impulsado por AI/ML y ha implementado varias pruebas de concepto utilizando los servicios de Amazon AI. También ha desarrollado la plataforma de análisis avanzado como parte del viaje de transformación digital. Kiran Challapalli es un desarrollador de negocios de tecnología profunda en el sector público de AWS. Tiene más de 8 años de experiencia en AI/ML y 23 años de experiencia general en ventas y desarrollo de software. Kiran ayuda a las empresas del sector público de toda la India a explorar y cocrear soluciones basadas en la nube que utilizan tecnologías de inteligencia artificial, aprendizaje automático e inteligencia artificial generativa (incluidos modelos de lenguaje de gran tamaño).

Kiran Challapalli es un desarrollador de negocios de tecnología profunda en el sector público de AWS. Tiene más de 8 años de experiencia en AI/ML y 23 años de experiencia general en ventas y desarrollo de software. Kiran ayuda a las empresas del sector público de toda la India a explorar y cocrear soluciones basadas en la nube que utilizan tecnologías de inteligencia artificial, aprendizaje automático e inteligencia artificial generativa (incluidos modelos de lenguaje de gran tamaño).