Clientes de todos los tamaños e industrias están innovando en AWS al incorporar aprendizaje automático (ML) en sus productos y servicios. Los desarrollos recientes en los modelos de IA generativa han acelerado aún más la necesidad de adoptar el aprendizaje automático en todas las industrias. Sin embargo, la implementación de controles de seguridad, privacidad de datos y gobernanza siguen siendo desafíos clave que enfrentan los clientes al implementar cargas de trabajo de aprendizaje automático a escala. Abordar esos desafíos construye el marco y las bases para mitigar el riesgo y el uso responsable de productos impulsados por ML. Aunque la IA generativa puede necesitar controles adicionales, como eliminar la toxicidad y prevenir el jailbreak y las alucinaciones, comparte los mismos componentes fundamentales de seguridad y gobernanza que el ML tradicional.

Escuchamos de los clientes que necesitan conocimientos especializados y una inversión de hasta 12 meses para desarrollar su producto personalizado. Amazon SageMaker Implementación de plataforma de ML para garantizar entornos de ML escalables, confiables, seguros y gobernados para sus líneas de negocio (LOB) o equipos de ML. Si carece de un marco para gobernar el ciclo de vida de ML a escala, puede encontrarse con desafíos como el aislamiento de recursos a nivel de equipo, el escalamiento de recursos de experimentación, la puesta en funcionamiento de los flujos de trabajo de ML, la ampliación de la gobernanza del modelo y la gestión de la seguridad y el cumplimiento de las cargas de trabajo de ML.

Gobernar el ciclo de vida de ML a escala es un marco que le ayudará a crear una plataforma de ML con controles de gobernanza y seguridad integrados basados en las mejores prácticas de la industria y los estándares empresariales. Este marco aborda los desafíos proporcionando orientación prescriptiva a través de un enfoque de marco modular que amplía una Torre de control de AWS Entorno AWS de múltiples cuentas y el enfoque discutido en la publicación Configuración de entornos de aprendizaje automático seguros y bien gobernados en AWS.

Proporciona orientación prescriptiva para las siguientes funciones de la plataforma ML:

- Fundamentos de múltiples cuentas, seguridad y redes – Esta función utiliza AWS Control Tower y principios bien diseñados para configurar y operar servicios de redes, seguridad y entornos de múltiples cuentas.

- Fundamentos de datos y gobernanza – Esta función utiliza un arquitectura de malla de datos para configurar y operar el lago de datos, el almacén central de funciones y las bases de gobierno de datos para permitir un acceso detallado a los datos.

- Servicios de gobernanza y compartidos de plataforma de aprendizaje automático – Esta función permite configurar y operar servicios comunes como CI/CD, Catálogo de servicios de AWS para entornos de aprovisionamiento y un registro de modelos central para la promoción y el linaje de modelos.

- Entornos de equipo de ML – Esta función permite configurar y operar entornos para equipos de ML para el desarrollo de modelos, pruebas e implementación de sus casos de uso para incorporar controles de seguridad y gobernanza.

- Observabilidad de la plataforma ML – Esta función ayuda a solucionar problemas e identificar la causa raíz de los problemas en los modelos de ML mediante la centralización de registros y proporcionando herramientas para la visualización del análisis de registros. También proporciona orientación para generar informes de uso y costos para casos de uso de ML.

Aunque este marco puede brindar beneficios a todos los clientes, es más beneficioso para los clientes de empresas grandes, maduras, reguladas o globales que desean escalar sus estrategias de ML en un enfoque controlado, compatible y coordinado en toda la organización. Ayuda a permitir la adopción de ML y al mismo tiempo mitiga los riesgos. Este marco es útil para los siguientes clientes:

- Clientes de grandes empresas que tienen muchos LOB o departamentos interesados en utilizar ML. Este marco permite que diferentes equipos creen e implementen modelos de aprendizaje automático de forma independiente, al tiempo que proporciona una gobernanza central.

- Clientes empresariales con una madurez en ML de moderada a alta. Ya han implementado algunos modelos iniciales de ML y buscan ampliar sus esfuerzos de ML. Este marco puede ayudar a acelerar la adopción de ML en toda la organización. Estas empresas también reconocen la necesidad de una gobernanza para gestionar aspectos como el control de acceso, el uso de datos, el rendimiento del modelo y los sesgos injustos.

- Empresas en industrias reguladas como servicios financieros, atención médica, química y el sector privado. Estas empresas necesitan una gobernanza y una audibilidad sólidas para cualquier modelo de aprendizaje automático utilizado en sus procesos comerciales. La adopción de este marco puede ayudar a facilitar el cumplimiento y al mismo tiempo permitir el desarrollo de modelos locales.

- Organizaciones globales que necesitan equilibrar el control centralizado y local. El enfoque federado de este marco permite al equipo de ingeniería de la plataforma central establecer algunas políticas y estándares de alto nivel, pero también brinda a los equipos de LOB flexibilidad para adaptarse en función de las necesidades locales.

En la primera parte de esta serie, analizamos la arquitectura de referencia para configurar la plataforma ML. En una publicación posterior, brindaremos orientación prescriptiva sobre cómo implementar los distintos módulos en la arquitectura de referencia en su organización.

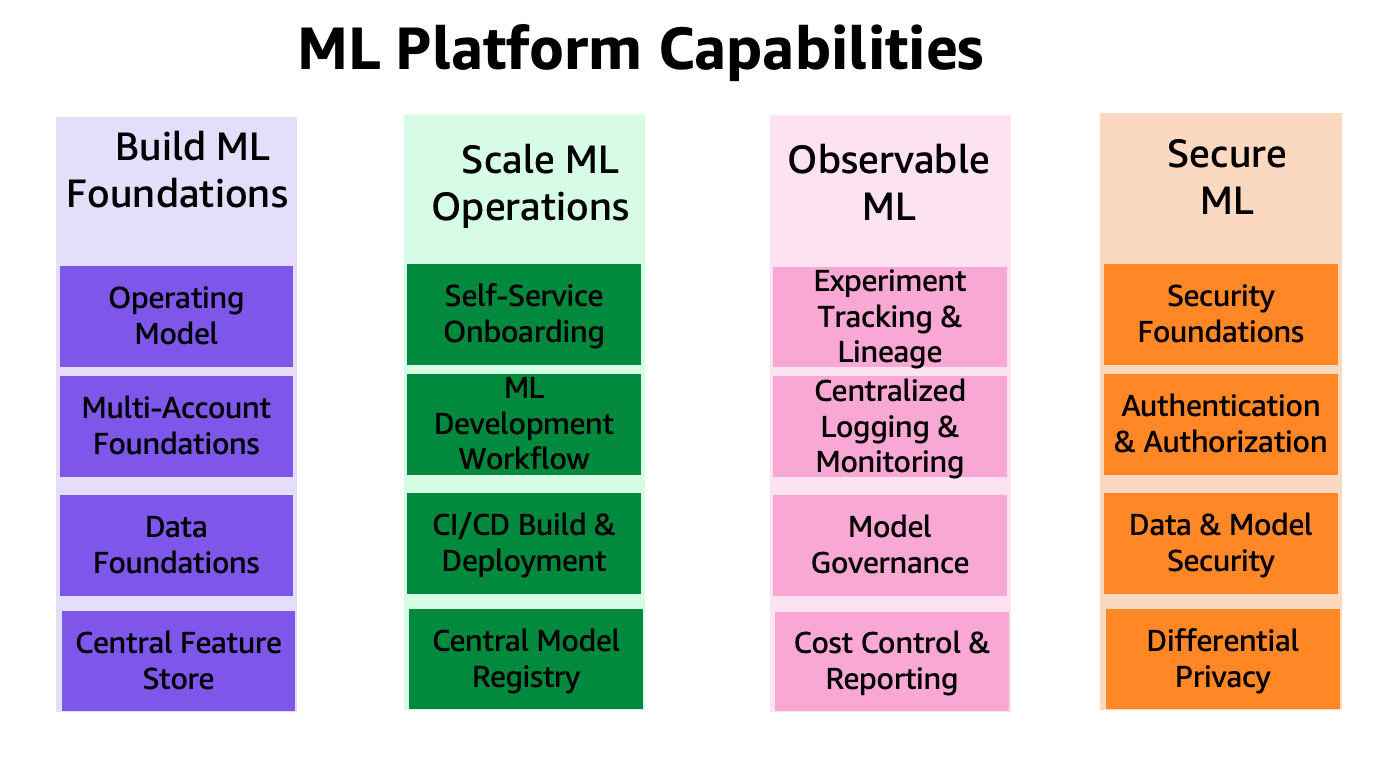

Las capacidades de la plataforma ML se agrupan en cuatro categorías, como se muestra en la siguiente figura. Estas capacidades forman la base de la arquitectura de referencia que se analiza más adelante en esta publicación:

- Construya las bases del aprendizaje automático

- Escalar las operaciones de aprendizaje automático

- AA observable

- Aprendizaje automático seguro

Resumen de la solución

El marco para gobernar el ciclo de vida de ML a escala permite a las organizaciones incorporar controles de seguridad y gobernanza a lo largo del ciclo de vida de ML que a su vez ayudan a las organizaciones a reducir el riesgo y acelerar la incorporación de ML en sus productos y servicios. El marco ayuda a optimizar la configuración y la gobernanza de entornos de aprendizaje automático seguros, escalables y confiables que pueden escalarse para admitir un número cada vez mayor de modelos y proyectos. El marco permite las siguientes características:

- Aprovisionamiento de cuentas e infraestructura con recursos de infraestructura que cumplen con las políticas de la organización

- Implementación de autoservicio de entornos de ciencia de datos y plantillas de operaciones de aprendizaje automático (MLOps) de un extremo a otro para casos de uso de aprendizaje automático

- Aislamiento de recursos a nivel de LOB o de equipo para el cumplimiento de la seguridad y la privacidad

- Acceso gobernado a datos de nivel de producción para experimentación y flujos de trabajo listos para producción.

- Gestión y gobernanza de repositorios de código, canalizaciones de código, modelos implementados y funciones de datos.

- Un registro de modelos y un almacén de características (componentes locales y centrales) para mejorar la gobernanza

- Controles de seguridad y gobernanza para el proceso de desarrollo e implementación del modelo de un extremo a otro.

En esta sección, proporcionamos una descripción general de la orientación prescriptiva para ayudarlo a construir esta plataforma de aprendizaje automático en AWS con controles de gobernanza y seguridad integrados.

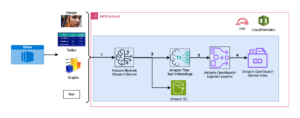

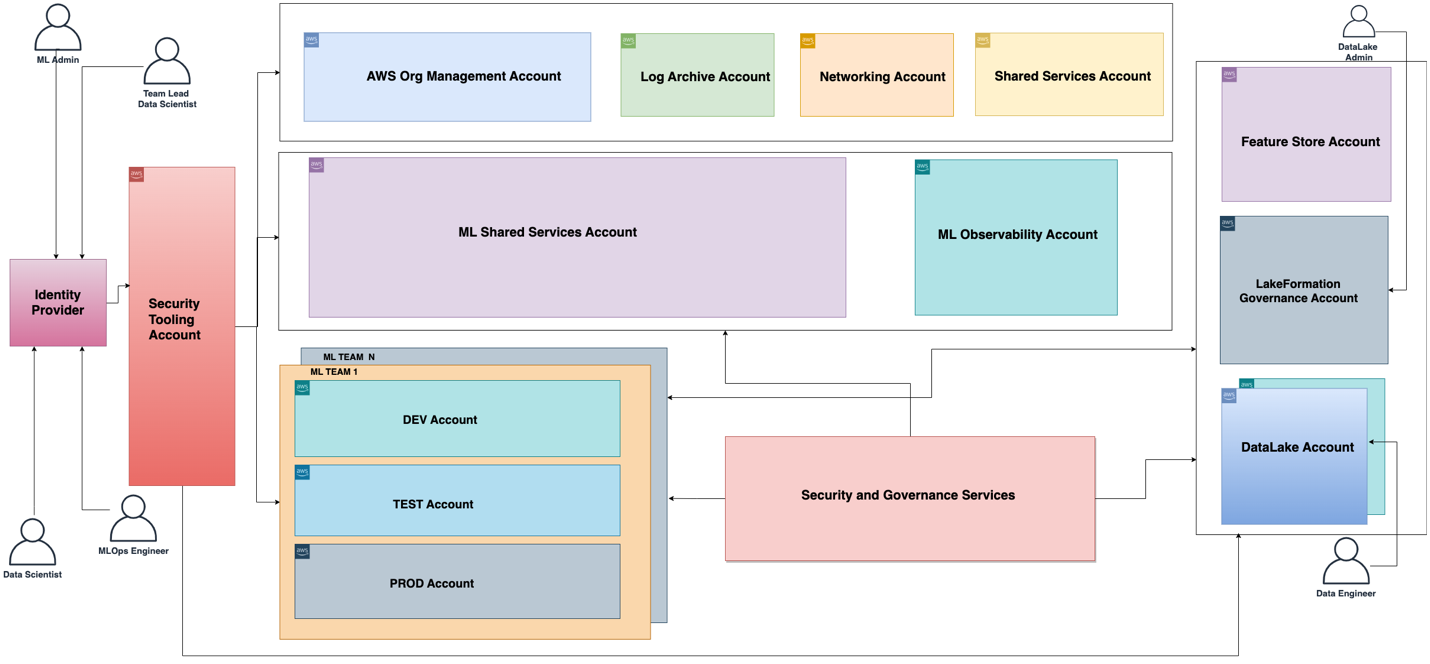

La arquitectura funcional asociada con la plataforma ML se muestra en el siguiente diagrama. La arquitectura asigna las diferentes capacidades de la plataforma ML a las cuentas de AWS.

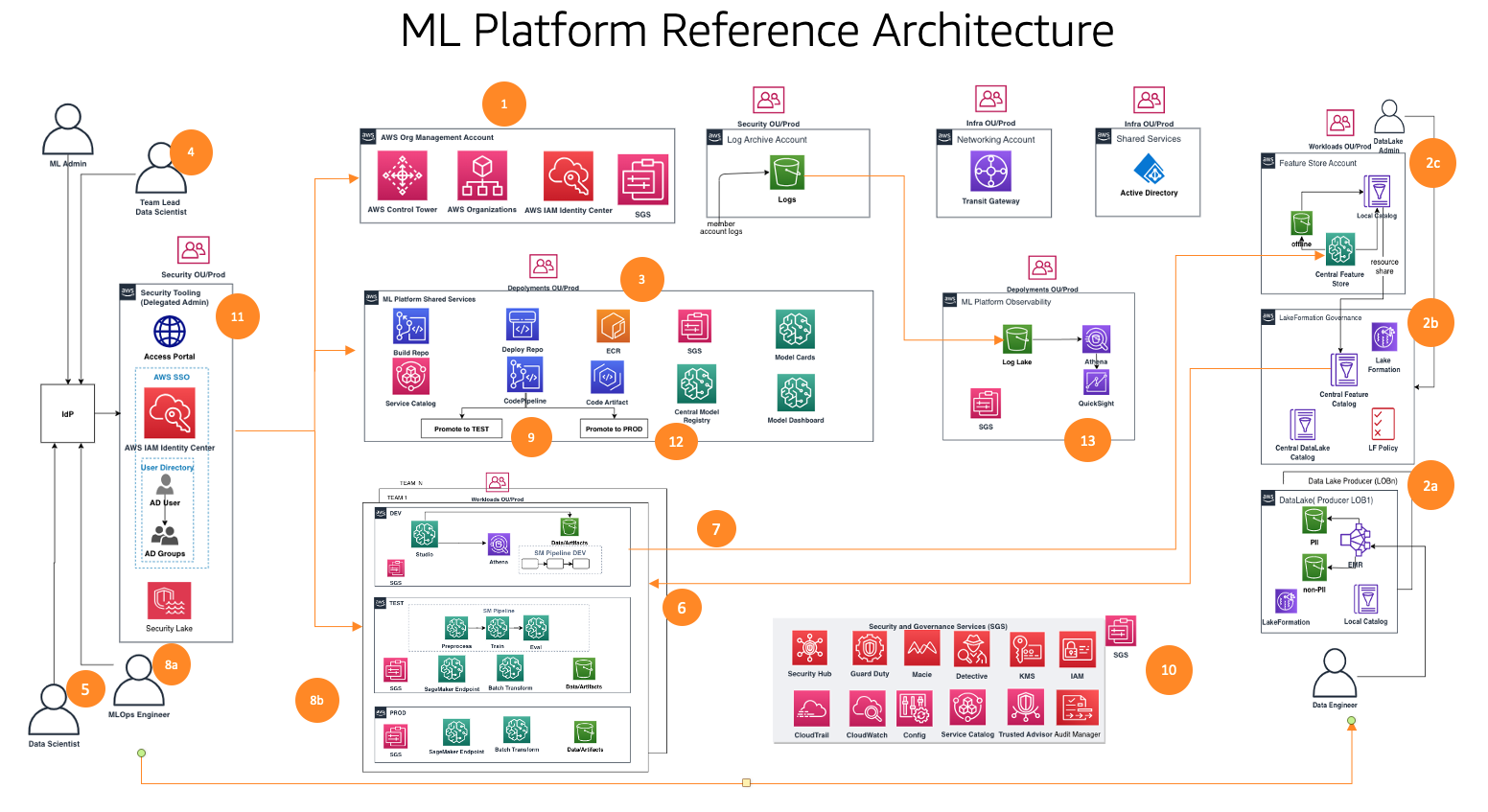

La arquitectura funcional con diferentes capacidades se implementa utilizando una serie de servicios de AWS, incluidos Organizaciones de AWS, SageMaker, servicios AWS DevOps y un lago de datos. La arquitectura de referencia para la plataforma ML con varios servicios de AWS se muestra en el siguiente diagrama.

Este marco considera múltiples personas y servicios para gobernar el ciclo de vida del aprendizaje automático a escala. Recomendamos los siguientes pasos para organizar sus equipos y servicios:

- Con AWS Control Tower y las herramientas de automatización, su administrador de la nube configura las bases de múltiples cuentas, como Organizaciones y Centro de identidad de AWS IAM (sucesor de AWS Single Sign-On) y servicios de seguridad y gobernanza como Servicio de administración de claves de AWS (AWS KMS) y Catálogo de servicios. Además, el administrador configura una variedad de unidades organizativas (OU) y cuentas iniciales para respaldar sus flujos de trabajo de análisis y aprendizaje automático.

- Los administradores del lago de datos configuran su lago de datos y su catálogo de datos, y configuran el almacén de funciones central trabajando con el administrador de la plataforma ML.

- El administrador de la plataforma ML proporciona servicios compartidos de ML, como Compromiso de código de AWS, AWS CodePipeline, Registro de contenedores elásticos de Amazon (Amazon ECR), un registro de modelo central, Tarjetas modelo de SageMaker, Panel de modelos de SageMakery productos del catálogo de servicios para equipos de aprendizaje automático.

- El líder del equipo de ML se federa a través de IAM Identity Center, utiliza productos del catálogo de servicios y aprovisiona recursos en el entorno de desarrollo del equipo de ML.

- Los científicos de datos de los equipos de ML de diferentes unidades de negocio se federan en el entorno de desarrollo de su equipo para crear el canal del modelo.

- Los científicos de datos buscan y extraen funciones del catálogo de la tienda de funciones central, crean modelos mediante experimentos y seleccionan el mejor modelo para promocionarlo.

- Los científicos de datos crean y comparten nuevas funciones en el catálogo de la tienda de funciones central para su reutilización.

- Un ingeniero de ML implementa la canalización del modelo en el entorno de prueba del equipo de ML mediante un proceso de CI/CD de servicios compartidos.

- Después de la validación de las partes interesadas, el modelo ML se implementa en el entorno de producción del equipo.

- Los controles de seguridad y gobernanza están integrados en cada capa de esta arquitectura utilizando servicios como Centro de seguridad de AWS, Servicio de guardia de Amazon, Amazonas Macie, y más.

- Los controles de seguridad se administran de forma centralizada desde la cuenta de herramientas de seguridad mediante Security Hub.

- Las capacidades de gobernanza de la plataforma ML, como SageMaker Model Cards y SageMaker Model Dashboard, se administran de forma centralizada desde la cuenta de servicios de gobernanza.

- Reloj en la nube de Amazon y Seguimiento de la nube de AWS Se puede acceder a los registros de cada cuenta de miembro de forma centralizada desde una cuenta de observabilidad mediante servicios nativos de AWS.

A continuación, profundizamos en los módulos de la arquitectura de referencia para este marco.

Módulos de arquitectura de referencia.

La arquitectura de referencia consta de ocho módulos, cada uno diseñado para resolver un conjunto específico de problemas. En conjunto, estos módulos abordan la gobernanza en varias dimensiones, como infraestructura, datos, modelo y costo. Cada módulo ofrece un conjunto distinto de funciones e interopera con otros módulos para proporcionar una plataforma de aprendizaje automático integrada de extremo a extremo con controles de gobernanza y seguridad integrados. En esta sección, presentamos un breve resumen de las capacidades de cada módulo.

Fundaciones multicuenta

Este módulo ayuda a los administradores de la nube a crear una Zona de aterrizaje de la torre de control de AWS como marco fundacional. Esto incluye la creación de una estructura de múltiples cuentas, autenticación y autorización a través de IAM Identity Center, un diseño radial de red, servicios de registro centralizados y nuevas cuentas de miembros de AWS con bases de seguridad y gobernanza estandarizadas.

Además, este módulo brinda orientación sobre las mejores prácticas sobre unidades organizativas y estructuras de cuentas que son apropiadas para respaldar sus flujos de trabajo de análisis y aprendizaje automático. Los administradores de la nube comprenderán el propósito de las cuentas y unidades organizativas requeridas, cómo implementarlas y los servicios clave de seguridad y cumplimiento que deben utilizar para gobernar centralmente sus cargas de trabajo de análisis y aprendizaje automático.

También se cubre un marco para vender nuevas cuentas, que utiliza la automatización para establecer una base de referencia para las nuevas cuentas cuando se aprovisionan. Al configurar un proceso automatizado de aprovisionamiento de cuentas, los administradores de la nube pueden proporcionar a los equipos de análisis y aprendizaje automático las cuentas que necesitan para realizar su trabajo más rápidamente, sin sacrificar una base sólida de gobernanza.

Fundamentos del lago de datos

Este módulo ayuda a los administradores del lago de datos a configurar un lago de datos para ingerir datos, seleccionar conjuntos de datos y utilizar el Formación del lago AWS modelo de gobernanza para gestionar el acceso a datos detallado entre cuentas y usuarios mediante un catálogo de datos centralizado, políticas de acceso a datos y controles de acceso basados en etiquetas. Puede comenzar poco a poco con una cuenta para las bases de su plataforma de datos para una prueba de concepto o algunas cargas de trabajo pequeñas. Para la implementación de cargas de trabajo de producción de mediana a gran escala, recomendamos adoptar una estrategia de múltiples cuentas. En tal entorno, los LOB pueden asumir el rol de productores y consumidores de datos utilizando diferentes cuentas de AWS, y la gobernanza del lago de datos se opera desde una cuenta central compartida de AWS. El productor de datos recopila, procesa y almacena datos de su dominio de datos, además de monitorear y garantizar la calidad de sus activos de datos. Los consumidores de datos consumen los datos del productor de datos después de que el catálogo centralizado los comparte mediante Lake Formation. El catálogo centralizado almacena y gestiona el catálogo de datos compartido para las cuentas de productores de datos.

Servicios de plataforma de aprendizaje automático

Este módulo ayuda al equipo de ingeniería de la plataforma ML a configurar servicios compartidos que utilizan los equipos de ciencia de datos en las cuentas de su equipo. Los servicios incluyen un portafolio de Catálogo de Servicios con productos para Dominio de SageMaker despliegue, Perfil de usuario del dominio SageMaker implementación, plantillas de modelos de ciencia de datos para la construcción e implementación de modelos. Este módulo tiene funcionalidades para un registro de modelos centralizado, tarjetas de modelo, panel de modelo y canalizaciones de CI/CD utilizadas para orquestar y automatizar los flujos de trabajo de desarrollo e implementación de modelos.

Además, este módulo detalla cómo implementar los controles y la gobernanza necesarios para habilitar capacidades de autoservicio basadas en personas, lo que permite a los equipos de ciencia de datos implementar de forma independiente la infraestructura de nube y las plantillas de aprendizaje automático necesarias.

Desarrollo de casos de uso de ML

Este módulo ayuda a los LOB y a los científicos de datos a acceder al dominio SageMaker de su equipo en un entorno de desarrollo y crear una instancia de una plantilla de creación de modelos para desarrollar sus modelos. En este módulo, los científicos de datos trabajan en una instancia de cuenta de desarrollo de la plantilla para interactuar con los datos disponibles en el lago de datos centralizado, reutilizar y compartir funciones de un almacén de funciones central, crear y ejecutar experimentos de aprendizaje automático, crear y probar sus flujos de trabajo de aprendizaje automático. y registrar sus modelos en un registro de modelos de cuenta de desarrollo en sus entornos de desarrollo.

En las plantillas también se implementan capacidades como el seguimiento de experimentos, informes de explicabilidad de modelos, monitoreo de sesgos de datos y modelos, y registro de modelos, lo que permite una rápida adaptación de las soluciones a los modelos desarrollados por los científicos de datos.

Operaciones de aprendizaje automático

Este módulo ayuda a los ingenieros de LOB y ML a trabajar en sus instancias de desarrollo de la plantilla de implementación del modelo. Una vez registrado y aprobado el modelo candidato, configuran canalizaciones de CI/CD y ejecutan flujos de trabajo de ML en el entorno de prueba del equipo, que registra el modelo en el registro central de modelos que se ejecuta en una cuenta de servicios compartidos de plataforma. Cuando se aprueba un modelo en el registro de modelos central, se activa una canalización de CI/CD para implementar el modelo en el entorno de producción del equipo.

Tienda de funciones centralizada

Una vez que los primeros modelos se implementan en producción y múltiples casos de uso comienzan a compartir funciones creadas a partir de los mismos datos, un almacén de funciones se vuelve esencial para garantizar la colaboración entre casos de uso y reducir el trabajo duplicado. Este módulo ayuda al equipo de ingeniería de la plataforma ML a configurar un almacén de funciones centralizado para proporcionar almacenamiento y gobernanza para las funciones de ML creadas por los casos de uso de ML, lo que permite la reutilización de funciones en todos los proyectos.

Registro y observabilidad

Este módulo ayuda a los profesionales de LOB y ML a obtener visibilidad del estado de las cargas de trabajo de ML en entornos de ML a través de la centralización de la actividad de registros como CloudTrail, CloudWatch, registros de flujo de VPC y registros de cargas de trabajo de ML. Los equipos pueden filtrar, consultar y visualizar registros para su análisis, lo que también puede ayudar a mejorar la postura de seguridad.

Costo e informes

Este módulo ayuda a varias partes interesadas (administrador de la nube, administrador de la plataforma, oficina comercial de la nube) a generar informes y paneles para desglosar los costos a nivel de usuario de ML, equipo de ML y producto de ML, y realizar un seguimiento del uso, como la cantidad de usuarios, los tipos de instancias y puntos finales.

Los clientes nos han pedido que les brindemos orientación sobre cuántas cuentas crear y cómo estructurarlas. En la siguiente sección, brindamos orientación sobre esa estructura de cuentas como referencia que puede modificar para adaptarla a sus necesidades de acuerdo con los requisitos de gobierno empresarial.

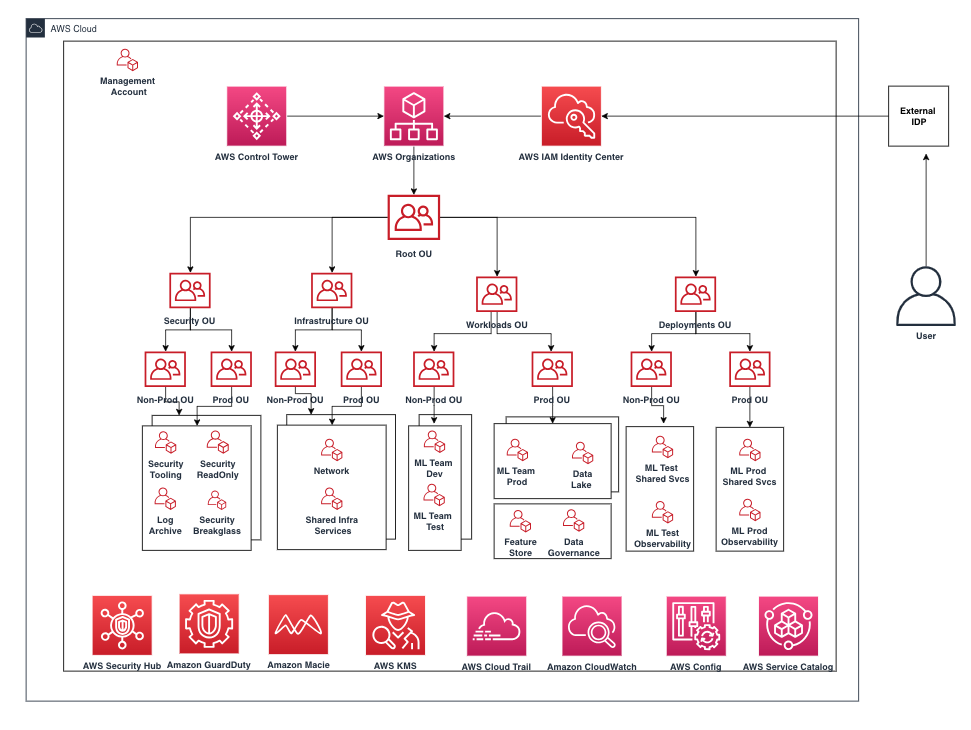

En esta sección, analizamos nuestra recomendación para organizar la estructura de su cuenta. Compartimos una estructura de cuentas de referencia básica; sin embargo, recomendamos que los administradores de datos y aprendizaje automático trabajen estrechamente con su administrador de la nube para personalizar esta estructura de cuenta según los controles de su organización.

Recomendamos organizar las cuentas por unidad organizativa para seguridad, infraestructura, cargas de trabajo e implementaciones. Además, dentro de cada unidad organizativa, organice por unidades organizativas de producción y no producción porque las cuentas y cargas de trabajo implementadas bajo ellas tienen controles diferentes. A continuación, analizamos brevemente esas unidades organizativas.

Unidad organizativa de seguridad

Las cuentas de esta unidad organizativa son administradas por el administrador de la nube o el equipo de seguridad de la organización para monitorear, identificar, proteger, detectar y responder a eventos de seguridad.

Unidad organizativa de infraestructura

Las cuentas en esta unidad organizativa son administradas por el administrador de la nube o el equipo de red de la organización para administrar redes y recursos compartidos de infraestructura a nivel empresarial.

Recomendamos tener las siguientes cuentas en la unidad organizativa de infraestructura:

- Nuestra red – Configurar una infraestructura de red centralizada como Pasarela de tránsito de AWS

- Servicios compartidos – Configurar servicios AD centralizados y puntos finales de VPC

Unidad organizativa de cargas de trabajo

Las cuentas de esta unidad organizativa son administradas por los administradores del equipo de la plataforma de la organización. Si necesita implementar diferentes controles para cada equipo de plataforma, puede anidar otros niveles de unidad organizativa para ese fin, como una unidad organizativa de cargas de trabajo de aprendizaje automático, una unidad organizativa de cargas de trabajo de datos, etc.

Recomendamos las siguientes cuentas en la unidad organizativa de cargas de trabajo:

- Cuentas de desarrollo, prueba y producción de ML a nivel de equipo – Configure esto según los requisitos de aislamiento de su carga de trabajo.

- Cuentas de lago de datos – Partición de cuentas según su dominio de datos

- Cuenta central de gobernanza de datos – Centraliza tus políticas de acceso a datos

- Cuenta de la tienda de funciones centrales – Centralizar funciones para compartir entre equipos

Unidad organizativa de implementaciones

Las cuentas de esta unidad organizativa son administradas por los administradores del equipo de la plataforma de la organización para implementar cargas de trabajo y observabilidad.

Recomendamos las siguientes cuentas en la unidad organizativa de implementaciones porque el equipo de la plataforma de aprendizaje automático puede configurar diferentes conjuntos de controles en este nivel de unidad organizativa para administrar y controlar las implementaciones:

- Cuentas de servicios compartidos de ML para prueba y producción – Plataforma de hosts de servicios compartidos CI/CD y registro de modelos.

- La observabilidad de ML representa pruebas y productos. – Aloja registros de CloudWatch, registros de CloudTrail y otros registros según sea necesario

A continuación, analizamos brevemente los controles de la organización que deben considerarse para integrarse en las cuentas de los miembros para monitorear los recursos de la infraestructura.

Controles del entorno de AWS

Un control es una regla de alto nivel que proporciona una gobernanza continua para su entorno general de AWS. Está expresado en un lenguaje sencillo. En este marco, utilizamos AWS Control Tower para implementar los siguientes controles que le ayudarán a gobernar sus recursos y monitorear el cumplimiento entre grupos de cuentas de AWS:

- Controles preventivos – Un control preventivo garantiza que sus cuentas mantengan el cumplimiento porque no permite acciones que conduzcan a violaciones de políticas y se implementan mediante una Política de control de servicios (SCP). Por ejemplo, puede establecer un control preventivo que garantice que CloudTrail no se elimine ni se detenga en cuentas o regiones de AWS.

- Controles de detectives – Un control de detección detecta el incumplimiento de los recursos dentro de sus cuentas, como violaciones de políticas, proporciona alertas a través del panel y se implementa mediante Configuración de AWS normas. Por ejemplo, puede crear un control de detección para detectar si el acceso público de lectura está habilitado para el Servicio de almacenamiento simple de Amazon (Amazon S3) en la cuenta compartida del archivo de registro.

- Controles proactivos – Un control proactivo escanea sus recursos antes de que se aprovisionen y se asegura de que los recursos cumplan con ese control y se implementen utilizando Formación en la nube de AWS manos. Los recursos que no cumplan con los requisitos no se aprovisionarán. Por ejemplo, puede configurar un control proactivo que verifique que no se permita el acceso directo a Internet para una instancia de notebook de SageMaker.

Interacciones entre servicios de plataforma de ML, casos de uso de ML y operaciones de ML

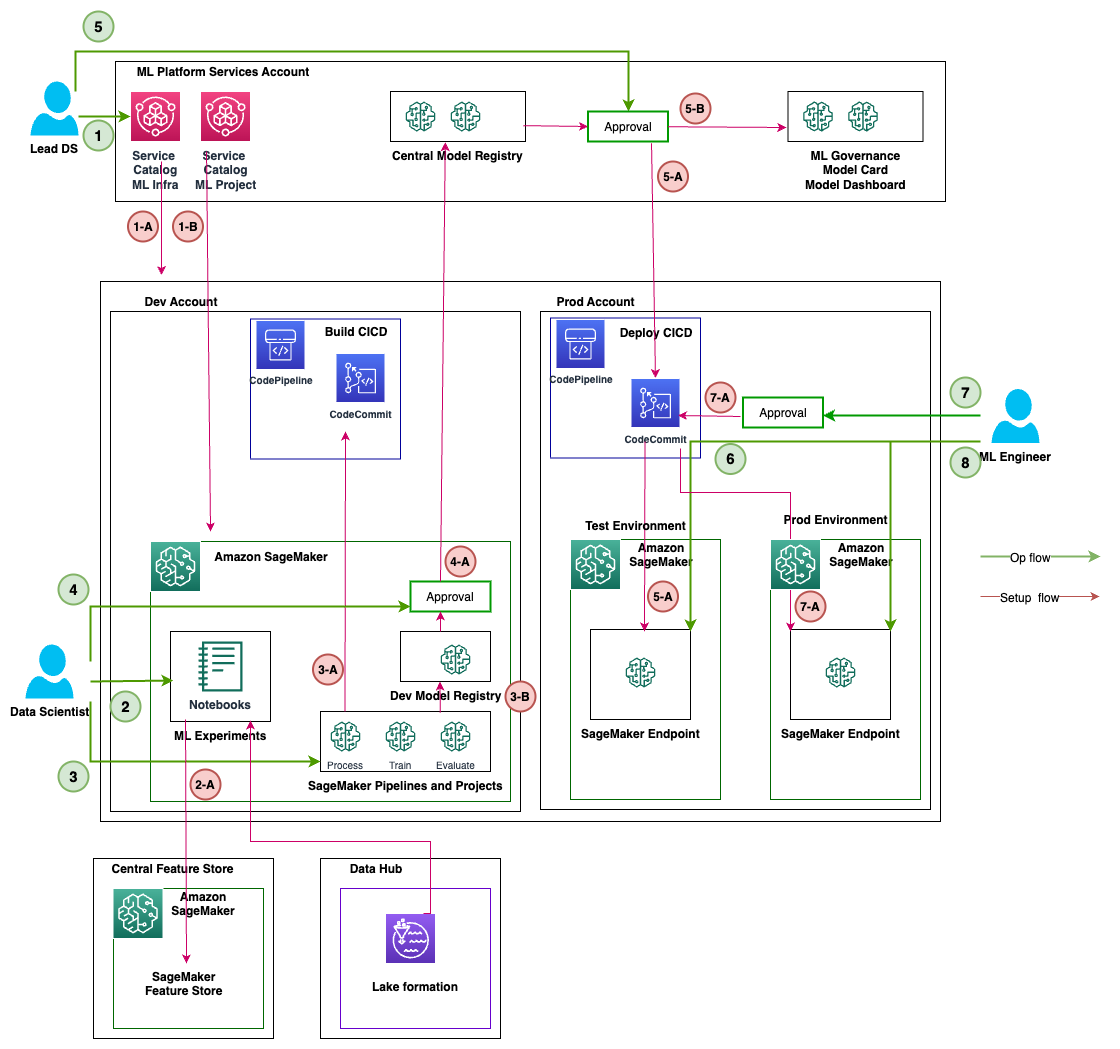

Diferentes personas, como el jefe de ciencia de datos (científico de datos principal), el científico de datos y el ingeniero de ML, operan los módulos 2 a 6 como se muestra en el siguiente diagrama para las diferentes etapas de los servicios de la plataforma de ML, el desarrollo de casos de uso de ML y las operaciones de ML. junto con las bases del lago de datos y el almacén de funciones central.

La siguiente tabla resume la actividad del flujo de operaciones y los pasos del flujo de configuración para diferentes personas. Una vez que una persona inicia una actividad de aprendizaje automático como parte del flujo de operaciones, los servicios se ejecutan como se menciona en los pasos del flujo de configuración.

| Persona | Actividad de flujo de operaciones: número | Actividad de flujo de operaciones: descripción | Paso de flujo de configuración: número | Paso de flujo de configuración: descripción |

| Líder del equipo de ciencia de datos o aprendizaje automático |

1 |

Utiliza Service Catalog en la cuenta de servicios de la plataforma ML e implementa lo siguiente:

|

1-A |

|

|

1-B |

|

|||

| Datos Científico |

2 |

Realiza y rastrea experimentos de aprendizaje automático en cuadernos de SageMaker. |

2-A |

|

|

3 |

Automatiza experimentos de aprendizaje automático exitosos con proyectos y canalizaciones de SageMaker. |

3-A |

|

|

|

3-B |

Después de ejecutar las canalizaciones de SageMaker, guarda el modelo en el registro de modelos local (dev). | |||

| Científico de datos líder o líder del equipo de ML |

4 |

Aprueba el modelo en el registro de modelos local (dev) |

4-A |

Escritura de metadatos del modelo y paquetes de modelo desde el registro de modelo local (dev) al registro de modelo central |

|

5 |

Aprueba el modelo en el registro central de modelos. |

5-A |

Inicia el proceso de implementación de CI/CD para crear puntos finales de SageMaker en el entorno de prueba. | |

|

5-B |

Escribe la información y los metadatos del modelo en el módulo de gobernanza de ML (tarjeta de modelo, panel de modelo) en la cuenta de servicios de la plataforma de ML desde la cuenta local (de desarrollo). | |||

| Ingeniero ML |

6 |

Prueba y monitorea el punto final de SageMaker en el entorno de prueba después de CI/CD | . | |

|

7 |

Aprueba la implementación de puntos finales de SageMaker en el entorno de producción. |

7-A |

Inicia el proceso de implementación de CI/CD para crear puntos finales de SageMaker en el entorno de producción. | |

|

8 |

Prueba y monitorea el punto final de SageMaker en el entorno de prueba después de CI/CD | . | ||

Personas e interacciones con diferentes módulos de la plataforma ML.

Cada módulo está dirigido a personas objetivo particulares dentro de divisiones específicas que utilizan el módulo con mayor frecuencia, otorgándoles acceso principal. Luego se permite el acceso secundario a otras divisiones que requieren el uso ocasional de los módulos. Los módulos se adaptan a las necesidades de roles o personas laborales particulares para optimizar la funcionalidad.

Hablamos de los siguientes equipos:

- Ingeniería de nube central – Este equipo opera a nivel de nube empresarial en todas las cargas de trabajo para configurar servicios de infraestructura de nube comunes, como la configuración de redes, identidades, permisos y administración de cuentas a nivel empresarial.

- Ingeniería de plataforma de datos. – Este equipo gestiona lagos de datos empresariales, recopilación de datos, curación de datos y gobernanza de datos.

- Ingeniería de plataforma ML – Este equipo opera a nivel de plataforma de ML en todos los LOB para proporcionar servicios de infraestructura de ML compartidos, como aprovisionamiento de infraestructura de ML, seguimiento de experimentos, gobernanza de modelos, implementación y observabilidad.

La siguiente tabla detalla qué divisiones tienen acceso primario y secundario para cada módulo según las personas objetivo del módulo.

| Número de módulo | Módulos | Acceso principal | Acceso secundario | Personas objetivo | Numero de cuentas |

|

1 |

Fundaciones multicuenta | Ingeniería de nube central | LOB individuales |

|

Pocos |

|

2 |

Fundamentos del lago de datos | Ingeniería de plataforma de datos o nube central | LOB individuales |

|

Múltiple |

|

3 |

Servicios de plataforma de aprendizaje automático | Ingeniería de plataforma de aprendizaje automático o nube central | LOB individuales |

|

Un |

|

4 |

Desarrollo de casos de uso de ML | LOB individuales | Ingeniería de plataforma de aprendizaje automático o nube central |

|

Múltiple |

|

5 |

Operaciones de aprendizaje automático | Ingeniería de nube central o ML | LOB individuales |

|

Múltiple |

|

6 |

Tienda de funciones centralizada | Nube central o ingeniería de datos | LOB individuales |

|

Un |

|

7 |

Registro y observabilidad | Ingeniería de nube central | LOB individuales |

|

Un |

|

8 |

Costo e informes | LOB individuales | Ingeniería de plataforma central |

|

Un |

Conclusión

En esta publicación, presentamos un marco para gobernar el ciclo de vida de ML a escala que lo ayuda a implementar cargas de trabajo de ML bien diseñadas que incorporan controles de seguridad y gobernanza. Discutimos cómo este marco adopta un enfoque holístico para construir una plataforma de aprendizaje automático considerando la gobernanza de datos, la gobernanza de modelos y los controles a nivel empresarial. Le animamos a experimentar con el marco y los conceptos presentados en esta publicación y compartir sus comentarios.

Sobre los autores

carnero vital es arquitecto principal de soluciones de aprendizaje automático en AWS. Tiene más de tres décadas de experiencia en la arquitectura y creación de aplicaciones distribuidas, híbridas y en la nube. Le apasiona crear soluciones de big data y AI/ML seguras, escalables y confiables para ayudar a los clientes empresariales en su proceso de adopción y optimización de la nube para mejorar sus resultados comerciales. En su tiempo libre, anda en motocicleta y camina con su oveja de tres años.

carnero vital es arquitecto principal de soluciones de aprendizaje automático en AWS. Tiene más de tres décadas de experiencia en la arquitectura y creación de aplicaciones distribuidas, híbridas y en la nube. Le apasiona crear soluciones de big data y AI/ML seguras, escalables y confiables para ayudar a los clientes empresariales en su proceso de adopción y optimización de la nube para mejorar sus resultados comerciales. En su tiempo libre, anda en motocicleta y camina con su oveja de tres años.

Sovik Kumar Nath es un arquitecto de soluciones de IA/ML con AWS. Tiene una amplia experiencia en el diseño de soluciones integrales de aprendizaje automático y análisis empresarial en finanzas, operaciones, marketing, atención médica, gestión de la cadena de suministro e IoT. Sovik ha publicado artículos y posee una patente en el monitoreo de modelos ML. Tiene doble maestría de la Universidad del Sur de Florida, Universidad de Friburgo, Suiza, y una licenciatura del Instituto Indio de Tecnología, Kharagpur. Fuera del trabajo, a Sovik le gusta viajar, viajar en ferry y ver películas.

Sovik Kumar Nath es un arquitecto de soluciones de IA/ML con AWS. Tiene una amplia experiencia en el diseño de soluciones integrales de aprendizaje automático y análisis empresarial en finanzas, operaciones, marketing, atención médica, gestión de la cadena de suministro e IoT. Sovik ha publicado artículos y posee una patente en el monitoreo de modelos ML. Tiene doble maestría de la Universidad del Sur de Florida, Universidad de Friburgo, Suiza, y una licenciatura del Instituto Indio de Tecnología, Kharagpur. Fuera del trabajo, a Sovik le gusta viajar, viajar en ferry y ver películas.

Maira Ladeira Tanke es especialista senior en datos en AWS. Como líder técnica, ayuda a los clientes a acelerar la consecución de valor empresarial a través de tecnología emergente y soluciones innovadoras. Maira trabaja en AWS desde enero de 2020. Antes de eso, trabajó como científica de datos en múltiples industrias enfocándose en lograr valor comercial a partir de los datos. En su tiempo libre, Maira disfruta viajar y pasar tiempo con su familia en un lugar cálido.

Maira Ladeira Tanke es especialista senior en datos en AWS. Como líder técnica, ayuda a los clientes a acelerar la consecución de valor empresarial a través de tecnología emergente y soluciones innovadoras. Maira trabaja en AWS desde enero de 2020. Antes de eso, trabajó como científica de datos en múltiples industrias enfocándose en lograr valor comercial a partir de los datos. En su tiempo libre, Maira disfruta viajar y pasar tiempo con su familia en un lugar cálido.

Ryan Lempka es arquitecto senior de soluciones en Amazon Web Services, donde ayuda a sus clientes a trabajar hacia atrás desde los objetivos comerciales para desarrollar soluciones en AWS. Tiene una amplia experiencia en estrategia empresarial, gestión de sistemas de TI y ciencia de datos. Ryan se dedica a ser un aprendiz permanente y disfruta desafiarse a sí mismo todos los días para aprender algo nuevo.

Ryan Lempka es arquitecto senior de soluciones en Amazon Web Services, donde ayuda a sus clientes a trabajar hacia atrás desde los objetivos comerciales para desarrollar soluciones en AWS. Tiene una amplia experiencia en estrategia empresarial, gestión de sistemas de TI y ciencia de datos. Ryan se dedica a ser un aprendiz permanente y disfruta desafiarse a sí mismo todos los días para aprender algo nuevo.

Sriharsh Adari es arquitecto sénior de soluciones en Amazon Web Services (AWS), donde ayuda a los clientes a trabajar hacia atrás a partir de los resultados comerciales para desarrollar soluciones innovadoras en AWS. A lo largo de los años, ha ayudado a varios clientes en la transformación de plataformas de datos en verticales de la industria. Su área principal de especialización incluye estrategia tecnológica, análisis de datos y ciencia de datos. En su tiempo libre, le gusta practicar deportes, ver programas de televisión en exceso y jugar Tabla.

Sriharsh Adari es arquitecto sénior de soluciones en Amazon Web Services (AWS), donde ayuda a los clientes a trabajar hacia atrás a partir de los resultados comerciales para desarrollar soluciones innovadoras en AWS. A lo largo de los años, ha ayudado a varios clientes en la transformación de plataformas de datos en verticales de la industria. Su área principal de especialización incluye estrategia tecnológica, análisis de datos y ciencia de datos. En su tiempo libre, le gusta practicar deportes, ver programas de televisión en exceso y jugar Tabla.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/governing-the-ml-lifecycle-at-scale-part-1-a-framework-for-architecting-ml-workloads-using-amazon-sagemaker/

- :posee

- :es

- :no

- :dónde

- $ UP

- 1

- 10

- 100

- 12

- 12 meses

- 2020

- 28

- 7

- 8

- 971

- a

- Nuestra Empresa

- acelerar

- de la máquina

- accesible

- Conforme

- Mi Cuenta

- Cuentas

- logro

- el logro de

- a través de

- acciones

- actividad

- Ad

- adaptar

- adaptaciónes

- adición

- Adicionales

- dirección

- direcciones

- direccionamiento

- Admin

- administradores

- Adopción

- Adopción

- Después

- AI

- Modelos AI

- AI / ML

- Alertas

- Todos

- permitido

- Permitir

- permite

- a lo largo de

- ya haya utilizado

- también

- Aunque

- Amazon

- Amazon SageMaker

- Amazon Web Services

- Servicios Web de Amazon (AWS)

- an

- análisis

- Analytics

- y

- e infraestructura

- cualquier

- aplicaciones

- enfoque

- adecuado

- aprobado

- arquitectura

- Archive

- somos

- Reservada

- AS

- Activos

- asociado

- asumir

- At

- Autenticación

- autorización

- automatizado

- Confirmación de Viaje

- Automatización

- Hoy Disponibles

- AWS

- Balance

- basado

- Base

- BE

- porque

- se convierte en

- esto

- antes

- "Ser"

- beneficioso

- beneficios

- MEJOR

- y las mejores prácticas

- entre

- parcialidad

- Big

- Big Data

- Descanso

- brevemente

- build

- Construir la

- construye

- estrategia de negocios

- pero

- by

- PUEDEN

- candidato

- capacidades

- tarjeta

- Tarjetas

- case

- cases

- catalogar

- categoría

- abastece

- Causa

- Reubicación

- central

- Centralización

- centralizado

- cadena

- retos

- desafiante

- Cheques

- química

- de cerca

- Soluciones

- adopción en la nube

- infraestructura de nube

- código

- colaboración

- --

- colectivamente

- Algunos

- Empresas

- compliance

- obediente

- componentes

- incluido

- concepto

- conceptos

- considerado

- en vista de

- considera

- consumir

- Clientes

- Envase

- control

- Torre de control

- controlado

- controles

- coordinado

- Core

- Cost

- Precio

- cubierto

- Para crear

- creado

- curaduría

- Clientes

- personalizan

- se adaptan

- página de información de sus operaciones

- de los tableros

- datos

- acceso a los datos

- Data Analytics

- Lago de datos

- Plataforma de datos

- privacidad de datos

- Ciencia de los datos

- científico de datos

- conjuntos de datos

- día

- décadas

- a dedicados

- profundo

- Grado

- departamentos

- desplegar

- desplegado

- Desplegando

- despliegue

- Despliegues

- despliega

- Diseño

- diseñado

- diseño

- detalles

- Dev

- desarrollar

- desarrollado

- Desarrollo

- desarrollos

- una experiencia diferente

- dimensiones

- de reservas

- discutir

- discutido

- distinto

- distribuidos

- inmersión

- dominio

- doble

- DE INSCRIPCIÓN

- cada una

- esfuerzos

- incrustar

- integrado

- incrustación

- emergentes

- Tecnología emergente

- habilitar

- facilita

- permite

- permitiendo

- fomentar

- de extremo a extremo

- Punto final

- ingeniero

- Ingeniería

- certificados

- mejorar

- garantizar

- asegura

- asegurando que

- Empresa

- Nivel de Empresa

- empresas

- Entorno

- ambientes

- esencial

- evaluar

- Eventos

- Cada

- diario

- ejemplo

- experience

- experimento

- experimentos

- Experiencia

- expresados

- extensión

- en los detalles

- Amplia experiencia

- enfrentado

- facilitar

- familia

- Feature

- Caracteristicas

- realimentación

- pocos

- Figura

- filtrar

- financiar

- financiero

- servicios financieros

- Nombre

- Flexibilidad

- Florida

- de tus señales

- enfoque

- siguiendo

- formulario

- formación

- Fundación

- Fundamentos

- Digital XNUMXk

- Marco conceptual

- Gratuito

- Desde

- función

- funcional

- funcionalidades

- a la fatiga

- funciones

- promover

- Además

- Obtén

- generar

- la generación de

- generativo

- IA generativa

- da

- Buscar

- gobierno

- modelo de gobernancia

- módulo de gobernanza

- gobernado

- gobernante

- concesión

- Grupo

- guía

- Tienen

- es

- he

- cabeza

- la salud

- oír

- ayuda

- ayudado

- ayuda

- aquí

- Alta

- de alto nivel

- su

- mantiene

- holístico

- Manos

- anfitriones

- Cómo

- Como Hacer

- Sin embargo

- HTML

- http

- HTTPS

- Bujes

- Híbrido

- identificar

- Identidad

- if

- implementar

- implementación

- implementado

- implementación

- mejorar

- la mejora de

- in

- incluir

- incluye

- Incluye

- creciente

- independientemente

- Indian

- industrias

- energético

- información

- EN LA MINA

- inicial

- Iniciados

- innovando

- originales

- ejemplo

- Innovadora

- COMPLETAMENTE

- interactuar

- interacciones

- interesado

- Internet

- Acceso a Internet

- dentro

- Introducido

- inversión extranjera

- IOT

- solo

- IT

- Enero

- Trabajos

- jpg

- Clave

- especialistas

- Kumar

- Falta

- lago

- lagos

- aterrizaje

- idioma

- large

- luego

- .

- Lead

- APRENDE:

- aprendizaje

- Nivel

- ciclo de vida

- como

- linaje

- líneas

- local

- log

- registro

- mirando

- máquina

- máquina de aprendizaje

- hecho

- mantener

- HACE

- gestionan

- gestionado

- Management

- gestiona

- administrar

- muchos

- Mapas

- Marketing

- un estudiante adulto

- madurez

- Puede..

- miembro

- mencionado

- malla

- metadatos

- mitigar

- mitigar los riesgos

- ML

- MLOps

- modelo

- modelos

- modificar

- modulares

- Módulo

- Módulos

- Monitorear

- monitoreo

- monitores

- meses

- más,

- MEJOR DE TU

- motocicleta

- Películas

- múltiples

- nativo

- ¿ Necesita ayuda

- Nest

- del sistema,

- red

- telecomunicaciones

- Nuevo

- Nuevas características

- Next

- cuaderno

- número

- ,

- ocasional

- of

- Ofertas

- Oficina

- a menudo

- Viejo

- on

- una vez

- ONE

- en marcha

- funcionar

- operado

- opera

- funcionamiento

- Operaciones

- optimización

- Optimización

- or

- organización

- para las fiestas.

- la organización de

- Otro

- nuestros

- salir

- resultados

- afuera

- Más de

- total

- visión de conjunto

- paquete

- parte

- particular

- apasionado

- patentar

- Realizar

- actuación

- permisos

- industrial

- Colocar

- Natural

- plataforma

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- jugando

- políticas

- política

- portafolio

- Publicación

- prácticas

- presente

- la prevención

- primario

- Director de la escuela

- Anterior

- política de privacidad

- privada

- sector privado

- Proactiva

- problemas

- en costes

- productor

- Productores

- Producto

- Producción

- Productos

- proyecta

- promociones y

- prueba

- prueba de concepto

- protector

- proporcionar

- proporciona un

- proporcionando

- público

- publicado

- propósito

- calidad

- con rapidez

- rápido

- Leer

- reciente

- reconocer

- recomiendan

- Recomendación

- reducir

- referencia

- regiones

- registrarte

- registrado

- registros

- registro

- regulados

- industrias reguladas

- confianza

- la eliminación de

- Informes

- exigir

- Requisitos

- Requisitos

- Recurso

- Recursos

- responder

- responsable

- reutilizar

- paseos

- Riesgo

- riesgos

- Función

- También soy miembro del cuerpo docente de World Extreme Medicine (WEM) y embajadora europea de igualdad para The Transformational Travel Council (TTC). En mi tiempo libre, soy una incansable aventurera, escaladora, patrona de día, buceadora y defensora de la igualdad de género en el deporte y la aventura. En XNUMX, fundé Almas Libres, una ONG nacida para involucrar, educar y empoderar a mujeres y niñas a través del deporte urbano, la cultura y la tecnología.

- raíz

- Regla

- reglas

- Ejecutar

- correr

- Ryan

- sacrificando

- sabio

- Tuberías de SageMaker

- mismo

- escalable

- Escala

- la ampliación

- Ciencia:

- Científico

- los científicos

- Buscar

- secundario

- Sección

- sector

- seguro

- EN LINEA

- Los eventos de seguridad

- Autoservicio

- mayor

- Serie

- de coches

- Servicios

- set

- Sets

- pólipo

- Configure

- Compartir

- compartido

- Acciones

- compartir

- ella

- En Corto

- tienes

- mostrado

- Shows

- sencillos

- desde

- soltero

- Tamaño

- chica

- So

- a medida

- Soluciones

- RESOLVER

- algo

- algo

- Sur

- Premium

- especialista

- especializado

- soluciones y

- Gastos

- Deportes

- etapas

- son afectados por la empresa

- las partes interesadas

- estándares de salud

- comienzo

- Estado

- paso

- pasos

- Sin embargo

- detenido

- STORAGE

- tienda

- tiendas

- estrategias

- Estrategia

- fuerte

- estructura

- estructuras

- estudio

- exitosos

- tal

- siguiente

- RESUMEN

- suministro

- cadena de suministro

- gestión de la cadena de suministro

- SOPORTE

- Apoyar

- seguro

- Suiza

- Todas las funciones a su disposición

- mesa

- adaptado

- toma

- toma

- Target

- equipo

- equipos

- Técnico

- Tecnología

- Estrategia tecnológica

- plantilla

- plantillas

- test

- Pruebas

- esa

- La

- El Estado

- su

- Les

- luego

- Estas

- ellos

- cosas

- así

- aquellos

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- a lo largo de

- equipo

- a

- hacia

- tower

- seguir

- Seguimiento

- tradicional

- Entrenar

- transformaciones

- tránsito

- Viajar

- GIRO

- tv

- tipos

- bajo

- entender

- injusto

- unidades que

- universidad

- us

- Uso

- utilizan el

- caso de uso

- usado

- Usuario

- usuarios

- usos

- usando

- utilizar

- validación

- propuesta de

- variedad

- diversos

- verticales

- vía

- Violaciónes

- la visibilidad

- visualización

- visualizar

- caminar

- quieres

- caliente

- ver

- we

- web

- servicios web

- WELL

- cuando

- sean

- que

- mientras

- seguirá

- dentro de

- sin

- Actividades:

- trabajado

- flujos de trabajo

- trabajando

- años

- Usted

- tú

- zephyrnet