Esta publicación está escrita en colaboración con Jan Paul Assendorp, Thomas Lietzow, Christopher Masch, Alexander Meinert, Dr. Lars Palzer, Jan Schillemans de SIGNAL IDUNA.

En SIGNAL IDUNA, una gran aseguradora alemana, actualmente nos estamos reinventando con nuestro programa de transformación VISION2023 para estar aún más orientados al cliente. Dos aspectos son fundamentales para esta transformación: la reorganización de gran parte de la fuerza laboral en equipos multifuncionales y ágiles, y convertirse en una empresa verdaderamente basada en datos. Aquí, el lema "Tú lo construyes, tú lo ejecutas" es un requisito importante para un equipo multifuncional que crea un producto de datos o aprendizaje automático (ML). Esto impone restricciones estrictas sobre cuánto puede gastar el equipo de trabajo para producir y ejecutar un producto.

Esta publicación muestra cómo SIGNAL IDUNA aborda este desafío y utiliza el AWS Cloud para permitir que los equipos multifuncionales construyan y pongan en funcionamiento sus propios productos ML. Con este fin, primero presentamos la estructura organizativa de los equipos ágiles, que establece los requisitos centrales para la infraestructura de la nube utilizada para desarrollar y ejecutar un producto. A continuación, mostramos cómo tres equipos centrales en SIGNAL IDUNA permiten que los equipos multifuncionales creen productos de datos en la nube de AWS con asistencia mínima, al proporcionar un flujo de trabajo adecuado y soluciones de infraestructura que se pueden usar y adaptar fácilmente. Finalmente, revisamos nuestro enfoque y lo comparamos con un enfoque más clásico donde el desarrollo y la operación están separados más estrictamente.

Agile@SI: la base del cambio organizacional

Desde principios de 2021, SIGNAL IDUNA ha puesto en marcha su estrategia Agile@SI y ha establecido métodos ágiles para desarrollar soluciones orientadas al cliente en toda la compañía [1]. Las tareas y metas anteriores ahora las llevan a cabo equipos multifuncionales, llamados escuadrones. Estos escuadrones emplean métodos ágiles (como el marco Scrum), toman sus propias decisiones y crean productos orientados al cliente. Por lo general, los equipos están ubicados en divisiones comerciales, como marketing, y muchos tienen un fuerte énfasis en la creación de productos basados en datos y ML. Como ejemplo, los casos de uso típicos en seguros son la predicción de abandono de clientes y la recomendación de productos.

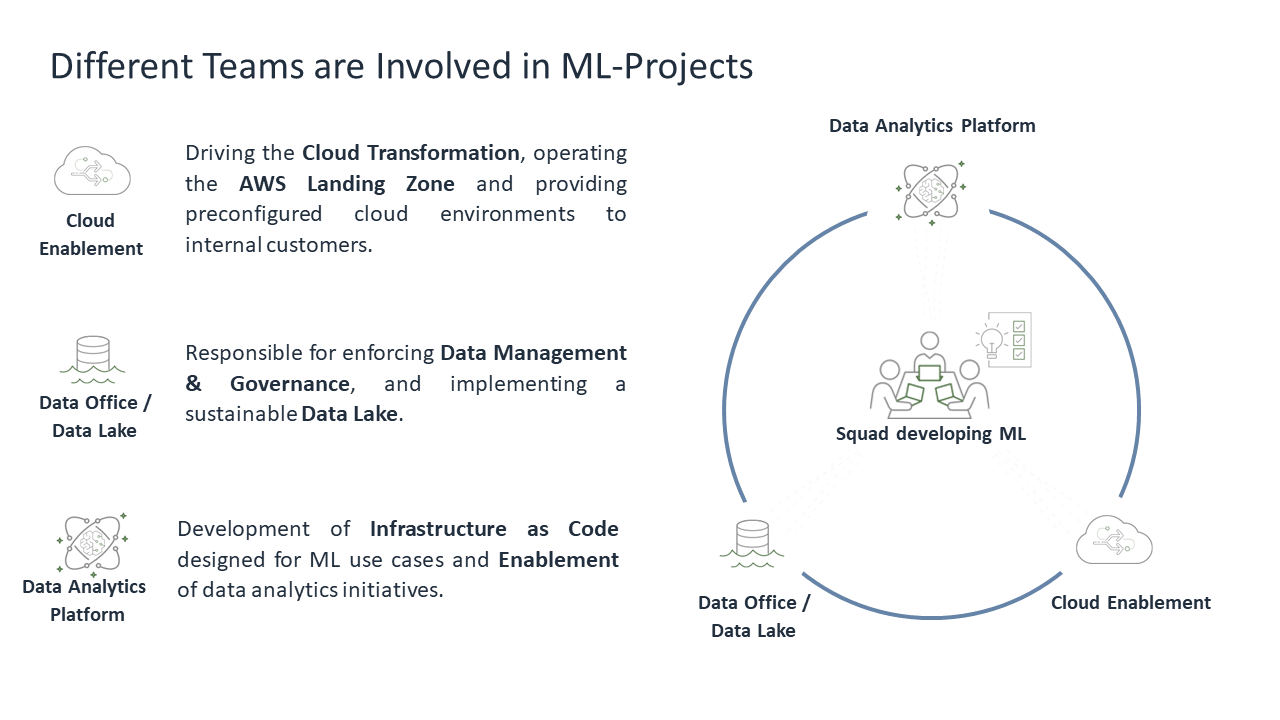

Debido a la complejidad de ML, crear una solución de ML por parte de un solo escuadrón es un desafío y, por lo tanto, requiere la colaboración de diferentes escuadrones.

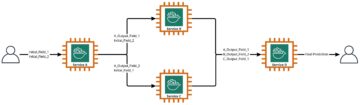

SIGNAL IDUNA tiene tres equipos esenciales que apoyan la creación de soluciones ML. Rodeado por estos tres escuadrones se encuentra el equipo responsable del desarrollo y la operación a largo plazo de la solución ML. Este enfoque sigue el modelo de responsabilidad compartida de AWS [2].

En la imagen de arriba, todos los escuadrones están representados en una vista general.

Habilitación de la nube

La infraestructura de nube subyacente para toda la organización es proporcionada por Squad Enablement Cloud. Su tarea es permitir que los equipos construyan productos basados en tecnologías de la nube por su cuenta. Esto mejora el tiempo de comercialización creando nuevos productos como ML, y sigue el principio de "Usted lo crea, lo ejecuta".

Oficina de datos/Lago de datos

Mover datos a la nube, así como encontrar el conjunto de datos correcto, es compatible con el equipo Data Office/Data Lake. Configuran un catálogo de datos que se puede utilizar para buscar y seleccionar los conjuntos de datos necesarios. Su objetivo es establecer la transparencia y la gobernanza de los datos. Además, son responsables de establecer y operar un lago de datos que ayude a los equipos a acceder y procesar datos relevantes.

Plataforma de análisis de datos

Nuestro escuadrón Data Analytics Platform (DAP) es un equipo centrado en la nube y ML en SIGNAL IDUNA que es competente en ingeniería ML, ingeniería de datos y ciencia de datos. Habilitamos equipos internos que utilizan la nube pública para ML al proporcionar componentes de infraestructura y conocimiento. Nuestros productos y servicios se presentan en detalle en la siguiente sección.

Habilitación de equipos multifuncionales para crear soluciones de aprendizaje automático

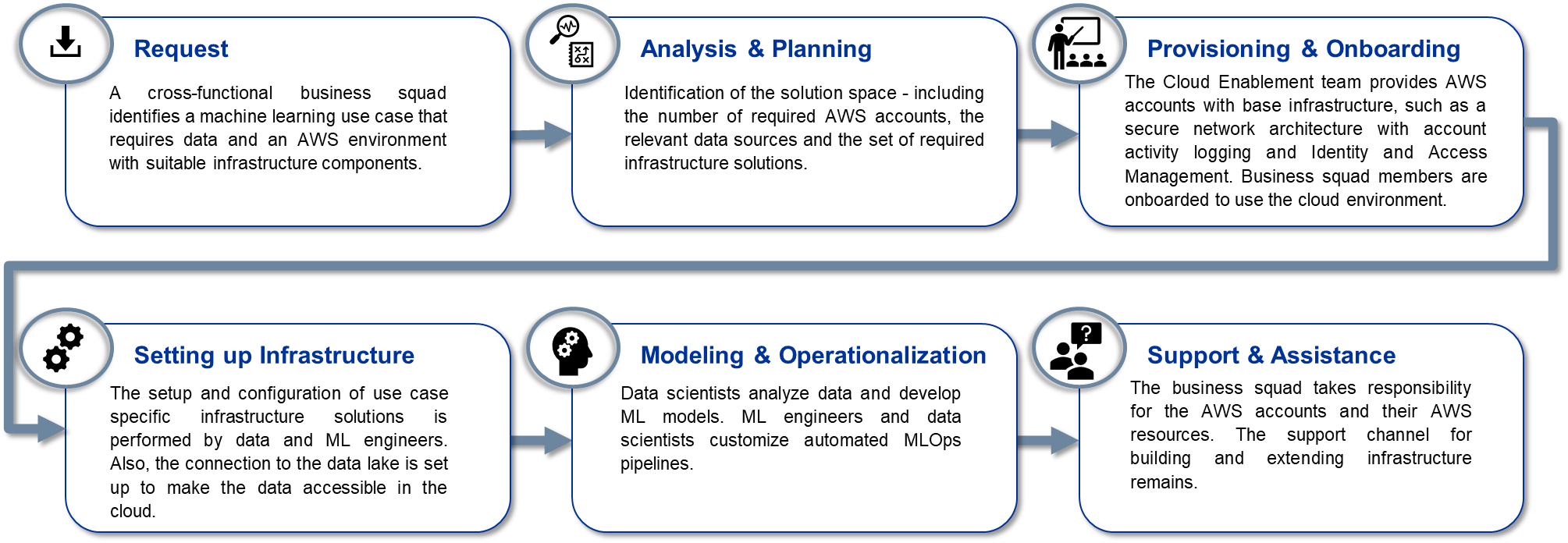

Para permitir que los equipos multifuncionales de SIGNAL IDUNA desarrollen soluciones de aprendizaje automático, necesitamos una forma rápida y versátil de aprovisionar una infraestructura de nube reutilizable, así como un flujo de trabajo eficiente para que los equipos de incorporación utilicen las capacidades de la nube.

Con este fin, creamos un proceso estandarizado de incorporación y soporte, y proporcionamos plantillas de infraestructura modular como Infraestructura como código (IaC). Estas plantillas contienen componentes de infraestructura diseñados para casos de uso comunes de ML que se pueden adaptar fácilmente a los requisitos de un caso de uso específico.

El flujo de trabajo de la creación de soluciones de ML

Hay tres roles técnicos principales involucrados en la creación y operación de soluciones de ML: el científico de datos, el ingeniero de ML y un ingeniero de datos. Cada rol es parte del equipo multifuncional y tiene diferentes responsabilidades. El científico de datos tiene el conocimiento de dominio requerido de los requisitos funcionales y técnicos del caso de uso. El ingeniero de ML se especializa en la creación de soluciones de ML automatizadas y la implementación de modelos. Y el ingeniero de datos se asegura de que los datos fluyan desde las instalaciones y dentro de la nube.

El proceso de provisión de la plataforma es el siguiente:

La infraestructura del caso de uso específico se define en IaC y se versiona en un repositorio central del proyecto. Esto también incluye canalizaciones para el entrenamiento y la implementación de modelos, así como otros artefactos de código relacionados con la ciencia de datos. Los científicos de datos, los ingenieros de ML y los ingenieros de datos tienen acceso al repositorio del proyecto y pueden configurar y actualizar todo el código de infraestructura de forma autónoma. Esto permite que el equipo modifique rápidamente la infraestructura si es necesario. Sin embargo, el ingeniero de ML siempre puede ayudar a desarrollar y actualizar la infraestructura o los modelos de ML.

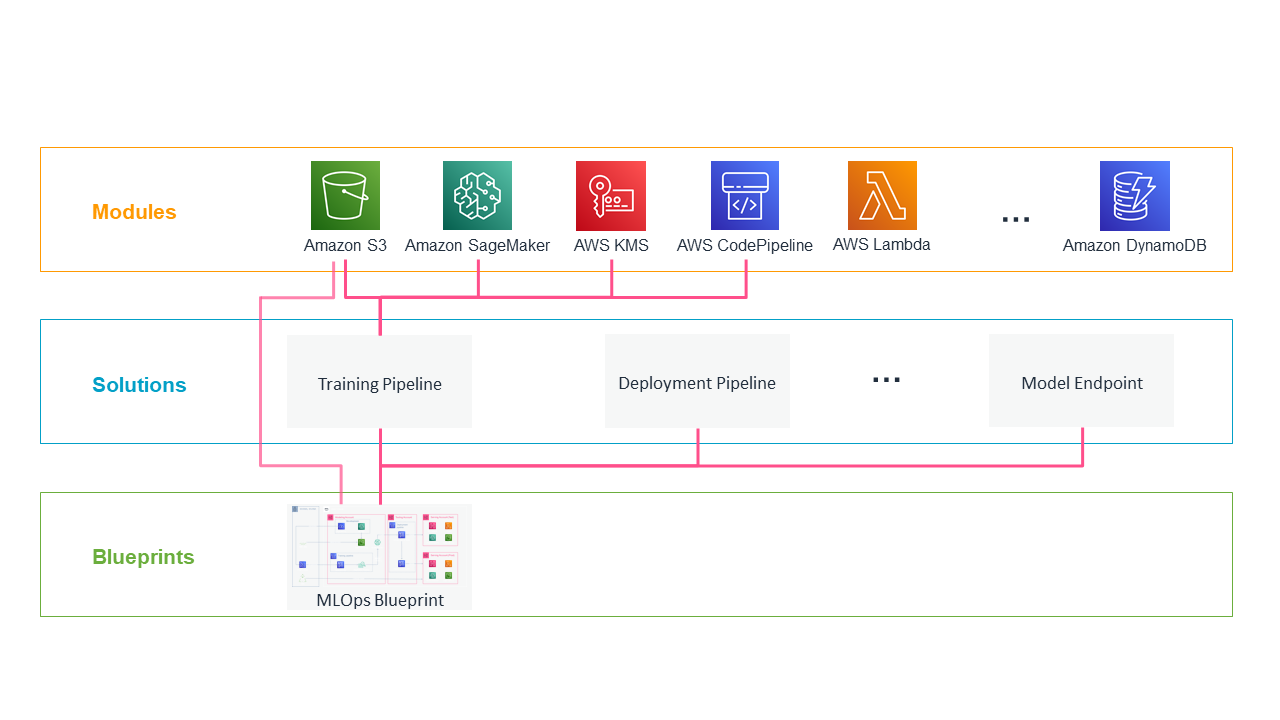

Componentes de infraestructura modular y reutilizable

Los recursos IaC jerárquicos y modulares se implementan en Terraform e incluir infraestructura para casos de uso comunes de ciencia de datos y ETL. Esto nos permite reutilizar el código de infraestructura y hacer cumplir las políticas de seguridad y cumplimiento requeridas, como usar Servicio de administración de claves de AWS (KMS) encriptación de datos, así como encapsulación de infraestructura en Nube privada virtual de Amazon (VPC) entornos sin acceso directo a Internet.

La estructura jerárquica del IaC es la siguiente:

- Módulos encapsule los servicios básicos de AWS con la configuración necesaria para la seguridad y la administración de acceso. Esto incluye configuraciones de mejores prácticas, como la prevención del acceso público a Servicio de almacenamiento simple de Amazon (S3) cubos, o hacer cumplir el cifrado para todos los archivos almacenados.

- En algunos casos, necesita una variedad de servicios para automatizar procesos, como implementar modelos ML en diferentes etapas. Por lo tanto, definimos Soluciones como un paquete de diferentes módulos en una configuración conjunta para diferentes tipos de tareas.

- Además, ofrecemos completa Plano que combinan soluciones en diferentes entornos para satisfacer las múltiples necesidades potenciales de un proyecto. En nuestro modelo de MLOps, definimos una infraestructura implementable para entrenar, aprovisionar y monitorear modelos de ML que están integrados y distribuidos en cuentas de AWS. Discutimos más detalles en la siguiente sección.

Estos productos son versionados en un repositorio central por el equipo DAP. Esto nos permite mejorar continuamente nuestro IaC y considerar nuevas funciones de AWS, como Amazon SageMaker Registro de modelos. Cada escuadrón puede hacer referencia a estos recursos, parametrizarlos según sea necesario y finalmente implementarlos en sus propias cuentas de AWS.

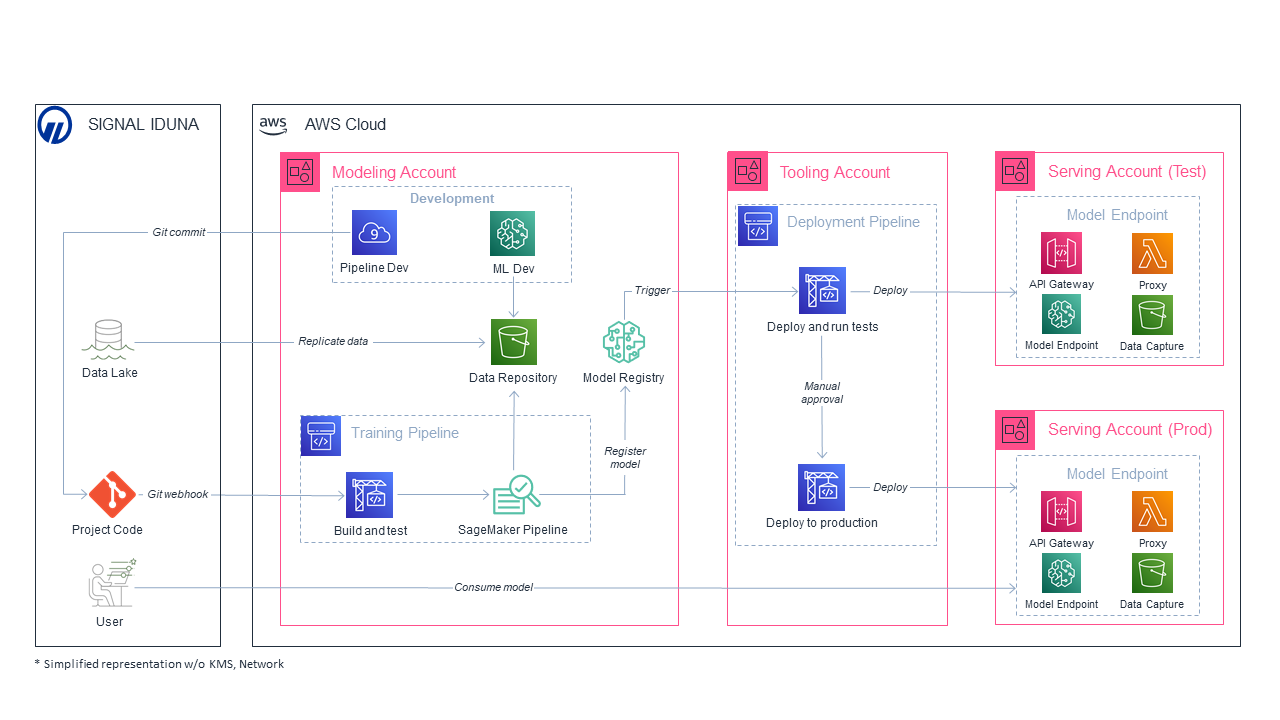

Arquitectura MLOps

Proporcionamos un plan listo para usar con soluciones específicas para cubrir todo el proceso de MLOps. El proyecto contiene infraestructura distribuida en cuatro cuentas de AWS para crear e implementar modelos de aprendizaje automático. Esto nos permite aislar recursos y flujos de trabajo para los diferentes pasos del proceso de MLOps. La siguiente figura muestra la arquitectura multicuenta y describimos cómo la responsabilidad sobre pasos específicos del proceso se divide entre los diferentes roles técnicos.

El modelado cuenta incluye servicios para el desarrollo de modelos ML. En primer lugar, el ingeniero de datos emplea un proceso ETL para proporcionar datos relevantes del lago de datos SIGNAL IDUNA, la puerta de enlace centralizada para flujos de trabajo basados en datos en la nube de AWS. Posteriormente, el conjunto de datos puede ser utilizado por el científico de datos para entrenar y evaluar modelos candidatos. Una vez que está listo para experimentos extensos, el ingeniero de ML integra un candidato modelo en una canalización de capacitación automatizada. Usamos Amazon SageMaker Pipelines para automatizar el entrenamiento, el ajuste de hiperparámetros y la evaluación de modelos a escala. Esto también incluye el linaje de modelos y un mecanismo de aprobación estandarizado para que los modelos se preparen para su implementación en producción. Las pruebas unitarias automatizadas y el análisis de código garantizan la calidad y la confiabilidad del código para cada paso de la canalización, como el preprocesamiento de datos, el entrenamiento de modelos y la evaluación. Una vez que se evalúa y aprueba un modelo, utilizamos ModelPackages de Amazon SageMaker como una interfaz para el modelo entrenado y los metadatos relevantes.

El estampación La cuenta contiene canalizaciones de CI/CD automatizadas con diferentes etapas para probar e implementar modelos entrenados. En la etapa de prueba, los modelos se despliegan en el sirviendo sin producir cuenta. Si bien la calidad del modelo se evalúa en el proceso de capacitación antes de que el modelo se prepare para la producción, aquí ejecutamos pruebas de rendimiento e integración en un entorno de prueba aislado. Después de pasar la etapa de prueba, los modelos se implementan en el servir-prod cuenta para integrarse en los flujos de trabajo de producción.

Separar las etapas del flujo de trabajo de MLOps en diferentes cuentas de AWS nos permite aislar el desarrollo y las pruebas de la producción. Por lo tanto, podemos aplicar una estricta política de acceso y seguridad. Además, los roles de IAM personalizados garantizan que los servicios específicos solo puedan acceder a los datos y otros servicios necesarios para su alcance, siguiendo las principio de menor privilegio. Los servicios dentro de los entornos de servicio también pueden hacerse accesibles a los procesos comerciales externos. Por ejemplo, un proceso comercial puede consultar un punto final dentro del entorno de producción de servicio para obtener predicciones del modelo.

Beneficios de nuestro enfoque

Este proceso tiene muchas ventajas en comparación con una separación estricta de desarrollo y operación tanto para los modelos ML como para la infraestructura requerida:

- Aislamiento: cada equipo recibe su propio conjunto de cuentas de AWS que están completamente aisladas de los entornos de otros equipos. Esto facilita la gestión de los derechos de acceso y mantiene la privacidad de los datos para quienes tienen derecho a trabajar con ellos.

- Habilitación de la nube: Los miembros del equipo con poca experiencia previa en DevOps en la nube (como muchos científicos de datos) pueden observar fácilmente todo el proceso de diseño y administración de la infraestructura ya que (casi) nada se les oculta detrás de un servicio central. Esto crea una mejor comprensión de la infraestructura, lo que a su vez puede ayudarlos a crear productos de ciencia de datos de manera más eficiente.

- propiedad del producto: El uso de soluciones de infraestructura preconfiguradas y servicios administrados mantiene muy baja la barrera para administrar un producto ML en producción. Por lo tanto, un científico de datos puede fácilmente tomar posesión de un modelo que se pone en producción. Esto minimiza el conocido riesgo de no poder poner un modelo en producción después del desarrollo.

- Innovation: Dado que los ingenieros de ML participan mucho antes de que un modelo esté listo para ponerse en producción, pueden crear soluciones de infraestructura adecuadas para nuevos casos de uso mientras los científicos de datos desarrollan un modelo de ML.

- Adaptabilidad: Dado que la solución IaC desarrollada por DAP está disponible gratuitamente, cualquier equipo puede adaptarla fácilmente para que coincida con una necesidad específica para su caso de uso.

- Fuente abierta: Todas las nuevas soluciones de infraestructura pueden estar fácilmente disponibles a través del repositorio de código DAP central para que las utilicen otros equipos. Con el tiempo, esto creará una rica base de código con componentes de infraestructura adaptados a diferentes casos de uso.

Resumen

En esta publicación, ilustramos cómo los equipos multifuncionales en SIGNAL IDUNA están siendo habilitados para crear y ejecutar productos ML en AWS. Un elemento central de nuestro enfoque es el uso de un conjunto dedicado de cuentas de AWS para cada equipo en combinación con proyectos y soluciones de IaC personalizados. Estos dos componentes permiten que un equipo multifuncional cree y opere una infraestructura de calidad de producción. A su vez, pueden asumir la propiedad total de sus productos ML.

Consulte Canalizaciones de creación de modelos de Amazon SageMaker – Amazon SageMaker para obtener más información.

Encuentre más información sobre ML en AWS en nuestra página oficial.

Referencias

[1] https://www.handelsblatt.com/finanzen/versicherungsbranche-vorbild-spotify-signal-iduna-wird-von-einer-handwerker-versicherung-zum-agilen-konzern/27381902.html

[2] https://blog.crisp.se/wp-content/uploads/2012/11/SpotifyScaling.pdf

[3] https://aws.amazon.com/compliance/shared-responsibility-model/

Acerca de los autores

Jan Paul Assendorp es un ingeniero de ML con un fuerte enfoque en ciencia de datos. Construye modelos ML y automatiza el entrenamiento de modelos y la implementación en entornos de producción.

Jan Paul Assendorp es un ingeniero de ML con un fuerte enfoque en ciencia de datos. Construye modelos ML y automatiza el entrenamiento de modelos y la implementación en entornos de producción.

Thomas Lietzów es el Scrum Master del escuadrón Data Analytics Platform.

Thomas Lietzów es el Scrum Master del escuadrón Data Analytics Platform.

cristobal masch es el propietario del producto de la plataforma de análisis de datos del escuadrón con conocimientos en ingeniería de datos, ciencia de datos e ingeniería de ML.

cristobal masch es el propietario del producto de la plataforma de análisis de datos del escuadrón con conocimientos en ingeniería de datos, ciencia de datos e ingeniería de ML.

Alejandro Meinert es parte del equipo de Data Analytics Platform y trabaja como ingeniero de ML. Comenzó con estadísticas, creció en proyectos de ciencia de datos, encontró pasión por los métodos y la arquitectura de ML.

Alejandro Meinert es parte del equipo de Data Analytics Platform y trabaja como ingeniero de ML. Comenzó con estadísticas, creció en proyectos de ciencia de datos, encontró pasión por los métodos y la arquitectura de ML.

Dr. Lars Palzer es un científico de datos y parte del equipo de la plataforma de análisis de datos. Después de ayudar a construir los componentes de la arquitectura MLOps, ahora los usa para construir productos ML.

Dr. Lars Palzer es un científico de datos y parte del equipo de la plataforma de análisis de datos. Después de ayudar a construir los componentes de la arquitectura MLOps, ahora los usa para construir productos ML.

Jan Schillemans es un ingeniero de ML con experiencia en ingeniería de software. Se enfoca en aplicar las mejores prácticas de ingeniería de software en entornos ML (MLOps).

Jan Schillemans es un ingeniero de ML con experiencia en ingeniería de software. Se enfoca en aplicar las mejores prácticas de ingeniería de software en entornos ML (MLOps).

- Coinsmart. El mejor intercambio de Bitcoin y criptografía de Europa.

- Platoblockchain. Inteligencia del Metaverso Web3. Conocimiento amplificado. ACCESO LIBRE.

- CriptoHawk. Radar de altcoins. Prueba gratis.

- Fuente: https://aws.amazon.com/blogs/machine-learning/how-signal-iduna-operationalizes-machine-learning-projects-on-aws/

- "

- 100

- 2021

- de la máquina

- Mi Cuenta

- a través de

- la columna Acción

- ventajas

- ágil

- Todos

- Aunque

- Amazon

- análisis

- Analytics

- La aplicación de

- enfoque

- arquitectura

- Confirmación de Viaje

- Hoy Disponibles

- AWS

- "Ser"

- MEJOR

- y las mejores prácticas

- build

- Construir la

- Packs ahorro

- capacidades

- cases

- Reto

- Soluciones

- infraestructura de nube

- código

- colaboración

- combinación

- Algunos

- compañía

- en comparación con

- compliance

- Configuración

- contiene

- Creamos

- datos

- Data Analytics

- Ciencia de los datos

- científico de datos

- a dedicados

- desplegar

- Desplegando

- despliegue

- diseño

- detalle

- desarrollar

- desarrollado

- el desarrollo

- Desarrollo

- una experiencia diferente

- discutir

- distribuidos

- dominio

- pasan fácilmente

- cifrado

- Punto final

- ingeniero

- Ingeniería

- certificados

- Entorno

- esencial

- establecer

- ejemplo

- experience

- RÁPIDO

- Caracteristicas

- Figura

- Finalmente

- Nombre

- Focus

- centrado

- siguiendo

- encontrado

- Fundación

- Marco conceptual

- ser completados

- Goals

- gobierno

- ayuda

- ayuda

- esta página

- Cómo

- HTTPS

- imagen

- implementado

- importante

- mejorar

- incluir

- información

- EN LA MINA

- aseguradora

- COMPLETAMENTE

- integración

- Interfaz

- Internet

- involucra

- IT

- Clave

- especialistas

- large

- APRENDE:

- aprendizaje

- pequeño

- Largo

- máquina

- máquina de aprendizaje

- Management

- administrar

- Mercado

- Marketing

- Match

- Miembros

- Meta

- ML

- modelo

- modelos

- modulares

- monitoreo

- Nuevas características

- nuevos diseños y productos

- LANZAMIENTO

- oficial

- Inmersión

- funcionamiento

- organización

- Otro

- propietario

- actuación

- plataforma

- políticas

- política

- predicción

- Predicciones

- Prevención

- privada

- en costes

- Producto

- Producción

- Productos

- Programa

- proyecto

- proyecta

- proporcionar

- público

- nube pública

- calidad

- repositorio

- Requisitos

- Requisitos

- Recursos

- responsable

- una estrategia SEO para aparecer en las búsquedas de Google.

- Riesgo

- Ejecutar

- Escala

- Ciencia:

- Científico

- los científicos

- Buscar

- EN LINEA

- de coches

- Servicios

- servicio

- set

- compartido

- sencillos

- Software

- Ingeniería de software

- Soluciones

- se especializa

- pasar

- Etapa

- comienzo

- fundó

- statistics

- STORAGE

- Estrategia

- fuerte

- Después

- SOPORTE

- Soportado

- rodeado

- tareas

- equipo

- Técnico

- Tecnologías

- test

- Pruebas

- pruebas

- equipo

- Formación

- Transparencia

- Actualizar

- us

- utilizan el

- utilizar

- Virtual

- Ver ahora

- QUIENES

- dentro de

- sin

- Actividades:

- Empleados

- funciona