Esta publicación está coescrita por Jyoti Sharma y Sharmo Sarkar de Vericast.

Para cualquier problema de aprendizaje automático (ML), el científico de datos comienza trabajando con datos. Esto incluye recopilar, explorar y comprender los aspectos comerciales y técnicos de los datos, junto con la evaluación de cualquier manipulación que pueda ser necesaria para el proceso de creación del modelo. Un aspecto de esta preparación de datos es la ingeniería de características.

Ingeniería de características se refiere al proceso en el que las variables relevantes se identifican, seleccionan y manipulan para transformar los datos sin procesar en formas más útiles y utilizables para usar con el algoritmo ML utilizado para entrenar un modelo y realizar inferencias en su contra. El objetivo de este proceso es aumentar el rendimiento del algoritmo y el modelo predictivo resultante. El proceso de ingeniería de características implica varias etapas, incluida la creación de características, la transformación de datos, la extracción de características y la selección de características.

La creación de una plataforma para la ingeniería de funciones generalizada es una tarea común para los clientes que necesitan producir muchos modelos de ML con diferentes conjuntos de datos. Este tipo de plataforma incluye la creación de un proceso impulsado por programación para producir datos de ingeniería de funciones finalizados, listos para el entrenamiento de modelos con poca intervención humana. Sin embargo, generalizar la ingeniería de características es un desafío. Cada problema comercial es diferente, cada conjunto de datos es diferente, los volúmenes de datos varían mucho de un cliente a otro, y la calidad de los datos y, a menudo, la cardinalidad de una determinada columna (en el caso de los datos estructurados) pueden desempeñar un papel importante en la complejidad de la ingeniería de funciones. proceso. Además, la naturaleza dinámica de los datos de un cliente también puede generar una gran variación en el tiempo de procesamiento y los recursos necesarios para completar de manera óptima la ingeniería de funciones.

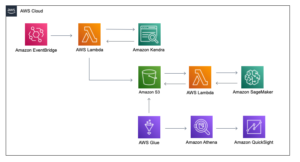

cliente de AWS vericast es una empresa de soluciones de marketing que toma decisiones basadas en datos para impulsar el ROI de marketing para sus clientes. La plataforma interna de aprendizaje automático basada en la nube de Vericast, creada en torno al proceso CRISP-ML(Q), utiliza varios servicios de AWS, incluidos Amazon SageMaker, Procesamiento de Amazon SageMaker, AWS Lambday Funciones de paso de AWS, para producir los mejores modelos posibles que se adapten a los datos específicos del cliente. Esta plataforma tiene como objetivo capturar la repetibilidad de los pasos que intervienen en la creación de varios flujos de trabajo de ML y agruparlos en módulos de flujo de trabajo generalizables estándar dentro de la plataforma.

En esta publicación, compartimos cómo Vericast optimizó la ingeniería de características usando SageMaker Processing.

Resumen de la solución

La plataforma de aprendizaje automático de Vericast ayuda en la implementación más rápida de nuevos modelos comerciales basados en flujos de trabajo existentes o en la activación más rápida de modelos existentes para nuevos clientes. Por ejemplo, un modelo que predice la propensión al correo directo es bastante diferente de un modelo que predice la sensibilidad de los cupones de descuento de los clientes de un cliente de Vericast. Resuelven diferentes problemas comerciales y, por lo tanto, tienen diferentes escenarios de uso en el diseño de una campaña de marketing. Pero desde el punto de vista de ML, ambos pueden interpretarse como modelos de clasificación binaria y, por lo tanto, podrían compartir muchos pasos comunes desde una perspectiva de flujo de trabajo de ML, incluido el ajuste y entrenamiento de modelos, evaluación, interpretabilidad, implementación e inferencia.

Debido a que estos modelos son problemas de clasificación binaria (en términos de ML), estamos separando a los clientes de una empresa en dos clases (binarios): los que responderían positivamente a la campaña y los que no. Además, estos ejemplos se consideran una clasificación desequilibrada porque los datos utilizados para entrenar el modelo no contendrían un número igual de clientes que responderían favorablemente y no.

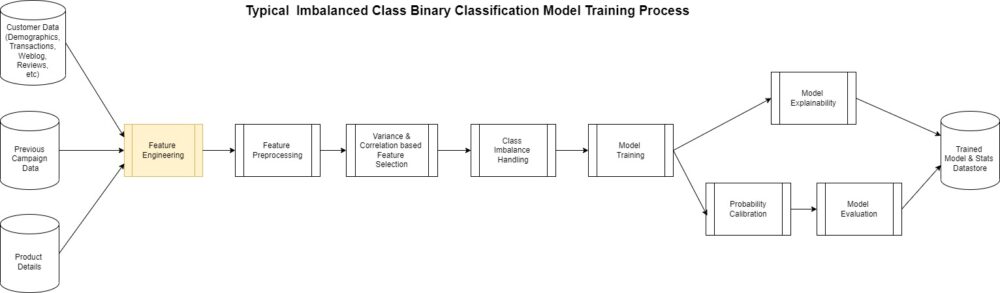

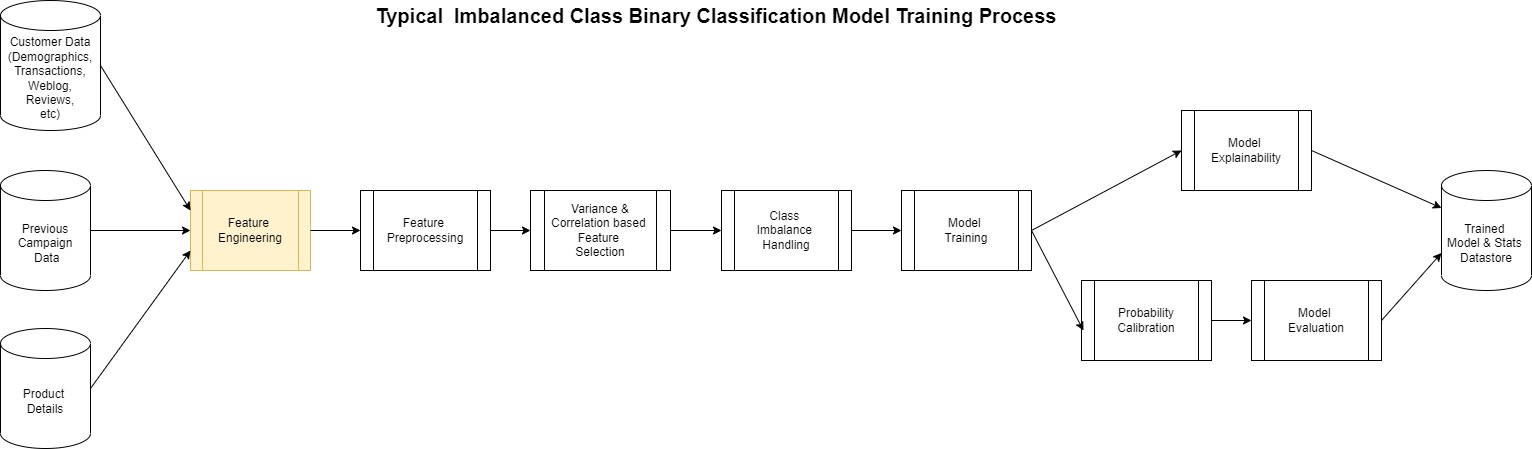

La creación real de un modelo como este sigue el patrón generalizado que se muestra en el siguiente diagrama.

La mayor parte de este proceso es el mismo para cualquier clasificación binaria excepto por el paso de ingeniería de características. Este es quizás el paso más complicado pero a veces pasado por alto en el proceso. Los modelos de ML dependen en gran medida de las características utilizadas para crearlos.

La plataforma de aprendizaje automático nativa de la nube de Vericast tiene como objetivo generalizar y automatizar los pasos de ingeniería de funciones para varios flujos de trabajo de ML y optimizar su rendimiento en una métrica de costo versus tiempo mediante el uso de las siguientes funciones:

- La biblioteca de ingeniería de funciones de la plataforma – Consiste en un conjunto de transformaciones en constante evolución que se han probado para producir características generalizables de alta calidad basadas en conceptos específicos del cliente (por ejemplo, datos demográficos del cliente, detalles del producto, detalles de la transacción, etc.).

- Optimizadores de recursos inteligentes – La plataforma utiliza la capacidad de infraestructura bajo demanda de AWS para activar el tipo más óptimo de recursos de procesamiento para el trabajo de ingeniería de características en particular según la complejidad esperada del paso y la cantidad de datos que necesita procesar.

- Escalado dinámico de trabajos de ingeniería de funciones – Para esto se utiliza una combinación de varios servicios de AWS, pero sobre todo SageMaker Processing. Esto garantiza que la plataforma produzca funciones de alta calidad de manera rentable y oportuna.

Esta publicación se centra en el tercer punto de esta lista y muestra cómo lograr un escalado dinámico de los trabajos de procesamiento de SageMaker para lograr un marco de procesamiento de datos más administrado, eficaz y rentable para grandes volúmenes de datos.

SageMaker Processing permite cargas de trabajo que ejecutan pasos para el procesamiento previo o posterior de datos, la ingeniería de características, la validación de datos y la evaluación de modelos en SageMaker. También proporciona un entorno gestionado y elimina la complejidad del trabajo pesado indiferenciado necesario para configurar y mantener la infraestructura necesaria para ejecutar las cargas de trabajo. Además, SageMaker Processing proporciona una interfaz API para ejecutar, monitorear y evaluar la carga de trabajo.

La ejecución de trabajos de procesamiento de SageMaker se lleva a cabo completamente dentro de un clúster de SageMaker administrado, con trabajos individuales colocados en contenedores de instancias en tiempo de ejecución. El clúster administrado, las instancias y los contenedores informan las métricas a Reloj en la nube de Amazon, incluido el uso de GPU, CPU, memoria, memoria de GPU, métricas de disco y registro de eventos.

Estas funciones brindan beneficios a los ingenieros y científicos de datos de Vericast al ayudar en el desarrollo de flujos de trabajo de preprocesamiento generalizados y abstraer la dificultad de mantener los entornos generados en los que ejecutarlos. Sin embargo, pueden surgir problemas técnicos dada la naturaleza dinámica de los datos y sus variadas características que pueden incorporarse a una solución tan general. El sistema debe hacer una conjetura inicial informada sobre el tamaño del clúster y las instancias que lo componen. Esta conjetura necesita evaluar los criterios de los datos e inferir los requisitos de CPU, memoria y disco. Esta conjetura puede ser totalmente apropiada y funcionar adecuadamente para el trabajo, pero en otros casos puede no ser así. Para un conjunto de datos y un trabajo de preprocesamiento dados, la CPU puede tener un tamaño insuficiente, lo que resulta en un rendimiento de procesamiento maximizado y tiempos prolongados para completarse. Peor aún, la memoria podría convertirse en un problema, lo que daría como resultado un rendimiento deficiente o eventos de falta de memoria que harían que todo el trabajo fallara.

Con estos obstáculos técnicos en mente, Vericast se dispuso a crear una solución. Necesitaban seguir siendo de naturaleza general y encajar en el panorama más amplio del flujo de trabajo de preprocesamiento siendo flexibles en los pasos involucrados. También era importante resolver tanto la necesidad potencial de escalar el entorno en los casos en que el rendimiento se veía comprometido como recuperarse correctamente de tal evento o cuando un trabajo finalizaba prematuramente por cualquier motivo.

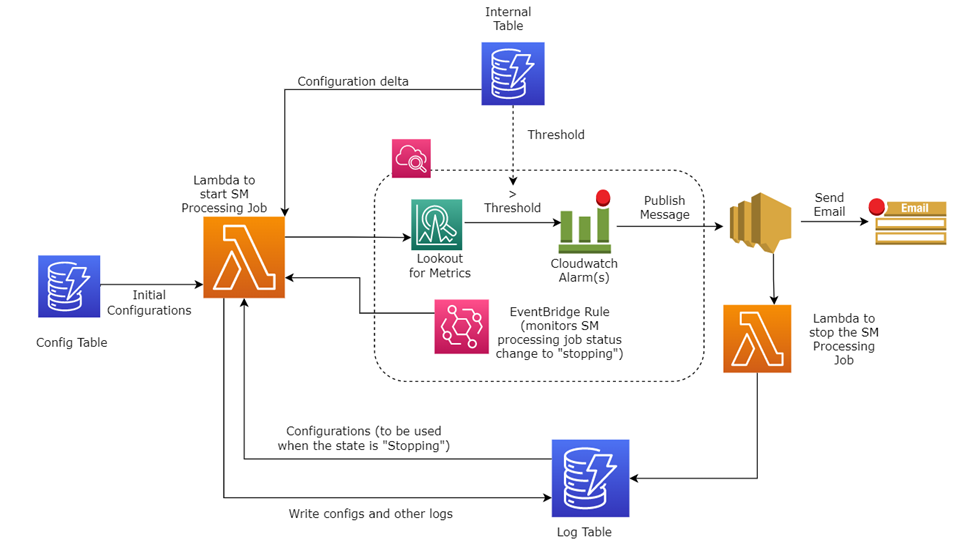

La solución creada por Vericast para resolver este problema utiliza varios servicios de AWS que trabajan juntos para alcanzar sus objetivos comerciales. Fue diseñado para reiniciar y ampliar el clúster de procesamiento de SageMaker en función de las métricas de rendimiento observadas mediante funciones de Lambda que supervisan los trabajos. Para no perder trabajo cuando ocurre un evento de escalado o para recuperarse de un trabajo que se detiene inesperadamente, se implementó un servicio basado en puntos de control que utiliza Amazon DynamoDB y almacena los datos procesados parcialmente en Servicio de almacenamiento simple de Amazon (Amazon S3) cubos a medida que se completan los pasos. El resultado final es una solución autoescalable, robusta y monitoreada dinámicamente.

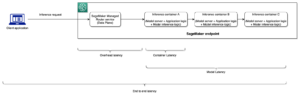

El siguiente diagrama muestra una descripción general de alto nivel de cómo funciona el sistema.

En las siguientes secciones, analizamos los componentes de la solución con más detalle.

Inicializando la solución

El sistema asume que un proceso separado inicia la solución. Por el contrario, este diseño no está diseñado para funcionar solo porque no producirá ningún artefacto o salida, sino que actúa como una implementación secundaria para uno de los sistemas que usan trabajos de procesamiento de SageMaker. En el caso de Vericast, la solución se inicia mediante una llamada desde un paso de Step Functions iniciado en otro módulo del sistema más grande.

Una vez que se inicia la solución y se activa una primera ejecución, se lee una configuración estándar básica de una tabla de DynamoDB. Esta configuración se utiliza para establecer parámetros para el trabajo de procesamiento de SageMaker y tiene las suposiciones iniciales de las necesidades de infraestructura. Ahora se inicia el trabajo de procesamiento de SageMaker.

Monitoreo de metadatos y salida

Cuando se inicia el trabajo, una función de Lambda escribe los metadatos de procesamiento del trabajo (la configuración actual del trabajo y otra información de registro) en la tabla de registro de DynamoDB. Esta información de metadatos y registro mantiene un historial del trabajo, su configuración inicial y en curso, y otros datos importantes.

En ciertos puntos, a medida que se completan los pasos en el trabajo, los datos del punto de control se agregan a la tabla de registro de DynamoDB. Los datos de salida procesados se mueven a Amazon S3 para una recuperación rápida si es necesario.

Esta función de Lambda también configura un Puente de eventos de Amazon regla que supervisa el estado del trabajo en ejecución. Específicamente, esta regla está observando el trabajo para observar si el estado del trabajo cambia a stopping o está en un stopped estado. Esta regla de EventBridge desempeña un papel importante en el reinicio de un trabajo si se produce un error o se produce un evento de escalado automático planificado.

Monitoreo de métricas de CloudWatch

La función de Lambda también configura una alarma de CloudWatch basada en una expresión matemática de métrica en el trabajo de procesamiento, que monitorea las métricas de todas las instancias para la utilización de la CPU, la utilización de la memoria y la utilización del disco. Este tipo de alarma (métrica) utiliza umbrales de alarma de CloudWatch. La alarma genera eventos basados en el valor de la métrica o expresión relativa a los umbrales durante varios períodos de tiempo.

En el caso de uso de Vericast, la expresión de umbral está diseñada para considerar las instancias del controlador y del ejecutor como separadas, con métricas monitoreadas individualmente para cada una. Al tenerlos separados, Vericast sabe cuál está causando la alarma. Esto es importante para decidir cómo escalar en consecuencia:

- Si las métricas del ejecutor superan el umbral, es bueno escalar horizontalmente

- Si las métricas del controlador cruzan el umbral, escalar horizontalmente probablemente no ayudará, por lo que debemos escalar verticalmente

Expresión de métricas de alarma

Vericast puede acceder a las siguientes métricas en su evaluación de escalamiento y falla:

- CPUUtilización – La suma de la utilización de cada núcleo de CPU individual

- MemoriaUtilización – El porcentaje de memoria que utilizan los contenedores en una instancia

- Utilización de disco – El porcentaje de espacio en disco utilizado por los contenedores en una instancia

- Uso de GPU – El porcentaje de unidades de GPU que utilizan los contenedores en una instancia

- Utilización de memoria GPU – El porcentaje de memoria GPU utilizada por los contenedores en una instancia

Al escribir estas líneas, Vericast solo considera CPUUtilization, MemoryUtilizationy DiskUtilization. En el futuro, tienen la intención de considerar GPUUtilization y GPUMemoryUtilization .

El siguiente código es un ejemplo de una alarma de CloudWatch basada en una expresión matemática métrica para el escalado automático de Vericast:

Esta expresión ilustra que la alarma de CloudWatch está considerando DriverMemoryUtilization (memoryDriver), CPUUtilization (cpuDriver), DiskUtilization (diskDriver), ExecutorMemoryUtilization (memoryExec), CPUUtilization (cpuExec)y DiskUtilization (diskExec) como métricas de seguimiento. El número 80 en la expresión anterior representa el valor umbral.

Aquí, IF((cpuDriver) > 80, 1, 0 implica que si la utilización de la CPU del controlador supera el 80 %, se asigna 1 como umbral; de lo contrario, 0. IF(AVG(METRICS("memoryExec")) > 80, 1, 0 implica que todas las métricas con cadena memoryExec en él se consideran y se calcula un promedio sobre eso. Si ese porcentaje promedio de uso de memoria supera los 80, se asigna 1 como umbral; de lo contrario, 0.

El operador lógico OR se utiliza en la expresión para unificar todas las utilizaciones de la expresión; si alguna de las utilizaciones alcanza su umbral, activa la alarma.

Para obtener más información sobre el uso de alarmas de métricas de CloudWatch basadas en expresiones matemáticas de métricas, consulte Creación de una alarma de CloudWatch basada en una expresión matemática métrica.

Limitaciones de alarma de CloudWatch

CloudWatch limita la cantidad de métricas por alarma a 10. Esto puede causar limitaciones si necesita considerar más métricas que esta.

Para superar esta limitación, Vericast ha configurado alarmas basadas en el tamaño general del clúster. Se crea una alarma por cada tres instancias (para tres instancias, habrá una alarma porque sumaría nueve métricas). Suponiendo que la instancia del controlador se considere por separado, se crea otra alarma separada para la instancia del controlador. Por lo tanto, el número total de alarmas que se crean es aproximadamente equivalente a un tercio del número de nodos ejecutores y uno adicional para la instancia del controlador. En cada caso, el número de métricas por alarma está por debajo del límite de 10 métricas.

Qué pasa cuando estás en estado de alarma

Si se alcanza un umbral predeterminado, la alarma pasa a un alarm Estado, que utiliza Servicio de notificación simple de Amazon (Amazon SNS) para enviar notificaciones. En este caso, envía una notificación por correo electrónico a todos los suscriptores con los detalles sobre la alarma en el mensaje.

Amazon SNS también se utiliza como desencadenante de una función de Lambda que detiene el trabajo de procesamiento de SageMaker que se está ejecutando actualmente porque sabemos que el trabajo probablemente fallará. Esta función también registra registros en la tabla de registros relacionados con el evento.

La regla de EventBridge configurada al inicio del trabajo notará que el trabajo ha entrado en un stopping estado unos segundos más tarde. Luego, esta regla vuelve a ejecutar la primera función de Lambda para reiniciar el trabajo.

El proceso de escalado dinámico

La primera función Lambda después de ejecutarse dos o más veces sabrá que un trabajo anterior ya se inició y ahora se detuvo. La función pasará por un proceso similar de obtener la configuración base del trabajo original en la tabla de registro de DynamoDB y también recuperará la configuración actualizada de la tabla interna. Esta configuración actualizada es una configuración delta de recursos que se establece en función del tipo de escalado. El tipo de escala se determina a partir de los metadatos de la alarma, como se describió anteriormente.

Se utiliza la configuración original más el delta de recursos porque se inicia una nueva configuración y un nuevo trabajo de procesamiento de SageMaker con los recursos aumentados.

Este proceso continúa hasta que el trabajo se completa con éxito y puede resultar en múltiples reinicios según sea necesario, agregando más recursos cada vez.

El resultado de Vericast

Esta solución de escalado automático personalizado ha sido fundamental para hacer que la plataforma de aprendizaje automático de Vericast sea más robusta y tolerante a fallas. La plataforma ahora puede manejar cargas de trabajo de diferentes volúmenes de datos con una mínima intervención humana.

Antes de implementar esta solución, estimar los requisitos de recursos para todos los módulos basados en Spark en proceso era uno de los mayores cuellos de botella del proceso de incorporación de nuevos clientes. Los flujos de trabajo fallarían si el volumen de datos del cliente aumentara, o el costo sería injustificable si el volumen de datos disminuyera en producción.

Con la implementación de este nuevo módulo, las fallas en el flujo de trabajo debido a limitaciones de recursos se han reducido en casi un 80 %. Las pocas fallas restantes se deben principalmente a las restricciones de la cuenta de AWS y más allá del proceso de escalado automático. La mayor victoria de Vericast con esta solución es la facilidad con la que pueden incorporar nuevos clientes y flujos de trabajo. Vericast espera acelerar el proceso en al menos un 60-70 %, y aún no se han recopilado datos para una cifra final.

Aunque Vericast lo considera un éxito, tiene un costo. Según la naturaleza de este módulo y el concepto de escalado dinámico en su conjunto, los flujos de trabajo tienden a tardar alrededor de un 30 % más (caso promedio) que un flujo de trabajo con un clúster personalizado para cada módulo del flujo de trabajo. Vericast continúa optimizando en esta área, buscando mejorar la solución mediante la incorporación de inicialización de recursos basada en heurística para cada módulo de cliente.

Sharmo Sarkar, gerente sénior, plataforma de aprendizaje automático en Vericast, dice: “A medida que continuamos expandiendo nuestro uso de AWS y SageMaker, quería tomarme un momento para resaltar el increíble trabajo de nuestro equipo de servicios al cliente de AWS, arquitectos de soluciones de AWS dedicados, y los servicios profesionales de AWS con los que trabajamos. Su profundo conocimiento de AWS y SageMaker nos permitió diseñar una solución que satisfizo todas nuestras necesidades y nos brindó la flexibilidad y la escalabilidad que necesitábamos. Estamos muy agradecidos de tener un equipo de apoyo tan talentoso y bien informado de nuestro lado”.

Conclusión

En esta publicación, compartimos cómo SageMaker y SageMaker Processing han permitido a Vericast crear un marco de procesamiento de datos administrado, eficiente y rentable para grandes volúmenes de datos. Al combinar el poder y la flexibilidad de SageMaker Processing con otros servicios de AWS, pueden monitorear fácilmente el proceso generalizado de ingeniería de funciones. Pueden detectar automáticamente posibles problemas generados por la falta de cómputo, memoria y otros factores, e implementar automáticamente la escala vertical y horizontal según sea necesario.

SageMaker y sus herramientas también pueden ayudar a su equipo a alcanzar sus objetivos de aprendizaje automático. Para obtener más información sobre el procesamiento de SageMaker y cómo puede ayudarlo en sus cargas de trabajo de procesamiento de datos, consulte Procesar datos. Si recién está comenzando con ML y está buscando ejemplos y orientación, JumpStart de Amazon SageMaker puede ayudarte a empezar. JumpStart es un centro de aprendizaje automático desde el que puede acceder a algoritmos integrados con modelos de base entrenados previamente para ayudarlo a realizar tareas como el resumen de artículos y la generación de imágenes y soluciones prediseñadas para resolver casos de uso comunes.

Finalmente, si esta publicación lo ayuda o lo inspira a resolver un problema, ¡nos encantaría saberlo! Por favor comparta sus comentarios y opiniones.

Acerca de los autores

antonio mcclure es Arquitecto Senior de Soluciones de Socios del equipo de AWS SaaS Factory. Anthony también tiene un gran interés en el aprendizaje automático y la inteligencia artificial trabajando con la comunidad de campo técnico de ML/IA de AWS para ayudar a los clientes a hacer realidad sus soluciones de aprendizaje automático.

antonio mcclure es Arquitecto Senior de Soluciones de Socios del equipo de AWS SaaS Factory. Anthony también tiene un gran interés en el aprendizaje automático y la inteligencia artificial trabajando con la comunidad de campo técnico de ML/IA de AWS para ayudar a los clientes a hacer realidad sus soluciones de aprendizaje automático.

Jyoti Sharma es ingeniero de ciencia de datos en el equipo de la plataforma de aprendizaje automático de Vericast. Le apasionan todos los aspectos de la ciencia de datos y se enfoca en diseñar e implementar una plataforma de aprendizaje automático altamente escalable y distribuida.

Jyoti Sharma es ingeniero de ciencia de datos en el equipo de la plataforma de aprendizaje automático de Vericast. Le apasionan todos los aspectos de la ciencia de datos y se enfoca en diseñar e implementar una plataforma de aprendizaje automático altamente escalable y distribuida.

sharmo sarkar es Gerente Senior en Vericast. Dirige los equipos de I+D de Cloud Machine Learning Platform y Marketing Platform ML en Vericast. Tiene una amplia experiencia en Big Data Analytics, Computación Distribuida y Procesamiento de Lenguaje Natural. Fuera del trabajo, disfruta del motociclismo, el senderismo y el ciclismo en senderos de montaña.

sharmo sarkar es Gerente Senior en Vericast. Dirige los equipos de I+D de Cloud Machine Learning Platform y Marketing Platform ML en Vericast. Tiene una amplia experiencia en Big Data Analytics, Computación Distribuida y Procesamiento de Lenguaje Natural. Fuera del trabajo, disfruta del motociclismo, el senderismo y el ciclismo en senderos de montaña.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoAiStream. Inteligencia de datos Web3. Conocimiento amplificado. Accede Aquí.

- Acuñando el futuro con Adryenn Ashley. Accede Aquí.

- Compra y Vende Acciones en Empresas PRE-IPO con PREIPO®. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/how-vericast-optimized-feature-engineering-using-amazon-sagemaker-processing/

- :posee

- :es

- :no

- :dónde

- $ UP

- 1

- 10

- 100

- 15%

- 7

- a

- Nuestra Empresa

- de la máquina

- en consecuencia

- Mi Cuenta

- Lograr

- Activación

- hechos

- add

- adicional

- la adición de

- Adicionales

- adecuadamente

- Después

- en contra

- SIDA

- paquete de capacitación DWoVH

- alarma

- algoritmo

- algoritmos

- Todos

- solo

- a lo largo de

- ya haya utilizado

- también

- Amazon

- Amazon SageMaker

- cantidad

- an

- Analytics

- y

- Otra

- Antonio

- cualquier

- abejas

- adecuado

- arquitectura

- somos

- Reservada

- en torno a

- artículo

- artificial

- inteligencia artificial

- AS

- aspecto

- aspectos

- asigna

- ayudar

- At

- auto

- automatizado

- automáticamente

- promedio

- AWS

- Servicios profesionales de AWS

- bases

- basado

- BE

- porque

- a las que has recomendado

- esto

- "Ser"

- beneficios

- MEJOR

- Más allá de

- Big

- Big Data

- Mayor

- empujón

- ambas

- Trayendo

- build

- Construir la

- construido

- incorporado

- pero

- by

- calculado

- llamar al

- Campaña

- PUEDEN

- Puede conseguir

- Capturando

- case

- cases

- Causa

- causando

- a ciertos

- desafiante

- Cambios

- clase

- privadas

- clasificación

- cliente

- incorporación de clientes

- clientes

- Soluciones

- Médico

- código

- Columna

- combinación

- combinar

- proviene

- comentarios

- Algunos

- vibrante e inclusiva

- compañía

- completar

- ultima

- complejidad

- Complicado

- componentes

- Comprometida

- Calcular

- informática

- concepto

- conceptos

- Configuración

- Considerar

- considerado

- en vista de

- considera

- restricciones

- que no contengo

- Contenedores

- continue

- continúa

- Cost

- rentable

- podría

- cupón

- Para crear

- creado

- creación

- criterios

- Cruz

- Current

- En la actualidad

- personalizado

- cliente

- Clientes

- datos

- Data Analytics

- Preparación de datos

- proceso de datos

- Ciencia de los datos

- científico de datos

- basada en datos

- conjuntos de datos

- decidir

- decisiones

- a dedicados

- profundo

- Delta

- Demografía

- dependiente

- despliegue

- descrito

- Diseño

- diseñado

- diseño

- detalle

- detalles

- determina

- Desarrollo

- una experiencia diferente

- A diferencia

- Dificultad

- de reservas

- El descuento

- discutir

- distribuidos

- Computación distribuída

- impulsados

- conductor

- dos

- lugar de trabajo dinámico

- dinamicamente

- cada una

- Más temprano

- facilidad

- pasan fácilmente

- ya sea

- facilita

- permite

- ingeniero

- Ingeniería

- certificados

- asegura

- Todo

- Entorno

- ambientes

- igual

- Equivalente a

- evaluar

- evaluación

- evaluación

- Evento

- Eventos

- ejemplo

- ejemplos

- Excepto

- existente

- Expandir

- esperado

- espera

- experience

- Explorar

- expresiones

- en los detalles

- Amplia experiencia

- factores importantes

- personal

- FALLO

- Fracaso

- Feature

- Caracteristicas

- Fed

- realimentación

- pocos

- campo

- final

- finalizado

- Nombre

- cómodo

- Flexibilidad

- flexible

- centrado

- siguiendo

- siguiente

- Formularios

- Fundación

- Marco conceptual

- Desde

- completamente

- función

- funciones

- Además

- futuras

- reunión

- General

- generado

- genera

- generación de AHSS

- obtener

- conseguir

- dado

- Go

- objetivo

- Goals

- Va

- candidato

- GPU

- agradecido

- guía

- tenido

- encargarse de

- que sucede

- Tienen

- es

- he

- oír

- pesado

- levantar objetos pesados

- ayuda

- ayuda

- de alto nivel

- alta calidad

- Destacar

- altamente

- historia

- Horizontal

- horizontalmente

- Cómo

- Como Hacer

- Sin embargo

- HTML

- http

- HTTPS

- Bujes

- humana

- Obstáculos

- i

- no haber aun identificado una solucion para el problema

- if

- ilustra

- imagen

- implementar

- implementación

- implementación

- importante

- mejorar

- in

- En otra

- incluye

- Incluye

- incorporando

- aumente

- aumentado

- la increíble calidad de

- INSTRUMENTO individual

- Individualmente

- información

- EN LA MINA

- inicial

- Iniciados

- ejemplo

- instrumental

- Intelligence

- la intención de

- intereses

- Interfaz

- interno

- intervención

- dentro

- involucra

- cuestiones

- IT

- SUS

- Trabajos

- Empleo

- jpg

- solo

- Tipo

- Saber

- Falta

- idioma

- large

- principalmente

- mayores

- luego

- Prospectos

- APRENDE:

- aprendizaje

- menos

- Biblioteca

- cirugía estética

- la limitación

- limitaciones

- límites

- Etiqueta LinkedIn

- Lista

- pequeño

- log

- registro

- lógico

- por más tiempo

- mirando

- perder

- amar

- máquina

- máquina de aprendizaje

- mantener

- Mantener los

- mantiene

- para lograr

- HACE

- Realizar

- gestionado

- gerente

- manipulado

- manera

- muchos

- Marketing

- las matemáticas

- Puede..

- Conoce a

- Salud Cerebral

- mensaje

- metadatos

- métrico

- Métrica

- podría

- mente

- mínimo

- ML

- modelo

- modelos

- Módulo

- Módulos

- momento

- Monitorear

- monitoreado

- monitoreo

- monitores

- más,

- MEJOR DE TU

- cuales son las que reflejan

- Montaña

- múltiples

- debe

- Natural

- Procesamiento natural del lenguaje

- Naturaleza

- ¿ Necesita ayuda

- necesidad

- Nuevo

- nodos

- notablemente

- Aviso..

- .

- notificaciones

- ahora

- número

- ,

- observar

- of

- a menudo

- on

- On-Demand

- A bordo

- Inmersión

- ONE

- en marcha

- , solamente

- operador

- óptimo

- Optimización

- optimizado

- or

- reconocida por

- Otro

- "nuestr

- salir

- Resultado

- salida

- afuera

- Más de

- total

- Superar

- visión de conjunto

- parámetros

- parte

- particular

- Socio

- Pasando (Paso)

- apasionado

- Patrón de Costura

- porcentaje

- Realizar

- actuación

- quizás

- períodos

- la perspectiva

- imagen

- industrial

- Colocar

- planificado

- plataforma

- Plataformas

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- Jugar

- juega

- Por favor

- más

- punto

- puntos

- pobre

- posible

- Publicación

- posible

- industria

- predecir

- anterior

- probablemente

- Problema

- problemas

- Procesado

- tratamiento

- producir

- Producto

- Producción

- Profesional

- proporcionar

- previsto

- proporciona un

- poner

- calidad

- Búsqueda

- más rápido

- I + D

- más bien

- Crudo

- en comunicarse

- Leer

- ready

- Realidad

- razón

- archivos

- Recuperar

- recuperación

- Reducción

- se refiere

- relacionado

- permanecer

- restante

- reporte

- Requisitos

- Requisitos

- Recurso

- Recursos

- Responder

- resultado

- resultante

- robusto

- Función

- aproximadamente

- Regla

- Ejecutar

- correr

- SaaS

- sabio

- mismo

- dice

- Escalabilidad

- escalable

- Escala

- la ampliación

- Solución de escala

- escenarios

- Ciencia:

- Científico

- los científicos

- segundos

- (secciones)

- seleccionado

- selección

- envío

- envía

- mayor

- Sensibilidad

- separado

- separación

- de coches

- Servicios

- set

- Sets

- Varios

- Compartir

- compartido

- Sharma

- ella

- mostrado

- Shows

- lado

- importante

- similares

- sencillos

- Tamaño

- So

- a medida

- Soluciones

- RESOLVER

- Espacio

- soluciones y

- específicamente

- velocidad

- Girar

- etapas

- estándar

- es la

- comienzo

- fundó

- comienza

- Estado

- Estado

- paso

- pasos

- Sin embargo

- detenido

- parada

- Paradas

- STORAGE

- tiendas

- Cordón

- fuerte

- estructurado

- suscriptores

- comercial

- Con éxito

- tal

- SOPORTE

- te

- Todas las funciones a su disposición

- mesa

- adaptado

- ¡Prepárate!

- toma

- talentosos

- Tarea

- tareas

- equipo

- equipos

- Técnico

- términos

- que

- esa

- La

- El futuro de las

- su

- Les

- luego

- Ahí.

- por lo tanto

- Estas

- ellos

- Código

- así

- aquellos

- Tres

- umbral

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- equipo

- veces

- a

- juntos

- Total

- Entrenar

- Formación

- transaccional

- Detalles de la transacción

- Transformar

- transformaciones

- detonante

- desencadenados

- dos

- tipo

- principiante

- bajo

- comprensión

- unidades que

- hasta

- actualizado

- us

- usable

- Uso

- utilizan el

- caso de uso

- usado

- usando

- validación

- propuesta de

- diversos

- vertical

- volumen

- volúmenes

- vs

- deseado

- fue

- ver

- Camino..

- we

- WELL

- cuando

- que

- QUIENES

- todo

- totalmente

- seguirá

- ganar

- dentro de

- Actividades:

- flujos de trabajo

- trabajando

- funciona

- peor

- se

- la escritura

- aún

- Rendimiento

- Usted

- tú

- zephyrnet