AutoML le permite obtener información general y rápida a partir de sus datos justo al comienzo del ciclo de vida de un proyecto de aprendizaje automático (ML). Comprender desde el principio qué técnicas de preprocesamiento y tipos de algoritmos proporcionan mejores resultados reduce el tiempo para desarrollar, entrenar e implementar el modelo correcto. Desempeña un papel crucial en el proceso de desarrollo de cada modelo y permite a los científicos de datos centrarse en las técnicas de ML más prometedoras. Además, AutoML proporciona un modelo de rendimiento básico que puede servir como punto de referencia para el equipo de ciencia de datos.

Una herramienta AutoML aplica una combinación de diferentes algoritmos y varias técnicas de preprocesamiento a sus datos. Por ejemplo, puede escalar los datos, realizar una selección de características univariadas, realizar PCA en diferentes niveles de umbral de variación y aplicar agrupación. Estas técnicas de preprocesamiento podrían aplicarse individualmente o combinarse en una tubería. Posteriormente, una herramienta de AutoML entrenaría diferentes tipos de modelos, como regresión lineal, Elastic-Net o bosque aleatorio, en diferentes versiones de su conjunto de datos preprocesado y realizaría una optimización de hiperparámetros (HPO). Piloto automático Amazon SageMaker elimina el trabajo pesado de construir modelos ML. Después de proporcionar el conjunto de datos, SageMaker Autopilot explora automáticamente diferentes soluciones para encontrar el mejor modelo. Pero, ¿qué sucede si desea implementar su versión personalizada de un flujo de trabajo de AutoML?

Esta publicación muestra cómo crear un flujo de trabajo de AutoML personalizado en Amazon SageMaker usando Ajuste automático de modelos de Amazon SageMaker con código de muestra disponible en un Repo de GitHub.

Resumen de la solución

Para este caso de uso, supongamos que usted es parte de un equipo de ciencia de datos que desarrolla modelos en un dominio especializado. Ha desarrollado un conjunto de técnicas de preprocesamiento personalizadas y ha seleccionado una serie de algoritmos que normalmente espera que funcionen bien con su problema de aprendizaje automático. Cuando trabaje en nuevos casos de uso de ML, primero le gustaría realizar una ejecución de AutoML utilizando sus técnicas y algoritmos de preprocesamiento para limitar el alcance de las posibles soluciones.

Para este ejemplo, no utiliza un conjunto de datos especializado; en su lugar, trabaja con el conjunto de datos de Vivienda de California que importará desde Servicio de almacenamiento simple de Amazon (Amazon S3). El objetivo es demostrar la implementación técnica de la solución utilizando SageMaker HPO, que luego se puede aplicar a cualquier conjunto de datos y dominio.

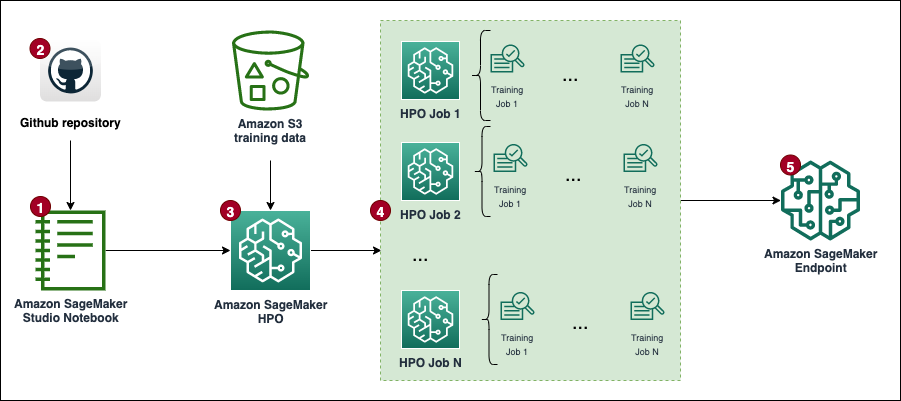

El siguiente diagrama presenta el flujo de trabajo general de la solución.

Requisitos previos

Los siguientes son requisitos previos para completar el tutorial de esta publicación:

Implementar la solución

El código completo está disponible en el Repositorio GitHub.

Los pasos para implementar la solución (como se indica en el diagrama de flujo de trabajo) son los siguientes:

- Crear una instancia de cuaderno y especifique lo siguiente:

- Tipo de instancia de cuaderno, escoger ml.t3.medio.

- Inferencia elástica, escoger ninguna.

- Identificador de plataforma, escoger Amazon Linux 2, laboratorio Jupyter 3.

- Rol de IAM, elige el valor predeterminado

AmazonSageMaker-ExecutionRole. Si no existe, crea uno nuevo. Gestión de identidades y accesos de AWS (IAM) y adjuntar el Política de IAM de AmazonSageMakerFullAccess.

Tenga en cuenta que debe crear una política y una función de ejecución de alcance mínimo en producción.

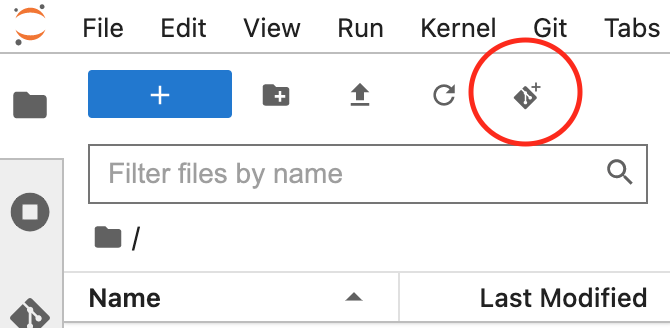

- Abra la interfaz de JupyterLab para su instancia de notebook y clone el repositorio de GitHub.

Puede hacerlo iniciando una nueva sesión de terminal y ejecutando el git clone <REPO> comando o utilizando la funcionalidad de la interfaz de usuario, como se muestra en la siguiente captura de pantalla.

- Abra la

automl.ipynbarchivo de cuaderno, seleccione elconda_python3kernel y siga las instrucciones para activar un conjunto de trabajos de HPO.

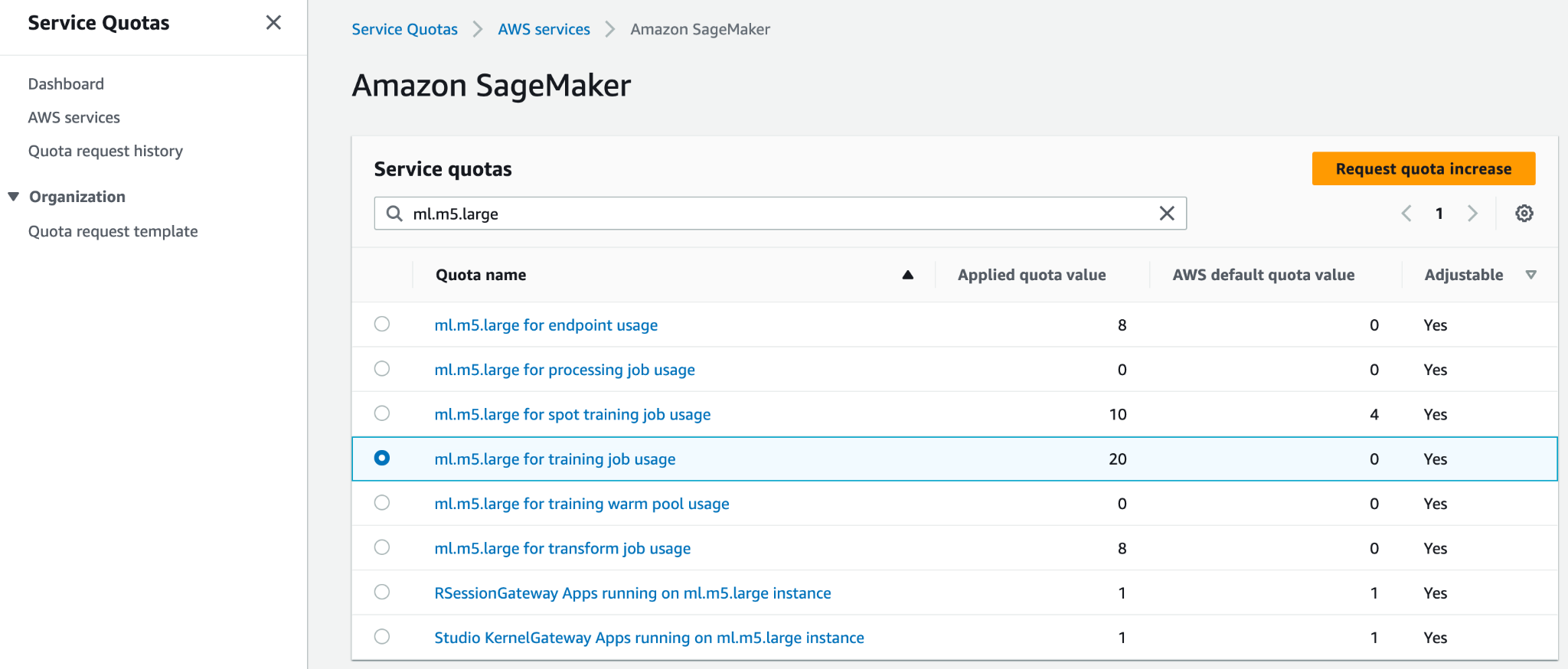

Para ejecutar el código sin ningún cambio, debe aumentar la cuota de servicio para ml.m5.large para uso en trabajos de capacitación y Número de instancias en todos los trabajos de entrenamiento. AWS permite de forma predeterminada solo 20 trabajos de capacitación de SageMaker paralelos para ambas cuotas. Es necesario solicitar un aumento de cuota a 30 para ambos. Por lo general, ambos cambios de cuota deberían aprobarse en unos minutos. Referirse a Solicitar un aumento de cuota para obtener más información.

Si no desea cambiar la cuota, simplemente puede modificar el valor de la MAX_PARALLEL_JOBS variable en el script (por ejemplo, a 5).

- Cada trabajo de HPO completará un conjunto de La capacitación laboral ensayos e indicar el modelo con hiperparámetros óptimos.

- Analizar los resultados y implementar el modelo de mejor rendimiento.

Esta solución generará costos en su cuenta de AWS. El coste de esta solución dependerá del número y duración de los trabajos de formación de HPO. A medida que estos aumenten, también lo hará el costo. Puede reducir costos limitando el tiempo de capacitación y configurando TuningJobCompletionCriteriaConfig de acuerdo con las instrucciones que se analizan más adelante en esta publicación. Para obtener información sobre precios, consulte Precios de Amazon SageMaker.

En las siguientes secciones, analizamos el cuaderno con más detalle con ejemplos de código y los pasos para analizar los resultados y seleccionar el mejor modelo.

Configuración inicial

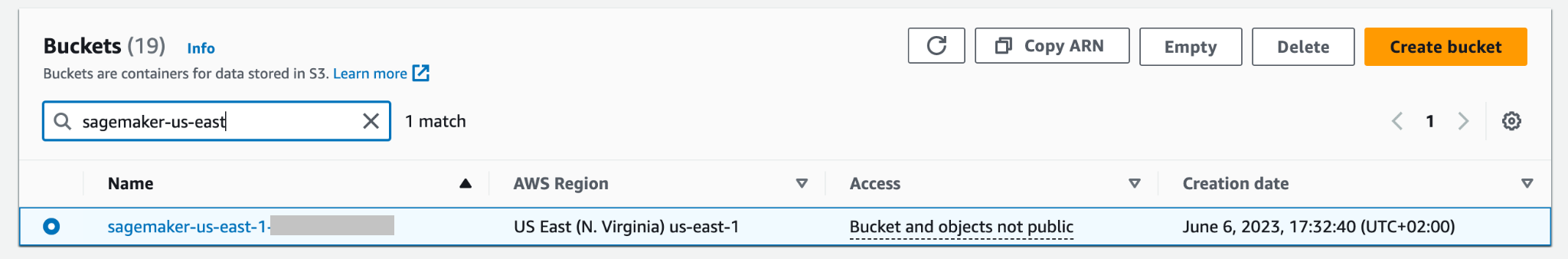

Comencemos ejecutando el Importaciones y configuración sección en el custom-automl.ipynb computadora portátil. Instala e importa todas las dependencias requeridas, crea una instancia de una sesión y un cliente de SageMaker y establece la región predeterminada y el depósito S3 para almacenar datos.

Preparación de datos

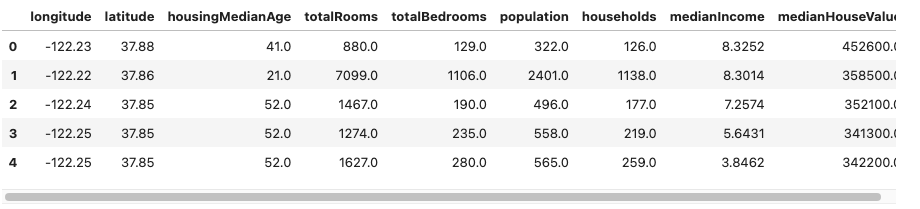

Descargue el conjunto de datos de Vivienda de California y prepárelo ejecutando el Descarga de datos sección del cuaderno. El conjunto de datos se divide en marcos de datos de entrenamiento y prueba y se carga en el depósito S3 predeterminado de la sesión de SageMaker.

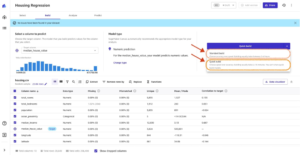

Todo el conjunto de datos tiene 20,640 registros y 9 columnas en total, incluido el objetivo. El objetivo es predecir el valor medio de una casa (medianHouseValue columna). La siguiente captura de pantalla muestra las filas superiores del conjunto de datos.

Plantilla de guión de entrenamiento

El flujo de trabajo de AutoML en esta publicación se basa en scikit-aprender canalizaciones y algoritmos de preprocesamiento. El objetivo es generar una gran combinación de diferentes canales de preprocesamiento y algoritmos para encontrar la configuración con mejor rendimiento. Comencemos por crear un script de capacitación genérico, que persiste localmente en la instancia del cuaderno. En este script, hay dos bloques de comentarios vacíos: uno para inyectar hiperparámetros y el otro para el objeto de canalización del modelo de preprocesamiento. Se inyectarán dinámicamente para cada candidato a modelo de preprocesamiento. El propósito de tener un script genérico es mantener la implementación SECO (no lo repita).

Crear preprocesamiento y combinaciones de modelos.

La preprocessors El diccionario contiene una especificación de técnicas de preprocesamiento aplicadas a todas las características de entrada del modelo. Cada receta se define mediante un Pipeline o un FeatureUnion Objeto de scikit-learn, que encadena transformaciones de datos individuales y las apila. Por ejemplo, mean-imp-scale es una receta simple que garantiza que los valores faltantes se imputen utilizando los valores medios de las columnas respectivas y que todas las características se escale utilizando el Escalador estándar. En contraste, el mean-imp-scale-pca La receta encadena algunas operaciones más:

- Imputa los valores faltantes en las columnas con su media.

- Aplicar escala de características utilizando la media y la desviación estándar.

- Calcule PCA sobre los datos de entrada en un valor de umbral de varianza específico y combínelo con las características de entrada imputadas y escaladas.

En esta publicación, todas las funciones de entrada son numéricas. Si tiene más tipos de datos en su conjunto de datos de entrada, debe especificar una canalización más complicada donde se apliquen diferentes ramas de preprocesamiento a diferentes conjuntos de tipos de características.

La models El diccionario contiene especificaciones de diferentes algoritmos a los que se ajusta el conjunto de datos. Cada tipo de modelo viene con la siguiente especificación en el diccionario:

- salida_script – Señala la ubicación del guión de entrenamiento utilizado por el estimador. Este campo se completa dinámicamente cuando el

modelsEl diccionario se combina con elpreprocessorsdiccionario. - inserciones – Define el código que se insertará en el

script_draft.pyy posteriormente guardado enscript_output. La clave“preprocessor”se deja en blanco intencionalmente porque esta ubicación se llena con uno de los preprocesadores para crear múltiples combinaciones de modelo-preprocesador. - hiperparámetros – Un conjunto de hiperparámetros optimizados por el trabajo de HPO.

- incluir_cls_metadatos – Más detalles de configuración requeridos por SageMaker

Tunerclase.

Un ejemplo completo de la models El diccionario está disponible en el repositorio de GitHub.

A continuación, repitamos el preprocessors y models diccionarios y crear todas las combinaciones posibles. Por ejemplo, si tu preprocessors El diccionario contiene 10 recetas y tienes 5 definiciones de modelos en el models diccionario, el diccionario de canalizaciones recién creado contiene 50 canalizaciones de modelo de preprocesador que se evalúan durante HPO. Tenga en cuenta que los scripts de canalización individuales aún no se han creado en este momento. El siguiente bloque de código (celda 9) del cuaderno Jupyter recorre en iteración todos los objetos del modelo de preprocesador en el pipelines diccionario, inserta todas las piezas de código relevantes y conserva una versión específica del script localmente en el cuaderno. Esos scripts se utilizan en los siguientes pasos al crear estimadores individuales que conecta al trabajo de HPO.

Definir estimadores

Ahora puede trabajar en la definición de los estimadores de SageMaker que utiliza el trabajo de HPO una vez que los scripts estén listos. Comencemos creando una clase contenedora que defina algunas propiedades comunes para todos los estimadores. Hereda de la SKLearn clase y especifica la función, el número de instancias y el tipo, así como qué columnas utiliza el script como características y el destino.

Construyamos el estimators diccionario iterando a través de todos los scripts generados antes y ubicados en el scripts directorio. Se crea una instancia de un nuevo estimador usando el SKLearnBase clase, con un nombre de estimador único y uno de los scripts. Tenga en cuenta que el estimators El diccionario tiene dos niveles: el nivel superior define un pipeline_family. Esta es una agrupación lógica basada en el tipo de modelos a evaluar y es igual a la longitud del models diccionario. El segundo nivel contiene tipos de preprocesadores individuales combinados con los datos dados. pipeline_family. Esta agrupación lógica es necesaria al crear el trabajo HPO.

Definir argumentos del sintonizador HPO

Para optimizar el paso de argumentos al HPO Tuner clase, el HyperparameterTunerArgs La clase de datos se inicializa con los argumentos requeridos por la clase HPO. Viene con un conjunto de funciones que garantizan que los argumentos de HPO se devuelvan en el formato esperado al implementar múltiples definiciones de modelos a la vez.

El siguiente bloque de código utiliza el introducido anteriormente HyperparameterTunerArgs clase de datos. Creas otro diccionario llamado hp_args y generar un conjunto de parámetros de entrada específicos para cada estimator_family del desplegable estimators diccionario. Estos argumentos se utilizan en el siguiente paso al inicializar trabajos de HPO para cada familia de modelos.

Crear objetos sintonizadores HPO

En este paso, creará sintonizadores individuales para cada estimator_family. ¿Por qué crean tres trabajos de HPO separados en lugar de lanzar solo uno en todos los estimadores? El HyperparameterTuner La clase está restringida a 10 definiciones de modelo adjuntas. Por lo tanto, cada HPO es responsable de encontrar el preprocesador de mejor rendimiento para una familia de modelos determinada y ajustar los hiperparámetros de esa familia de modelos.

Los siguientes son algunos puntos más con respecto a la configuración:

- La estrategia de optimización es bayesiana, lo que significa que HPO monitorea activamente el rendimiento de todas las pruebas y orienta la optimización hacia combinaciones de hiperparámetros más prometedoras. La parada anticipada debe establecerse en DESC or Auto cuando se trabaja con una estrategia bayesiana, que maneja esa lógica por sí misma.

- Cada trabajo de HPO se ejecuta para un máximo de 100 trabajos y ejecuta 10 trabajos en paralelo. Si trabaja con conjuntos de datos más grandes, es posible que desee aumentar el número total de trabajos.

- Además, es posible que desee utilizar configuraciones que controlen cuánto tiempo se ejecuta un trabajo y cuántos trabajos activa su HPO. Una forma de hacerlo es establecer el tiempo de ejecución máximo en segundos (para esta publicación, lo configuramos en 1 hora). Otra es utilizar el recientemente lanzado

TuningJobCompletionCriteriaConfig. Ofrece un conjunto de configuraciones que monitorean el progreso de sus trabajos y deciden si es probable que más trabajos mejoren el resultado. En esta publicación, establecemos el número máximo de trabajos de capacitación que no mejoran en 20. De esa manera, si la puntuación no mejora (por ejemplo, a partir de la cuadragésima prueba), no tendrás que pagar por las pruebas restantes hastamax_jobssea alcanzado.

Ahora repitamos el tuners y hp_args diccionarios y activar todos los trabajos de HPO en SageMaker. Tenga en cuenta el uso del argumento de espera establecido en False, lo que significa que el kernel no esperará hasta que se completen los resultados y usted podrá activar todos los trabajos a la vez.

Es probable que no se completen todos los trabajos de capacitación y que algunos de ellos puedan ser detenidos por el trabajo de HPO. La razón de esto es la TuningJobCompletionCriteriaConfig—La optimización finaliza si se cumple alguno de los criterios especificados. En este caso, cuando el criterio de optimización no mejora durante 20 trabajos consecutivos.

Analizar resultados

La celda 15 del cuaderno verifica si todos los trabajos de HPO están completos y combina todos los resultados en forma de un marco de datos de pandas para su posterior análisis. Antes de analizar los resultados en detalle, echemos un vistazo de alto nivel a la consola SageMaker.

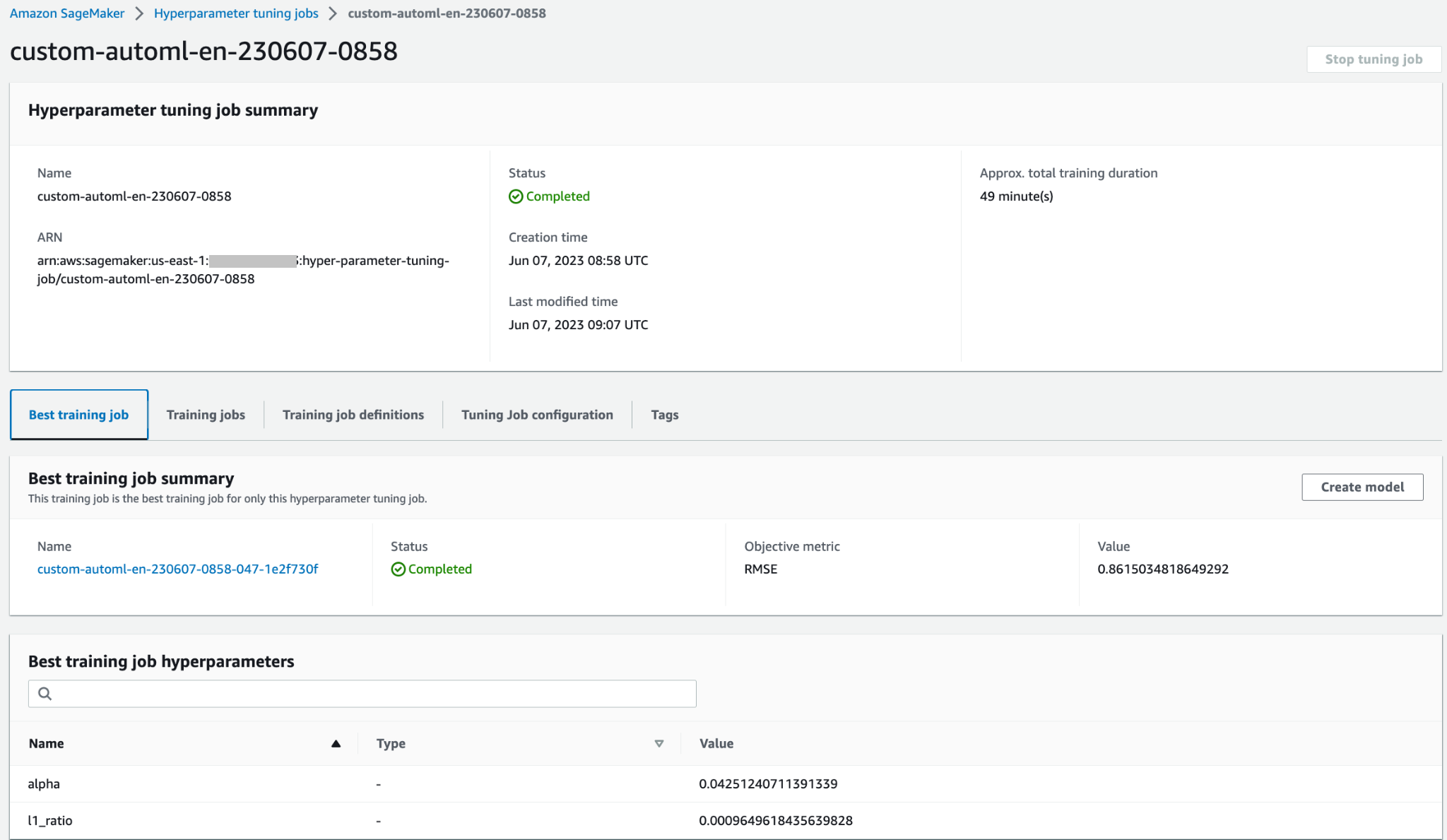

En la parte superior de la Trabajos de ajuste de hiperparámetros página, puede ver sus tres trabajos de HPO iniciados. Todos terminaron temprano y no realizaron los 100 trabajos de capacitación. En la siguiente captura de pantalla, puede ver que la familia de modelos Elastic-Net completó la mayor cantidad de pruebas, mientras que otras no necesitaron tantos trabajos de capacitación para encontrar el mejor resultado.

Puede abrir el trabajo de HPO para acceder a más detalles, como trabajos de capacitación individuales, configuración del trabajo y la mejor información y rendimiento del trabajo de capacitación.

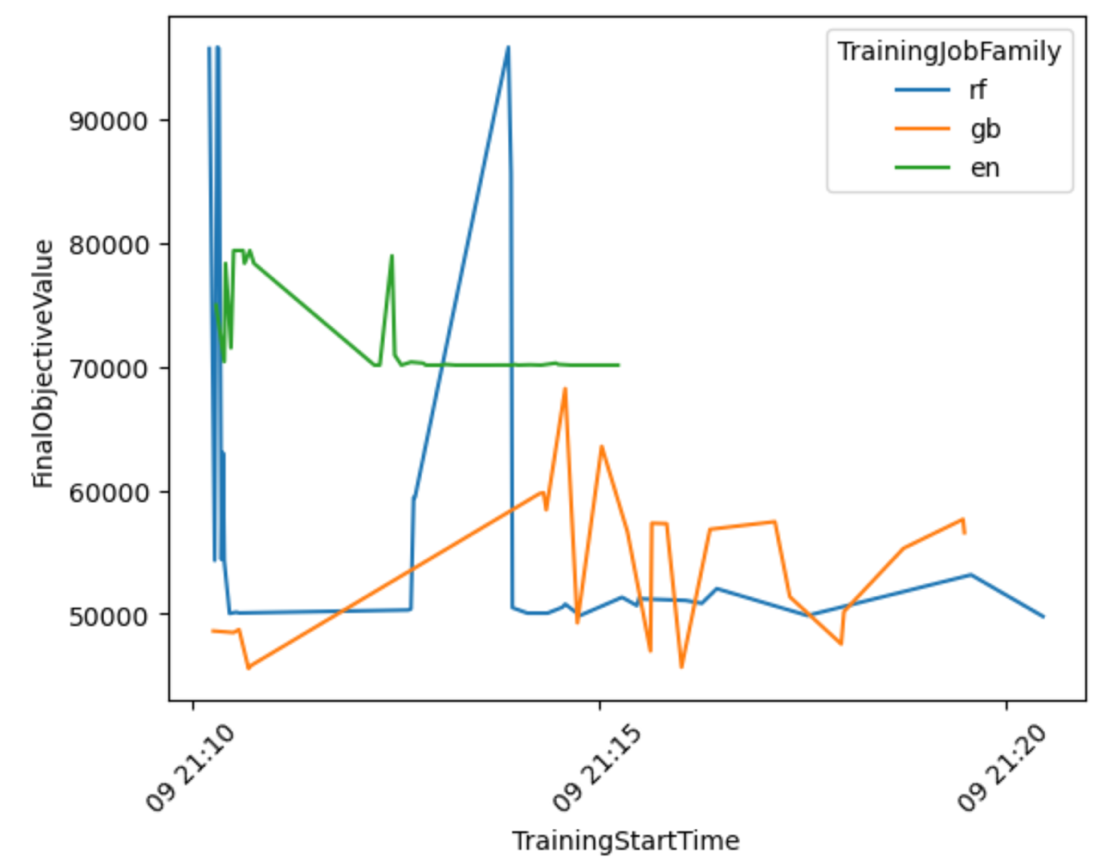

Produzcamos una visualización basada en los resultados para obtener más información sobre el rendimiento del flujo de trabajo de AutoML en todas las familias de modelos.

Del siguiente gráfico se puede concluir que el Elastic-Net El rendimiento del modelo oscilaba entre 70,000 y 80,000 RMSE y finalmente se estancó, ya que el algoritmo no pudo mejorar su rendimiento a pesar de probar varias técnicas de preprocesamiento y valores de hiperparámetros. También parece que RandomForest El rendimiento varió mucho dependiendo del conjunto de hiperparámetros explorado por HPO, pero a pesar de muchas pruebas no pudo bajar del error de 50,000 RMSE. GradientBoosting logró el mejor rendimiento desde el principio, por debajo de 50,000 RMSE. HPO intentó mejorar aún más ese resultado, pero no pudo lograr un mejor rendimiento en otras combinaciones de hiperparámetros. Una conclusión general para todos los trabajos de HPO es que no se requirieron tantos trabajos para encontrar el conjunto de hiperparámetros de mejor rendimiento para cada algoritmo. Para mejorar aún más el resultado, deberá experimentar creando más funciones y realizando ingeniería de funciones adicionales.

También puede examinar una vista más detallada de la combinación modelo-preprocesador para sacar conclusiones sobre las combinaciones más prometedoras.

Seleccione el mejor modelo e impleméntelo

El siguiente fragmento de código selecciona el mejor modelo en función del valor objetivo más bajo alcanzado. Luego puede implementar el modelo como un punto final de SageMaker.

Limpiar

Para evitar cargos no deseados en su cuenta de AWS, le recomendamos que elimine los recursos de AWS que utilizó en esta publicación:

- En la consola de Amazon S3, vacíe los datos del depósito de S3 donde se almacenaron los datos de entrenamiento.

- En la consola de SageMaker, detenga la instancia del cuaderno.

- Elimine el punto final del modelo si lo implementó. Los puntos finales deben eliminarse cuando ya no estén en uso, porque se facturan según el tiempo de implementación.

Conclusión

En esta publicación, mostramos cómo crear un trabajo HPO personalizado en SageMaker utilizando una selección personalizada de algoritmos y técnicas de preprocesamiento. En particular, este ejemplo demuestra cómo automatizar el proceso de generación de muchos scripts de capacitación y cómo usar estructuras de programación de Python para una implementación eficiente de múltiples trabajos de optimización paralelos. Esperamos que esta solución sirva de base para cualquier trabajo de ajuste de modelo personalizado que implementará con SageMaker para lograr un mayor rendimiento y acelerar sus flujos de trabajo de aprendizaje automático.

Consulte los siguientes recursos para profundizar aún más su conocimiento sobre cómo utilizar SageMaker HPO:

Acerca de los autores

Konrad Semsch es arquitecto sénior de soluciones de aprendizaje automático en el equipo del laboratorio de datos de Amazon Web Services. Ayuda a los clientes a utilizar el aprendizaje automático para resolver sus desafíos comerciales con AWS. Le gusta inventar y simplificar para brindar a los clientes soluciones simples y pragmáticas para sus proyectos de IA/ML. Lo que más le apasiona son MlOps y la ciencia de datos tradicional. Fuera del trabajo, es un gran aficionado al windsurf y al kitesurf.

Konrad Semsch es arquitecto sénior de soluciones de aprendizaje automático en el equipo del laboratorio de datos de Amazon Web Services. Ayuda a los clientes a utilizar el aprendizaje automático para resolver sus desafíos comerciales con AWS. Le gusta inventar y simplificar para brindar a los clientes soluciones simples y pragmáticas para sus proyectos de IA/ML. Lo que más le apasiona son MlOps y la ciencia de datos tradicional. Fuera del trabajo, es un gran aficionado al windsurf y al kitesurf.

Atún Ersoy es arquitecto senior de soluciones en AWS. Su objetivo principal es ayudar a los clientes del sector público a adoptar tecnologías de nube para sus cargas de trabajo. Tiene experiencia en desarrollo de aplicaciones, arquitectura empresarial y tecnologías de centros de contacto. Sus intereses incluyen arquitecturas sin servidor y AI/ML.

Atún Ersoy es arquitecto senior de soluciones en AWS. Su objetivo principal es ayudar a los clientes del sector público a adoptar tecnologías de nube para sus cargas de trabajo. Tiene experiencia en desarrollo de aplicaciones, arquitectura empresarial y tecnologías de centros de contacto. Sus intereses incluyen arquitecturas sin servidor y AI/ML.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/implement-a-custom-automl-job-using-pre-selected-algorithms-in-amazon-sagemaker-automatic-model-tuning/

- :posee

- :es

- :no

- :dónde

- $ UP

- 000

- 1

- 10

- 100

- 12

- 13

- 14

- 15%

- 20

- 2000

- 22

- 25

- 28

- 30

- 39

- 50

- 7

- 70

- 8

- 80

- 9

- a

- Poder

- Nuestra Empresa

- de la máquina

- Conforme

- Mi Cuenta

- Lograr

- alcanzado

- a través de

- activamente

- Adicionales

- Adicionalmente

- adoptar

- Después

- AI / ML

- objetivo

- algoritmo

- algoritmos

- Todos

- Permitir

- permite

- ya haya utilizado

- también

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- análisis

- analizar

- el análisis de

- y

- Otra

- cualquier

- Aplicación

- Desarrollo de aplicaciones

- aplicada

- se aplica

- Aplicá

- aprobado

- arquitectura

- somos

- argumento

- argumentos

- AS

- asumir

- At

- adjuntar

- auto

- automatizado

- Automático

- automáticamente

- AutoML

- Hoy Disponibles

- AWS

- fondo

- bases

- basado

- Base

- Bayesiano

- BE

- porque

- antes

- Comienzo

- a continuación

- MEJOR

- mejores

- entre

- Big

- Bloquear

- Bloques

- ambas

- sucursales

- build

- Construir la

- pero

- .

- by

- California

- llamar al

- , que son

- PUEDEN

- candidato

- case

- cases

- Reubicación

- cadenas

- retos

- el cambio

- Cambios

- cargos

- Cheques

- Elige

- clase

- CLF

- cliente

- Soluciones

- Médico

- clustering

- código

- Columna

- Columnas

- combinación

- combinaciones

- combinado

- combina

- proviene

- comentario

- Algunos

- completar

- Completado

- completando

- Complicado

- concluye

- conclusión

- Conducir

- Configuración

- consecutivo

- Consola

- contacte

- contact center

- contiene

- contraste

- control

- Cost

- Precio

- podría

- Para crear

- creado

- Creamos

- criterios

- crucial

- En la actualidad

- personalizado

- Clientes

- datos

- Ciencia de los datos

- conjuntos de datos

- tratar

- decidir

- Profundizar

- Predeterminado

- se define

- Define

- definir

- Definiciones

- demostrar

- demuestra

- depender

- dependencias

- Dependiente

- desplegar

- desplegado

- Desplegando

- despliegue

- derivar

- A pesar de las

- detalle

- detallado

- detalles

- desarrollar

- desarrollado

- Desarrollo

- desarrolla el

- desviación

- DICT

- una experiencia diferente

- directorios

- discutir

- discutido

- do

- No

- dominio

- No

- DE INSCRIPCIÓN

- dibujar

- secas

- duración

- durante

- dinamicamente

- cada una

- Temprano en la

- eficiente

- elimina

- habilitar

- Punto final

- Ingeniería

- garantizar

- asegura

- Empresa

- Todo

- enteramente

- igual

- error

- evaluar

- evaluado

- finalmente

- Cada

- examinar

- ejemplo

- ejemplos

- ejecución

- existe

- esperar

- esperado

- experimento

- explicado

- explorado

- explora

- false

- familias

- familia

- ventilador

- Feature

- Caracteristicas

- pocos

- campo

- Archive

- lleno

- Encuentre

- la búsqueda de

- Nombre

- cómodo

- Digital XNUMXk

- Focus

- seguir

- siguiendo

- siguiente

- bosque

- formulario

- formato

- FRAME

- Desde

- frontal o trasero

- ser completados

- función

- a la fatiga

- funciones

- promover

- General

- generar

- generado

- la generación de

- obtener

- Git

- GitHub

- dado

- Go

- objetivo

- va

- gráfica

- mano

- Manijas

- Tienen

- es

- he

- pesado

- levantar objetos pesados

- ayudando

- ayuda

- aquí

- de alto nivel

- más alto

- más alto

- esperanza

- horas.

- Hogar

- hogares

- viviendas

- Cómo

- Como Hacer

- HTML

- http

- HTTPS

- Optimización de hiperparámetros

- Ajuste de hiperparámetros

- Identidad

- if

- implementar

- implementación

- importar

- importaciones

- mejorar

- la mejora de

- in

- incluir

- Incluye

- aumente

- indicar

- INSTRUMENTO individual

- Individualmente

- información

- Las opciones de entrada

- entradas

- Insertos

- Insights

- ejemplo

- Instrucciones

- integración

- intencionalmente

- intereses

- Interfaz

- dentro

- Introducido

- IT

- SUS

- sí mismo

- Trabajos

- Empleo

- jpg

- solo

- tan siquiera solo una

- Guardar

- Clave

- especialistas

- el lab

- large

- mayores

- luego

- lanzado

- lanzamiento

- aprendizaje

- izquierda

- Longitud Mínima

- Nivel

- ciclo de vida

- cirugía estética

- como

- que otros

- limitar

- Linux

- carga

- localmente

- situados

- Ubicación

- lógica

- lógico

- Largo

- por más tiempo

- Mira

- Lote

- más bajo

- máquina

- máquina de aprendizaje

- muchos

- máximas

- Puede..

- personalizado

- significa

- ir

- las etiquetas

- Métrica

- podría

- Min

- que falta

- ML

- MLOps

- modelo

- modelos

- modificar

- Monitorear

- monitores

- más,

- MEJOR DE TU

- múltiples

- nombre

- estrecho

- navega

- ¿ Necesita ayuda

- Nuevo

- recién

- Next

- no

- Ninguna

- cuaderno

- señaló

- ahora

- número

- numpy

- objeto

- objetivo

- objetos

- of

- off

- Ofertas

- on

- una vez

- ONE

- , solamente

- habiertos

- Operaciones

- óptimo

- optimización

- Optimización

- optimizado

- or

- solicite

- OS

- Otro

- Otros

- salir

- salida

- afuera

- Más de

- total

- página

- Los pandas

- Paralelo

- parámetros

- parte

- particular

- Pasando (Paso)

- apasionado

- camino

- Pagar

- Realizar

- actuación

- realizar

- Persiste

- piezas

- industrial

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- juega

- enchufe

- punto

- puntos

- política

- población

- posible

- Publicación

- posible

- pragmático

- predecir

- Predictor

- Preparar

- requisitos previos

- regalos

- evitar

- previamente

- cotización

- primario

- Imprimir

- Problema

- producir

- Producción

- Programación

- Progreso

- proyecto

- proyecta

- prometedor

- propiedades

- proporcionar

- proporciona un

- proporcionando

- público

- propósito

- Python

- azar

- rápido

- alcanzado

- ready

- razón

- recientemente

- recetas

- recomiendan

- archivos

- reducir

- reduce

- remitir

- referencia

- con respecto a

- expresiones regulares

- región

- liberado

- restante

- remove

- repetir

- repositorio

- solicita

- exigir

- Requisitos

- Recursos

- aquellos

- responsable

- límite

- resultado

- Resultados

- volvemos

- Derecho

- Función

- Ejecutar

- correr

- corre

- tiempo de ejecución

- sabio

- Ajuste automático de modelos de SageMaker

- salvado

- Escala

- la ampliación

- Ciencia:

- los científicos

- scikit-aprender

- alcance

- Puntuación

- guión

- guiones

- Segundo

- segundos

- Sección

- (secciones)

- sector

- ver

- parece

- seleccionado

- selección

- AUTO

- mayor

- separado

- ayudar

- Sin servidor

- de coches

- Servicios

- Sesión

- set

- Sets

- ajustes

- Configure

- ella

- tienes

- exhibido

- mostrado

- Shows

- sencillos

- simplificando

- simplemente

- retazo

- So

- a medida

- Soluciones

- RESOLVER

- algo

- especializado

- soluciones y

- especificación

- Especificaciones

- especificado

- velocidad

- dividido

- montón

- estándar

- comienzo

- Comience a

- Estado

- paso

- pasos

- Detener

- detenido

- parada

- STORAGE

- almacenados

- almacenamiento

- Estrategia

- estructura

- estructuras

- Después

- tal

- Soportado

- mesa

- adaptado

- ¡Prepárate!

- Target

- equipo

- Técnico

- técnicas

- Tecnologías

- terminal

- test

- Pruebas

- esa

- La

- su

- Les

- luego

- Ahí.

- por lo tanto

- Estas

- ellos

- así

- aquellos

- Tres

- umbral

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- equipo

- a

- juntos

- del IRS

- parte superior

- Total

- hacia

- tradicional

- Entrenar

- Formación

- transformaciones

- juicio

- ensayos

- probado

- detonante

- desencadenados

- desencadenando

- tratando de

- sintonización

- dos

- tipo

- tipos

- típicamente

- ui

- bajo

- comprensión

- único

- hasta

- no deseado

- subido

- Uso

- utilizan el

- caso de uso

- usado

- usos

- usando

- VALIDAR

- propuesta de

- Valores

- variable

- variado

- diversos

- versión

- versiones

- Ver

- visualización

- W

- esperar

- tutorial

- quieres

- fue

- Camino..

- we

- web

- servicios web

- WELL

- tuvieron

- ¿

- cuando

- mientras

- sean

- que

- porque

- seguirá

- dentro de

- sin

- Actividades:

- flujo de trabajo

- flujos de trabajo

- trabajando

- se

- escribir

- aún

- Usted

- tú

- a ti mismo

- zephyrnet