By kenna hughes-castleberry publicado el 02 de diciembre de 2022

Gracias a los avances tecnológicos, cada vez es más difícil saber qué es real y qué no. Este problema empeora con el uso de la tecnología deepfake:audios y videos que usan IA para reemplazar a las personas o sus voces. Si bien muchos deepfakes se han utilizado con éxito para el entretenimiento (como si Nicholas Cage estaba en el En busca del arca perdida) o juegos (como en atletas de la fifa), un gran porcentaje de ellos han sido creados para más motivos siniestros. A medida que se vuelve más fácil crear estos videos manipulados, muchos expertos esperan que la computación cuántica pueda ayudar a superar las amenazas potenciales de esta tecnología en ascenso.

¿Cómo funciona la tecnología Deepfake?

Para crear un video deepfake exitoso, necesita máquina de aprendizaje algoritmos “Los algoritmos de aprendizaje profundo aprenden por sí mismos cómo resolver problemas a partir de grandes conjuntos de datos y luego se utilizan para intercambiar caras en videos y otros contenidos digitales”, explicó. Post-cuántico CEO andersen cheng. Post-Quantum es una empresa líder en ciberseguridad que se enfoca en resistencia cuántica seguridad, incluso contra deepfakes. “Existen varios métodos para crear estos deepfakes”, afirmó Cheng, “pero el más popular es el uso de redes neuronales profundas que involucran codificadores automáticos. Un codificador automático es un programa de inteligencia artificial de aprendizaje profundo que estudia clips de video para comprender cómo se ve una persona desde múltiples ángulos y el entorno circundante, y luego mapea a esa persona en el individuo al encontrar características comunes”.

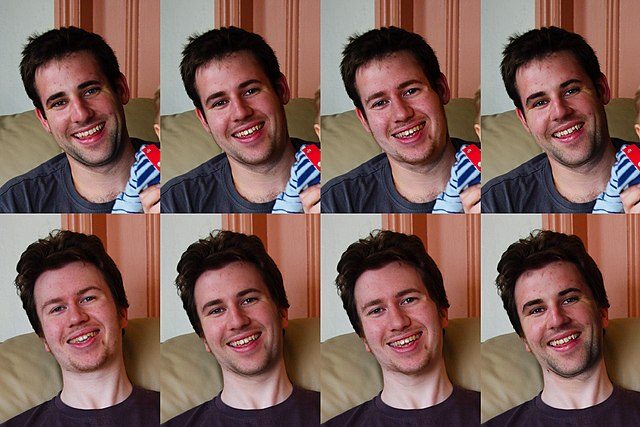

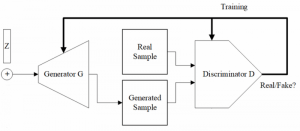

Configuración de una tecnología deepfake (PC Wikimedia Commons)

Para asegurarse de que el codificador automático funcione correctamente, se deben analizar múltiples clips de video de la cara del sujeto para obtener un conjunto más grande de datos. Luego, el codificador automático puede ayudar a crear un video compuesto intercambiando el individuo original con el nuevo sujeto. Un segundo tipo de aprendizaje automático llamado Red Adversarial General (GAN) detectará y mejorará las fallas en el nuevo video compuesto. De acuerdo a un Artículo 2022: "Las GAN entrenan a un 'generador' para crear nuevas imágenes a partir de la representación latente de la imagen de origen y un 'discriminador' para evaluar el realismo de los materiales generados". Este proceso ocurre varias veces hasta que el discriminador no puede saber si el video está manipulado y si el deepfake está completo.

La amenaza de la tecnología Deepfake

Actualmente, hay muchos software de código abierto o aplicaciones gratuitas que las personas pueden usar para crear falsificaciones profundas. Si bien esto puede parecer beneficioso para muchos, especialmente para aquellos en la industria del entretenimiento, ha generado algunos problemas graves, incluso criminales. De acuerdo a un Informe de seguimiento profundo, el 96% de los videos deepfake en línea en 2019 fueron, como era de esperar, pornografía. Si bien muchos de estos videos ilícitos se hicieron para vengarse de un ex, otros se usaron para crear escándalos entre celebridades femeninas e incluso políticos. En 2018, se lanzó un video falso de un partido político belga mostrando al entonces presidente Trump discutiendo los Acuerdos Climáticos de París. Dado que las noticias falsas ya se están convirtiendo en un problema para el público en general, los videos falsos profundos podrían ser la gota que colma el vaso. Incluso audio deepfake está causando estragos, como un archivo de audio manipulado de la CEO de una empresa de tecnología ayudó a cometer un acto de fraude. Para Cheng, este tipo de medios pueden desgastar la confianza del público con bastante rapidez. “Tenemos el problema más amplio de la confianza social: cómo podrá el público discernir entre lo que es real y lo que es falso”, agregó Cheng. “Como hemos visto, incluso hay evidencia de que se están utilizando deepfakes para eludir medidas de protección como la autenticación biométrica”. Con estas crecientes preocupaciones, Cheng y su equipo en Post-Quantum creen que tienen una solución en forma de nombre, un software especializado de ultra seguridad.

Preparación para las amenazas de la tecnología DeepFake

Al observar las múltiples amenazas que plantean la computación cuántica y las falsificaciones profundas, Cheng y este equipo crearon Nomidio para garantizar que las identidades de inicio de sesión e incluso la autenticación biométrica permanezcan seguras. “Nomidio es un servicio biométrico multifactorial (MFB) biométrico sin contraseña que permite la autenticación segura con una experiencia de usuario simple e intuitiva”, dijo Cheng. "Reemplaza el inicio de sesión basado en nombre de usuario/contraseña y el inicio de sesión único, y los usuarios se autentican con su perfil biométrico con autenticación multifactor (MFA) en segundo plano". Como Cheng ha sido un experto en ciberseguridad durante muchos años, se aseguró de que Nomidio también pudiera estar seguro contra las falsificaciones profundas. “Nuestra filosofía central al crearlo fue usar la mayor cantidad de información adicional posible y una autenticación multifactor real (es decir, con más de dos factores), por lo que, de hecho, es la solución ideal para abordar cualquier desarrollo futuro en tecnología deepfake. En última instancia, esto se debe al hecho de que el MFA tradicional es insuficiente, pero el MFB puede hacer que los ataques en tiempo real sean prácticamente imposibles. Es decir, una combinación de, por ejemplo, voz, cara y un código PIN es altamente segura por el hecho de que es posible falsificar cualquier factor único, pero falsificar los tres en la misma instancia es prácticamente imposible. Con Nomidio, se puede combinar una combinación de biometría de voz y rostro, reconocimiento de voz, datos dependientes del contexto e incluso análisis de comportamiento en un solo sistema de autenticación. ”

Si bien Nomidio en sí no aprovecha la computación cuántica para superar las amenazas de falsificación profunda, las computadoras cuánticas podrían potencialmente funcionar contra estos archivos multimedia falsos. Como computadoras cuánticas a menudo aprovechan los algoritmos de aprendizaje automático para trabajar más rápido y de manera más eficiente, pueden detectar videos falsos o archivos de audio a un ritmo más rápido. Si bien la tecnología aún se está desarrollando y pocos están considerando las falsificaciones profundas como un caso de uso potencial para las computadoras cuánticas, estas máquinas de siguiente nivel podrían usarse en el futuro para hacer que nuestros medios sean más veraces y precisos.

Con las amenazas de la tecnología deepfake cada vez más evidentes, muchos gobiernos y empresas ya están tratando de encontrar formas de ayudar a combatirla. En 2021, Facebook lanzó el Deepfake Detection Challenge, con un premio de $500,000 para aquellos que creen nueva tecnología para detectar falsificaciones profundas. En los EE. UU., estados como California, Texas y Virginia tienen leyes que prohíben el uso de deepfakes tanto para la pornografía como para la política. los Parlamento Europeo también estableció más regulaciones sobre los deepfakes, modificando la Ley de Servicios Digitales para imponer el uso de etiquetas en los videos deepfakes. Si bien esta legislación no entrará en vigencia hasta 2024, muestra la gravedad de la amenaza de la tecnología deepfake.

Kenna Hughes-Castleberry es redactora de Inside Quantum Technology y comunicadora científica en JILA (una asociación entre la Universidad de Colorado Boulder y el NIST). Sus ritmos de escritura incluyen tecnología profunda, metaverso y tecnología cuántica.