Hoy, nos complace anunciar que los modelos de base Mistral 7B, desarrollados por Mistral AI, están disponibles para los clientes a través de JumpStart de Amazon SageMaker para implementar con un clic para ejecutar la inferencia. Con 7 mil millones de parámetros, Mistral 7B se puede personalizar fácilmente e implementar rápidamente. Puede probar este modelo con SageMaker JumpStart, un centro de aprendizaje automático (ML) que brinda acceso a algoritmos y modelos para que pueda comenzar rápidamente con ML. En esta publicación, explicamos cómo descubrir e implementar el modelo Mistral 7B.

¿Qué es Mistral 7B?

Mistral 7B es un modelo básico desarrollado por Mistral AI, que admite capacidades de generación de código y texto en inglés. Admite una variedad de casos de uso, como resumen de texto, clasificación, finalización de texto y finalización de código. Para demostrar la fácil personalización del modelo, Mistral AI también lanzó un modelo Mistral 7B Instruct para casos de uso de chat, ajustado utilizando una variedad de conjuntos de datos de conversación disponibles públicamente.

Mistral 7B es un modelo transformador y utiliza atención de consultas agrupadas y atención de ventana deslizante para lograr una inferencia más rápida (baja latencia) y manejar secuencias más largas. La atención de consultas grupales es una arquitectura que combina la atención de múltiples consultas y de múltiples cabezas para lograr una calidad de salida cercana a la atención de múltiples cabezas y una velocidad comparable a la atención de múltiples consultas. La atención de ventana deslizante utiliza las capas apiladas de un transformador para atender en el pasado más allá del tamaño de la ventana para aumentar la longitud del contexto. Mistral 7B tiene una longitud de contexto de 8,000 tokens, demuestra baja latencia y alto rendimiento, y tiene un rendimiento sólido en comparación con alternativas de modelos más grandes, lo que proporciona bajos requisitos de memoria en un tamaño de modelo 7B. El modelo está disponible bajo el permiso. Licencia de Apache 2.0, para uso sin restricciones.

¿Qué es SageMaker JumpStart?

Con SageMaker JumpStart, los profesionales del aprendizaje automático pueden elegir entre una lista cada vez mayor de modelos básicos de mejor rendimiento. Los profesionales del aprendizaje automático pueden implementar modelos básicos en sitios dedicados. Amazon SageMaker instancias dentro de un entorno aislado de red y personalice modelos utilizando SageMaker para el entrenamiento e implementación de modelos.

Ahora puede descubrir e implementar Mistral 7B con unos pocos clics en Estudio Amazon SageMaker o programáticamente a través de SageMaker Python SDK, lo que le permite derivar el rendimiento del modelo y los controles de MLOps con funciones de SageMaker como Canalizaciones de Amazon SageMaker, Depurador de Amazon SageMakero registros de contenedor. El modelo se implementa en un entorno seguro de AWS y bajo los controles de su VPC, lo que ayuda a garantizar la seguridad de los datos.

Descubre modelos

Puede acceder a los modelos básicos de Mistral 7B a través de SageMaker JumpStart en la interfaz de usuario de SageMaker Studio y el SDK de SageMaker Python. En esta sección, repasamos cómo descubrir los modelos en SageMaker Studio.

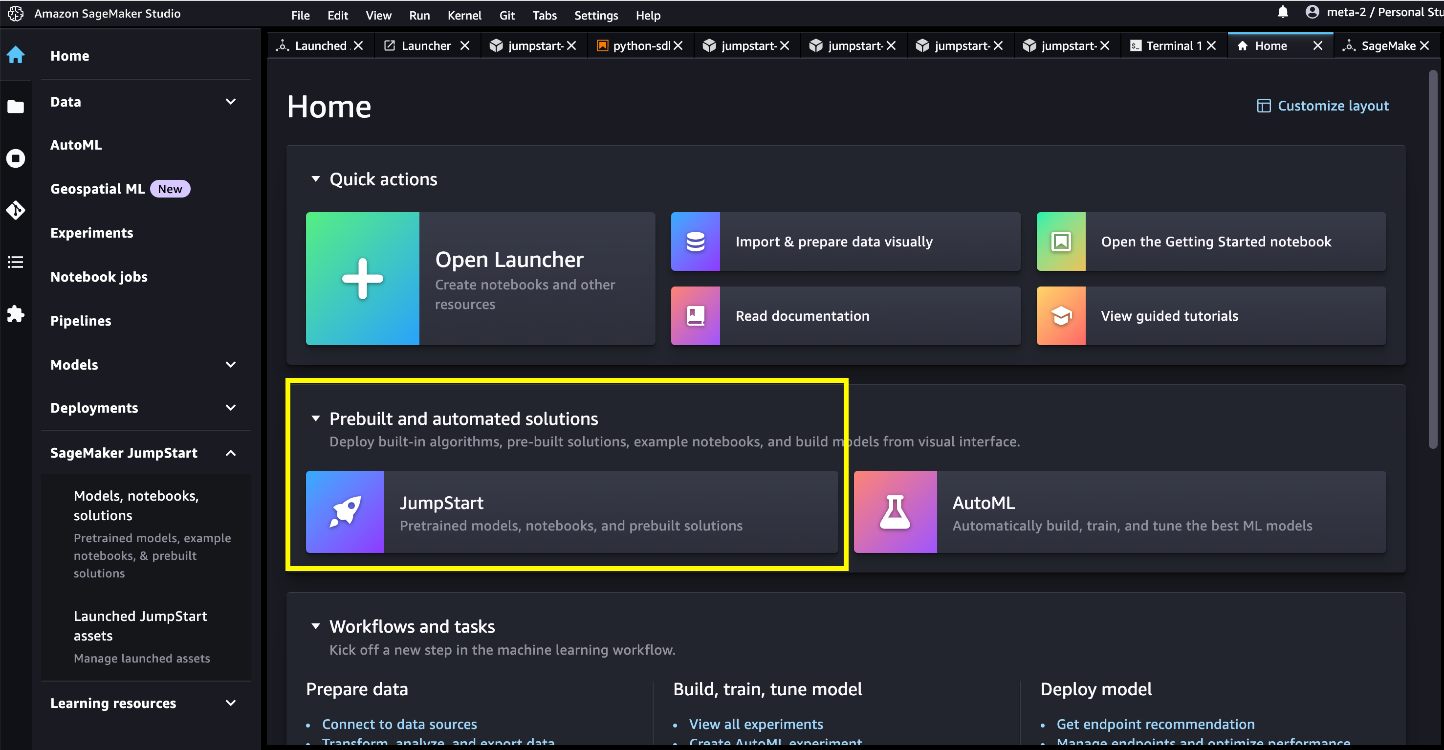

SageMaker Studio es un entorno de desarrollo integrado (IDE) que proporciona una única interfaz visual basada en web donde puede acceder a herramientas especialmente diseñadas para realizar todos los pasos de desarrollo de ML, desde la preparación de datos hasta la creación, capacitación e implementación de sus modelos de ML. Para obtener más detalles sobre cómo comenzar y configurar SageMaker Studio, consulte Estudio Amazon SageMaker.

En SageMaker Studio, puede acceder a SageMaker JumpStart, que contiene modelos, cuadernos y soluciones prediseñadas previamente entrenados, en Soluciones preconstruidas y automatizadas.

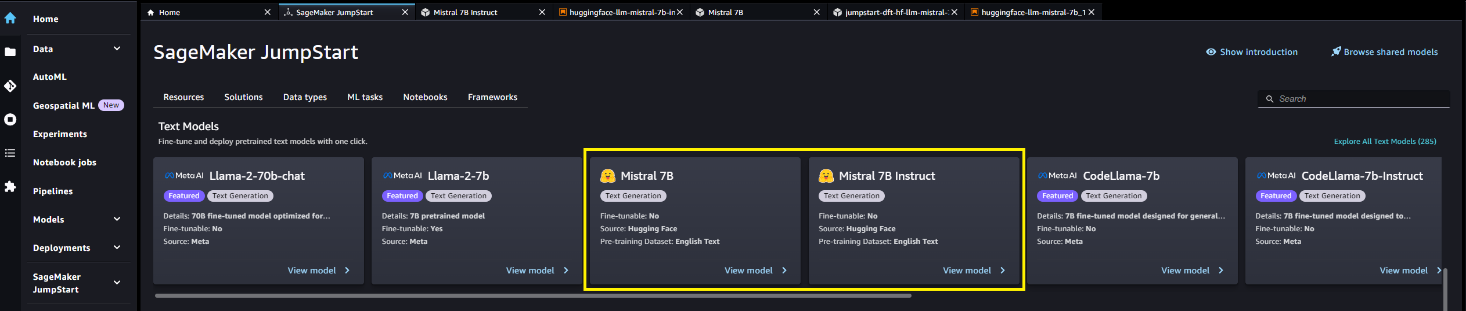

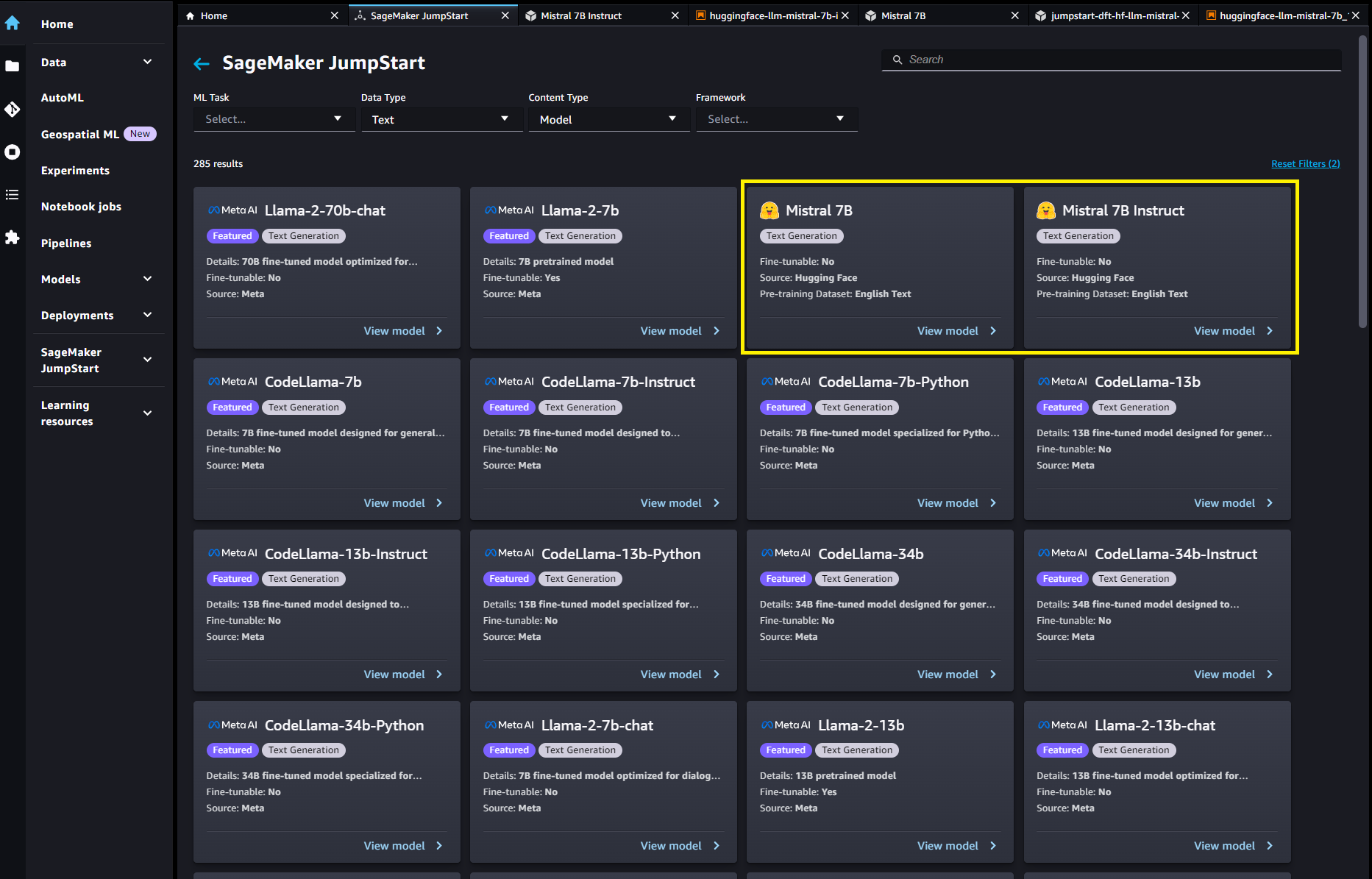

Desde la página de inicio de SageMaker JumpStart, puede buscar soluciones, modelos, cuadernos y otros recursos. Puedes encontrar Mistral 7B en el Modelos básicos: generación de texto carrusel

También puede encontrar otras variantes de modelos eligiendo Explora todos los modelos de texto o buscando “Mistral”.

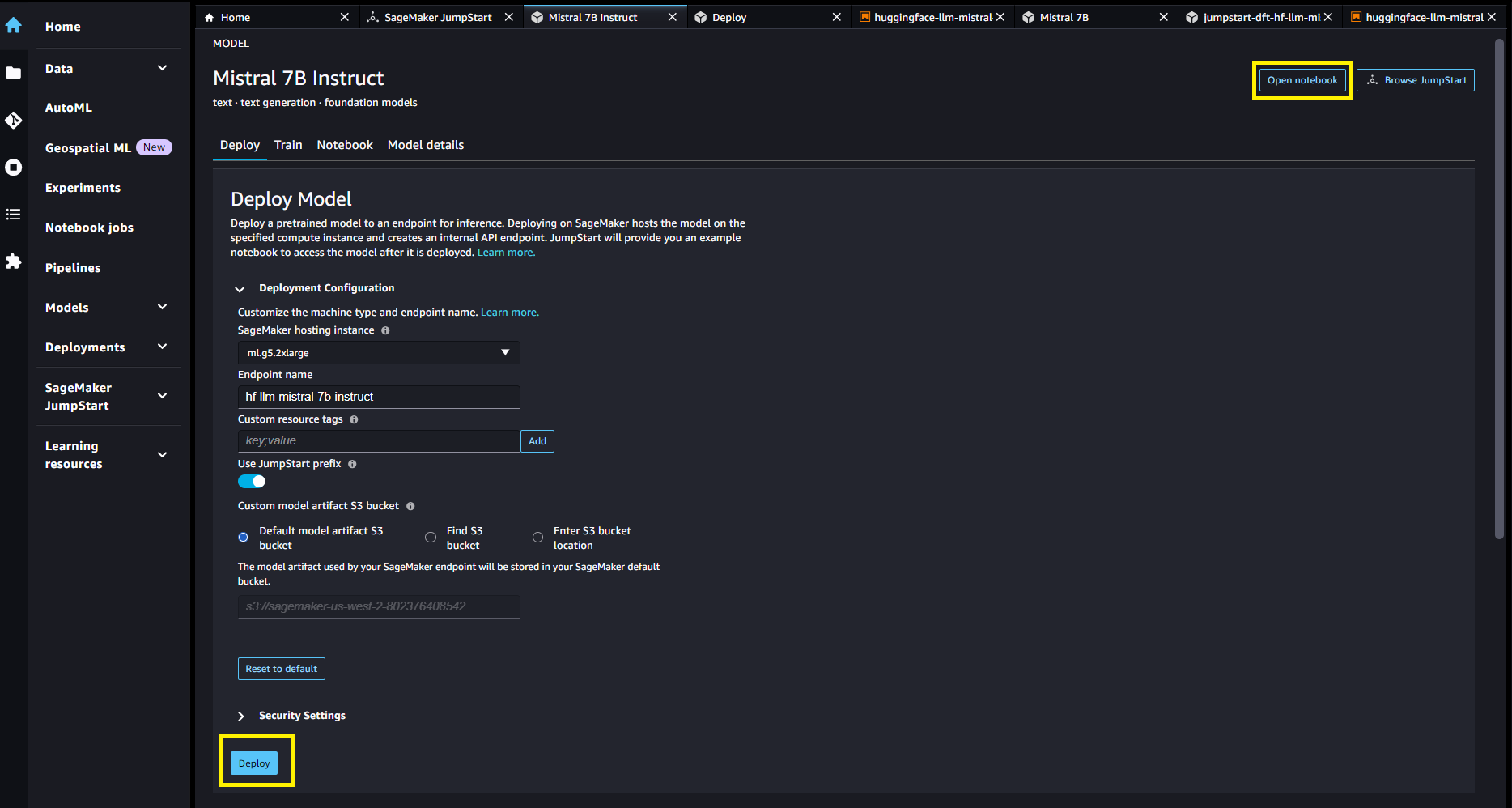

Puede elegir la tarjeta de modelo para ver detalles sobre el modelo, como la licencia, los datos utilizados para entrenar y cómo utilizarlo. También encontrarás dos botones, Despliegue y Cuaderno abierto, que le ayudará a utilizar el modelo (la siguiente captura de pantalla muestra el Despliegue opción).

Implementar modelos

La implementación comienza cuando usted elija Despliegue. Alternativamente, puede implementar a través del cuaderno de ejemplo que aparece cuando elige Cuaderno abierto. El cuaderno de ejemplo proporciona una guía integral sobre cómo implementar el modelo para la inferencia y la limpieza de recursos.

Para implementar usando una computadora portátil, comenzamos seleccionando el modelo Mistral 7B, especificado por el model_id. Puede implementar cualquiera de los modelos seleccionados en SageMaker con el siguiente código:

Esto implementa el modelo en SageMaker con configuraciones predeterminadas, incluido el tipo de instancia predeterminado (ml.g5.2xlarge) y las configuraciones de VPC predeterminadas. Puede cambiar estas configuraciones especificando valores no predeterminados en JumpStartModelo. Una vez implementado, puede ejecutar la inferencia en el extremo implementado a través del predictor de SageMaker:

Optimización de la configuración de implementación

Los modelos Mistral utilizan el servicio de modelos de inferencia de generación de texto (TGI versión 1.1). Al implementar modelos con el contenedor de aprendizaje profundo (DLC) TGI, puede configurar una variedad de argumentos del lanzador a través de variables de entorno al implementar su punto final. Para admitir la longitud de contexto de 8,000 tokens de los modelos Mistral 7B, SageMaker JumpStart ha configurado algunos de estos parámetros de forma predeterminada: configuramos MAX_INPUT_LENGTH y MAX_TOTAL_TOKENS a 8191 y 8192, respectivamente. Puede ver la lista completa inspeccionando su objeto modelo:

De forma predeterminada, SageMaker JumpStart no bloquea a los usuarios simultáneos a través de la variable de entorno. MAX_CONCURRENT_REQUESTS menor que el valor predeterminado de TGI de 128. La razón es que algunos usuarios pueden tener cargas de trabajo típicas con longitudes de contexto de carga útil pequeñas y desean una alta simultaneidad. Tenga en cuenta que el DLC SageMaker TGI admite varios usuarios simultáneos mediante lotes continuos. Al implementar su punto final para su aplicación, podría considerar si debe fijar MAX_TOTAL_TOKENS or MAX_CONCURRENT_REQUESTS antes de la implementación para proporcionar el mejor rendimiento para su carga de trabajo:

Aquí, mostramos cómo el rendimiento del modelo puede diferir para su carga de trabajo de endpoint típica. En las siguientes tablas, puede observar que las consultas de tamaño pequeño (128 palabras de entrada y 128 tokens de salida) tienen bastante rendimiento con una gran cantidad de usuarios simultáneos, alcanzando un rendimiento de tokens del orden de 1,000 tokens por segundo. Sin embargo, a medida que la cantidad de palabras de entrada aumenta a 512 palabras de entrada, el punto final satura su capacidad de procesamiento por lotes (la cantidad de solicitudes simultáneas que se permite procesar simultáneamente), lo que genera una meseta en el rendimiento y degradaciones significativas de la latencia que comienzan alrededor de 16 usuarios simultáneos. Finalmente, cuando varios usuarios simultáneos consultan el punto final con contextos de entrada grandes (por ejemplo, 6,400 palabras) simultáneamente, esta meseta de rendimiento se produce relativamente rápido, hasta el punto en que su cuenta de SageMaker comenzará a encontrar límites de tiempo de espera de respuesta de 60 segundos para sus solicitudes sobrecargadas. .

| . | rendimiento (tokens/s) | ||||||||||

| usuarios concurrentes | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| modelo | tipo de instancia | palabras de entrada | fichas de salida | . | |||||||

| mistral-7b-instruir | ml.g5.2xgrande | 128 | 128 | 30 | 54 | 89 | 166 | 287 | 499 | 793 | 1030 |

| 512 | 128 | 29 | 50 | 80 | 140 | 210 | 315 | 383 | 458 | ||

| 6400 | 128 | 17 | 25 | 30 | 35 | - | - | - | - | ||

| . | Latencia p50 (ms/token) | ||||||||||

| usuarios concurrentes | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| modelo | tipo de instancia | palabras de entrada | fichas de salida | . | |||||||

| mistral-7b-instruir | ml.g5.2xgrande | 128 | 128 | 32 | 33 | 34 | 36 | 41 | 46 | 59 | 88 |

| 512 | 128 | 34 | 36 | 39 | 43 | 54 | 71 | 112 | 213 | ||

| 6400 | 128 | 57 | 71 | 98 | 154 | - | - | - | - | ||

Indicaciones de inferencia y ejemplo

Mistral 7B

Puede interactuar con un modelo Mistral 7B base como cualquier modelo de generación de texto estándar, donde el modelo procesa una secuencia de entrada y genera las siguientes palabras predichas en la secuencia. El siguiente es un ejemplo simple con aprendizaje de múltiples disparos, donde el modelo recibe varios ejemplos y la respuesta del ejemplo final se genera con conocimiento contextual de estos ejemplos anteriores:

Instrucción Mistral 7B

La versión adaptada a las instrucciones de Mistral acepta instrucciones formateadas en las que los roles de conversación deben comenzar con un mensaje de usuario y alternar entre usuario y asistente. Un mensaje de usuario simple puede verse como el siguiente:

Un mensaje de varios giros sería similar al siguiente:

Este patrón se repite durante todos los turnos que haya en la conversación.

En las siguientes secciones, exploramos algunos ejemplos utilizando el modelo Mistral 7B Instruct.

Recuperación de conocimiento

El siguiente es un ejemplo de recuperación de conocimientos:

Respuesta a preguntas de contexto amplio

Para demostrar cómo utilizar este modelo para admitir contextos de entrada de gran longitud, el siguiente ejemplo incorpora un pasaje titulado "Ratas" de Robert Sullivan (referencia), de la prueba de comprensión de lectura de artes del lenguaje inglés de grado 10 del MCAS a la instrucción de indicaciones de entrada y le hace al modelo una pregunta dirigida sobre el texto:

Matemáticas y razonamiento

Los modelos Mistral también reportan fortalezas en la precisión matemática. Mistral puede proporcionar comprensión como la siguiente lógica matemática:

Codificación

El siguiente es un ejemplo de un mensaje de codificación:

Limpiar

Una vez que haya terminado de ejecutar el cuaderno, asegúrese de eliminar todos los recursos que creó en el proceso para que se detenga su facturación. Utilice el siguiente código:

Conclusión

En esta publicación, le mostramos cómo comenzar con Mistral 7B en SageMaker Studio e implementar el modelo para inferencia. Dado que los modelos básicos están previamente entrenados, pueden ayudar a reducir los costos de capacitación e infraestructura y permitir la personalización para su caso de uso. Visita JumpStart de Amazon SageMaker ahora mismo para comenzar.

Recursos

Acerca de los autores

Dr.Kyle Ulrich es un científico aplicado del equipo JumpStart de Amazon SageMaker. Sus intereses de investigación incluyen algoritmos escalables de aprendizaje automático, visión artificial, series temporales, no paramétricos bayesianos y procesos gaussianos. Su doctorado es de la Universidad de Duke y ha publicado artículos en NeurIPS, Cell y Neuron.

Dr.Kyle Ulrich es un científico aplicado del equipo JumpStart de Amazon SageMaker. Sus intereses de investigación incluyen algoritmos escalables de aprendizaje automático, visión artificial, series temporales, no paramétricos bayesianos y procesos gaussianos. Su doctorado es de la Universidad de Duke y ha publicado artículos en NeurIPS, Cell y Neuron.

Dr. Ashish Khetan es un científico aplicado sénior de Amazon SageMaker JumpStart y ayuda a desarrollar algoritmos de aprendizaje automático. Obtuvo su doctorado en la Universidad de Illinois Urbana-Champaign. Es un investigador activo en aprendizaje automático e inferencia estadística, y ha publicado muchos artículos en conferencias NeurIPS, ICML, ICLR, JMLR, ACL y EMNLP.

Dr. Ashish Khetan es un científico aplicado sénior de Amazon SageMaker JumpStart y ayuda a desarrollar algoritmos de aprendizaje automático. Obtuvo su doctorado en la Universidad de Illinois Urbana-Champaign. Es un investigador activo en aprendizaje automático e inferencia estadística, y ha publicado muchos artículos en conferencias NeurIPS, ICML, ICLR, JMLR, ACL y EMNLP.

Vivek Singh es gerente de producto de Amazon SageMaker JumpStart. Se centra en permitir que los clientes incorporen SageMaker JumpStart para simplificar y acelerar su viaje de aprendizaje automático para crear aplicaciones de IA generativa.

Vivek Singh es gerente de producto de Amazon SageMaker JumpStart. Se centra en permitir que los clientes incorporen SageMaker JumpStart para simplificar y acelerar su viaje de aprendizaje automático para crear aplicaciones de IA generativa.

Roy Alela es un arquitecto sénior de soluciones especialista en IA/ML en AWS con sede en Múnich, Alemania. Roy ayuda a los clientes de AWS, desde pequeñas empresas emergentes hasta grandes empresas, a entrenar e implementar modelos de lenguaje grandes de manera eficiente en AWS. A Roy le apasionan los problemas de optimización computacional y la mejora del rendimiento de las cargas de trabajo de IA.

Roy Alela es un arquitecto sénior de soluciones especialista en IA/ML en AWS con sede en Múnich, Alemania. Roy ayuda a los clientes de AWS, desde pequeñas empresas emergentes hasta grandes empresas, a entrenar e implementar modelos de lenguaje grandes de manera eficiente en AWS. A Roy le apasionan los problemas de optimización computacional y la mejora del rendimiento de las cargas de trabajo de IA.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/mistral-7b-foundation-models-from-mistral-ai-are-now-available-in-amazon-sagemaker-jumpstart/

- :posee

- :es

- :no

- :dónde

- $ UP

- 000

- 1

- 10

- 100

- 12

- 14

- 150

- 16

- 25

- 26%

- 30

- 400

- 50

- 7

- 8

- 9

- a

- <del>

- Nuestra Empresa

- acelerar

- Acepta

- de la máquina

- Conforme

- Mi Cuenta

- la exactitud

- Lograr

- lector activo

- adición

- Adulto

- Después

- en contra

- edad

- AI

- AI / ML

- algoritmos

- Todos

- permitido

- casi

- a lo largo de

- junto al

- también

- alternativas

- hacerlo

- Amazon

- Amazon SageMaker

- JumpStart de Amazon SageMaker

- Amazon Web Services

- America

- cantidad

- cantidades

- an

- y

- e infraestructura

- Angeles

- Anunciar

- Otra

- https://www.youtube.com/watch?v=xB-eutXNUMXJtA&feature=youtu.be

- cualquier

- nadie

- dondequiera

- aparte

- apartamentos

- Aplicación

- aplicaciones

- aplicada

- aproximadamente

- arquitectura

- somos

- en torno a

- artículo

- Artes

- AS

- Legal

- asociado

- At

- Los intentos

- asistir

- atraído

- atractivo

- autor

- Confirmación de Viaje

- Hoy Disponibles

- promedio

- conscientes

- lejos

- AWS

- Atrás

- bolsas

- bases

- basado

- golpear

- baterías

- agresión con lesiones

- Bayesiano

- BE

- porque

- esto

- antes

- detrás de

- "Ser"

- bajo

- MEJOR

- entre

- Más allá de

- Bill

- facturación

- mil millones

- Negro

- Tablas de remo

- Bolt

- primer libro

- ambas

- compró

- rompe

- PUENTE

- Brooklyn

- marrón

- build

- Construir la

- pero

- Comprar

- by

- , que son

- llegó

- PUEDEN

- de

- tarjeta

- carrusel

- case

- cases

- causado

- a ciertos

- el cambio

- canales

- Elige

- la elección de

- Cities

- Ciudad

- abrazadera

- clasificación

- clic

- escalar

- Cerrar

- Pacífica

- costero

- código

- Codificación

- Colapso

- combina

- cómo

- Algunos

- comparable

- en comparación con

- terminación

- computational

- computadora

- Visión por computador

- competidor

- conferencias

- configurado

- confundido

- Considerar

- Envase

- contiene

- contexto

- contextos

- contextual

- control

- controles

- Conversación

- Cobre

- esquinas

- Cost

- Precio

- país

- Protectora

- cubierto

- Para crear

- creado

- Current

- Clientes

- personalización

- personalizan

- se adaptan

- Oscuro

- datos

- seguridad de datos

- conjuntos de datos

- día

- Días

- a dedicados

- profundo

- deep learning

- Ciervo

- Predeterminado

- demostrar

- demuestra

- desplegar

- desplegado

- Desplegando

- despliegue

- despliega

- depresión.

- detalles

- desarrollar

- desarrollado

- Desarrollo

- HIZO

- diferir de

- una experiencia diferente

- DIG

- que dirigieron

- directorios

- suciedad

- descrubrir

- interrupciones

- do

- gama

- No

- dólares

- hecho

- No

- DE INSCRIPCIÓN

- dos

- Duque

- duke university

- cada una

- tierra

- pasan fácilmente

- de forma sencilla

- comer

- eficiente.

- ya sea

- Emergencia Dental

- enfatizar

- habilitar

- permitiendo

- encuentro

- de extremo a extremo

- Punto final

- England

- Inglés

- garantizar

- Participar

- Todo

- Entorno

- equipado

- especialmente

- estimación

- Incluso

- Cada

- en todas partes

- ejemplo

- ejemplos

- excelente,

- excitado

- excluyendo

- Exit

- experto

- Explicar

- explorar

- extensión

- Ojos

- hecho

- más rápida

- Caracteristicas

- alimentación

- Pies

- pocos

- Figura

- archivos

- final

- Finalmente

- Encuentre

- Nombre

- se centra

- siguiendo

- Comida

- Fútbol

- bosque

- encontrado

- Fundación

- Digital XNUMXk

- Desde

- frontal o trasero

- ser completados

- ganado

- GAS

- generado

- generación de AHSS

- generativo

- IA generativa

- Alemania

- obtener

- Go

- tiene

- grado

- gris

- Grupo procesos

- Crecer

- Creciendo

- crece

- guía

- tenido

- encargarse de

- Tienen

- he

- cabeza

- ayuda

- ayudando

- ayuda

- por lo tanto

- en esta

- Alta

- su

- Agujero

- Agujeros

- Hogar

- Cómo

- Como Hacer

- Sin embargo

- HTML

- HTTPS

- Bujes

- humana

- cien

- i

- HIELO

- helado

- ideal

- if

- Illinois

- importar

- la mejora de

- in

- incluir

- Incluye

- aumente

- Los aumentos

- EN LA MINA

- Las opciones de entrada

- entradas

- ejemplo

- Instrucciones

- COMPLETAMENTE

- interactuar

- intereses

- Interfaz

- dentro

- aislado

- IT

- SUS

- mandíbulas

- jpg

- Niños

- Matar

- Tipo

- especialistas

- conocido

- kyle

- laboratorio

- lagos

- aterrizaje

- idioma

- large

- mayores

- Apellidos

- Estado latente

- ponedoras

- Lead

- líder

- fuga

- Fugas

- APRENDE:

- aprendizaje

- Longitud Mínima

- dejar

- Licencia

- luz

- ligeramente

- relámpago

- como

- que otros

- LIMITE LAS

- límites

- forrado

- LINK

- Lista

- pequeño

- para vivir

- Vidas

- ll

- lógica

- Largo

- por más tiempo

- Mira

- parece

- los

- Los Ángeles

- Baja

- inferior

- máquina

- máquina de aprendizaje

- hecho

- para lograr

- HACE

- gerente

- manual

- muchos

- Misa

- las matemáticas

- matemáticas

- Puede..

- Salud Cerebral

- mencionado

- podría

- millones

- menor de edad

- minuto

- ML

- MLOps

- modelo

- modelos

- Moderno

- modificado

- dinero

- Mes

- más,

- MEJOR DE TU

- mucho más

- múltiples

- Música

- debe

- my

- nombre

- nombres

- estrecho

- Natural

- Cerca

- negativas

- Nest

- anidación

- del sistema,

- telecomunicaciones

- Neutro

- Nuevo

- New York

- Ciudad de Nueva York

- Los periódicos

- Next

- noche

- no

- Ninguna

- nariz

- cuaderno

- ahora

- número

- objeto

- observar

- of

- a menudo

- Viejo

- on

- A bordo

- una vez

- ONE

- , solamente

- sobre

- abre

- optimización

- Optión

- or

- solicite

- natural

- Otro

- de otra manera

- salir

- salida

- salidas

- Más de

- página

- dinero

- palma

- papeles

- parámetros

- parte

- passage

- apasionado

- pasado

- Patrón de Costura

- PAWS

- (PDF)

- Personas

- para

- percibidas

- por ciento

- Realizar

- actuación

- Doctor en Filosofía

- teléfono

- escogido

- Lugares

- Plantas

- plástico

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- punto

- tóxico

- pobre

- positivo

- Publicación

- Una libra de

- previsto

- Predictor

- preparación

- presión

- anterior

- Anterior

- problemas

- Procesado

- en costes

- Producto

- gerente de producto

- proporcionar

- previsto

- proporciona un

- proporcionando

- en público

- publicado

- puramente

- fines

- empujó

- poner

- Python

- calidad

- consultas

- pregunta

- con rapidez

- exactamente

- carriles

- RATA

- Rate

- alcanzando

- Reading

- razón

- remitir

- relativamente

- liberado

- reporte

- Informes

- solicitudes

- Requisitos

- la investigación

- investigador

- Recursos

- respectivamente

- respuesta

- Restaurantes

- restricciones

- Retiro

- Derecho

- ROBERT

- Función

- También soy miembro del cuerpo docente de World Extreme Medicine (WEM) y embajadora europea de igualdad para The Transformational Travel Council (TTC). En mi tiempo libre, soy una incansable aventurera, escaladora, patrona de día, buceadora y defensora de la igualdad de género en el deporte y la aventura. En XNUMX, fundé Almas Libres, una ONG nacida para involucrar, educar y empoderar a mujeres y niñas a través del deporte urbano, la cultura y la tecnología.

- Rolling

- roy

- Ejecutar

- correr

- s

- de manera segura

- Safety

- sabio

- Sierra

- escalable

- Científico

- los científicos

- Sdk

- Buscar

- búsqueda

- Segundo

- Sección

- (secciones)

- seguro

- EN LINEA

- parecer

- seleccionado

- seleccionar

- mayor

- sentido

- sentimiento

- Secuencia

- Serie

- Servicios

- servicio

- set

- siete

- Varios

- agudo

- brilla

- Compras

- tienes

- Mostrar

- mostró

- Shows

- lado

- importante

- sencillos

- simplificar

- simultáneamente

- desde

- soltero

- sentarse

- Sentado

- Tamaño

- Piel

- chica

- menores

- chasquido

- So

- Soft

- únicamente

- Soluciones

- algo

- a veces

- Del Sur

- Espacio

- especialista

- especificado

- velocidad

- propagación

- primavera

- cuadrado

- cuadrados

- Squeeze

- apilado

- estándar

- comienzo

- fundó

- Comience a

- comienza

- Startups

- dijo

- Zonas

- estaciones

- estadístico

- quedarse

- pasos

- Sin embargo

- detenido

- tiendas

- corrientes

- calle

- fortalezas

- fuerte

- más fuerte

- estructura

- estudios

- estudio

- ESTUDIO

- sujeto

- tal

- Sullivan

- suministro

- SOPORTE

- Apoyar

- soportes

- seguro

- sobrevivir

- te

- llaves

- equipo

- términos

- test

- texto

- que

- esa

- La

- El oeste

- el mundo

- su

- Les

- sí mismos

- luego

- Ahí.

- por lo tanto

- Estas

- ellos

- pensar

- así

- aquellos

- ¿aunque?

- mil

- miles

- Tres

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- rendimiento

- equipo

- Series de tiempo

- titulada

- a

- ficha

- Tokens

- Total

- ciudad

- Entrenar

- Formación

- trenes

- transformador

- trampas

- viajes

- Los árboles

- try

- túnel

- se convierte

- Tweet

- dos

- tipo

- principiante

- típicamente

- ui

- bajo

- universidad

- desconocido

- utilizan el

- caso de uso

- usado

- Usuario

- usuarios

- usos

- usando

- utilidad

- propuesta de

- Valores

- variable

- variedad

- diversos

- Ve

- vehículo

- Vehículos

- versión

- muy

- vía

- Video

- Ver

- visión

- Visite

- Esperando

- caminar

- quieres

- fue

- Residuos

- Agua

- Camino..

- formas

- we

- web

- servicios web

- Basado en la Web

- WELL

- tuvieron

- West

- ¿

- Que es

- cuando

- sean

- que

- mientras

- complejo de salvador blanco

- amplio

- anchura

- Wild

- seguirá

- ventana

- dentro de

- sin

- palabras

- los trabajadores.

- mundo

- se

- año

- york

- Usted

- tú

- zephyrnet