El mes pasado, el programa de Investigación y Desarrollo de Redes y Tecnologías de la Información (NITRD, por sus siglas en inglés) conmemoró su 30 aniversario en Washington DC Puede leer el resumen completo del evento esta página. En un esfuerzo por resaltar el impacto que han tenido las inversiones federales en la comunidad de investigación informática, el evento contó con cinco paneles en los que los participantes discutieron los logros clave en el campo durante la última década y las direcciones futuras. Cada panel se centró en una subárea importante de la investigación informática: informática a escala, redes y seguridad, inteligencia artificial/aprendizaje automático, privacidad e Internet de las cosas e informática socialmente responsable.

La privacidad se ha convertido en un gran tema de conversación no solo entre la comunidad de investigación informática, sino en todas las disciplinas, tanto en la academia como en la industria. Los efectos adversos sobre la privacidad derivados de la disponibilidad de conjuntos de datos a gran escala se están multiplicando por la sensores, dispositivos y actuadores interconectados que componen el Internet de las Cosas (IoT). Moderado por Charles (“Chuck”) Romine (NIST) y con los expertos de campo Ed Felten (Princeton), Marc Groman (Groman Consulting), Katerina Megas (NIST) y Sunoo Park (Cornell), Panel 4: Privacidad e IoT analiza temas importantes como las ventajas y desventajas entre el uso de datos y la privacidad y los posibles objetivos de investigación para ayudar a lograr soluciones de políticas efectivas.

Romine comenzó destacando un hilo común en todos los paneles: “hablar tanto de los beneficios como de las capacidades extraordinarias que se brindan a través de las inversiones de fondos federales, junto con los riesgos asociados”. IoT no es diferente, brinda a las personas acceso a información insuperable, permite campañas publicitarias exitosas y adapta la tecnología a su gusto personal, pero también pone en peligro la privacidad del usuario.

Como señaló Megas, "la razón principal por la que estamos emprendiendo este esfuerzo es porque queremos poder ver que IoT sea reconocido y que la sociedad obtenga los beneficios". Luego compartió los beneficios potenciales y la importancia de poder compartir datos a través de IoT. Existe una escala "fenomenal" de dispositivos en IoT que se puede usar para identificar problemas en conjuntos de datos, aprender cosas que tienen un alto potencial de impacto para las personas y la sociedad, capacitar tecnologías de inteligencia artificial y permitir que pequeñas empresas innovadoras prueben sus dispositivos. Romine preguntó a los panelistas cuáles son realmente los riesgos de privacidad asociados en este contexto de IoT e intercambio de información.

Groman respondió explicando primero la interacción entre la privacidad y el IoT. El lado de la privacidad de IoT es un subconjunto de datos dentro del conjunto más grande que se recopila, que se trata de personas o se relaciona con ellas. ¿Saben las personas que se recopilan datos sobre ellas? ¿Existe una interfaz en la que pueda interactuar con el dispositivo, aprender lo que está recopilando o cambiarlo? ¿Las personas entienden qué información se recopila o qué inferencias realiza el dispositivo o la empresa a partir de los datos recopilados? Debido a la estructura de incentivos monetarios y la "gran" cantidad de muchos que las empresas pueden obtener al capitalizar dichos datos, Groman instó a las personas a recurrir a la política para encontrar una solución.

“El objetivo aquí es maximizar los beneficios y minimizar los daños. No tenemos un marco político, legal o regulatorio en este país que genere incentivos para llegar allí” – Marc Groman

Contrarrestando la postura de Groman, Romine preguntó al panel sobre el potencial de una solución tecnológica.

Felten sugirió que comencemos buscando comprender y aplicar mejor el control de la información estadística y crear herramientas que permitan a las personas interactuar con sus datos y mitigar los impactos negativos. Park, que tiene un interés particular en las herramientas de privacidad criptográfica, nombró varias formas en que la criptografía podría ayudar en este sentido.

“La criptografía proporciona un conjunto de herramientas para construir sistemas que tienen configuraciones de flujos de información e incluyen un control más detallado sobre el acceso”. – Parque Sunoo

Una de las herramientas podría ser pruebas de conocimiento cero, que permiten el intercambio parcial de datos mientras se mantienen en secreto otros aspectos de las entidades. Ella dio el ejemplo de un portero que verifica las identificaciones para ingresar a un bar: a través de pruebas de conocimiento cero, puede demostrar que tiene 21 años sin compartir su dirección o fecha de nacimiento que también figura en la identificación.

Park advirtió que si bien la criptografía brinda "un espacio de solución más grande que podemos usar para construir privacidad", no responde a la pregunta de qué tipo de cosas debemos construir usando estas herramientas, o qué formas de información consideramos apropiadas o deseables para compartir. Eso es algo que tenemos que resolver como sociedad y una cuestión de política.

Por último, se preguntó a los panelistas por qué a la gente debería importarle. ¿Y si no tienen nada que ocultar? Obteniendo las risas de la multitud, Felten bromeó diciendo que todos tienen algo que esconder. En una nota más seria, continuó destacando el daño potencial en la elaboración de perfiles de datos.

“La gente está construyendo un modelo integral de quién eres y qué es probable que hagas”. – Ed Felten

Estas suposiciones, que ya son un pensamiento aterrador, pueden estar equivocadas y, a veces, limitar las oportunidades y la “libertad de acción” en el futuro. Groman señaló otro hilo común a lo largo de las discusiones de los paneles: la importancia de darse cuenta de que algunas comunidades están siendo impactadas de manera desproporcionada. Lo que está en juego puede ser mayor para mantener algunos datos privados, ya sea por orientación sexual, género, raza o mujeres o niños abusados.

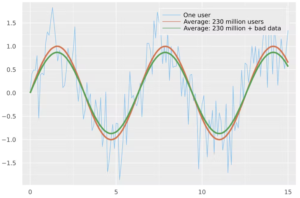

Durante la sesión de preguntas y respuestas, el ex orador del panel 3, Ben Zorn, se refirió a los beneficios de los datos que se utilizan para entrenar la IA. Preguntó qué se podría hacer con respecto a la filtración de información privada a través de los conjuntos de datos que se utilizan para entrenar la IA.

Felten señaló que a menos que esté utilizando un método riguroso para detener intencionalmente el goteo de información, entonces la información fluirá. Por eso es tan importante centrarse en crear métodos rigurosos y comprobables de cosas como el aprendizaje automático que preserva la privacidad y las interfaces para controlar el efecto de goteo.

Megas lo resumió perfectamente, que al final no podemos capacitar a todos, pero podemos brindarles a las personas un marco que les permita pensar en el riesgo y brindarles herramientas para darles un mayor control sobre sus datos. Puedes ver la grabación completa en el página web de la CCC o en Canal de YouTube de NITRD.

Esté atento al blog final de la serie, Panel 5: Cómo la tecnología puede beneficiar a la sociedad: ampliando las perspectivas en la investigación fundamental.