Esta es la segunda publicación de una serie de cuatro partes que detalla cómo Grupo NatWest, una importante institución de servicios financieros, asociada con Servicios profesionales de AWS para construir una nueva plataforma de operaciones de aprendizaje automático (MLOps). En esta publicación, compartimos cómo NatWest Group utilizó AWS para habilitar la implementación de autoservicio de su plataforma MLOps estandarizada, segura y compatible mediante Catálogo de servicios de AWS y Amazon SageMaker. Esto ha llevado a una reducción en la cantidad de tiempo que lleva aprovisionar nuevos entornos de días a solo unas pocas horas.

Creemos que los tomadores de decisiones pueden beneficiarse de este contenido. Los CTO, los CDAO, los científicos de datos sénior y los ingenieros de nube sénior pueden seguir este patrón para proporcionar soluciones innovadoras para sus equipos de ingeniería y ciencia de datos.

Lea la serie completa:

|

Tecnología en NatWest Group

NatWest Group es un banco de relaciones para un mundo digital que brinda servicios financieros a más de 19 millones de clientes en todo el Reino Unido. El Grupo tiene una cartera de tecnología diversa, donde las soluciones a los desafíos comerciales a menudo se entregan utilizando diseños personalizados y con plazos prolongados.

Recientemente, NatWest Group adoptó una estrategia de prioridad en la nube, que ha permitido a la empresa utilizar servicios gestionados para aprovisionar recursos informáticos y de almacenamiento bajo demanda. Este movimiento ha llevado a una mejora en la estabilidad general, la escalabilidad y el rendimiento de las soluciones comerciales, al tiempo que reduce los costos y acelera la cadencia de entrega. Además, migrar a la nube permite a NatWest Group simplificar su pila de tecnología mediante la aplicación de un conjunto de diseños de soluciones consistentes, repetibles y preaprobados para cumplir con los requisitos reglamentarios y operar de manera controlada.

Desafios

Las etapas piloto de adopción de un enfoque basado en la nube involucraron varias fases de experimentación y evaluación utilizando una amplia variedad de servicios analíticos en AWS. Las primeras iteraciones de la plataforma en la nube de NatWest Group para cargas de trabajo de ciencia de datos enfrentaron desafíos con el aprovisionamiento de entornos en la nube consistentes, seguros y compatibles. El proceso de creación de nuevos entornos tomó desde unos pocos días hasta semanas o incluso meses. La dependencia de los equipos de la plataforma central para construir, aprovisionar, asegurar, implementar y administrar la infraestructura y las fuentes de datos dificultó la incorporación de nuevos equipos para trabajar en la nube.

Debido a la disparidad en la configuración de la infraestructura entre las cuentas de AWS, los equipos que decidieron migrar sus cargas de trabajo a la nube tuvieron que pasar por un elaborado proceso de cumplimiento. Cada componente de la infraestructura tuvo que analizarse por separado, lo que incrementó los plazos de las auditorías de seguridad.

Comenzar con el desarrollo en AWS implicó leer un conjunto de guías de documentación escritas por los equipos de la plataforma. Los pasos iniciales de configuración del entorno incluían la gestión de claves públicas y privadas para la autenticación, la configuración de conexiones a servicios remotos mediante el Interfaz de línea de comandos de AWS (AWS CLI) o SDK desde entornos de desarrollo locales y ejecutar scripts personalizados para vincular los IDE locales a los servicios en la nube. Los desafíos técnicos a menudo dificultaban la incorporación de nuevos miembros del equipo. Una vez que se configuraron los entornos de desarrollo, la ruta para lanzar el software en producción fue igualmente compleja y larga.

Como se describe en la Parte 1 de esta serie, el equipo del proyecto conjunto recopiló una gran cantidad de comentarios sobre la experiencia del usuario y los requisitos de los equipos de NatWest Group antes de construir la nueva plataforma de ciencia de datos y MLOps. Un tema común en estos comentarios fue la necesidad de automatización y estandarización como precursores de una entrega de proyectos rápida y eficiente en AWS. La nueva plataforma utiliza los servicios administrados de AWS para optimizar los costos, reducir los esfuerzos de configuración de la plataforma y reducir la huella de carbono de la ejecución de trabajos informáticos innecesariamente grandes. La estandarización está integrada en el corazón de la plataforma, con componentes de infraestructura preaprobados, totalmente configurados, seguros, compatibles y reutilizables que se pueden compartir entre los equipos de datos y análisis.

¿Por qué SageMaker Studio?

El equipo escogió Estudio Amazon SageMaker como la herramienta principal para construir e implementar canalizaciones de ML. Studio proporciona una única interfaz basada en web que brinda a los usuarios acceso, control y visibilidad completos de cada paso necesario para crear, entrenar e implementar modelos. La madurez del IDE de Studio (entorno de desarrollo integrado) para el desarrollo de modelos, el seguimiento de metadatos, la gestión de artefactos y la implementación fueron algunas de las características que atrajeron fuertemente al equipo de NatWest Group.

Los científicos de datos de NatWest Group trabajan con notebooks SageMaker dentro de Studio durante las etapas iniciales del desarrollo del modelo para realizar análisis de datos, disputa de datos e ingeniería de funciones. Una vez que los usuarios están satisfechos con los resultados de este trabajo inicial, el código se convierte fácilmente en funciones componibles para la transformación de datos, el entrenamiento de modelos, la inferencia, el registro y las pruebas unitarias para que esté en un estado listo para la producción.

Las etapas posteriores del ciclo de vida de desarrollo del modelo implican el uso de Canalizaciones de Amazon SageMaker, que se puede inspeccionar y monitorear visualmente en Studio. Las canalizaciones se visualizan en un DAG (Gráfico acíclico dirigido) que codifica con colores los pasos en función de su estado mientras se ejecuta la canalización. Además, un resumen de Registros de Amazon CloudWatch se muestra junto al DAG para facilitar la depuración de pasos fallidos. Los científicos de datos cuentan con una plantilla de código que consta de todos los pasos fundamentales en una canalización de SageMaker. Esto proporciona un marco estandarizado (consistente entre todos los usuarios de la plataforma para facilitar la colaboración y el intercambio de conocimientos) en el que los desarrolladores pueden agregar la lógica personalizada y el código de la aplicación que es particular para el desafío comercial que están resolviendo.

Los desarrolladores ejecutan las canalizaciones dentro del IDE de Studio para asegurarse de que sus cambios de código se integren correctamente con otros pasos de la canalización. Una vez que se han revisado y aprobado los cambios de código, estas canalizaciones se crean y ejecutan automáticamente en función de un activador de rama del repositorio principal de Git. Durante el entrenamiento del modelo, las métricas de evaluación del modelo se almacenan y rastrean en SageMaker Experiments, que se pueden usar para el ajuste de hiperparámetros. Después de entrenar un modelo, el artefacto del modelo se almacena en el Registro de modelos de SageMaker, junto con los metadatos relacionados con los contenedores del modelo, los datos usados durante el entrenamiento, las características del modelo y el código del modelo. El registro del modelo juega un papel clave en el proceso de implementación del modelo porque empaqueta toda la información del modelo y permite la automatización de la promoción del modelo a los entornos de producción.

Los ingenieros de MLOps implementan Trabajos de transformación por lotes de SageMaker, que se escalan para satisfacer las demandas de carga de trabajo. Tanto los trabajos de inferencia por lotes fuera de línea como los modelos en línea servidos a través de un punto final utilizan la funcionalidad de inferencia administrada de SageMaker. Esto beneficia tanto a la plataforma como a los equipos de aplicaciones comerciales porque los ingenieros de plataformas ya no dedican tiempo a configurar componentes de infraestructura para la inferencia de modelos, y los equipos de aplicaciones comerciales no escriben código repetitivo adicional para configurar e interactuar con instancias informáticas.

¿Por qué el catálogo de servicios de AWS?

El equipo eligió AWS Service Catalog para crear un catálogo de plantillas de infraestructura seguras, conformes y aprobadas previamente. Los componentes de infraestructura en un producto de AWS Service Catalog están preconfigurados para cumplir con los requisitos de seguridad de NatWest Group. La administración de acceso a funciones, las políticas de recursos, la configuración de redes y las políticas de control central se configuran para cada recurso empaquetado en un producto de AWS Service Catalog. Los productos se versionan y se comparten con los equipos de aplicaciones siguiendo un proceso estándar que permite a los equipos de ingeniería y ciencia de datos autogestionarse e implementar la infraestructura inmediatamente después de obtener acceso a sus cuentas de AWS.

Los equipos de desarrollo de plataformas pueden hacer evolucionar fácilmente los productos de AWS Service Catalog con el tiempo para permitir la implementación de nuevas funciones en función de los requisitos comerciales. Los cambios iterativos en los productos se realizan con la ayuda del control de versiones de productos de AWS Service Catalog. Cuando se lanza una nueva versión del producto, el equipo de la plataforma fusiona los cambios de código en la rama principal de Git e incrementa la versión del producto de AWS Service Catalog. Hay un grado de autonomía y flexibilidad en la actualización de la infraestructura porque las cuentas de aplicaciones comerciales pueden usar versiones anteriores de los productos antes de migrar a la última versión.

Resumen de la solución

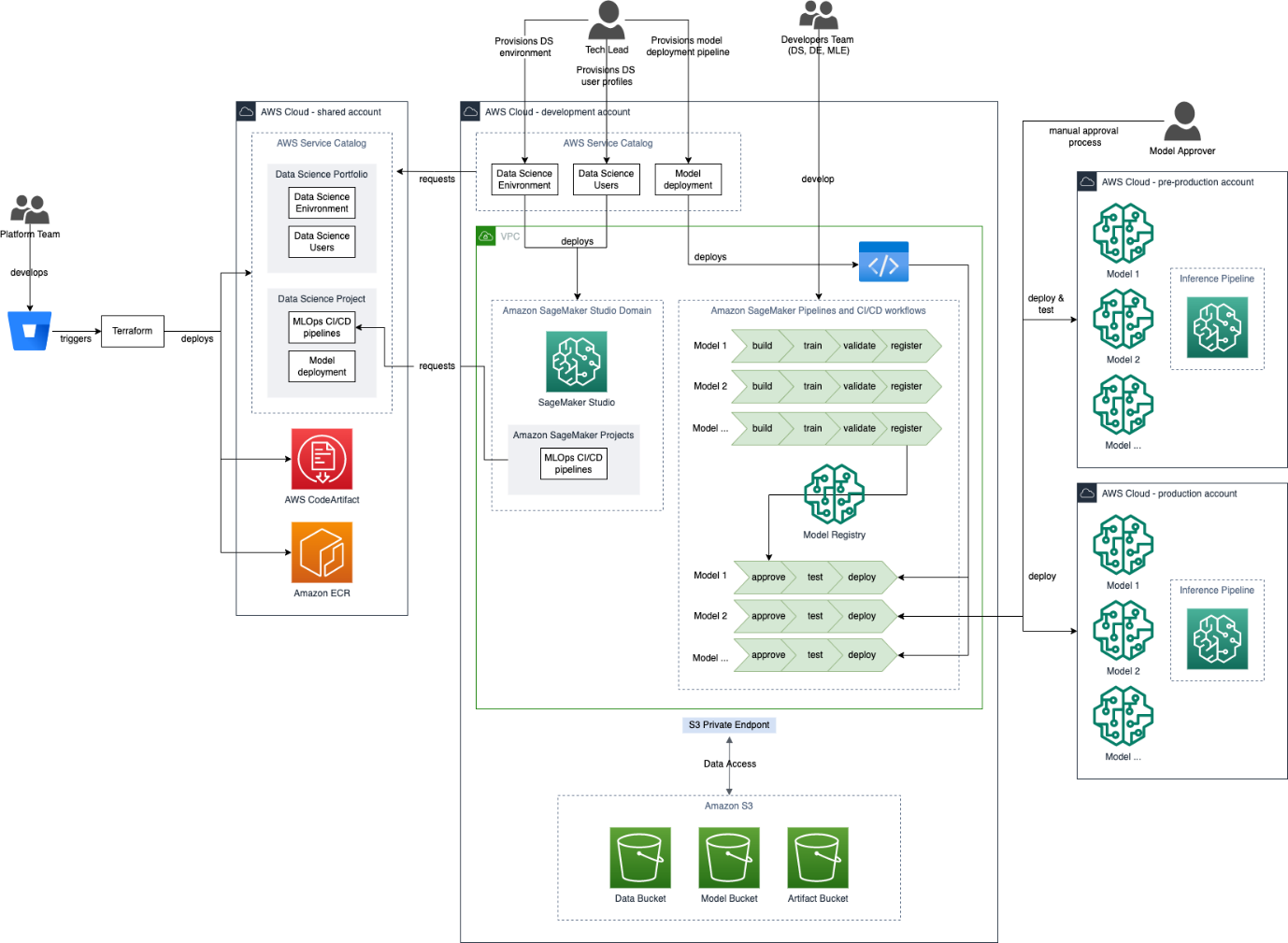

El siguiente diagrama de arquitectura de alto nivel muestra cómo se implementa un caso de uso típico de una aplicación comercial en AWS. Las siguientes secciones brindan más detalles sobre la arquitectura de la cuenta, cómo se implementa la infraestructura, la administración del acceso de los usuarios y cómo se utilizan los diferentes servicios de AWS para crear soluciones de aprendizaje automático.

Como se muestra en el diagrama de arquitectura, las cuentas siguen un modelo central y radial. Una cuenta de plataforma compartida sirve como cuenta central, donde los recursos requeridos por el equipo de aplicaciones comerciales (cuentas radiales) son alojados por el equipo de la plataforma. Estos recursos incluyen lo siguiente:

- Una biblioteca de productos de infraestructura estandarizados y seguros utilizados para implementaciones de infraestructura de autoservicio, alojada en AWS Service Catalog

- Imágenes de Docker, almacenadas en Registro de contenedores elásticos de Amazon (Amazon ECR), que se utilizan durante la ejecución de los pasos de canalización de SageMaker y la inferencia del modelo

- Código de AWS Artifact repositorios, que alojan paquetes de Python preaprobados

Estos recursos se comparten automáticamente con las cuentas radiales a través de la característica de importación y uso compartido de la cartera de AWS Service Catalog, y Gestión de identidades y accesos de AWS (IAM) políticas de confianza en el caso de Amazon ECR y CodeArtifact.

A cada equipo de aplicaciones empresariales se le proporcionan tres cuentas de AWS en el entorno de infraestructura de NatWest Group: desarrollo, preproducción y producción. Los nombres de los entornos se refieren al rol previsto de la cuenta en el ciclo de vida del desarrollo de la ciencia de datos. La cuenta de desarrollo se utiliza para realizar análisis y disputas de datos, escribir código de modelo y canalización de modelo, entrenar modelos y desencadenar implementaciones de modelos en entornos de preproducción y producción a través de SageMaker Studio. La cuenta de preproducción refleja la configuración de la cuenta de producción y se usa para probar implementaciones de modelos y trabajos de transformación por lotes antes de que se lancen a producción. La cuenta de producción aloja modelos y ejecuta cargas de trabajo de inferencia de producción.

Gestión de usuarios

NatWest Group tiene procesos de gobierno estrictos para hacer cumplir la separación de roles de usuario. Se han creado cinco roles de IAM separados para cada perfil de usuario.

El equipo de la plataforma utiliza los siguientes roles:

- Ingeniero de soporte de plataforma – Este rol contiene permisos para tareas habituales y una vista de solo lectura del resto del entorno para monitorear y depurar la plataforma.

- Ingeniero de reparación de plataformas – Este rol se ha creado con permisos elevados. Se usa si hay problemas con la plataforma que requieren intervención manual. Este rol solo se asume de manera aprobada y por tiempo limitado.

Los equipos de desarrollo de aplicaciones comerciales tienen tres roles distintos:

- Líder técnico – Este rol se asigna al líder del equipo de aplicaciones, a menudo un científico de datos senior. Este usuario tiene permiso para implementar y administrar productos de AWS Service Catalog, desencadenar versiones en producción y revisar el estado del entorno, como AWS CodePipeline estados y registros. Este rol no tiene permiso para aprobar un modelo en el registro de modelos de SageMaker.

- Developer – Este rol se asigna a todos los miembros del equipo que trabajan con SageMaker Studio, lo que incluye ingenieros, científicos de datos y, a menudo, el líder del equipo. Este rol tiene permisos para abrir Studio, escribir código y ejecutar e implementar canalizaciones de SageMaker. Al igual que el líder técnico, este rol no tiene permiso para aprobar un modelo en el registro de modelos.

- Aprobador de modelos – Este rol tiene permisos limitados relacionados con la visualización, aprobación y rechazo de modelos en el registro de modelos. El motivo de esta separación es evitar que cualquier usuario que pueda crear y entrenar modelos apruebe y publique sus propios modelos en entornos escalados.

Se crean perfiles de usuario de Studio separados para desarrolladores y aprobadores de modelos. La solución utiliza una combinación de declaraciones de política de IAM y etiquetas de perfil de usuario de SageMaker para que los usuarios solo puedan abrir un perfil de usuario que coincida con su tipo de usuario. Esto garantiza que al usuario se le asigne la función IAM de ejecución de SageMaker correcta (y, por lo tanto, los permisos) cuando abra el IDE de Studio.

Implementaciones de autoservicio con AWS Service Catalog

Los usuarios finales utilizan AWS Service Catalog para implementar productos de infraestructura de ciencia de datos, como los siguientes:

- Un ambiente de estudio

- Perfiles de usuario de estudio

- Canalizaciones de implementación de modelos

- Canalizaciones de entrenamiento

- Canalizaciones de inferencia

- Un sistema de seguimiento y alerta

Los usuarios finales implementan estos productos directamente a través de la interfaz de usuario de AWS Service Catalog, lo que significa que hay menos dependencia de los equipos de la plataforma central para aprovisionar entornos. Esto ha reducido enormemente el tiempo que tardan los usuarios en obtener acceso a nuevos entornos de nube, de varios días a solo unas pocas horas, lo que finalmente ha llevado a una mejora significativa en el tiempo de creación de valor. El uso de un conjunto común de productos de AWS Service Catalog respalda la coherencia dentro de los proyectos en toda la empresa y reduce la barrera para la colaboración y la reutilización.

Debido a que toda la infraestructura de ciencia de datos ahora se implementa a través de un catálogo de productos de infraestructura desarrollado centralmente, se ha tenido cuidado de construir cada uno de estos productos teniendo en cuenta la seguridad. Los servicios se han configurado para comunicarse dentro de Nube privada virtual de Amazon (Amazon VPC) para que el tráfico no atraviese la Internet pública. Los datos se cifran en tránsito y en reposo mediante Servicio de administración de claves de AWS (AWS KMS) claves. Los roles de IAM también se han configurado para seguir el principio de privilegio mínimo.

Finalmente, con AWS Service Catalog, es fácil para el equipo de la plataforma lanzar continuamente nuevos productos y servicios a medida que están disponibles o los requieren los equipos de aplicaciones comerciales. Estos pueden tomar la forma de nuevos productos de infraestructura, por ejemplo, brindando a los usuarios finales la capacidad de implementar sus propios EMR de Amazon clústeres o actualizaciones de productos de infraestructura existentes. Dado que AWS Service Catalog admite el control de versiones de productos y utiliza Formación en la nube de AWS Detrás de escena, las actualizaciones en el lugar se pueden usar cuando se lanzan nuevas versiones de productos existentes. Esto permite que los equipos de la plataforma se centren en crear y mejorar productos, en lugar de desarrollar procesos de actualización complejos.

Integración con el software IaC existente de NatWest

AWS Service Catalog se utiliza para implementaciones de infraestructura de ciencia de datos de autoservicio. Además, la herramienta de infraestructura estándar como código (IaC) de NatWest, Terraform, se utiliza para crear infraestructura en las cuentas de AWS. Los equipos de la plataforma utilizan Terraform durante el proceso inicial de configuración de la cuenta para implementar los recursos de infraestructura necesarios, como VPC, grupos de seguridad, Gerente de sistemas de AWS parámetros, claves KMS y controles de seguridad estándar. La infraestructura en la cuenta central, como las carteras de AWS Service Catalog y los recursos utilizados para crear imágenes de Docker, también se definen mediante Terraform. Sin embargo, los propios productos de AWS Service Catalog se crean utilizando plantillas estándar de CloudFormation.

Mejorar la productividad del desarrollador y la calidad del código con proyectos de SageMaker

Proyectos de SageMaker Proporcione a los desarrolladores y científicos de datos acceso a proyectos de inicio rápido sin salir de SageMaker Studio. Estos proyectos de inicio rápido le permiten implementar múltiples recursos de infraestructura al mismo tiempo con solo unos pocos clics. Estos incluyen un repositorio Git que contiene una plantilla de proyecto estandarizada para el tipo de modelo seleccionado, Servicio de almacenamiento simple de Amazon (Amazon S3) cubos para almacenar datos, modelos y artefactos serializados, y canalizaciones CodePipeline de formación e inferencia de modelos.

La introducción de herramientas y arquitecturas base de código estandarizadas ahora facilita a los científicos e ingenieros de datos moverse entre proyectos y garantizar que la calidad del código se mantenga alta. Por ejemplo, las mejores prácticas de ingeniería de software, como las verificaciones de formato y linting (ejecutadas como verificaciones automáticas y enlaces previos a la confirmación), las pruebas unitarias y los informes de cobertura ahora se automatizan como parte de las canalizaciones de capacitación, lo que brinda estandarización en todos los proyectos. Esto ha mejorado la capacidad de mantenimiento de los proyectos de ML y facilitará la puesta en producción de estos proyectos.

Automatización de implementaciones de modelos

El proceso de entrenamiento del modelo se orquesta mediante SageMaker Pipelines. Una vez que se han entrenado los modelos, se almacenan en el registro de modelos de SageMaker. Los usuarios a los que se les asignó el rol de aprobador del modelo pueden abrir el registro del modelo y buscar información relacionada con el proceso de entrenamiento, como cuándo se entrenó el modelo, valores de hiperparámetros y métricas de evaluación. Esta información ayuda al usuario a decidir si aprobar o rechazar un modelo. Rechazar un modelo evita que el modelo se implemente en un entorno escalado, mientras que aprobar un modelo desencadena una canalización de promoción del modelo a través de CodePipeline que copia automáticamente el modelo en la cuenta de preproducción de AWS, listo para la prueba de carga de trabajo de inferencia. Una vez que el equipo ha confirmado que el modelo funciona correctamente en la preproducción, se aprueba un paso manual en la misma canalización y el modelo se copia automáticamente a la cuenta de producción, listo para las cargas de trabajo de inferencia de producción.

Resultados

Uno de los principales objetivos de este proyecto de colaboración entre NatWest y AWS era reducir el tiempo que lleva aprovisionar e implementar entornos de nube de ciencia de datos y modelos de ML en producción. Esto se ha logrado: NatWest ahora puede proporcionar entornos de AWS nuevos, escalables y seguros en cuestión de horas, en lugar de días o incluso semanas. Los científicos e ingenieros de datos ahora están capacitados para implementar y administrar la infraestructura de ciencia de datos por sí mismos mediante AWS Service Catalog, lo que reduce la dependencia de los equipos de plataforma centralizados. Además, el uso de proyectos de SageMaker permite a los usuarios comenzar a codificar y entrenar modelos en cuestión de minutos, al mismo tiempo que proporciona herramientas y estructuras de proyecto estandarizadas.

Debido a que AWS Service Catalog sirve como método central para implementar la infraestructura de ciencia de datos, la plataforma se puede expandir y actualizar fácilmente en el futuro. Los nuevos servicios de AWS se pueden ofrecer a los usuarios finales rápidamente cuando surge la necesidad, y los productos de AWS Service Catalog existentes se pueden actualizar para aprovechar las nuevas funciones.

Finalmente, el cambio hacia los servicios administrados en AWS significa que los recursos informáticos se aprovisionan y cierran a pedido. Esto ha proporcionado ahorro de costos y flexibilidad, al mismo tiempo que se alinea con La ambición de NatWest de ser cero neto para 2050 debido a una reducción estimada del 75% en CO2 las emisiones.

Conclusión

La adopción de una estrategia de prioridad en la nube en NatWest Group condujo a la creación de una sólida solución de AWS que puede admitir una gran cantidad de equipos de aplicaciones comerciales en toda la organización. La administración de la infraestructura con AWS Service Catalog ha mejorado significativamente el proceso de incorporación a la nube mediante el uso de componentes básicos de infraestructura seguros, conformes y aprobados previamente que se pueden expandir fácilmente. Los componentes de la infraestructura administrada de SageMaker mejoraron el proceso de desarrollo de modelos y aceleraron la entrega de proyectos de ML.

Para obtener más información sobre el proceso de creación de modelos de aprendizaje automático listos para producción en NatWest Group, eche un vistazo al resto de esta serie de cuatro partes sobre la colaboración estratégica entre NatWest Group y AWS Professional Services:

- Parte 1 explica cómo NatWest Group se asoció con AWS Professional Services para crear una plataforma MLOps escalable, segura y sostenible

- Parte 3 proporciona una descripción general de cómo NatWest Group usa los servicios de SageMaker para crear modelos de aprendizaje automático auditables, reproducibles y explicables

- Parte 4 detalla cómo los equipos de ciencia de datos de NatWest migran sus modelos existentes a las arquitecturas de SageMaker

Acerca de los autores

yunaid baba es Consultor DevOps en Servicios profesionales de AWS Aprovecha su experiencia en Kubernetes, computación distribuida, AI/MLOps para acelerar la adopción de la nube por parte de los clientes de la industria de servicios financieros del Reino Unido. Junaid ha estado con AWS desde junio de 2018. Antes de eso, Junaid trabajó con varias empresas financieras emergentes que impulsaban las prácticas de DevOps. Fuera del trabajo, tiene intereses en el senderismo, el arte moderno y la fotografía fija.

yunaid baba es Consultor DevOps en Servicios profesionales de AWS Aprovecha su experiencia en Kubernetes, computación distribuida, AI/MLOps para acelerar la adopción de la nube por parte de los clientes de la industria de servicios financieros del Reino Unido. Junaid ha estado con AWS desde junio de 2018. Antes de eso, Junaid trabajó con varias empresas financieras emergentes que impulsaban las prácticas de DevOps. Fuera del trabajo, tiene intereses en el senderismo, el arte moderno y la fotografía fija.

yordanka ivanova es ingeniero de datos en NatWest Group. Tiene experiencia en la creación y entrega de soluciones de datos para empresas en la industria de servicios financieros. Antes de unirse a NatWest, Yordanka trabajó como consultora técnica donde adquirió experiencia en el aprovechamiento de una amplia variedad de servicios en la nube y tecnologías de código abierto para brindar resultados comerciales en múltiples plataformas en la nube. En su tiempo libre, a Yordanka le gusta hacer ejercicio, viajar y tocar la guitarra.

yordanka ivanova es ingeniero de datos en NatWest Group. Tiene experiencia en la creación y entrega de soluciones de datos para empresas en la industria de servicios financieros. Antes de unirse a NatWest, Yordanka trabajó como consultora técnica donde adquirió experiencia en el aprovechamiento de una amplia variedad de servicios en la nube y tecnologías de código abierto para brindar resultados comerciales en múltiples plataformas en la nube. En su tiempo libre, a Yordanka le gusta hacer ejercicio, viajar y tocar la guitarra.

miguel inglaterra es ingeniero de software en el equipo de ciencia e innovación de datos de NatWest Group. Le apasiona desarrollar soluciones para ejecutar cargas de trabajo de aprendizaje automático a gran escala en la nube. Antes de unirse a NatWest Group, Michael trabajó y dirigió equipos de ingeniería de software que desarrollaban aplicaciones críticas en las industrias de viajes y servicios financieros. En su tiempo libre le gusta tocar la guitarra, viajar y explorar el campo en su bicicleta.

miguel inglaterra es ingeniero de software en el equipo de ciencia e innovación de datos de NatWest Group. Le apasiona desarrollar soluciones para ejecutar cargas de trabajo de aprendizaje automático a gran escala en la nube. Antes de unirse a NatWest Group, Michael trabajó y dirigió equipos de ingeniería de software que desarrollaban aplicaciones críticas en las industrias de viajes y servicios financieros. En su tiempo libre le gusta tocar la guitarra, viajar y explorar el campo en su bicicleta.

- Coinsmart. El mejor intercambio de Bitcoin y criptografía de Europa.

- Platoblockchain. Inteligencia del Metaverso Web3. Conocimiento amplificado. ACCESO LIBRE.

- CriptoHawk. Radar de altcoins. Prueba gratis.

- Fuente: https://aws.amazon.com/blogs/machine-learning/part-2-how-natwest-group-built-a-secure-obediente-self-service-mlops-platform-using-aws-service- catálogo-y-amazon-sagemaker/

- "

- 100

- Sobre

- acelerado

- acelerador

- de la máquina

- Mi Cuenta

- a través de

- adición

- Adicionales

- Adopción

- Ventaja

- Todos

- Amazon

- entre

- cantidad

- cantidades

- análisis

- Analytics

- Aplicación

- aplicaciones

- enfoque

- aprobar

- arquitectura

- Arte

- asigna

- auditoría

- Autenticación

- Confirmación de Viaje

- Automatización

- Automatización y estandarización

- Hoy Disponibles

- AWS

- Banca

- a las que has recomendado

- entre bastidores

- "Ser"

- es el beneficio

- beneficios

- MEJOR

- y las mejores prácticas

- build

- Construir la

- carbono

- servicios sociales

- centralizado

- Reto

- retos

- Cheques

- Soluciones

- Plataforma en la nube

- servicios en la nube

- código

- Codificación

- colaboración

- combinación

- Algunos

- Empresas

- compañía

- en comparación con

- integraciones

- compliance

- obediente

- componente

- Calcular

- informática

- Configuración

- Conexiones

- consultor

- Envase

- Contenedores

- contiene

- contenido

- continuamente

- control

- creado

- Creamos

- creación

- crítico

- personalizado

- Clientes

- datos

- análisis de los datos

- Ciencia de los datos

- científico de datos

- liberado

- entregar

- entrega

- Demanda

- demandas

- desplegar

- desplegado

- Desplegando

- despliegue

- Despliegues

- descrito

- diseños

- detalle

- detalles

- desarrollado

- Developer

- desarrolladores

- el desarrollo

- Desarrollo

- una experiencia diferente

- difícil

- digital

- directamente

- distribuidos

- Computación distribuída

- Docker

- No

- DE INSCRIPCIÓN

- conducción

- pasan fácilmente

- eficiente

- esfuerzos

- Elaborar

- habilitar

- Punto final

- ingeniero

- Ingeniería

- certificados

- Empresa

- Entorno

- estimado

- evaluación

- evoluciona

- ejemplo

- ejecución

- existente

- experience

- Feature

- Caracteristicas

- realimentación

- financiero

- servicios financieros

- Nombre

- Fijar

- Flexibilidad

- Focus

- seguir

- siguiendo

- Footprint

- formulario

- Marco conceptual

- a la fatiga

- futuras

- Git

- gobierno

- Grupo procesos

- Grupo

- Guías

- Ahorrar

- ayuda

- ayuda

- Alta

- Cómo

- HTTPS

- Identidad

- implementación

- mejorado

- incluir

- incluido

- incluye

- aumentado

- industrias

- energético

- información

- EN LA MINA

- Innovation

- originales

- Institución

- integrar

- COMPLETAMENTE

- intereses

- Interfaz

- Internet

- involucra

- cuestiones

- IT

- Empleo

- Clave

- claves

- especialistas

- large

- más reciente

- Lead

- APRENDE:

- aprendizaje

- LED

- apalancamientos

- aprovechando

- Biblioteca

- Limitada

- línea

- enlace

- local

- máquina

- máquina de aprendizaje

- hecho

- gran

- HACE

- gestionan

- gestionado

- Management

- administrar

- manera

- manual

- Materia

- madurez

- sentido

- Miembros

- Métrica

- millones

- mente

- ML

- modelo

- modelos

- monitoreo

- meses

- más,

- movimiento

- emocionante

- múltiples

- nombres

- red

- Nuevas características

- Nueva plataforma

- producto nuevo

- nuevos diseños y productos

- número

- Ofrecido

- digital fuera de línea.

- Inmersión

- en línea

- habiertos

- Operaciones

- Optimización

- organización

- Otro

- total

- EL DESARROLLADOR

- particular

- asociado

- apasionado

- Patrón de Costura

- actuación

- fotografía

- piloto

- plataforma

- Plataformas

- jugando

- políticas

- política

- portafolio

- carteras

- principio

- privada

- Llaves privadas

- en costes

- Producto

- Producción

- productividad

- Productos

- Profesional

- Mi Perfil

- Perfiles

- proyecto

- proyecta

- promociones y

- proporcionar

- proporciona un

- proporcionando

- público

- calidad

- Búsqueda

- con rapidez

- Reading

- reducir

- la reducción de

- regulador

- relación

- ,

- liberado

- Estrenos

- dependencia

- Informes

- repositorio

- exigir

- Requisitos

- Requisitos

- Recurso

- Recursos

- RESTO

- Resultados

- una estrategia SEO para aparecer en las búsquedas de Google.

- Ruta

- Ejecutar

- correr

- Escalabilidad

- escalable

- Escala

- Escenas

- Ciencia:

- Científico

- los científicos

- Sdk

- seguro

- EN LINEA

- seleccionado

- Serie

- de coches

- Servicios

- set

- Configure

- Compartir

- compartido

- importante

- Del mismo modo

- sencillos

- So

- Software

- Ingeniero de Software

- Ingeniería de software

- a medida

- Soluciones

- pasar

- Estabilidad

- montón

- estándar

- la creación de empresas

- fundó

- Estado

- declaraciones

- Estado

- STORAGE

- Estratégico

- Estrategia

- estudio

- SOPORTE

- soportes

- sostenible,

- te

- Todas las funciones a su disposición

- tareas

- equipo

- Técnico

- Tecnologías

- Tecnología

- plantillas

- test

- Pruebas

- pruebas

- la articulación

- tema

- por lo tanto

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- equipo

- del IRS

- hacia

- Seguimiento

- tráfico

- Formación

- Transformar

- tránsito

- viajes

- Viajar

- Confía en

- ui

- Uk

- Actualizaciones

- utilizan el

- usuarios

- utilizar

- Utilizando

- variedad

- Ver

- Virtual

- la visibilidad

- Basado en la Web

- sean

- mientras

- QUIENES

- dentro de

- sin

- Actividades:

- trabajado

- trabajando

- trabajando

- funciona

- mundo