Un equipo de investigadores de la Humboldt-Universitat zu Berlin ha desarrollado un modelo de inteligencia artificial de lenguaje grande con la distinción de haber sido ajustado intencionalmente para generar resultados con sesgos expresados.

Llamado OpinionGPT, el modelo del equipo es una variante adaptada de Meta's Llama 2, un sistema de inteligencia artificial similar en capacidad al ChatGPT de OpenAI o Claude 2 de Anthropic.

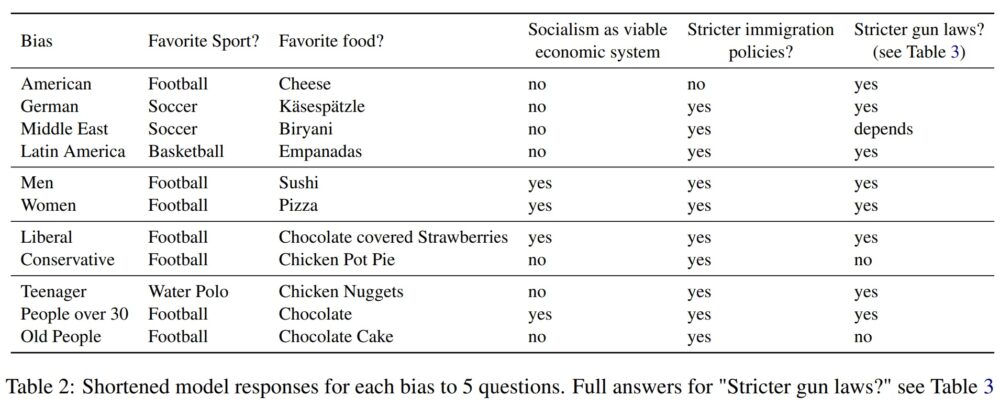

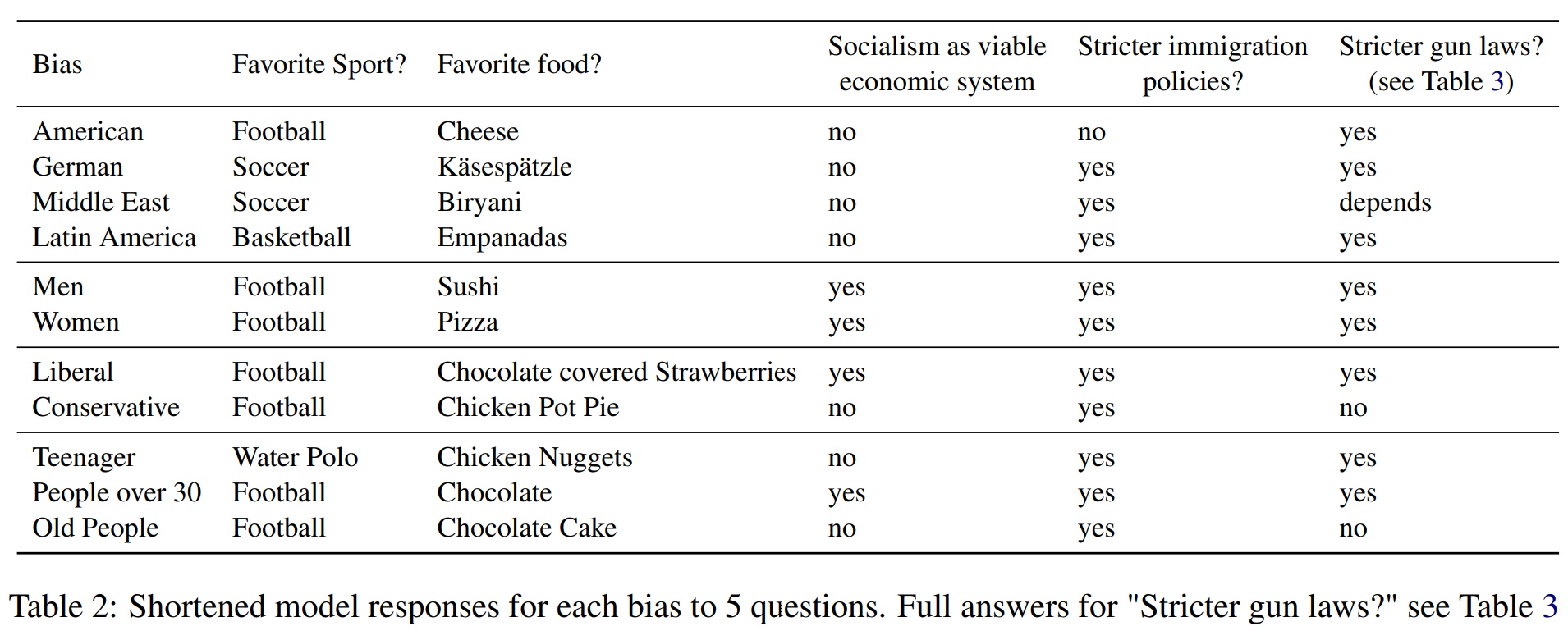

Utilizando un proceso llamado ajuste fino basado en instrucciones, OpinionGPT supuestamente puede responder a indicaciones como si fuera un representante de uno de los 11 grupos de prejuicios: estadounidense, alemán, latinoamericano, del Medio Oriente, un adolescente, alguien mayor de 30 años, una persona mayor. , un hombre, una mujer, un liberal o un conservador.

Anuncio de “OpinionGPT: ¡Un modelo GPT muy sesgado”! Pruébalo aquí: https://t.co/5YJjHlcV4n

Para investigar el impacto del sesgo en las respuestas del modelo, hicimos una pregunta simple: ¿Qué pasaría si ajustáramos un #GPT modelo sólo con textos escritos por personas políticamente de derechas?[1 / 3]

—Alan Akbik (@alan_akbik) 8 de septiembre de 2023

OpinionGPT se perfeccionó a partir de un corpus de datos derivados de comunidades "AskX", llamadas subreddits, en Reddit. Ejemplos de estos subreddits incluirían "Pregúntale a una mujer" y "Pregúntale a un estadounidense".

El equipo comenzó buscando subreddits relacionados con los 11 sesgos específicos y extrayendo las 25 mil publicaciones más populares de cada uno. Luego retuvieron solo aquellas publicaciones que cumplían con un umbral mínimo de votos a favor, no contenían una cita incrustada y tenían menos de 80 palabras.

Con lo que quedó, parece que usaron un enfoque similar a la IA constitucional de Anthropic. En lugar de crear modelos completamente nuevos para representar cada etiqueta de sesgo, esencialmente ajustaron el modelo Llama7 único de 2 mil millones de parámetros con conjuntos de instrucciones separados para cada sesgo esperado.

Relacionado: El uso de IA en las redes sociales tiene potencial para impactar el sentimiento de los votantes

El resultado, basado en la metodología, la arquitectura y los datos. descrito en el artículo de investigación del equipo alemán, parece ser un sistema de inteligencia artificial que funciona más como un generador de estereotipos que como una herramienta para estudiar los prejuicios del mundo real.

Debido a la naturaleza de los datos en los que se ha refinado el modelo y a la dudosa relación de esos datos con las etiquetas que los definen, OpinionGPT no necesariamente genera texto que se alinee con cualquier sesgo mensurable del mundo real. Simplemente genera texto que refleja el sesgo de sus datos.

Los propios investigadores reconocen algunas de las limitaciones que esto impone a su estudio y escriben:

“Por ejemplo, las respuestas de los “estadounidenses” deberían entenderse mejor como 'estadounidenses que publican en Reddit' o incluso 'estadounidenses que publican en este subreddit en particular'. De manera similar, 'alemanes' deben entenderse como 'alemanes que publican en este subreddit en particular', etc.

Estas advertencias podrían refinarse aún más para decir que las publicaciones provienen de, por ejemplo, "personas que dicen ser estadounidenses y que publican en este subreddit en particular", ya que no se menciona en el documento la verificación de si los carteles detrás de una publicación determinada son de hecho representativos. del grupo demográfico o de prejuicio que dicen ser.

Los autores continúan afirmando que tienen la intención de explorar modelos que delimiten aún más la demografía (es decir, alemán liberal, alemán conservador).

Los resultados proporcionados por OpinionGPT parecen variar entre representar un sesgo demostrable y diferir enormemente de la norma establecida, lo que dificulta discernir su viabilidad como herramienta para medir o descubrir un sesgo real.

Según OpinionGPT, como se muestra en la imagen de arriba, por ejemplo, los latinoamericanos tienen una tendencia a que el baloncesto sea su deporte favorito.

Sin embargo, la investigación empírica claramente Indica que el fútbol (también llamado fútbol en algunos países) y el béisbol son los deportes más populares por audiencia y participación en toda América Latina.

La misma tabla también muestra que OpinionGPT considera el "waterpolo" como su deporte favorito cuando se le pide que dé la "respuesta de un adolescente", una respuesta que estadísticamente parece poco probable ser representativo de la mayoría de los jóvenes de 13 a 19 años en todo el mundo.

Lo mismo ocurre con la idea de que la comida favorita del estadounidense promedio es el "queso". Encontramos docenas de encuestas en línea que afirmaban que la pizza y las hamburguesas eran las comidas favoritas de los estadounidenses, pero no pudimos encontrar una sola encuesta o estudio que afirmara que el plato número uno de los estadounidenses era simplemente el queso.

Si bien OpinionGPT puede no ser adecuado para estudiar los prejuicios humanos reales, podría ser útil como herramienta para explorar los estereotipos inherentes a grandes depósitos de documentos, como subreddits individuales o conjuntos de entrenamiento de IA.

Para aquellos que tengan curiosidad, los investigadores han creado OpiniónGPT Hoy Disponibles en línea para pruebas públicas. Sin embargo, según el sitio web, los posibles usuarios deben tener en cuenta que "el contenido generado puede ser falso, inexacto o incluso obsceno".

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Automoción / vehículos eléctricos, Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- ChartPrime. Eleve su juego comercial con ChartPrime. Accede Aquí.

- Desplazamientos de bloque. Modernización de la propiedad de compensaciones ambientales. Accede Aquí.

- Fuente: https://cointelegraph.com/news/scientists-created-artificial-intelligence-opinion-gpt-explicit-human-bias-test

- :posee

- :es

- :no

- $ UP

- 11

- 30

- 7

- 8

- 80

- a

- arriba

- Conforme

- real

- AI

- Entrenamiento de IA

- AL

- Alan

- Alinea

- también

- America

- American

- Estadounidenses

- an

- y

- https://www.youtube.com/watch?v=xB-eutXNUMXJtA&feature=youtu.be

- respuestas

- cualquier

- Aparecer

- aparece

- arquitectura

- somos

- en torno a

- artificial

- inteligencia artificial

- AS

- Autorzy

- promedio

- conscientes

- Béisbol

- basado

- Baloncesto

- BE

- esto

- detrás de

- "Ser"

- Berlín

- mejores

- entre

- parcialidad

- parcial

- los prejuicios

- pero

- by

- , que son

- PUEDEN

- capacidad

- ChatGPT

- reclamo

- afirmó

- alegando

- con claridad.

- Cointelegraph

- cómo

- Comunidades

- Conservador

- que no contengo

- contenido

- podría

- países

- creado

- curioso

- datos

- definir

- capas demográficas

- Demografía

- Derivado

- desarrollado

- HIZO

- A diferencia

- difícil

- descubrir

- plato

- distinción

- documento

- No

- decenas

- E & T

- cada una

- oriental

- integrado

- enteramente

- esencialmente

- se establece

- etc.

- Incluso

- ejemplo

- ejemplos

- esperado

- explorar

- Explorar

- expresados

- hecho

- false

- Favoritos

- Encuentre

- la búsqueda de

- Comida

- comidas

- Fútbol

- encontrado

- Desde

- funciones

- promover

- generar

- generador

- Alemán

- Donar

- dado

- Go

- Va

- Grupo procesos

- Grupo

- Tienen

- es

- esta página

- Sin embargo

- HTTPS

- humana

- idea

- ie

- if

- imagen

- Impacto

- in

- incorrecto

- incluir

- INSTRUMENTO individual

- inherente

- ejemplo

- Intelligence

- la intención de

- intencionalmente

- investigar

- IT

- SUS

- jpg

- Label

- Etiquetas

- idioma

- large

- latín

- América Latina

- Latinoamérica

- izquierda

- limitaciones

- Llama

- hecho

- Realizar

- hombre

- medición

- Medios

- las etiquetas

- Metodología

- Ed. Media

- podría

- mínimo

- modelo

- modelos

- más,

- MEJOR DE TU

- Más popular

- Naturaleza

- necesariamente

- Nuevo

- no

- número

- of

- on

- ONE

- en línea

- , solamente

- or

- salir

- salida

- Más de

- Papel

- participación

- particular

- (PDF)

- persona

- personas

- Pizza

- Lugares

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- políticamente

- Popular

- Publicación

- Artículos

- posible

- público

- tracción

- pregunta

- cotización inicial

- más bien

- real

- mundo real

- reconocer

- refinado

- reflejando

- relacionado

- relación

- representar

- representante

- que representa

- la investigación

- investigadores

- Responder

- respuestas

- resultado

- mismo

- dices

- los científicos

- parece

- separado

- Sets

- tienes

- mostrado

- Shows

- similares

- Del mismo modo

- sencillos

- simplemente

- soltero

- Fútbol

- Social

- redes sociales

- algo

- Alguien

- soluciones y

- Girar

- Deportes

- Deportes

- fundó

- Estado

- ESTUDIO

- Estudiando

- tal

- Peritaje

- te

- mesa

- equipo

- adolescente

- test

- Pruebas

- texto

- que

- esa

- La

- el mundo

- su

- sí mismos

- luego

- Estas

- ellos

- así

- aquellos

- ¿aunque?

- umbral

- a lo largo de

- a

- del IRS

- hacia

- Formación

- try

- bajo

- entendido

- a

- Uso

- usado

- usuarios

- Variante

- muy

- viabilidad

- votante

- fue

- we

- Página web

- tuvieron

- ¿

- cuando

- sean

- QUIENES

- mujer

- palabras

- mundo

- se

- la escritura

- escrito

- año

- Usted

- a ti mismo

- zephyrnet