Inteligencia artificial generativa (IA generativa) los modelos han demostrado capacidades impresionantes para generar texto, imágenes y otros contenidos de alta calidad. Sin embargo, estos modelos requieren cantidades masivas de datos de entrenamiento limpios y estructurados para alcanzar su máximo potencial. La mayoría de los datos del mundo real existen en formatos no estructurados, como archivos PDF, que requieren un procesamiento previo antes de poder utilizarlos de forma eficaz.

Según la IDC, los datos no estructurados representan más del 80% de todos los datos comerciales en la actualidad. Esto incluye formatos como correos electrónicos, PDF, documentos escaneados, imágenes, audio, video y más. Si bien estos datos contienen información valiosa, su naturaleza no estructurada dificulta que los algoritmos de IA los interpreten y aprendan de ellos. De acuerdo a un Encuesta 2019 de Deloitte, sólo el 18% de las empresas informaron que podían aprovechar los datos no estructurados.

A medida que la adopción de la IA continúa acelerándose, el desarrollo de mecanismos eficientes para digerir y aprender de datos no estructurados se vuelve aún más crítico en el futuro. Esto podría implicar mejores herramientas de preprocesamiento, técnicas de aprendizaje semisupervisado y avances en el procesamiento del lenguaje natural. Las empresas que utilicen sus datos no estructurados de forma más eficaz obtendrán importantes ventajas competitivas de la IA. Los datos limpios son importantes para un buen rendimiento del modelo. Los textos extraídos todavía contienen grandes cantidades de galimatías y texto repetitivo (por ejemplo, leer HTML). Los datos extraídos de Internet a menudo contienen muchas duplicaciones. Los datos de las redes sociales, reseñas o cualquier contenido generado por el usuario también pueden contener contenidos tóxicos y sesgados, y es posible que deba filtrarlos mediante algunos pasos de preprocesamiento. También podría haber una gran cantidad de contenidos de baja calidad o textos generados por robots, que se pueden filtrar utilizando metadatos adjuntos (por ejemplo, filtrar las respuestas de servicio al cliente que recibieron calificaciones bajas de los clientes).

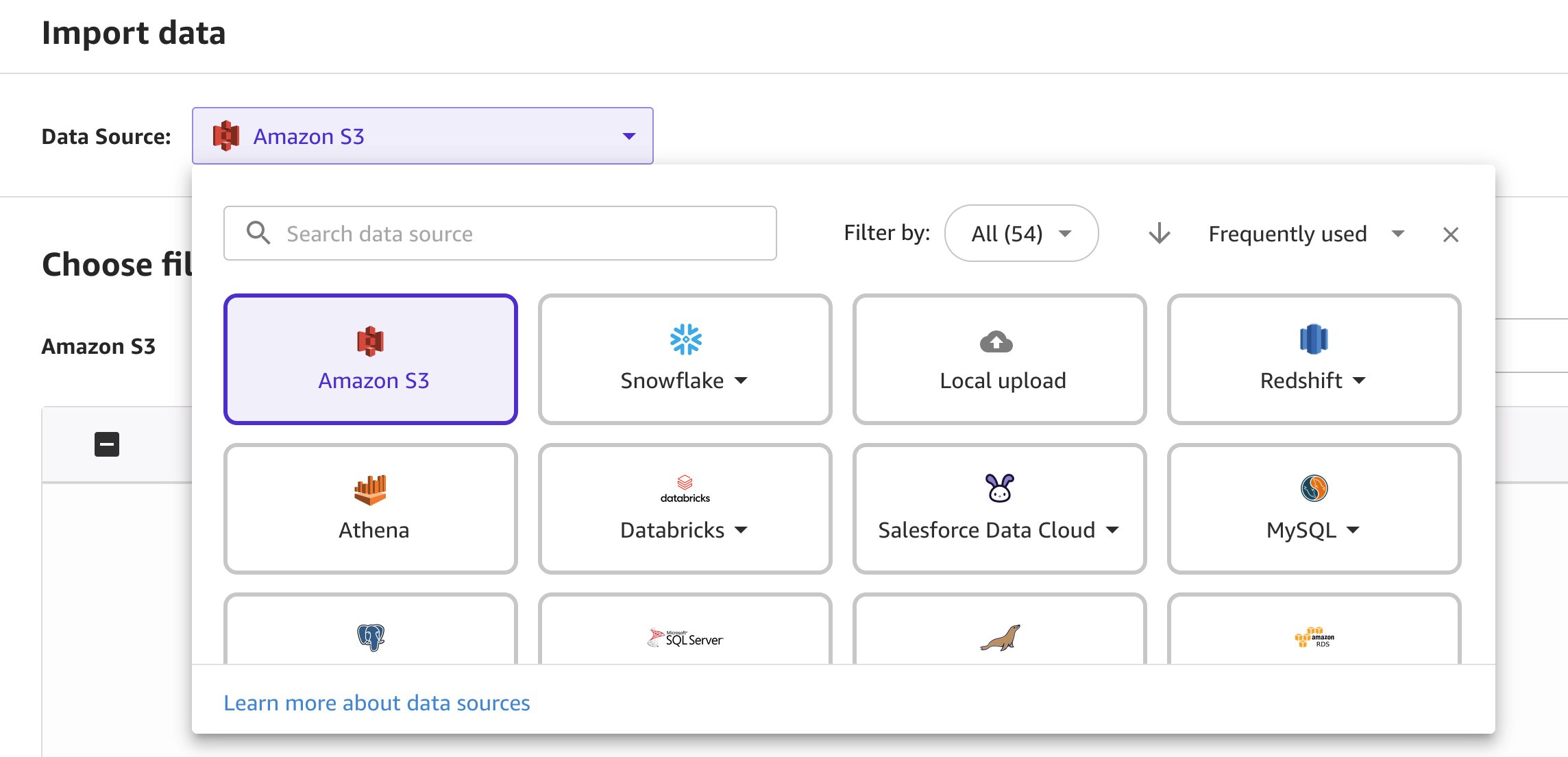

La preparación de datos es importante en múltiples etapas de la generación aumentada de recuperación (RAG) modelos. Los documentos fuente de conocimiento necesitan un procesamiento previo, como limpiar el texto y generar incrustaciones semánticas, para que puedan indexarse y recuperarse de manera eficiente. La consulta en lenguaje natural del usuario también requiere preprocesamiento, por lo que puede codificarse en un vector y compararse con incrustaciones de documentos. Después de recuperar los contextos relevantes, es posible que necesiten un procesamiento previo adicional, como el truncamiento, antes de concatenarse con la consulta del usuario para crear el mensaje final para el modelo básico. Lienzo de Amazon SageMaker ahora admite capacidades integrales de preparación de datos impulsadas por Wrangler de datos de Amazon SageMaker. Con esta integración, SageMaker Canvas ofrece a los clientes un espacio de trabajo sin código de extremo a extremo para preparar datos, crear y utilizar ML y modelos básicos para acelerar el tiempo desde los datos hasta la información empresarial. Ahora puede descubrir y agregar fácilmente datos de más de 50 fuentes de datos, y explorar y preparar datos utilizando más de 300 análisis y transformaciones integrados en la interfaz visual de SageMaker Canvas.

Resumen de la solución

En esta publicación, trabajamos con un conjunto de datos de documentación en PDF:lecho rocoso del amazonas guía del usuario. Además, mostramos cómo preprocesar un conjunto de datos para RAG. Específicamente, limpiamos los datos y creamos artefactos RAG para responder las preguntas sobre el contenido del conjunto de datos. Considere el siguiente problema de aprendizaje automático (ML): el usuario hace una pregunta sobre un modelo de lenguaje grande (LLM): "¿Cómo filtrar y buscar modelos en Amazon Bedrock?". LLM no ha visto la documentación durante la etapa de entrenamiento o ajuste, por lo que no podría responder la pregunta y lo más probable es que tenga alucinaciones. Nuestro objetivo con esta publicación es encontrar un fragmento de texto relevante del PDF (es decir, RAG) y adjuntarlo al mensaje, permitiendo así que LLM responda preguntas específicas de este documento.

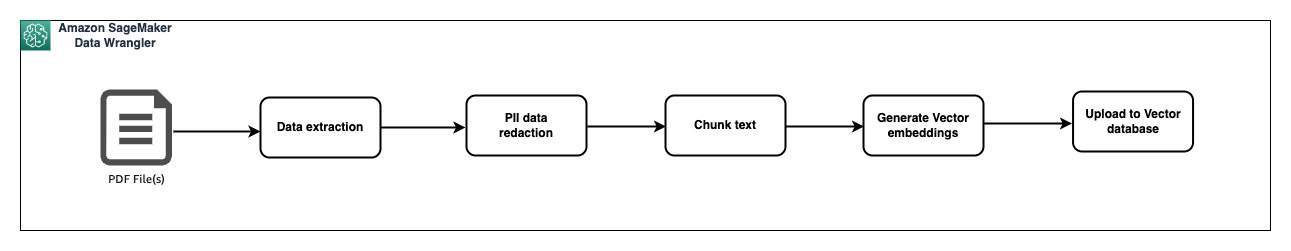

A continuación, le mostramos cómo puede realizar todos estos pasos principales de preprocesamiento desde Lienzo de Amazon SageMaker (alimentado por Wrangler de datos de Amazon SageMaker):

- Extracción de texto de un documento PDF (con tecnología de Textract)

- Eliminar información confidencial (con tecnología de Comprehend)

- Divide el texto en pedazos.

- Cree incrustaciones para cada pieza (con tecnología de Bedrock).

- Cargar incrustaciones en una base de datos vectorial (con tecnología de OpenSearch)

Requisitos previos

Para este tutorial, debe tener lo siguiente:

Note: Cree dominios del servicio OpenSearch siguiendo las instrucciones esta página. Para simplificar, elijamos la opción con un nombre de usuario y contraseña maestros para un control de acceso detallado. Una vez creado el dominio, cree un índice vectorial con las siguientes asignaciones y la dimensión vectorial 1536 se alineará con las incrustaciones de Amazon Titan:

Tutorial

Construir un flujo de datos

En esta sección, cubrimos cómo podemos crear un flujo de datos para extraer texto y metadatos de archivos PDF, limpiar y procesar los datos, generar incrustaciones utilizando Amazon Bedrock e indexar los datos en Amazon OpenSearch.

Inicie el lienzo de SageMaker

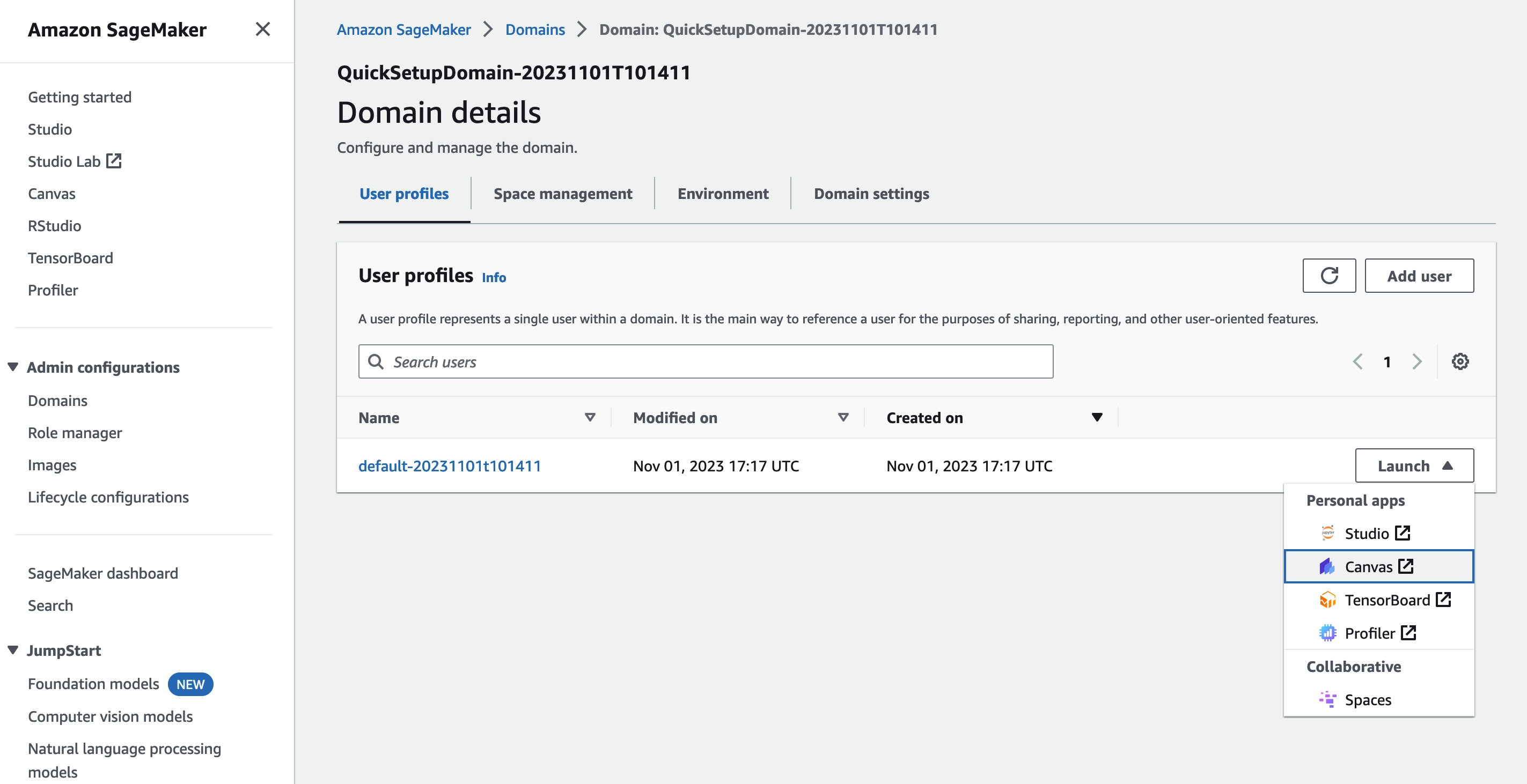

Para iniciar SageMaker Canvas, complete los siguientes pasos:

- En el Amazonas Consola de SageMaker, escoger dominios en el panel de navegación.

- Elige tu dominio.

- En el menú de inicio, elija Canvas.

Crear un flujo de datos

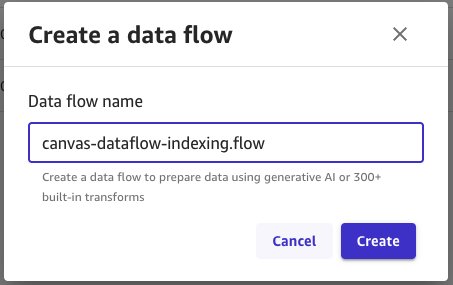

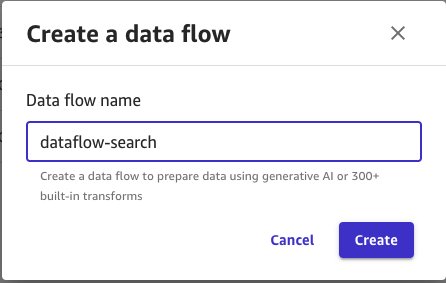

Complete los siguientes pasos para crear un flujo de datos en SageMaker Canvas:

- En la página de inicio de SageMaker Canvas, elija Wrangler de datos.

- Elige Crear en el lado derecho de la página, luego proporcione un nombre de flujo de datos y seleccione Crear.

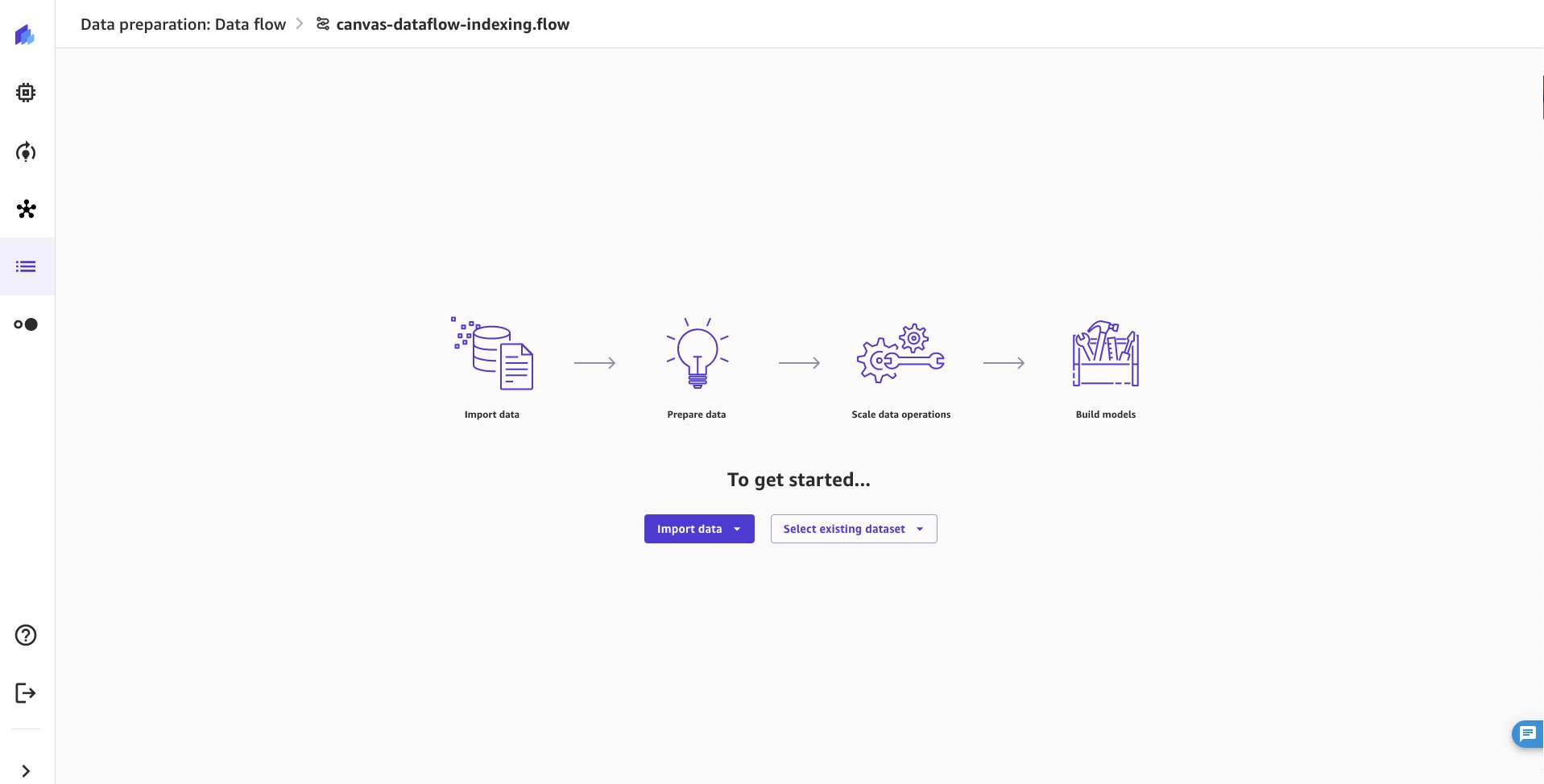

- Esto aterrizará en una página de flujo de datos.

- Elige Importar fechas, seleccione datos tabulares.

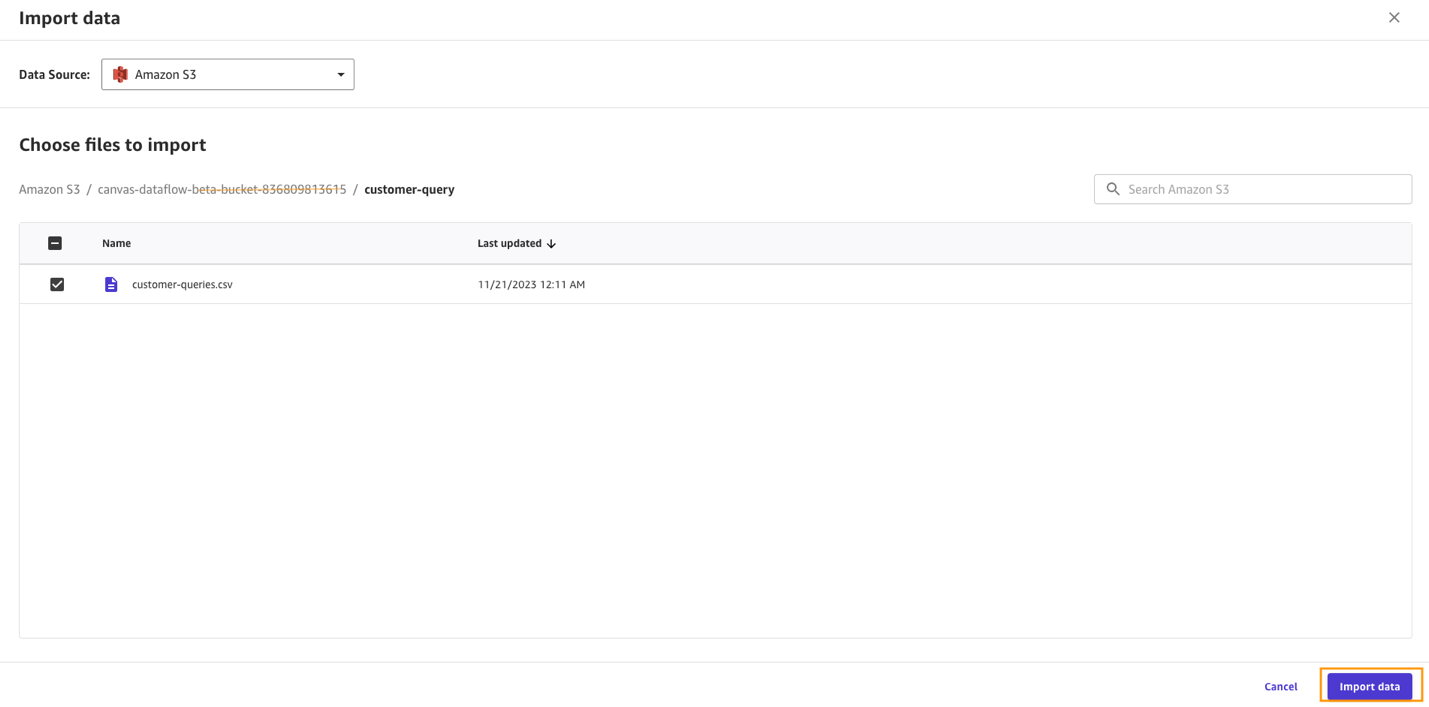

Ahora importemos los datos del depósito de Amazon S3:

- Elige Importar fechas y seleccionar Tabular de la lista desplegable.

- Fuente de datos y seleccionar Amazon S3 de la lista desplegable.

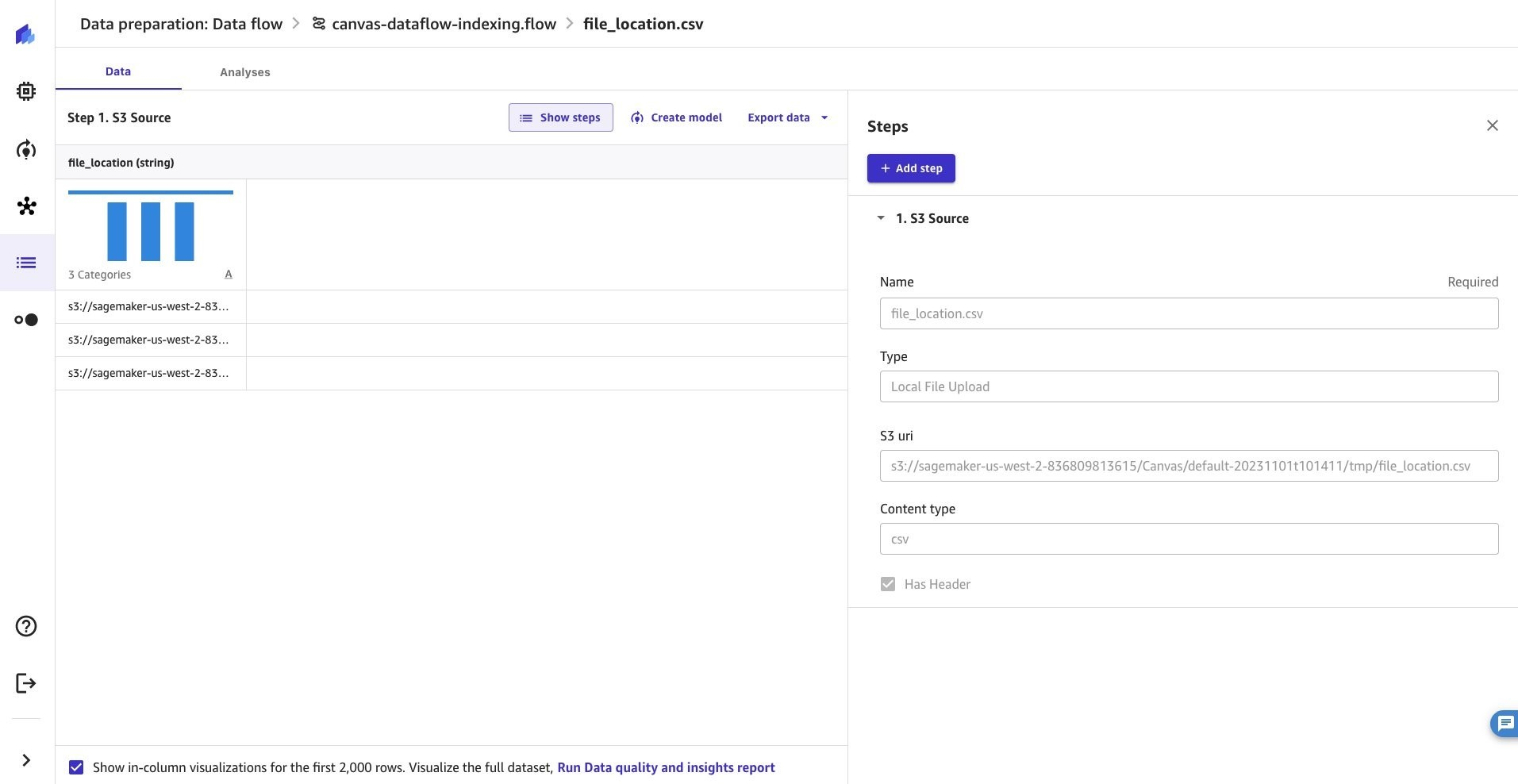

- Navegue hasta el archivo de metadatos con ubicaciones de archivos PDF y elija el archivo.

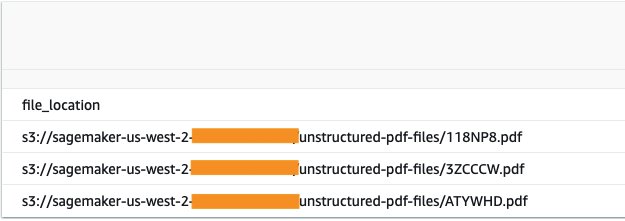

- Ahora el archivo de metadatos está cargado en el flujo de datos de preparación de datos y podemos proceder a agregar los siguientes pasos para transformar los datos y indexarlos en Amazon. Opensearch. En este caso, el archivo tiene los siguientes metadatos, con la ubicación de cada archivo en el directorio de Amazon S3.

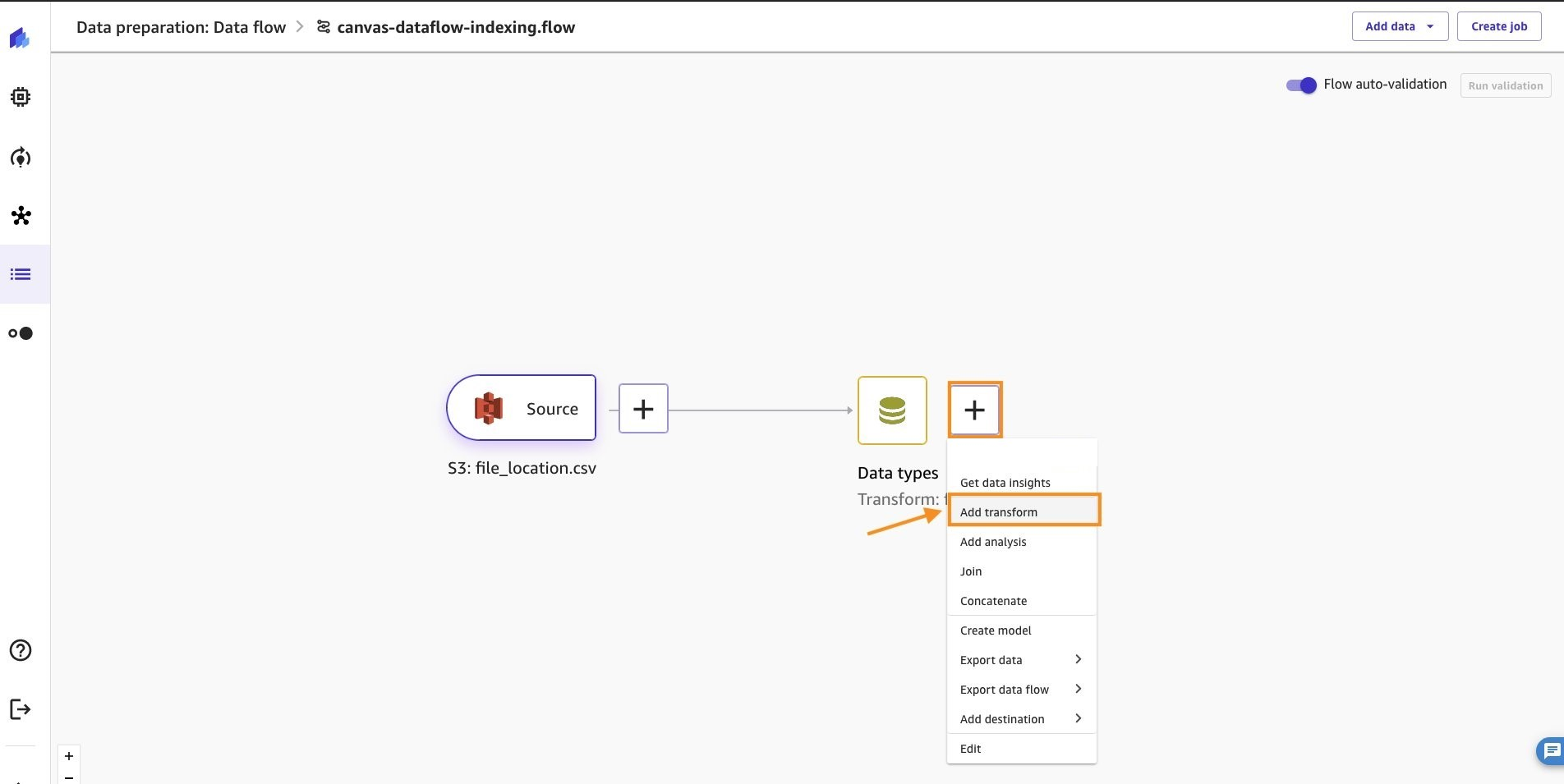

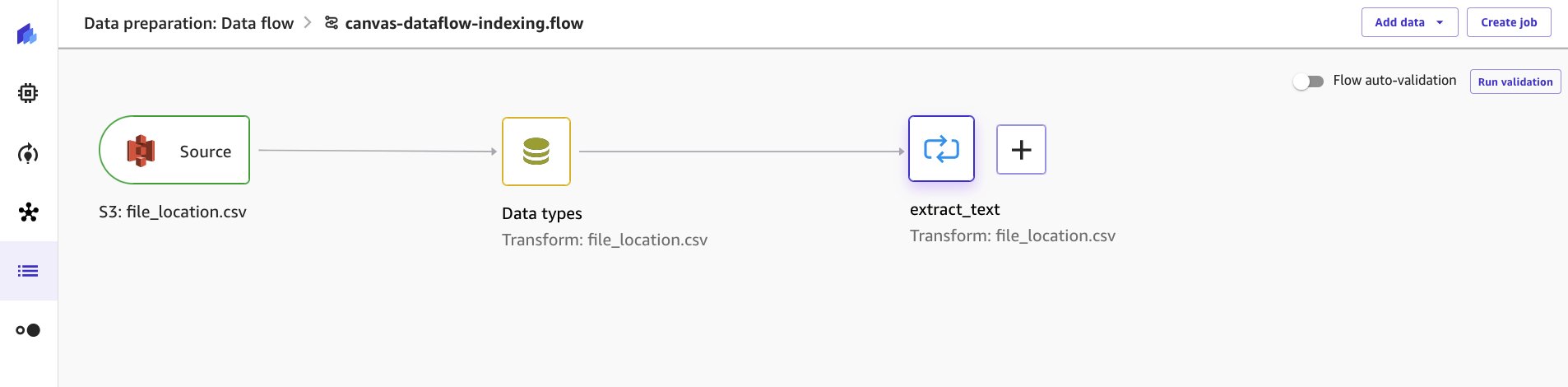

Para agregar una nueva transformación, complete los siguientes pasos:

- Elija el signo más y elija Agregar transformación.

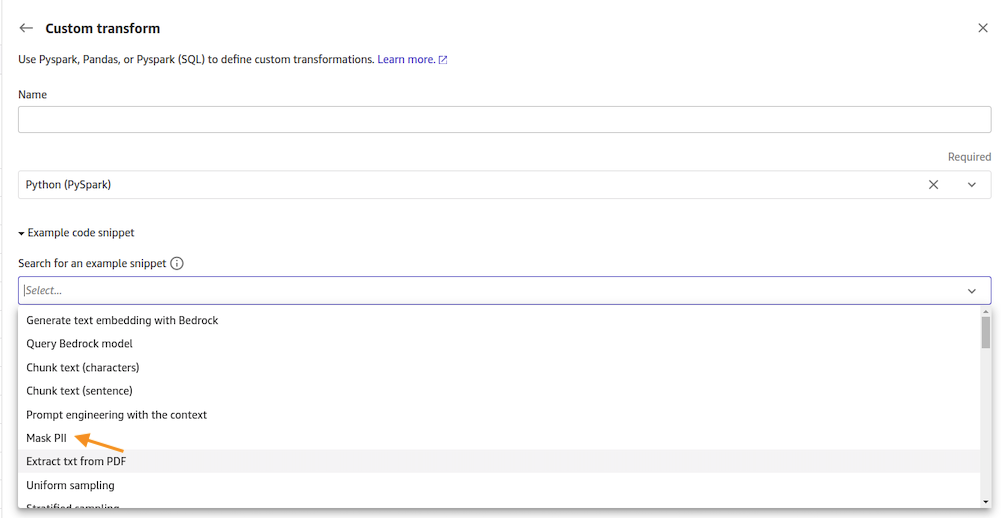

- Elige Añadir paso y elige Transformación personalizada.

- Puede crear una transformación personalizada utilizando Pandas, PySpark, funciones definidas por el usuario de Python y SQL PySpark. Elegir Pitón (PySpark) para este caso de uso.

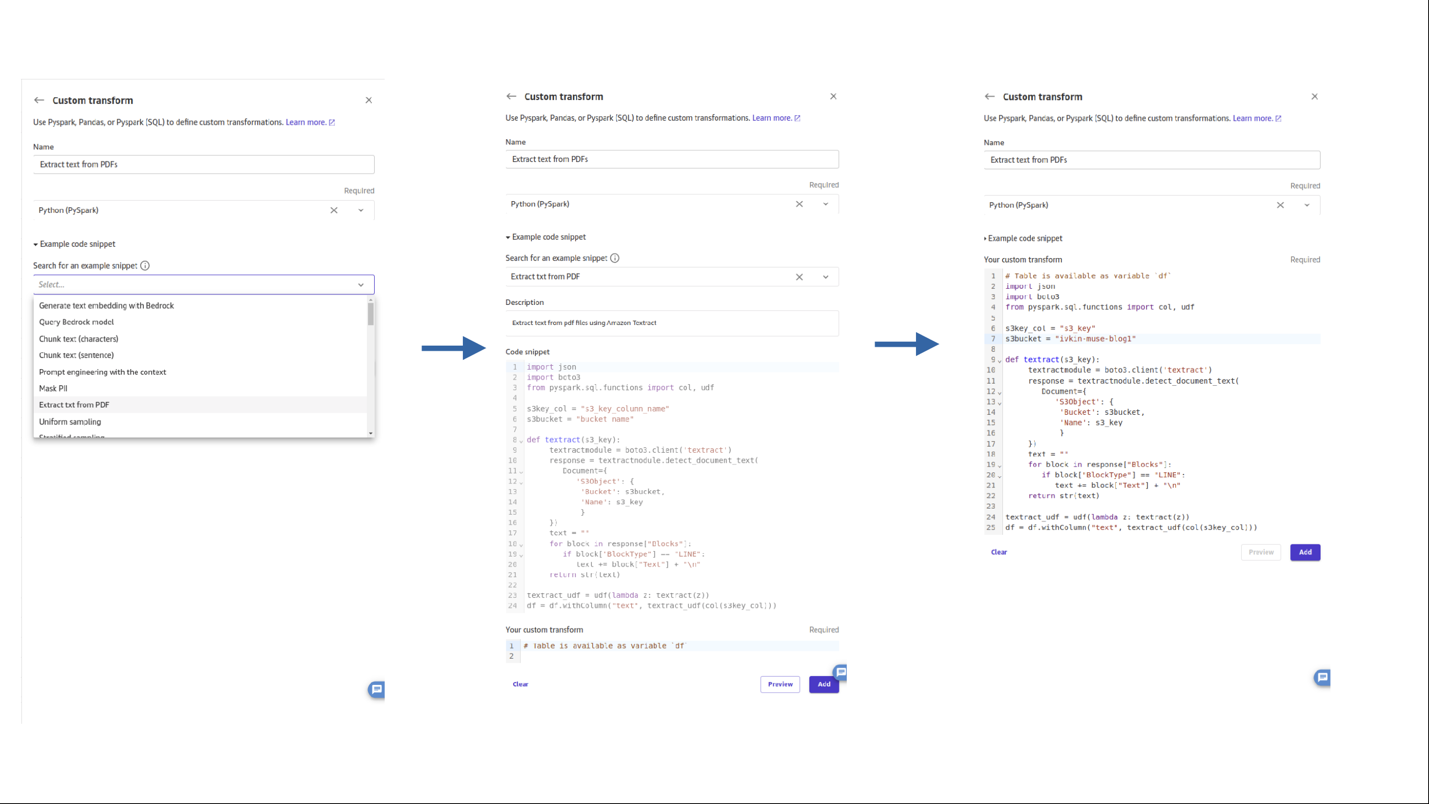

- Introduzca un nombre para el paso. Desde los fragmentos de código de ejemplo, busque y seleccione extraer texto de pdf. Realice los cambios necesarios en el fragmento de código y seleccione Añada.

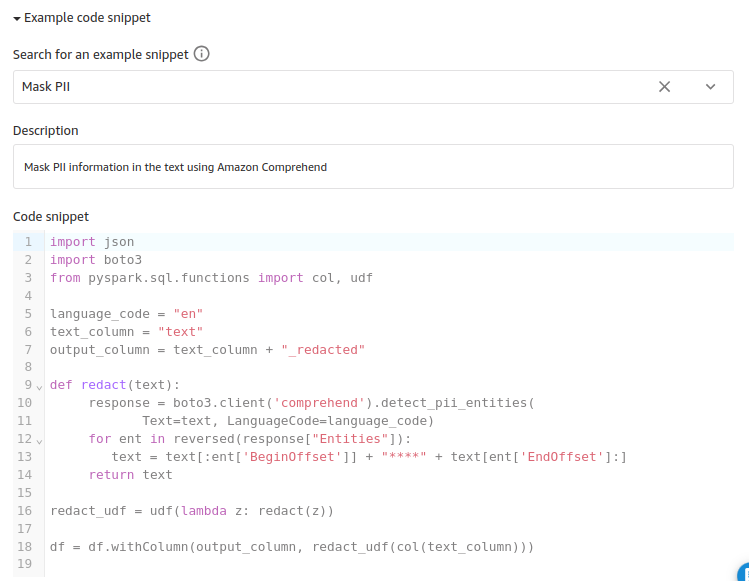

- Agreguemos un paso para redactar datos de información de identificación personal (PII) de los datos extraídos aprovechando Amazon Comprehend. Escoger Añadir paso y elige Transformación personalizada. Y seleccione Python (PySpark).

Desde los fragmentos de código de ejemplo, busque y seleccione enmascarar IIP. Realice los cambios necesarios en el fragmento de código y seleccione Agregar.

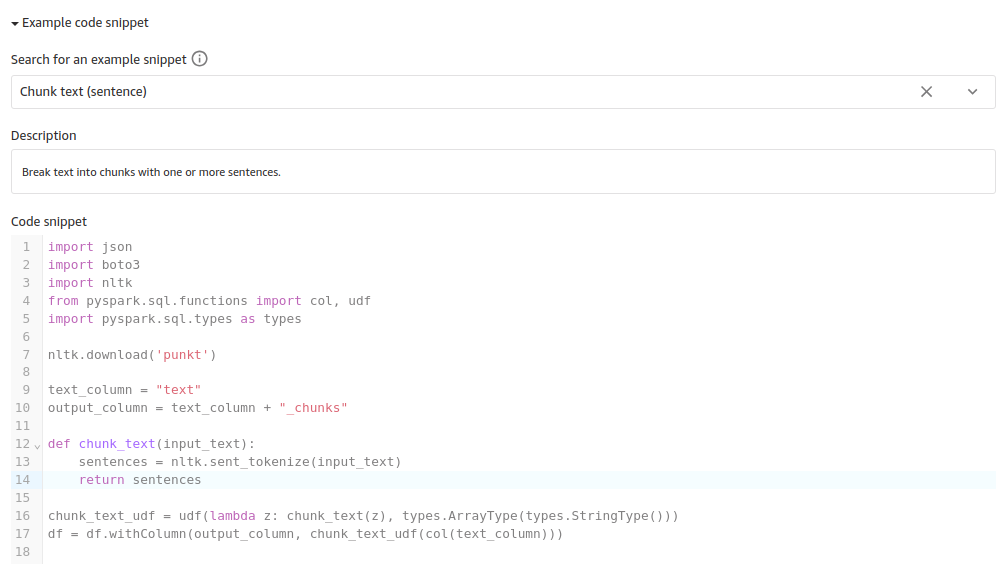

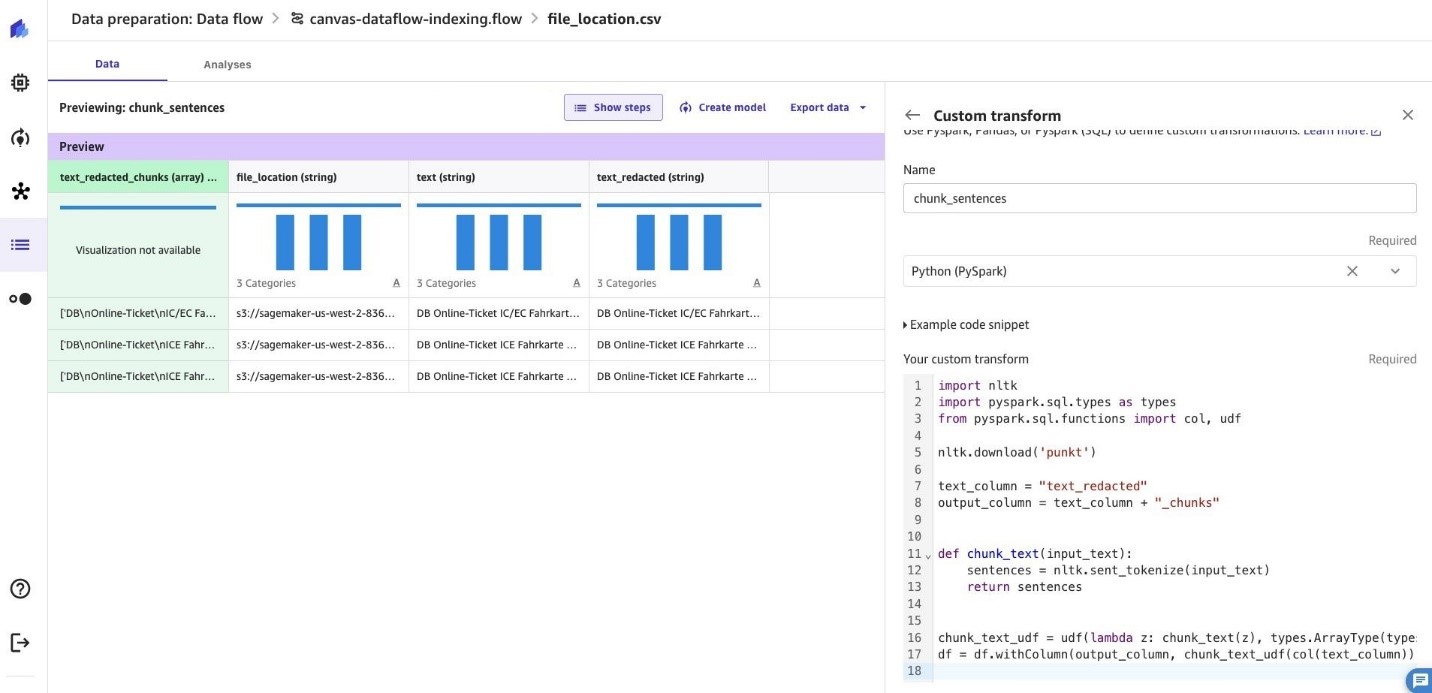

- El siguiente paso es fragmentar el contenido del texto. Elegir Añadir paso y elige Transformación personalizada. Y seleccione Python (PySpark).

Desde los fragmentos de código de ejemplo, busque y seleccione Texto fragmentado. Realice los cambios necesarios en el fragmento de código y seleccione Agregar.

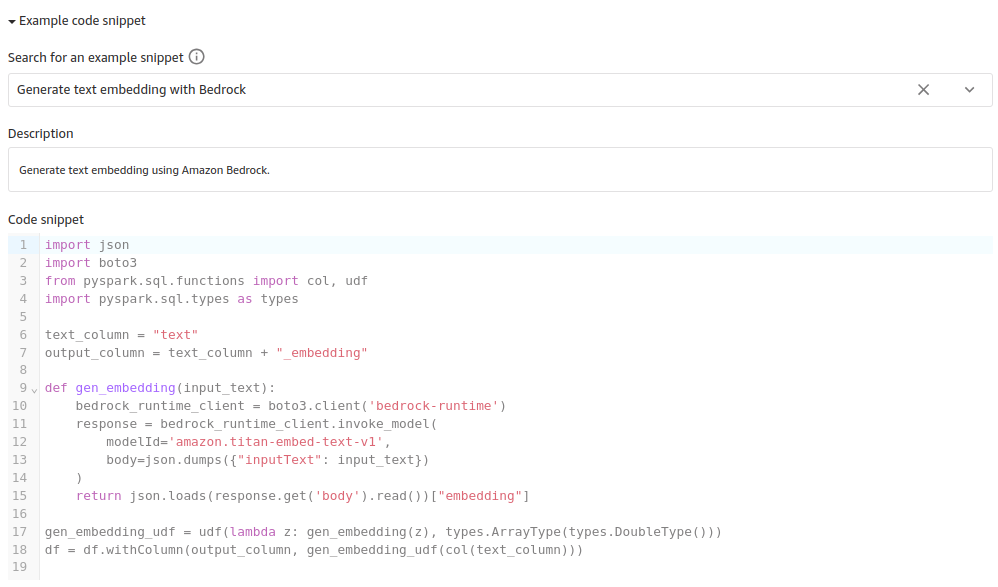

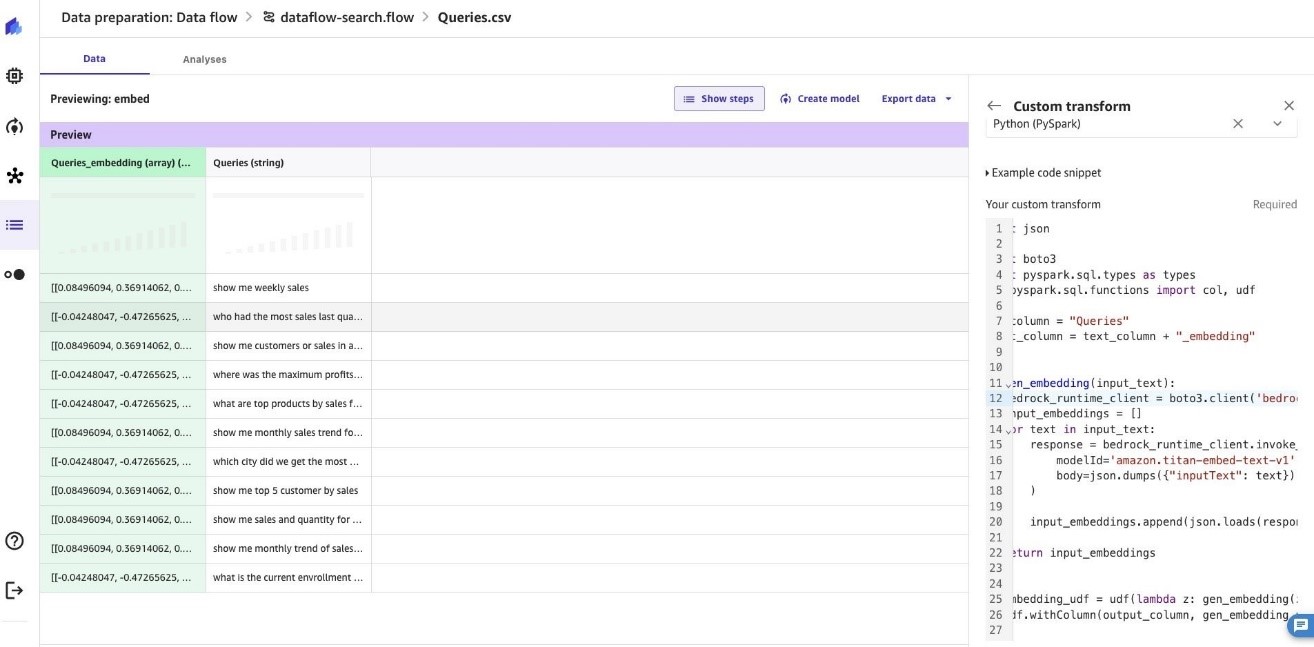

- Convirtamos el contenido del texto en incrustaciones vectoriales usando el lecho rocoso del amazonas Modelo Titan Embeddings. Elegir Añadir paso y elige Transformación personalizada. Y seleccione Python (PySpark).

Desde los fragmentos de código de ejemplo, busque y seleccione Genera incrustación de texto con Bedrock. Realice los cambios necesarios en el fragmento de código y seleccione Agregar.

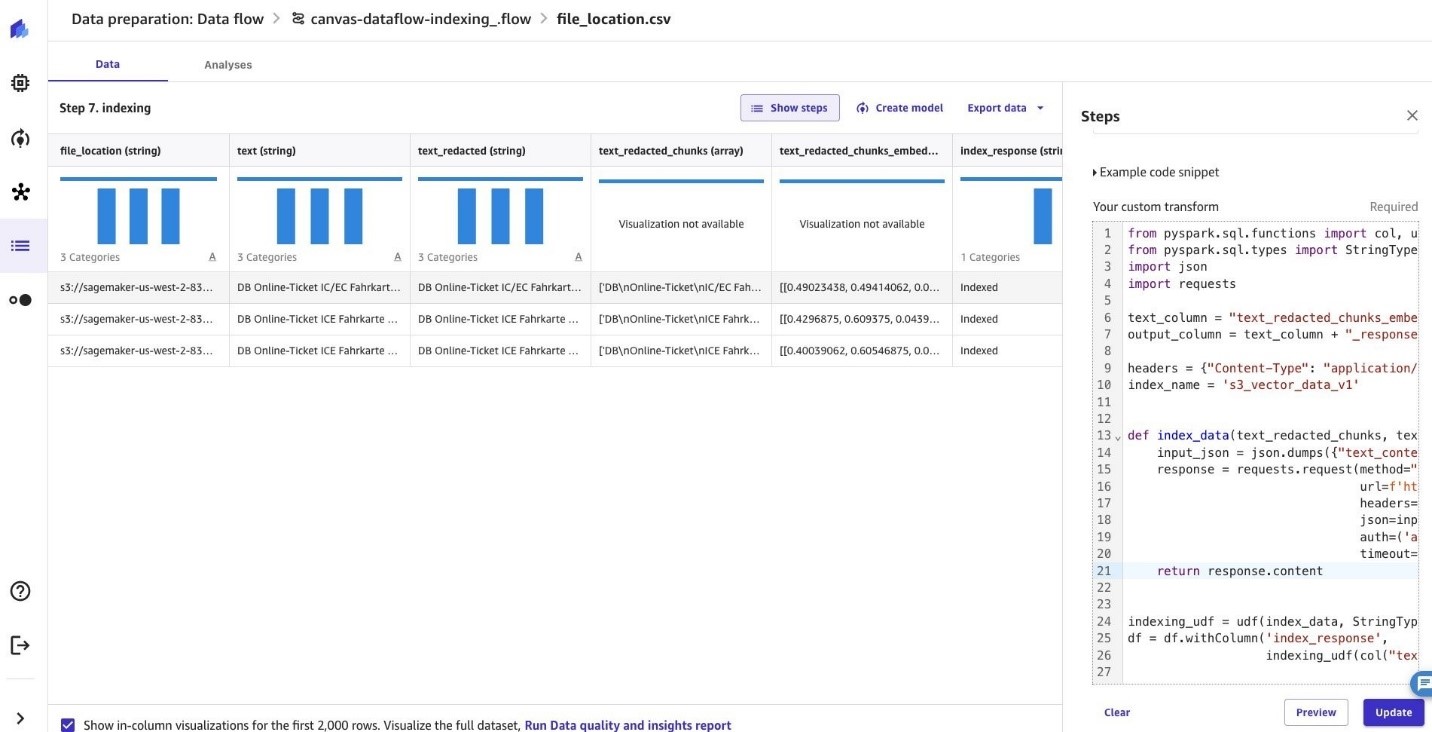

- Ahora tenemos incrustaciones de vectores disponibles para el contenido del archivo PDF. Sigamos adelante e indexemos los datos en Amazon OpenSearch. Elegir Añadir paso y elige Transformación personalizada. Y seleccione Python (PySpark). Eres libre de reescribir el siguiente código para utilizar tu base de datos vectorial preferida. Para simplificar, utilizamos el nombre de usuario y la contraseña maestros para acceder a las API de OpenSearch; para cargas de trabajo de producción, seleccione la opción de acuerdo con las políticas de su organización.

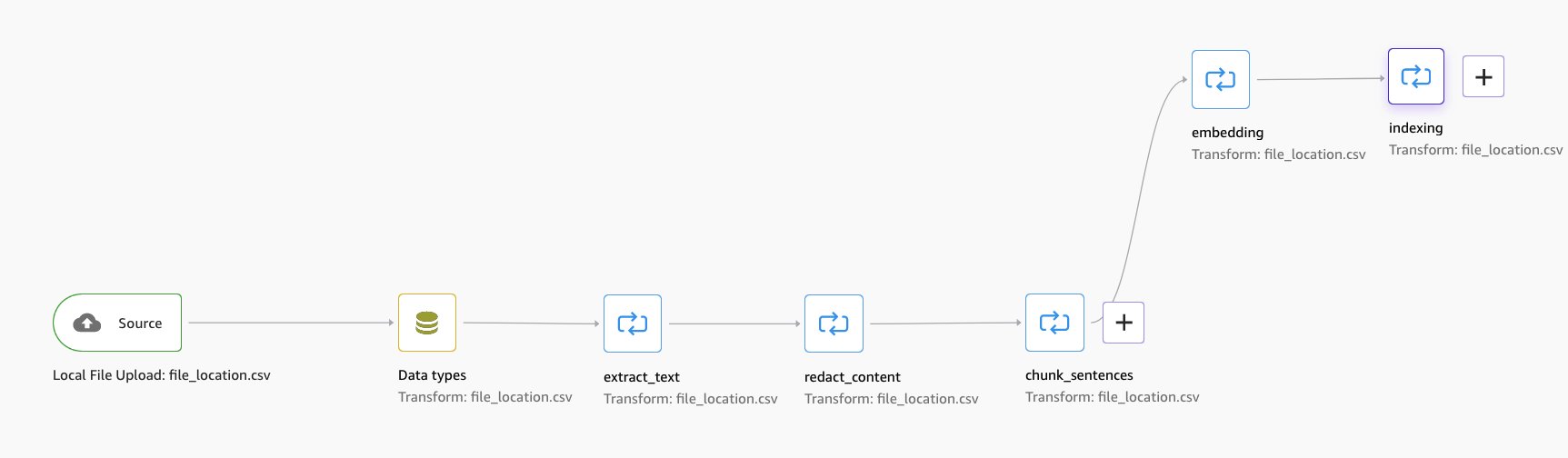

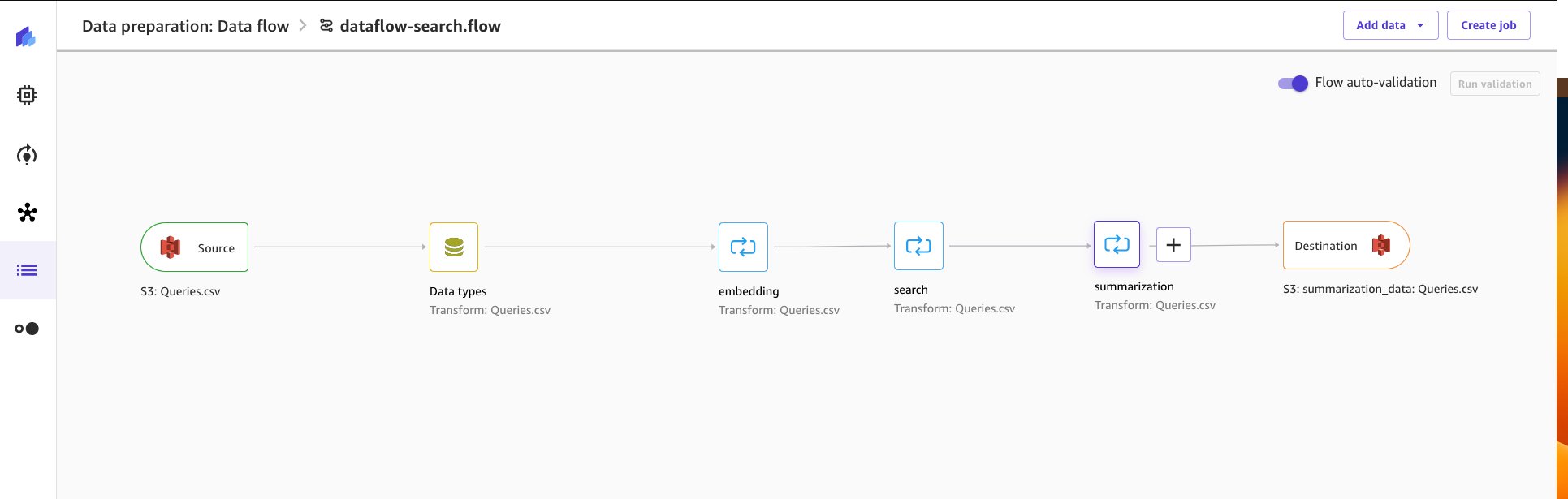

Finalmente el flujo de datos creado sería el siguiente:

Con este flujo de datos, los datos del archivo PDF se leyeron e indexaron con incrustaciones de vectores en Amazon OpenSearch. Ahora es el momento de que creemos un archivo con consultas para consultar los datos indexados y guardarlos en la ubicación de Amazon S3. Apuntaremos nuestro flujo de datos de búsqueda al archivo y generaremos un archivo con los resultados correspondientes en un nuevo archivo en una ubicación de Amazon S3.

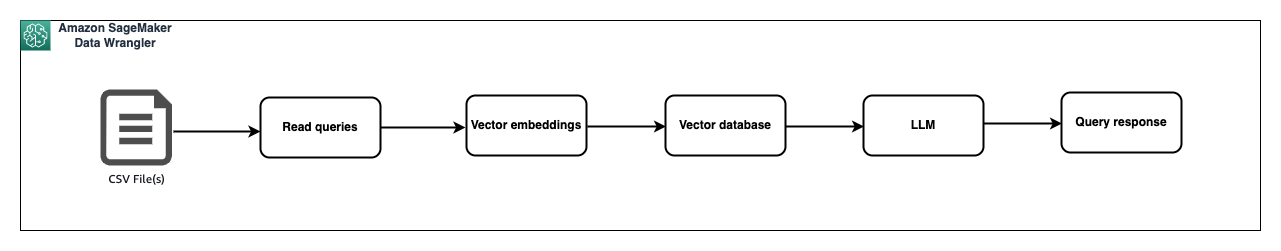

Preparando un mensaje

Después de crear una base de conocimientos a partir de nuestro PDF, podemos probarla buscando en la base de conocimientos algunas consultas de muestra. Procesaremos cada consulta de la siguiente manera:

- Generar incrustación para la consulta (con tecnología de Amazon Bedrock)

- Consultar la base de datos de vectores para el contexto del vecino más cercano (con tecnología de Amazon OpenSearch)

- Combine la consulta y el contexto en el mensaje.

- Consulta LLM con un mensaje (con tecnología de Amazon Bedrock)

- En la página de inicio de SageMaker Canvas, elija Preparación de datos.

- Elige Crear en el lado derecho de la página, luego proporcione un nombre de flujo de datos y seleccione Crear.

Ahora carguemos las preguntas de los usuarios y luego creemos un mensaje combinando la pregunta y los documentos similares. Este mensaje se proporciona al LLM para generar una respuesta a la pregunta del usuario.

- Carguemos un archivo csv con preguntas de los usuarios. Elegir Datos de importacion y seleccionar Tabular de la lista desplegable.

- Fuente de datos, y seleccionar Amazon S3 de la lista desplegable. Alternativamente, puede optar por cargar un archivo con consultas de los usuarios.

- Agreguemos una transformación personalizada para convertir los datos en incrustaciones vectoriales, seguida de una búsqueda de incrustaciones relacionadas desde Amazon OpenSearch, antes de enviar un mensaje a Amazon Bedrock con la consulta y el contexto de la base de conocimientos. Para generar incrustaciones para la consulta, puede utilizar el mismo fragmento de código de ejemplo. Generar incrustación de texto con Bedrock mencionado en el Paso #7 arriba.

Invoquemos la API de Amazon OpenSearch para buscar documentos relevantes para las incrustaciones de vectores generadas. Agregue una transformación personalizada con Python (PySpark).

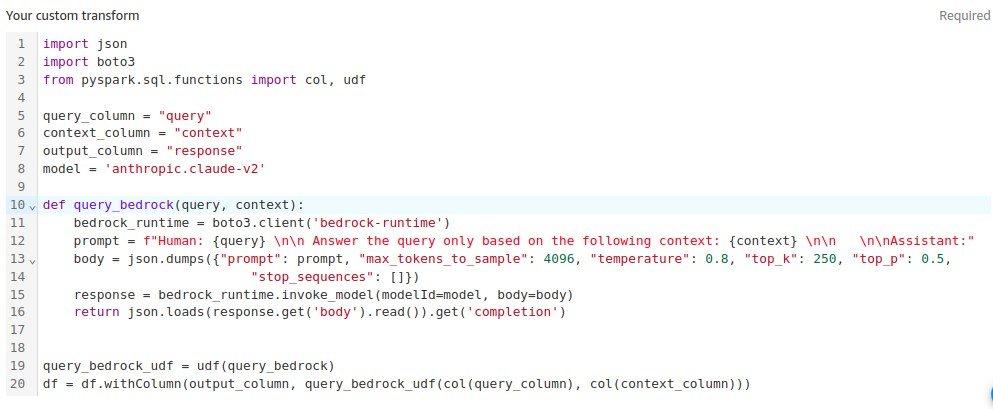

Agreguemos una transformación personalizada para llamar a la API de Amazon Bedrock para responder a la consulta, pasando los documentos de la base de conocimientos de Amazon OpenSearch. Desde los fragmentos de código de ejemplo, busque y seleccione Consulta Bedrock con contexto. Realice los cambios necesarios en el fragmento de código y seleccione Agregar.

En resumen, el flujo de datos de respuesta a preguntas basado en RAG es el siguiente:

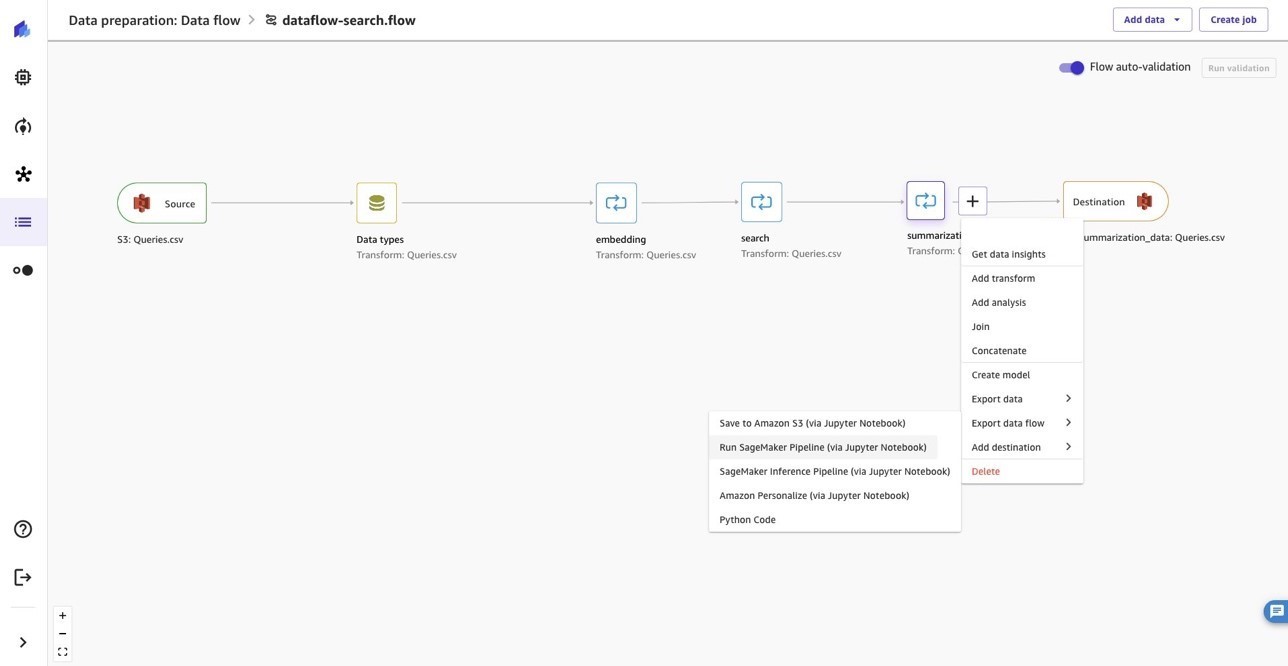

Los profesionales del aprendizaje automático dedican mucho tiempo a elaborar código de ingeniería de características, aplicándolo a sus conjuntos de datos iniciales, entrenando modelos en los conjuntos de datos diseñados y evaluando la precisión del modelo. Dada la naturaleza experimental de este trabajo, incluso el proyecto más pequeño da lugar a múltiples iteraciones. El mismo código de ingeniería de características a menudo se ejecuta una y otra vez, lo que desperdicia tiempo y recursos informáticos al repetir las mismas operaciones. En organizaciones grandes, esto puede causar una pérdida de productividad aún mayor porque diferentes equipos a menudo ejecutan trabajos idénticos o incluso escriben código de ingeniería de funciones duplicado porque no tienen conocimiento del trabajo anterior. Para evitar el reprocesamiento de funciones, exportaremos nuestro flujo de datos a Amazon Canalización de SageMaker. Vamos a seleccionar el Botón + a la derecha de la consulta. Seleccione exportar flujo de datos y elija Ejecutar canalización de SageMaker (a través del cuaderno Jupyter).

Limpiar

Para evitar incurrir en cargos futuros, elimine o cierre los recursos que creó mientras seguía esta publicación. Referirse a Cerrar sesión en Amazon SageMaker Canvas para más información.

Conclusión

En esta publicación, le mostramos cómo funcionan las capacidades de un extremo a otro de Amazon SageMaker Canvas al asumir el rol de un profesional de datos que prepara datos para un LLM. La preparación interactiva de datos permitió limpiar, transformar y analizar rápidamente los datos para diseñar características informativas. Al eliminar las complejidades de la codificación, SageMaker Canvas permitió una iteración rápida para crear un conjunto de datos de entrenamiento de alta calidad. Este flujo de trabajo acelerado condujo directamente a la creación, capacitación e implementación de un modelo de aprendizaje automático de alto rendimiento para lograr un impacto empresarial. Con su preparación integral de datos y su experiencia unificada desde datos hasta conocimientos, SageMaker Canvas permite a los usuarios mejorar sus resultados de aprendizaje automático.

Le animamos a aprender más explorando Wrangler de datos de Amazon SageMaker, Lienzo de Amazon SageMaker, Titán Amazonas modelos, lecho rocoso del amazonasy Amazon Servicio de búsqueda abierta para crear una solución utilizando la implementación de muestra proporcionada en esta publicación y un conjunto de datos relevante para su negocio. Si tiene preguntas o sugerencias, deje un comentario.

Acerca de los autores

Ajjay Govindaram es arquitecto sénior de soluciones en AWS. Trabaja con clientes estratégicos que usan AI/ML para resolver problemas comerciales complejos. Su experiencia radica en brindar dirección técnica y asistencia en el diseño para implementaciones de aplicaciones de IA/ML de modestas a grandes escalas. Su conocimiento abarca desde arquitectura de aplicaciones hasta big data, análisis y aprendizaje automático. Le gusta escuchar música mientras descansa, experimentar el aire libre y pasar tiempo con sus seres queridos.

Ajjay Govindaram es arquitecto sénior de soluciones en AWS. Trabaja con clientes estratégicos que usan AI/ML para resolver problemas comerciales complejos. Su experiencia radica en brindar dirección técnica y asistencia en el diseño para implementaciones de aplicaciones de IA/ML de modestas a grandes escalas. Su conocimiento abarca desde arquitectura de aplicaciones hasta big data, análisis y aprendizaje automático. Le gusta escuchar música mientras descansa, experimentar el aire libre y pasar tiempo con sus seres queridos.

Nikita Ivkina es un científico aplicado sénior en Amazon SageMaker Data Wrangler con intereses en el aprendizaje automático y los algoritmos de limpieza de datos.

Nikita Ivkina es un científico aplicado sénior en Amazon SageMaker Data Wrangler con intereses en el aprendizaje automático y los algoritmos de limpieza de datos.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/simplify-data-prep-for-gen-ai-with-amazon-sagemaker-data-wrangler/

- :posee

- :es

- :no

- 100

- 14

- 20

- 25

- 28

- 50

- 7

- 8

- 804

- a

- Poder

- Nuestra Empresa

- arriba

- acelerar

- acelerado

- de la máquina

- Conforme

- Cuentas

- la exactitud

- add

- Adicionales

- Adopción

- avances

- Ventaja

- ventajas

- Después

- de nuevo

- agregar

- adelante

- AI

- AI / ML

- algoritmos

- Alinea

- Todos

- permitido

- también

- Amazon

- Amazon SageMaker

- Wrangler de datos de Amazon SageMaker

- Amazon Web Services

- cantidades

- an

- Analiza

- Analytics

- el análisis de

- y

- https://www.youtube.com/watch?v=xB-eutXNUMXJtA&feature=youtu.be

- cualquier

- abejas

- Aplicación

- aplicada

- La aplicación de

- arquitectura

- somos

- artificial

- inteligencia artificial

- AS

- Ayuda

- At

- adjuntar

- audio

- aumentado

- Hoy Disponibles

- evitar

- AWS

- bases

- basado

- BE

- porque

- se convierte en

- esto

- antes

- "Ser"

- mejores

- parcial

- Big

- Big Data

- build

- Construir la

- incorporado

- negocios

- .

- by

- llamar al

- PUEDEN

- lienzo

- capacidades

- case

- Causa

- Cambios

- cargos

- Elige

- limpia

- Limpieza

- código

- Codificación

- combinar

- comentario

- Empresas

- en comparación con

- competitivos

- completar

- integraciones

- complejidades

- comprender

- exhaustivo

- Calcular

- Considerar

- Consola

- que no contengo

- contiene

- contenido

- contenido

- contexto

- contextos

- continúa

- control

- convertir

- Correspondiente

- podría

- Protectora

- Para crear

- creado

- crítico

- personalizado

- cliente

- Servicio al Cliente

- Clientes

- datos

- Preparación de datos

- Base de datos

- conjuntos de datos

- Deloitte

- demostrado

- Desplegando

- Despliegues

- Diseño

- detalles

- el desarrollo

- una experiencia diferente

- difícil

- Dimensiones

- dirección

- directamente

- descrubrir

- do

- documento

- documentación

- documentos

- dominio

- dominios

- DE INSCRIPCIÓN

- durante

- e

- cada una

- pasan fácilmente

- de manera eficaz

- eficiente

- eficiente.

- correo

- incrustación

- empodera

- facilita

- permitiendo

- fomentar

- de extremo a extremo

- ingeniero

- ingeniería

- Ingeniería

- evaluación

- Incluso

- ejemplo

- existe

- experience

- experimentando

- experimental

- explorar

- Explorar

- exportar

- extraerlos

- Feature

- Caracteristicas

- pocos

- Terrenos

- Archive

- filtrar

- final

- Encuentre

- de tus señales

- seguido

- siguiendo

- siguiente

- Forbes

- Fundación

- Fundamentos

- Gratuito

- Desde

- ser completados

- funciones

- promover

- futuras

- Obtén

- generar

- generado

- la generación de

- generación de AHSS

- generativo

- IA generativa

- obtener

- Donar

- dado

- Buscar

- Go

- objetivo

- candidato

- mayor

- Tienen

- he

- cabeceras

- alta calidad

- su

- mantiene

- Inicio

- Cómo

- Como Hacer

- Sin embargo

- HTML

- HTTPS

- i

- idéntico

- if

- imágenes

- Impacto

- implementación

- importar

- importante

- impresionante

- mejorar

- in

- incluye

- índice

- indexado

- información

- informativo

- inicial

- Insights

- Instrucciones

- integración

- Intelligence

- interactivo

- intereses

- Interfaz

- Internet

- dentro

- involucrar

- IT

- iteración

- iteraciones

- SUS

- Empleo

- jpg

- json

- especialistas

- CARGA TERRESTRE

- idioma

- large

- Gran escala

- lanzamiento

- Prospectos

- APRENDE:

- aprendizaje

- Abandonar

- LED

- aprovechando

- se encuentra

- como

- Lista

- Escucha Activa

- LLM

- carga

- Ubicación

- Ubicaciones

- de

- Lote

- ser querido

- Baja

- máquina

- máquina de aprendizaje

- Inicio

- para lograr

- HACE

- máscara

- masivo

- dominar

- Puede..

- los mecanismos de

- Medios

- Menú

- Meta

- metadatos

- ML

- modelo

- modelos

- modesto

- más,

- MEJOR DE TU

- múltiples

- Música

- nombre

- Natural

- Procesamiento natural del lenguaje

- Naturaleza

- Navegación

- necesario

- ¿ Necesita ayuda

- Nuevo

- Next

- no

- cuaderno

- ahora

- of

- a menudo

- on

- una vez

- las

- , solamente

- Operaciones

- Optión

- or

- organización

- para las fiestas.

- Otro

- nuestros

- salir

- resultados

- al exterior

- salida

- Más de

- página

- Los pandas

- cristal

- Pasando (Paso)

- Contraseña

- (PDF)

- actuación

- con

- recoger

- pieza

- piezas

- industrial

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- Por favor

- más

- punto

- políticas

- Publicación

- posible

- alimentado

- preferido

- preparación

- Preparar

- preparación

- Anterior

- probablemente

- Problema

- problemas

- proceder

- tratamiento

- Producción

- productividad

- Profesional

- proyecto

- propiedades

- previsto

- proporciona un

- proporcionando

- Python

- consultas

- pregunta

- Preguntas

- con rapidez

- rangos

- rápido

- Calificaciones

- en comunicarse

- Leer

- mundo real

- recibido

- remitir

- relacionado

- la eliminación de

- reportado

- solicitudes

- exigir

- requiere

- Recursos

- respuesta

- respuestas

- descansando

- Resultados

- volvemos

- Reseñas

- Derecho

- Función

- Ejecutar

- sabio

- mismo

- Guardar

- Científico

- Buscar

- búsqueda

- Sección

- visto

- selecciona

- enviando

- mayor

- sensible

- de coches

- Servicios

- ajustes

- tienes

- Mostrar

- mostró

- cerrar

- cerrar

- lado

- firmar

- importante

- similares

- sencillez

- simplificar

- Tamaño

- retazo

- So

- Social

- redes sociales

- a medida

- Soluciones

- RESOLVER

- algo

- Fuente

- Fuentes

- soluciones y

- específicamente

- pasar

- Gastos

- Etapa

- etapas

- paso

- pasos

- Sin embargo

- Estratégico

- estructurado

- RESUMEN

- soportes

- Peritaje

- ¡Prepárate!

- equipos

- Técnico

- técnicas

- test

- texto

- esa

- La

- El futuro de las

- su

- Les

- luego

- Ahí.

- Estas

- ellos

- así

- Así

- equipo

- titán

- a

- hoy

- Formación

- Transformar

- transformaciones

- transformadora

- verdadero

- truncamiento

- tipo

- tipos

- unificado

- us

- utilizan el

- usado

- Usuario

- usuarios

- usando

- Valioso

- vía

- Video

- visual

- tutorial

- we

- web

- servicios web

- WELL

- que

- mientras

- QUIENES

- seguirá

- Actividades:

- flujo de trabajo

- funciona

- se

- escribir

- Usted

- tú

- zephyrnet