El presidente del Tribunal Supremo de Estados Unidos, John Roberts, cree que la inteligencia artificial desempeñará un papel cada vez más importante en el proceso legal, pero espera que "los jueces humanos existan por un tiempo".

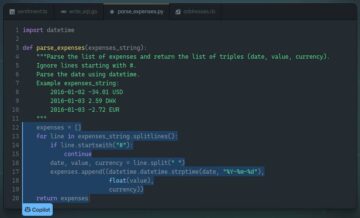

Roberts hizo esa observación en su Informe de fin de año 2023 sobre el poder judicial federal [(PDF)], que no había tocado el tema anteriormente.

"La IA obviamente tiene un gran potencial para aumentar drásticamente el acceso a información clave tanto para abogados como para no abogados", escribió Roberts. "Pero igualmente obviamente corre el riesgo de invadir los intereses de privacidad y deshumanizar la ley".

Roberts citó el valor potencial de los sistemas de inteligencia artificial para ayudar a las personas que no pueden permitirse una representación legal al permitirles preparar presentaciones judiciales por su cuenta. Al mismo tiempo, advirtió que los modelos de IA han hecho titulares por su tendencia a alucinar, “lo que provocó que los abogados que utilizaban la aplicación presentaran escritos con citaciones de casos inexistentes. (Siempre es una mala idea)”.

Como para subrayar esa preocupación, documentos revelados la semana pasada revelaron que Michael Cohen, el abogado que anteriormente manejó los asuntos legales del presidente Donald Trump, le había dado a su propio abogado citaciones legales falsas de Google Bardo. Lo hizo en apoyo de una moción que buscaba poner fin anticipadamente a su supervisión ordenada por el tribunal, luego de admitir violaciones en el financiamiento de campañas de 2018.

Roberts también argumentó que actualmente las máquinas no pueden igualar la capacidad de un juez humano para evaluar la sinceridad del discurso de un acusado. “Los matices importan: muchas cosas pueden cambiar con una mano temblorosa, una voz temblorosa, un cambio de inflexión, una gota de sudor, un momento de vacilación, una ruptura fugaz en el contacto visual”, escribió.

Y continuó observando que, en los casos penales en los que se utiliza la IA para evaluar el riesgo de fuga, la reincidencia u otras decisiones predictivas, existe una controversia constante sobre el debido proceso, la confiabilidad y los sesgos que dichos sistemas pueden contener.

"Al menos en la actualidad, los estudios muestran una percepción pública persistente de una 'brecha de equidad entre humanos e IA', lo que refleja la opinión de que las decisiones humanas, a pesar de todos sus defectos, son más justas que cualquier cosa que la máquina escupe", escribió Roberts.

Esa percepción fue cuestionada en un artículo de septiembre por los académicos de Harvard Victoria Angelova, Will Dobbie y Crystal Yang a través de la Oficina Nacional de Investigación Económica. El , “Recomendaciones algorítmicas y discreción humana”, descubre que cuando los jueces humanos anulan las decisiones algorítmicas sobre si liberar o detener a un acusado bajo fianza, el 90 por ciento de los humanos tienen un rendimiento inferior al algoritmo a la hora de detectar posibles reincidentes.

"Este hallazgo indica que el juez típico en nuestro entorno es menos hábil para predecir malas conductas que el algoritmo y que podríamos reducir sustancialmente las tasas de malas conductas automatizando las decisiones de liberación", afirman los autores en su artículo.

Al mismo tiempo, el 10 por ciento de los jueces logran superar al algoritmo al anular sus recomendaciones y anticipan mejor la mala conducta de los acusados. El factor común entre estos “jueces altamente capacitados” es que es menos probable que hayan trabajado anteriormente en el cumplimiento de la ley y son mejores en el uso de información privada que no está disponible para el algoritmo.

El documento dice que los jueces poco calificados prestan más atención a factores demográficos como la raza, mientras que los jueces altamente calificados se centran más en cuestiones no demográficas como la salud mental, el abuso de sustancias y los recursos financieros.

Sin duda, los jueces humanos seguirán existiendo por un tiempo, opina Roberts. Y para la mayoría de bajo rendimiento, puede ser que la IA pueda ayudarles a mejorar, al menos en el contexto de la toma de decisiones previa al juicio. ®

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://go.theregister.com/feed/www.theregister.com/2024/01/02/supreme_court_ai_roberts/

- :posee

- :es

- :no

- :dónde

- 10

- 2018

- 2023

- 7

- a

- capacidad

- Nuestra Empresa

- abuso

- académica

- de la máquina

- Negocios

- AI

- Modelos AI

- Sistemas de IA

- Alimentado por IA

- algoritmo

- algorítmico

- igual

- Todos

- Permitir

- también

- hacerlo

- entre

- an

- y

- anticipando

- Aplicación

- somos

- argumentó

- en torno a

- artificial

- inteligencia artificial

- AS

- evaluar

- At

- abogado

- Autorzy

- automatizar

- Hoy Disponibles

- Malo

- fianza

- BE

- cree

- mejores

- los prejuicios

- Descanso

- oficina

- pero

- by

- Campaña

- PUEDEN

- no puede

- cases

- causado

- Desafiado

- el cambio

- jefe

- citado

- CO

- Cohen

- Algunos

- Protocolo de Tratamiento

- contacte

- que no contengo

- contexto

- controversia

- podría

- CORTE

- Presentaciones judiciales

- Abogados de

- Cristal

- En la actualidad

- Toma de Decisiones

- decisiones

- disminuir

- acusados

- capas demográficas

- HIZO

- discreción

- documentos

- Donald

- Donald Trump

- duda

- dramáticamente

- dos

- Temprano en la

- Economic

- final

- cumplimiento

- espera

- ojos

- factor

- factores importantes

- más justo

- justicia

- Federal

- limaduras

- financiar

- financiero

- la búsqueda de

- encuentra

- defectos

- vuelo

- Focus

- siguiendo

- Desde

- brecha

- dado

- maravillosa

- tenido

- mano

- harvard

- Tienen

- he

- Salud

- ayuda

- su

- HTTPS

- humana

- Humanos

- idea

- if

- importante

- in

- aumente

- cada vez más

- Indica

- Inflexión

- información

- Intelligence

- intereses

- cuestiones

- IT

- SUS

- Juan

- jpg

- juez

- los jueces

- solo

- Justice

- Clave

- Apellido

- de derecho criminal

- aplicación de la ley

- abogado

- empresas

- menos

- Legal

- menos

- como

- que otros

- máquina

- Máquinas

- hecho

- Mayoría

- para lograr

- gestionan

- Match

- Cuestiones

- Puede..

- mental

- Salud mental

- Michael

- modelos

- más,

- movimiento

- mucho más

- Nacional

- no

- Nuance

- observación

- observar

- of

- on

- en marcha

- or

- Otro

- nuestros

- salir

- Superar

- anular

- anulación

- EL DESARROLLADOR

- Papel

- Pagar

- (PDF)

- Personas

- por ciento

- percepción

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- Jugar

- posible

- predecir

- Preparar

- presente

- presidente

- Presidente de los Estados Unidos, Donald Trump

- previamente

- política de privacidad

- privada

- información privada

- público

- Carrera

- Tarifas

- RE

- recomendaciones

- reflejando

- ,

- fiabilidad

- reporte

- Informes

- representación

- la investigación

- Recursos

- Revelado

- Riesgo

- riesgos

- Función

- s

- mismo

- dice

- la búsqueda de

- Septiembre

- pólipo

- Mostrar

- experto

- So

- habla

- punteo

- Estado

- estudios

- enviar

- sustancia

- sustancialmente

- tal

- supervisión

- SOPORTE

- supremo

- Corte Suprema de Justicia

- SUDOR

- Todas las funciones a su disposición

- que

- esa

- El

- la Ley

- su

- Les

- Ahí.

- Estas

- ellos

- así

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- equipo

- a

- tema

- tocado

- triunfo

- GIRO

- principiante

- usado

- usando

- propuesta de

- Victoria

- Ver

- Violaciónes

- Voz

- fue

- we

- semana

- fuimos

- lo que

- cuando

- sean

- que

- mientras

- QUIENES

- seguirá

- trabajado

- escribí

- zephyrnet