Introducción

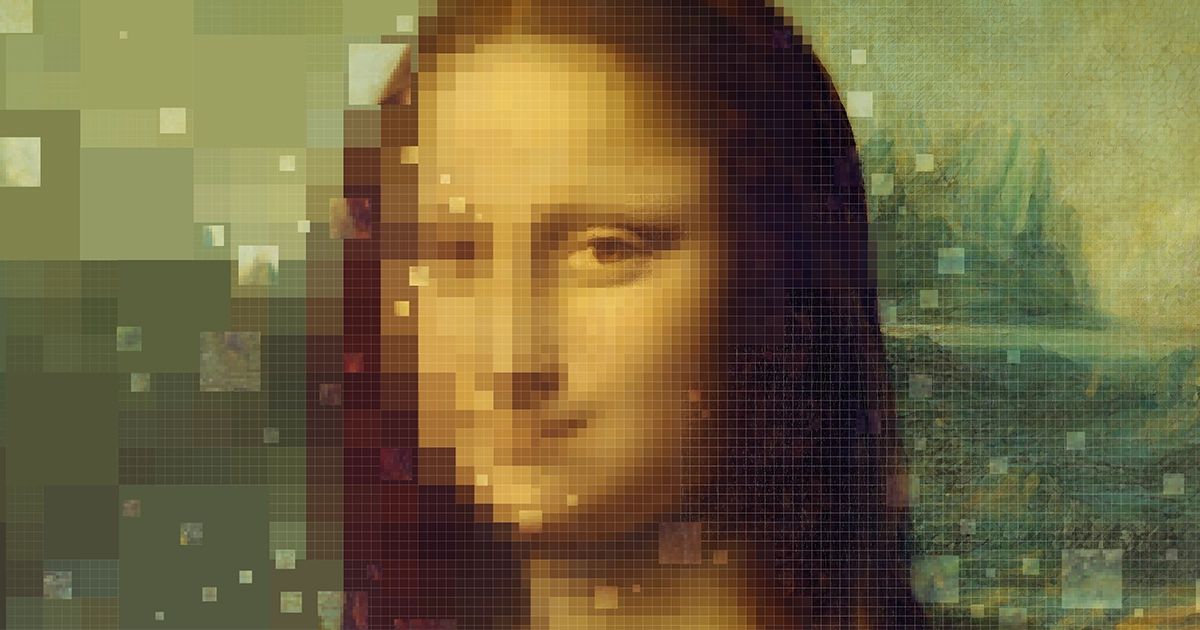

Es uno de los mayores clichés en el crimen y la ciencia ficción: un investigador muestra una fotografía borrosa en la pantalla de una computadora y pide que la mejoren, y boom, la imagen se enfoca, revelando alguna pista esencial. Es una maravillosa comodidad para contar historias, pero ha sido una ficción frustrante durante décadas: si amplías demasiado una imagen, se vuelve visiblemente pixelada. No hay datos suficientes para hacer más.

“Si simplemente amplías ingenuamente una imagen, quedará borrosa. Habrá muchos detalles, pero estará mal”, dijo Bryan Catanzaro, vicepresidente de investigación de aprendizaje profundo aplicado en Nvidia.

Recientemente, investigadores y profesionales han comenzado a incorporar algoritmos de inteligencia artificial en sus herramientas de mejora de imágenes, lo que hace que el proceso sea más fácil y potente, pero todavía existen límites en la cantidad de datos que se pueden recuperar de cualquier imagen. Afortunadamente, a medida que los investigadores impulsan los algoritmos de mejora cada vez más, encuentran nuevas formas de hacer frente a esos límites e incluso, en ocasiones, encuentran formas de superarlos.

En la última década, los investigadores comenzaron a mejorar las imágenes con un nuevo tipo de modelo de IA llamado red generativa adversaria, o GAN, que podía producir imágenes detalladas y de aspecto impresionante. "Las imágenes de repente empezaron a verse mucho mejor", dijo Tomer Michaeli, ingeniero eléctrico del Technion en Israel. Pero le sorprendió que las imágenes creadas por GAN mostraran altos niveles de distorsión, que mide qué tan cerca está una imagen mejorada de la realidad subyacente de lo que muestra. Las GAN produjeron imágenes que parecían bonitas y naturales, pero en realidad estaban inventando o “alucinando” detalles que no eran precisos, lo que se registraba como altos niveles de distorsión.

Michaeli observó cómo el campo de la restauración fotográfica se dividía en dos subcomunidades distintas. “Uno mostraba bonitas fotografías, muchas de ellas realizadas por GAN. Los otros mostraban datos, pero no mostraban muchas imágenes, porque no se veían bien”, dijo.

En 2017, Michaeli y su estudiante de posgrado Yochai Blau analizaron esta dicotomía de manera más formal. Trazaron el rendimiento de varios algoritmos de mejora de imágenes en un gráfico de distorsión versus calidad perceptiva, utilizando una medida conocida de calidad perceptiva que se correlaciona bien con el juicio subjetivo de los humanos. Como esperaba Michaeli, algunos de los algoritmos dieron como resultado una calidad visual muy alta, mientras que otros fueron muy precisos y con baja distorsión. Pero ninguno tenía ambas ventajas; había que elegir uno u otro. Los investigadores denominaron esto el equilibrio entre percepción y distorsión.

Michaeli también desafió a otros investigadores idear algoritmos que puedan producir la mejor calidad de imagen para un nivel dado de distorsión, para permitir comparaciones justas entre los algoritmos de imágenes bonitas y los de estadísticas agradables. Desde entonces, cientos de investigadores de IA han informado sobre las cualidades de distorsión y percepción de sus algoritmos. citando el artículo de Michaeli y Blau que describía la compensación.

A veces, las implicaciones del equilibrio entre percepción y distorsión no son graves. Nvidia, por ejemplo, descubrió que las pantallas de alta definición no reproducían bien algunos contenidos visuales de baja definición, por lo que en febrero lanzó una herramienta que utiliza el aprendizaje profundo para mejorar la transmisión de video. En este caso, los ingenieros de Nvidia eligieron la calidad de percepción sobre la precisión, aceptando el hecho de que cuando el algoritmo mejora el video, creará algunos detalles visuales que no están en el video original. “La modelo está alucinando. Todo es una suposición”, dijo Catanzaro. "La mayoría de las veces está bien que un modelo de súper resolución adivine mal, siempre y cuando sea consistente".

Introducción

Por supuesto, las aplicaciones en investigación y medicina exigen mucha más precisión. La tecnología de inteligencia artificial ha dado lugar a importantes avances en la obtención de imágenes, pero "a veces conlleva efectos secundarios no deseados, como sobreadaptar o [agregar] características falsas, y por lo tanto debe tratarse con extremo cuidado", dijo Junjie Yao, ingeniero biomédico de la Universidad de Duke. El año pasado coescribió un que describe cómo las herramientas de inteligencia artificial pueden mejorar los métodos existentes para medir el flujo sanguíneo y el metabolismo en el cerebro, mientras se mantienen seguros en el lado exacto del equilibrio entre percepción y distorsión.

Una forma de eludir los límites sobre la cantidad de datos que se pueden extraer de una imagen es simplemente incorporar datos de más imágenes, aunque eso a menudo no es tan simple. Los investigadores que estudian el medio ambiente a través de imágenes de satélite han avanzado en la combinación de diferentes fuentes de datos visuales. En 2021, un grupo de investigadores de China y el Reino Unido datos fusionados desde dos tipos diferentes de satélites para obtener una mejor visión de la deforestación en la cuenca del Congo, la segunda selva tropical más grande del mundo y una de las mayores reservas de biodiversidad. Los investigadores tomaron datos de dos satélites Landsat, que han medido la deforestación durante décadas, y utilizaron técnicas de aprendizaje profundo para refinar la resolución de las imágenes de 30 a 10 metros. Luego fusionaron ese conjunto de imágenes con datos de dos satélites Sentinel-2, que tienen una matriz de detectores ligeramente diferente. Las imágenes combinadas "permitieron detectar entre un 11% y un 21% más de áreas perturbadas de lo que era posible utilizando solo las imágenes Sentinel-2 o Landsat-7/8", escribieron.

Michaeli sugiere otra forma de eludir, si no superar, los límites estrictos a la accesibilidad de la información. En lugar de conformarse con una respuesta firme sobre cómo mejorar una imagen de baja calidad, los modelos podrían mostrar múltiples interpretaciones diferentes de la imagen original. En un artículo titulado “Súper resolución explorable”, ayudó a demostrar cómo las herramientas de mejora de imágenes pueden presentar al usuario múltiples sugerencias. Una imagen borrosa y de baja resolución de una persona que lleva lo que parece ser una camisa grisácea podría reconstruirse en una imagen de mayor resolución en la que la camisa tenga rayas verticales, rayas horizontales o cuadros en blanco y negro, todas las cuales son igualmente plausibles. .

En otro ejemplo, Michaeli tomó una fotografía de baja calidad de una matrícula y la pasó por un mejorador de imágenes de IA líder, que mostró que un 1 en la matrícula se parecía más a un cero. Pero cuando la imagen fue procesada por un algoritmo diferente y más abierto que diseñó Michaeli, el dígito parecía igualmente probable que fuera un cero, un 1 o un 8. Este enfoque podría ayudar a descartar otros números sin concluir erróneamente que el dígito era cero.

Mientras las diferentes disciplinas lidian con el equilibrio entre percepción y distorsión a su manera, la cuestión de cuánto podemos extraer de las imágenes de IA y cuánto podemos confiar en esas imágenes sigue siendo central. "Debemos tener en cuenta que para generar estas bonitas imágenes, los algoritmos simplemente crean detalles", dijo Michaeli. Podemos mitigar esas alucinaciones, pero el todopoderoso botón de “mejora” para resolver crímenes seguirá siendo un sueño.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Automoción / vehículos eléctricos, Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- ChartPrime. Eleve su juego comercial con ChartPrime. Accede Aquí.

- Desplazamientos de bloque. Modernización de la propiedad de compensaciones ambientales. Accede Aquí.

- Fuente: https://www.quantamagazine.org/the-ai-tools-making-images-look-better-20230823/

- :posee

- :es

- :no

- ][pag

- $ UP

- 1

- 10

- 2017

- 2021

- 30

- 8

- a

- AC

- aceptar

- accesibilidad

- la exactitud

- preciso

- la adición de

- avances

- ventajas

- adversario

- AI

- algoritmo

- algoritmos

- Todos

- permitir

- solo

- también

- an

- y

- Otra

- https://www.youtube.com/watch?v=xB-eutXNUMXJtA&feature=youtu.be

- cualquier

- aparece

- aplicada

- enfoque

- somos

- áreas

- en torno a

- Formación

- artificial

- inteligencia artificial

- AS

- At

- BE

- porque

- se convierte en

- esto

- comenzado

- MEJOR

- mejores

- entre

- Mayor

- biomédica

- Negro

- sangre

- volar

- auge

- ambas

- Cerebro

- pero

- .

- by

- , que son

- PUEDEN

- servicios sociales

- case

- central

- Cheques

- China

- eligió

- Cerrar

- combinado

- combinar

- cómo

- proviene

- computadora

- pantalla de la computadora

- Congo

- consistente

- contenido

- comodidad

- podría

- Curso

- Delito

- datos

- década

- décadas

- profundo

- deep learning

- deforestación

- Demanda

- demostrar

- descrito

- diseñado

- detalle

- detallado

- detalles

- detectado

- una experiencia diferente

- terrible

- disciplinas

- distinto

- do

- sueño

- doblado

- Duque

- duke university

- más fácil

- los efectos

- ingeniero

- certificados

- mejorar

- mejorado

- mejorar

- suficientes

- Entorno

- igualmente

- esencial

- Incluso

- NUNCA

- ejemplo

- existente

- esperado

- extraerlos

- extremo

- hecho

- feria

- falso

- muchos

- Caracteristicas

- Febrero

- Ficción

- campo

- la búsqueda de

- en fin

- Firme

- de tus señales

- Focus

- Formalmente

- encontrado

- Desde

- frustrante

- promover

- generativo

- obtener

- dado

- va

- graduados

- gráfica

- Grupo procesos

- tenido

- Difícil

- Tienen

- he

- ayuda

- ayudado

- Alta

- alta definición

- su

- Horizontal

- Cómo

- Como Hacer

- HTTPS

- Cientos

- IEEE

- if

- imagen

- imágenes

- Proyección de imagen

- implicaciones

- mejorar

- in

- incorporar

- incorporando

- información

- ejemplo

- Intelligence

- dentro

- Israel

- IT

- solo

- Guardar

- Tipo

- conocido

- Apellidos

- El año pasado

- líder

- aprendizaje

- LED

- Nivel

- Licencia

- como

- que otros

- límites

- Largo

- Mira

- miró

- mirando

- Lote

- Baja

- hecho

- revista

- gran

- para lograr

- Realizar

- muchos

- medir

- medidas

- medición

- medicina

- Metabolismo

- métodos

- mente

- Mitigar las

- modelo

- modelos

- más,

- MEJOR DE TU

- mucho más

- múltiples

- Natural

- Naturaleza

- red

- del sistema,

- Nuevo

- agradable

- Ninguna

- Nvidia

- of

- a menudo

- on

- ONE

- las

- or

- reconocida por

- Otro

- Otros

- salir

- salida

- Más de

- Superar

- EL DESARROLLADOR

- Papel

- pasado

- percepción

- actuación

- persona

- recoger

- Fotos

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- plausible

- posible

- poderoso

- presente

- presidente

- bastante

- Procesado

- producir

- producido

- profesionales

- Progreso

- Tira

- Push

- cualidades

- calidad

- pregunta

- Realidad

- FILTRO

- registrado

- liberado

- permanecer

- permanece

- representación

- reportado

- la investigación

- investigadores

- Resolución

- restauración

- revelando

- Regla

- de manera segura

- Said

- satélite

- satélites

- Ciencia:

- Ciencia ficción

- Pantalla

- mallas

- El segundo mas largo

- set

- asentamiento

- tienes

- Mostrar

- mostró

- Shows

- lado

- sencillos

- simplemente

- desde

- ligeramente diferente

- So

- algo

- Fuentes

- dividido

- fundó

- Sin embargo

- tiendas

- la narración

- en streaming

- Rayas

- Estudiante

- ESTUDIO

- tal

- Sugiere

- súper

- sorprendido

- técnicas

- Tecnología

- que

- esa

- La

- el mundo

- su

- Les

- luego

- Ahí.

- Estas

- ellos

- así

- aquellos

- ¿aunque?

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- Así

- equipo

- veces

- titulada

- a

- demasiado

- se

- del IRS

- Confía en

- dos

- tipos

- Reino Unido

- subyacente

- universidad

- no deseado

- usado

- Usuario

- usos

- usando

- diversos

- Versus

- vertical

- muy

- vicio

- Vice Presidenta

- Video

- Ver

- fue

- Vistas

- Camino..

- formas

- we

- webp

- WELL

- tuvieron

- ¿

- cuando

- que

- mientras

- complejo de salvador blanco

- QUIENES

- seguirá

- sin

- maravilloso

- mundo

- Mal

- escribí

- año

- Usted

- zephyrnet

- cero