- Võib 12 2014

- Vasilis Vryniotis

- . 4 kommentaari

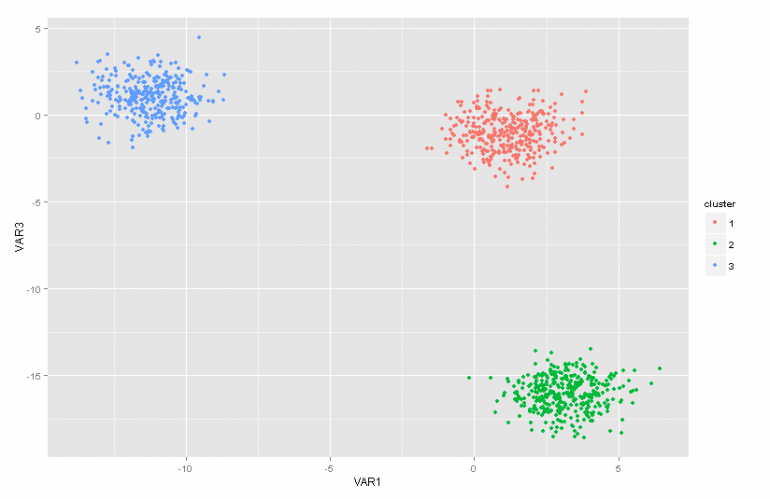

See ajaveebi postitus on Dirichlet Processi segumudeleid käsitleva artiklisarja teine osa. Eelmises artiklis oli meil ülevaade mitmetest klastrianalüüsi tehnikatest ja arutasime mõningaid probleeme/piiranguid, mis nende kasutamisel esile kerkivad. Lisaks tutvustasime lühidalt Dirichleti protsessisegude mudeleid, rääkisime nende kasulikkusest ja tutvustasime mõningaid nende rakendusi.

Värskendus: Datumboxi masinõppe raamistik on nüüd avatud lähtekoodiga ja tasuta lae alla. Tutvuge paketiga com.datumbox.framework.machinelearning.clustering, et näha Dirichleti protsessisegude mudelite rakendamist Javas.

Dirichleti protsessisegude mudeleid võib alguses olla raske alla neelata peamiselt seetõttu, et need on lõpmatud segumudelid, millel on palju erinevaid esitusi. Õnneks on hea viis teemale lähenemiseks alustada Dirichleti jaotusega lõplike segude mudelitest ja seejärel liikuda lõpmatute mudeliteni.

Sellest tulenevalt tutvustan selles artiklis lühidalt mõningaid olulisi jaotusi, mida vajame, me kasutame neid Dirichlet Priori koos mitmenomilise tõenäosusega mudeli konstrueerimiseks ja seejärel liigume Dirichleti jaotusel põhineva lõpliku segu mudeli juurde.

1. Beetaversiooni levitamine

. Beeta levitamine on pidevate jaotuste perekond, mis on määratletud vahemikus [0,1]. Selle parameetriks on kaks positiivset parameetrit a ja b ning selle vorm sõltub suuresti nende kahe parameetri valikust.

Joonis 1: Beeta jaotus erinevate a, b parameetrite jaoks

Beetajaotust kasutatakse tavaliselt tõenäosuste jaotuse modelleerimiseks ja sellel on järgmine tõenäosustihedus:

![]()

1. võrrand: beeta-PDF

Kus Γ(x) on gammafunktsioon ja a, b jaotuse parameetrid. Beetat kasutatakse tavaliselt tõenäosusväärtuste jaotusena ja see annab meile tõenäosuse, et modelleeritud tõenäosus võrdub konkreetse väärtusega P = p0. Oma määratluse järgi on beetajaotus võimeline modelleerima binaarsete tulemuste tõenäosust, mille väärtused on tõesed või väärad. Parameetreid a ja b võib pidada vastavalt edu ja ebaõnnestumise pseudoarvudeks. Seega modelleerib beeta jaotus õnnestumise tõenäosust a õnnestumiste ja b ebaõnnestumiste korral.

2. Dirichleti jaotus

. Dirichleti levitamine on beeta jaotuse üldistus mitme tulemuse jaoks (või teisisõnu kasutatakse seda mitme tulemusega sündmuste puhul). See on parameetris k parameetriga ai mis peab olema positiivne. Dirichleti jaotus võrdub beeta jaotusega, kui muutujate arv k = 2.

Joonis 2: Dirichleti jaotus erinevate ai parameetrid

Dirichleti jaotust kasutatakse tavaliselt tõenäosuste jaotuse modelleerimiseks ja sellel on järgmine tõenäosustihedus:

![]()

Võrrand 2: Dirichlet PDF

Kui Γ(x) on gammafunktsioon, siis pi võta väärtused [0,1] ja Σpi=1. Dirichlet' jaotus modelleerib p ühisjaotusti ja annab tõenäosuse, et P1=p1,P2=p2,….,Pk-1=pk-1 koos P-gak=1 – ΣPi. Nagu Beeta puhul, on ka ai parameetreid võib pidada iga i sündmuse esinemiste pseudoarvudeks. Dirichleti jaotust kasutatakse k rivaalisündmuse esinemise tõenäosuse modelleerimiseks ja seda tähistatakse sageli kui Dirichlet(a).

3. Dirichlet Prior multinomiaalse tõenäosusega

Nagu varem mainitud, võib Dirichleti jaotust vaadelda kui tõenäosusjaotuste jaotust. Juhtudel, kui tahame modelleerida k sündmuse toimumise tõenäosust, tuleks kasutada Bayesi lähenemisviisi Multinomaalne tõenäosus ja Dirichlet Priors .

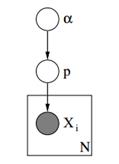

Allpool näeme sellise mudeli graafilist mudelit.

Joonis 3: Multinomiaalse tõenäosusega Dirichlet Priorite graafiline mudel

Ülaltoodud graafilises mudelis on α ak-mõõtmeline vektor Dirichlet priorsi hüperparameetritega, p on ak-mõõtmeline vektor tõenäosusväärtustega ja xi on skalaarväärtus vahemikus 1 kuni k, mis annab meile teada, milline sündmus on toimunud. Lõpuks peaksime tähele panema, et P järgib Dirichleti jaotust, mis on parameetritega konfigureeritud vektoriga α ja seega P ~ Dirichlet(α), samas kui xi muutujad järgivad diskreetset jaotust (Multinomial), mis on parameetritega p-tõenäosuste vektoriga. Sarnaseid hierarhilisi mudeleid saab kasutada dokumentide klassifitseerimisel, et esitada märksõnade sageduste jaotusi erinevatel teemadel.

4. Lõpliku segu mudel Dirichleti jaotusega

Dirichlet Distributioni abil saame konstrueerida a Lõpliku segu mudel mida saab kasutada klastrite moodustamiseks. Oletame, et meil on järgmine mudel:

![]()

![]()

![]()

![]()

Valem 3: Dirichleti jaotusega lõpliku segu mudel

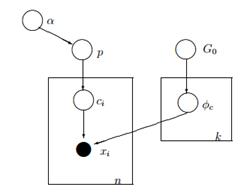

Ülaltoodud mudel eeldab järgmist: Meil on andmestik X, millel on n vaatlust ja me tahame sellel teha klastrianalüüsi. K on konstantne lõplik arv, mis näitab kasutatavate klastrite/komponentide arvu. Ci muutujad salvestavad vaatluse X klastri määramisei, võtavad nad väärtused 1 kuni k ja järgivad diskreetset jaotust parameetriga p, mis on komponentide segunemise tõenäosus. F on meie X generatiivne jaotus ja see on parameetritega parameetritega määratud ![]() mis sõltub iga vaatluse klastri määramisest. Kokku on meil k ainulaadset

mis sõltub iga vaatluse klastri määramisest. Kokku on meil k ainulaadset ![]() parameetrid, mis on võrdsed meie klastrite arvuga. The

parameetrid, mis on võrdsed meie klastrite arvuga. The ![]() muutuja salvestab parameetrid, mis parameetriseerivad generatiivset F-jaotust ja eeldame, et see järgib baasi G0 levitamine. Muutuja p salvestab segu protsendid iga k klastri jaoks ja järgib Dirichlet'i parameetritega α / k. Lõpuks on α ak-mõõtmeline vektor Dirichlet' jaotuse hüperparameetritega (pseudoarvudega) [2].

muutuja salvestab parameetrid, mis parameetriseerivad generatiivset F-jaotust ja eeldame, et see järgib baasi G0 levitamine. Muutuja p salvestab segu protsendid iga k klastri jaoks ja järgib Dirichlet'i parameetritega α / k. Lõpuks on α ak-mõõtmeline vektor Dirichlet' jaotuse hüperparameetritega (pseudoarvudega) [2].

Joonis 4: Lõpliku segu mudeli graafiline mudel Dirichleti jaotusega

Lihtsam ja vähem matemaatiline viis mudeli selgitamiseks on järgmine. Eeldame, et meie andmeid saab rühmitada k klastritesse. Igal klastril on oma parameetrid ![]() ja neid parameetreid kasutatakse meie andmete genereerimiseks. Parameetrid

ja neid parameetreid kasutatakse meie andmete genereerimiseks. Parameetrid ![]() eeldatakse, et nad järgivad mingit jaotust G0. Iga vaatlus on kujutatud vektoriga xi ja ci väärtus, mis näitab klastrit, kuhu see kuulub. Järelikult ci võib vaadelda kui muutujat, mis järgneb diskreetsele jaotusele parameetriga p, mis pole midagi muud kui segutõenäosused, st iga klastri esinemise tõenäosus. Arvestades, et käsitleme oma probleemi Bayesi viisil, ei käsitle me parameetrit p konstantse tundmatu vektorina. Selle asemel eeldame, et P järgneb Dirichletile, mida parameetrid on hüperparameetrid α / k.

eeldatakse, et nad järgivad mingit jaotust G0. Iga vaatlus on kujutatud vektoriga xi ja ci väärtus, mis näitab klastrit, kuhu see kuulub. Järelikult ci võib vaadelda kui muutujat, mis järgneb diskreetsele jaotusele parameetriga p, mis pole midagi muud kui segutõenäosused, st iga klastri esinemise tõenäosus. Arvestades, et käsitleme oma probleemi Bayesi viisil, ei käsitle me parameetrit p konstantse tundmatu vektorina. Selle asemel eeldame, et P järgneb Dirichletile, mida parameetrid on hüperparameetrid α / k.

5. Töötamine lõpmatu k-klastriga

Eelmine segumudel võimaldab meil läbi viia juhendamata õppimist, järgib Bayesi lähenemisviisi ja seda saab laiendada hierarhilise struktuuriga. Sellegipoolest on see piiratud mudel, kuna see kasutab konstantset eelnevalt määratletud k arvu klastreid. Seetõttu tuleb meil enne klastrianalüüsi läbiviimist määratleda komponentide arv ja nagu me varem arutasime enamiku rakenduste puhul, on see teadmata ja seda ei saa kergesti hinnata.

Üks viis selle lahendamiseks on ette kujutada, et k-l on väga suur väärtus, mis kaldub lõpmatuseni. Teisisõnu võime ette kujutada selle mudeli piiri, kui k kaldub lõpmatuseni. Kui see on nii, siis näeme, et vaatamata sellele, et klastrite arv k on lõpmatu, ei saa tegelik aktiivsete klastrite arv (need, millel on vähemalt üks vaatlus) olla suurem kui n (mis on vaatluste koguarv meie andmekogumis). Tegelikult nagu me hiljem näeme, on aktiivsete klastrite arv oluliselt väiksem kui n ja need on võrdelised ![]() .

.

Loomulikult on k piiri viimine lõpmatusse mittetriviaalne. Tekivad mitmed küsimused, näiteks kas sellist limiiti on võimalik võtta, kuidas see mudel välja näeks ja kuidas me saame ehitada ja kasutada sellist mudelit.

Järgmises artiklis keskendume täpselt neile küsimustele: defineerime Dirichlet' protsessi, tutvustame DP erinevaid esitusi ja lõpuks keskendume Hiina restoraniprotsessile, mis on intuitiivne ja tõhus viis Dirichlet' protsessi konstrueerimiseks.

Loodan, et see postitus oli teile kasulik. Kui jagasite, võtke hetk, et jagada artiklit Facebookis ja Twitteris. 🙂

- AI

- ai kunst

- ai kunsti generaator

- on robot

- tehisintellekti

- tehisintellekti sertifikaat

- tehisintellekti robot

- tehisintellekti robotid

- tehisintellekti tarkvara

- blockchain

- plokiahela konverents ai

- coingenius

- vestluslik tehisintellekt

- krüptokonverents ai

- dall's

- Datumbox

- sügav õpe

- google ai

- masinõpe

- Masinõpe ja statistika

- Platon

- plato ai

- Platoni andmete intelligentsus

- Platoni mäng

- PlatoData

- platogaming

- skaala ai

- süntaks

- sephyrnet