Generatiivsete AI-rakenduste kiire kasutuselevõtuga peavad need rakendused õigeaegselt reageerima, et vähendada suurema läbilaskevõimega tajutavat latentsust. Vundamendimudelid (FM-id) on sageli eelkoolitatud tohutul hulgal andmekogudel, mille parameetrid ulatuvad miljonitest miljarditeni ja rohkemgi. Suured keelemudelid (LLM) on teatud tüüpi FM-id, mis genereerivad teksti vastusena kasutaja järeldustele. Nende mudelite tuletamine erineva konfiguratsiooniga järeldusparameetritega võib viia ebajärjekindlate latentsusaegadeni. Ebakõla võib tuleneda erinevast arvust vastuselubadest, mida mudelilt ootate, või kiirendi tüübist, millele mudel juurutatakse.

Mõlemal juhul võite täieliku vastuse ootamise asemel kasutada oma järelduste jaoks vastuste voogesituse lähenemisviisi, mis saadab teabetükid tagasi kohe pärast nende genereerimist. See loob interaktiivse kogemuse, võimaldades teil näha osalisi vastuseid reaalajas voogesitusena, mitte hilinenud täieliku vastuse asemel.

Ametliku teatega, et Amazon SageMakeri reaalajas järeldus toetab nüüd vastuse voogesitust, saate nüüd kasutamise ajal pidevalt järeldusvastuseid kliendile tagasi voogesitada Amazon SageMaker reaalajas järeldused vastuse voogedastusega. See lahendus aitab teil luua interaktiivseid kogemusi erinevate generatiivsete AI rakenduste jaoks, nagu vestlusrobotid, virtuaalsed assistendid ja muusikageneraatorid. See postitus näitab teile, kuidas realiseerida kiiremaid reageerimisaegu esimese baidi (Time to First Byte, TTFB) kujul ja vähendada üldist tajutavat latentsust Llama 2 mudelite järeldamisel.

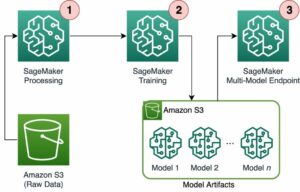

Lahenduse juurutamiseks kasutame täielikult hallatud teenust SageMaker andmete ettevalmistamiseks ning masinõppe (ML) mudelite loomiseks, koolitamiseks ja juurutamiseks mis tahes kasutusjuhtumiks koos täielikult hallatud infrastruktuuri, tööriistade ja töövoogudega. Lisateavet SageMakeri pakutavate juurutusvõimaluste kohta leiate artiklist Amazon SageMakeri mudelimajutuse KKK. Saame aru, kuidas saame lahendada latentsusprobleeme, kasutades vastuse voogesituse abil reaalajas järeldusi.

Lahenduse ülevaade

Kuna soovime käsitleda ülalmainitud latentsusaegasid, mis on seotud reaalajas järeldamisega LLM-idega, mõistame esmalt, kuidas saame kasutada vastuse voogesituse tuge reaalajas järelduste tegemiseks Llama 2 jaoks. Kuid iga LLM saab ära kasutada vastuse voogesituse tuge reaalajas. - aja järeldused.

Llama 2 on eelkoolitatud ja peenhäälestatud generatiivse tekstimudelite kogum, mille skaala ulatub 7 miljardist 70 miljardi parameetrini. Llama 2 mudelid on ainult dekoodri arhitektuuriga autoregressiivsed mudelid. Kui Llama 2 mudelid on varustatud viipade ja järeldusparameetritega, on nad võimelised genereerima teksti vastuseid. Neid mudeleid saab kasutada tõlkimiseks, kokkuvõtete tegemiseks, küsimustele vastamiseks ja vestluseks.

Selle postituse jaoks kasutame mudelit Llama 2 Chat meta-llama/Llama-2-13b-chat-hf SageMakeris reaalajas järelduste tegemiseks koos vastuse voogesitusega.

Kui rääkida mudelite juurutamisest SageMakeri lõpp-punktides, saate mudelid konteinerisse paigutada spetsiaalsete seadmete abil AWS-i süvaõppe konteiner (DLC) pildid, mis on saadaval populaarsete avatud lähtekoodiga teekide jaoks. Llama 2 mudelid on teksti genereerimise mudelid; võite kasutada kas Hugging Face LLM järelduskonteinerid SageMakeris powered by Hugging Face Teksti genereerimise järeldus (TGI) või AWS-i DLC-d Suur mudeli järeldus (LMI).

Selles postituses juurutame Llama 2 13B vestlusmudeli, kasutades DLC-sid SageMaker Hostingis, et teha reaalajas järeldusi, mida toidavad G5 eksemplarid. G5 eksemplarid on suure jõudlusega GPU-põhised eksemplarid graafikamahukate rakenduste ja ML-i järelduste tegemiseks. Saate kasutada ka toetatud eksemplaritüüpe p4d, p3, g5 ja g4dn asjakohaste muudatustega vastavalt eksemplari konfiguratsioonile.

Eeldused

Selle lahenduse rakendamiseks peaks teil olema järgmine:

- AWS-i konto, millel on AWS-i identiteedi- ja juurdepääsuhaldus (IAM) roll, millel on õigused hallata lahenduse osana loodud ressursse.

- Kui töötate esimest korda Amazon SageMaker Studio, peate esmalt looma a SageMakeri domeen.

- Kallistava näo konto. Registreeri oma e-postiga, kui teil veel kontot pole.

- Hugging Face'is saadaolevatele mudelitele, eriti lukustatud mudelitele (nt Llama), peenhäälestamiseks ja järelduste tegemiseks peaks teil olema Hugging Face'i konto, et saada lugemispääsuluba. Pärast Hugging Face'i konto registreerimist, logi sisse külastama https://huggingface.co/settings/tokens lugemisõiguse loomiseks.

- Juurdepääs Llama 2-le, kasutades sama e-posti ID-d, mida kasutasite Hugging Face'i kasutajaks registreerumisel.

- Hugging Face'i kaudu saadaolevad Llama 2 mudelid on avatavad mudelid. Llama mudeli kasutamist reguleerib Meta litsents. Mudeli kaalude ja märgiseadise allalaadimiseks taotleda juurdepääsu laamale ja aktsepteerige nende litsentsi.

- Pärast juurdepääsu andmist (tavaliselt paari päeva pärast) saate e-kirjaga kinnituse. Selle näite jaoks kasutame mudelit

Llama-2-13b-chat-hf, kuid teil peaks olema juurdepääs ka teistele variantidele.

1. lähenemine: kallistava näo TGI

Selles jaotises näitame teile, kuidas juurutada meta-llama/Llama-2-13b-chat-hf mudel SageMakeri reaalajas lõpp-punktile koos vastuste voogesitusega, kasutades Hugging Face TGI-d. Järgmises tabelis on toodud selle juurutuse spetsifikatsioonid.

| spetsifikatsioon | Väärtus |

| Konteiner | Kallistav nägu TGI |

| Mudeli nimi | meta-laama/llama-2-13b-chat-hf |

| ML-i juhtum | ml.g5.12xsuur |

| Järeldus | Reaalajas vastuse voogesitusega |

Mudeli juurutamine

Esiteks hangite juurutava LLM-i baaspildi. Seejärel ehitate mudeli põhipildile. Lõpuks juurutate mudeli SageMakeri hostimise ML-eksemplarile reaalajas järelduste tegemiseks.

Vaatame, kuidas programmiliselt juurutamist saavutada. Lühiduse huvides käsitletakse selles jaotises ainult koodi, mis aitab juurutamisetappe. Täielik juurutamise lähtekood on saadaval sülearvutis llama-2-hf-tgi/llama-2-13b-chat-hf/1-deploy-llama-2-13b-chat-hf-tgi-sagemaker.ipynb.

Hankige eelehitatud uusim Hugging Face LLM DLC, mis töötab TGI-l SageMakeri DLC-d. Kasutate seda pilti juurutamiseks meta-llama/Llama-2-13b-chat-hf mudel SageMakeris. Vaadake järgmist koodi:

Määrake mudeli keskkond konfiguratsiooniparameetritega, mis on määratletud järgmiselt.

asendama <YOUR_HUGGING_FACE_READ_ACCESS_TOKEN> konfiguratsiooniparameetri jaoks HUGGING_FACE_HUB_TOKEN teie Hugging Face profiililt saadud märgi väärtusega, nagu on kirjeldatud selle postituse eeltingimuste jaotises. Konfiguratsioonis määrate mudeli koopia kohta kasutatavate GPU-de arvuks 4 jaoks SM_NUM_GPUS. Seejärel saate kasutusele võtta meta-llama/Llama-2-13b-chat-hf mudel ml.g5.12xsuurel eksemplaril, mis on varustatud 4 GPU-ga.

Nüüd saate luua eksemplari HuggingFaceModel eelnimetatud keskkonnakonfiguratsiooniga:

Lõpuks juurutage mudel, pakkudes argumendid mudelis saadaolevale juurutusmeetodile erinevate parameetriväärtustega, näiteks endpoint_name, initial_instance_countja instance_type:

Tehke järeldused

Hugging Face TGI DLC-l on võimalus vastuseid voogesitada ilma mudeli kohandamise või koodi muutmiseta. Sa võid kasutada invoke_endpoint_with_response_stream kui kasutate Boto3 või InvokeEndpointWithResponseStream SageMaker Python SDK-ga programmeerimisel.

. InvokeEndpointWithResponseStream SageMakeri API võimaldab arendajatel voogesitada vastuseid SageMakeri mudelitelt, mis võib aidata parandada klientide rahulolu, vähendades tajutavat latentsust. See on eriti oluline generatiivsete AI-mudelitega loodud rakenduste puhul, kus kohene töötlemine on olulisem kui kogu vastuse ootamine.

Selle näite puhul kasutame mudeli tuletamiseks Boto3 ja SageMaker API-t invoke_endpoint_with_response_stream järgmiselt:

Argument CustomAttributes on seatud väärtusele accept_eula=false. . accept_eula parameeter peab olema seatud väärtusele true et saada edukalt vastus Llama 2 mudelitelt. Pärast edukat kutsumist kasutades invoke_endpoint_with_response_stream, tagastab meetod baitidest koosneva vastusevoo.

Järgmine diagramm illustreerib seda töövoogu.

Teil on vaja iteraatorit, mis liigub üle baitide voo ja analüüsib need loetavaks tekstiks. The LineIterator teostuse leiate aadressilt llama-2-hf-tgi/llama-2-13b-chat-hf/utils/LineIterator.py. Nüüd olete valmis ette valmistama viipa ja juhised, et neid mudeli järeldamisel kasuliku koormana kasutada.

Valmistage ette viip ja juhised

Selles etapis valmistate ette viipa ja juhised oma LLM-i jaoks. Llama 2 küsimiseks peaks teil olema järgmine viipamall:

Saate luua meetodis programmiliselt määratletud viipamalli build_llama2_prompt, mis ühtib ülalmainitud viipamalliga. Seejärel määratlete juhised vastavalt kasutusjuhtumile. Sel juhul anname mudelile korralduse luua turunduskampaania jaoks meil, nagu on kirjeldatud get_instructions meetod. Nende meetodite kood on failis llama-2-hf-tgi/llama-2-13b-chat-hf/2-sagemaker-realtime-inference-llama-2-13b-chat-hf-tgi-streaming-response.ipynb märkmik. Koostage juhend koos täidetava ülesandega, nagu on üksikasjalikult kirjeldatud user_ask_1 järgmiselt:

Edastame juhised viipa koostamiseks vastavalt faili build_llama2_prompt loodud viipamallile.

Ühendame järeldusparameetrid koos võtmega viipaga stream väärtusega True lõpliku kasuliku koormuse moodustamiseks. Saada kasulik koormus aadressile get_realtime_response_stream, mida kasutatakse vastuse voogesitusega lõpp-punkti kutsumiseks:

LLM-ist loodud tekst voogesitatakse väljundisse, nagu on näidatud järgmises animatsioonis.

2. lähenemisviis: LMI koos DJL-i serveerimisega

Selles jaotises näitame, kuidas juurutada meta-llama/Llama-2-13b-chat-hf mudel SageMakeri reaalajas lõpp-punktile koos vastuse voogesitusega, kasutades LMI-d koos DJL-i teenindamisega. Järgmises tabelis on toodud selle juurutuse spetsifikatsioonid.

| spetsifikatsioon | Väärtus |

| Konteiner | LMI konteineri pilt koos DJL Servingiga |

| Mudeli nimi | meta-laama/llama-2-13b-chat-hf |

| ML-i juhtum | ml.g5.12xsuur |

| Järeldus | Reaalajas vastuse voogesitusega |

Esmalt laadite mudeli alla ja salvestate selle Amazoni lihtne salvestusteenus (Amazon S3). Seejärel määrate S3 URI, mis näitab mudeli S3 eesliidet serving.properties faili. Järgmisena hankite juurutatava LLM-i baaspildi. Seejärel ehitate mudeli põhipildile. Lõpuks juurutate mudeli reaalajas järelduste tegemiseks SageMakeri hostimise ML-eksemplari.

Vaatame, kuidas eelnimetatud juurutamisetappe programmiliselt saavutada. Lühiduse huvides on selles jaotises üksikasjalikult kirjeldatud ainult kood, mis aitab juurutamisetappe. Selle juurutuse täielik lähtekood on saadaval sülearvutis llama-2-lmi/llama-2-13b-chat/1-deploy-llama-2-13b-chat-lmi-response-streaming.ipynb.

Laadige Hugging Face'ist alla mudeli hetktõmmis ja laadige mudeli artefaktid Amazon S3-sse

Eespool nimetatud eeltingimustega laadige mudel alla SageMakeri sülearvuti eksemplari ja seejärel laadige see edasiseks juurutamiseks üles S3 ämbrisse:

Pange tähele, et kuigi te ei esita kehtivat juurdepääsuluba, laaditakse mudel alla. Kuid kui võtate sellise mudeli kasutusele, siis mudeli esitamine ei õnnestu. Seetõttu on soovitatav välja vahetada <YOUR_HUGGING_FACE_READ_ACCESS_TOKEN> argumendi eest token Teie Hugging Face profiililt saadud märgi väärtusega, nagu on eeltingimustes kirjeldatud. Selle postituse jaoks täpsustame Llama 2 ametliku mudeli nime, mis on märgitud Hugging Face'is väärtusega meta-llama/Llama-2-13b-chat-hf. Tihendamata mudel laaditakse alla local_model_path eelnimetatud koodi käitamise tulemusena.

Laadige failid üles Amazon S3-sse ja hankige URI, mida hiljem kasutatakse serving.properties.

Te pakendate meta-llama/Llama-2-13b-chat-hf mudel LMI konteineri kujutisel koos DJL-i esitamisega, kasutades konfiguratsiooni, mis on määratud kaudu serving.properties. Seejärel juurutate mudeli koos mudeliartefaktidega, mis on pakitud SageMaker ML-i eksemplari ml.g5.12xlarge konteineri kujutisele. Seejärel kasutate seda ML-i eksemplari SageMakeri hostimiseks reaalajas järelduste tegemiseks.

Valmistage ette mudeliartefaktid DJL-i serveerimiseks

Valmistage ette oma mudeli artefaktid, luues a serving.properties konfiguratsioonifail:

Kasutame selles konfiguratsioonifailis järgmisi sätteid:

- mootor – See määrab DJL-i jaoks kasutatava käitusaja mootori. Võimalikud väärtused hõlmavad

Python,DeepSpeed,FasterTransformerjaMPI. Sel juhul seadsime selle niiMPI. Mudeli paralleelsus ja järeldus (MPI) hõlbustab mudeli jaotamist kõigi saadaolevate GPU-de vahel ja kiirendab seega järelduste tegemist. - option.entryPoint – See valik määrab, millist DJL Servingi pakutavat töötlejat soovite kasutada. Võimalikud väärtused on

djl_python.huggingface,djl_python.deepspeedjadjl_python.stable-diffusion. Me kasutamedjl_python.huggingfaceKallistava Face Accelerate jaoks. - option.tensor_parallel_degree – See suvand määrab mudelil tehtavate tensoride paralleelsektsioonide arvu. Saate määrata GPU-seadmete arvu, mille üle Accelerate peab mudeli jaotama. See parameeter juhib ka töötajate arvu mudeli kohta, mis käivitatakse DJL-i teenindamise ajal. Näiteks kui meil on 4 graafikaprotsessoriga masin ja me loome neli partitsiooni, siis on meil iga mudeli kohta üks töötaja päringute teenindamiseks.

- option.low_cpu_mem_usage – See vähendab mudelite laadimisel protsessori mälukasutust. Soovitame selle seada

TRUE. - option.rolling_batch – See võimaldab iteratsioonitasemel komplekteerimist, kasutades ühte toetatud strateegiatest. Väärtused hõlmavad

auto,schedulerjalmi-dist. Me kasutamelmi-distpideva partiide laadimise sisselülitamiseks Llama 2 jaoks. - option.max_rolling_batch_size – See piirab samaaegsete päringute arvu pidevas partiis. Vaikimisi on väärtus 32.

- option.model_id – Peaksite välja vahetama

{{model_id}}a-s hostitud eelkoolitatud mudeli ID-ga Hugging Face mudelite hoidla või S3 tee mudeli artefaktidele.

Rohkem konfiguratsioonivalikuid leiate aadressilt Konfiguratsioonid ja seaded.

Kuna DJL Serving eeldab, et mudeli artefaktid pakitakse ja vormindatakse tar-faili, käivitage järgmine koodilõik, et tihendada ja laadida üles tar-fail Amazon S3-sse:

Hankige uusim LMI konteineri kujutis DJL Servingiga

Järgmisena kasutate mudeli juurutamiseks LMI jaoks SageMakeriga saadaolevaid DLC-sid. Hankige SageMakeri kujutise URI djl-deepspeed konteiner programmiliselt, kasutades järgmist koodi:

Rakenduse juurutamiseks saate kasutada ülalnimetatud pilti meta-llama/Llama-2-13b-chat-hf mudel SageMakeris. Nüüd saate jätkata mudeli loomist.

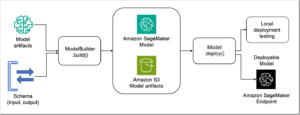

Loo mudel

Saate luua mudeli, mille konteiner on ehitatud kasutades inference_image_uri ja mudeli teeninduskood, mis asub S3 URI juures, mida tähistab s3_code_artifact:

Nüüd saate luua mudeli konfiguratsiooni koos kõigi lõpp-punkti konfiguratsiooni üksikasjadega.

Looge mudeli konfiguratsioon

Kasutage järgmist koodi, et luua mudeli konfiguratsioon identifitseeritud mudelile model_name:

Mudeli konfiguratsioon on määratletud ProductionVariants parameeter InstanceType ML-eksemplari jaoks ml.g5.12xlarge. Samuti pakute ModelName kasutades sama nime, mida kasutasite mudeli loomisel eelmises etapis, luues sellega seose mudeli ja lõpp-punkti konfiguratsiooni vahel.

Nüüd, kui olete mudeli ja mudeli konfiguratsiooni määratlenud, saate luua SageMakeri lõpp-punkti.

Looge SageMakeri lõpp-punkt

Looge mudeli juurutamiseks lõpp-punkt järgmise koodilõigu abil:

Juurutamise edenemist saate vaadata järgmise koodilõigu abil.

Pärast juurutamise õnnestumist on lõpp-punkti olek InService. Nüüd, kui lõpp-punkt on valmis, teeme järeldused vastuse voogesituse abil.

Reaalajas järeldused vastuse voogesitusega

Nagu me käsitlesime Hugging Face TGI varasemas lähenemisviisis, saate kasutada sama meetodit get_realtime_response_stream vastuse voogesituse käivitamiseks SageMakeri lõpp-punktist. LMI-meetodi abil järelduste tegemise kood on dokumendis llama-2-lmi/llama-2-13b-chat/2-inference-llama-2-13b-chat-lmi-response-streaming.ipynb märkmik. The LineIterator teostus asub llama-2-lmi/utils/LineIterator.py. Pange tähele, et LineIterator LMI konteinerisse juurutatud Llama 2 Chati mudeli puhul erineb mudelist LineIterator viidatud Hugging Face TGI jaotises. The LineIterator silmused üle baitide voo Llama 2 vestlusmudelitest, mis on tuletatud LMI konteineriga djl-deepspeed versioon 0.25.0. Järgmine abifunktsioon sõelub vastusevoogu, mis on saadud läbi järelduspäringust, mis on tehtud kaudu invoke_endpoint_with_response_stream API-d:

Eelnev meetod prindib poolt loetud andmevoo LineIterator inimesele loetavas vormingus.

Uurime, kuidas koostada viip ja juhised, et neid mudeli järeldamisel kasuliku koormana kasutada.

Kuna järeldate sama mudelit nii Hugging Face TGI-s kui ka LMI-s, on viipa ja juhiste ettevalmistamise protsess sama. Seetõttu võite kasutada meetodeid get_instructions ja build_llama2_prompt järeldamiseks.

. get_instructions meetod tagastab juhised. Koostage juhised koos täidetava ülesandega, nagu on üksikasjalikult kirjeldatud user_ask_2 järgmiselt:

Edastage juhised viipa koostamiseks vastavalt loodud viipamallile build_llama2_prompt:

Seame kokku järeldusparameetrid koos viipaga lõpliku kasuliku koormuse moodustamiseks. Seejärel saadate kasuliku koormuse aadressile get_realtime_response_stream, mida kasutatakse vastuse voogesitusega lõpp-punkti kutsumiseks:

LLM-ist loodud tekst voogesitatakse väljundisse, nagu on näidatud järgmises animatsioonis.

Koristage

Tarbetute tasude vältimiseks kasutage AWS-i juhtimiskonsool postituses mainitud lähenemisviiside käitamise ajal loodud lõpp-punktide ja nendega seotud ressurside kustutamiseks. Mõlema juurutusviisi puhul tehke järgmine puhastusrutiin.

asendama <SageMaker_Real-time_Endpoint_Name> muutuja jaoks endpoint_name tegeliku lõpp-punktiga.

Teise lähenemisviisi jaoks salvestasime mudeli ja koodi artefaktid Amazon S3-le. Saate S3 ämbri puhastada järgmise koodi abil:

Järeldus

Selles postituses arutasime, kuidas erinev arv vastusemärke või erinev järeldusparameetrite komplekt võib mõjutada LLM-idega seotud latentsusaega. Näitasime, kuidas vastuse voogesituse abil probleemi lahendada. Seejärel tuvastasime kaks lähenemisviisi Llama 2 Chati mudelite juurutamiseks ja järeldamiseks AWS-i DLC-de abil - LMI ja Hugging Face TGI.

Nüüd peaksite mõistma voogesitusvastuse tähtsust ja seda, kuidas see võib tajutavat latentsust vähendada. Voogesitusvastus võib parandada kasutajakogemust, mis muidu sunniks teid ootama, kuni LLM koostab kogu vastuse. Lisaks parandab Llama 2 Chati mudelite juurutamine koos vastuste voogesitusega kasutajakogemust ja teeb teie kliendid õnnelikuks.

Võite vaadata ametlikke aws-proove amazon-sagemaker-lama2-response-streaming-recipes mis hõlmab teiste Llama 2 mudelivariantide kasutuselevõttu.

viited

Autoritest

Pavan Kumar Rao Navule on Amazon Web Servicesi lahenduste arhitekt. Ta teeb koostööd Indias ISV-dega, et aidata neil AWS-i uuendusi teha. Ta on avaldanud raamatu "Getting Started with V Programming". Ta omandas andmeteaduse magistrikraadi India Tehnoloogiainstituudis (IIT), Hyderabadis. Samuti omandas ta India ärijuhtimise ja halduse koolis IT-alase magistriõppe magistrikraadi ning Vaagdevi Tehnoloogia- ja Teadusinstituudis on tal elektroonika- ja kommunikatsioonitehnika bakalaureusekraad. Pavan on AWS-i sertifitseeritud lahenduste arhitekti professionaal ja omab muid sertifikaate, nagu AWS-i sertifitseeritud masinõppe eriala, Microsofti sertifitseeritud professionaal (MCP) ja Microsofti sertifitseeritud tehnoloogiaspetsialist (MCTS). Ta on ka avatud lähtekoodiga entusiast. Vabal ajal meeldib talle kuulata Sia ja Rihanna suurepäraseid maagilisi hääli.

Pavan Kumar Rao Navule on Amazon Web Servicesi lahenduste arhitekt. Ta teeb koostööd Indias ISV-dega, et aidata neil AWS-i uuendusi teha. Ta on avaldanud raamatu "Getting Started with V Programming". Ta omandas andmeteaduse magistrikraadi India Tehnoloogiainstituudis (IIT), Hyderabadis. Samuti omandas ta India ärijuhtimise ja halduse koolis IT-alase magistriõppe magistrikraadi ning Vaagdevi Tehnoloogia- ja Teadusinstituudis on tal elektroonika- ja kommunikatsioonitehnika bakalaureusekraad. Pavan on AWS-i sertifitseeritud lahenduste arhitekti professionaal ja omab muid sertifikaate, nagu AWS-i sertifitseeritud masinõppe eriala, Microsofti sertifitseeritud professionaal (MCP) ja Microsofti sertifitseeritud tehnoloogiaspetsialist (MCTS). Ta on ka avatud lähtekoodiga entusiast. Vabal ajal meeldib talle kuulata Sia ja Rihanna suurepäraseid maagilisi hääli.

Sudhanshu vihkamine on AWS-i peamine AI/ML-spetsialist ja teeb koostööd klientidega, et nõustada neid nende MLO-de ja generatiivse AI-teekonna kohta. Oma eelmises rollis enne Amazoni töötas ta välja ideede loomise, lõi ja juhtis meeskondi, et luua maapealseid avatud lähtekoodiga tehisintellekti- ja mänguplatvorme, ning turustas seda edukalt enam kui 100 kliendiga. Sudhanshu kiituseks on paar patenti, ta on kirjutanud kaks raamatut ja mitu paberit ja ajaveebi ning esitanud oma seisukohti erinevatel tehnilistel foorumitel. Ta on olnud mõttejuht ja kõneleja ning tegutsenud selles valdkonnas peaaegu 25 aastat. Ta on töötanud Fortune 1000 klientidega üle kogu maailma ja viimati digitaalsete kohalike klientidega Indias.

Sudhanshu vihkamine on AWS-i peamine AI/ML-spetsialist ja teeb koostööd klientidega, et nõustada neid nende MLO-de ja generatiivse AI-teekonna kohta. Oma eelmises rollis enne Amazoni töötas ta välja ideede loomise, lõi ja juhtis meeskondi, et luua maapealseid avatud lähtekoodiga tehisintellekti- ja mänguplatvorme, ning turustas seda edukalt enam kui 100 kliendiga. Sudhanshu kiituseks on paar patenti, ta on kirjutanud kaks raamatut ja mitu paberit ja ajaveebi ning esitanud oma seisukohti erinevatel tehnilistel foorumitel. Ta on olnud mõttejuht ja kõneleja ning tegutsenud selles valdkonnas peaaegu 25 aastat. Ta on töötanud Fortune 1000 klientidega üle kogu maailma ja viimati digitaalsete kohalike klientidega Indias.

- SEO-põhise sisu ja PR-levi. Võimenduge juba täna.

- PlatoData.Network Vertikaalne generatiivne Ai. Jõustage ennast. Juurdepääs siia.

- PlatoAiStream. Web3 luure. Täiustatud teadmised. Juurdepääs siia.

- PlatoESG. Süsinik, CleanTech, Energia, Keskkond päikeseenergia, Jäätmekäitluse. Juurdepääs siia.

- PlatoTervis. Biotehnoloogia ja kliiniliste uuringute luureandmed. Juurdepääs siia.

- Allikas: https://aws.amazon.com/blogs/machine-learning/inference-llama-2-models-with-real-time-response-streaming-using-amazon-sagemaker/

- :on

- :on

- : kus

- $ UP

- 1

- 10

- 100

- 11

- 12

- 14

- 15%

- 150

- 16

- 19

- 1.

- 25

- 32

- 385

- 50

- 7

- 70

- 8

- 9

- a

- võime

- Võimalik

- MEIST

- kiirendama

- kiirendab

- kiirendi

- aktsepteerima

- juurdepääs

- konto

- Saavutada

- üle

- tegevus

- tegelik

- Lisaks

- aadress

- haldamine

- vastu võtma

- Vastuvõtmine

- ADEelis

- nõustama

- mõjutada

- pärast

- AI

- AI mudelid

- AI / ML

- alice

- Joondab

- Materjal: BPA ja flataatide vaba plastik

- Lubades

- võimaldab

- mööda

- juba

- Ka

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- ja

- animatsioon

- teatas

- Teadaanne

- mistahes

- API

- rakendused

- lähenemine

- lähenemisviisid

- asjakohane

- arhitektuuri-

- arhitektuur

- OLEME

- argument

- argumendid

- AS

- assistendid

- seotud

- At

- autor

- saadaval

- vältima

- AWS

- tagasi

- baas

- partii

- BE

- sest

- olnud

- enne

- vahel

- Peale

- Miljard

- miljardeid

- BIN

- blogid

- keha

- raamat

- Raamatud

- mõlemad

- ehitama

- Ehitab

- ehitatud

- äri

- kuid

- by

- helistama

- Kampaania

- CAN

- võimeline

- juhul

- sertifikaadid

- atesteeritud

- Vaidluste lahendamine

- koormuste

- vestlus

- jututoad

- puhastama

- klient

- kliendid

- klubi

- kood

- kogumine

- COM

- kombineeritud

- tuleb

- KOMMUNIKATSIOON

- konkurent

- konfiguratsioon

- kinnitus

- Konteiner

- Konteinerid

- pidev

- pidevalt

- kontrolli

- võiks

- Paar

- kupong

- kaetud

- KATTED

- looma

- loodud

- loob

- loomine

- krediit

- klient

- Kliendi rahulolu

- Kliendid

- andmed

- andmeteadus

- Päeva

- sügav

- sügav õpe

- vaikimisi

- määratlema

- määratletud

- Hilineb

- näitama

- juurutada

- lähetatud

- juurutamine

- kasutuselevõtu

- üksikasjalik

- detailid

- Arendajad

- seadmed

- erinev

- digitaalne

- arutatud

- Ära

- lae alla

- ajal

- Ajalugu

- kumbki

- Elektroonika

- võimaldab

- Lõpp-punkt

- Mootor

- Inseneriteadus

- entusiast

- Kogu

- keskkond

- eriti

- asutades

- Isegi

- näide

- täidesaatev

- ootab

- ootab

- kogemus

- Kogemused

- uurima

- nägu

- hõlbustab

- vale

- kiiremini

- fail

- Faile

- lõplik

- Lõpuks

- esimene

- Esimest korda

- Järel

- järgneb

- eest

- vorm

- formaat

- heaolu

- Foorumid

- avastatud

- Sihtasutus

- neli

- tasuta

- Alates

- täis

- täielikult

- funktsioon

- edasi

- Gamification

- väravaga

- tekitama

- loodud

- teeniva

- põlvkond

- generatiivne

- Generatiivne AI

- generaatorid

- saama

- gif

- maakera

- Go

- juhitakse

- GPU

- GPU

- antud

- suur

- õnnelik

- viha

- Olema

- he

- aitama

- aitab

- suur jõudlus

- rohkem

- tema

- omab

- võõrustas

- Hosting

- Kuidas

- Kuidas

- aga

- HTML

- http

- HTTPS

- Kallistav Nägu

- inimesele loetav

- ID

- tuvastatud

- Identity

- if

- illustreerib

- pilt

- pildid

- Vahetu

- rakendada

- täitmine

- import

- tähtsus

- oluline

- parandama

- parandab

- in

- sisaldama

- Kaasa arvatud

- India

- india

- osutatud

- tööstus

- info

- Infrastruktuur

- uuendama

- sisend

- sisendite

- sees

- Näiteks

- selle asemel

- Instituut

- juhised

- interaktiivne

- Internet

- küsimustes

- IT

- ITS

- teekond

- Json

- Võti

- kumar

- keel

- suur

- Hilinemine

- latentsusprobleemid

- pärast

- hiljemalt

- algatama

- viima

- juht

- õppimine

- Led

- Pikkus

- raamatukogud

- litsents

- nagu

- piirid

- joon

- kuulama

- Laama

- LLM

- laadimine

- asub

- armastab

- masin

- masinõpe

- tehtud

- tegema

- TEEB

- juhtima

- juhitud

- juhtimine

- Turundus

- max

- mai..

- MCP

- Mälu

- mainitud

- Meta

- meetod

- meetodid

- Microsoft

- miljonid

- ML

- MLOps

- mudel

- mudelid

- kuu

- rohkem

- kõige

- muusika

- peab

- nimi

- Nimega

- emakeelena

- peaaegu

- Vajadus

- vajadustele

- Uus

- järgmine

- meeles

- märkmik

- nüüd

- number

- esemeid

- jälgima

- saama

- saadud

- of

- pakutud

- ametlik

- sageli

- on

- ONE

- ainult

- avatud

- avatud lähtekoodiga

- valik

- Valikud

- or

- Muu

- muidu

- piirjooned

- väljund

- üle

- üldine

- pakendatud

- pakendamine

- dokumendid

- Parallel

- parameeter

- parameetrid

- osa

- sooritama

- Patendi

- tee

- kohta

- tajutav

- täitma

- teostatud

- Õigused

- Platvormid

- Platon

- Platoni andmete intelligentsus

- PlatoData

- võrra

- populaarne

- võimalik

- post

- sisse

- eelnev

- Valmistama

- ettevalmistamisel

- eeldused

- esitatud

- eelmine

- Peamine

- pildid

- Probleem

- jätkama

- protsess

- Töödeldud

- töötlemine

- Toode

- toote käivitamine

- professionaalne

- profiil

- Programming

- Edu

- omadused

- anda

- tingimusel

- annab

- pakkudes

- avaldatud

- eesmärkidel

- Python

- pütorch

- küsimus

- alates

- kiire

- pigem

- Lugenud

- valmis

- reaalne

- reaalajas

- mõistma

- saama

- saadud

- hiljuti

- soovitama

- soovitatav

- vähendama

- vähendab

- vähendamine

- viitama

- seos

- asendama

- vastus

- Hoidla

- taotleda

- Taotlusi

- Vahendid

- Reageerida

- vastus

- vastuste

- kaasa

- tagasipöördumine

- Tulu

- Roll

- rutiinne

- jooks

- jooksmine

- jookseb

- runtime

- salveitegija

- sama

- rahulolu

- Skaala

- Kool

- teadus

- SDK

- sujuv

- Teine

- Osa

- vaata

- saatma

- saadab

- teenima

- teenus

- Teenused

- teenindavad

- komplekt

- seaded

- mitu

- Lühike

- peaks

- näitama

- näitas

- näidatud

- Näitused

- kirjutama

- lihtne

- Snapshot

- jupp

- lahendus

- Lahendused

- varsti

- allikas

- lähtekoodi

- Kõneleja

- spetsialist

- spetsialiseeritud

- Eriala

- spetsifikatsioonid

- määratletud

- alustatud

- olek

- Samm

- Sammud

- Peatus

- ladustamine

- salvestada

- ladustatud

- strateegiad

- oja

- otseülekanne

- streaming

- Voogesituse teenus

- edukas

- edukas

- Edukalt

- selline

- toetama

- Toetatud

- Toetab

- tabel

- Võtma

- Ülesanne

- meeskonnad

- tech

- Tehniline

- Tehnoloogia

- šabloon

- tekst

- kui

- et

- .

- oma

- Neile

- SIIS

- Seal.

- sellega

- seetõttu

- Need

- nad

- see

- kuigi?

- arvasin

- läbilaskevõime

- aeg

- korda

- et

- sümboolne

- märgid

- töövahendid

- Rong

- Tõlge

- tõsi

- Pööramine

- kaks

- tüüp

- liigid

- tüüpiliselt

- mõistma

- tarbetu

- kuni

- Kasutus

- kasutama

- kasutage juhtumit

- Kasutatud

- Kasutaja

- User Experience

- kasutamine

- kehtiv

- väärtus

- Väärtused

- muutuja

- eri

- varieeruv

- suur

- versioon

- kaudu

- vaade

- virtuaalne

- visiit

- HÄÄLED

- ootama

- ootamine

- tahan

- we

- web

- veebiteenused

- Hästi

- olid

- millal

- mis

- kuigi

- kogu

- kelle

- will

- koos

- jooksul

- ilma

- töötas

- töötaja

- töötajate

- töövoog

- Töövoogud

- töö

- töötab

- oleks

- kirjutama

- kirjalik

- aastat

- sa

- Sinu

- sephyrnet