Amazon SageMaker mitme mudeli lõpp-punktid (MME) on täielikult hallatav SageMakeri järelduse võimalus, mis võimaldab teil juurutada tuhandeid mudeleid ühes lõpp-punktis. Varem eraldasid MME-d mudelitele CPU arvutusvõimsust staatiliselt, sõltumata mudeli liikluskoormusest, kasutades Mitme mudeli server (MMS) selle mudelserverina. Selles postituses käsitleme lahendust, milles MME saab dünaamiliselt kohandada igale mudelile määratud arvutusvõimsust mudeli liiklusmustri alusel. See lahendus võimaldab teil MME-de aluseks olevaid arvutusi tõhusamalt kasutada ja kulusid kokku hoida.

MME-d laadivad ja tühjendavad mudeleid dünaamiliselt lõpp-punkti sissetuleva liikluse põhjal. MMS-i mudeliserverina kasutades eraldavad MME-d iga mudeli jaoks kindla arvu mudelitöötajaid. Lisateabe saamiseks vaadake Mudelite hostimismustrid rakenduses Amazon SageMaker, 3. osa: käitage ja optimeerige mitme mudeli järeldusi Amazon SageMakeri mitme mudeli lõpp-punktidega.

See võib aga põhjustada mõningaid probleeme, kui teie liiklusmuster on muutuv. Oletame, et teil on üks või mitu mudelit, mis saavad palju liiklust. Saate konfigureerida MMS-i nii, et see eraldaks nende mudelite jaoks palju töötajaid, kuid see määratakse kõigile MME taga olevatele mudelitele, kuna see on staatiline konfiguratsioon. See viib selleni, et suur hulk töötajaid kasutab riistvaralist arvutust – isegi tühikäigumudelid. Vastupidine probleem võib juhtuda, kui määrate töötajate arvule väikese väärtuse. Populaarsetel mudelitel ei ole mudeliserveri tasemel piisavalt töötajaid, et nende mudelite lõpp-punkti taha piisavalt riistvara õigesti eraldada. Peamine probleem seisneb selles, et liiklusmustrite agnostikuks jääda on raske, kui te ei saa oma töötajaid mudeliserveri tasemel dünaamiliselt skaleerida, et eraldada vajalik kogus arvutusi.

Selles postituses käsitletud lahendust kasutatakse DJLSering mudeliserverina, mis võib aidata leevendada mõningaid arutletud probleeme ja võimaldada mudelite kaupa skaleerimist ning võimaldada MME-del olla liiklusmustrite agnostikud.

MME arhitektuur

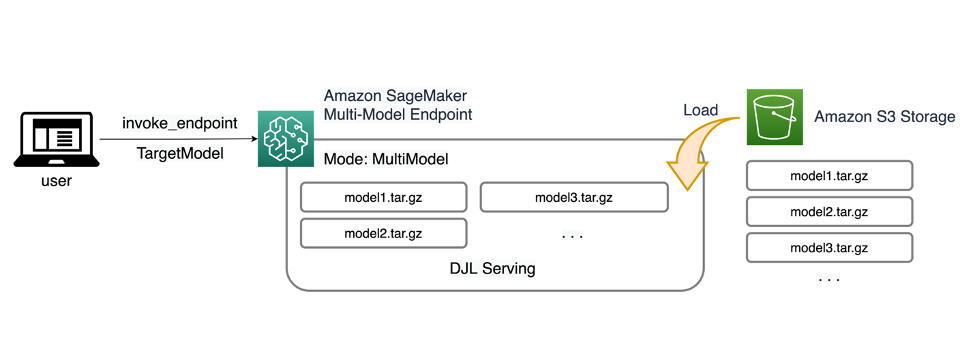

SageMakeri MME-d võimaldavad teil juurutada mitu mudelit ühe järelduse lõpp-punkti taga, mis võib sisaldada ühte või mitut eksemplari. Iga eksemplar on mõeldud mitme mudeli laadimiseks ja teenindamiseks kuni selle mälu ja CPU/GPU mahuni. Selle arhitektuuriga saab tarkvara kui teenuse (SaaS) äri murda mitme mudeli hostimise lineaarselt kasvavad kulud ja saavutada infrastruktuuri taaskasutamise, mis on kooskõlas mujal rakenduste pinus rakendatava mitme rendimudeliga. Järgmine diagramm illustreerib seda arhitektuuri.

SageMaker MME laadib dünaamiliselt mudeleid Amazoni lihtne salvestusteenus (Amazon S3) käivitamisel, selle asemel, et lõpp-punkti esmakordsel loomisel alla laadida kõik mudelid. Selle tulemusena võib mudeli esialgne kutsumine näha suuremat järelduste latentsust kui järgnevad järeldused, mis viiakse lõpule madala latentsusega. Kui mudel on käivitamisel konteinerisse juba laaditud, jäetakse allalaadimise etapp vahele ja mudel tagastab järeldused madala latentsusega. Oletame näiteks, et teil on mudel, mida kasutatakse vaid paar korda päevas. See laaditakse nõudmisel automaatselt, samas kui sageli kasutatavad mudelid säilitatakse mällu ja käivitatakse pidevalt madala latentsusega.

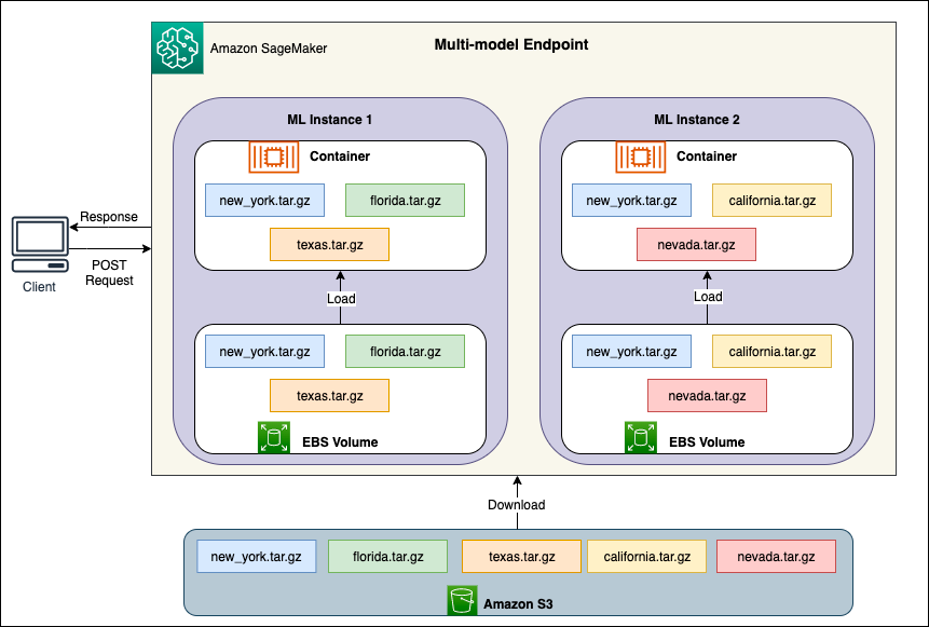

Iga MME taga on mudeli hostimise eksemplarid, nagu on näidatud järgmisel diagrammil. Need eksemplarid laadivad ja eemaldavad mitu mudelit mälusse ja sealt välja mudelite liiklusmustrite alusel.

SageMaker jätkab mudeli järelduspäringute suunamist eksemplari, kus mudel on juba laaditud, nii et päringud edastatakse vahemällu salvestatud mudelikoopiast (vt järgmist diagrammi, mis näitab esimese ennustuspäringu päringu teed võrreldes vahemällu salvestatud ennustusega päringu tee). Kui aga mudel saab palju kutsumistaotlusi ja MME jaoks on täiendavaid eksemplare, suunab SageMaker mõned päringud mõnele teisele eksemplarile, et kasvu arvesse võtta. SageMakeri automaatse mudeli skaleerimise eeliste kasutamiseks veenduge, et teil on eksemplari automaatse skaleerimise seadistamine et pakkuda täiendavat eksemplari võimsust. Seadistage lõpp-punkti tasemel skaleerimispoliitika kas kohandatud parameetrite või väljakutsete arvuga minutis (soovitatav), et lisada lõpp-punktiparki rohkem eksemplare.

Mudelserveri ülevaade

Mudelserver on tarkvarakomponent, mis pakub käituskeskkonda masinõppe (ML) mudelite juurutamiseks ja teenindamiseks. See toimib liidesena koolitatud mudelite ja klientrakenduste vahel, mis soovivad nende mudelite abil ennustusi teha.

Mudelserveri esmane eesmärk on võimaldada ML-mudelite pingevaba integreerimist ja tõhusat juurutamist tootmissüsteemidesse. Selle asemel, et manustada mudelit otse rakendusse või konkreetsesse raamistikku, pakub mudeliserver tsentraliseeritud platvormi, kus saab juurutada, hallata ja teenindada mitut mudelit.

Mudelserverid pakuvad tavaliselt järgmisi funktsioone:

- Mudeli laadimine – Server laadib treenitud ML-mudelid mällu, muutes need prognooside teenindamiseks valmis.

- Järeldus API – Server paljastab API, mis võimaldab klientrakendustel saata sisendandmeid ja saada ennustusi juurutatud mudelitelt.

- Scaling – Mudelserverid on loodud käsitlema mitme kliendi samaaegseid päringuid. Need pakuvad mehhanisme paralleelseks töötlemiseks ja ressursside tõhusaks haldamiseks, et tagada suur läbilaskevõime ja madal latentsusaeg.

- Integreerimine taustamootoritega – Mudeliserveritel on integratsioonid taustaraamistikega, nagu DeepSpeed ja FasterTransformer, et jagada suuri mudeleid ja käitada väga optimeeritud järeldusi.

DJL arhitektuur

DJL serveerimine on avatud lähtekoodiga suure jõudlusega universaalne mudelserver. DJL Serving on üles ehitatud Djl, Java programmeerimiskeeles kirjutatud süvaõppe raamatukogu. See võib võtta süvaõppemudeli, mitu mudelit või töövoogu ja teha need HTTP-lõpp-punkti kaudu kättesaadavaks. DJL Serving toetab mudelite juurutamist mitmest raamistikust, nagu PyTorch, TensorFlow, Apache MXNet, ONNX, TensorRT, Hugging Face Transformers, DeepSpeed, FasterTransformer ja palju muud.

DJL Serving pakub palju funktsioone, mis võimaldavad teil oma mudeleid suure jõudlusega juurutada:

- Kasutusmugavus – DJL Serving suudab enamikke mudeleid karbist välja võtta. Lihtsalt tooge mudeliartefaktid ja DJL Serving saab neid majutada.

- Mitme seadme ja kiirendi tugi - DJL Serving toetab mudelite juurutamist protsessoris, GPU-s ja AWS Inferentia.

- jõudlus – DJL Serving käivitab läbilaskevõime suurendamiseks mitmelõimelise järelduse ühes JVM-is.

- Dünaamiline komplekteerimine – DJL Serving toetab läbilaskevõime suurendamiseks dünaamilist partiide jagamist.

- Automaatne skaleerimine - DJL Serving skaleerib töötajaid automaatselt liikluskoormuse alusel üles ja alla.

- Mitme mootori tugi – DJL Serving saab korraga hostida erinevaid raamistikke (nt PyTorch ja TensorFlow) kasutavaid mudeleid.

- Ansambli ja töövoo mudelid – DJL Serving toetab mitmest mudelist koosnevate keeruliste töövoogude juurutamist ja käitab töövoo osasid CPU-s ja osi GPU-s. Töövoo mudelid võivad kasutada erinevaid raamistikke.

Eelkõige muudab DJL Servingi automaatse skaleerimise funktsioon lihtsaks tagada, et mudelid on sissetuleva liikluse jaoks sobivalt skaleeritud. Vaikimisi määrab DJL Serving olemasoleva riistvara (CPU tuumad, GPU-seadmed) alusel maksimaalse toetatava mudeli töötajate arvu. Saate määrata iga mudeli jaoks alumise ja ülemise piiri tagamaks, et alati saab teenindada minimaalset liiklustaset ja et üks mudel ei tarbi kõiki saadaolevaid ressursse.

DJL Serving kasutab a Võrkjas frontend backend töötaja lõimekogumite peal. Frontend kasutab ühte Netty seadistust koos mitmega HttpRequestHandlers. Erinevad päringutöötlejad pakuvad tuge Järeldus API, Haldamise APIvõi muud API-d, mis on saadaval erinevatest pistikprogrammidest.

Taustaprogramm põhineb ümber WorkLoadManager (WLM) moodul. WLM hoolitseb iga mudeli jaoks mitme töötaja lõime eest koos komplekteerimisega ja taotleb neile marsruutimist. Kui serveeritakse mitut mudelit, kontrollib WLM esmalt iga mudeli järelduspäringu järjekorra suurust. Kui järjekorra suurus on mudeli partii suurusest kaks korda suurem, suurendab WLM sellele mudelile määratud töötajate arvu.

Lahenduse ülevaade

DJL-i rakendamine MME-ga erineb MMS-i vaikeseadest. DJL-i serveerimiseks MME-ga tihendame järgmised failid form.tar.gz vormingus, mida SageMaker Inference ootab:

- mudel.joblib – Selle juurutuse jaoks surume mudeli metaandmed otse tarballi. Sel juhul töötame koos a

.joblibfaili, seega esitame selle faili oma tarballis, et meie järeldusskripti lugeda. Kui artefakt on liiga suur, saate selle lükata ka Amazon S3-le ja osutada sellele DJL-i jaoks määratud esituskonfiguratsioonis. - serveerimine.omadused – Siin saate konfigureerida mis tahes serveriga seotud mudelit keskkonnamuutujad. DJL-i jõud seisneb siin selles, et saate konfigureerida

minWorkersjamaxWorkersiga mudeli tarballi jaoks. See võimaldab igal mudelil mudeliserveri tasemel skaleerida üles ja alla. Näiteks kui ainsusmudel võtab vastu suurema osa MME liiklusest, suurendab mudeliserver töötajaid dünaamiliselt. Selles näites me neid muutujaid ei konfigureeri ja laseme DJL-l määrata vajaliku arvu töötajaid sõltuvalt meie liiklusmustrist. - mudel.py – See on järeldusskript mis tahes kohandatud eel- või järeltöötluse jaoks, mida soovite rakendada. Model.py eeldab, et teie loogika on vaikimisi kapseldatud käepidememeetodisse.

- nõuded.txt (valikuline) - Vaikimisi on DJL installitud koos PyTorchiga, kuid kõik vajalikud täiendavad sõltuvused saate siia lükata.

Selle näite puhul tutvustame DJL-i võimsust MME-ga, võttes SKLearni näidismudeli. Teeme selle mudeliga koolitust ja seejärel loome sellest mudeliartefaktist 1,000 koopiat, et toetada meie MME-d. Seejärel näitame, kuidas DJL saab dünaamiliselt skaleerida, et käsitleda mis tahes tüüpi liiklusmustreid, mida teie MME võib vastu võtta. See võib hõlmata liikluse ühtlast jaotumist kõigi mudelite või isegi mõne populaarse mudeli vahel, mis saavad suurema osa liiklusest. Kogu koodi leiate järgmisest GitHub repo.

Eeldused

Selle näite puhul kasutame SageMakeri märkmiku eksemplari koos conda_python3 tuuma ja ml.c5.xlarge eksemplariga. Koormustestide tegemiseks võite kasutada Amazon Elastic Compute Cloud (Amazon EC2) eksemplar või suurem SageMakeri sülearvuti eksemplar. Selles näites skaleerime üle tuhande tehingu sekundis (TPS), seega soovitame testida raskema EC2 eksemplariga, näiteks ml.c5.18xlarge, et teil oleks rohkem arvutusi.

Looge mudelartefakt

Kõigepealt peame looma mudeliartefakti ja andmed, mida selles näites kasutame. Sel juhul genereerime NumPy abil mõned tehisandmed ja treenime SKLearni lineaarse regressioonimudeli abil järgmise koodilõigu abil:

Pärast eelmise koodi käivitamist peaks teil olema a model.joblib teie kohalikus keskkonnas loodud faili.

Tõmmake DJL Dockeri pilt

Dockeri kujutis djl-inference:0.23.0-cpu-full-v1.0 on meie selles näites kasutatav DJL-i serveerimismahuti. Sõltuvalt oma piirkonnast saate kohandada järgmist URL-i:

inference_image_uri = "474422712127.dkr.ecr.us-east-1.amazonaws.com/djl-serving-cpu:latest"

Soovi korral saate seda pilti kasutada ka põhipildina ja laiendada seda oma Dockeri kujutise loomiseks Amazoni elastsete konteinerite register (Amazon ECR) koos muude vajalike sõltuvustega.

Looge mudelifail

Esiteks loome faili nimega serving.properties. See juhendab DJLServingit kasutama Pythoni mootorit. Samuti määratleme max_idle_time 600 sekundit. See tagab, et meil kulub mudeli kohta töötavate töötajate arvu vähendamiseks kauem aega. Me ei kohane minWorkers ja maxWorkers mida saame määratleda ja laseme DJL-il dünaamiliselt arvutada vajalike töötajate arvu sõltuvalt liiklusest, mida iga mudel vastu võtab. Serveerimisomadused on näidatud järgmiselt. Konfiguratsioonivalikute täieliku loendi vaatamiseks vaadake Mootori konfiguratsioon.

Järgmisena loome faili model.py, mis määratleb mudeli laadimise ja järelduste loogika. MME-de puhul on iga model.py fail konkreetse mudeli jaoks spetsiifiline. Mudelid salvestatakse mudelipoe alla oma radadele (tavaliselt /opt/ml/model/). Mudelite laadimisel laaditakse need nende enda kataloogi mudelipoe tee alla. Selle demo täielikku model.py näidet saab näha jaotises GitHub repo.

Loome a model.tar.gz fail, mis sisaldab meie mudelit (model.joblib), model.pyja serving.properties:

Demonstratsiooni eesmärgil teeme samast 1,000 koopiat model.tar.gz faili, mis esindab suurt hulka hostitavaid mudeleid. Tootmises peate looma a model.tar.gz faili iga mudeli jaoks.

Lõpuks laadime need mudelid üles Amazon S3-sse.

Looge SageMakeri mudel

Nüüd loome a SageMakeri mudel. Kasutame SageMakeri mudeli loomiseks varem määratletud ECR-pilti ja eelmise sammu mudeli artefakti. Mudeli seadistuses konfigureerime režiimi MultiModelina. See annab DJLServingile teada, et loome MME-d.

Looge SageMakeri lõpp-punkt

Selles demos kasutame tuhandetesse ulatuvasse TPS-i skaleerimiseks 20 ml.c5d.18xlarge eksemplare. Sihitava TPS-i saavutamiseks suurendage vajadusel oma eksemplari tüübi limiiti.

Koormustestimine

Artikli kirjutamise ajal oli SageMakeri sisemine koormustesti tööriist Amazon SageMakeri järelduste soovitus ei toeta algselt MME-de testimist. Seetõttu kasutame avatud lähtekoodiga Pythoni tööriista rändrohutirts. Locusti on lihtne seadistada ja see suudab jälgida selliseid mõõdikuid nagu TPS ja lõpplatentsus. Täieliku ülevaate saamiseks selle SageMakeriga seadistamise kohta vt Amazon SageMakeri reaalajas järelduste lõpp-punktide koormustestimise parimad tavad.

Sel juhul on meil kolm erinevat liiklusmustrit, mida tahame MME-dega simuleerida, seega on meil järgmised kolm Pythoni skripti, mis joonduvad iga mustriga. Meie eesmärk on siin tõestada, et olenemata meie liiklusmustrist suudame saavutada sama eesmärgi TPS-i ja asjakohaselt skaleerida.

Saame oma Locusti skriptis määrata kaalu, et määrata liiklus meie mudelite erinevate osade vahel. Näiteks meie ühe kuuma mudeli puhul rakendame kahte meetodit järgmiselt.

Seejärel saame igale meetodile määrata teatud kaalu, mis on siis, kui teatud meetod saab teatud protsendi liiklusest:

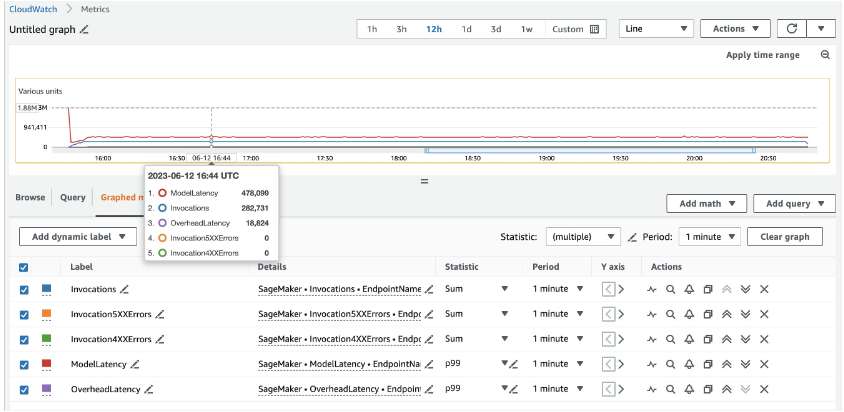

20 ml.c5d.18xlarge eksemplaride puhul näeme alljärgnevaid kutsumõõdikuid Amazon CloudWatch konsool. Need väärtused jäävad kõigi kolme liiklusmustri puhul üsna järjepidevaks. SageMakeri reaalajas järelduste ja MME-de CloudWatchi mõõdikute paremaks mõistmiseks vaadake SageMakeri lõpp-punkti kutsumise mõõdikud.

Ülejäänud Locusti skriptid leiate veebisaidilt jaanikaunade kataloog GitHubi hoidlas.

kokkuvõte

Selles postituses arutasime, kuidas MME saab mudeli liiklusmustri põhjal dünaamiliselt kohandada igale mudelile määratud arvutusvõimsust. See äsja käivitatud funktsioon on saadaval kõigis AWS-i piirkondades, kus SageMaker on saadaval. Pange tähele, et väljakuulutamise ajal toetatakse ainult CPU eksemplare. Lisateabe saamiseks vaadake Toetatud algoritmid, raamistikud ja eksemplarid.

Autoritest

Ram Vegiraju on SageMaker Service meeskonnaga ML arhitekt. Ta keskendub sellele, et aidata klientidel luua ja optimeerida oma AI/ML-lahendusi Amazon SageMakeris. Vabal ajal armastab ta reisimist ja kirjutamist.

Ram Vegiraju on SageMaker Service meeskonnaga ML arhitekt. Ta keskendub sellele, et aidata klientidel luua ja optimeerida oma AI/ML-lahendusi Amazon SageMakeris. Vabal ajal armastab ta reisimist ja kirjutamist.

Qingwei Li on Amazon Web Servicesi masinõppe spetsialist. Ta sai doktorikraadi. operatsioonide uurimisel pärast seda, kui ta murdis oma nõustaja uurimistoetuse konto ja ei suutnud väljastada lubatud Nobeli preemiat. Praegu aitab ta finantsteenuste ja kindlustussektori klientidel AWS-is masinõppelahendusi luua. Vabal ajal meeldib talle lugeda ja õpetada.

Qingwei Li on Amazon Web Servicesi masinõppe spetsialist. Ta sai doktorikraadi. operatsioonide uurimisel pärast seda, kui ta murdis oma nõustaja uurimistoetuse konto ja ei suutnud väljastada lubatud Nobeli preemiat. Praegu aitab ta finantsteenuste ja kindlustussektori klientidel AWS-is masinõppelahendusi luua. Vabal ajal meeldib talle lugeda ja õpetada.

James Wu on AWS-i vanem AI/ML-lahenduste spetsialist. aidata klientidel AI/ML lahendusi kavandada ja luua. Jamesi töö hõlmab laia valikut ML kasutusjuhtumeid, mille peamine huvi on arvutinägemine, sügav õppimine ja ML-i skaleerimine kogu ettevõttes. Enne AWS-iga liitumist oli James arhitekt, arendaja ja tehnoloogiajuht üle 10 aasta, sealhulgas 6 aastat inseneritöös ning 4 aastat turundus- ja reklaamitööstuses.

James Wu on AWS-i vanem AI/ML-lahenduste spetsialist. aidata klientidel AI/ML lahendusi kavandada ja luua. Jamesi töö hõlmab laia valikut ML kasutusjuhtumeid, mille peamine huvi on arvutinägemine, sügav õppimine ja ML-i skaleerimine kogu ettevõttes. Enne AWS-iga liitumist oli James arhitekt, arendaja ja tehnoloogiajuht üle 10 aasta, sealhulgas 6 aastat inseneritöös ning 4 aastat turundus- ja reklaamitööstuses.

Saurabh Trikande on Amazon SageMaker Inference'i vanemtootejuht. Ta on kirglik töö klientidega ja teda motiveerib eesmärk demokratiseerida masinõpe. Ta keskendub põhiprobleemidele, mis on seotud keeruliste ML-rakenduste, mitme rentniku ML-mudelite, kulude optimeerimise ja süvaõppemudelite juurutamise kättesaadavamaks muutmisega. Vabal ajal naudib Saurabh matkamist, uuenduslike tehnoloogiate õppimist, TechCrunchi jälgimist ja perega aega veetmist.

Saurabh Trikande on Amazon SageMaker Inference'i vanemtootejuht. Ta on kirglik töö klientidega ja teda motiveerib eesmärk demokratiseerida masinõpe. Ta keskendub põhiprobleemidele, mis on seotud keeruliste ML-rakenduste, mitme rentniku ML-mudelite, kulude optimeerimise ja süvaõppemudelite juurutamise kättesaadavamaks muutmisega. Vabal ajal naudib Saurabh matkamist, uuenduslike tehnoloogiate õppimist, TechCrunchi jälgimist ja perega aega veetmist.

Xu Deng on tarkvarainseneride juht koos SageMakeri meeskonnaga. Ta keskendub sellele, et aidata klientidel luua ja optimeerida oma AI/ML järelduskogemust Amazon SageMakeris. Vabal ajal armastab ta reisimist ja lumelauaga sõitmist.

Xu Deng on tarkvarainseneride juht koos SageMakeri meeskonnaga. Ta keskendub sellele, et aidata klientidel luua ja optimeerida oma AI/ML järelduskogemust Amazon SageMakeris. Vabal ajal armastab ta reisimist ja lumelauaga sõitmist.

Siddharth Venkatesan on AWS-i süvaõppe tarkvarainsener. Praegu keskendub ta lahenduste loomisele suurte mudelite järelduste tegemiseks. Enne AWS-i töötas ta organisatsioonis Amazon Grocery, luues uusi maksefunktsioone klientidele kogu maailmas. Väljaspool tööd meeldib talle suusatada, õues olla ja sporti vaadata.

Siddharth Venkatesan on AWS-i süvaõppe tarkvarainsener. Praegu keskendub ta lahenduste loomisele suurte mudelite järelduste tegemiseks. Enne AWS-i töötas ta organisatsioonis Amazon Grocery, luues uusi maksefunktsioone klientidele kogu maailmas. Väljaspool tööd meeldib talle suusatada, õues olla ja sporti vaadata.

Rohith Nallamaddi on AWS-i tarkvaraarenduse insener. Ta töötab GPU-de sügava õppimise töökoormuse optimeerimise, suure jõudlusega ML-i järelduste loomise ja lahenduste teenindamise nimel. Enne seda töötas ta Amazon F3 äri jaoks AWS-il põhinevate mikroteenuste loomisega. Väljaspool tööd meeldib talle mängida ja sporti vaadata.

Rohith Nallamaddi on AWS-i tarkvaraarenduse insener. Ta töötab GPU-de sügava õppimise töökoormuse optimeerimise, suure jõudlusega ML-i järelduste loomise ja lahenduste teenindamise nimel. Enne seda töötas ta Amazon F3 äri jaoks AWS-il põhinevate mikroteenuste loomisega. Väljaspool tööd meeldib talle mängida ja sporti vaadata.

- SEO-põhise sisu ja PR-levi. Võimenduge juba täna.

- PlatoData.Network Vertikaalne generatiivne Ai. Jõustage ennast. Juurdepääs siia.

- PlatoAiStream. Web3 luure. Täiustatud teadmised. Juurdepääs siia.

- PlatoESG. Süsinik, CleanTech, Energia, Keskkond päikeseenergia, Jäätmekäitluse. Juurdepääs siia.

- PlatoTervis. Biotehnoloogia ja kliiniliste uuringute luureandmed. Juurdepääs siia.

- Allikas: https://aws.amazon.com/blogs/machine-learning/run-ml-inference-on-unplanned-and-spiky-traffic-using-amazon-sagemaker-multi-model-endpoints/

- :on

- : kus

- $ UP

- 000

- 1

- 10

- 100

- 116

- 118

- 12

- 16

- 17

- 20

- 23

- 31

- 600

- 7

- 9

- a

- MEIST

- kiirendi

- pääses

- juurdepääsetav

- majutada

- konto

- Saavutada

- üle

- õigusaktid

- lisama

- Täiendavad lisad

- ADEelis

- reklaam

- pärast

- AI / ML

- algoritme

- viia

- Materjal: BPA ja flataatide vaba plastik

- eraldama

- paigutatud

- võimaldama

- võimaldab

- mööda

- juba

- Ka

- alati

- Amazon

- Amazon EC2

- Amazon SageMaker

- Amazon Web Services

- summa

- an

- ja

- Teadaanne

- Teine

- mistahes

- Apache

- API

- API-liidesed

- taotlus

- rakendused

- rakendatud

- asjakohaselt

- arhitektuur

- OLEME

- ümber

- kunstlik

- AS

- määratud

- eeldab

- At

- auto

- Automatiseeritud

- automaatselt

- saadaval

- AWS

- tagasi

- Taustaprogramm

- baas

- põhineb

- partii

- BE

- sest

- taga

- Parem

- vahel

- keha

- suurendada

- piirid

- Kast

- Murdma

- tooma

- Murdis

- ehitama

- Ehitus

- ehitatud

- äri

- kuid

- by

- kutsutud

- CAN

- võime

- Võimsus

- mis

- juhul

- juhtudel

- rakk

- tsentraliseeritud

- kindel

- väljakutseid

- Kontroll

- klass

- klient

- kliendid

- kood

- tuleb

- täitma

- Lõpetatud

- keeruline

- komponent

- Koosneb

- Arvutama

- arvuti

- Arvuti visioon

- arvutustehnika

- arvutusvõimsus

- konkurent

- konfiguratsioon

- järjepidev

- järjepidevalt

- konsool

- tarbima

- sisaldama

- Konteiner

- kontekst

- pidev

- tuum

- Maksma

- kulud

- KATTED

- looma

- loodud

- loomine

- Praegu

- tava

- Kliendid

- andmed

- päev

- sügav

- sügav õpe

- vaikimisi

- määratlema

- määratletud

- Määratleb

- tarnima

- Nõudlus

- demo

- Demokraatlik

- sõltuvused

- Olenevalt

- kujutatud

- juurutada

- lähetatud

- juurutamine

- kasutuselevõtu

- Disain

- kavandatud

- Määrama

- määrab

- arendaja

- & Tarkvaraarendus

- seade

- seadmed

- skeem

- erinev

- raske

- otse

- kataloog

- arutama

- arutatud

- jaotus

- laevalaadija

- Ei tee

- Ära

- alla

- lae alla

- allalaadimine

- dünaamiline

- dünaamiliselt

- iga

- Ajalugu

- tõhus

- tõhusalt

- vaevata

- kumbki

- mujal

- kinnistamine

- võimaldama

- võimaldab

- kapseldatud

- Lõpuks-lõpuni

- Lõpp-punkt

- Mootor

- insener

- Inseneriteadus

- piisavalt

- tagama

- ettevõte

- keskkond

- viga

- Isegi

- näide

- erand

- ootab

- ootab

- kogemus

- laiendama

- nägu

- Ebaõnnestunud

- õiglaselt

- pere

- tunnusjoon

- FUNKTSIOONID

- vähe

- fail

- Faile

- finants-

- finantsteenus

- leidma

- esimene

- fikseeritud

- FLEET

- keskendub

- Järel

- järgneb

- eest

- formaat

- Raamistik

- raamistikud

- sageli

- Alates

- Frontend

- täis

- täielikult

- funktsionaalsused

- tekitama

- saama

- saab

- GitHub

- eesmärk

- GPU

- GPU

- anda

- suurem

- käepide

- juhtuda

- riistvara

- Olema

- he

- aitama

- aidates

- aitab

- siin

- Suur

- rohkem

- kõrgelt

- tema

- võõrustaja

- võõrustas

- Hosting

- KUUM

- Kuidas

- Kuidas

- aga

- HTML

- http

- HTTPS

- Idle

- if

- illustreerib

- pilt

- rakendada

- täitmine

- import

- in

- sisaldama

- hõlmab

- Kaasa arvatud

- Sissetulev

- Suurendama

- kasvav

- tööstusharudes

- tööstus

- info

- Infrastruktuur

- esialgne

- uuenduslik

- uuenduslikke tehnoloogiaid

- sisend

- paigaldatud

- Näiteks

- selle asemel

- kindlustus

- integratsioon

- integratsioon

- huvi

- Interface

- sisse

- kutsutud

- probleem

- küsimustes

- IT

- ITS

- james

- Java

- töö

- liitumine

- jpg

- lihtsalt

- keel

- suur

- suurem

- Hilinemine

- hiljemalt

- käivitatud

- viima

- juht

- Leads

- Õppida

- õppimine

- laskma

- Tase

- Raamatukogu

- nagu

- meeldib

- LIMIT

- sirgjooneline

- nimekiri

- koormus

- laadimine

- saadetised

- kohalik

- loogika

- enam

- armastab

- Madal

- vähendada

- masin

- masinõpe

- põhiline

- Enamus

- tegema

- TEEB

- Tegemine

- juhitud

- juht

- juhtiv

- palju

- Turundus

- Turundus ja reklaam

- maksimaalne

- mai..

- mehhanismid

- Mälu

- Metaandmed

- meetod

- meetodid

- Meetrika

- mikroteenused

- võib

- miinimum

- minut

- Leevendada

- ML

- viis

- mudel

- mudelid

- moodulid

- rohkem

- kõige

- motiveeritud

- mitmekordne

- nimi

- natiivselt

- vajalik

- Vajadus

- vaja

- Uus

- äsja

- nobeli preemia

- mitte ükski

- meeles

- märkmik

- nüüd

- number

- tuim

- of

- pakkuma

- Pakkumised

- on

- ONE

- ainult

- avatud

- avatud lähtekoodiga

- Operations

- vastupidine

- optimeerimine

- optimeerima

- optimeeritud

- optimeerimine

- Valikud

- or

- Muu

- meie

- välja

- väljas

- väljund

- väljaspool

- üle

- enda

- Parallel

- parameetrid

- osa

- eriline

- osad

- kirglik

- tee

- teed

- Muster

- mustrid

- makse

- kohta

- protsent

- täitma

- jõudlus

- toru

- inimesele

- Platon

- Platoni andmete intelligentsus

- PlatoData

- mängimine

- pluginad

- Punkt

- poliitika

- Basseinid

- populaarne

- post

- võim

- tavad

- eelnev

- ennustus

- Ennustused

- eelmine

- varem

- esmane

- Eelnev

- preemia

- Probleem

- protsess

- töötlemine

- Toode

- tootejuht

- Produktsioon

- Programming

- lubas

- korralikult

- omadused

- Tõesta

- anda

- annab

- säte

- eesmärk

- eesmärkidel

- Lükkama

- lükatakse

- Python

- pütorch

- juhuslik

- valik

- Lugenud

- Lugemine

- valmis

- reaalajas

- saama

- saadud

- saab

- vastuvõtmine

- soovitatav

- viitama

- Sõltumata sellest

- piirkond

- piirkondades

- seotud

- jääma

- asendama

- Hoidla

- esindama

- taotleda

- Taotlusi

- Nõuded

- teadustöö

- Vahendid

- vastus

- REST

- kaasa

- Tulu

- taaskasutada

- Marsruut

- liinidel

- Marsruutimine

- jooks

- jookseb

- runtime

- SaaS

- salveitegija

- SageMakeri järeldus

- sama

- proov

- Säästa

- ütlema

- Skaala

- skaleeritud

- Kaalud

- ketendamine

- käsikiri

- skripte

- Teine

- sekundit

- vaata

- nähtud

- SELF

- saatma

- vanem

- teenima

- serveeritud

- server

- Serverid

- teenus

- Teenused

- teenindavad

- komplekt

- Komplektid

- seade

- mitu

- peaks

- presentatsioon

- näidatud

- Näitused

- lihtne

- simuleerima

- üheaegselt

- ühekordne

- ainsus

- SUURUS

- väike

- jupp

- So

- tarkvara

- tarkvara

- tarkvaraarenduse

- Tarkvara insener

- lahendus

- Lahendused

- mõned

- allikas

- spetsialist

- konkreetse

- Kulutused

- jagada

- sport

- Kestab

- staatiline

- Samm

- ladustamine

- salvestada

- ladustatud

- lihtne

- järgnev

- selline

- soovitama

- toetama

- Toetatud

- Toetab

- kindel

- süsteemid

- Võtma

- võtab

- võtmine

- sihtmärk

- sihtimine

- õpetamine

- meeskond

- TechCrunch

- Tehnoloogiad

- Tehnoloogia

- ütleb

- tensorivool

- Testimine

- testid

- kui

- et

- .

- oma

- Neile

- SIIS

- Seal.

- seetõttu

- Need

- nad

- see

- need

- tuhat

- tuhandeid

- kolm

- Läbi

- läbilaskevõime

- aeg

- korda

- et

- liiga

- tööriist

- ülemine

- suunas

- tps

- jälgida

- liiklus

- Rong

- koolitatud

- koolitus

- Tehingud

- trafod

- Reisimine

- püüdma

- kaks

- tüüp

- tüüpiliselt

- all

- aluseks

- mõistma

- mõistmine

- Universaalne

- URL

- kasutama

- kasutage juhtumit

- Kasutatud

- kasutusalad

- kasutamine

- tavaliselt

- kasutades

- väärtus

- Väärtused

- muutuja

- eri

- nägemus

- vs

- tahan

- oli

- vaadates

- we

- web

- veebiteenused

- kaal

- M

- millal

- samas kui

- mis

- lai

- Lai valik

- will

- koos

- jooksul

- Töö

- töötas

- töötaja

- töötajate

- töövoog

- Töövoogud

- töö

- töötab

- oleks

- kirjutamine

- kirjalik

- X

- aastat

- sa

- Sinu

- sephyrnet