یک مقاله تحقیقاتی جدید منتشر شده، یک تراشه محاسباتی در حافظه (CIM) را توصیف میکند که نورونهای مصنوعی را با RAM مقاومتی (RRAM) ترکیب میکند تا وزنهای مدل هوش مصنوعی را بتوان روی همان تراشه ذخیره و پردازش کرد.

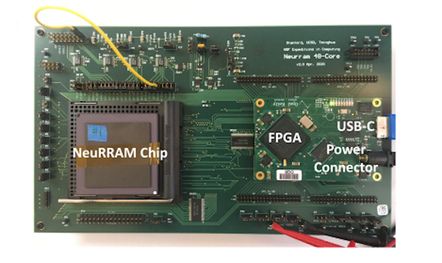

یک تراشه محاسباتی در حافظه مبتنی بر حافظه با دسترسی تصادفی مقاومتی (برای بزرگنمایی کلیک کنید). تصویر: وان و همکاران

محققان پشت این طراحی ادعا میکنند که برای کاربردهای لبه کارآمدتر است، زیرا حرکت دادهها را بین بلوکهای محاسباتی و حافظه جداگانه حذف میکند.

محاسبات لبه و هوش مصنوعی هر دو حداقل در مسیر رشد شهاب سنگی در آینده نزدیک هستند به گفته شرکت تحلیلی IDC. برخی سناریوها آنها را با هم ترکیب میکنند زیرا استقرار لبهها ممکن است در قدرت و اتصال محدود باشد، با این حال هنوز نیاز به تجزیه و تحلیل حجم قابل توجهی از دادهها و ارائه پاسخی تقریباً همزمان به رویدادها دارند، و یک مدل هوش مصنوعی «زندگی» در دستگاه را به بهینهترین راهحل تبدیل میکند. .

با توجه به این موضوع، گروهی از محققان تراشهای را توسعه دادهاند که NeuRRAM نامیده میشود، زیرا نورونهای مصنوعی را با RRAM در یک معماری جدید ترکیب میکند. هدف این پروژه ارائه طرحی بود که بتواند به طور همزمان بازده انرژی بالا و همچنین تطبیق پذیری برای پشتیبانی از مدل های مختلف هوش مصنوعی و دقت قابل مقایسه با اجرای همان مدل در نرم افزار را ارائه دهد.

این پروژه در ابتدا به عنوان بخشی از پروژه بنیاد علوم طبیعت به نام "اکسپدیشن ها در محاسبات" آغاز شد. این پروژه گروهی از محققان را از موسسات مختلف با پیشینههای مختلف، از جمله برخی از استنفورد و UCSD، و همچنین محققان دانشگاه Tsinghua در چین که در ساخت دستگاههای RRAM متخصص هستند، گرد هم آورد.

بهره وری انرژی: استنباط هوش مصنوعی در Gizmo با باتری انجام می شود

به گفته وایر وان، محقق فارغ التحصیل دانشگاه استنفورد و یکی از نویسندگان مقالهNeuRRAM که دیروز در Nature منتشر شد، به عنوان یک تراشه هوش مصنوعی توسعه داده شده است که بهره وری انرژی استنباط هوش مصنوعی را تا حد زیادی بهبود می بخشد، در نتیجه به عملکردهای پیچیده هوش مصنوعی اجازه می دهد مستقیماً در دستگاه های لبه باتری مانند پوشیدنی های هوشمند، پهپادها و حسگرهای صنعتی اینترنت اشیا تحقق یابد. .

در تراشههای هوش مصنوعی امروزی، پردازش دادهها و ذخیرهسازی دادهها در مکانهای جداگانهای اتفاق میافتد - واحد محاسبات و واحد حافظه. جابجایی مکرر داده بین این واحدها بیشترین انرژی را مصرف می کند و به گلوگاهی برای تحقق پردازنده های هوش مصنوعی کم مصرف برای دستگاه های لبه تبدیل می شود.

برای رفع این مشکل، تراشه NeuRRAM یک مدل «محاسبه در حافظه» را پیادهسازی میکند که در آن پردازش مستقیماً در حافظه انجام میشود. همچنین از RAM مقاومتی (RRAM) استفاده میکند، یک نوع حافظه که به سرعت RAM استاتیک است اما غیرفرار است و به آن اجازه میدهد وزنهای مدل هوش مصنوعی را ذخیره کند. یکی از ویژگیهای کلیدی سلولهای RRAM این است که وزنهای عصبی را میتوان در سلولهای حافظه بهعنوان سطوح رسانایی مختلف ذخیره کرد، از طریق مبدلهای دیجیتال به آنالوگ (DAC) کدگذاری شده و به آرایه حافظه تغذیه شد.

این یک شبیه سازی نرم افزاری نیست، سخت افزاری است

مطالعات قبلی روی معماریهای CIM انجام شده است، اما این اولین موردی است که طیف گستردهای از کاربردهای هوش مصنوعی را در سختافزار به جای شبیهسازی نرمافزار نشان میدهد، در حالی که انرژی کارآمدتر است و قادر به اجرای دقیق الگوریتمها است، چیزی که هیچ یک از مطالعات قبلی وجود ندارد. به گفته وان توانستند به طور همزمان نشان دهند.

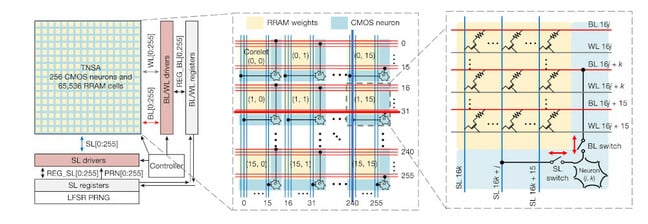

NeuRRAM از 48 هسته CIM تشکیل شده است که در مجموع از 3 میلیون سلول RRAM تشکیل شده است. هر هسته به عنوان یک آرایه عصبی سیناپسی قابل انتقال (TNSA) توصیف میشود که از شبکهای از سلولهای RRAM 256×256 و مدارهای عصبی مصنوعی 256 CMOS تشکیل شده است که مبدلهای آنالوگ به دیجیتال (ADCs) و عملکردهای فعالسازی را اجرا میکنند.

طبق این مقاله، معماری TNSA برای ارائه کنترل انعطافپذیر جهت جریان داده طراحی شده است که برای پشتیبانی از طیف متنوعی از مدلهای هوش مصنوعی با الگوهای مختلف جریان داده بسیار مهم است.

به عنوان مثال، در شبکههای عصبی کانولوشن (CNN) که در وظایف مرتبط با بینایی رایج هستند، دادهها در یک جهت از طریق لایهها برای تولید نمایش دادهها در سطوح مختلف انتزاعی جریان مییابند، در حالی که در برخی مدلهای دیگر نمونهگیری احتمالی بین لایهها به صورت رفت و برگشت انجام میشود. تا زمانی که شبکه به حالت احتمال زیاد همگرا شود.

این مقاله میگوید، با این حال، طرحهای دیگری که CIM را با RRAM ترکیب کردهاند، به عملکرد در یک جهت محدود میشوند، معمولاً با سیمکشی ردیفها و ستونهای آرایه نوار متقاطع RRAM به مدارهای اختصاصی در حاشیه برای هدایت ورودیها و اندازهگیری خروجیها.

چگونه کار می کند

راز پیکربندی مجدد NeuRRAM این است که مدارهای عصبی CMOS را بین سلول های RRAM توزیع می کند و آنها را در طول ردیف ها و ستون ها به هم متصل می کند.

هر TNSA به تعدادی کورلت تقسیم می شود که هر کدام از سلول های RRAM 16×16 و یک مدار نورون تشکیل شده است. کورلت ها با خطوط بیت مشترک (BL) و خطوط کلمه (WL) در جهت افقی و خطوط منبع (SL) در امتداد جهت عمودی به هم متصل می شوند.

مدار نورون از طریق سوئیچ ها به یک BL و یک SL از هر 16 عددی که از کورلت عبور می کند وصل می شود و مسئول یکپارچه سازی ورودی ها از 256 RRAM است که به همان BL یا SL متصل می شوند.

هر مدار نورون می تواند از سوئیچ های BL و SL خود برای ورودی و خروجی استفاده کند. این بدان معنی است که می تواند ضرب ماتریس-بردار آنالوگ (MVM) را از یک سلول RRAM دریافت کند که از BL یا SL از طریق سوئیچ ها می آید، اما همچنین می تواند نتایج دیجیتال تبدیل شده را از طریق همان سوئیچ ها به ثبات های جانبی ارسال کند.

این ترتیب به این معنی است که جهتهای جریان داده متفاوت را میتوان با پیکربندی سوئیچ برای استفاده در مراحل ورودی و خروجی هر مدار عصبی پیادهسازی کرد.

(این معماری همچنین ما را تا حدودی در ذهن قرار می دهد تراشه پردازنده هوش مصنوعی SambaNova، که به عنوان شبکه ای از واحدهای محاسباتی و واحدهای حافظه پیاده سازی شده است که توسط یک پارچه ارتباطی روی تراشه که جریان داده را کنترل می کند، به هم متصل شده اند.)

بر اساس این مقاله، برای به حداکثر رساندن عملکرد استنتاج هوش مصنوعی با استفاده از 48 هسته CIM در NeuRRAM، میتوان استراتژیهای مختلف نگاشت وزن را پیادهسازی کرد که از موازیسازی مدل و موازیسازی دادهها استفاده میکنند.

در مورد CNN، استراتژی ممکن است کپی کردن وزن لایههای اولیه و محاسباتی فشرده به چندین هسته CIM برای استنتاج موازی باشد. این مقاله شرح مفصل تری از استراتژی های نگاشت وزن موجود را ارائه می دهد.

این مقاله نتایج استنتاج اندازهگیری شده با سختافزار را با استفاده از تراشه برای طیف وسیعی از وظایف هوش مصنوعی از جمله طبقهبندی تصاویر با استفاده از مجموعه دادههای CIFAR-10 و MNIST، تشخیص فرمان گفتار Google و بازیابی تصویر MNIST، که با مدلهای مختلف هوش مصنوعی پیادهسازی شده است، گزارش میکند.

ادعا می شود که به دقت استنتاج قابل مقایسه با مدل های نرم افزاری آموزش دیده با وزن های 4 بیتی در تمام این وظایف محک دست می یابد. برای مثال، نرخ خطای 0.98 درصدی در تشخیص رقم دستنویس MNIST با استفاده از CNN 7 لایه، نرخ خطای 14.34 درصدی در طبقهبندی شی CIFAR-10 با استفاده از ResNet-20 و نرخ خطای 15.34 درصدی در تشخیص فرمان گفتار Google با استفاده از LSTM 4 سلولی (حافظه کوتاه مدت طولانی).

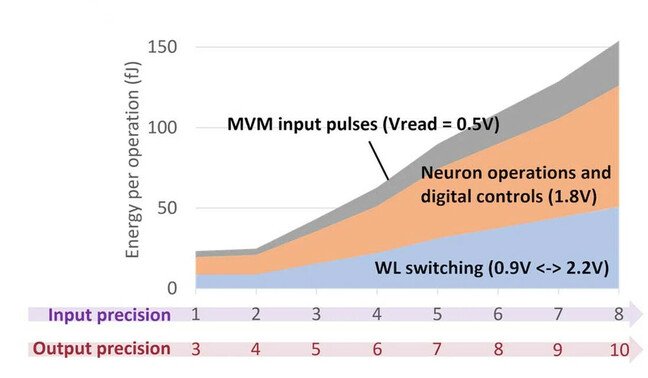

همچنین ادعا میشود که تراشه NeuRRAM دارای بازده انرژی است که دو برابر بهتر از طراحیهای قبلی تراشههای CIM با استفاده از RRAM، در دقت بیتهای محاسباتی مختلف است. با این حال، مصرف انرژی در مقاله به شکلی ذکر نشده است که به راحتی با دستگاه های تجاری موجود در بازار مقایسه شود، و شکل زیر نشان دهنده مصرف انرژی در هر عملیات در دقت بیت های مختلف اندازه گیری شده در فمتوژول (fJ) است.

با این حال، وان به ما گفت که برای یک کار معمولی تشخیص کلمات کلیدی در زمان واقعی که امروزه روی بسیاری از دستگاههای خانه هوشمند اجرا میشود (مانند گفتن به بلندگوی هوشمند برای روشن کردن نور)، NeuRRAM کمتر از ۲ میکرووات انرژی مصرف میکند.

او گفت: «این بدان معناست که حتی در یک باتری سکهای کوچک، میتواند بیش از 10 سال کار کند (بدون در نظر گرفتن انرژی مصرف شده توسط سایر اجزای سیستم).

بر اساس این مقاله، تراشه با استفاده از فناوری CMOS 130 نانومتری ساخته شده است و انتظار میرود که بهرهوری انرژی با مقیاسپذیری فناوری، مانند سایر محصولات نیمهرسانا، بهبود یابد.

تولید هنوز سالها باقی مانده است

بنابراین آیا ما شاهد یک دستگاه تجاری حمل و نقل بر اساس این فناوری خواهیم بود؟ وان میگوید که پتانسیل بالایی برای تجاریسازی دارد و شخصاً در حال بررسی کار روی تولید آن است.

او به ما گفت: «مناسب ترین مورد استفاده اولیه بسیار محتمل است در لبه های شدید / اینترنت اشیا».

یک محصول مبتنی بر تراشه NeuRRAM می تواند مانند سایر شتاب دهنده ها در یک سیستم با یک CPU ترکیب شود، اما این برای هر برنامه ای ضروری نیست.

وان گفت: «اخیراً روند دادههای حسگرهایی که مستقیماً بدون عبور از پردازنده یا حافظه اضافی به پردازندههای هوش مصنوعی داده میشوند، وجود داشته است. برای یک CPU، که در آن CPU وظایف دیگر را مدیریت می کند.

تراشه NeuRRAM فقط برای استنباط کار در نظر گرفته شده است، عمدتاً به این دلیل که فناوری RRAM در شکل فعلی آن برای آموزش چندان مناسب نیست زیرا فرآیند آموزش نیاز به به روز رسانی مکرر حافظه دارد و وان گفت: "عملیات بسیار گرانی روی RRAM".

در حال حاضر بسیاری از ریختهگریهای تجاری توانایی ساخت دستگاههای RRAM را دارند، اما بیشتر برای استفاده از حافظه جاسازی شده به جای محاسبه در حافظه. هنگامی که فرآیند RRAM به طور گسترده در دسترس طراحان IC قرار گیرد، یک محصول NeuRRAM ممکن است رخ دهد.

با این حال، پیشبینی زمان دقیق این اتفاق دشوار است و وان گفت که ممکن است در دو تا سه سال آینده یا بسیار بیشتر باشد. ®

- AI

- آی هنر

- مولد هنر ai

- ربات ai

- هوش مصنوعی

- گواهی هوش مصنوعی

- هوش مصنوعی در بانکداری

- ربات هوش مصنوعی

- ربات های هوش مصنوعی

- نرم افزار هوش مصنوعی

- بلاکچین

- کنفرانس بلاک چین ai

- coingenius

- هوش مصنوعی محاوره ای

- کنفرانس کریپتو ai

- دل-ه

- یادگیری عمیق

- گوگل ai

- فراگیری ماشین

- افلاطون

- افلاطون آی

- هوش داده افلاطون

- بازی افلاطون

- PlatoData

- بازی پلاتو

- مقیاس Ai

- نحو

- ثبت نام

- زفیرنت