کشف تقلب مشکل مهمی است که در خدمات مالی، رسانه های اجتماعی، تجارت الکترونیک، بازی و سایر صنایع کاربرد دارد. این پست اجرای یک راه حل تشخیص تقلب را با استفاده از مدل شبکه کانولوشن گراف رابطه ای (RGCN) برای پیش بینی احتمال کلاهبرداری یک تراکنش از طریق هر دو حالت استنتاج انتقالی و استقرایی ارائه می دهد. شما می توانید پیاده سازی ما را به یک آمازون SageMaker نقطه پایانی بهعنوان یک راهحل کشف تقلب در زمان واقعی، بدون نیاز به ذخیرهسازی گراف خارجی یا هماهنگسازی، در نتیجه هزینه استقرار مدل را بهطور قابلتوجهی کاهش میدهد.

مشاغلی که به دنبال یک سرویس کاملاً مدیریت شده AWS AI برای تشخیص تقلب هستند نیز می توانند استفاده کنند ردیاب تقلب آمازون، که می توانید از آن برای شناسایی پرداخت های آنلاین مشکوک، کشف کلاهبرداری حساب جدید، جلوگیری از سوء استفاده از برنامه آزمایشی و وفاداری یا بهبود تشخیص تصاحب حساب استفاده کنید.

بررسی اجمالی راه حل

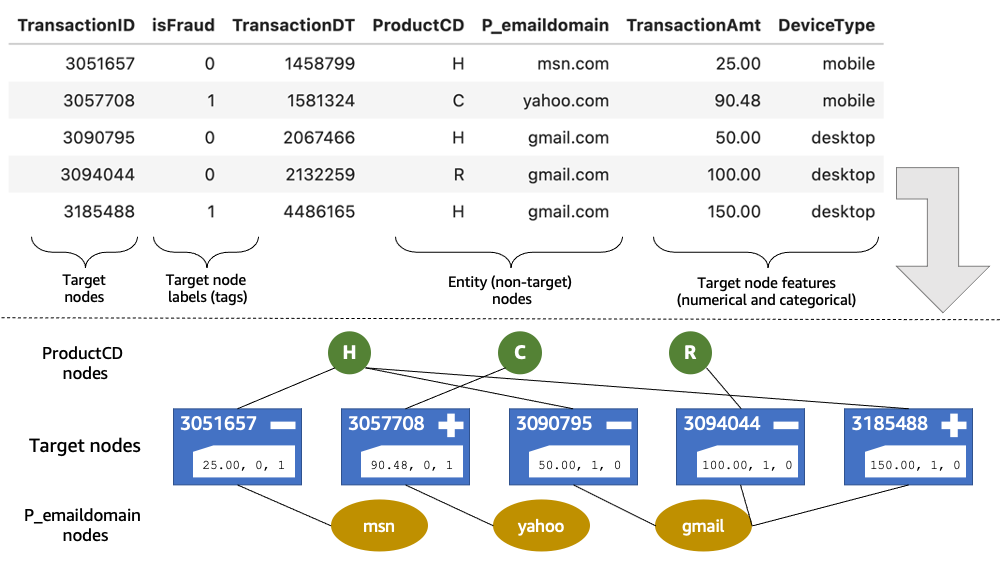

نمودار زیر یک شبکه تراکنش مالی نمونه را توصیف می کند که شامل انواع مختلفی از اطلاعات است. هر تراکنش حاوی اطلاعاتی مانند شناسههای دستگاه، شناسههای Wi-Fi، آدرسهای IP، مکانهای فیزیکی، شماره تلفن و موارد دیگر است. ما مجموعه دادههای تراکنش را از طریق یک نمودار ناهمگن نشان میدهیم که شامل انواع مختلفی از گرهها و لبهها است. سپس، مشکل کشف تقلب به عنوان یک وظیفه طبقه بندی گره در این گراف ناهمگن مدیریت می شود.

شبکههای عصبی گراف (GNN) در مقابله با مشکلات کشف تقلب، عملکرد بهتری از روشهای یادگیری تحت نظارت رایج مانند درختهای تصمیم تقویتشده با گرادیان یا شبکههای فید فوروارد کاملاً متصل در مجموعه دادههای محک زده، نویدبخش است. در یک راه اندازی معمولی تشخیص تقلب، در طول مرحله آموزش، یک مدل GNN بر روی مجموعه ای از تراکنش های برچسب دار آموزش داده می شود. هر تراکنش آموزشی با یک برچسب باینری ارائه میشود که نشان میدهد آیا تقلبی است یا خیر. سپس این مدل آموزش دیده می تواند برای شناسایی تراکنش های جعلی در میان مجموعه ای از تراکنش های بدون برچسب در طول مرحله استنتاج استفاده شود. دو حالت مختلف استنتاج وجود دارد: استنتاج انتقالی در مقابل استنتاج استقرایی (که بعداً در این پست بیشتر به آن خواهیم پرداخت).

مدلهای مبتنی بر GNN، مانند RGCN، میتوانند از اطلاعات توپولوژیکی بهره ببرند و ساختار گراف و ویژگیهای گرهها و لبهها را برای یادگیری یک نمایش معنادار که تراکنشهای مخرب را از تراکنشهای قانونی متمایز میکند، ترکیب کنند. RGCN می تواند به طور موثر یاد بگیرد که انواع مختلف گره ها و یال ها (روابط) را از طریق جاسازی گراف ناهمگن نشان دهد. در نمودار قبل، هر تراکنش بهعنوان یک گره هدف مدلسازی میشود و چندین موجودیت مرتبط با هر تراکنش بهعنوان انواع گرههای غیرهدف مدلسازی میشوند، مانند ProductCD و P_emaildomain. گره های هدف دارای ویژگی های عددی و دسته بندی شده هستند، در حالی که انواع دیگر گره ها فاقد ویژگی هستند. مدل RGCN یک جاسازی برای هر نوع گره غیر هدف را یاد می گیرد. برای جاسازی یک گره هدف، یک عملیات کانولوشن برای محاسبه جاسازی آن با استفاده از ویژگی ها و جاسازی های همسایگی آن استفاده می شود. در ادامه پست، ما از اصطلاحات GNN و RGCN به جای یکدیگر استفاده می کنیم.

شایان ذکر است که استراتژیهای جایگزین، مانند برخورد با موجودیتهای غیرهدف بهعنوان ویژگیها و رمزگذاری آنها، اغلب به دلیل ویژگیهای بزرگ این موجودیتها غیرممکن است. برعکس، رمزگذاری آنها به عنوان موجودیتهای گراف، مدل GNN را قادر میسازد تا از توپولوژی ضمنی در روابط موجودیت استفاده کند. به عنوان مثال، تراکنشهایی که یک شماره تلفن مشترک با تراکنشهای جعلی شناختهشده به اشتراک میگذارند، احتمالاً کلاهبرداری نیز هستند.

نمایش گراف به کار گرفته شده توسط GNN ها پیچیدگی هایی را در اجرای آنها ایجاد می کند. این امر به ویژه برای برنامههایی مانند تشخیص تقلب، که در آنها نمایش نمودار ممکن است در طول استنتاج با گرههای جدید اضافه شده که با موجودیتهایی که در طول آموزش مدل شناخته نشدهاند مطابقت دارند، تقویت شود. این سناریوی استنتاج معمولاً به عنوان حالت القایی. در تضاد، حالت انتقالی سناریویی است که فرض می کند نمایش گراف ساخته شده در طول آموزش مدل در طول استنتاج تغییر نخواهد کرد. مدلهای GNN اغلب در حالت انتقالی با ساختن نمایشهای نموداری از مجموعهای ترکیبی از نمونههای آموزشی و آزمایشی ارزیابی میشوند، در حالی که برچسبهای آزمایشی را در حین انتشار به عقب میپوشانند. این تضمین میکند که نمایش گراف ثابت است، و مدل GNN نیازی به اجرای عملیات برای گسترش نمودار با گرههای جدید در طول استنتاج ندارد. متأسفانه، هنگام شناسایی تراکنش های تقلبی در یک محیط واقعی، نمی توان نمایش نمودار ایستا را فرض کرد. بنابراین، هنگام استقرار مدلهای GNN برای تشخیص تقلب در محیطهای تولید، پشتیبانی از استنتاج استقرایی مورد نیاز است.

علاوه بر این، شناسایی تراکنش های تقلبی در زمان واقعی بسیار مهم است، به ویژه در موارد تجاری که تنها یک شانس برای توقف فعالیت های غیرقانونی وجود دارد. به عنوان مثال، کاربران کلاهبردار می توانند فقط یک بار با یک حساب کاربری مخرب رفتار کنند و دیگر از همان حساب استفاده نکنند. استنتاج بلادرنگ بر روی مدلهای GNN پیچیدگی بیشتری را برای پیادهسازی معرفی میکند. اغلب لازم است عملیات استخراج زیرگراف برای پشتیبانی از استنتاج بلادرنگ اجرا شود. عملیات استخراج زیرگراف برای کاهش تأخیر استنتاج زمانی که نمایش گراف بزرگ است و انجام استنتاج در کل نمودار بسیار گران می شود مورد نیاز است. یک الگوریتم برای استنتاج استقرایی بلادرنگ با یک مدل RGCN به صورت زیر اجرا می شود:

- با توجه به دسته ای از تراکنش ها و یک مدل RGCN آموزش دیده، نمایش گراف را با موجودیت های دسته گسترش دهید.

- بردارهای تعبیه گره های غیر هدف جدید را با میانگین بردار تعبیه شده از نوع گره مربوطه خود اختصاص دهید.

- استخراج زیرگراف القا شده توسط kپرش از همسایگی گره های هدف از دسته.

- استنتاج را روی زیرگراف انجام دهید و نمرات پیشبینی بازگشت را برای گرههای هدف دسته انجام دهید.

- نمایش گراف را با حذف گره های تازه اضافه شده پاک کنید (این مرحله تضمین می کند که نیاز به حافظه برای استنتاج مدل ثابت می ماند).

سهم کلیدی این پست ارائه یک مدل RGCN است که الگوریتم استنتاج استقرایی بلادرنگ را پیاده سازی می کند. میتوانید پیادهسازی RGCN ما را در نقطه پایانی SageMaker بهعنوان راهحل تشخیص تقلب بلادرنگ مستقر کنید. راهحل ما نیازی به ذخیرهسازی یا ارکستراسیون گراف خارجی ندارد و هزینه استقرار مدل RGCN را برای وظایف تشخیص تقلب بهطور قابلتوجهی کاهش میدهد. این مدل همچنین حالت استنتاج انتقالی را پیادهسازی میکند و ما را قادر میسازد آزمایشهایی را برای مقایسه عملکرد مدل در حالتهای استقرایی و انتقالی انجام دهیم. کد مدل و نوت بوک با آزمایش را می توان از نمونه های AWS مخزن GitHub.

این پست مبتنی بر پست است با استفاده از Amazon SageMaker، Amazon Neptune و Deep Graph یک راه حل تشخیص تقلب در زمان واقعی مبتنی بر GNN بسازید.. پست قبلی یک راه حل تشخیص تقلب در زمان واقعی مبتنی بر RGCN با استفاده از SageMaker ایجاد کرد. نپتون آمازون، و کتابخانه نمودار عمیق (DGL). راهحل قبلی از پایگاه داده نپتون به عنوان ذخیرهسازی گراف خارجی استفاده میکرد AWS لامبدا برای ارکستراسیون برای استنتاج بلادرنگ، و فقط شامل آزمایشهایی در حالت transductive بود.

مدل RGCN معرفی شده در این پست، تمام عملیات الگوریتم استنتاج استقرایی بلادرنگ را تنها با استفاده از DGL به عنوان یک وابستگی پیادهسازی میکند و برای استقرار نیازی به ذخیرهسازی گراف خارجی یا ارکستراسیون ندارد.

ما ابتدا عملکرد مدل RGCN را در حالتهای انتقالی و القایی بر روی یک مجموعه داده معیار ارزیابی میکنیم. همانطور که انتظار می رفت، عملکرد مدل در حالت القایی کمی کمتر از حالت انتقالی است. ما همچنین اثر فراپارامتر را مطالعه می کنیم k در عملکرد مدل هایپرپارامتر k تعداد پرش های انجام شده برای استخراج زیرگراف در مرحله 3 الگوریتم استنتاج بلادرنگ را کنترل می کند. مقادیر بالاتر از k زیرگرافهای بزرگتری تولید میکند و میتواند منجر به عملکرد استنتاج بهتر در ازای تأخیر بیشتر شود. به این ترتیب، ما همچنین آزمایشهای زمانبندی را برای ارزیابی امکانسنجی مدل RGCN برای یک کاربرد بلادرنگ انجام میدهیم.

مجموعه داده

ما با استفاده از مجموعه داده های تقلب IEEE-CIS، همان مجموعه داده ای که در قبلی استفاده شده بود پست. مجموعه داده شامل بیش از 590,000 رکورد تراکنش است که دارای برچسب تقلب باینری هستند ( isFraud ستون). داده ها به دو جدول تقسیم می شوند: تراکنش و هویت. با این حال، همه سوابق تراکنش دارای اطلاعات هویتی متناظر نیستند. ما دو جدول را به هم وصل می کنیم TransactionID ستون، که در مجموع 144,233 رکورد تراکنش را برای ما باقی می گذارد. ما جدول را بر اساس مُهر زمان تراکنش مرتب میکنیم (the TransactionDT ستون) و ایجاد یک تقسیم درصدی 80/20 بر حسب زمان، تولید 115,386 و 28,847 تراکنش برای آموزش و آزمایش، به ترتیب.

برای جزئیات بیشتر در مورد مجموعه داده و نحوه قالب بندی آن برای مطابقت با نیاز ورودی DGL، مراجعه کنید شناسایی تقلب در شبکه های ناهمگن با استفاده از Amazon SageMaker و Deep Graph Library.

ساخت نمودار

ما با استفاده از TransactionID ستون برای تولید گره های هدف. ما از ستون های زیر برای تولید 11 نوع گره غیر هدف استفاده می کنیم:

card1از طریقcard6ProductCDaddr1وaddr2P_emaildomainوR_emaildomain

ما از 38 ستون به عنوان ویژگی های دسته بندی گره های هدف استفاده می کنیم:

M1از طریقM9DeviceTypeوDeviceInfoid_12از طریقid_38

ما از 382 ستون به عنوان ویژگی های عددی گره های هدف استفاده می کنیم:

TransactionAmtdist1وdist2id_01از طریقid_11C1از طریقC14D1از طریقD15V1از طریقV339

نمودار ما ساخته شده از تراکنش های آموزشی شامل 217,935 گره و 2,653,878 یال است.

فراپارامترها

سایر پارامترها برای مطابقت با پارامترهای گزارش شده در قبلی تنظیم شده اند پست. قطعه زیر آموزش مدل RGCN را در حالت های انتقالی و القایی نشان می دهد:

حالت القایی در مقابل حالت انتقالی

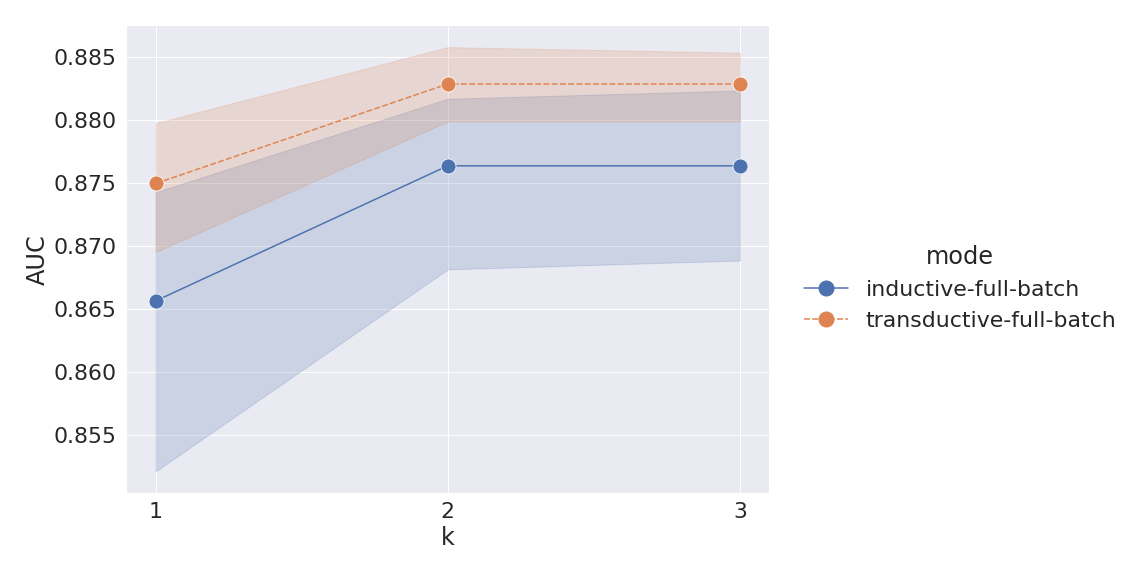

ما پنج آزمایش برای حالت استقرایی و پنج آزمایش برای حالت انتقالی انجام می دهیم. برای هر آزمایش، یک مدل RGCN را آموزش می دهیم و آن را روی دیسک ذخیره می کنیم و 10 مدل به دست می آوریم. ما هر مدل را بر روی نمونههای آزمایشی ارزیابی میکنیم در حالی که تعداد پرشها را افزایش میدهیم (پارامتر k) برای استخراج زیرگراف برای استنتاج، تنظیم استفاده می شود k به 1، 2، و 3. ما روی تمام نمونه های آزمایشی به طور همزمان پیش بینی می کنیم و امتیاز ROC AUC را برای هر آزمایش محاسبه می کنیم. نمودار زیر میانگین و فاصله اطمینان 95% نمرات AUC را نشان می دهد.

می بینیم که عملکرد در حالت انتقالی کمی بالاتر از حالت القایی است. برای k2 =، میانگین نمرات AUC برای حالت های القایی و انتقالی به ترتیب 0.876 و 0.883 است. این مورد انتظار است زیرا مدل RGCN میتواند جاسازیهای همه گرههای موجودیت را در حالت transductive، از جمله گرههای موجود در مجموعه آزمایشی، یاد بگیرد. در مقابل، حالت استقرایی فقط به مدل اجازه میدهد تا جاسازیهای گرههای موجود را که در مثالهای آموزشی وجود دارند، یاد بگیرد، و بنابراین برخی از گرهها باید در طول استنتاج با میانگین پر شوند. در عین حال، افت عملکرد بین حالت های انتقالی و القایی قابل توجه نیست و حتی در حالت القایی، مدل RGCN با AUC 0.876 به عملکرد خوبی دست می یابد. ما همچنین مشاهده می کنیم که عملکرد مدل برای مقادیر بهبود نمی یابد k> 2. این به معنای آن تنظیم است k=2 یک زیرگراف به اندازه کافی بزرگ را در طول استنتاج استخراج می کند که منجر به عملکرد بهینه می شود. این مشاهدات با آزمایش بعدی ما نیز تأیید می شود.

همچنین شایان ذکر است که برای حالت transductive، AUC مدل ما 0.883 بالاتر از AUC مربوطه 0.870 گزارش شده در قبلی است. پست. ما از ستونهای بیشتری به عنوان ویژگیهای عددی و دستهبندی گرههای هدف استفاده میکنیم که میتواند امتیاز AUC بالاتر را توضیح دهد. همچنین خاطرنشان میکنیم که آزمایشهای پست قبلی فقط یک آزمایش را انجام دادند.

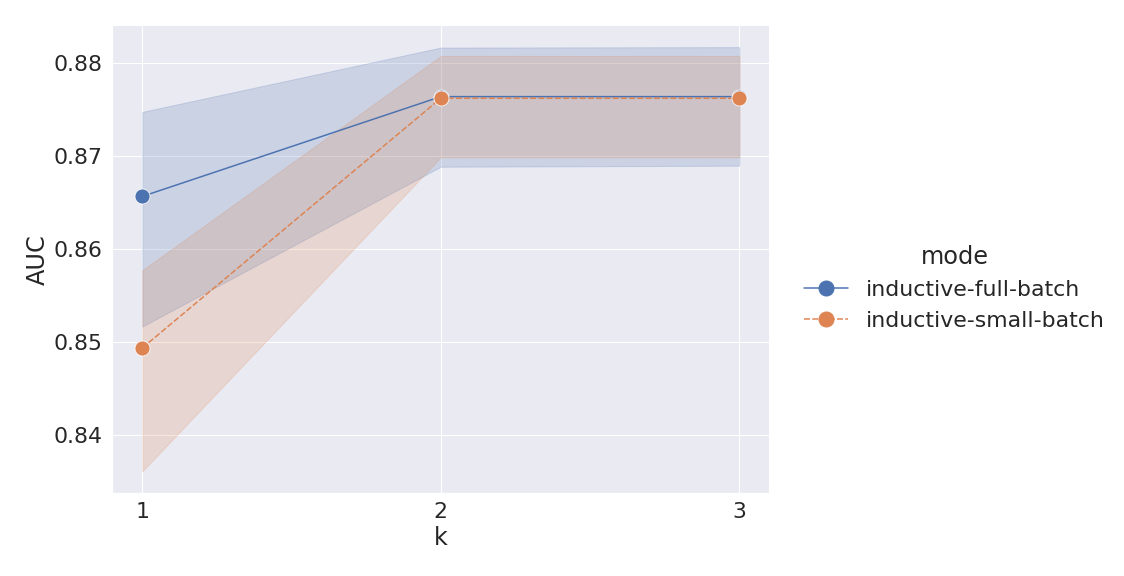

استنتاج در یک دسته کوچک

برای این آزمایش، مدل RGCN را در یک تنظیم استنتاج دستهای کوچک ارزیابی میکنیم. ما از پنج مدل استفاده می کنیم که در آزمایش قبلی در حالت استقرایی آموزش داده شده بودند. ما عملکرد این مدلها را هنگام پیشبینی در دو حالت مقایسه میکنیم: استنتاج دستهای کامل و کوچک. برای استنتاج دسته ای کامل، همانطور که در آزمایش قبلی انجام شد، کل مجموعه آزمایش را پیش بینی می کنیم. برای استنتاج دستهای کوچک، با تقسیم مجموعه آزمایشی به 28 دسته با اندازه مساوی با تقریباً 1,000 تراکنش در هر دسته، در دستههای کوچک پیشبینی میکنیم. ما امتیازات AUC را برای هر دو تنظیمات با استفاده از مقادیر مختلف محاسبه می کنیم k. نمودار زیر میانگین و فاصله اطمینان 95% را برای تنظیمات استنتاج دسته ای کامل و کوچک نشان می دهد.

ما آن عملکرد را برای استنتاج دستهای کوچک مشاهده میکنیم k=1 کمتر از دسته کامل است. با این حال، عملکرد استنتاج دستهای کوچک با دسته کامل مطابقت دارد k> 1. این را می توان به زیرگراف های بسیار کوچکتری نسبت داد که برای دسته های کوچک استخراج می شوند. ما این را با مقایسه اندازه های زیرگراف با اندازه کل نمودار ساخته شده از تراکنش های آموزشی تأیید می کنیم. ما اندازه گراف ها را از نظر تعداد گره ها با هم مقایسه می کنیم. برای k=1، متوسط اندازه زیرگراف برای استنتاج دستهای کوچک کمتر از 2% نمودار آموزشی است. و برای استنباط دسته ای کامل وقتی k=1، اندازه زیرگراف 22٪ است. چه زمانی k=2، اندازه زیرگراف برای استنتاج دستهای کوچک و کامل به ترتیب 54% و 64% است. در نهایت، اندازه زیرگراف برای هر دو تنظیمات استنتاج به 100٪ می رسد k=3. به عبارت دیگر، زمانی که k>1، زیرگراف برای یک دسته کوچک به اندازه کافی بزرگ می شود و استنتاج دسته کوچک را قادر می سازد به همان عملکرد استنتاج دسته ای کامل برسد.

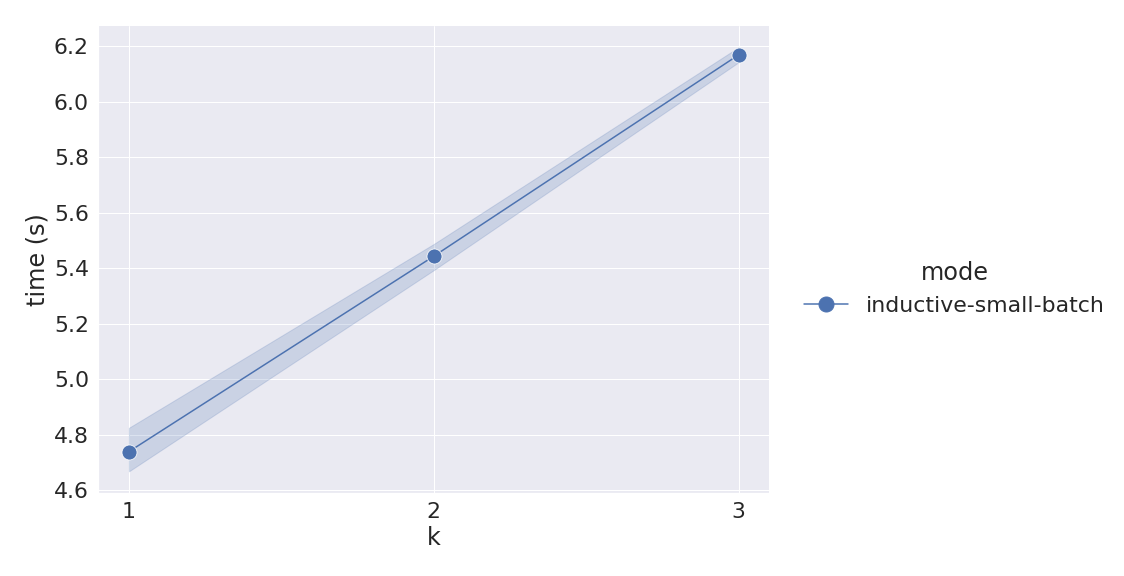

ما همچنین تأخیر پیشبینی را برای هر دسته ثبت میکنیم. ما آزمایشهای خود را روی یک نمونه ml.r5.12xlarge انجام میدهیم، اما میتوانید از نمونه کوچکتر با حافظه 64 G برای اجرای همان آزمایشها استفاده کنید. نمودار زیر میانگین و فاصله اطمینان 95% تاخیرهای پیشبینی دستهای کوچک را برای مقادیر مختلف نشان میدهد. k.

تأخیر شامل هر پنج مرحله الگوریتم استنتاج استقرایی بلادرنگ است. ما می بینیم که وقتی k=2، پیشبینی 1,030 تراکنش به طور متوسط 5.4 ثانیه طول میکشد که منجر به خروجی 190 تراکنش در ثانیه میشود. این تأیید می کند که پیاده سازی مدل RGCN برای تشخیص تقلب در زمان واقعی مناسب است. ما همچنین توجه داشته باشید که قبلی پست مقادیر تأخیر سختی را برای اجرای آنها ارائه نکردند.

نتیجه

مدل RGCN منتشر شده با این پست، الگوریتم را برای استنتاج استقرایی بلادرنگ پیادهسازی میکند و نیازی به ذخیرهسازی یا ارکستراسیون نمودار خارجی ندارد. پارامتر k در مرحله 3 الگوریتم تعداد جهشهای انجام شده برای استخراج زیرگراف برای استنتاج را مشخص میکند و منجر به یک مبادله بین دقت مدل و تأخیر پیشبینی میشود. ما استفاده کردیم مجموعه داده های تقلب IEEE-CIS در آزمایشات ما، و به طور تجربی آن مقدار بهینه پارامتر را تأیید کرد k برای این مجموعه داده 2 است که به امتیاز AUC 0.876 و تأخیر پیشبینی کمتر از 6 ثانیه در هر 1,000 تراکنش میرسد.

این پست یک فرآیند گام به گام برای آموزش و ارزیابی یک مدل RGCN برای کشف تقلب در زمان واقعی ارائه می دهد. کلاس مدل شامل روشهایی را برای کل چرخه عمر مدل، از جمله روشهای سریالسازی و سریالسازی، پیادهسازی میکند. این مدل را قادر می سازد تا برای کشف تقلب در زمان واقعی استفاده شود. می توانید مدل را به عنوان تخمینگر PyTorch SageMaker آموزش دهید و سپس با استفاده از موارد زیر آن را در نقطه پایانی SageMaker مستقر کنید. دفتر یادداشت به عنوان یک الگو نقطه پایانی قادر به پیشبینی تقلب در دستههای کوچک تراکنشهای خام در زمان واقعی است. همچنین می توانید استفاده کنید توصیه کننده استنباط آمازون SageMaker برای انتخاب بهترین نوع نمونه و پیکربندی برای نقطه پایانی استنتاج بر اساس حجم کاری شما.

برای اطلاعات بیشتر در مورد این موضوع و پیاده سازی، ما شما را تشویق می کنیم که اسکریپت های ما را به تنهایی بررسی و آزمایش کنید. می توانید به دفترچه یادداشت ها و کد کلاس مدل مربوطه از آدرس دسترسی داشته باشید نمونه های AWS مخزن GitHub.

درباره نویسنده

دیمیتری بسپالوف یک دانشمند ارشد کاربردی در آزمایشگاه راه حل های یادگیری ماشین آمازون است، جایی که به مشتریان AWS در صنایع مختلف کمک می کند تا پذیرش هوش مصنوعی و ابر خود را تسریع کنند.

دیمیتری بسپالوف یک دانشمند ارشد کاربردی در آزمایشگاه راه حل های یادگیری ماشین آمازون است، جایی که به مشتریان AWS در صنایع مختلف کمک می کند تا پذیرش هوش مصنوعی و ابر خود را تسریع کنند.

رایان برند یک دانشمند کاربردی در آزمایشگاه راه حل های یادگیری ماشین آمازون است. او تجربه خاصی در استفاده از یادگیری ماشینی برای مشکلات در مراقبت های بهداشتی و علوم زندگی دارد. در اوقات فراغت از خواندن تاریخ و داستان های علمی تخیلی لذت می برد.

رایان برند یک دانشمند کاربردی در آزمایشگاه راه حل های یادگیری ماشین آمازون است. او تجربه خاصی در استفاده از یادگیری ماشینی برای مشکلات در مراقبت های بهداشتی و علوم زندگی دارد. در اوقات فراغت از خواندن تاریخ و داستان های علمی تخیلی لذت می برد.

یانجون چی مدیر ارشد علوم کاربردی در آزمایشگاه راه حل یادگیری ماشین آمازون است. او برای کمک به مشتریان AWS برای سرعت بخشیدن به هوش مصنوعی و پذیرش ابری خود، نوآوری می کند و از یادگیری ماشینی استفاده می کند.

یانجون چی مدیر ارشد علوم کاربردی در آزمایشگاه راه حل یادگیری ماشین آمازون است. او برای کمک به مشتریان AWS برای سرعت بخشیدن به هوش مصنوعی و پذیرش ابری خود، نوآوری می کند و از یادگیری ماشینی استفاده می کند.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- پلاتوبلاک چین. Web3 Metaverse Intelligence. دانش تقویت شده دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/build-a-gnn-based-real-time-fraud-detection-solution-using-the-deep-graph-library-without-using-external-graph-storage/

- 000

- 1

- 10

- 100

- 11

- 2%

- 28

- 7

- ٪۱۰۰

- a

- قادر

- درباره ما

- سو استفاده کردن

- شتاب دادن

- دسترسی

- قابل دسترسی است

- حساب

- دقت

- دستیابی به

- دستیابی به

- در میان

- فعالیت ها

- اضافه

- اضافه

- اضافی

- آدرس

- اتخاذ

- مزیت - فایده - سود - منفعت

- AI

- الگوریتم

- معرفی

- اجازه می دهد تا

- جایگزین

- آمازون

- آموزش ماشین آمازون

- نپتون آمازون

- آمازون SageMaker

- در میان

- و

- کاربرد

- برنامه های کاربردی

- اعمال می شود

- با استفاده از

- تقریبا

- صف

- اختصاص داده

- مرتبط است

- فرض

- افزوده شده

- میانگین

- AWS

- مستقر

- زیرا

- شود

- بودن

- محک

- معیار

- بهترین

- بهتر

- میان

- نام تجاری

- ساختن

- می سازد

- ساخته

- کسب و کار

- حمل

- موارد

- شانس

- تغییر دادن

- کلاس

- طبقه بندی

- ابر

- پذیرش ابر

- رمز

- ستون

- ستون ها

- ترکیب شده

- ترکیب

- مقايسه كردن

- مقایسه

- پیچیدگی

- محاسبه

- رفتار

- اعتماد به نفس

- پیکر بندی

- تکرار

- تایید شده

- متصل

- ثابت

- ساخت

- ساخت و ساز

- شامل

- کنتراست

- سهم

- گروه شاهد

- متناظر

- هزینه

- ایجاد

- ایجاد

- بسیار سخت

- مشتریان

- داده ها

- پایگاه داده

- مجموعه داده ها

- تصمیم

- عمیق

- به طور پیش فرض

- مشخص

- وابستگی

- گسترش

- استقرار

- گسترش

- جزئیات

- کشف

- دستگاه

- dgl

- DID

- مختلف

- بحث و تبادل نظر

- نمی کند

- قطره

- در طی

- هر

- تجارت الکترونیک

- اثر

- به طور موثر

- را قادر می سازد

- را قادر می سازد

- تشویق

- نقطه پایانی

- تضمین می کند

- تمام

- اشخاص

- موجودیت

- محیط

- به خصوص

- ارزیابی

- ارزیابی

- ارزیابی

- حتی

- هر

- مثال

- مثال ها

- انتظار می رود

- گران

- تجربه

- تجربه

- توضیح دهید

- اکتشاف

- گسترش

- خارجی

- عصاره

- امکانات

- داستان

- سرانجام

- مالی

- خدمات مالی

- نام خانوادگی

- پیروی

- به دنبال آن است

- قالب

- تقلب

- کشف تقلب

- جعلی

- رایگان

- از جانب

- کامل

- کاملا

- بازی

- تولید می کنند

- دریافت کنید

- GitHub

- خوب

- گراف

- بزرگ

- سخت

- بهداشت و درمان

- کمک

- کمک می کند

- بالاتر

- تاریخ

- چگونه

- چگونه

- اما

- HTML

- HTTPS

- شناسایی

- هویت

- غیر مجاز

- انجام

- پیاده سازی

- اجرای

- پیاده سازی می کند

- واردات

- مهم

- بهبود

- in

- در دیگر

- مشمول

- شامل

- از جمله

- افزایش

- لوازم

- اطلاعات

- ورودی

- نمونه

- معرفی

- معرفی می کند

- IP

- آدرس های IP

- IT

- پیوستن

- کلید

- شناخته شده

- آزمایشگاه

- برچسب

- برچسب ها

- بزرگ

- بزرگتر

- تاخیر

- رهبری

- یاد گرفتن

- یادگیری

- کتابخانه

- زندگی

- علوم زندگی

- wifecycwe

- احتمالا

- بار

- مکان

- به دنبال

- وفاداری

- برنامه وفاداری

- دستگاه

- فراگیری ماشین

- مدیر

- مسابقه

- معنی دار

- رسانه ها

- حافظه

- روش

- ML

- حالت

- مدل

- مدل

- حالت های

- بیش

- لازم

- نپتون

- شبکه

- شبکه

- شبکه های عصبی

- جدید

- بعد

- گره

- گره

- عدد

- تعداد

- مشاهده کردن

- بدست آوردن

- ONE

- آنلاین

- پرداخت آنلاین

- عمل

- عملیات

- بهینه

- تنظیم و ارکستراسیون

- دیگر

- بهتر از

- خود

- پانداها

- پارامتر

- پارامترهای

- گذشت

- مبلغ پرداختی

- درصد

- انجام

- کارایی

- انجام

- فاز

- تلفن

- فیزیکی

- افلاطون

- هوش داده افلاطون

- PlatoData

- محبوب

- پست

- پیش بینی

- پیش بینی

- پیش گویی

- در حال حاضر

- هدیه

- جلوگیری از

- قبلی

- قبلا

- مشکل

- مشکلات

- روند

- تولید کردن

- تولید

- برنامه

- وعده

- ارائه

- ارائه

- مارماهی

- Qi

- خام

- رسیدن به

- مطالعه

- واقعی

- دنیای واقعی

- زمان واقعی

- رکورد

- سوابق

- كاهش دادن

- را کاهش می دهد

- کاهش

- اشاره

- مربوط

- روابط

- روابط

- منتشر شد

- از بین بردن

- گزارش

- نشان دادن

- نمایندگی

- نیاز

- ضروری

- نیاز

- قابل احترام

- REST

- نتیجه

- نتایج

- برگشت

- دویدن

- رایان

- حکیم ساز

- استنباط SageMaker

- همان

- ذخیره

- سناریو

- علم

- داستان تخیلی علمی

- علوم

- دانشمند

- اسکریپت

- دوم

- ثانیه

- ارشد

- سرویس

- خدمات

- تنظیم

- محیط

- تنظیمات

- برپایی

- چند

- اشتراک گذاری

- نشان داده شده

- نشان می دهد

- قابل توجه

- به طور قابل توجهی

- تنها

- اندازه

- اندازه

- کوچک

- کوچکتر

- So

- آگاهی

- رسانه های اجتماعی

- راه حل

- مزایا

- برخی از

- خاص

- سرعت

- انشعاب

- تقسیم می کند

- گام

- مراحل

- متوقف کردن

- ذخیره سازی

- استراتژی ها

- ساختار

- مهاجرت تحصیلی

- زیرنویس

- زیرگرافها

- چنین

- کت و شلوار

- مناسب

- پشتیبانی

- مشکوک

- جدول

- گرفتن

- تصاحب

- طول می کشد

- هدف

- کار

- وظایف

- قالب

- قوانین و مقررات

- آزمون

- تست

- La

- نمودار

- شان

- در نتیجه

- از این رو

- از طریق

- توان

- زمان

- برچسب زمان

- زمان

- به

- هم

- موضوع

- جمع

- قطار

- آموزش دیده

- آموزش

- معامله

- معاملات

- درمان

- درختان

- محاکمه

- آزمایش های

- درست

- انواع

- نوعی

- us

- استفاده کنید

- کاربران

- معمولا

- تایید شده

- ارزش

- ارزشها

- از طريق

- که

- در حین

- وای فای

- اراده

- بدون

- کلمات

- با ارزش

- خواهد بود

- شما

- شما

- زفیرنت