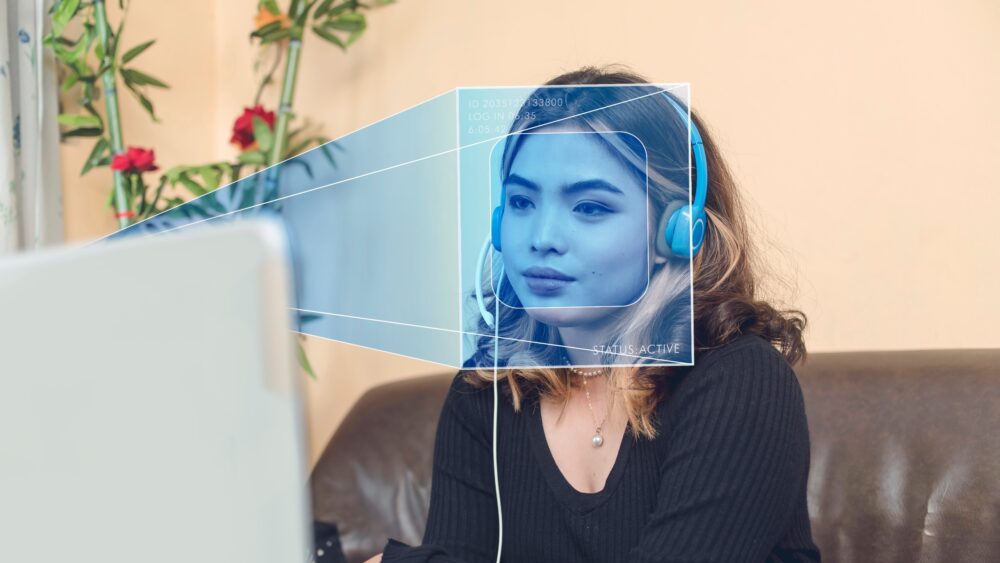

اگر این هفته در شبکه های اجتماعی بوده اید، احتمالاً با عکس هایی از تصاویر ساخته شده توسط هوش مصنوعی از دوستان خود به عنوان موجودات پری، شخصیت های انیمیشن، آواتارها و موجودات جادویی مواجه شده اید.

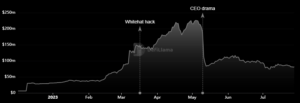

این تا حدی به خاطر لنسا است، یک هوش مصنوعی که پرتره های دیجیتال را بر اساس عکس هایی که کاربران آپلود می کنند ترکیب می کند. پرتره های این برنامه عملاً اینترنت را اشغال کرد و لنزا تبدیل به پربارترین برنامه در فروشگاه برنامه اپل شد.

Lensa، مانند همه برنامههای کاربردی هوش مصنوعی که تصاویر را بهصورت دیجیتالی ارائه میکنند، به دلیل جنسیسازی ظاهراً آشکار تصاویر زنانه، هم تحسین و هم بحثهایی را برانگیخته است. سایر کاربران خاطرنشان کردند که این برنامه پوست آنها را رنگ پریده یا بدن آنها را لاغرتر می کند.

همچنین بخوانید: فناوری هوش مصنوعی که تصاویر جعلی عمیق و ویرانگر ایجاد می کند

چگونه "آواتار جادویی" خود را بدست آوریم

تصاویری که این دور را انجام می دهند، ایجاد افتخارآمیز از عملکرد آواتارهای جادویی لنز است. برای درک آن، باید برنامه لنزا را روی گوشی دانلود کنید. اشتراک سالانه حدود 35.99 دلار است، اما اگر کسی بخواهد ابتدا آن را بررسی کند، خدمات آن نیز در دسترس است، البته با محدودیت هایی به صورت رایگان در یک هفته آزمایشی.

با این حال، تولید آواتارهای جادویی محبوب نیاز به هزینه اضافی دارد زیرا برنامه می گوید «قدرت محاسباتی فوق العاده» برای دستیابی به آن است.

در یک آزمایش رایگان، می توانید 50 آواتار را با قیمت 3.99 دلار و 200 آواتار را با قیمت 7.99 دلار دریافت کنید. برای به دست آوردن بهترین نتایج، این برنامه کاربران را تشویق می کند که حداقل 20 تصویر نزدیک آپلود کنند.

در حالت ایدهآل، این تصاویر باید نمای نزدیک از صورت فرد با مجموعهای از پسزمینهها، حالات چهره و زاویههای متفاوت باشد. این برنامه اصرار دارد که کاربران باید 13 سال و بالاتر باشند. Lensa یک برنامه کاملاً جدید نیست.

این اپلیکیشن که محصولی از Prisma است، برای اولین بار در سال 2016 به لطف عملکردی که به کاربران اجازه می داد سلفی های خود را به عکس هایی به سبک هنرمندان مشهور تغییر دهند، محبوب شد.

لنز چگونه کار می کند؟

به گفته این شرکت، از چیزی که آن را «فناوری TrueDepth API» مینامد استفاده میکند که در آن کاربر عکسها یا «دادههای چهره» را ارائه میکند، سپس هوش مصنوعی روی الگوریتمهای خود آموزش داده میشود تا عملکرد بهتری داشته باشد و نتایج بهتری به شما نشان دهد. آموزش زمانی است که هوش مصنوعی داده ها را پردازش می کند، مدل ها را تایید و آزمایش می کند.

برای استفاده از این اپلیکیشن میتوان 20 سلفی با عبارات و زوایای مختلف تهیه کرد و گزینه 100 آواتار را انتخاب کرد.

حدود 20 دقیقه طول می کشد تا کار انجام شود. پس از اتمام، هوش مصنوعی آواتارهایی را برمی گرداند که در 10 دسته قرار می گیرند مانند فانتزی، شاهزاده خانم پری، فوکوس، پاپ، شیک، انیمه، سبک، کاوایی، رنگین کمانی و کیهانی.

«به طور کلی، من احساس میکردم که این اپلیکیشن با تولید تصاویر هنری بر اساس سلفیهای من کار شایستهای انجام داده است. در بیشتر پرترهها نمیتوانستم خودم را کاملاً بشناسم، اما میتوانستم ببینم از کجا آمدهاند.» زوئی سوتیله CNN نوشت.

«به نظر میرسید که ویژگیهای خاصی مانند پوست رنگ پریده یا بینی گرد من را بیشتر از سایرین تشخیص داده و تکرار میکند. برخی از آنها به سبک واقعی تری بودند و به اندازه کافی نزدیک بودند، اگر از دور آنها را ببینم ممکن است فکر کنم در واقع عکس های من هستند. دیگران به طور قابل توجهی سبک تر و هنرمندانه تر بودند، بنابراین آنها کمتر به من احساس خاصی می کردند.

سوتیله متوجه شد که هوش مصنوعی او را سبک تر می کند.

در مورد من، من همچنین احساس کردم که به طور خودکار من را سبکتر میکند و تصویری که در گالریام از من و دوستی با پوست تیرهتر امتحان کردم، نسخهای بسیار روشنتر از ما را نشان داد، به وضوح اغراقآمیز بود، و تمایل به روشنتر شدن را نشان داد. رنگ پوست مشکی

جنسی کردن زنان

دیگرانی که از آن استفاده کردند نگرانی های کم و بیش مشابهی داشتند.

زنان می گویند هوش مصنوعی به سرعت تصاویر آنها را جنسی می کند. اما در مقاله قبلی ما توضیح داده شده این به دلیل تعداد زیادی از تصاویر جنسی موجود در مجموعه داده های مورد استفاده در آموزش هوش مصنوعی امکان پذیر شده است.

به عبارت دیگر، این بدان معنی است که هوش مصنوعی با نحوه تولید آن تصاویر و به راحتی پورنوگرافی آشنا است. با کمی حیله، می توان از آن خواست که در صورت تمایل کاربر، ناخواسته از آن تصاویر نیز پورن تولید کند.

جنسی کردن زن جوانی که بیشتر وقت خود را با پوشیدن لباسهای گشاد در معرض دید عموم صرف میکرد تا از این نوع جنسیسازی جلوگیری کند. منع مردان از استفاده از هوش مصنوعی https://t.co/YnNCurvYDS

- ژان آو آرک اما یک کمدی (@postnuclearjoan) دسامبر 13، 2022

در داستانهای دیگر، توضیح دادهایم که چگونه AI:s را میتوان فریب داد و اطلاعاتی در مورد نحوه ساختن ارائه میدهد بمب برای مثال. به طرز عجیبی، موضوع جنسیت در تصاویر مردانی که در ویژگی آواتار جادویی آپلود شده بودند ظاهر نشد. برای بررسی فناوری MIT، ملیسا هیکیلا نوشت,

آواتارهای من به صورت کارتونی مستهجن شده بودند، در حالی که همکاران مرد من فضانورد، کاشف و مخترع بودند.

از سوی دیگر، سوتیله متوجه شد که هوش مصنوعی «در یکی از گیجکنندهترین عکسها» او را «مانند صورت من روی بدن برهنه» نشان داده است.

او گفت: «در چندین عکس، به نظر میرسید که من برهنه هستم، اما با پتویی که به صورت استراتژیک قرار گرفتهام، یا تصویر فقط برای پنهان کردن هر چیز واضحی بریده شده است.

زوئی سوتیله میافزاید: «و بسیاری از تصاویر، حتی در جایی که من کاملاً لباس پوشیده بودم، دارای حالت چهرهای خشن، دکلرههای چشمگیر و لباسهای ضعیف بودند که با عکسهایی که من ارسال کرده بودم مطابقت نداشت.»

برخی دیگر ابراز نگرانی کردند که با فناوری هوش مصنوعی مانند لنز تبدیل به ستاره های پورنو شوند.

هشدار: هر کسی در جهان می تواند پورن غیر توافقی شما را در حال حاضر داشته باشد!!

مردم از ابزارهای مولد هوش مصنوعی مانند Lensa بدون درک عواقب وخیم آن می ترسند.

🧵 بدترین قسمت؟ در اینجا چیزی است که شرکت ها نمی خواهند شما بدانید: pic.twitter.com/gdS0h1FbXj

— کریتارث میتال | Ghostwriter 🖋️ (@kritarthmittal) دسامبر 14، 2022

بدبختی بدن

برای زنان با بدن کامل، تجربه تا حدودی متفاوت و در برخی موارد حتی بدتر بود. هوش مصنوعی آنها را لاغرتر و جذاب تر کرد.

برای Lmfao اگر به Body Dysmorphia مبتلا هستید، از برنامه Lensa برای عکسهای تولید شده توسط هوش مصنوعی استفاده نکنید. این اخطار شماست» یک کاربر نوشت.

دیگری گفت که این برنامه او را آسیایی کرده است.

برنامه AI Lensa را امتحان کرد. به من بگویید چرا هوش مصنوعی باعث شد آسیایی تر از همیشه به نظر برسم؟ 😂😂😂😂 pic.twitter.com/lveJNXaXHO

— کریستینا🌴🌊🐚 (@kut1e) دسامبر 9، 2022

کاربر دیگری در توییتر شکایت کرد که هنگام استفاده از هوش مصنوعی 8 دلار برای تجربه بدشکلی بدن پرداخت کرده است.

8 دلار به لنز پرداخت کرد تا بدشکلی بدن را تجربه کند pic.twitter.com/NRYfh5Jyej

- گرت (@dollhaus_x) دسامبر 3، 2022

بدشکلی بدن یک وضعیت سلامت روان است که در آن فرد زمان زیادی را صرف نگرانی در مورد نقص های ظاهری خود می کند. این نقص ها اغلب برای دیگران قابل توجه نیست.

دیگری شکایت کرد که هوش مصنوعی به طور خودکار وزن قابل توجهی را روی تصاویر کامل او کاهش می دهد.

«یک شکایتی که از هوش مصنوعی لنز دارم این است که در برخی از تصاویر شما را لاغر می کند. به عنوان یک فرد چاق، این تصاویر واقعاً من را آزار می داد. بنابراین مراقب باشید که اگر یک هموطن چاق هستید و علاقه ای به لاغر شدن ندارید تحریک نشوید،» ماریا موفق (@Shlatz) در 5 دسامبر 2022 نوشت.

بمب ساعتی روانی

و روانشناسان با اظهارات او موافقند که هوش مصنوعی می تواند زنان کاملاً مشخص را تحریک کند.

روانشناس بالینی، دکتر. تونی پیکوسیک متخصص سلامت روان استرالیایی که در مورد اختلال بدشکلی بدن تحقیق میکند و متخصص در درمان اختلال بدشکلی بدن است، معتقد است که این برنامه میتواند بیشتر از اینکه مفید باشد ضرر داشته باشد و چیزی جز یک "ابزار فیلتر کردن عکس" برای تغییر ادراک فرد از خود نیست.

پیکووس میگوید: «زمانی که اختلاف بیشتری بین ظاهر ایدهآل و تصور شده وجود داشته باشد، میتواند نارضایتی، پریشانی و تمایل به اصلاح یا تغییر ظاهر خود را با وسایل بالقوه ناسالم یا ناایمن» مانند اختلال در غذا خوردن یا عملهای زیبایی غیرضروری افزایش دهد.

او از پاک شدن تصاویر "جزئیات پیچیده" مانند "لک و خطوط" ابراز نگرانی کرد، چیزی که می تواند نگرانی در مورد پوست فرد را افزایش دهد. او میگوید این امر همچنین میتواند از نظر روانی باعث تحریک یک فرد آسیبپذیر شود.

«دیدن یک تصویر خارجی که ناامنی آنها را به آنها منعکس می کند، فقط این ایده را تقویت می کند که ببینید، این با من اشتباه است! و من تنها کسی نیستم که میتوانم آن را ببینم!» پیکوس میگوید.

او می گوید با توجه به این واقعیت که هوش مصنوعی ویژگی های خود را معرفی می کند که ظاهر واقعی یک کاربر را به تصویر نمی کشد، این برنامه می تواند نگرانی های جدیدی ایجاد کند.

او میگوید که «آواتارهای جادویی» هوش مصنوعی «بهویژه جالب بودند، زیرا عینیتر به نظر میرسند – گویی که یک موجود خارجی و دانا، این تصویر را از آنچه شما شبیه به نظر میبینید ایجاد کرده است».

این، او احساس میکند در واقع برای افراد مبتلا به اختلال بدشکلی بدن «مفید» خواهد بود و به روشن کردن «عدم تطابق» بین «نگرش منفی فرد نسبت به خود و نحوهی دید دیگران» کمک میکند.

با این حال، او خاطرنشان کرد که هوش مصنوعی به دلیل تلاش برای به تصویر کشیدن یک «نسخه پیشرفته و کاملتر» از چهره فرد، عینی نبود.

به عنوان مثال، فردی که اختلال بدشکلی بدن یا BDD را تجربه می کند، "ممکن است وقتی تصویر خود را مشاهده می کند، اعتماد به نفس مختصری را تجربه کند و بخواهد این نسخه از خود را با جهان به اشتراک بگذارد"، او می گوید، اما در صورت خاموش بودن به سختی از واقعیت آسیب می بیند. صفحه نمایش، بدون فیلتر، در آینه یا عکسی که از خودشان می گیرند.»

دفاع از خودش

Andrey Usoltsev، مدیر عامل شرکت Prisma Labs، میگوید که شرکت او در حال حاضر با پرسشهایی درباره Lensa "غرق" شده است و پیوندی به صفحه پرسشهای متداول ارائه میدهد که به سوالات مربوط به تصاویر جنسی جنسی میپردازد، البته نه به نوع واکنشهای کاربر که پیکوس توصیف میکند.

«مشاهده انعکاس این موضوع در برنامه بسیار چالش برانگیز خواهد بود و نوعی «تأیید» برای دیدگاهی که آنها نسبت به خود دارند ارائه میکند و باعث میشود که «بیشتر در این اختلال ریشهدار شوند».

انتشار پایدار

Lensa همچنین از Stable Diffusion استفاده میکند که از ترکیب یادگیری عمیق استفاده میکند که میتواند تصاویر جدیدی را از توضیحات متن ایجاد کند و میتواند بر روی رایانه شخصی ویندوز یا لینوکس، روی Mac یا در فضای ابری روی سختافزار رایانه اجارهای اجرا شود.

شبکه عصبی Stable Diffusion با کمک یادگیری فشرده در ارتباط کلمات و ارتباط آماری کلی بین موقعیت پیکسل ها در تصاویر تسلط یافته است.

در دیگری پوشش دادیم داستان چگونه این فناوری میتواند عواقب ویرانکنندهای را با ارائه و به تصویر کشیدن تصاویری از افراد بهگونهای که به نظر مجرم هستند یا درگیر اعمالی کمتر از چاپلوس مانند دزدی باشد، داشته باشد.

به عنوان مثال، میتوان به Stable Diffusion منبع باز دستور داد، مانند «تام هنکس در کلاس درس»، و تصویر جدیدی از تام هنکس در کلاس درس به او میدهد. در مورد تام هنک، پیادهروی در پارک است، زیرا صدها عکس او قبلاً در مجموعه دادههای مورد استفاده برای آموزش Stable Diffusion هستند.

هنرمندان نیز معامله خام می گیرند

در عرصه هنر، برخی از هنرمندان ناراضی هستند.

آنها نگران هستند که هوش مصنوعی معیشت آنها را تهدید کند. این به این دلیل است که هنرمندان، از جمله هنرمندان دیجیتال، نمی توانند به سرعت هوش مصنوعی برای یک پرتره دیجیتال تولید کنند.

من اینها را به دلایل حفظ حریم خصوصی حذف میکنم/چون سعی نمیکنم کسی را صدا کنم. اینها همه پرتره های لنسا هستند که بقایای درهم ریخته امضای یک هنرمند هنوز قابل مشاهده است. این بقایای امضای یکی از هنرمندان متعددی است که از آنها دزدیده است.

یک 🧵 https://t.co/0lS4WHmQfW pic.twitter.com/7GfDXZ22s1

- لورین ایپسوم (@LaurynIpsum) دسامبر 6، 2022

شرکت مادر لنز، پریسما، تلاش کرده است تا نگرانیهای مربوط به فناوری خود را که کار هنرمندان دیجیتال را حذف میکند، برطرف کند.

"در حالی که هم انسان و هم هوش مصنوعی در مورد سبک های هنری به روش های نیمه مشابه یاد می گیرند، تفاوت های اساسی وجود دارد: هوش مصنوعی قادر است به سرعت تجزیه و تحلیل کند و از مجموعه های بزرگی از داده ها یاد بگیرد، اما سطح توجه و قدردانی از هنر را ندارد. به عنوان یک انسان،” نوشت این شرکت در توییتر در تاریخ 6 دسامبر.

میگوید «خروجیها را نمیتوان بهعنوان کپی دقیق هر اثر هنری خاصی توصیف کرد».

آیا این هنر تولید شده توسط هوش مصنوعی است یا هنر کپی شده با هوش مصنوعی؟ آیا هوش مصنوعی لنز از هنر انسان دزدی می کند؟ یک کارشناس این بحث را توضیح می دهد https://t.co/cxi2t6URC7 pic.twitter.com/20xJgbHZgA

— جان چپمن (@JChapman1729) دسامبر 15، 2022

تغییر تصویر از خود

کری بومن، یک متخصص اخلاق زیستی در دانشگاه تورنتو، میگوید که هوش مصنوعی این پتانسیل را دارد که در کنار سایر مسائل اخلاقی، بر تصویر فرد از خود تأثیر منفی بگذارد.

بومن روز دوشنبه گفت: "از برخی جهات، می تواند بسیار سرگرم کننده باشد، اما این تصاویر ایده آل شده توسط انتظارات اجتماعی هدایت می شوند که می توانند بسیار بی رحمانه و بسیار محدود باشند."

بومن گفت این برنامه های هوش مصنوعی از منابع مجموعه داده مانند اینترنت در جستجوی سبک های هنری مختلف برای ایجاد این پرتره ها استفاده می کنند. نکته منفی این است که وقتی هوش مصنوعی این کار را انجام می دهد، هنرمندان به ندرت برای استفاده از کارشان پاداش مالی دریافت می کنند یا اعتباری دریافت می کنند.

«آنچه با هوش مصنوعی در حال ظهور اتفاق میافتد این است که قوانین واقعاً نتوانستهاند از نظر قانون کپیرایت با این موضوع مطابقت داشته باشند. این بسیار دشوار است و بسیار مبهم است و اصول اخلاقی حتی از قوانین عقب تر است زیرا من استدلال می کنم که این اساساً ناعادلانه است.

نگرانی های مربوط به داده های شخصی

بومن همچنین نگرانی هایی را مطرح کرد که چگونه داده های شخصی افراد ذخیره می شود.

آیا واقعاً می خواهید چهره خود در یک پایگاه داده بزرگ باشد؟ مردم باید خودشان در این مورد تصمیم بگیرند، اما این خوش خیم نیست، هیچ چیزی در این مورد وجود ندارد، این فقط سرگرم کننده نیست.»

Lensa می گوید که عکس ها بیش از 24 ساعت در سرورها و برنامه ها نگهداری نمی شوند. با یادگیری عمیق و الگوریتمهای یادگیری ماشین، هوش مصنوعی جمعآوری میکند و سپس نتایج بهتری را در آینده ارائه میکند، همچنین بر اساس دادههای حذف شده. بومن میگوید که این منجر به نگرانیهای ایمنی در مورد استفاده بالقوه از تشخیص چهره خواهد شد، زیرا پلیس میتواند از این نوع دادهها بهطور غیرقانونی استفاده کند.

- AI

- آلبرایت استون بریج

- مخالف تشکیل یا اتحادیههای بزرگ صنایع

- باراک اوباما

- بیت کوین

- بلاکچین

- انطباق با بلاک چین

- کالیفرنیا

- چین

- coinbase

- coingenius

- اجماع

- کنفرانس رمزنگاری

- معدنکاری رمز گشایی

- کریپتو کارنسی (رمز ارزها )

- مدیر فضای مجازی چین

- غیر متمرکز

- deepfakes

- DEFI

- دارایی های دیجیتال

- دونالد مغلوب ساختن پیشی جستن

- ethereum

- فیس بوک

- فراگیری ماشین

- متانیوز

- رمز غیر قابل شستشو

- پل تریولو

- افلاطون

- افلاطون آی

- هوش داده افلاطون

- PlatoData

- بازی پلاتو

- چند ضلعی

- اثبات سهام

- تنظیم

- مقررات

- پیشرفته

- W3

- xi jinping

- زفیرنت