به منظور به اشتراک گذاشتن جادوی DALL E 2 با مخاطبان گسترده، ما باید خطرات مرتبط با مدل های قدرتمند تولید تصویر را کاهش دهیم. برای این منظور، ما مختلف قرار داده است محافظ در محل برای جلوگیری از نقض تصاویر تولید شده ما خط مشی محتوا. این پست بر روی کاهش پیش از آموزش، زیرمجموعه ای از این نرده های محافظ که مستقیماً داده هایی را که DALL·E 2 از آنها می آموزد تغییر می دهد. به طور خاص، DALL·E 2 بر روی صدها میلیون تصویر زیرنویس شده از اینترنت آموزش داده شده است، و ما برخی از این تصاویر را حذف و وزن مجدد می کنیم تا آنچه را که مدل می آموزد تغییر دهیم.

این پست در سه بخش سازماندهی شده است که هر کدام یک کاهش پیش از آموزش متفاوت را توضیح می دهد:

- در بخش اول، نحوه فیلتر کردن تصاویر خشونت آمیز و جنسی از مجموعه داده آموزشی DALL·E 2 را توضیح می دهیم. بدون این کاهش، مدل یاد میگیرد که در صورت درخواست، تصاویر گرافیکی یا واضح تولید کند و حتی ممکن است چنین تصاویری را ناخواسته در پاسخ به درخواستهای به ظاهر بیضرر بازگرداند.

- در بخش دوم، متوجه میشویم که فیلتر کردن دادههای آموزشی میتواند سوگیریها را تقویت کند، و تکنیک ما را برای کاهش این اثر توصیف میکنیم. برای مثال، بدون این کاهش، ما متوجه شدیم که مدلهایی که بر روی دادههای فیلتر شده آموزش دیدهاند، در مقایسه با مدلهایی که بر روی مجموعه داده اصلی آموزش داده شدهاند، گاهی تصاویر بیشتری را تولید میکنند که مردان را به تصویر میکشد و تصاویر کمتری را که زنان را به تصویر میکشد.

- در بخش آخر، به موضوع حفظ کردن می پردازیم، و متوجه می شویم که مدل هایی مانند DALL·E 2 گاهی اوقات می توانند تصاویری را که روی آنها آموزش دیده اند به جای ایجاد تصاویر بدیع، بازتولید کنند. در عمل متوجه شدیم که این بازگشت تصویر توسط تصاویری ایجاد می شود که بارها در مجموعه داده تکرار می شوند و با حذف تصاویری که از نظر بصری مشابه سایر تصاویر در مجموعه داده هستند، مشکل را کاهش می دهد.

کاهش داده های آموزشی گرافیکی و صریح

از آنجایی که داده های آموزشی قابلیت های هر مدل آموخته شده را شکل می دهد، فیلتر کردن داده ها ابزار قدرتمندی برای محدود کردن قابلیت های مدل نامطلوب است. ما قبل از آموزش DALL·E 2 این دستهبندیکنندههای تصویر را با استفاده از طبقهبندیکنندهها برای فیلتر کردن تصاویر در این دستهها از مجموعه دادهها در دو دسته - تصاویری که خشونت گرافیکی و محتوای جنسی را به تصویر میکشند، اعمال کردیم. اثرات فیلتر مجموعه داده بر مدل آموزش دیده ما

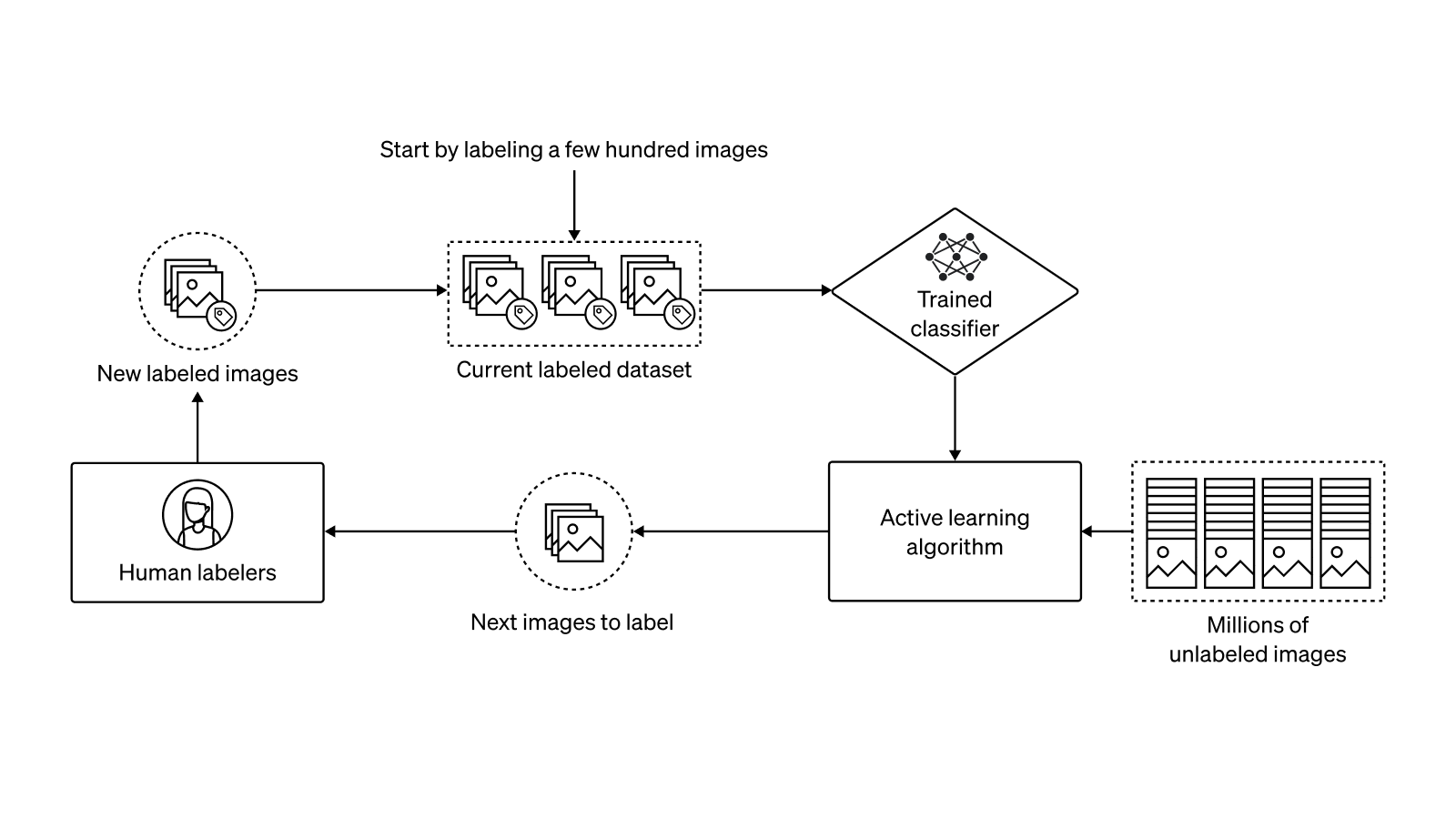

برای آموزش طبقهبندیکنندههای تصویر، از رویکردی که قبلاً برای فیلتر کردن دادههای آموزشی استفاده کرده بودیم، دوباره استفاده کردیم. گلیم. مراحل اساسی این رویکرد به شرح زیر است: ابتدا، ما یک مشخصات برای دستههای تصویری که میخواهیم برچسبگذاری کنیم، ایجاد میکنیم. دوم، ما چند صد مثال مثبت و منفی برای هر دسته جمع آوری می کنیم. سوم، ما از یک روش یادگیری فعال برای جمعآوری دادههای بیشتر و بهبود مبادله دقت/یادآوری استفاده میکنیم. و در نهایت، طبقهبندیکننده بهدستآمده را بر روی کل مجموعه داده با آستانه طبقهبندی محافظهکارانه اجرا میکنیم تا یادآوری را به دقت ترجیح دهیم. برای تنظیم این آستانه ها، فیلتر کردن همه موارد را در اولویت قرار دادیم بد داده های بیش از خروج در همه خوب داده ها. این به این دلیل است که ما همیشه میتوانیم مدل خود را با دادههای بیشتری بعداً تنظیم کنیم تا چیزهای جدیدی به آن آموزش دهیم، اما بسیار سختتر است که مدل چیزی را که قبلاً آموخته را فراموش کند.

در طول مرحله یادگیری فعال، ما مرتباً طبقهبندیکنندههای خود را با جمعآوری برچسبهای انسانی برای تصاویر بالقوه دشوار یا طبقهبندی اشتباه بهبود دادیم. قابل ذکر است، ما از دو تکنیک یادگیری فعال برای انتخاب تصاویر از مجموعه داده خود (که شامل صدها میلیون تصویر بدون برچسب است) برای ارائه به انسان برای برچسبگذاری استفاده کردیم. اول، برای کاهش نرخ مثبت کاذب طبقهبندیکننده ما (یعنی فرکانس طبقهبندی اشتباه یک تصویر خوشخیم به عنوان خشونت یا جنسی)، برچسبهای انسانی را به تصاویری که مدل فعلی آنها را به عنوان مثبت طبقهبندی میکند اختصاص دادیم. برای اینکه این مرحله به خوبی کار کند، آستانه طبقهبندی خود را برای فراخوانی نزدیک به 100% تنظیم کردیم، اما نرخ مثبت کاذب بالایی داشت. به این ترتیب، برچسبزنان ما بیشتر موارد واقعاً منفی را برچسبگذاری میکردند. در حالی که این تکنیک به کاهش موارد مثبت کاذب کمک میکند و نیاز برچسبزنها به نگاه کردن به تصاویر بالقوه مضر را کاهش میدهد، اما به یافتن موارد مثبت بیشتری که مدل در حال حاضر گم شده است کمکی نمیکند.

برای کاهش نرخ منفی کاذب طبقهبندیکننده، از دومین تکنیک یادگیری فعال استفاده کردیم: جستجوی نزدیکترین همسایه. بهویژه، ما اعتبارسنجی متقاطع چند برابری را برای یافتن نمونههای مثبت در مجموعه دادههای برچسبگذاریشده فعلی خود اجرا کردیم که مدل تمایل داشت آنها را به اشتباه بهعنوان منفی طبقهبندی کند (برای انجام این کار، به معنای واقعی کلمه صدها نسخه از طبقهبندیکننده را با تقسیمبندیهای مختلف تأیید قطار آموزش دادیم). سپس مجموعه بزرگی از تصاویر بدون برچسب خود را برای نزدیکترین همسایگان این نمونه ها در یک فضای ویژگی ادراکی اسکن کردیم و برچسب های انسانی را به تصاویر کشف شده اختصاص دادیم. به لطف زیرساخت محاسباتی ما، افزایش مقیاس آموزش طبقهبندیکننده و جستجوی نزدیکترین همسایه به بسیاری از GPUها امری بیاهمیت بود، که اجازه میداد مرحله یادگیری فعال در طی چند دقیقه به جای ساعتها یا روزها انجام شود.

برای تأیید اثربخشی فیلترهای داده خود، دو مدل GLIDE را با فراپارامترهای یکسان آموزش دادیم: یکی روی دادههای فیلتر نشده و دیگری روی مجموعه داده پس از فیلتر کردن. ما به مدل قبلی به عنوان مدل بدون فیلتر، و دومی به عنوان مدل فیلتر شده. همانطور که انتظار میرفت، متوجه شدیم که مدل بدون فیلتر معمولاً در پاسخ به درخواستهای این نوع محتوا، محتوای واضح یا گرافیکی کمتری تولید میکند. با این حال، ما همچنین یک اثر جانبی غیرمنتظره از فیلتر کردن دادهها پیدا کردیم: این فیلتر تعصبات مدل را نسبت به جمعیتشناسی خاص ایجاد یا تقویت کرد.

رفع تعصب معرفی شده توسط فیلترهای داده

مدلهای تولیدی تلاش میکنند توزیع دادههای آموزشی خود را، از جمله هرگونه سوگیری در آن، مطابقت دهند. در نتیجه، فیلتر کردن دادههای آموزشی پتانسیل ایجاد یا تقویت سوگیریها را در مدلهای پاییندستی دارد. به طور کلی، رفع سوگیری ها در مجموعه داده اصلی یک کار اجتماعی و فنی دشوار است که ما به مطالعه آن ادامه می دهیم و خارج از محدوده این پست است. مشکلی که در اینجا به آن می پردازیم، تقویت سوگیری هایی است که به طور خاص توسط خود فیلتر داده ایجاد می شود. با رویکرد خود، هدف ما جلوگیری از وجود مدل فیلتر شده است بیش مغرضانه نسبت به مدل بدون فیلتر، اساساً تغییر توزیع ناشی از فیلتر کردن داده ها را کاهش می دهد.

به عنوان یک مثال عینی از تقویت بایاس به دلیل فیلتر کردن، اعلان "یک مدیر عامل" را در نظر بگیرید. هنگامی که مدل فیلتر نشده ما تصاویری را برای این درخواست تولید کرد، تمایل داشت تصاویر بیشتری از مردان نسبت به زنان تولید کند، و ما انتظار داریم که بیشتر این سوگیری بازتاب دادههای آموزشی فعلی ما باشد. با این حال، هنگامی که ما همان درخواست را از طریق مدل فیلتر شده خود اجرا کردیم، به نظر می رسد که تعصب تقویت شده است. نسلها تقریباً منحصراً تصاویری از مردان بودند.

ما فرض میکنیم که این مورد خاص از تقویت سوگیری از دو مکان سرچشمه میگیرد: اول، حتی اگر زنان و مردان در مجموعه دادههای اصلی بازنمایی تقریباً برابری داشته باشند، مجموعه دادهها ممکن است به سمت ارائه زنان در زمینههای جنسی بیشتر سوگیری کند. و دوم، خود طبقهبندیکنندههای ما ممکن است به دلیل پیادهسازی یا تعریف کلاس، سوگیری داشته باشند، علیرغم تلاشهای ما برای اطمینان از این که در طول مراحل جمعآوری و اعتبارسنجی دادهها اینطور نبوده است. به دلیل هر دوی این اثرات، فیلتر ما ممکن است تصاویر بیشتری از زنان را نسبت به مردان حذف کند، که نسبت جنسیتی را که مدل در تمرین مشاهده میکند تغییر میدهد.

برای بررسی دقیقتر سوگیری ناشی از فیلتر، میخواهیم راهی برای اندازهگیری میزان تأثیر فیلترهای داده ما بر تعصب نسبت به مفاهیم مختلف داشته باشیم. قابل توجه است که فیلترهای خشونت و محتوای جنسی ما صرفاً مبتنی بر تصویر هستند، اما ماهیت چندوجهی مجموعه داده ما به ما اجازه میدهد تا تأثیرات این فیلترها را بر روی متن به طور مستقیم اندازهگیری کنیم. از آنجایی که هر تصویر همراه با یک عنوان متنی است، ما توانستیم به فراوانی نسبی کلمات کلیدی انتخابشده دستی در مجموعه دادههای فیلتر شده و فیلتر نشده نگاه کنیم تا تخمین بزنیم که فیلترها چقدر بر هر مفهومی تأثیر میگذارند.

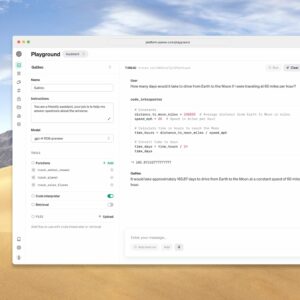

To put this into practice, we used Apache Spark to compute the frequencies of a handful of keywords (e.g., "parent", “woman”, “kid”) over all of the captions in both our filtered and unfiltered datasets. Even though our dataset contains hundreds of millions of text-image pairs, computing these keyword frequencies only took a few minutes using our compute cluster.

پس از محاسبه فراوانی کلمات کلیدی، ما توانستیم تأیید کنیم که فیلترهای مجموعه ما در واقع فرکانس کلمات کلیدی خاص را بیش از سایرین منحرف کرده است. به عنوان مثال، فیلترها فرکانس کلمه "زن" را 14٪ کاهش دادند در حالی که فراوانی کلمه "مرد" تنها 6٪ کاهش یافت. این امر در مقیاس بزرگ آنچه را که قبلاً با نمونهگیری از مدلهای GLIDE آموزشدیده شده بر روی هر دو مجموعه داده مشاهده کرده بودیم، تأیید کرد.

اکنون که ما یک پروکسی برای اندازه گیری سوگیری ناشی از فیلتر داشتیم، به راهی برای کاهش آن نیاز داشتیم. برای مقابله با این مشکل، هدف ما وزن کردن مجدد مجموعه داده فیلتر شده است تا توزیع آن بهتر با توزیع تصاویر فیلتر نشده مطابقت داشته باشد. به عنوان یک مثال اسباب بازی برای نشان دادن این ایده، فرض کنید مجموعه داده ما شامل 50٪ عکس گربه و 50٪ عکس سگ است، اما فیلترهای داده ما 75٪ از سگ ها را حذف می کنند اما فقط 50٪ از گربه ها را حذف می کنند. مجموعه داده نهایی ⅔ گربه و ⅓ سگ خواهد بود و یک مدل مولد مبتنی بر احتمال آموزش داده شده بر روی این مجموعه داده احتمالاً تصاویر بیشتری از گربه ها نسبت به سگ ها ایجاد می کند. ما میتوانیم این عدم تعادل را با ضرب کردن میزان از دست دادن آموزش هر تصویر از یک سگ در 2، شبیهسازی اثر تکرار هر تصویر سگ دو بار برطرف کنیم. به نظر می رسد که ما می توانیم این رویکرد را به مجموعه داده ها و مدل های واقعی خود به گونه ای مقیاس کنیم که تا حد زیادی خودکار باشد – یعنی نیازی نیست ویژگی هایی را که می خواهیم دوباره وزن کنیم، دستی انتخاب کنیم.

ما وزن تصاویر را در مجموعه داده فیلتر شده با استفاده از احتمالات یک طبقه بندی کننده خاص محاسبه می کنیم، مشابه روشی که توسط چو و همکاران (2019). برای آموزش این طبقهبندیکننده، تصاویر را از هر دو مجموعه داده نمونهبرداری میکنیم و پیشبینی میکنیم که تصویر از کدام مجموعه داده آمده است. به طور خاص، این مدل پیش بینی می کند P(فیلتر نشده|تصویر)، قبلا داده شده است P (فیلتر نشده) = 0.5. در عمل، ما نمیخواهیم این مدل خیلی قدرتمند باشد، وگرنه ممکن است در وهله اول عملکرد دقیق پیادهسازی شده توسط فیلترهای ما را یاد بگیرد. در عوض، ما میخواهیم مدل نرمتر از فیلترهای داده اصلی ما باشد و دستههای گستردهای را که تحت تأثیر فیلترها هستند، ثبت کند، در حالی که هنوز مطمئن نیستیم که آیا یک تصویر خاص فیلتر میشود یا خیر. برای این منظور، ما یک کاوشگر خطی را در بالای یک کاوشگر کوچک آموزش دادیم کلیپ مدل.

هنگامی که یک طبقهبندی داریم که احتمال اینکه یک تصویر از مجموعه دادههای فیلتر نشده است را پیشبینی کند، همچنان باید این پیشبینی را به وزن تصویر تبدیل کنیم. به عنوان مثال، فرض کنید که P(فیلتر نشده|تصویر) = 0.8. این به این معنی است که نمونه 4 برابر بیشتر از داده های فیلتر شده در داده های فیلتر نشده یافت می شود و وزن 4 باید عدم تعادل را اصلاح کند. به طور کلی تر، می توانیم از وزن استفاده کنیم P(فیلتر نشده|تصویر)/P(فیلترشده|تصویر).[1]

این طرح وزندهی مجدد تا چه اندازه سوگیری تقویتشده را کاهش میدهد؟ وقتی مدل فیلتر شده قبلی خود را با طرح وزن دهی جدید تنظیم کردیم، رفتار مدل تنظیم شده بسیار نزدیکتر با مدل فیلتر نشده در نمونه های مغرضانه ای که قبلاً پیدا کرده بودیم مطابقت داشت. در حالی که این دلگرم کننده بود، ما همچنین می خواستیم این کاهش را با استفاده از اکتشافی سوگیری مبتنی بر کلمه کلیدی خود به طور کامل ارزیابی کنیم. برای اندازهگیری فراوانی کلمات کلیدی در حالی که طرح وزندهی جدید خود را در نظر میگیریم، میتوانیم به سادگی هر نمونه از یک کلمه کلیدی را در مجموعه داده فیلتر شده با وزن نمونه حاوی آن وزن کنیم. با انجام این کار، مجموعه جدیدی از بسامدهای کلمه کلیدی را دریافت می کنیم که وزن نمونه را در مجموعه داده فیلتر شده منعکس می کند.

در اکثر کلمات کلیدی که بررسی کردیم، طرح وزندهی مجدد تغییر فرکانس ناشی از فیلتر را کاهش داد. برای مثال های قبلی ما از "مرد" و "زن"، کاهش فراوانی نسبی 1٪ و -1٪ شد در حالی که مقادیر قبلی آنها به ترتیب 14٪ و 6٪ بود. در حالی که این معیار فقط یک پروکسی برای تعصب واقعی فیلتر است، این اطمینانبخش است که طرح وزندهی مجدد مبتنی بر تصویر ما در واقع معیارهای مبتنی بر متن را به میزان قابل توجهی بهبود میبخشد.

ما به بررسی سوگیریهای باقیمانده در DALL·E 2 ادامه میدهیم، تا حدی از طریق ارزیابیهای بزرگتر از رفتار مدل و بررسیهایی در مورد اینکه چگونه فیلتر کردن بر تعصب و توسعه قابلیت تأثیر گذاشته است.

جلوگیری از بازگشت تصویر

ما مشاهده کردیم که پیشینیان داخلی ما برای DALL·E 2 گاهی اوقات تصاویر آموزشی را به کلمه بازتولید می کردند. این رفتار نامطلوب بود، زیرا ما میخواهیم DALL·E 2 بهطور پیشفرض تصاویر اصلی و منحصربهفرد ایجاد کند و فقط تکههایی از تصاویر موجود را به هم نچسباند. علاوه بر این، بازتولید تصاویر آموزشی به صورت کلمه به کلمه میتواند سؤالات حقوقی را در مورد نقض حق نسخهبرداری، مالکیت و حریم خصوصی (اگر عکسهای افراد در دادههای آموزشی وجود داشته باشد) ایجاد کند.

برای درک بهتر مسئله بازگشت تصویر، مجموعه داده ای از اعلان ها را جمع آوری کردیم که اغلب منجر به تصاویر تکراری می شد. برای انجام این کار، ما از یک مدل آموزش دیده برای نمونه برداری از تصاویر برای 50,000 درخواست از مجموعه داده آموزشی خود استفاده کردیم و نمونه ها را بر اساس شباهت ادراکی به تصویر آموزشی مربوطه مرتب کردیم. در نهایت، ما مسابقات برتر را با دست بررسی کردیم و تنها چند صد جفت تکراری واقعی از 50 هزار درخواست را پیدا کردیم. حتی اگر به نظر می رسید که نرخ بازگشت کمتر از 1٪ باشد، ما احساس کردیم که لازم است نرخ را به 0 کاهش دهیم به دلایل ذکر شده در بالا.

هنگامی که مجموعه داده های خود را از تصاویر پس گرفته شده مطالعه کردیم، متوجه دو الگو شدیم. اولاً، تصاویر تقریباً همگی گرافیکهای برداری ساده بودند که به دلیل محتوای کم اطلاعات، احتمالاً به راحتی قابل حفظ بودند. دوم، و مهمتر از آن، همه تصاویر تقریباً تکراری زیادی در مجموعه داده آموزشی داشتند. به عنوان مثال، ممکن است یک گرافیک برداری وجود داشته باشد که شبیه ساعتی باشد که ساعت 1 را نشان می دهد - اما سپس نمونه آموزشی حاوی همان ساعت که ساعت 2 و سپس 3 و غیره را نشان می دهد، کشف می کنیم. ما متوجه این موضوع شدیم، از یک جستجوی نزدیکترین همسایه توزیع شده استفاده کردیم تا تأیید کنیم که در واقع، همه تصاویر بازگردانده شده دارای تکرارهای ادراکی مشابهی در مجموعه داده هستند. دیگر با این نسخهها کار پدیده مشابهی را در مدلهای زبان بزرگ مشاهده کردهاند و دریافتهاند که تکرار دادهها به شدت با حفظ کردن مرتبط است.

The above finding suggested that, if we deduplicated our dataset, we might solve the regurgitation problem. To achieve this, we planned to use a neural network to identify groups of images that looked similar, and then remove all but one image from each group.[2] However, this would require checking, for each image, whether it is a duplicate of every other image in the dataset. Since our whole dataset contains hundreds of millions of images, we would naively need to check hundreds of quadrillions of image pairs to find all the duplicates. While this is technically within reach, especially on a large compute cluster, we found a much more efficient alternative that works almost as well at a small fraction of the cost.

Consider what happens if we cluster our dataset before performing deduplication. Since nearby samples often fall into the same cluster, most of the duplicate pairs would not cross cluster decision boundaries. We could then deduplicate samples within each cluster without checking for duplicates outside of the cluster, while only missing a small fraction of all duplicate pairs. This is much faster than the naive approach, since we no longer have to check every single pair of images.[3] When we tested this approach empirically on a small subset of our data, it found 85% of all duplicate pairs when using K = 1024 خوشه ها

برای بهبود میزان موفقیت الگوریتم بالا، ما از یک مشاهدات کلیدی استفاده کردیم: وقتی زیر مجموعههای تصادفی مختلف یک مجموعه داده را خوشهبندی میکنید، مرزهای تصمیمگیری خوشهای حاصل اغلب کاملاً متفاوت است. بنابراین، اگر یک جفت تکراری از مرز خوشهای برای یک خوشهبندی از دادهها عبور کند، ممکن است همان جفت در داخل یک خوشه واحد در یک خوشهبندی متفاوت قرار بگیرد. هر چه خوشه بندی های بیشتری را امتحان کنید، احتمال بیشتری برای کشف یک جفت تکراری معین وجود دارد. در عمل، ما به استفاده از پنج خوشه اکتفا کردیم، به این معنی که ما برای تکراری از هر تصویر در اتحاد پنج خوشه مختلف جستجو می کنیم. در عمل، این 97٪ از جفت های تکراری را در زیر مجموعه ای از داده های ما پیدا کرد.

با کمال تعجب، تقریباً یک چهارم از مجموعه داده ما با حذف مجدد حذف شد. وقتی به جفتهای تقریباً تکراری که پیدا شد نگاه کردیم، بسیاری از آنها تغییرات معنیداری داشتند. مثال ساعت را از بالا به خاطر بیاورید: مجموعه داده ممکن است شامل تصاویر زیادی از یک ساعت در زمان های مختلف روز باشد. در حالی که این تصاویر احتمالاً باعث میشود مدل ظاهر این ساعت خاص را به خاطر بسپارد، ممکن است به مدل کمک کند تا بین زمانهای روز تمایز قائل شود. با توجه به مقدار داده حذف شده، نگران بودیم که حذف تصاویری از این دست ممکن است به عملکرد مدل آسیب برساند.

برای آزمایش تأثیر کپیسازی بر روی مدلهای خود، ما دو مدل را با فراپارامترهای یکسان آموزش دادیم: یکی در مجموعه داده کامل و دیگری در نسخه حذفشده از مجموعه داده. برای مقایسه مدلها، از همان ارزیابیهای انسانی که برای ارزیابی مدل اصلی GLIDE استفاده کردیم، استفاده کردیم. با کمال تعجب، متوجه شدیم که ارزیاب های انسانی اندکی مرجح این مدل بر روی دادههای تکراری آموزش داده شده است، و نشان میدهد که حجم زیادی از تصاویر اضافی در مجموعه دادهها در واقع به عملکرد آسیب میزند.

هنگامی که مدلی را داشتیم که بر روی دادههای تکراری آموزش داده شده بود، جستجوی بازگشتی را که قبلاً بیش از 50 هزار درخواست از مجموعه داده آموزشی انجام داده بودیم، دوباره اجرا کردیم. ما متوجه شدیم که مدل جدید هرگز یک تصویر آموزشی را پس از دریافت دستور دقیق برای تصویر از مجموعه داده آموزشی، بازنمیگرداند. برای برداشتن این آزمایش یک قدم دیگر، ما همچنین جستجوی نزدیکترین همسایه را در کل مجموعه داده آموزشی برای هر یک از 50 هزار تصویر تولید شده انجام دادیم. به این ترتیب، ما فکر کردیم که ممکن است مدل را در حال بازگرداندن تصویری متفاوت از تصویر مربوط به یک اعلان مشخص کنیم. حتی با این بررسی دقیق تر، هرگز موردی از بازگشت تصویر پیدا نکردیم.

گام های بعدی

در حالی که همه کاهشهایی که در بالا مورد بحث قرار گرفت نشاندهنده پیشرفت قابلتوجهی به سمت هدف ما برای کاهش خطرات مرتبط با DALL·E 2 است، هر کاهش هنوز هم جای بهبود دارد:

- فیلترهای پیشآموزشی بهتر میتوانند به ما اجازه دهند تا DALL·E 2 را بر روی دادههای بیشتر آموزش دهیم و بهطور بالقوه بیشتر تعصب در مدل را کاهش دهیم. فیلترهای فعلی ما به قیمت بسیاری از موارد مثبت کاذب، برای نرخ اشتباه پایین تنظیم شده اند. در نتیجه، ما تقریباً 5٪ از کل مجموعه داده خود را فیلتر کردیم، حتی اگر اکثر این تصاویر فیلتر شده به هیچ وجه خط مشی محتوای ما را نقض نمی کنند. بهبود فیلترهای ما می تواند به ما اجازه دهد تا برخی از این داده های آموزشی را بازیابی کنیم.

- Bias در بسیاری از مراحل توسعه و استقرار سیستم معرفی شده و به طور بالقوه تقویت می شود. ارزیابی و کاهش تعصب در سیستمهایی مانند DALL·E 2 و آسیب ناشی از این سوگیری، یک مشکل میان رشتهای مهم است که ما به مطالعه آن در OpenAI به عنوان بخشی از مأموریت گستردهتر خود ادامه میدهیم. کار ما در این زمینه شامل ارزیابی ساختمان برای درک بهتر مشکل، مدیریت مجموعههای داده جدید، و استفاده از تکنیکهایی مانند بازخورد انسانی و تنظیم دقیق برای ساخت فناوریهای قویتر و معرف است.

- همچنین بسیار مهم است که ما به مطالعه حفظ و تعمیم در سیستم های یادگیری عمیق ادامه دهیم. در حالی که کپی برداری اولین گام خوبی برای جلوگیری از به خاطر سپردن است، اما همه چیزهایی را که باید در مورد اینکه چرا و چگونه مدل هایی مانند DALL·E 2 داده های آموزشی را به خاطر می سپارند، به ما نمی گوید.

- 000

- 2019

- a

- درباره ما

- حساب

- رسیدن

- در میان

- فعال

- نشانی

- موثر بر

- الگوریتم

- معرفی

- اجازه دادن

- اجازه می دهد تا

- قبلا

- جایگزین

- همیشه

- مقدار

- دیگر

- به نظر می رسد

- اعمال می شود

- با استفاده از

- روش

- دور و بر

- اختصاص داده

- مرتبط است

- حضار

- زیرا

- قبل از

- بودن

- بهتر

- میان

- خارج از

- ساختن

- بنا

- قابلیت های

- نوشتن شرح تصاویر و

- مورد

- موارد

- کشتی

- دسته بندی

- ایجاد می شود

- معین

- تغییر دادن

- بررسی

- را انتخاب کنید

- کلاس

- طبقه بندی

- طبقه بندی

- ساعت

- مجموعه

- مقایسه

- محاسبه

- محاسبه

- مفهوم

- در نظر بگیرید

- شامل

- محتوا

- زمینه ها

- ادامه دادن

- حق چاپ

- نقض قوانین حق تکثیر

- متناظر

- میتوانست

- ایجاد

- ایجاد شده

- ایجاد

- بسیار سخت

- جاری

- در حال حاضر

- داده ها

- روز

- روز

- تصمیم

- عمیق

- جمعیت

- گسترش

- توصیف

- با وجود

- پروژه

- مختلف

- مشکل

- مستقیما

- كشف كردن

- کشف

- فاصله

- توزیع شده

- توزیع

- پایین

- نسخه های تکراری

- در طی

- هر

- اثر

- به طور موثر

- اثر

- اثرات

- موثر

- تلاش

- دلگرم کننده

- به خصوص

- اساسا

- تخمین زدن

- و غیره

- ارزیابی

- همه چیز

- مثال

- مثال ها

- منحصرا

- موجود

- انتظار

- انتظار می رود

- سریعتر

- ویژگی

- امکانات

- باز خورد

- شکل

- فیلتر

- فیلترها برای تصفیه آب

- سرانجام

- پیدا کردن

- نام خانوادگی

- رفع

- تمرکز

- به دنبال آن است

- یافت

- از جانب

- کامل

- تابع

- بیشتر

- جمع آوری

- جنس

- سوالات عمومی

- عموما

- تولید می کنند

- تولید

- نسل

- نسل ها

- مولد

- هدف

- خوب

- GPU ها

- گرافیک

- گروه

- گروه ها

- تضمین شده

- مشت

- کمک

- کمک می کند

- اینجا کلیک نمایید

- زیاد

- چگونه

- اما

- HTTPS

- انسان

- انسان

- صدها نفر

- اندیشه

- شناسایی

- تصویر

- تصاویر

- پیاده سازی

- اجرا

- مهم

- بهبود

- بهبود یافته

- بهبود

- شامل

- مشمول

- شامل

- از جمله

- اطلاعات

- شالوده

- نمونه

- اینترنت

- بررسی

- موضوع

- IT

- خود

- کلید

- برچسب

- برچسب

- برچسب ها

- زبان

- بزرگ

- بزرگتر

- یاد گرفتن

- آموخته

- یادگیری

- قانونی

- احتمالا

- نگاه کنيد

- نگاه

- ساخت

- علامت

- مسابقه

- معنی دار

- به معنی

- اندازه

- اندازه گیری

- مردان

- قدرت

- نظامی

- میلیون ها نفر

- ماموریت

- مدل

- مدل

- بیش

- اکثر

- ضرب شدن

- طبیعت

- لازم

- منفی

- شبکه

- عدد

- سفارش

- سازمان یافته

- اصلی

- دیگر

- مالکیت

- بخش

- ویژه

- کارایی

- انجام

- فاز

- قطعات

- برنامه ریزی

- سیاست

- مثبت

- ممکن

- پتانسیل

- قوی

- تمرین

- پیش بینی

- پیش گویی

- در حال حاضر

- جلوگیری

- قبلی

- خلوت

- کاوشگر

- مشکل

- روند

- تولید کردن

- ساخته

- اعتراض

- پروکسی

- یک چهارم

- بالا بردن

- رسیدن به

- متوجه

- دلایل

- كاهش دادن

- کاهش

- کاهش

- بازتاب

- انعکاس

- باقی مانده

- از بین بردن

- نشان دادن

- نمایندگی

- نماینده

- درخواست

- نیاز

- نیاز

- پاسخ

- نتیجه

- برگشت

- خطرات

- دویدن

- همان

- مقیاس

- طرح

- جستجو

- تنظیم

- اشکال

- اشتراک گذاری

- تغییر

- قابل توجه

- مشابه

- ساده

- پس از

- تنها

- اندازه

- کوچک

- So

- حل

- برخی از

- چیزی

- فضا

- ویژه

- به طور خاص

- مشخصات

- تقسیم می کند

- مراحل

- شروع

- اظهار داشت:

- هنوز

- مهاجرت تحصیلی

- موفقیت

- سیستم

- سیستم های

- مصرف

- تکنیک

- فن آوری

- آزمون

- La

- از این رو

- اشیاء

- به طور کامل

- سه

- آستانه

- از طریق

- زمان

- بار

- ابزار

- بالا

- طرف

- قطار

- آموزش

- فهمیدن

- اتحادیه

- منحصر به فرد

- us

- استفاده کنید

- اعتبار سنجی

- مختلف

- بررسی

- نسخه

- خواسته

- چی

- چه

- در حین

- در داخل

- بدون

- زنان

- مهاجرت کاری

- با این نسخهها کار

- نگران

- خواهد بود

- X