هوش مصنوعی (AI) به یک موضوع مهم و محبوب در جامعه فناوری تبدیل شده است. همانطور که هوش مصنوعی تکامل یافته است، ما شاهد ظهور انواع مختلفی از مدل های یادگیری ماشین (ML) بوده ایم. یک رویکرد، معروف به مدلسازی گروه، به سرعت در بین دانشمندان داده و پزشکان مورد توجه قرار گرفته است. در این پست، مدلهای گروهی چیست و چرا استفاده از آنها میتواند مفید باشد، بحث میکنیم. سپس نمونه ای از نحوه آموزش، بهینه سازی و استقرار مجموعه های سفارشی خود را با استفاده از آن ارائه می کنیم آمازون SageMaker.

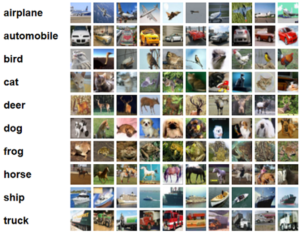

یادگیری گروهی به استفاده از مدلها و الگوریتمهای یادگیری چندگانه برای به دست آوردن پیشبینیهای دقیقتر از هر الگوریتم یادگیری منفرد اشاره دارد. ثابت شده است که آنها در کاربردهای متنوع و تنظیمات یادگیری مانند امنیت سایبری [1] و کشف تقلب، سنجش از راه دور، پیشبینی بهترین مراحل بعدی در تصمیمگیری مالی، تشخیص پزشکی، و حتی بینایی کامپیوتری و پردازش زبان طبیعی (NLP) کارآمد هستند. وظایف ما تمایل داریم که گروهها را بر اساس تکنیکهای مورد استفاده برای آموزش، ترکیب آنها و نحوه ادغام پیشبینیهای مختلف در یک استنتاج واحد دستهبندی کنیم. این دسته بندی ها عبارتند از:

- تقویت - آموزش متوالی چند یادگیرنده ضعیف، که در آن هر پیشبینی نادرست از زبانآموزان قبلی در دنباله، وزن و ورودی بالاتری به یادگیرنده بعدی داده میشود و در نتیجه یادگیرنده قویتری ایجاد میشود. به عنوان مثال می توان به AdaBoost، Gradient Boosting و XGBoost اشاره کرد.

- بسته بندی کردن - از چندین مدل برای کاهش واریانس یک مدل استفاده می کند. به عنوان مثال می توان به جنگل تصادفی و درختان اضافی اشاره کرد.

- انباشتن (ترکیب) - اغلب از مدلهای ناهمگن استفاده میکند، جایی که پیشبینیهای هر برآوردگر جداگانه در کنار هم قرار میگیرند و به عنوان ورودی برای برآوردگر نهایی که پیشبینی را مدیریت میکند، استفاده میشود. فرآیند آموزشی این برآوردگر نهایی اغلب از اعتبارسنجی متقابل استفاده می کند.

روشهای متعددی برای ترکیب پیشبینیها در یک پیشبینی وجود دارد که در نهایت مدل تولید میکند، به عنوان مثال، با استفاده از یک متا برآوردگر مانند یادگیرنده خطی، یک روش رأیگیری که از مدلهای متعدد برای پیشبینی بر اساس رأی اکثریت برای وظایف طبقهبندی استفاده میکند. یا یک گروه میانگین برای رگرسیون.

اگرچه چندین کتابخانه و فریم ورک پیادهسازی مدلهای گروهی، مانند XGBoost، CatBoost، یا جنگل تصادفی scikit-learn را ارائه میدهند، در این پست ما بر روی آوردن مدلهای خود و استفاده از آنها بهعنوان یک مجموعه انباشته تمرکز میکنیم. با این حال، به جای استفاده از منابع اختصاصی برای هر مدل (کارهای آموزشی و تنظیم اختصاصی و نقاط پایانی میزبانی در هر مدل)، ما یک گروه سفارشی (چند مدل) را با استفاده از یک کار آموزشی SageMaker و یک کار تنظیم، آموزش میدهیم، تنظیم و مستقر میکنیم. استقرار در یک نقطه پایانی واحد، در نتیجه کاهش هزینه احتمالی و سربار عملیاتی.

BYOE: گروه خود را بیاورید

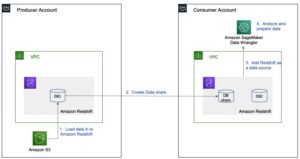

چندین روش برای آموزش و استقرار مدلهای گروه ناهمگن با SageMaker وجود دارد: میتوانید هر مدل را در یک شغل آموزشی جداگانه و هر مدل را جداگانه با استفاده از آن بهینه کنید تنظیم خودکار مدل Amazon SageMaker. هنگام میزبانی این مدل ها، SageMaker راه های مقرون به صرفه مختلفی را برای میزبانی چندین مدل در زیرساخت مستاجر یکسان ارائه می دهد. الگوهای استقرار دقیق برای این نوع تنظیمات را می توان در اینجا یافت الگوهای میزبانی مدل در Amazon SageMaker، قسمت 1: الگوهای طراحی رایج برای ساخت برنامه های ML در Amazon SageMaker. این الگوها شامل استفاده از چندین نقطه پایانی (برای هر مدل آموزشدیده) یا یک نقطه پایانی است نقطه پایانی چند مدلی، یا حتی مجرد نقطه پایانی چند کانتینری جایی که کانتینرها را می توان به صورت جداگانه فراخوانی کرد یا در یک خط لوله زنجیر کرد. همه این راه حل ها شامل یک متا تخمینگر (به عنوان مثال در یک AWS لامبدا تابع) که هر مدل را فراخوانی می کند و تابع ترکیب یا رای را اجرا می کند.

با این حال، اجرای چندین شغل آموزشی ممکن است سربار عملیاتی و هزینه ای را به همراه داشته باشد، به خصوص اگر گروه شما به آموزش بر روی همان داده ها نیاز داشته باشد. به طور مشابه، میزبانی مدلهای مختلف در نقاط پایانی یا کانتینرهای جداگانه و ترکیب نتایج پیشبینی آنها برای دقت بهتر، نیازمند فراخوانهای متعدد است و بنابراین مدیریت، هزینه و تلاشهای نظارتی بیشتری را معرفی میکند. به عنوان مثال، SageMaker پشتیبانی می کند مجموعه مدل های ML با استفاده از سرور استنتاج تریتون، اما این راه حل مستلزم آن است که مدل ها یا مجموعه های مدل توسط باطن تریتون پشتیبانی شوند. علاوه بر این، تلاشهای بیشتری از سوی مشتری برای راهاندازی سرور تریتون و یادگیری بیشتر برای درک نحوه عملکرد بکاندهای مختلف تریتون مورد نیاز است. بنابراین، مشتریان روش سادهتری را برای پیادهسازی راهحلها ترجیح میدهند که در آن فقط باید یکبار فراخوان را به نقطه پایانی ارسال کنند و از انعطافپذیری برای کنترل نحوه جمعآوری نتایج برای تولید خروجی نهایی برخوردار باشند.

بررسی اجمالی راه حل

برای رفع این نگرانیها، نمونهای از آموزش گروهی را با استفاده از یک کار آموزشی، بهینهسازی فراپارامترهای مدل و استقرار آن با استفاده از یک کانتینر به یک نقطه پایانی بدون سرور مرور میکنیم. ما از دو مدل برای مجموعه گروه خود استفاده می کنیم: CatBoost و XGBoost (که هر دو گروه های تقویت کننده هستند). برای داده های خود، ما از مجموعه داده دیابت [2] از کتابخانه scikit-learn: شامل 10 ویژگی (سن، جنس، توده بدن، فشار خون، و شش اندازه گیری سرم خون) است و مدل ما پیشرفت بیماری را 1 سال پس از جمع آوری ویژگی های پایه پیش بینی می کند (یک رگرسیون). مدل).

مخزن کامل کد را می توان در اینجا یافت GitHub.

چندین مدل را در یک کار SageMaker آموزش دهید

برای آموزش مدل های خود، از کارهای آموزشی SageMaker در حالت Script استفاده می کنیم. با حالت Script، میتوانید آموزش سفارشی (و بعداً کد استنتاج) را در حین استفاده از کانتینرهای چارچوب SageMaker بنویسید. کانتینرهای چارچوب به شما امکان می دهند از محیط های آماده مدیریت شده توسط AWS استفاده کنید که شامل تمام تنظیمات و ماژول های لازم است. برای نشان دادن اینکه چگونه می توانید یک کانتینر چارچوب را سفارشی کنید، به عنوان مثال، از کانتینر SKLearn از پیش ساخته شده استفاده می کنیم که شامل بسته های XGBoost و CatBoost نمی شود. دو گزینه برای افزودن این بسته ها وجود دارد: یا ظرف داخلی را گسترش دهید برای نصب CatBoost و XGBoost (و سپس استقرار به عنوان یک کانتینر سفارشی)، یا استفاده از ویژگی حالت اسکریپت شغلی آموزشی SageMaker، که به شما امکان می دهد requirements.txt فایل هنگام ایجاد برآوردگر آموزشی. کار آموزش SageMaker کتابخانه های فهرست شده را در requirements.txt فایل در زمان اجرا به این ترتیب، شما نیازی به مدیریت مخزن تصویر Docker خود ندارید و انعطاف پذیری بیشتری برای اجرای اسکریپت های آموزشی که به بسته های پایتون اضافی نیاز دارند، فراهم می کند.

بلوک کد زیر کدی را که برای شروع آموزش استفاده می کنیم را نشان می دهد. این entry_point پارامتر به اسکریپت آموزشی ما اشاره می کند. ما همچنین از دو ویژگی متقاعد کننده SageMaker SDK API استفاده می کنیم:

- ابتدا، مسیر محلی به دایرکتوری منبع و وابستگیهای خود را در آن مشخص میکنیم

source_dirوdependenciesپارامترها به ترتیب SDK آن دایرکتوری ها را فشرده و در آنها آپلود می کند سرویس ذخیره سازی ساده آمازون (Amazon S3) و SageMaker آنها را در نمونه آموزشی تحت فهرست کاری در دسترس قرار خواهند داد/opt/ml/code. - دوم، ما از SDK استفاده می کنیم

SKLearnشی برآوردگر با پایتون و نسخه چارچوب ترجیحی ما، به طوری که SageMaker ظرف مربوطه را می کشد. ما همچنین یک متریک آموزشی سفارشی تعریف کرده ایم.validation:rmse'، که در گزارش های آموزشی منتشر می شود و توسط SageMaker ضبط می شود. بعداً از این متریک به عنوان متریک هدف در کار تنظیم استفاده می کنیم.

hyperparameters = {"num_round": 6, "max_depth": 5}

estimator_parameters = {

"entry_point": "multi_model_hpo.py",

"source_dir": "code",

"dependencies": ["my_custom_library"],

"instance_type": training_instance_type,

"instance_count": 1,

"hyperparameters": hyperparameters,

"role": role,

"base_job_name": "xgboost-model",

"framework_version": "1.0-1",

"keep_alive_period_in_seconds": 60,

"metric_definitions":[

{'Name': 'validation:rmse', 'Regex': 'validation-rmse:(.*?);'}

]

}

estimator = SKLearn(**estimator_parameters)بعد، ما اسکریپت آموزشی خود را می نویسیم (multi_model_hpo.py). اسکریپت ما از یک جریان ساده پیروی می کند: جذب فراپارامترها که کار با آن پیکربندی شد و آموزش مدل CatBoost و مدل XGBoost. الف را نیز اجرا می کنیم ضربدر k-fold تابع اعتبارسنجی کد زیر را ببینید:

if __name__ == "__main__":

parser = argparse.ArgumentParser() # Sagemaker specific arguments. Defaults are set in the environment variables.

parser.add_argument("--output-data-dir", type=str, default=os.environ["SM_OUTPUT_DATA_DIR"])

parser.add_argument("--model-dir", type=str, default=os.environ["SM_MODEL_DIR"])

parser.add_argument("--train", type=str, default=os.environ["SM_CHANNEL_TRAIN"])

parser.add_argument("--validation", type=str, default=os.environ["SM_CHANNEL_VALIDATION"])

.

.

.

"""

Train catboost

"""

K = args.k_fold

catboost_hyperparameters = {

"max_depth": args.max_depth,

"eta": args.eta,

}

rmse_list, model_catboost = cross_validation_catboost(train_df, K, catboost_hyperparameters)

.

.

.

"""

Train the XGBoost model

""" hyperparameters = {

"max_depth": args.max_depth,

"eta": args.eta,

"objective": args.objective,

"num_round": args.num_round,

} rmse_list, model_xgb = cross_validation(train_df, K, hyperparameters)پس از آموزش مدل ها، میانگین هر دو پیش بینی CatBoost و XGBoost را محاسبه می کنیم. نتیجه، pred_mean، پیش بینی نهایی گروه ما است. سپس، ما تعیین می کنیم mean_squared_error در مقابل مجموعه اعتبارسنجی val_rmse برای ارزیابی کل گروه در طول آموزش استفاده می شود. توجه داشته باشید که ما همچنین مقدار RMSE را در الگویی چاپ می کنیم که با regexی که در آن استفاده کرده ایم مطابقت داشته باشد metric_definitions. بعداً، SageMaker Automatic Model Tuning از آن برای گرفتن متریک هدف استفاده خواهد کرد. کد زیر را ببینید:

pred_mean = np.mean(np.array([pred_catboost, pred_xgb]), axis=0)

val_rmse = mean_squared_error(y_validation, pred_mean, squared=False)

print(f"Final evaluation result: validation-rmse:{val_rmse}")در نهایت، اسکریپت ما هر دو آرتیفکت مدل را در پوشه خروجی واقع در آن ذخیره میکند /opt/ml/model.

وقتی یک کار آموزشی کامل شد، SageMaker محتوای آن را بسته بندی و کپی می کند /opt/ml/model دایرکتوری به عنوان یک شی منفرد در قالب TAR فشرده به مکان S3 که در پیکربندی کار مشخص کرده اید. در مورد ما، SageMaker دو مدل را در یک فایل TAR باندل میکند و در پایان کار آموزشی آن را در Amazon S3 آپلود میکند. کد زیر را ببینید:

model_file_name = 'catboost-regressor-model.dump'

# Save CatBoost model

path = os.path.join(args.model_dir, model_file_name)

print('saving model file to {}'.format(path))

model.save_model(path)

.

.

.

# Save XGBoost model

model_location = args.model_dir + "/xgboost-model"

pickle.dump(model, open(model_location, "wb"))

logging.info("Stored trained model at {}".format(model_location))به طور خلاصه، باید توجه داشته باشید که در این روش ما یک بار داده ها را دانلود کردیم و دو مدل را با استفاده از یک کار آموزشی آموزش دادیم.

تنظیم خودکار مدل مجموعه

از آنجایی که ما در حال ساخت مجموعه ای از مدل های ML هستیم، کاوش در همه جایگشت های فراپارامتر ممکن غیرعملی است. SageMaker ارائه می دهد تنظیم خودکار مدل (AMT)، که با تمرکز بر امیدوار کننده ترین ترکیبات مقادیر در محدوده هایی که شما مشخص می کنید به دنبال بهترین ابرپارامترهای مدل می گردد (این به شما بستگی دارد که محدوده های مناسب را برای کاوش تعریف کنید). SageMaker از چندین روش بهینه سازی پشتیبانی می کند برای شما انتخاب کنید

ما با تعریف دو بخش از فرآیند بهینهسازی شروع میکنیم: متریک هدف و فراپارامترهایی که میخواهیم تنظیم کنیم. در مثال ما از اعتبارسنجی RMSE به عنوان متریک هدف استفاده می کنیم و تنظیم می کنیم eta و max_depth (برای سایر فراپارامترها مراجعه کنید فراپارامترهای XGBoost و فراپارامترهای CatBoost):

from sagemaker.tuner import (

IntegerParameter,

ContinuousParameter,

HyperparameterTuner,

) hyperparameter_ranges = {

"eta": ContinuousParameter(0.2, 0.3),

"max_depth": IntegerParameter(3, 4)

}

metric_definitions = [{"Name": "validation:rmse", "Regex": "validation-rmse:([0-9.]+)"}]

objective_metric_name = "validation:rmse"ما همچنین باید اطمینان حاصل کنیم که در اسکریپت آموزشی که هایپرپارامترهای ما هاردکد نیستند و از آرگومان های زمان اجرا SageMaker استخراج شده اند:

catboost_hyperparameters = {

"max_depth": args.max_depth,

"eta": args.eta,

}SageMaker همچنین هایپرپارامترها را در یک فایل JSON می نویسد و می تواند از آن خوانده شود /opt/ml/input/config/hyperparameters.json در مورد نمونه آموزشی

مانند CatBoost، ما نیز فراپارامترهای مدل XGBoost را میگیریم (به این نکته توجه کنید objective و num_round تنظیم نشده اند):

catboost_hyperparameters = {

"max_depth": args.max_depth,

"eta": args.eta,

}در نهایت، ما کار تنظیم hyperparameter را با استفاده از این تنظیمات راهاندازی میکنیم:

tuner = HyperparameterTuner(

estimator,

objective_metric_name,

hyperparameter_ranges,

max_jobs=4,

max_parallel_jobs=2,

objective_type='Minimize'

)

tuner.fit({"train": train_location, "validation": validation_location}, include_cls_metadata=False)وقتی کار کامل شد، می توانید مقادیر بهترین کار آموزشی (با حداقل RMSE) را بازیابی کنید:

job_name=tuner.latest_tuning_job.name

attached_tuner = HyperparameterTuner.attach(job_name)

attached_tuner.describe()["BestTrainingJob"]برای اطلاعات بیشتر در مورد AMT مراجعه کنید تنظیم خودکار مدل را با SageMaker انجام دهید.

گسترش

برای استقرار مجموعه سفارشی خود، باید یک اسکریپت برای رسیدگی به درخواست استنتاج و پیکربندی میزبانی SageMaker ارائه کنیم. در این مثال، ما از یک فایل واحد استفاده کردیم که شامل کد آموزش و استنتاج (multi_model_hpo.py). SageMaker از کد زیر استفاده می کند _ name _ == "_ main _" برای آموزش و کارکردها model_fn, input_fnو predict_fn هنگام استقرار و ارائه مدل

اسکریپت استنتاج

همانند آموزش، ما از ظرف فریمورک SageMaker SKLearn با اسکریپت استنتاج خودمان استفاده می کنیم. این اسکریپت سه روش مورد نیاز SageMaker را پیاده سازی می کند.

اول، model_fn متد فایل های مصنوع مدل ذخیره شده ما را می خواند و آنها را در حافظه بارگذاری می کند. در مورد ما، متد مجموعه ما را به عنوان برمی گرداند all_model، که یک لیست پایتون است، اما می توانید از فرهنگ لغت با نام مدل ها به عنوان کلید نیز استفاده کنید.

def model_fn(model_dir):

catboost_model = CatBoostRegressor()

catboost_model.load_model(os.path.join(model_dir, model_file_name))

model_file = "xgboost-model"

model = pickle.load(open(os.path.join(model_dir, model_file), "rb"))

all_model = [catboost_model, model]

return all_modelدوم، input_fn متد دادههای ورودی درخواست را که باید به کنترلکننده استنتاج ما ارسال شود، از حالت سریال خارج میکند. برای اطلاعات بیشتر در مورد کنترل کننده های ورودی، مراجعه کنید تطبیق ظرف استنتاج خودتان.

def input_fn(input_data, content_type):

dtype=None

payload = StringIO(input_data)

return np.genfromtxt(payload, dtype=dtype, delimiter=",")سوم، predict_fn متد مسئول گرفتن پیشبینی از مدلها است. این روش مدل و داده های برگردانده شده را می گیرد input_fn به عنوان پارامتر و پیش بینی نهایی را برمی گرداند. در مثال ما، نتیجه CatBoost را از اولین عضو لیست مدل (model[0]) و XGBoost از عضو دوم (model[1]، و ما از یک تابع ترکیبی استفاده می کنیم که میانگین هر دو پیش بینی را برمی گرداند:

def predict_fn(input_data, model):

predictions_catb = model[0].predict(input_data)

dtest = xgb.DMatrix(input_data)

predictions_xgb = model[1].predict(dtest,

ntree_limit=getattr(model, "best_ntree_limit", 0),

validate_features=False)

return np.mean(np.array([predictions_catb, predictions_xgb]), axis=0)اکنون که مدل های آموزش دیده و اسکریپت استنتاج خود را داریم، می توانیم محیط را برای استقرار گروه خود پیکربندی کنیم.

استنتاج بدون سرور SageMaker

اگر چه وجود دارد بسیاری از گزینه های میزبانی در SageMaker، در این مثال از یک نقطه پایانی بدون سرور استفاده می کنیم. نقاط پایانی بدون سرور به طور خودکار منابع محاسباتی را راهاندازی میکنند و بسته به ترافیک آنها را در داخل و خارج مقیاس میکنند. این کار سنگینی غیرمتمایز سرورهای مدیریتی را از بین می برد. این گزینه برای بارهای کاری که دوره های بیکاری بین جهش های ترافیکی دارند و می توانند شروع سرد را تحمل کنند، ایده آل است.

پیکربندی نقطه پایانی بدون سرور ساده است زیرا نیازی به انتخاب انواع نمونه یا مدیریت سیاست های مقیاس بندی نداریم. ما فقط نیاز به ارائه دو پارامتر داریم: اندازه حافظه و حداکثر همزمانی. نقطه پایانی بدون سرور به طور خودکار منابع محاسباتی را متناسب با حافظه ای که انتخاب می کنید اختصاص می دهد. اگر اندازه حافظه بزرگتری انتخاب کنید، ظرف شما به vCPU های بیشتری دسترسی دارد. شما همیشه باید اندازه حافظه نقطه پایانی خود را با توجه به اندازه مدل خود انتخاب کنید. پارامتر دومی که باید ارائه کنیم حداکثر همزمانی است. برای یک نقطه پایانی واحد، این پارامتر را می توان تا 200 تنظیم کرد (تا لحظه نگارش این مقاله، محدودیت تعداد کل نقاط پایانی بدون سرور در یک منطقه 50 است). باید توجه داشته باشید که حداکثر همزمانی برای یک نقطه پایانی مجزا مانع از آن میشود که آن نقطه پایانی تمام فراخوانهای مجاز برای حساب شما را بگیرد، زیرا هر فراخوانی نقطه پایانی فراتر از حداکثر کاهش مییابد (برای اطلاعات بیشتر در مورد کل همزمانی برای تمام نقاط پایانی بدون سرور در هر منطقه، مراجعه کنید. به نقاط پایانی و سهمیه های Amazon SageMaker).

from sagemaker.serverless.serverless_inference_config import ServerlessInferenceConfig

serverless_config = ServerlessInferenceConfig(

memory_size_in_mb=6144,

max_concurrency=1,

) اکنون که نقطه پایانی را پیکربندی کردیم، در نهایت میتوانیم مدلی را که در کار بهینهسازی هایپرپارامتر انتخاب شده است، مستقر کنیم:

estimator=attached_tuner.best_estimator()

predictor = estimator.deploy(serverless_inference_config=serverless_config)پاک کردن

حتی اگر نقاط پایانی بدون سرور در صورت عدم استفاده، هزینه صفر دارند، پس از اتمام اجرای این مثال، باید مطمئن شوید که نقطه پایانی را حذف کنید:

predictor.delete_endpoint(predictor.endpoint)نتیجه

در این پست، یک رویکرد را برای آموزش، بهینه سازی و استقرار یک گروه سفارشی پوشش دادیم. ما روند استفاده از یک کار آموزشی واحد برای آموزش چندین مدل، نحوه استفاده از تنظیم خودکار مدل برای بهینهسازی فراپارامترهای مجموعه، و نحوه استقرار یک نقطه پایانی بدون سرور را که استنتاجهای چندین مدل را با هم ترکیب میکند، شرح دادیم.

استفاده از این روش مشکلات احتمالی هزینه و عملیات را حل می کند. هزینه یک کار آموزشی بر اساس منابعی است که برای مدت زمان استفاده از آن استفاده می کنید. با دانلود فقط یک بار داده ها برای آموزش دو مدل، ما به نصف مرحله دانلود داده کار و حجم مصرفی که داده ها را ذخیره می کند کاهش دادیم و در نتیجه هزینه کلی کار آموزشی را کاهش دادیم. علاوه بر این، شغل AMT چهار شغل آموزشی را اجرا کرد که هر کدام با کاهش زمان و ذخیرهسازی ذکر شده، بهطوریکه 4 برابر در هزینه صرفهجویی میکنند! با توجه به استقرار مدل در نقطه پایانی بدون سرور، از آنجایی که شما برای مقدار داده پردازش شده نیز پرداخت می کنید، با فراخوانی نقطه پایانی تنها یک بار برای دو مدل، نیمی از هزینه داده های ورودی/خروجی را پرداخت می کنید.

اگرچه این پست تنها مزایای دو مدل را نشان میدهد، اما میتوانید از این روش برای آموزش، کوک کردن و استقرار مدلهای گروهی متعدد استفاده کنید تا اثری حتی بیشتر ببینید.

منابع

[1] راج کومار، پی آرون; سلواکومار، اس (2011). "تشخیص حمله انکار سرویس توزیع شده با استفاده از مجموعه ای از طبقه بندی کننده عصبی". ارتباطات کامپیوتری 34 (11): 1328–1341. doi:10.1016/j.comcom.2011.01.012.

[2] بردلی افرون، تروور هستی، ایین جانستون و رابرت تیبشیرانی (2004) "رگرسیون کمترین زاویه"، سالنامه آمار (با بحث)، 407-499. (https://web.stanford.edu/~hastie/Papers/LARS/LeastAngle_2002.pdf)

درباره نویسنده

ملانی لی، دکترا، یک TAM متخصص ارشد AI/ML در AWS مستقر در سیدنی، استرالیا است. او به مشتریان سازمانی کمک می کند تا راه حل هایی را با استفاده از ابزارهای پیشرفته AI/ML در AWS ایجاد کنند و راهنمایی هایی را در مورد معماری و اجرای راه حل های یادگیری ماشین با بهترین شیوه ها ارائه می دهد. او در اوقات فراغت خود عاشق گشت و گذار در طبیعت در فضای باز و گذراندن وقت با خانواده و دوستان است.

ملانی لی، دکترا، یک TAM متخصص ارشد AI/ML در AWS مستقر در سیدنی، استرالیا است. او به مشتریان سازمانی کمک می کند تا راه حل هایی را با استفاده از ابزارهای پیشرفته AI/ML در AWS ایجاد کنند و راهنمایی هایی را در مورد معماری و اجرای راه حل های یادگیری ماشین با بهترین شیوه ها ارائه می دهد. او در اوقات فراغت خود عاشق گشت و گذار در طبیعت در فضای باز و گذراندن وقت با خانواده و دوستان است.

اوری روزنبرگ مدیر فنی متخصص AI و ML برای اروپا، خاورمیانه و آفریقا است. Uri در خارج از اسرائیل کار می کند تا مشتریان سازمانی را برای طراحی، ساخت و بهره برداری از حجم کاری ML در مقیاس توانمند کند. او در اوقات فراغت خود از دوچرخه سواری، پیاده روی و به حداقل رساندن RMSE لذت می برد.

اوری روزنبرگ مدیر فنی متخصص AI و ML برای اروپا، خاورمیانه و آفریقا است. Uri در خارج از اسرائیل کار می کند تا مشتریان سازمانی را برای طراحی، ساخت و بهره برداری از حجم کاری ML در مقیاس توانمند کند. او در اوقات فراغت خود از دوچرخه سواری، پیاده روی و به حداقل رساندن RMSE لذت می برد.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. خودرو / خودروهای الکتریکی، کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- BlockOffsets. نوسازی مالکیت افست زیست محیطی. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/efficiently-train-tune-and-deploy-custom-ensembles-using-amazon-sagemaker/

- : دارد

- :است

- :نه

- :جایی که

- ][پ

- $UP

- 1

- 10

- 100

- 11

- 200

- 2011

- 50

- 60

- 7

- a

- درباره ما

- دسترسی

- مطابق

- حساب

- دقت

- دقیق

- اضافه کردن

- اضافی

- علاوه بر این

- نشانی

- افریقا

- پس از

- در برابر

- سن

- AI

- AI / ML

- الگوریتم

- الگوریتم

- معرفی

- مجاز

- اجازه می دهد تا

- همچنین

- همیشه

- آمازون

- آمازون SageMaker

- آمازون خدمات وب

- در میان

- مقدار

- an

- و

- هر

- برنامه های کاربردی

- روش

- هستند

- استدلال

- AS

- At

- حمله

- استرالیا

- اتوماتیک

- بطور خودکار

- در دسترس

- میانگین

- دور

- AWS

- بخش مدیریت

- مستقر

- خط مقدم

- BE

- زیرا

- شدن

- بوده

- بودن

- مفید

- مزایای

- بهترین

- بهترین شیوه

- بهتر

- میان

- خارج از

- ترکیب

- مخلوط

- مسدود کردن

- خون

- فشار خون

- بدن

- تقویت

- هر دو

- به ارمغان بیاورد

- آوردن

- ساختن

- بنا

- ساخته شده در

- بسته

- اما

- by

- محاسبه

- CAN

- گرفتن

- اسیر

- مورد

- دسته

- زنجیر شده

- بار

- را انتخاب کنید

- طبقه بندی

- رمز

- سرد

- مجموعه

- ترکیب

- ترکیب

- مشترک

- ارتباطات

- انجمن

- متقاعد کننده

- کامل

- محاسبه

- کامپیوتر

- چشم انداز کامپیوتر

- نگرانی ها

- پیکر بندی

- پیکربندی

- تشکیل شده است

- ظرف

- ظروف

- محتوا

- کنترل

- متناظر

- هزینه

- مقرون به صرفه

- پوشش داده شده

- ایجاد

- سفارشی

- مشتری

- مشتریان

- سفارشی

- امنیت سایبری

- داده ها

- تصمیم گیری

- اختصاصی

- پیش فرض

- تعريف كردن

- مشخص

- تعریف کردن

- نشان دادن

- خود داری از خدمات

- بستگی دارد

- گسترش

- استقرار

- گسترش

- طرح

- الگوهای طراحی

- دقیق

- کشف

- مشخص کردن

- مختلف

- دایرکتوری

- بحث و تبادل نظر

- گفتگو

- مرض

- مختلف

- کارگر بارانداز

- نمی کند

- آیا

- دانلود

- موادی که موقتا برای استعمال انبار میشود

- مدت

- در طی

- هر

- شرق

- اثر

- موثر

- موثر

- تلاش

- هر دو

- ظهور

- قدرت دادن

- قادر ساختن

- پایان

- نقطه پایانی

- اطمینان حاصل شود

- سرمایه گذاری

- محیط

- محیط

- به خصوص

- اروپا

- ارزیابی

- حتی

- تکامل

- مثال

- مثال ها

- اکتشاف

- بررسی

- اضافی

- خانواده

- ویژگی

- امکانات

- پرونده

- فایل ها

- نهایی

- سرانجام

- مالی

- نام خانوادگی

- انعطاف پذیری

- جریان

- تمرکز

- تمرکز

- پیروی

- به دنبال آن است

- برای

- جنگل

- قالب

- یافت

- چهار

- چارچوب

- چارچوب

- تقلب

- کشف تقلب

- دوستان

- از جانب

- کامل

- تابع

- توابع

- بعلاوه

- افزایش

- به دست آوردن

- تولید می کنند

- دریافت کنید

- گرفتن

- داده

- بیشتر

- راهنمایی

- نیم

- دسته

- دستگیره

- آیا

- he

- سنگین

- بلند کردن سنگین

- کمک می کند

- او

- بالاتر

- خود را

- میزبان

- میزبانی وب

- چگونه

- چگونه

- اما

- HTML

- HTTP

- HTTPS

- بهینه سازی هایپرپارامتر

- تنظیم فراپارامتر

- دلخواه

- آرام

- if

- تصویر

- انجام

- اجرای

- پیاده سازی می کند

- مهم

- in

- شامل

- شامل

- فرد

- به طور جداگانه

- اطلاعات

- شالوده

- ورودی

- نصب

- نمونه

- در عوض

- اطلاعات

- به

- معرفی

- معرفی می کند

- استناد کرد

- فراخوانی میکند

- اسرائيل

- مسائل

- IT

- کار

- شغل ها

- JPG

- json

- کلید

- نوع

- شناخته شده

- زبان

- بزرگتر

- بعد

- راه اندازی

- یادگیری

- بهره برداری

- Li

- کتابخانه ها

- کتابخانه

- بلند کردن اجسام

- محدود

- فهرست

- ذکر شده

- بارهای

- محلی

- واقع شده

- محل

- ورود به سیستم

- مطالب

- دوست دارد

- دستگاه

- فراگیری ماشین

- اصلی

- اکثریت

- ساخت

- مدیریت

- اداره می شود

- مدیریت

- مدیر

- مدیریت

- توده

- بیشترین

- متوسط

- اندازه گیری

- پزشکی

- عضو

- حافظه

- ادغام کردن

- روش

- روش

- متری

- متوسط

- خاورمیانه

- قدرت

- حداقل

- به حداقل رساندن

- ML

- حالت

- مدل

- مدل

- ماژول ها

- نظارت بر

- بیش

- اکثر

- چندگانه

- نام

- نام

- طبیعی

- پردازش زبان طبیعی

- طبیعت

- لازم

- نیاز

- بعد

- nlp

- اطلاع..

- عدد

- متعدد

- هدف

- هدف

- of

- پیشنهادات

- غالبا

- on

- یک بار

- ONE

- فقط

- کار

- قابل استفاده

- بهینه سازی

- بهینه سازی

- بهینه سازی

- گزینه

- گزینه

- or

- OS

- دیگر

- ما

- خارج

- خارج از منزل

- تولید

- به طور کلی

- خود

- بسته

- پارامتر

- پارامترهای

- بخش

- بخش

- گذشت

- مسیر

- الگو

- الگوهای

- پرداخت

- برای

- دوره ها

- فاز

- خط لوله

- افلاطون

- هوش داده افلاطون

- PlatoData

- نقطه

- سیاست

- محبوب

- ممکن

- پست

- پتانسیل

- شیوه های

- پیش بینی

- پیش گویی

- پیش بینی

- پیشگو

- پیش بینی می کند

- ترجیح می دهند

- مرجح

- فشار

- جلوگیری از

- قبلی

- چاپ

- روش

- روند

- فرآوری شده

- در حال پردازش

- تولید کردن

- پیشرفت

- امید بخش

- اثبات شده

- ارائه

- فراهم می کند

- پــایتــون

- تصادفی

- سریعا

- خواندن

- كاهش دادن

- کاهش

- کاهش

- اشاره دارد

- نظر

- regex

- منطقه

- دور

- مخزن

- نشان دادن

- درخواست

- ضروری

- نیاز

- منابع

- به ترتیب

- مسئوليت

- نتیجه

- نتایج

- برگشت

- بازده

- راست

- رابرت

- نقش

- دویدن

- در حال اجرا

- s

- حکیم ساز

- تنظیم خودکار مدل SageMaker

- همان

- ذخیره

- صرفه جویی کردن

- مقیاس

- مقیاس گذاری

- دانشمندان

- یادگیری

- اسکریپت

- sdk

- دوم

- دیدن

- مشاهده گردید

- انتخاب شد

- ارسال

- ارشد

- جداگانه

- دنباله

- سرم

- بدون سرور

- سرور

- سرویس

- خدمات

- خدمت

- تنظیم

- تنظیمات

- چند

- ارتباط جنسی

- او

- باید

- نشان داد

- نشان می دهد

- به طور مشابه

- ساده

- تنها

- شش

- اندازه

- So

- راه حل

- مزایا

- حل می کند

- منبع

- متخصص

- خاص

- مشخص شده

- خرج کردن

- پشته

- انباشته

- پشتهسازی

- استنفورد

- شروع

- شروع می شود

- وضعیت هنر

- ارقام

- مراحل

- ذخیره سازی

- ذخیره شده

- پرده

- ساده

- قوی

- چنین

- خلاصه

- پشتیبانی

- پشتیبانی از

- مطمئن

- سیدنی

- طول می کشد

- مصرف

- هدف

- وظایف

- فنی

- تکنیک

- پیشرفته

- مستاجر

- نسبت به

- که

- La

- شان

- آنها

- سپس

- آنجا.

- در نتیجه

- از این رو

- اینها

- آنها

- این

- کسانی که

- اگر چه؟

- سه

- از طریق

- زمان

- بار

- به

- با هم

- ابزار

- موضوع

- جمع

- کشش

- ترافیک

- قطار

- آموزش دیده

- آموزش

- درختان

- ترور

- تریتون

- دو

- انواع

- زیر

- فهمیدن

- استفاده

- استفاده کنید

- استفاده

- استفاده

- با استفاده از

- اعتبار سنجی

- ارزش

- ارزشها

- مختلف

- نسخه

- دید

- حجم

- رای گیری

- می خواهم

- بود

- مسیر..

- راه

- we

- وب

- خدمات وب

- وزن

- بود

- چی

- چه زمانی

- که

- در حین

- تمام

- چرا

- اراده

- با

- در داخل

- مهاجرت کاری

- کارگر

- با این نسخهها کار

- نوشتن

- نوشته

- XGBoost

- سال

- شما

- شما

- زفیرنت

- صفر