در چشم انداز مراقبت های بهداشتی امروزی که به سرعت در حال تحول است، پزشکان با حجم وسیعی از داده های بالینی از منابع مختلف، مانند یادداشت های مراقب، پرونده الکترونیک سلامت، و گزارش های تصویربرداری مواجه هستند. این انبوه اطلاعات، در عین حال که برای مراقبت از بیمار ضروری است، میتواند برای متخصصان پزشکی نیز طاقتفرسا و زمانبر باشد تا از میان آنها را بررسی و تجزیه و تحلیل کنند. خلاصه کردن کارآمد و استخراج بینش از این داده ها برای مراقبت بهتر از بیمار و تصمیم گیری بسیار مهم است. اطلاعات خلاصه شده بیمار می تواند برای تعدادی از فرآیندهای پایین دستی مانند جمع آوری داده ها، کدگذاری موثر بیماران، یا گروه بندی بیماران با تشخیص های مشابه برای بررسی مفید باشد.

مدلهای هوش مصنوعی (AI) و یادگیری ماشین (ML) در رسیدگی به این چالشها نویدهای زیادی را نشان دادهاند. می توان مدل ها را برای تجزیه و تحلیل و تفسیر حجم زیادی از داده های متنی آموزش داد و به طور موثر اطلاعات را به خلاصه های مختصر فشرده می کند. با خودکار کردن فرآیند خلاصهسازی، پزشکان میتوانند به سرعت به اطلاعات مرتبط دسترسی پیدا کنند و به آنها اجازه میدهد تا بر مراقبت از بیمار تمرکز کنند و تصمیمات آگاهانهتری بگیرند. موارد زیر را ببینید بررسی موردی برای کسب اطلاعات بیشتر در مورد یک مورد استفاده در دنیای واقعی.

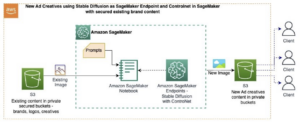

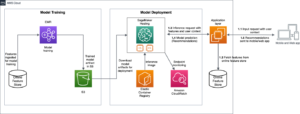

آمازون SageMaker، یک سرویس ML کاملاً مدیریت شده، یک پلت فرم ایده آل برای میزبانی و پیاده سازی مدل ها و رویکردهای خلاصه سازی مختلف مبتنی بر AI/ML فراهم می کند. در این پست، گزینههای مختلف برای پیادهسازی تکنیکهای خلاصهسازی در SageMaker از جمله استفاده از آن را بررسی میکنیم Amazon SageMaker JumpStart مدلهای پایه، تنظیم دقیق مدلهای از پیش آموزشدیده از Hugging Face، و ساخت مدلهای خلاصهسازی سفارشی. همچنین مزایا و معایب هر رویکرد را مورد بحث قرار میدهیم و متخصصان مراقبتهای بهداشتی را قادر میسازند تا مناسبترین راهحل را برای تولید خلاصههای مختصر و دقیق از دادههای بالینی پیچیده انتخاب کنند.

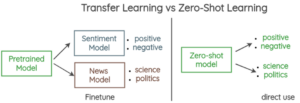

دو اصطلاح مهم که قبل از شروع باید بدانیم: از قبل آموزش دیده و تنظیم دقیق. یک مدل از پیش آموزش دیده یا پایه مدلی است که بر روی مجموعه بزرگی از داده ها، معمولاً برای دانش عمومی زبان، ساخته و آموزش داده شده است. تنظیم دقیق فرآیندی است که در آن به یک مدل از پیش آموزشدیده داده میشود تا مجموعه دادههای اختصاصی دامنه دیگری به منظور بهبود عملکرد آن در یک کار خاص ارائه شود. در یک محیط مراقبت های بهداشتی، این به این معنی است که برخی از داده ها از جمله عبارات و اصطلاحات مربوط به مراقبت از بیمار به مدل داده شود.

مدل های خلاصه سازی سفارشی را در SageMaker بسازید

اگرچه این رویکرد پر تلاش است، اما برخی از سازمان ها ممکن است ترجیح دهند مدل های خلاصه سازی سفارشی را از ابتدا در SageMaker بسازند. این رویکرد مستلزم دانش عمیقتر مدلهای AI/ML است و ممکن است شامل ایجاد یک معماری مدل از ابتدا یا تطبیق مدلهای موجود برای مطابقت با نیازهای خاص باشد. ساخت مدلهای سفارشی میتواند انعطافپذیری و کنترل بیشتری بر فرآیند خلاصهسازی ارائه دهد، اما در مقایسه با رویکردهایی که از مدلهای از پیش آموزش دیده شروع میشوند، به زمان و منابع بیشتری نیز نیاز دارد. ضروری است قبل از ادامه، مزایا و معایب این گزینه را به دقت بسنجید، زیرا ممکن است برای همه موارد استفاده مناسب نباشد.

مدل های پایه SageMaker JumpStart

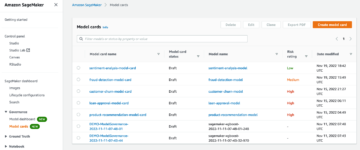

یک گزینه عالی برای اجرای خلاصه سازی در SageMaker استفاده از مدل های پایه JumpStart است. این مدلها که توسط سازمانهای تحقیقاتی پیشرو هوش مصنوعی توسعه یافتهاند، طیفی از مدلهای زبانی از پیش آموزشدیده را ارائه میکنند که برای کارهای مختلف از جمله خلاصهسازی متن بهینهسازی شدهاند. SageMaker JumpStart دو نوع مدل پایه ارائه می کند: مدل های اختصاصی و مدل های منبع باز. SageMaker JumpStart همچنین واجد شرایط HIPAA را فراهم می کند و آن را برای بار کاری مراقبت های بهداشتی مفید می کند. این در نهایت به عهده مشتری است که از انطباق اطمینان حاصل کند، بنابراین حتما اقدامات مناسب را انجام دهید. دیدن معماری برای امنیت و انطباق HIPAA در خدمات وب آمازون برای جزئیات بیشتر.

مدل های پایه اختصاصی

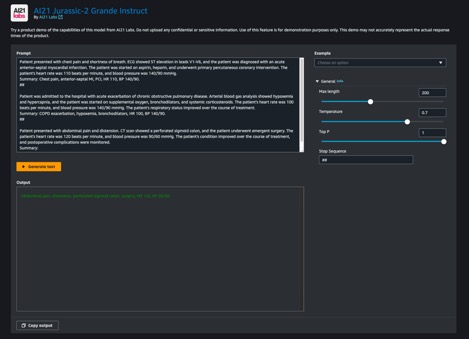

مدل های اختصاصی مانند مدل های ژوراسیک از AI21 و مدل Cohere Generate از Cohere را می توان از طریق SageMaker JumpStart در کنسول مدیریت AWS و در حال حاضر در حال پیش نمایش هستند. زمانی که نیازی به تنظیم دقیق مدل خود بر روی داده های سفارشی ندارید، استفاده از مدل های اختصاصی برای خلاصه سازی ایده آل است. این یک راه حل با کاربری آسان و خارج از جعبه ارائه می دهد که می تواند نیازهای خلاصه سازی شما را با حداقل پیکربندی برآورده کند. با استفاده از قابلیت های این مدل های از پیش آموزش دیده، می توانید در زمان و منابعی که در غیر این صورت صرف آموزش و تنظیم دقیق یک مدل سفارشی می شود، صرفه جویی کنید. علاوه بر این، مدلهای اختصاصی معمولاً با APIها و SDKهای کاربرپسند ارائه میشوند که فرآیند یکپارچهسازی با سیستمها و برنامههای موجود شما را ساده میکنند. اگر نیازهای خلاصهسازی شما را میتوان با مدلهای اختصاصی از پیش آموزشدیده بدون نیاز به سفارشیسازی یا تنظیم دقیق برآورده کرد، آنها راهحلی راحت، مقرونبهصرفه و کارآمد برای وظایف خلاصهسازی متن شما ارائه میدهند. از آنجایی که این مدلها بهطور خاص برای موارد استفاده در مراقبتهای بهداشتی آموزش داده نشدهاند، نمیتوان کیفیت را برای زبان پزشکی بدون تنظیم دقیق تضمین کرد.

Jurassic-2 Grande Instruct یک مدل زبان بزرگ (LLM) توسط آزمایشگاه AI21 است که برای دستورالعمل های زبان طبیعی بهینه شده و برای کارهای مختلف زبانی قابل استفاده است. این یک API با کاربری آسان و Python SDK ارائه می دهد که کیفیت و مقرون به صرفه بودن را متعادل می کند. کاربردهای پرطرفدار شامل تولید کپی بازاریابی، تقویت چت بات ها و خلاصه سازی متن است.

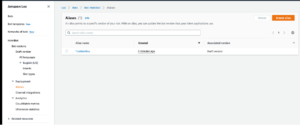

در کنسول SageMaker، به SageMaker JumpStart بروید، مدل AI21 Jurassic-2 Grande Instruct را پیدا کنید و انتخاب کنید. مدل را امتحان کنید.

اگر میخواهید مدل را در نقطه پایانی SageMaker که مدیریت میکنید مستقر کنید، میتوانید مراحل این نمونه را دنبال کنید. دفتر یادداشت، که به شما نحوه استقرار Jurassic-2 Large را با استفاده از SageMaker نشان می دهد.

مدل های بنیاد منبع باز

مدلهای منبع باز شامل مدلهای FLAN T5، Bloom و GPT-2 هستند که میتوانند از طریق SageMaker JumpStart در Amazon SageMaker Studio UI، SageMaker JumpStart در کنسول SageMaker و SageMaker JumpStart API. این مدلها را میتوان بهخوبی تنظیم کرد و در نقاط پایانی تحت حساب AWS شما مستقر کرد و به شما مالکیت کامل وزن مدل و کدهای اسکریپت را میدهد.

Flan-T5 XL یک مدل قدرتمند و همه کاره است که برای طیف وسیعی از وظایف زبانی طراحی شده است. با تنظیم دقیق مدل با داده های دامنه خاص خود، می توانید عملکرد آن را برای موارد استفاده خاص خود، مانند خلاصه سازی متن یا هر کار NLP دیگری، بهینه کنید. برای جزئیات در مورد نحوه تنظیم دقیق Flan-T5 XL با استفاده از SageMaker Studio UI، به دستورالعمل تنظیم دقیق FLAN T5 XL با Amazon SageMaker Jumpstart.

تنظیم دقیق مدل های از پیش آموزش دیده با صورت در آغوش گرفته در SageMaker

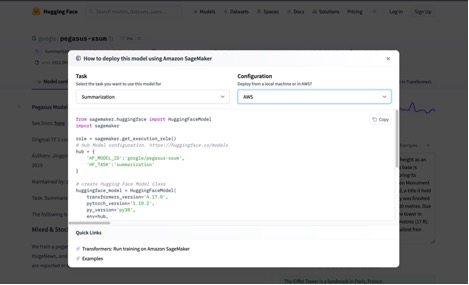

یکی از محبوب ترین گزینه ها برای اجرای خلاصه سازی در SageMaker، تنظیم دقیق مدل های از پیش آموزش دیده با استفاده از Hugging Face است. ترانسفورماتور کتابخانه Hugging Face طیف گسترده ای از مدل های ترانسفورماتور از پیش آموزش دیده را ارائه می دهد که به طور خاص برای کارهای مختلف پردازش زبان طبیعی (NLP) از جمله خلاصه سازی متن طراحی شده اند. با کتابخانه Hugging Face Transformers، میتوانید به راحتی این مدلهای از پیش آموزشدیده را روی دادههای دامنه خاص خود با استفاده از SageMaker تنظیم کنید. این رویکرد چندین مزیت دارد، مانند زمان آموزش سریع تر، عملکرد بهتر در دامنه های خاص، و بسته بندی و استقرار مدل آسان تر با استفاده از ابزارها و خدمات داخلی SageMaker. اگر نمیتوانید مدل مناسبی را در SageMaker JumpStart پیدا کنید، میتوانید هر مدلی را که توسط Hugging Face ارائه میشود انتخاب کنید و آن را با استفاده از SageMaker تنظیم کنید.

برای شروع کار با یک مدل برای آشنایی با قابلیت های ML، تنها کاری که باید انجام دهید این است که SageMaker Studio را باز کنید، یک مدل از پیش آموزش دیده را پیدا کنید که می خواهید از آن استفاده کنید. Hugging Face Model Hubو SageMaker را به عنوان روش استقرار خود انتخاب کنید. Hugging Face کدی را برای کپی کردن، چسباندن و اجرا در نوت بوک به شما می دهد. به همین راحتی است! بدون نیاز به تجربه مهندسی ML.

کتابخانه Hugging Face Transformers سازندگان را قادر میسازد تا بر روی مدلهای از پیش آموزشدیده کار کنند و کارهای پیشرفتهای مانند تنظیم دقیق را انجام دهند که در بخشهای زیر به بررسی آنها میپردازیم.

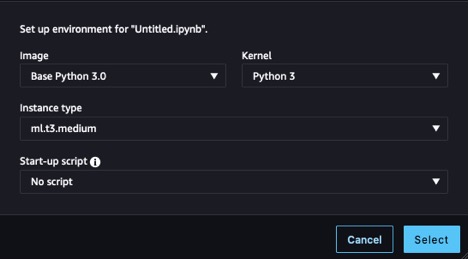

تامین منابع

قبل از شروع، باید یک دفترچه یادداشت تهیه کنیم. برای دستورالعمل ها، به مراحل 1 و 2 مراجعه کنید یک مدل یادگیری ماشینی به صورت محلی بسازید و آموزش دهید. برای این مثال از تنظیمات نشان داده شده در تصویر زیر استفاده کردیم.

ما همچنین نیاز به ایجاد یک سرویس ذخیره سازی ساده آمازون سطل (Amazon S3) برای ذخیره داده های آموزشی و مصنوعات آموزشی. برای دستورالعمل، مراجعه کنید ایجاد یک سطل.

مجموعه داده را آماده کنید

برای تنظیم دقیق مدل خود برای داشتن دانش بهتر دامنه، باید داده های مناسب برای کار را بدست آوریم. هنگام آموزش برای یک مورد استفاده سازمانی، باید تعدادی از وظایف مهندسی داده را انجام دهید تا داده های خود را آماده کنید تا برای آموزش آماده شوید. این وظایف خارج از محدوده این پست هستند. برای این مثال، ما برخی از دادههای مصنوعی را برای تقلید از یادداشتهای پرستاری تولید کردهایم و آنها را در Amazon S3 ذخیره کردهایم. ذخیره داده های خود در آمازون S3 ما را قادر می سازد حجم کاری ما را برای انطباق با HIPAA معمار کنید. ما با دریافت آن یادداشت ها و بارگیری آنها در نمونه ای که نوت بوک ما در حال اجرا است شروع می کنیم:

یادداشت ها از یک ستون شامل ورودی کامل، یادداشت، و یک ستون حاوی یک نسخه کوتاه شده تشکیل شده اند که نمونه ای از خروجی مورد نظر ما است، خلاصه. هدف از استفاده از این مجموعه داده، بهبود واژگان بیولوژیکی و پزشکی مدل ما است، به طوری که با خلاصه کردن در یک زمینه مراقبت های بهداشتی، به نام تنظیم دقیق دامنه، و به مدل خود نشان دهید که چگونه خروجی خلاصه شده آن را ساختار می دهد. در برخی موارد خلاصهسازی، ممکن است بخواهیم یک چکیده از یک مقاله یا یک خلاصه یک خطی از یک بررسی ایجاد کنیم، اما در این مورد، ما سعی میکنیم مدل خود را به خروجی یک نسخه کوتاه از علائم و اقدامات انجام شده برسانیم. برای یک بیمار تا کنون

مدل را بارگذاری کنید

مدلی که ما به عنوان پایه خود استفاده می کنیم، نسخه ای از Pegasus گوگل است که در Hugging Face Hub به نام Hugging Face Hub در دسترس است. pegasus-xsum. قبلاً برای خلاصهسازی از قبل آموزش داده شده است، بنابراین فرآیند تنظیم دقیق ما میتواند بر گسترش دانش دامنه آن تمرکز کند. اصلاح کاری که مدل ما اجرا می کند، نوع دیگری از تنظیم دقیق است که در این پست به آن پرداخته نشده است. کتابخانه Transformer یک کلاس برای بارگذاری تعریف مدل از ما فراهم می کند model_checkpoint: google/pegasus-xsum. این مدل را از هاب بارگیری می کند و در نوت بوک ما نمونه سازی می کند تا بتوانیم بعداً از آن استفاده کنیم. زیرا pegasus-xsum یک مدل دنباله به دنباله است، ما می خواهیم از نوع Seq2Seq استفاده کنیم مدل خودکار کلاس:

اکنون که مدل خود را داریم، زمان آن رسیده است که توجه خود را به اجزای دیگری معطوف کنیم که ما را قادر میسازد تا حلقه آموزشی خود را اجرا کنیم.

یک توکن ساز ایجاد کنید

اولین مورد از این اجزا توکنایزر است. از Tokenization فرآیندی است که در آن کلمات از داده های ورودی به نمایش های عددی تبدیل می شوند که مدل ما می تواند آن را درک کند. مجدداً، کتابخانه Transformer کلاسی را برای ما فراهم میکند تا تعریف توکنایزر را از همان چک پوینت بارگیری کنیم که برای نمونهسازی مدل استفاده کردیم:

با استفاده از این شی توکن ساز، میتوانیم یک تابع پیشپردازش ایجاد کنیم و آن را روی مجموعه دادههایمان نگاشت کنیم تا توکنهایی را آماده کنیم تا به مدل وارد شوند. در نهایت، خروجی توکن شده را قالب بندی می کنیم و ستون های حاوی متن اصلی خود را حذف می کنیم، زیرا مدل قادر به تفسیر آنها نخواهد بود. اکنون ما با یک ورودی نشانه گذاری شده باقی مانده ایم که آماده وارد شدن به مدل است. کد زیر را ببینید:

با توکن سازی داده ها و نمونه سازی مدل ما، تقریباً آماده اجرای یک حلقه آموزشی هستیم. اجزای بعدی که می خواهیم ایجاد کنیم جمع آوری داده و بهینه ساز هستند. جمعآوری داده کلاس دیگری است که توسط Hugging Face از طریق کتابخانه Transformers ارائه میشود، که ما از آن برای ایجاد دستههایی از دادههای توکن شده خود برای آموزش استفاده میکنیم. ما به راحتی میتوانیم با استفاده از توکنایزر و اشیاء مدلی که قبلاً داریم، این را بسازیم، فقط با پیدا کردن نوع کلاس مربوطه که قبلاً برای مدل خود (Seq2Seq) برای کلاس جمعآوری استفاده کردهایم. عملکرد بهینه ساز حفظ وضعیت تمرین و به روز رسانی پارامترها بر اساس از دست دادن تمرین ما در حین کار در حلقه است. برای ایجاد یک بهینه ساز، می توانیم آن را وارد کنیم بهینه بسته از ماژول مشعل، که در آن تعدادی از الگوریتم های بهینه سازی موجود است. برخی از موارد رایجی که ممکن است قبلاً با آنها روبرو شده باشید عبارتند از Stochastic Gradient Descent و آدم، دومی که در مثال ما اعمال شده است. سازنده Adam پارامترهای مدل و نرخ یادگیری پارامتر شده را برای اجرای آموزشی داده شده در نظر می گیرد. کد زیر را ببینید:

آخرین مراحل قبل از شروع آموزش، ساختن شتاب دهنده و زمانبندی نرخ یادگیری است. شتاب دهنده از یک کتابخانه متفاوت (ما عمدتاً از Transformers استفاده کرده ایم) تولید شده توسط Hugging Face با نام مناسب Accelerate می آید و منطق مورد نیاز برای مدیریت دستگاه ها را در طول آموزش (مثلاً با استفاده از چندین GPU) از بین می برد. برای مولفه نهایی، کتابخانه همیشه مفید Transformers را برای پیاده سازی زمانبندی نرخ یادگیری خود مجدداً مشاهده می کنیم. با تعیین نوع زمانبندی، تعداد کل مراحل آموزش در حلقه ما، و بهینه ساز قبلی ایجاد شده، get_scheduler تابع یک شی را برمی گرداند که به ما امکان می دهد نرخ یادگیری اولیه خود را در طول فرآیند آموزش تنظیم کنیم:

ما اکنون به طور کامل برای آموزش آماده شده ایم! بیایید یک کار آموزشی راه اندازی کنیم و با نمونه سازی شروع کنیم train_args با استفاده از کتابخانه Transformers و انتخاب مقادیر پارامتر. ما میتوانیم اینها را به همراه سایر مؤلفهها و مجموعه دادههای آمادهشده خود مستقیماً به آن ارسال کنیم مربی و همانطور که در کد زیر نشان داده شده است آموزش را شروع کنید. بسته به اندازه مجموعه داده شما و پارامترهای انتخابی، ممکن است زمان قابل توجهی طول بکشد.

مدل را برای استنتاج بسته بندی کنید

پس از اجرای آموزش، شی مدل آماده استفاده برای استنتاج است. به عنوان بهترین روش، بیایید کار خود را برای استفاده در آینده ذخیره کنیم. ما باید مصنوعات مدل خود را ایجاد کنیم، آنها را با هم زیپ کنیم و تاربال خود را برای ذخیره سازی در Amazon S3 آپلود کنیم. برای اینکه مدل خود را برای فشرده سازی آماده کنیم، باید مدلی که اکنون به خوبی تنظیم شده است را باز کنیم، سپس مدل باینری و فایل های پیکربندی مرتبط را ذخیره کنیم. همچنین باید توکنایزر خود را در همان دایرکتوری ذخیره کنیم که مصنوعات مدل خود را در آن ذخیره کرده ایم تا زمانی که از مدل برای استنتاج استفاده می کنیم در دسترس باشد. ما model_dir اکنون پوشه باید چیزی شبیه به کد زیر باشد:

تنها چیزی که باقی می ماند این است که یک دستور tar را اجرا کنیم تا فهرست خود را فشرده کنیم و فایل tar.gz را در آمازون S3 آپلود کنیم:

مدل تازه تنظیم شده ما اکنون آماده و در دسترس است تا برای استنتاج استفاده شود.

انجام استنباط

برای استفاده از این آرتیفکت مدل برای استنتاج، یک فایل جدید باز کنید و از کد زیر استفاده کنید و آن را تغییر دهید model_data پارامتر متناسب با مکان ذخیره مصنوع شما در آمازون S3. را HuggingFaceModel سازنده مدل ما را از نقطه بازرسی که در آن ذخیره کردهایم بازسازی میکند model.tar.gz، که سپس می توانیم برای استنتاج با استفاده از روش deploy آن را مستقر کنیم. استقرار نقطه پایانی چند دقیقه طول می کشد.

پس از استقرار نقطه پایانی، میتوانیم از پیشبینیکنندهای که ایجاد کردهایم برای آزمایش آن استفاده کنیم. عبور کنید predict یک بار داده را انتخاب کنید و سلول را اجرا کنید، و پاسخ را از مدل تنظیم شده خود دریافت خواهید کرد:

برای دیدن مزایای تنظیم دقیق یک مدل، بیایید یک آزمایش سریع انجام دهیم. جدول زیر شامل یک اعلان و نتایج ارسال آن فرمان به مدل قبل و بعد از تنظیم دقیق است.

| سریع | پاسخگویی بدون تنظیم دقیق | پاسخ با Fine-Tuning |

| علائمی که بیمار تجربه می کند را خلاصه کنید. بیمار مردی 45 ساله با شکایت از درد قفسه سینه زیر سینه است که به بازوی چپ تابش می کند. درد در حین انجام کار در حیاط به طور ناگهانی شروع می شود که با تنگی نفس خفیف و دیافورز همراه است. ضربان قلب بیمار در بدو ورود 120، تعداد تنفس 24، فشار خون 170/95 بود. 12 الکتروکاردیوگرام سرب در بدو ورود به بخش اورژانس و سه نیتروگلیسیرین زیر زبانی بدون تسکین درد قفسه سینه انجام شد. الکتروکاردیوگرام ارتفاع ST را در لیدهای قدامی نشان می دهد که نشان دهنده انفارکتوس حاد قدامی میوکارد است. ما با آزمایشگاه کاتتریزاسیون قلب و آماده سازی برای کاتتریزاسیون قلب توسط متخصص قلب تماس گرفته ایم. | ما یک مورد انفارکتوس حاد میوکارد را ارائه می دهیم. | درد قفسه سینه، MI قدامی، PCI. |

همانطور که می بینید، مدل دقیق ما از اصطلاحات بهداشتی متفاوت استفاده می کند، و ما توانسته ایم ساختار پاسخ را مطابق با اهداف خود تغییر دهیم. توجه داشته باشید که نتایج به مجموعه داده شما و انتخاب های طراحی انجام شده در طول آموزش بستگی دارد. نسخه شما از مدل می تواند نتایج بسیار متفاوتی ارائه دهد.

پاک کردن

هنگامی که کار با نوت بوک SageMaker خود را به پایان رساندید، حتما آن را خاموش کنید تا از هزینه های منابع طولانی مدت جلوگیری کنید. توجه داشته باشید که خاموش کردن نمونه باعث میشود هر دادهای که در حافظه موقت نمونه ذخیره شده است را از دست بدهید، بنابراین باید قبل از پاکسازی، تمام کارهای خود را در ذخیرهسازی دائمی ذخیره کنید. همچنین باید به نقاط پایان صفحه را در کنسول SageMaker قرار دهید و هر نقطه پایانی را که برای استنباط مستقر شده است حذف کنید. برای حذف تمام مصنوعات، همچنین باید به کنسول آمازون S3 بروید تا فایل های آپلود شده در سطل خود را حذف کنید.

نتیجه

در این پست، گزینههای مختلفی را برای پیادهسازی تکنیکهای خلاصهسازی متن در SageMaker بررسی کردیم تا به متخصصان مراقبتهای بهداشتی کمک کنیم تا بهطور کارآمد پردازش کنند و بینشهایی را از مقادیر وسیعی از دادههای بالینی استخراج کنند. ما در مورد استفاده از مدل های فونداسیون SageMaker Jumpstart، تنظیم دقیق مدل های از پیش آموزش دیده از Hugging Face و ساخت مدل های خلاصه سازی سفارشی بحث کردیم. هر رویکرد دارای مزایا و معایب خاص خود است که نیازها و نیازهای مختلف را برآورده می کند.

ساخت مدلهای خلاصهسازی سفارشی در SageMaker به انعطافپذیری و کنترل زیادی اجازه میدهد، اما به زمان و منابع بیشتری نسبت به استفاده از مدلهای از پیش آموزشدیده نیاز دارد. مدلهای پایه SageMaker Jumpstart راهحلی با کاربری آسان و مقرونبهصرفه برای سازمانهایی که نیازی به سفارشیسازی یا تنظیم دقیق ندارند، و همچنین برخی از گزینهها برای تنظیم دقیق ساده ارائه میدهند. مدلهای از پیش آموزشدیده Hugging Face زمانهای آموزش سریعتر، عملکرد بهتر دامنه و ادغام یکپارچه با ابزارها و سرویسهای SageMaker را در کاتالوگ گستردهای از مدلها ارائه میکند، اما نیاز به تلاش برای پیادهسازی دارد. در زمان نوشتن این پست، آمازون گزینه دیگری را اعلام کرده است: بستر آمازون، که قابلیت های خلاصه سازی را در یک محیط مدیریت شده تر ارائه می دهد.

با درک مزایا و معایب هر رویکرد، متخصصان مراقبت های بهداشتی و سازمان ها می توانند تصمیمات آگاهانه ای را در مورد مناسب ترین راه حل برای تولید خلاصه های مختصر و دقیق از داده های بالینی پیچیده اتخاذ کنند. در نهایت، استفاده از مدلهای خلاصهسازی مبتنی بر AI/ML در SageMaker میتواند به طور قابلتوجهی مراقبت و تصمیمگیری از بیمار را با امکان دادن به متخصصان پزشکی برای دسترسی سریع به اطلاعات مرتبط و تمرکز بر ارائه مراقبت با کیفیت، افزایش دهد.

منابع

برای اسکریپت کامل مورد بحث در این پست و برخی داده های نمونه، به ادامه مطلب مراجعه کنید GitHub repo. برای اطلاعات بیشتر در مورد نحوه اجرای بارهای کاری ML در AWS، به منابع زیر مراجعه کنید:

درباره نویسندگان

کودی کالینز یک معمار راه حل مستقر در نیویورک در خدمات وب آمازون است. او با مشتریان ISV کار می کند تا راه حل های پیشرو در صنعت را در فضای ابری بسازد. او با موفقیت پروژه های پیچیده ای را برای صنایع مختلف ارائه کرده است و کارایی و مقیاس پذیری را بهینه کرده است. در اوقات فراغت خود از مطالعه، مسافرت و آموزش جیو جیتسو لذت می برد.

کودی کالینز یک معمار راه حل مستقر در نیویورک در خدمات وب آمازون است. او با مشتریان ISV کار می کند تا راه حل های پیشرو در صنعت را در فضای ابری بسازد. او با موفقیت پروژه های پیچیده ای را برای صنایع مختلف ارائه کرده است و کارایی و مقیاس پذیری را بهینه کرده است. در اوقات فراغت خود از مطالعه، مسافرت و آموزش جیو جیتسو لذت می برد.

امیر حکمه یک معمار AWS Solutions است که در پنسیلوانیا زندگی می کند. تمرکز حرفه ای او شامل همکاری با فروشندگان نرم افزار مستقل در سراسر شمال شرق، هدایت آنها در طراحی و ساخت پلت فرم های پیشرفته و مقیاس پذیر در AWS Cloud است.

امیر حکمه یک معمار AWS Solutions است که در پنسیلوانیا زندگی می کند. تمرکز حرفه ای او شامل همکاری با فروشندگان نرم افزار مستقل در سراسر شمال شرق، هدایت آنها در طراحی و ساخت پلت فرم های پیشرفته و مقیاس پذیر در AWS Cloud است.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. خودرو / خودروهای الکتریکی، کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- BlockOffsets. نوسازی مالکیت افست زیست محیطی. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/exploring-summarization-options-for-healthcare-with-amazon-sagemaker/

- : دارد

- :است

- :نه

- :جایی که

- $UP

- 1

- 10

- 100

- 12

- 14

- ٪۱۰۰

- 24

- 33

- 7

- 8

- 9

- a

- قادر

- درباره ما

- چکیده

- شتاب دادن

- شتاب دهنده

- دسترسی

- حساب

- دقیق

- در میان

- اقدامات

- آدم

- خطاب به

- اداره

- پیشرفته

- مزایای

- پس از

- از نو

- تجمع

- AI

- تحقیق ai

- AI / ML

- الگوریتم

- معرفی

- اجازه دادن

- اجازه می دهد تا

- در امتداد

- قبلا

- همچنین

- آمازون

- آمازون SageMaker

- آمازون خدمات وب

- مقدار

- مقدار

- an

- تحلیل

- و

- اعلام کرد

- دیگر

- هر

- API

- رابط های برنامه کاربردی

- مربوط

- برنامه های کاربردی

- اعمال می شود

- روش

- رویکردها

- مناسب

- معماری

- هستند

- ARM

- ورود

- مقاله

- AS

- مرتبط است

- At

- توجه

- اتوماسیون

- در دسترس

- اجتناب از

- دور

- AWS

- موازنه

- مستقر

- BE

- زیرا

- بوده

- قبل از

- شروع

- سود

- مزایای

- بهترین

- بهتر

- BIN

- خون

- فشار خون

- شکوفه

- جعبه

- نفس

- پهن

- ساختن

- سازندگان

- بنا

- ساخته

- ساخته شده در

- اما

- by

- صدا

- نام

- CAN

- قابلیت های

- اهميت دادن

- Осторожно

- مورد

- موارد

- کاتالوگ

- علت

- چالش ها

- تغییر دادن

- chatbots

- انتخاب

- را انتخاب کنید

- انتخاب

- برگزیده

- کلاس

- بالینی

- ابر

- رمز

- کد

- برنامه نویسی

- همکاری

- ستون

- ستون ها

- بیا

- می آید

- مشترک

- مقایسه

- شکایت

- پیچیده

- انطباق

- جزء

- اجزاء

- مرکب

- مختصر

- پیکر بندی

- منفی

- کنسول

- ساخت

- زمینه

- کنترل

- مناسب

- متناظر

- مقرون به صرفه

- هزینه

- میتوانست

- پوشش داده شده

- ایجاد

- ایجاد شده

- ایجاد

- بسیار سخت

- در حال حاضر

- سفارشی

- مشتری

- مشتریان

- سفارشی سازی

- داده ها

- مجموعه داده ها

- تصمیم گیری

- تصمیم گیری

- تعریف

- تحویل داده

- نشان دادن

- بخش

- وابسته

- بستگی دارد

- گسترش

- مستقر

- استقرار

- گسترش

- طرح

- طراحی

- طراحی

- مطلوب

- جزئیات

- توسعه

- دستگاه ها

- مختلف

- مستقیما

- کشف

- بحث و تبادل نظر

- بحث کردیم

- مختلف

- do

- پزشکان

- عمل

- دامنه

- حوزه

- انجام شده

- آیا

- پایین

- اشکالاتی

- در طی

- هر

- آسان تر

- به آسانی

- ساده

- آسان برای استفاده

- به طور موثر

- بهره وری

- موثر

- موثر

- تلاش

- الکترونیکی

- سوابق الکترونیکی سلامت

- شایستگی

- اورژانس

- قادر ساختن

- را قادر می سازد

- را قادر می سازد

- نقطه پایانی

- مهندسی

- بالا بردن

- اطمینان حاصل شود

- سرمایه گذاری

- ورود

- محیط

- دوره

- ضروری است

- حتی

- در حال تحول

- مثال

- موجود

- تجربه

- تجربه

- اکتشاف

- کشف

- بررسی

- گسترش

- عصاره

- چهره

- در مواجهه

- بسیار

- سریعتر

- تغذیه

- کمی از

- پرونده

- فایل ها

- نهایی

- سرانجام

- پیدا کردن

- پیدا کردن

- نام خانوادگی

- مناسب

- انعطاف پذیری

- تمرکز

- به دنبال

- پیروی

- برای

- قالب

- پایه

- از جانب

- کامل

- کاملا

- تابع

- بعلاوه

- آینده

- افزایش

- سوالات عمومی

- تولید می کنند

- تولید

- مولد

- دریافت کنید

- گرفتن

- دادن

- داده

- دادن

- Go

- گوگل

- GPU ها

- بزرگ

- بیشتر

- تضمین شده

- آیا

- he

- سلامتی

- بهداشت و درمان

- قلب

- کمک

- خود را

- میزبانی وب

- چگونه

- چگونه

- HTML

- HTTP

- HTTPS

- قطب

- صورت در آغوش گرفته

- دلخواه

- if

- تصویربرداری

- انجام

- پیاده سازی

- اجرای

- واردات

- مهم

- بهبود

- in

- در عمق

- شامل

- شامل

- از جمله

- مستقل

- لوازم

- صنعت

- اطلاعات

- اطلاع

- اول

- ورودی

- ورودی

- بینش

- نمونه

- دستورالعمل

- ادغام

- اطلاعات

- به

- شامل

- IT

- ITS

- کار

- json

- تنها

- دانستن

- دانش

- آزمایشگاه

- آزمایشگاه

- چشم انداز

- زبان

- بزرگ

- نام

- بعد

- رهبری

- برجسته

- منجر می شود

- یاد گرفتن

- یادگیری

- ترک کرد

- کتابخانه

- پسندیدن

- LLM

- بار

- بارگیری

- محل

- منطق

- نگاه کنيد

- از دست دادن

- خاموش

- دستگاه

- فراگیری ماشین

- ساخته

- حفظ

- ساخت

- ساخت

- مدیریت

- اداره می شود

- مدیریت

- نقشه

- بازار یابی (Marketing)

- ممکن است..

- متوسط

- پزشکی

- دیدار

- حافظه

- با

- روش

- قدرت

- حداقل

- دقیقه

- ML

- مدل

- مدل

- ماژول ها

- بیش

- اکثر

- محبوبترین

- چندگانه

- تحت عنوان

- طبیعی

- پردازش زبان طبیعی

- هدایت

- نیاز

- نیازهای

- جدید

- نیویورک

- به تازگی

- بعد

- nlp

- نه

- دفتر یادداشت

- یادداشت

- اکنون

- عدد

- هدف

- اشیاء

- of

- ارائه

- ارائه شده

- پیشنهادات

- قدیمی

- on

- ONE

- آنهایی که

- شروع

- به سوی

- باز کن

- منبع باز

- کار

- بهینه سازی

- بهینه سازی

- بهینه

- بهینه سازی

- گزینه

- گزینه

- or

- سفارش

- سازمان های

- اصلی

- دیگر

- در غیر این صورت

- ما

- خارج

- تولید

- خارج از

- روی

- خود

- مالکیت

- بسته

- بسته بندی

- با ما

- درد

- پارامتر

- پارامترهای

- ویژه

- عبور

- عبور

- بیمار

- pacientes

- اسب بالدار

- پنسیلوانیا

- کارایی

- مربوط

- عبارات

- سکو

- سیستم عامل

- افلاطون

- هوش داده افلاطون

- PlatoData

- نقطه

- محبوب

- پست

- قوی

- برق

- تمرین

- پیشگو

- ترجیح می دهند

- آماده

- آماده شده

- در حال حاضر

- فشار

- پیش نمایش

- قبلا

- در درجه اول

- روند

- فرآیندهای

- در حال پردازش

- ساخته

- حرفه ای

- حرفه ای

- پروژه ها

- وعده

- اختصاصی

- مثبت

- ارائه

- ارائه

- فراهم می کند

- ارائه

- تدارک

- هدف

- اهداف

- قرار دادن

- پــایتــون

- کیفیت

- سریع

- به سرعت

- محدوده

- سریعا

- نرخ

- مطالعه

- اماده

- دنیای واقعی

- سوابق

- مربوط

- تسکین

- برداشتن

- گزارش ها

- نیاز

- ضروری

- مورد نیاز

- نیاز

- تحقیق

- منابع

- پاسخ

- نتایج

- بازده

- این فایل نقد می نویسید:

- نقش

- دویدن

- در حال اجرا

- اجرا می شود

- حکیم ساز

- همان

- ذخیره

- مقیاس پذیری

- مقیاس پذیر

- حوزه

- خراش

- sdk

- sdks

- بدون درز

- بخش

- تیم امنیت لاتاری

- دیدن

- جداگانه

- سرویس

- خدمات

- تنظیم

- محیط

- تنظیمات

- چند

- کوتاه

- باید

- نشان

- نشان داده شده

- نشان می دهد

- بستن

- الک کن

- قابل توجه

- به طور قابل توجهی

- مشابه

- ساده

- ساده شده

- اندازه

- So

- تا حالا

- نرم افزار

- راه حل

- مزایا

- برخی از

- چیزی

- منابع

- خاص

- به طور خاص

- صرف

- شروع

- راه افتادن

- دولت

- وضعیت هنر

- مراحل

- ذخیره سازی

- opbevare

- ذخیره شده

- ذخیره سازی

- ساده

- ساختار

- استودیو

- زیر زبانی

- موفقیت

- چنین

- ناگهانی

- کت و شلوار

- مناسب

- خلاصه

- مطمئن

- نشانه ها

- خلاصه

- ترکیبی

- داده های مصنوعی

- سیستم های

- جدول

- گرفتن

- صورت گرفته

- طول می کشد

- کار

- وظایف

- تکنیک

- واژه شناسی

- قوانین و مقررات

- آزمون

- نسبت به

- که

- La

- هاب

- آنها

- سپس

- اینها

- آنها

- این

- کسانی که

- سه

- از طریق

- سراسر

- زمان

- زمان بر

- بار

- به

- امروز

- با هم

- نشانه گذاری شده است

- نشانه

- ابزار

- مشعل

- جمع

- قطار

- آموزش دیده

- آموزش

- مبدل

- ترانسفورماتور

- ترانسفورماتور

- سفر

- دو

- نوع

- انواع

- به طور معمول

- ui

- در نهایت

- ناتوان

- زیر

- فهمیدن

- درک

- بروزرسانی

- آپلود شده

- us

- استفاده کنید

- مورد استفاده

- استفاده

- کاربر پسند

- استفاده

- با استفاده از

- با استفاده از

- اعتبار سنجی

- ارزشها

- مختلف

- وسیع

- فروشندگان

- همه کاره

- نسخه

- بسیار

- جلد

- می خواهم

- بود

- we

- ثروت

- وب

- خدمات وب

- وزن کن

- خوب

- چی

- چه زمانی

- که

- در حین

- وسیع

- دامنه گسترده

- اراده

- با

- بدون

- کلمات

- مهاجرت کاری

- کارگر

- با این نسخهها کار

- خواهد بود

- نوشته

- سال

- نیویورک

- شما

- شما

- زفیرنت

- زیپ