- ممکن است 12، 2014

- واسیلیس ورینیوتس

- . 4 نظر

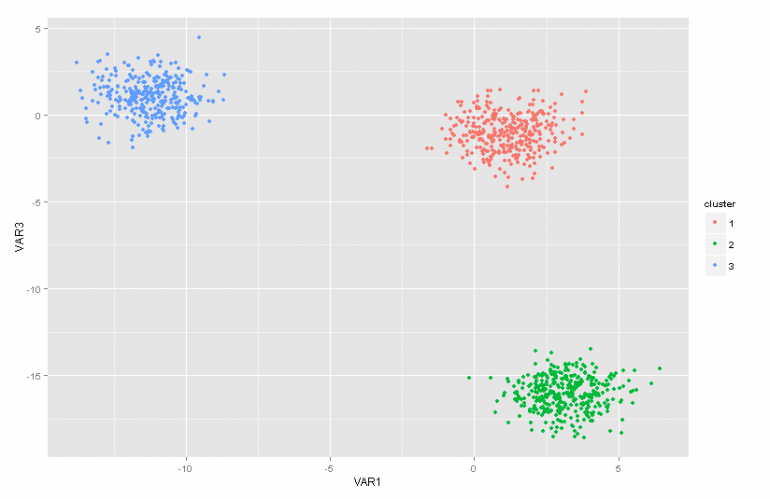

این پست وبلاگ قسمت دوم از مجموعه مقالات در مورد مدل های مخلوط فرآیند دیریکله است. در مقاله قبلی ما یک مروری بر چندین تکنیک تحلیل خوشه ای و ما در مورد برخی از مشکلات/محدودیت هایی که با استفاده از آنها به وجود می آیند بحث کردیم. علاوه بر این، مدلهای مخلوط فرآیند دیریکله را به اختصار ارائه کردیم، در مورد دلیل مفید بودن آنها صحبت کردیم و برخی از کاربردهای آنها را ارائه کردیم.

به روز رسانی: چارچوب یادگیری ماشین Datumbox اکنون منبع باز و رایگان است دانلود. برای مشاهده اجرای مدلهای مخلوط فرآیند دیریکله در جاوا، بسته com.datumbox.framework.machinelearning.clustering را بررسی کنید.

قورت دادن مدلهای مخلوط فرآیند دیریکله در ابتدا ممکن است کمی سخت باشد، زیرا آنها مدلهای مخلوط بینهایت با نمایشهای مختلف هستند. خوشبختانه یک راه خوب برای نزدیک شدن به موضوع، شروع از مدلهای مخلوط محدود با توزیع دیریکله و سپس حرکت به مدلهای نامحدود است.

در نتیجه در این مقاله به طور خلاصه چند توزیع مهم را که به آنها نیاز خواهیم داشت، ارائه میدهم، از آنها برای ساختن پیشین دیریکله با مدل درستنمایی چندجملهای استفاده میکنیم و سپس به مدل مخلوط محدود بر اساس توزیع دیریکله میرویم.

1. توزیع بتا

La توزیع بتا خانواده ای از توزیع های پیوسته است که در بازه [0,1،XNUMX] تعریف می شود. با دو پارامتر مثبت a و b پارامتر می شود و شکل آن به شدت به انتخاب آن دو پارامتر بستگی دارد.

شکل 1: توزیع بتا برای پارامترهای مختلف a، b

توزیع بتا معمولاً برای مدلسازی توزیع بر روی احتمالات استفاده میشود و چگالی احتمال زیر را دارد:

![]()

معادله 1: بتا PDF

جایی که Γ(x) تابع گاما و a، b پارامترهای توزیع است. بتا معمولاً بهعنوان توزیع مقادیر احتمال استفاده میشود و این احتمال را به ما میدهد که احتمال مدلسازی شده برابر با یک مقدار خاص P = p0 باشد. طبق تعریف خود، توزیع بتا قادر است احتمال نتایج باینری را که مقادیر درست یا نادرست می گیرند، مدل کند. پارامترهای a و b را می توان به ترتیب شبه شمارش موفقیت و شکست در نظر گرفت. بنابراین توزیع بتا احتمال موفقیت را با توجه به موفقیت ها و b شکست ها مدل می کند.

2. توزیع دیریکله

La توزیع دیریکله تعمیم توزیع بتا برای پیامدهای چندگانه است (یا به عبارت دیگر برای رویدادهایی با پیامدهای متعدد استفاده می شود). با k پارامتر a پارامتر می شودi که باید مثبت باشد هنگامی که تعداد متغیرها k = 2 باشد، توزیع دیریکله با توزیع بتا برابر است.

شکل 2: توزیع دیریکله برای انواع الفi پارامترهای

توزیع دیریکله معمولاً برای مدلسازی توزیع بر روی احتمالات استفاده میشود و چگالی احتمال زیر را دارد:

![]()

معادله 2: دیریکله PDF

جایی که Γ(x) تابع گاما است، pi مقادیر [0,1] و Σp را بگیریدi=1. توزیع دیریکله توزیع مشترک p را مدل می کندi و احتمال P را می دهد1=p1,P2=p2،….،پk-1=pk-1 با پk=1 – ΣPi. همانطور که در مورد بتا، ai پارامترها را می توان به عنوان شبه شماری از ظاهر هر رویداد i در نظر گرفت. توزیع دیریکله برای مدل سازی احتمال وقوع k رویدادهای رقیب استفاده می شود و اغلب به عنوان دیریکله (a) نشان داده می شود.

3. دیریکله پیشین با احتمال چندجمله ای

همانطور که قبلا ذکر شد، توزیع دیریکله را می توان به عنوان توزیعی بر توزیع های احتمالی دید. در مواردی که می خواهیم احتمال وقوع k رویداد را مدل کنیم، از یک رویکرد بیزی استفاده می شود احتمال چند جمله ای و پیشینیان دیریکله .

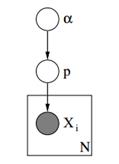

در زیر می توانیم مدل گرافیکی چنین مدلی را مشاهده کنیم.

شکل 3: مدل گرافیکی دیریکله پیشین ها با احتمال چندجمله ای

در مدل گرافیکی فوق، α بردار بعدی ak با پیش پارامترهای دیریکله، p بردار بعدی ak با مقادیر احتمال و x است.i یک مقدار اسکالر از 1 تا k است که به ما می گوید کدام رویداد رخ داده است. در نهایت باید توجه داشته باشیم که P از توزیع دیریکله با بردار α و بنابراین P~ دیریکله (α) پیروی می کند، در حالی که xi متغیرها از توزیع گسسته (چند جمله ای) با بردار p احتمالات پیروی می کنند. مدلهای سلسله مراتبی مشابهی را میتوان در طبقهبندی اسناد به کار برد تا توزیعهای فراوانی کلمات کلیدی را برای موضوعات مختلف نشان دهد.

4. مدل مخلوط محدود با توزیع دیریکله

با استفاده از توزیع دیریکله می توانیم a را بسازیم مدل مخلوط محدود که می توان از آن برای انجام خوشه بندی استفاده کرد. بیایید فرض کنیم که مدل زیر را داریم:

![]()

![]()

![]()

![]()

معادله 3: مدل مخلوط محدود با توزیع دیریکله

مدل فوق موارد زیر را فرض می کند: ما یک مجموعه داده X با n مشاهدات داریم و می خواهیم تجزیه و تحلیل خوشه ای را روی آن انجام دهیم. k یک عدد محدود ثابت است که تعداد خوشهها/مولفههایی را که ما استفاده خواهیم کرد را نشان میدهد. جi متغیرها انتساب خوشه مشاهده X را ذخیره می کنندi، مقادیر از 1 تا k را می گیرند و از توزیع گسسته با پارامتر p پیروی می کنند که احتمالات مخلوط اجزاء است. F توزیع مولد X ما است و با یک پارامتر پارامتر می شود ![]() که به انتساب خوشه هر مشاهده بستگی دارد. در کل ما k منحصر به فرد داریم

که به انتساب خوشه هر مشاهده بستگی دارد. در کل ما k منحصر به فرد داریم ![]() پارامترهایی برابر با تعداد خوشه های ما است. در

پارامترهایی برابر با تعداد خوشه های ما است. در ![]() متغیر پارامترهایی را ذخیره می کند که توزیع F مولد را پارامتر می کنند و ما فرض می کنیم که از پایه G پیروی می کند.0 توزیع متغیر p درصدهای مخلوط را برای هر یک از خوشههای k ذخیره میکند و دیریکله را با پارامترهای α/k دنبال میکند. در نهایت α بردار بعدی ak با فراپارامترهای (شبه شمار) توزیع دیریکله است [2].

متغیر پارامترهایی را ذخیره می کند که توزیع F مولد را پارامتر می کنند و ما فرض می کنیم که از پایه G پیروی می کند.0 توزیع متغیر p درصدهای مخلوط را برای هر یک از خوشههای k ذخیره میکند و دیریکله را با پارامترهای α/k دنبال میکند. در نهایت α بردار بعدی ak با فراپارامترهای (شبه شمار) توزیع دیریکله است [2].

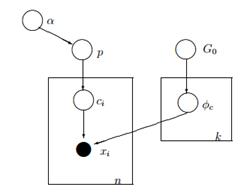

شکل 4: مدل گرافیکی مدل مخلوط محدود با توزیع دیریکله

یک روش ساده تر و کم ریاضی برای توضیح مدل به شرح زیر است. ما فرض می کنیم که داده های ما را می توان در k خوشه گروه بندی کرد. هر خوشه پارامترهای خاص خود را دارد ![]() و از آن پارامترها برای تولید داده های ما استفاده می شود. پارامترها

و از آن پارامترها برای تولید داده های ما استفاده می شود. پارامترها ![]() فرض بر این است که از توزیع G پیروی می کنند0. هر مشاهده با بردار x نشان داده می شودi و aci مقداری که نشان دهنده خوشه ای است که به آن تعلق دارد. در نتیجه جi را می توان به عنوان متغیری که از توزیع گسسته پیروی می کند با یک پارامتر p که چیزی جز احتمالات مخلوط، یعنی احتمال وقوع هر خوشه نیست، دیده می شود. با توجه به اینکه مشکل خود را به روش بیزی حل می کنیم، پارامتر p را به عنوان یک بردار مجهول ثابت در نظر نمی گیریم. در عوض فرض میکنیم که P از دیریکله پیروی میکند که با فراپارامترهای α/k پارامتر میشود.

فرض بر این است که از توزیع G پیروی می کنند0. هر مشاهده با بردار x نشان داده می شودi و aci مقداری که نشان دهنده خوشه ای است که به آن تعلق دارد. در نتیجه جi را می توان به عنوان متغیری که از توزیع گسسته پیروی می کند با یک پارامتر p که چیزی جز احتمالات مخلوط، یعنی احتمال وقوع هر خوشه نیست، دیده می شود. با توجه به اینکه مشکل خود را به روش بیزی حل می کنیم، پارامتر p را به عنوان یک بردار مجهول ثابت در نظر نمی گیریم. در عوض فرض میکنیم که P از دیریکله پیروی میکند که با فراپارامترهای α/k پارامتر میشود.

5. کار با k خوشه های بی نهایت

مدل مخلوط قبلی به ما اجازه میدهد تا یادگیری بدون نظارت را انجام دهیم، از رویکرد بیزی پیروی میکند و میتواند برای داشتن یک ساختار سلسله مراتبی گسترش یابد. با این وجود این یک مدل محدود است زیرا از یک عدد k از پیش تعریف شده ثابت از خوشه ها استفاده می کند. در نتیجه ما را ملزم میکند که قبل از انجام تحلیل خوشهای، تعداد مؤلفهها را تعریف کنیم و همانطور که قبلاً در بیشتر برنامهها بحث کردیم، این ناشناخته است و نمیتوان به راحتی تخمین زد.

یکی از راههای حل این مسئله این است که تصور کنید k مقدار بسیار زیادی دارد که به سمت بینهایت میرود. به عبارت دیگر می توانیم حد این مدل را زمانی تصور کنیم که k به بی نهایت تمایل دارد. اگر اینطور باشد، میتوانیم ببینیم که علیرغم اینکه تعداد خوشههای k بینهایت است، تعداد واقعی خوشههایی که فعال هستند (آنهایی که حداقل یک مشاهده دارند) نمیتواند بزرگتر از n باشد. تعداد کل مشاهدات در مجموعه داده ما). در واقع همانطور که بعدا خواهیم دید، تعداد خوشه های فعال به طور قابل توجهی کمتر از n خواهد بود و متناسب با ![]() .

.

البته در نظر گرفتن حد k تا بی نهایت امری بی اهمیت است. چندین سوال مطرح می شود از جمله اینکه آیا می توان چنین محدودیتی را در نظر گرفت، این مدل چگونه به نظر می رسد و چگونه می توانیم بسازیم و از چنین مدلی استفاده کنید.

در مقاله بعدی دقیقاً بر روی این سؤالات تمرکز خواهیم کرد: فرآیند دیریکله را تعریف می کنیم، بازنمایی های مختلف DP را ارائه می دهیم و در نهایت بر فرآیند رستوران چینی تمرکز خواهیم کرد که روشی بصری و کارآمد برای ساختن فرآیند دیریکله است.

امیدوارم این مطلب برای شما مفید باشد. اگر این کار را کردید، لطفا چند لحظه وقت بگذارید و مقاله را در فیس بوک و توییتر به اشتراک بگذارید. 🙂

- AI

- آی هنر

- مولد هنر ai

- ربات ai

- هوش مصنوعی

- گواهی هوش مصنوعی

- ربات هوش مصنوعی

- ربات های هوش مصنوعی

- نرم افزار هوش مصنوعی

- بلاکچین

- کنفرانس بلاک چین ai

- coingenius

- هوش مصنوعی محاوره ای

- کنفرانس کریپتو ai

- دل-ه

- Datumbox

- یادگیری عمیق

- گوگل ai

- فراگیری ماشین

- یادگیری ماشین و آمار

- افلاطون

- افلاطون آی

- هوش داده افلاطون

- بازی افلاطون

- PlatoData

- بازی پلاتو

- مقیاس Ai

- نحو

- زفیرنت