این یک پست مهمان توسط مهندس ارشد نرم افزار و یادگیری ماشین Kustomer، Ian Lantzy، و تیم AWS Umesh Kalaspurkar، Prasad Shetty و Jonathan Greifenberger است.

به قول خود کوستومر، «Kustomer پلتفرم SaaS CRM همهکانالی است که خدمات مشتریان سازمانی را برای ارائه تجربیات برجسته دوباره طراحی میکند. ما با اتوماسیون هوشمند ساخته شدهایم تا نیازهای هر مرکز تماس و کسبوکاری را با یکپارچهسازی دادهها از منابع متعدد برآورده کنیم و شرکتها را قادر میسازیم تا خدمات و پشتیبانی بدون زحمت، سازگار و شخصیشده را از طریق یک نمای جدول زمانی واحد ارائه دهند.

Kustomer می خواست توانایی تجزیه و تحلیل سریع حجم زیادی از ارتباطات پشتیبانی برای مشتریان تجاری خود - تجربه مشتری و سازمان های خدماتی - و کشف خودکار اطلاعاتی مانند قصد مشتری نهایی، موضوع خدمات مشتری و سایر بینش های مرتبط مرتبط با مصرف کننده را داشته باشد. درک این ویژگیها میتواند به سازمانهای CX کمک کند تا هزاران ایمیل پشتیبانی داخلی را با طبقهبندی و دستهبندی خودکار محتوا مدیریت کنند. اهرم های مشتری آمازون SageMaker برای مدیریت تجزیه و تحلیل ارتباطات پشتیبانی ورودی از طریق هوش مصنوعی خود IQ مشتری سکو. سرویس طبقهبندی مکالمه Kustomer IQ میتواند مکالمات را متنی کند و کارهای خستهکننده و تکراری را خودکار کند، حواس پرتی عامل و هزینه کلی هر تماس را کاهش دهد. این و سایر خدمات IQ Kustomer بهره وری و اتوماسیون را برای مشتریان تجاری خود افزایش داده است.

در این پست، ما در مورد اینکه Kustomer چگونه از تصاویر Docker سفارشی برای آموزش و استنتاج SageMaker استفاده میکند، صحبت میکنیم که ادغام را آسان میکند و فرآیند را ساده میکند. با این رویکرد، مشتریان تجاری Kustomer هر ماه به طور خودکار بیش از 50 هزار ایمیل پشتیبانی را با دقت 70 درصد طبقه بندی می کنند.

پیشینه و چالش ها

Kustomer از خط لوله طبقه بندی متن سفارشی برای سرویس طبقه بندی مکالمه خود استفاده می کند. این به آنها کمک می کند هزاران درخواست را در روز از طریق طبقه بندی و طبقه بندی خودکار با استفاده از آموزش و هماهنگی استنتاج SageMaker مدیریت کنند. موتور آموزشی Conversation Classification از تصاویر Docker سفارشی برای پردازش دادهها و آموزش مدلها با استفاده از مکالمات تاریخی استفاده میکند و سپس موضوعات، دستهها یا سایر برچسبهای سفارشی مورد نیاز یک نماینده خاص را برای طبقهبندی مکالمات پیشبینی میکند. سپس موتور پیشبینی از مدلهای آموزشدیده با یک تصویر داکر سفارشی دیگر برای دستهبندی مکالمات استفاده میکند، که سازمانها از آن برای خودکار کردن گزارشها یا هدایت مکالمات به یک تیم خاص بر اساس موضوع خود استفاده میکنند.

فرآیند طبقهبندی SageMaker با ایجاد یک خط لوله آموزشی و استنتاج که میتواند طبقهبندی متن و توصیههای متنی را ارائه دهد، آغاز میشود. یک راه اندازی معمولی با رویکردهای بدون سرور اجرا می شود AWS لامبدا برای پیش پردازش و پس پردازش داده، زیرا دارای حداقل نیاز تامین با یک مدل قیمت گذاری بر اساس تقاضای موثر است. با این حال، استفاده از SageMaker با وابستگیهایی مانند TensorFlow، NumPy، و Pandas میتواند به سرعت اندازه بسته مدل را افزایش دهد و مدیریت کلی فرآیند استقرار را دشوار و دشوار کند. Kustomer از تصاویر سفارشی Docker برای غلبه بر این چالش ها استفاده کرد.

تصاویر Docker سفارشی مزایای قابل توجهی را ارائه می دهند:

- به اندازههای بسته فشرده بزرگتر (بیش از 10 گیگابایت)، که میتواند شامل چارچوبهای معروف یادگیری ماشینی (ML) مانند TensorFlow، MXNet، PyTorch یا موارد دیگر باشد، اجازه میدهد.

- به شما امکان می دهد کدهای سفارشی یا الگوریتم های توسعه یافته محلی را بیاورید Amazon SageMaker Studio نوت بوک برای تکرار سریع و آموزش مدل.

- از تأخیرهای پیش پردازش ناشی از لامبدا هنگام باز کردن بسته های استقرار جلوگیری می کند.

- انعطاف پذیری را برای ادغام یکپارچه با سیستم های داخلی ارائه می دهد.

- سازگاری و مقیاس پذیری آینده تبدیل یک سرویس با استفاده از Docker را به جای بسته بندی فایل های zip. در تابع Lambda آسان تر می کند.

- زمان چرخش خط لوله استقرار CI/CD را کاهش می دهد.

- آشنایی Docker در تیم و سهولت استفاده را فراهم می کند.

- دسترسی به ذخیرههای داده را از طریق APIها و زمان اجرا فراهم میکند.

- پشتیبانی بهتری را برای مداخله برای هر پیش پردازش یا پس پردازشی ارائه می دهد که لامبدا به یک سرویس محاسباتی جداگانه برای هر فرآیند (مانند آموزش یا استقرار) نیاز دارد.

بررسی اجمالی راه حل

دستهبندی و برچسبگذاری ایمیلهای پشتیبانی یک گام مهم در فرآیند پشتیبانی مشتری است. این به شرکتها اجازه میدهد تا مکالمات را به سمت تیمهای مناسب هدایت کنند و در سطح بالایی بفهمند که مشتریانشان درباره چه چیزی با آنها تماس میگیرند. مشتریان تجاری Kustomer هر روز هزاران مکالمه را مدیریت می کنند، بنابراین طبقه بندی در مقیاس یک چالش است. خودکارسازی این فرآیند به نمایندگان کمک میکند تا مؤثرتر باشند و پشتیبانی منسجمتری ارائه دهند و با برقراری ارتباط سریعتر با افراد مناسب، به مشتریان خود کمک میکند.

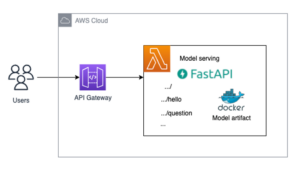

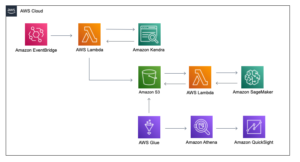

نمودار زیر معماری راه حل را نشان می دهد:

فرآیند طبقهبندی مکالمه زمانی شروع میشود که مشتری تجاری به Kustomer اجازه میدهد تا یک خط لوله آموزش و استنتاج راهاندازی کند که میتواند در طبقهبندی متن و توصیههای متنی به آنها کمک کند. Kustomer یک رابط کاربری را برای نظارت بر فرآیند آموزش و استنتاج در اختیار مشتریان خود قرار می دهد که با استفاده از SageMaker همراه با مدل های TensorFlow و تصاویر سفارشی Docker پیاده سازی می شود. فرآیند ساخت و استفاده از یک طبقهبندی کننده به پنج گردش کار اصلی تقسیم میشود که توسط یک سرویس کارگر در حال اجرا بر روی آن هماهنگ میشود. آمازون ECS. برای هماهنگ کردن رویدادهای خط لوله و راه اندازی آموزش و استقرار مدل، کارگر از یک استفاده می کند آمازون SQS با استفاده از Node.js SDK ارائه شده توسط AWS، مستقیماً با SageMaker ادغام می شود. گردش کار عبارتند از:

- صادرات داده

- پردازش داده ها

- آموزش

- گسترش

- استنباط

صادرات داده

فرآیند صادرات داده بر اساس تقاضا اجرا می شود و با فرآیند تأیید مشتری تجاری Kustomer برای تأیید استفاده از داده های ایمیل برای تجزیه و تحلیل شروع می شود. داده های مربوط به فرآیند طبقه بندی از طریق ایمیل اولیه دریافت شده از مشتری نهایی جمع آوری می شود. به عنوان مثال، یک ایمیل پشتیبانی معمولاً حاوی فکر منسجم کامل از مشکل با جزئیات مربوط به موضوع است. به عنوان بخشی از فرآیند صادرات، ایمیل ها از فروشگاه داده جمع آوری می شوند (MongoDB و جستجوی باز آمازون) و ذخیره شد سرویس ذخیره سازی ساده آمازون (Amazon S3).

پردازش داده ها

مرحله پیش پردازش داده، مجموعه داده را برای آموزش و گردش کار استنتاج با حذف هر برچسب HTML از ایمیل های مشتری و تغذیه آنها از طریق چندین مرحله تمیز کردن و پاکسازی برای شناسایی هر گونه HTML نادرست، پاک می کند. این فرآیند شامل استفاده از توکن سازها و ترانسفورماتورهای Hagging Face. هنگامی که فرآیند پاکسازی کامل شد، هر توکن سفارشی اضافی مورد نیاز برای آموزش به مجموعه داده خروجی اضافه می شود.

در مرحله پیش پردازش، یک تابع Lambda یک تصویر Docker سفارشی را فراخوانی می کند. این تصویر از یک پایه باریک پایتون 3.8 تشکیل شده است AWS Lambda Python Runtime Interface Client، و وابستگی هایی مانند NumPy و پانداها. تصویر سفارشی Docker در ذخیره می شود رجیستری ظروف الاستیک آمازون (Amazon ECR) و سپس از طریق خط لوله CI/CD برای استقرار تغذیه می شود. تابع Lambda مستقر شده داده ها را برای تولید سه مجموعه داده مجزا در هر طبقه بندی کننده نمونه برداری می کند:

- آموزش - برای فرآیند آموزش واقعی استفاده می شود

- اعتبار - برای اعتبارسنجی در طول فرآیند آموزش TensorFlow استفاده می شود

- تست - در پایان فرآیند آموزش برای مقایسه مدل های معیار استفاده می شود

مجموعه دادههای خروجی تولید شده، فایلهای ترشی پاندا هستند که در آمازون S3 ذخیره میشوند تا در مرحله آموزش مورد استفاده قرار گیرند.

آموزش

تصویر آموزشی سفارشی Kustomer از یک داکر بهینه سازی شده توسط GPU TensorFlow 2.7 استفاده می کند. تصویر به عنوان پایه کد سفارشی، وابستگیها و مدلهای پایه قبل از آپلود تصویر آموزشی docker سفارشی در ECR گنجانده شدهاند. از انواع نمونه های P3 برای فرآیند آموزش استفاده می شود و استفاده از یک تصویر پایه بهینه سازی شده GPU به کارآمدتر شدن هرچه بیشتر فرآیند آموزش کمک می کند. Amazon SageMaker با این تصویر داکر سفارشی برای آموزش مدلهای TensorFlow استفاده میشود که سپس در S3 ذخیره میشوند. معیارهای سفارشی نیز برای کمک به قابلیتهای اضافی مانند مقایسه مدل و آموزش مجدد خودکار محاسبه و ذخیره میشوند. پس از تکمیل مرحله آموزش، به کارگر هوش مصنوعی اطلاع داده می شود و مشتری تجاری می تواند گردش کار استقرار را شروع کند.

گسترش

برای گردش کار استقرار، یک تصویر استنتاج داکر سفارشی با استفاده از تصویر پایه سرویس دهی TensorFlow (که به طور خاص برای استنتاج سریع ساخته شده است) ایجاد می شود. کدها و وابستگیهای اضافی مانند numPy، Pandas، NL سفارشی و غیره برای ارائه عملکردهای اضافی، مانند قالببندی و تمیز کردن ورودیها قبل از استنتاج گنجانده شدهاند. FastAPI نیز به عنوان بخشی از تصویر سفارشی گنجانده شده است و برای ارائه نقاط پایانی REST API برای استنتاج و بررسی سلامت استفاده می شود. سپس SageMaker پیکربندی میشود تا مدلهای TensorFlow ذخیرهشده در S3 را با تصویر استنتاج بر روی نمونههای ml.c5 AWS بهینهسازی شده محاسبه کند تا نقاط پایانی استنتاج با کارایی بالا تولید کند. هر نقطه پایانی برای استفاده توسط یک مشتری ایجاد می شود تا مدل ها و داده های خود را جدا کند.

استنباط

پس از تکمیل گردش کار استقرار، گردش کار استنتاج کار را به دست می گیرد. همه اولین ایمیلهای پشتیبانی ورودی از طریق API استنتاج برای طبقهبندیکنندههای مستقر شده خاص آن مشتری ارسال میشوند. سپس طبقهبندیکنندههای مستقر شده، طبقهبندی متن را در هر یک از این ایمیلها انجام میدهند و هر کدام برچسبهای طبقهبندی را برای مشتری ایجاد میکنند.

پیشرفت ها و سفارشی سازی های احتمالی

Kustomer در حال بررسی توسعه راه حل با پیشرفت های زیر است:

- DLC های بغل کردن صورت – Kustomer در حال حاضر از تصاویر Docker پایه TensorFlow برای مرحله پیش پردازش داده ها استفاده می کند و قصد دارد به ظروف یادگیری عمیق چهره در آغوش گرفتن (DLC). این به شما کمک میکند فوراً مدلهای آموزشی را شروع کنید، از فرآیند پیچیده ساختن و بهینهسازی محیطهای آموزشی خود از ابتدا صرفنظر کنید. برای اطلاعات بیشتر ببین صورت در آغوش گرفتن در آمازون SageMaker.

- حلقه بازخورد - می توانید یک حلقه بازخورد را با استفاده از تکنیک های یادگیری فعال یا یادگیری تقویتی اجرا کنید تا کارایی کلی مدل را افزایش دهید.

- ادغام با سایر سیستم های داخلی – Kustomer توانایی یکپارچهسازی طبقهبندی متن با سیستمهای دیگر مانند Smart Suggestions را میخواهد، که یکی دیگر از خدمات Kustomer IQ است که صدها میانبر را بررسی میکند و میانبرهایی را پیشنهاد میکند که بیشترین ارتباط را با درخواست مشتری دارند، زمان پاسخدهی و عملکرد نماینده را بهبود میبخشد.

نتیجه

در این پست، نحوه استفاده Kustomer از تصاویر Docker سفارشی برای آموزش و استنتاج SageMaker را مورد بحث قرار دادیم، که یکپارچگی را آسان میکند و فرآیند را ساده میکند. ما نشان دادیم که چگونه Kustomer از Lambda و SageMaker با تصاویر Docker سفارشی استفاده میکند که به اجرای فرآیند طبقهبندی متن با گردشهای کاری پیشپردازش و پسپردازش کمک میکند. این انعطاف پذیری را برای استفاده از تصاویر بزرگتر برای ایجاد مدل، آموزش و استنتاج فراهم می کند. پشتیبانی از تصویر کانتینر برای Lambda به شما امکان می دهد عملکرد خود را حتی بیشتر سفارشی کنید و موارد استفاده جدید بسیاری را برای ML بدون سرور باز کنید. این راه حل از چندین سرویس AWS از جمله SageMaker، Lambda، Docker images، Amazon ECR، Amazon ECS، Amazon SQS و Amazon S3 بهره می برد.

اگر می خواهید در مورد Kustomer بیشتر بدانید، ما شما را تشویق می کنیم که از آن بازدید کنید وب سایت Kustomer و آنها را کشف کنید مطالعات موردی

کلیک کنید اینجا کلیک نمایید برای شروع سفر خود با Amazon SageMaker. برای تجربه عملی، می توانید به Amazon SageMaker مراجعه کنید کارگاه.

درباره نویسنده

اومش کالاسپورکار یک معمار راه حل مستقر در نیویورک برای AWS است. او بیش از 20 سال تجربه در طراحی و ارائه پروژههای نوآوری و تحول دیجیتال در بین شرکتها و استارتآپها دارد. او با کمک به مشتریان در شناسایی و غلبه بر چالش ها انگیزه دارد. اومش خارج از کار از پدر بودن، اسکی و مسافرت لذت می برد.

اومش کالاسپورکار یک معمار راه حل مستقر در نیویورک برای AWS است. او بیش از 20 سال تجربه در طراحی و ارائه پروژههای نوآوری و تحول دیجیتال در بین شرکتها و استارتآپها دارد. او با کمک به مشتریان در شناسایی و غلبه بر چالش ها انگیزه دارد. اومش خارج از کار از پدر بودن، اسکی و مسافرت لذت می برد.

ایان لانتزی یک مهندس ارشد نرم افزار و یادگیری ماشین برای Kustomer است و در انجام وظایف تحقیقاتی یادگیری ماشین و تبدیل آنها به خدمات تولید تخصص دارد.

ایان لانتزی یک مهندس ارشد نرم افزار و یادگیری ماشین برای Kustomer است و در انجام وظایف تحقیقاتی یادگیری ماشین و تبدیل آنها به خدمات تولید تخصص دارد.

پراساد شتی یک معمار راه حل های مستقر در بوستون برای AWS است. او محصولات نرم افزاری ساخته است و بیش از 20 سال است که نوآوری و نوآوری دیجیتال در محصولات و خدمات را در سراسر شرکت ها رهبری کرده است. او مشتاق هدایت استراتژی ابری و پذیرش آن و استفاده از فناوری برای ایجاد تجربیات عالی برای مشتری است. پراساد در اوقات فراغت خود از دوچرخه سواری و مسافرت لذت می برد.

پراساد شتی یک معمار راه حل های مستقر در بوستون برای AWS است. او محصولات نرم افزاری ساخته است و بیش از 20 سال است که نوآوری و نوآوری دیجیتال در محصولات و خدمات را در سراسر شرکت ها رهبری کرده است. او مشتاق هدایت استراتژی ابری و پذیرش آن و استفاده از فناوری برای ایجاد تجربیات عالی برای مشتری است. پراساد در اوقات فراغت خود از دوچرخه سواری و مسافرت لذت می برد.

جاناتان گریفنبرگر یک مدیر ارشد حساب مستقر در نیویورک برای AWS با 25 سال تجربه در صنعت فناوری اطلاعات است. جاناتان تیمی را رهبری میکند که به مشتریانی از صنایع مختلف و بخشهای عمودی در مسیر پذیرش و مدرنسازی ابر کمک میکند.

جاناتان گریفنبرگر یک مدیر ارشد حساب مستقر در نیویورک برای AWS با 25 سال تجربه در صنعت فناوری اطلاعات است. جاناتان تیمی را رهبری میکند که به مشتریانی از صنایع مختلف و بخشهای عمودی در مسیر پذیرش و مدرنسازی ابر کمک میکند.

- Coinsmart. بهترین صرافی بیت کوین و کریپتو اروپا.

- پلاتوبلاک چین. Web3 Metaverse Intelligence. دانش تقویت شده دسترسی رایگان.

- CryptoHawk. رادار آلت کوین امتحان رایگان.

- منبع: https://aws.amazon.com/blogs/machine-learning/how-kustomer-utilizes-custom-docker-images-amazon-sagemaker-to-build-a-text-classification-pipeline/

- "

- &

- 100

- سال 20

- 7

- درباره ما

- دسترسی

- حساب

- در میان

- فعال

- اضافی

- اتخاذ

- مزیت - فایده - سود - منفعت

- مزایای

- عاملان

- AI

- الگوریتم

- معرفی

- آمازون

- تحلیل

- دیگر

- API

- رابط های برنامه کاربردی

- روش

- معماری

- اتوماسیون

- AWS

- بودن

- ساختن

- بنا

- کسب و کار

- قابلیت های

- موارد

- ایجاد می شود

- به چالش

- چالش ها

- چک

- طبقه بندی

- تمیز کاری

- ابر

- رمز

- ارتباطات

- شرکت

- محاسبه

- مصرف کننده

- ظرف

- ظروف

- شامل

- محتوا

- گفتگو

- گفتگو

- تجربه مشتری

- خدمات مشتری

- پشتیبانی مشتریان

- مشتریان

- داده ها

- روز

- تاخیر

- تحویل

- تقاضا

- گسترش

- طرح

- توسعه

- دیجیتال

- کشف

- کارگر بارانداز

- رانندگی

- موثر

- بهره وری

- پست الکترونیک

- را قادر می سازد

- تشویق

- نقطه پایانی

- مهندس

- سرمایه گذاری

- حوادث

- مثال

- گسترش

- تجربه

- تجارب

- چهره

- FAST

- تغذیه

- باز خورد

- نام خانوادگی

- انعطاف پذیری

- پیروی

- تابع

- قابلیت

- تولید می کنند

- دادن

- GPU

- بزرگ

- مهمان

- پست مهمان

- داشتن

- سلامتی

- کمک

- کمک می کند

- زیاد

- چگونه

- HTTPS

- صدها نفر

- شناسایی

- تصویر

- انجام

- اجرا

- مشمول

- از جمله

- افزایش

- افزایش

- لوازم

- صنعت

- اطلاعات

- ابداع

- بینش

- ادغام

- ادغام

- هوشمند

- قصد

- رابط

- موضوع

- IT

- برچسب

- برچسب ها

- بزرگ

- بزرگتر

- یاد گرفتن

- یادگیری

- رهبری

- سطح

- اهرم ها

- به صورت محلی

- دستگاه

- فراگیری ماشین

- ساخت

- مدیر

- متریک

- ML

- مدل

- مدل

- MongoDB

- اکثر

- نیویورک

- تنظیم و ارکستراسیون

- سفارش

- سازمان های

- دیگر

- در غیر این صورت

- مردم

- کارایی

- سکو

- محبوب

- ممکن

- پیش گویی

- قیمت گذاری

- مشکل

- روند

- محصول

- تولید

- بهره وری

- محصولات

- پروژه ها

- ارائه

- فراهم می کند

- به سرعت

- کاهش

- نیاز

- ضروری

- تحقیق

- پاسخ

- REST

- مسیر

- دویدن

- در حال اجرا

- مقیاس پذیری

- مقیاس

- sdk

- بدون سرور

- سرویس

- خدمات

- خدمت

- تنظیم

- ساده

- اندازه

- هوشمند

- So

- نرم افزار

- مزایا

- تخصص دارد

- به طور خاص

- انشعاب

- صحنه

- شروع

- نوپا

- ذخیره سازی

- opbevare

- پرده

- استراتژی

- سلب کردن

- مطالعات

- قابل توجه

- پشتیبانی

- سیستم های

- صحبت

- وظایف

- تیم

- تکنیک

- پیشرفته

- هزاران نفر

- از طریق

- زمان

- نشانه

- تاپیک

- آموزش

- دگرگونی

- فهمیدن

- چشم انداز

- چی

- در داخل

- کلمات

- مهاجرت کاری

- سال