در عصر اطلاعات امروزی، حجم وسیعی از دادههای موجود در اسناد بیشماری هم چالش و هم فرصتی را برای کسبوکارها ایجاد میکند. روشهای سنتی پردازش اسناد اغلب از نظر کارایی و دقت کوتاهی میکنند و فضایی را برای نوآوری، کارایی هزینه و بهینهسازی باقی میگذارند. پردازش اسناد با ظهور پردازش هوشمند اسناد (IDP) شاهد پیشرفت های چشمگیری بوده است. با IDP، کسبوکارها میتوانند دادههای بدون ساختار را از انواع اسناد مختلف به بینشهای ساختیافته و عملی تبدیل کنند، کارایی را بهطور چشمگیری افزایش داده و تلاشهای دستی را کاهش دهند. با این حال، پتانسیل به همین جا ختم نمی شود. با ادغام هوش مصنوعی مولد (AI) در فرآیند، میتوانیم قابلیتهای IDP را افزایش دهیم. هوش مصنوعی مولد نه تنها قابلیت های پیشرفته ای را در پردازش اسناد معرفی می کند، بلکه سازگاری پویا را با تغییر الگوهای داده نیز معرفی می کند. این پست شما را با هم افزایی IDP و هوش مصنوعی مولد آشنا می کند و نشان می دهد که چگونه آنها مرز بعدی را در پردازش اسناد نشان می دهند.

ما IDP را در سری پردازش اسناد هوشمند با خدمات AWS AI به تفصیل مورد بحث قرار می دهیم (قسمت 1 و قسمت 2). در این پست، نحوه گسترش معماری جدید یا موجود IDP با مدلهای زبان بزرگ (LLM) را مورد بحث قرار میدهیم. به طور خاص، ما در مورد چگونگی ادغام بحث می کنیم متن آمازون با LangChain به عنوان لودر سند و بستر آمازون برای استخراج داده ها از اسناد و استفاده از قابلیت های هوش مصنوعی در مراحل مختلف IDP.

Amazon Txtract یک سرویس یادگیری ماشینی (ML) است که به طور خودکار متن، دست خط و داده ها را از اسناد اسکن شده استخراج می کند. Amazon Bedrock یک سرویس کاملاً مدیریت شده است که انتخابی از مدلهای پایه (FM) با کارایی بالا را از طریق APIهای آسان برای استفاده ارائه میدهد.

نمودار زیر یک معماری مرجع سطح بالا است که توضیح میدهد چگونه میتوانید گردش کار IDP را با مدلهای پایه افزایش دهید. بسته به مورد استفاده و نتیجه دلخواه می توانید از LLM ها در یک یا تمام مراحل IDP استفاده کنید.

در بخشهای بعدی، عمیقاً به چگونگی ادغام متن Amazon در جریانهای کاری هوش مصنوعی با استفاده از LangChain برای پردازش اسناد برای هر یک از این وظایف خاص میپردازیم. بلوک های کد ارائه شده در اینجا برای اختصار کوتاه شده اند. رجوع به ما شود مخزن GitHub برای نوت بوک های دقیق پایتون و گام به گام.

استخراج متن از اسناد یک جنبه مهم در پردازش اسناد با LLM است. می توانید از متن آمازون برای استخراج متن خام بدون ساختار از اسناد و حفظ اشیاء نیمه ساختاریافته یا ساختار یافته اصلی مانند جفت های کلید-مقدار و جداول موجود در سند استفاده کنید. بستههای اسنادی مانند مطالبات مراقبتهای بهداشتی و بیمه یا وامهای مسکن از فرمهای پیچیده تشکیل شدهاند که حاوی اطلاعات زیادی در قالبهای ساختاریافته، نیمه ساختاریافته و بدون ساختار است. استخراج سند در اینجا گام مهمی است زیرا LLM ها از محتوای غنی برای تولید پاسخ های دقیق تر و مرتبط تر بهره می برند، که در غیر این صورت می تواند بر کیفیت خروجی LLM ها تأثیر بگذارد.

LangChain یک چارچوب منبع باز قدرتمند برای ادغام با LLM ها است. LLM ها به طور کلی همه کاره هستند اما ممکن است با وظایف خاص دامنه که در آن زمینه عمیق تر و پاسخ های ظریف مورد نیاز است مشکل داشته باشند. LangChain به توسعه دهندگان در چنین سناریوهایی قدرت می دهد تا عواملی بسازند که می توانند وظایف پیچیده را به وظایف فرعی کوچکتر تقسیم کنند. سپس وظایف فرعی می توانند زمینه و حافظه را با اتصال و زنجیره اعلان های LLM به LLM ها معرفی کنند.

LangChain ارائه می دهد لودرهای سند که می تواند داده ها را از اسناد بارگیری و تبدیل کند. می توانید از آنها برای ساختاربندی اسناد در قالب های ترجیحی استفاده کنید که می توانند توسط LLM ها پردازش شوند. این AmazonTextractPDFLoader نوعی لودر خدماتی از لودر اسناد است که راه سریعی را برای خودکارسازی پردازش اسناد با استفاده از آمازون تکسترکت در ترکیب با LangChain ارائه می دهد. برای جزئیات بیشتر در AmazonTextractPDFLoader، مراجعه کنید LangChain مستندات. برای استفاده از بارگیری اسناد متنی آمازون، با وارد کردن آن از کتابخانه LangChain شروع کنید:

from langchain.document_loaders import AmazonTextractPDFLoaderhttps_loader = AmazonTextractPDFLoader("https://sample-website.com/sample-doc.pdf")

https_document = https_loader.load() s3_loader = AmazonTextractPDFLoader("s3://sample-bucket/sample-doc.pdf")

s3_document = s3_loader.load()شما همچنین می توانید اسناد را در آمازون S3 ذخیره کنید و با استفاده از الگوی URL s3://، همانطور که در توضیح داده شد، به آنها مراجعه کنید دسترسی به یک سطل با استفاده از S3://و این مسیر S3 را به بارگذار PDF متن آمازون منتقل کنید:

import boto3

textract_client = boto3.client('textract', region_name='us-east-2') file_path = "s3://amazon-textract-public-content/langchain/layout-parser-paper.pdf"

loader = AmazonTextractPDFLoader(file_path, client=textract_client)

documents = loader.load()یک سند چند صفحه ای حاوی چندین صفحه متن خواهد بود که سپس از طریق شیء اسناد، که فهرستی از صفحات است، قابل دسترسی است. کد زیر در صفحات موجود در شیء اسناد حلقه زده و متن سند را چاپ می کند که از طریق در دسترس است page_content صفت:

print(len(documents)) for document in documents: print(document.page_content)Amazon Comprehend و LLMs را می توان به طور موثر برای طبقه بندی اسناد استفاده کرد. Amazon Comprehend یک سرویس پردازش زبان طبیعی (NLP) است که از ML برای استخراج بینش از متن استفاده می کند. Amazon Comprehend همچنین از آموزش مدل طبقهبندی سفارشی با آگاهی از طرحبندی اسنادی مانند PDF، Word و فرمتهای تصویر پشتیبانی میکند. برای کسب اطلاعات بیشتر در مورد استفاده از طبقه بندی اسناد آمازون Comprehend، مراجعه کنید طبقهبندیکننده اسناد آمازون Comprehend پشتیبانی طرحبندی را برای دقت بالاتر اضافه میکند.

هنگامی که با LLM جفت می شود، طبقه بندی اسناد به یک رویکرد قدرتمند برای مدیریت حجم زیادی از اسناد تبدیل می شود. LLM ها در طبقه بندی اسناد مفید هستند زیرا می توانند متن، الگوها و عناصر متنی سند را با استفاده از درک زبان طبیعی تجزیه و تحلیل کنند. شما همچنین می توانید آنها را برای کلاس های اسناد خاص تنظیم کنید. هنگامی که یک نوع سند جدید معرفی شده در خط لوله IDP نیاز به طبقه بندی دارد، LLM می تواند متن را پردازش کرده و سند را با مجموعه ای از کلاس ها طبقه بندی کند. کد زیر نمونهای است که از لودر سند LangChain که توسط Amazon Textract پشتیبانی میشود برای استخراج متن از سند و استفاده از آن برای طبقهبندی سند استفاده میکند. ما استفاده می کنیم Anthropic Claude نسخه 2 برای انجام طبقه بندی از طریق Amazon Bedrock مدل کنید.

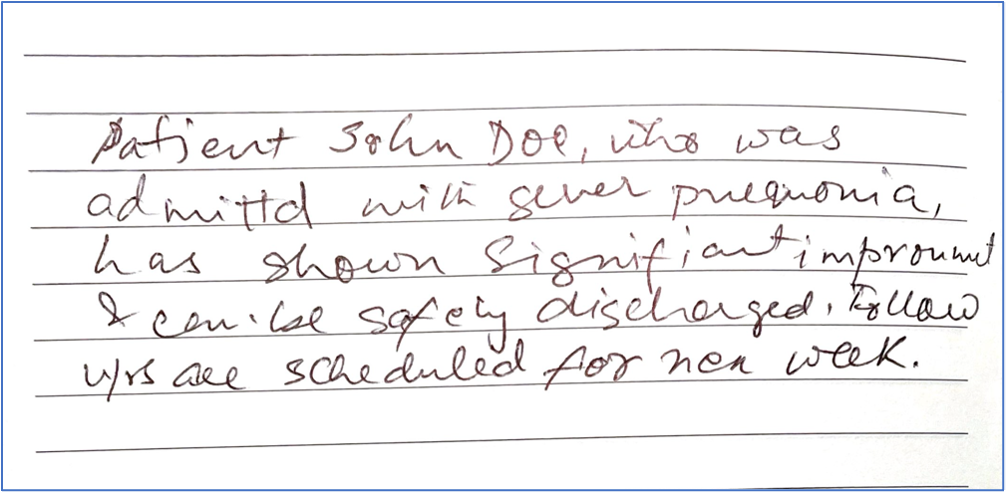

در مثال زیر، ابتدا متنی را از گزارش ترخیص بیمار استخراج می کنیم و از یک LLM برای طبقه بندی آن با فهرستی از سه نوع سند مختلف استفاده می کنیم.DISCHARGE_SUMMARY, RECEIPTو PRESCRIPTION. تصویر زیر گزارش ما را نشان می دهد.

from langchain.document_loaders import AmazonTextractPDFLoader

from langchain.llms import Bedrock

from langchain.prompts import PromptTemplate

from langchain.chains import LLMChain loader = AmazonTextractPDFLoader("./samples/document.png")

document = loader.load() template = """ Given a list of classes, classify the document into one of these classes. Skip any preamble text and just give the class name. <classes>DISCHARGE_SUMMARY, RECEIPT, PRESCRIPTION</classes>

<document>{doc_text}<document>

<classification>""" prompt = PromptTemplate(template=template, input_variables=["doc_text"])

bedrock_llm = Bedrock(client=bedrock, model_id="anthropic.claude-v2") llm_chain = LLMChain(prompt=prompt, llm=bedrock_llm)

class_name = llm_chain.run(document[0].page_content) print(f"The provided document is = {class_name}")

خلاصه سازی شامل فشرده کردن یک متن یا سند به یک نسخه کوتاهتر و در عین حال حفظ اطلاعات کلیدی آن است. این تکنیک برای بازیابی کارآمد اطلاعات مفید است، که کاربران را قادر می سازد تا به سرعت نکات کلیدی یک سند را بدون خواندن کل محتوا درک کنند. اگرچه متن آمازون مستقیماً خلاصه سازی متن را انجام نمی دهد، اما قابلیت های اساسی استخراج کل متن از اسناد را فراهم می کند. این متن استخراج شده به عنوان ورودی مدل LLM ما برای انجام وظایف خلاصه سازی متن عمل می کند.

با استفاده از همان گزارش تخلیه نمونه، استفاده می کنیم AmazonTextractPDFLoader برای استخراج متن از این سند. مانند قبل، ما از مدل Claude v2 از طریق Amazon Bedrock استفاده می کنیم و آن را با یک اعلان که حاوی دستورالعمل هایی در مورد آنچه که باید با متن انجام شود (در این مورد، خلاصه سازی) مقداردهی اولیه می کنیم. در نهایت، زنجیره LLM را با ارسال متن استخراج شده از بارگذار سند اجرا می کنیم. این یک عمل استنتاج در LLM با اعلان انجام می دهد که شامل دستورالعمل هایی برای خلاصه کردن است و متن سند با علامت گذاری شده است. Document. کد زیر را ببینید:

کد خلاصه گزارش خلاصه ترخیص بیمار را تولید می کند:

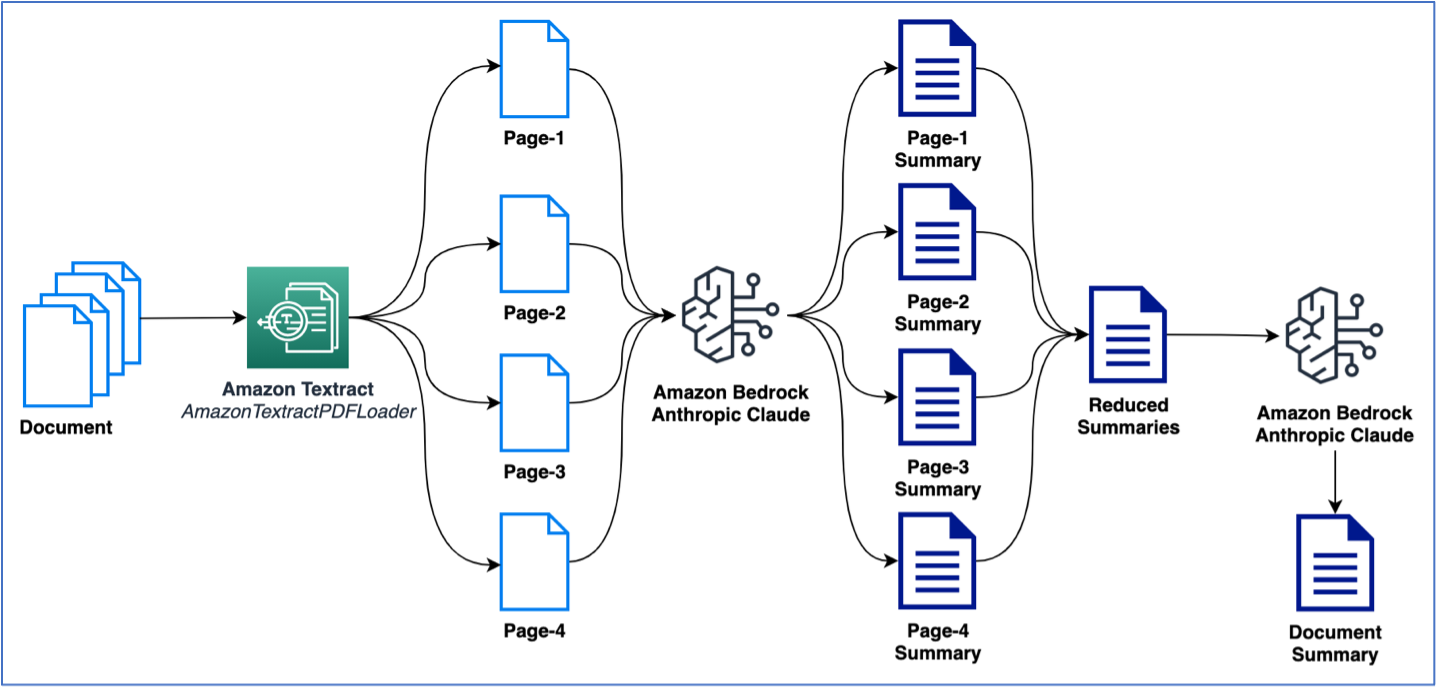

مثال قبل از یک سند تک صفحه ای برای انجام خلاصه سازی استفاده کرد. با این حال، احتمالاً با اسنادی سر و کار خواهید داشت که حاوی چندین صفحه هستند که نیاز به خلاصه سازی دارند. یک روش معمول برای انجام خلاصهسازی در چندین صفحه این است که ابتدا خلاصههایی را بر روی تکههای کوچکتر متن تولید کنید و سپس خلاصههای کوچکتر را ترکیب کنید تا خلاصه نهایی سند به دست آید. توجه داشته باشید که این روش به چندین تماس با LLM نیاز دارد. منطق این را می توان به راحتی ایجاد کرد. با این حال، LangChain یک زنجیره خلاصه سازی داخلی ارائه می کند که می تواند متون بزرگ (از اسناد چند صفحه ای) را خلاصه کند. خلاصهسازی میتواند از طریق انجام شود map_reduce یا با stuff گزینه هایی که به عنوان گزینه هایی برای مدیریت تماس های متعدد به LLM در دسترس هستند. در مثال زیر استفاده می کنیم map_reduce برای خلاصه کردن یک سند چند صفحه ای شکل زیر گردش کار ما را نشان می دهد.

بیایید ابتدا با استخراج سند شروع کنیم و تعداد کل نشانه ها در هر صفحه و تعداد کل صفحات را مشاهده کنیم:

بعد، ما از LangChain داخلی استفاده می کنیم load_summarize_chain برای خلاصه کردن کل سند:

from langchain.chains.summarize import load_summarize_chain summary_chain = load_summarize_chain(llm=bedrock_llm, chain_type='map_reduce')

output = summary_chain.run(document)

print(output.strip())استانداردسازی و پرسش و پاسخ

در این بخش، استانداردسازی و وظایف پرسش و پاسخ را مورد بحث قرار می دهیم.

استاندارد سازی

استانداردسازی خروجی یک وظیفه تولید متن است که در آن از LLM ها برای ارائه قالب بندی ثابت متن خروجی استفاده می شود. این کار به ویژه برای اتوماسیون استخراج موجودیت کلیدی که نیاز به تراز خروجی با فرمت های دلخواه دارد مفید است. برای مثال، میتوانیم بهترین شیوههای مهندسی سریع را برای تنظیم دقیق یک LLM برای قالببندی تاریخها به فرمت MM/DD/YYYY دنبال کنیم، که ممکن است با ستون DATE پایگاه داده سازگار باشد. بلوک کد زیر نمونه ای از نحوه انجام این کار با استفاده از LLM و مهندسی سریع را نشان می دهد. ما نه تنها فرمت خروجی را برای مقادیر تاریخ استاندارد می کنیم، بلکه از مدل می خواهیم تا خروجی نهایی را در قالب JSON تولید کند تا به راحتی در برنامه های پایین دست ما قابل مصرف باشد. ما استفاده می کنیم زبان بیان LangChain (LCEL) دو عمل را به هم زنجیر می کند. اولین اقدام از LLM می خواهد که یک خروجی فرمت JSON فقط از تاریخ های سند ایجاد کند. عمل دوم خروجی JSON را می گیرد و قالب تاریخ را استاندارد می کند. توجه داشته باشید که این عمل دو مرحله ای نیز ممکن است در یک مرحله با مهندسی سریع مناسب انجام شود، همانطور که در نرمال سازی و قالب بندی خواهیم دید.

خروجی نمونه کد قبلی یک ساختار JSON با تاریخ های 07/09/2020 و 08/09/2020 است که در قالب DD/MM/YYYY هستند و به ترتیب تاریخ پذیرش و ترخیص بیمار از بیمارستان هستند. به گزارش خلاصه ترخیص

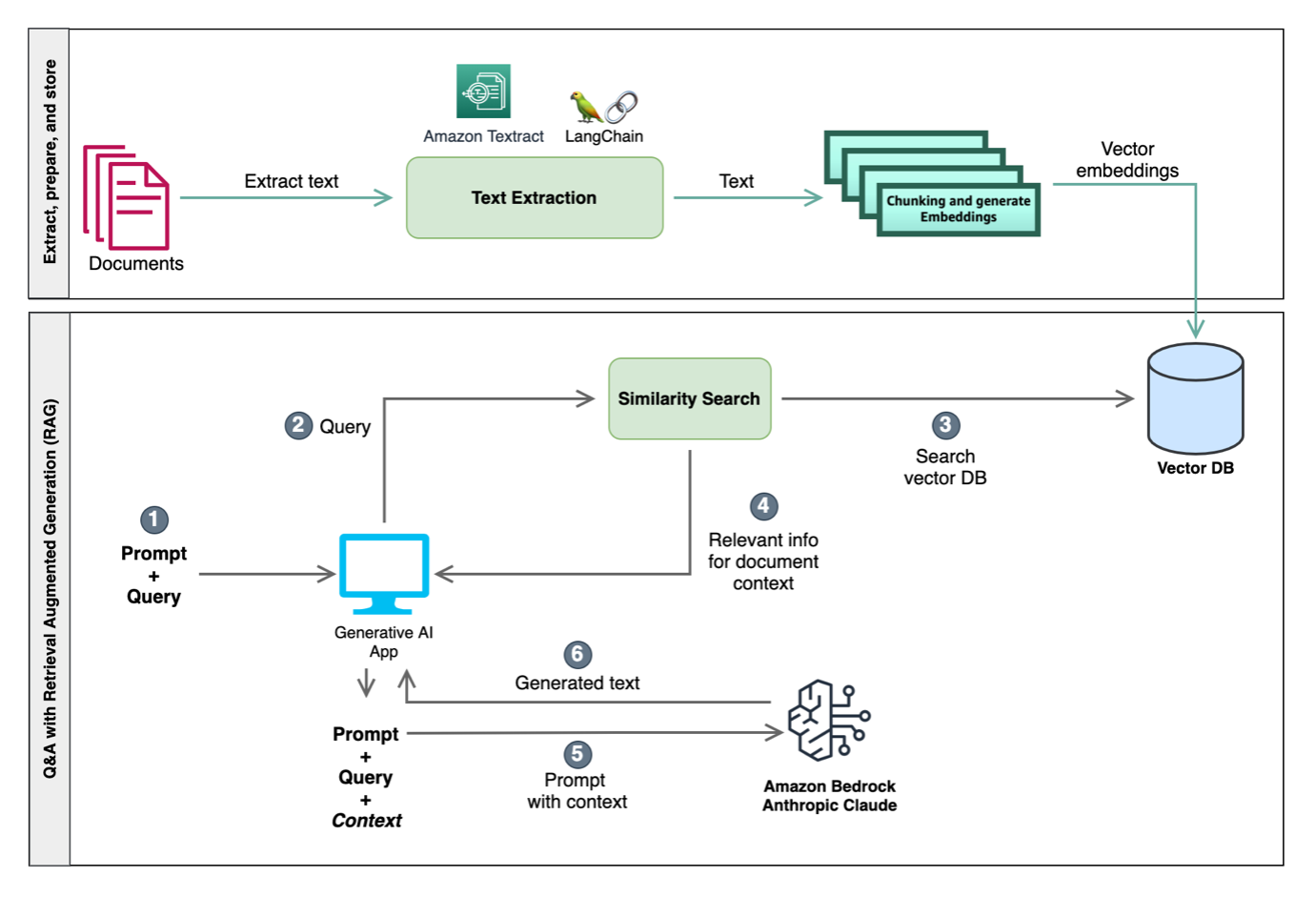

پرسش و پاسخ با Retrieval Augmented Generation

LLM ها به خاطر حفظ اطلاعات واقعی شناخته می شوند که اغلب به عنوان دانش جهانی یا جهان بینی آنها شناخته می شود. هنگامی که آنها به درستی تنظیم شوند، می توانند نتایج پیشرفته ای را ایجاد کنند. با این حال، محدودیتهایی برای اینکه چگونه یک LLM میتواند به طور مؤثر به این دانش دسترسی داشته باشد و آن را دستکاری کند، وجود دارد. در نتیجه، در وظایفی که به شدت به دانش خاصی متکی هستند، ممکن است عملکرد آنها برای موارد استفاده خاص بهینه نباشد. به عنوان مثال، در سناریوهای پرسش و پاسخ، ضروری است که مدل به طور دقیق به زمینه ارائه شده در سند بدون تکیه بر دانش جهانی خود پایبند باشد. انحراف از این امر می تواند منجر به ارائه نادرست، نادرستی یا حتی پاسخ های نادرست شود. متداول ترین روش مورد استفاده برای رفع این مشکل به نام شناخته شده است بازیابی نسل افزوده (RAG). این رویکرد نقاط قوت مدلهای بازیابی و مدلهای زبان را با هم ترکیب میکند و دقت و کیفیت پاسخهای تولید شده را افزایش میدهد.

LLMها همچنین میتوانند محدودیتهایی را به دلیل محدودیتهای حافظه و محدودیتهای سختافزاری که روی آن اجرا میکنند، اعمال کنند. برای رسیدگی به این مشکل، از تکنیکهایی مانند تکهشدن برای تقسیم اسناد بزرگ به بخشهای کوچکتر استفاده میشود که در محدوده نشانههای LLM قرار میگیرند. از سوی دیگر، تعبیهها در NLP عمدتاً برای به تصویر کشیدن معنای معنایی کلمات و روابط آنها با کلمات دیگر در فضایی با ابعاد بالا به کار میروند. این تعبیهها کلمات را به بردار تبدیل میکنند و به مدلها اجازه میدهند تا دادههای متنی را به طور موثر پردازش و درک کنند. با درک تفاوت های معنایی بین کلمات و عبارات، جاسازی ها LLM ها را قادر می سازند تا خروجی های منسجم و مرتبط با زمینه تولید کنند. به اصطلاحات کلیدی زیر توجه کنید:

- خرابکاری - این فرآیند مقادیر زیادی از متن را از اسناد به قطعات کوچکتر و معنی دارتر تجزیه می کند.

- درونه گیریها - این تبدیلهای برداری با ابعاد ثابت هر تکه هستند که اطلاعات معنایی تکهها را حفظ میکنند. این تعبیهها متعاقباً در یک پایگاه داده برداری بارگذاری میشوند.

- پایگاه داده برداری - این پایگاه داده ای از جاسازی کلمات یا بردارهایی است که زمینه کلمات را نشان می دهد. این به عنوان یک منبع دانش عمل می کند که به وظایف NLP در خطوط لوله پردازش اسناد کمک می کند. مزیت پایگاه داده برداری در اینجا این است که همانطور که در بخش زیر توضیح می دهیم تنها زمینه لازم را برای LLM ها در طول تولید متن فراهم می کند.

RAG از قدرت جاسازیها برای درک و واکشی بخشهای سند مربوطه در مرحله بازیابی استفاده میکند. با انجام این کار، RAG میتواند در محدوده محدودیتهای رمزی LLM کار کند، و اطمینان حاصل کند که مرتبطترین اطلاعات برای تولید انتخاب میشوند، که منجر به خروجیهای دقیقتر و مرتبطتر میشود.

نمودار زیر ادغام این تکنیکها را برای ایجاد ورودی به LLM نشان میدهد، درک متنی آنها را افزایش میدهد و پاسخهای درون متنی مرتبطتری را ممکن میسازد. یک رویکرد شامل جستجوی شباهت، با استفاده از هر دو پایگاه داده برداری و تکه تکه شدن است. پایگاه داده برداری جاسازی هایی را ذخیره می کند که اطلاعات معنایی را نشان می دهد و تکه تکه شدن متن را به بخش های قابل مدیریت تقسیم می کند. با استفاده از این زمینه از جستجوی شباهت، LLM ها می توانند وظایفی مانند پاسخگویی به سؤال و عملیات خاص دامنه مانند طبقه بندی و غنی سازی را اجرا کنند.

برای این پست، ما از یک رویکرد مبتنی بر RAG برای انجام پرسش و پاسخ درون متنی با اسناد استفاده میکنیم. در نمونه کد زیر، متن را از یک سند استخراج می کنیم و سپس سند را به تکه های کوچکتر متن تقسیم می کنیم. قطعه بندی مورد نیاز است زیرا ممکن است اسناد چند صفحه ای بزرگ داشته باشیم و LLM های ما ممکن است محدودیت هایی داشته باشند. سپس این تکه ها برای انجام جستجوی شباهت در مراحل بعدی در پایگاه داده برداری بارگذاری می شوند. در مثال زیر، ما از مدل Amazon Titan Embed Text v1 استفاده میکنیم که جاسازیهای برداری تکههای سند را انجام میدهد:

کد با استفاده از تکههای متنی که با عمل جستجوی شباهت از پایگاه داده برداری بازگردانده میشود، زمینه مرتبطی را برای LLM ایجاد میکند. برای این مثال، ما از یک منبع باز استفاده می کنیم فروشگاه وکتور FAISS به عنوان یک پایگاه داده برداری نمونه برای ذخیره جاسازی های برداری از هر تکه متن. سپس پایگاه داده برداری را به صورت a تعریف می کنیم LangChain retriever، که به آن منتقل می شود RetrievalQA زنجیر. این به صورت داخلی یک عبارت جستجوی شباهت را در پایگاه داده برداری اجرا می کند که n قطعه بالای متن (که در مثال ما n=3) مربوط به سؤال است را برمی گرداند. در نهایت، زنجیره LLM با زمینه مربوطه (گروهی از تکه های متن مرتبط) و سوالی که LLM باید به آن پاسخ دهد اجرا می شود. برای مشاهده کد گام به گام پرسش و پاسخ با RAG، به نوت بوک پایتون در GitHub.

به عنوان جایگزینی برای FAISS نیز می توانید استفاده کنید قابلیت های پایگاه داده برداری وکتور سرویس جستجوی باز آمازون, سرویس پایگاه داده رابطه ای آمازون (آمازون RDS) برای PostgreSQL با pgvector پسوند به عنوان پایگاه داده برداری، یا پایگاه داده منبع باز Chroma.

پرسش و پاسخ با داده های جدولی

پردازش داده های جدولی در اسناد می تواند برای LLM ها به دلیل پیچیدگی ساختاری آن چالش برانگیز باشد. متن آمازون را می توان با LLM ها تقویت کرد زیرا امکان استخراج جداول از اسناد را در قالب تو در تو از عناصر مانند صفحه، جدول و سلول ها فراهم می کند. انجام پرسش و پاسخ با داده های جدولی یک فرآیند چند مرحله ای است و می توان از طریق آن به آن دست یافت خود پرس و جو. در زیر مروری بر مراحل انجام شده است:

- جداول را از اسناد با استفاده از آمازون تکست استخراج کنید. با Amazon Textract، ساختار جدولی (ردیف ها، ستون ها، سرصفحه ها) را می توان از یک سند استخراج کرد.

- داده های جدولی را به همراه اطلاعات فراداده مانند نام سرصفحه و توضیحات هر سرصفحه در یک پایگاه داده برداری ذخیره کنید.

- از اعلان برای ساخت یک پرس و جو ساخت یافته، با استفاده از یک LLM، برای استخراج داده ها از جدول استفاده کنید.

- از کوئری برای استخراج داده های جدول مربوطه از پایگاه داده برداری استفاده کنید.

به عنوان مثال، در صورتحساب بانکی، با توجه به اعلان «معاملات با سپردههای بیش از 1000 دلار چیست»، LLM مراحل زیر را تکمیل میکند:

- ایجاد یک پرس و جو، مانند

“Query: transactions” , “filter: greater than (Deposit$)”. - پرس و جو را به یک پرس و جو ساخت یافته تبدیل کنید.

- پرس و جو ساخت یافته را در پایگاه داده برداری که داده های جدول ما در آن ذخیره می شود، اعمال کنید.

برای مشاهده نمونه کد گام به گام پرسش و پاسخ با جدول، به نوت بوک پایتون در GitHub.

الگوسازی و عادی سازی

در این بخش، ما به نحوه استفاده از تکنیک های مهندسی سریع و مکانیزم داخلی LangChain برای تولید خروجی با استخراج از یک سند در یک طرح مشخص می پردازیم. ما همچنین برخی از استانداردسازی را روی داده های استخراج شده با استفاده از تکنیک هایی که قبلاً بحث شد انجام می دهیم. ما با تعریف یک قالب برای خروجی مورد نظر خود شروع می کنیم. این به عنوان یک طرح عمل می کند و جزئیات مربوط به هر موجودیتی را که می خواهیم از متن سند استخراج کنیم، محصور می کند.

توجه داشته باشید که برای هر یک از موجودیتها، از توضیحات استفاده میکنیم تا توضیح دهیم آن موجودیت چیست تا به LLM در استخراج مقدار از متن سند کمک کند. در کد نمونه زیر، ما از این الگو برای ایجاد درخواست خود برای LLM به همراه متن استخراج شده از سند با استفاده از AmazonTextractPDFLoader و متعاقباً استنتاج را با مدل انجام دهید:

همانطور که می بینید، {keys} بخشی از اعلان کلیدهای قالب ما است و {details} کلیدها همراه با توضیحات آنها هستند. در این مورد، ما به مدل به طور صریح با فرمت خروجی غیر از مشخص کردن در دستورالعمل برای تولید خروجی در فرمت JSON، درخواست نمی کنیم. این در بیشتر موارد کار می کند. با این حال، از آنجایی که خروجی LLM ها تولید متن غیر قطعی است، ما می خواهیم فرمت را به صراحت به عنوان بخشی از دستورالعمل در اعلان مشخص کنیم. برای حل این مشکل می توانیم از LangChain استفاده کنیم تجزیه کننده خروجی ساخت یافته ماژول برای استفاده از مهندسی سریع خودکار که به تبدیل قالب ما به دستور دستور فرمت کمک می کند. ما از الگوی تعریف شده قبلی برای تولید دستور فرمت به صورت زیر استفاده می کنیم:

سپس از این متغیر در اعلان اصلی خود به عنوان دستورالعملی برای LLM استفاده می کنیم تا با ایجاد یک اصلاح کوچک در اعلان ما، خروجی را در طرح مورد نظر استخراج و قالب بندی کند:

تا کنون، ما فقط داده ها را از سند در یک طرح مورد نظر استخراج کرده ایم. با این حال، ما هنوز نیاز به انجام برخی استانداردسازی داریم. به عنوان مثال، ما می خواهیم تاریخ بستری و تاریخ ترخیص بیمار با فرمت DD/MM/YYYY استخراج شود. در این مورد، ما را افزایش می دهیم description کلید با دستورالعمل قالب بندی:

به نوت بوک پایتون در مراجعه کنید GitHub برای توضیح کامل و گام به گام.

املا و اصلاحات

LLM ها توانایی های قابل توجهی در درک و تولید متنی شبیه انسان از خود نشان داده اند. یکی از کاربردهای کمتر مورد بحث اما بسیار مفید LLM ها، پتانسیل آن ها در بررسی های گرامری و تصحیح جملات در اسناد است. برخلاف چککنندههای گرامر سنتی که بر مجموعهای از قوانین از پیش تعریفشده تکیه میکنند، LLMها از الگوهایی استفاده میکنند که از مقادیر وسیعی از دادههای متنی شناسایی کردهاند تا تعیین کنند که چه چیزی به عنوان زبان صحیح یا روان است. این بدان معنی است که آنها می توانند تفاوت های ظریف، زمینه و ظرافت هایی را که سیستم های مبتنی بر قانون ممکن است از دست بدهند، تشخیص دهند.

متنی را تصور کنید که از خلاصه ترخیص بیمار استخراج شده است که می گوید: «بیمار جان دو، که با پنومونی شدید بستری شده بود، بهبود قابل توجهی نشان داده است و می توان با خیال راحت ترخیص شد. پیگیری ها برای هفته آینده برنامه ریزی شده است. یک غلطگیر املای سنتی ممکن است «پذیرفتهشده»، «ذاتالریه»، «بهبود» و «نکته» را بهعنوان خطا تشخیص دهد. با این حال، زمینه این خطاها می تواند منجر به اشتباهات بیشتر یا پیشنهادات عمومی شود. یک LLM، مجهز به آموزش گستردهاش، ممکن است پیشنهاد کند: «بیمار جان دو، که با ذاتالریه شدید بستری شده بود، بهبود قابلتوجهی نشان داده است و میتوان با خیال راحت ترخیص شد. پیگیری ها برای هفته آینده برنامه ریزی شده است.»

در زیر یک سند نمونه دست نویس ضعیف با همان متنی است که قبلا توضیح داده شد.

ما سند را با یک بارکننده سند آمازون متن استخراج می کنیم و سپس از طریق مهندسی سریع به LLM دستور می دهیم تا متن استخراج شده را برای تصحیح هر گونه اشتباه املایی و یا گرامری تصحیح کند:

خروجی کد قبلی متن اصلی استخراج شده توسط بارگذار سند و سپس متن تصحیح شده تولید شده توسط LLM را نشان می دهد:

به خاطر داشته باشید که به همان اندازه که LLM قدرتمند هستند، ضروری است که پیشنهادات آنها را فقط به عنوان پیشنهادها در نظر بگیرید. اگرچه آنها پیچیدگی های زبان را به طرز چشمگیری درک می کنند، اما خطاناپذیر نیستند. برخی از پیشنهادات ممکن است معنی یا لحن متن اصلی را تغییر دهند. بنابراین، برای بازبینان انسانی بسیار مهم است که از اصلاحات ایجاد شده LLM به عنوان یک راهنما استفاده کنند، نه مطلق. همکاری شهود انسان با قابلیتهای LLM آیندهای را نوید میدهد که در آن ارتباطات نوشتاری ما نه تنها بدون خطا، بلکه غنیتر و ظریفتر باشد.

نتیجه

هوش مصنوعی مولد در حال تغییر نحوه پردازش اسناد با IDP برای بدست آوردن بینش است. در پست بهبود پردازش اسناد هوشمند AWS با هوش مصنوعی مولد، ما در مورد مراحل مختلف خط لوله و اینکه چگونه Ricoh مشتری AWS خط لوله IDP خود را با LLM ها تقویت می کند بحث کردیم. در این پست، مکانیسمهای مختلف افزایش گردش کار IDP با LLMها از طریق Amazon Bedrock، Amazon Textract و چارچوب محبوب LangChain را مورد بحث قرار دادیم. امروز میتوانید با استفاده از نوتبوکهای نمونه موجود در ما، با بارکننده اسناد متنی Amazon جدید با LangChain شروع کنید. مخزن GitHub. برای اطلاعات بیشتر در مورد کار با هوش مصنوعی مولد در AWS، مراجعه کنید معرفی ابزارهای جدید برای ساخت با هوش مصنوعی در AWS.

درباره نویسنده

سونالی سهو پیشرو پردازش هوشمند اسناد با تیم خدمات AI/ML در AWS است. او یک نویسنده، رهبر فکری و تکنولوژیست پرشور است. حوزه اصلی تمرکز او هوش مصنوعی و ML است و او اغلب در کنفرانس ها و جلسات AI و ML در سراسر جهان صحبت می کند. او هم وسعت و هم عمق تجربه در فناوری و صنعت فناوری، با تخصص صنعت در مراقبت های بهداشتی، بخش مالی و بیمه دارد.

سونالی سهو پیشرو پردازش هوشمند اسناد با تیم خدمات AI/ML در AWS است. او یک نویسنده، رهبر فکری و تکنولوژیست پرشور است. حوزه اصلی تمرکز او هوش مصنوعی و ML است و او اغلب در کنفرانس ها و جلسات AI و ML در سراسر جهان صحبت می کند. او هم وسعت و هم عمق تجربه در فناوری و صنعت فناوری، با تخصص صنعت در مراقبت های بهداشتی، بخش مالی و بیمه دارد.

انجان بیسواس یک معمار ارشد راه حل های خدمات هوش مصنوعی با تمرکز بر AI/ML و تجزیه و تحلیل داده ها است. Anjan بخشی از تیم خدمات هوش مصنوعی در سراسر جهان است و با مشتریان همکاری می کند تا به آنها کمک کند تا راه حل هایی برای مشکلات تجاری با هوش مصنوعی و ML ایجاد کنند. Anjan بیش از 14 سال تجربه کار با زنجیره تامین جهانی، تولید و سازمانهای خردهفروشی دارد و به طور فعال به مشتریان کمک میکند تا خدمات هوش مصنوعی AWS را شروع کرده و مقیاس کنند.

انجان بیسواس یک معمار ارشد راه حل های خدمات هوش مصنوعی با تمرکز بر AI/ML و تجزیه و تحلیل داده ها است. Anjan بخشی از تیم خدمات هوش مصنوعی در سراسر جهان است و با مشتریان همکاری می کند تا به آنها کمک کند تا راه حل هایی برای مشکلات تجاری با هوش مصنوعی و ML ایجاد کنند. Anjan بیش از 14 سال تجربه کار با زنجیره تامین جهانی، تولید و سازمانهای خردهفروشی دارد و به طور فعال به مشتریان کمک میکند تا خدمات هوش مصنوعی AWS را شروع کرده و مقیاس کنند.

چینمائی رین یک معمار راه حل های تخصصی AI/ML در خدمات وب آمازون است. او علاقه زیادی به ریاضیات کاربردی و یادگیری ماشین دارد. او بر طراحی پردازش اسناد هوشمند و راه حل های هوش مصنوعی مولد برای مشتریان AWS تمرکز دارد. خارج از محل کار، او از رقص سالسا و باچاتا لذت می برد.

چینمائی رین یک معمار راه حل های تخصصی AI/ML در خدمات وب آمازون است. او علاقه زیادی به ریاضیات کاربردی و یادگیری ماشین دارد. او بر طراحی پردازش اسناد هوشمند و راه حل های هوش مصنوعی مولد برای مشتریان AWS تمرکز دارد. خارج از محل کار، او از رقص سالسا و باچاتا لذت می برد.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- PlatoHealth. هوش بیوتکنولوژی و آزمایشات بالینی. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/intelligent-document-processing-with-amazon-textract-amazon-bedrock-and-langchain/

- : دارد

- :است

- :نه

- :جایی که

- .nex

- $1000

- $UP

- 1

- 10

- 100

- 11

- 12

- 13

- 14

- ٪۱۰۰

- 16

- 22

- 23

- 33

- ٪۱۰۰

- 7

- 9

- a

- توانایی

- درباره ما

- مطلق

- دسترسی

- قابل دسترسی است

- مطابق

- دقت

- دقیق

- دست

- در میان

- عمل

- اقدامات

- فعالانه

- فعالیت

- اعمال

- Ad

- نشانی

- می افزاید:

- پایبند بودن

- اقرار کردن

- پذیرفته

- پیشرفت

- مزیت - فایده - سود - منفعت

- ظهور

- سن

- عاملان

- AI

- خدمات هوش مصنوعی

- AI / ML

- هم راستا

- معرفی

- اجازه دادن

- اجازه می دهد تا

- در امتداد

- همچنین

- جایگزین

- هر چند

- آمازون

- درک آمازون

- آمازون RDS

- متن آمازون

- آمازون خدمات وب

- مقدار

- an

- علم تجزیه و تحلیل

- تحلیل

- و

- پاسخ

- آنتروپیک

- هر

- رابط های برنامه کاربردی

- برنامه های کاربردی

- اعمال می شود

- قرار ملاقات ها

- روش

- معماری

- هستند

- محدوده

- دور و بر

- هنر

- مصنوعی

- هوش مصنوعی

- هوش مصنوعی (AI)

- AS

- ظاهر

- همکاری

- دستیار

- At

- تقویت کردن

- افزوده شده

- نویسنده

- خودکار بودن

- خودکار

- بطور خودکار

- اتوماسیون

- در دسترس

- اطلاع

- AWS

- مشتری AWS

- بانک

- BE

- زیرا

- شود

- بوده

- قبل از

- مفید

- سود

- بهترین

- بهترین شیوه

- میان

- مسدود کردن

- بلاک ها

- هر دو

- وسعت

- شکستن

- می شکند

- ساختن

- بنا

- ساخته شده در

- کسب و کار

- کسب و کار

- اما

- by

- تماس ها

- CAN

- می توانید دریافت کنید

- قابلیت های

- گرفتن

- مورد

- موارد

- سلول ها

- معین

- زنجیر

- زنجیر

- به چالش

- به چالش کشیدن

- تغییر دادن

- تبادل

- متغیر

- چک

- انتخاب

- ادعای

- کلاس

- کلاس ها

- طبقه بندی

- طبقه بندی کنید

- رمز

- منسجم

- همکاری

- ستون

- ستون ها

- ترکیب

- ترکیب

- می آید

- مشترک

- عموما

- ارتباط

- سازگار

- کامل

- پیچیده

- پیچیدگی

- درک

- مختصر

- همایش ها

- اتصال

- استوار

- تشکیل شده است

- محدودیت ها

- ساختن

- شامل

- موجود

- شامل

- محتوا

- زمینه

- متنی

- تبدیل

- هسته

- اصلاح

- اصلاح شده

- اصلاحات

- میتوانست

- سادگی

- طراحی شده

- ایجاد

- بسیار سخت

- سفارشی

- مشتری

- مشتریان

- رقص

- داده ها

- تجزیه و تحلیل داده ها

- پایگاه داده

- پایگاه های داده

- تاریخ

- تاریخ

- مقدار

- عمیق

- عمیق تر

- تعريف كردن

- مشخص

- تعریف کردن

- نشان

- بستگی دارد

- سپرده

- عمق

- شرح داده شده

- شرح

- طراحی

- مطلوب

- جزئیات

- دقیق

- جزئیات

- تشخیص

- مشخص کردن

- توسعه

- توسعه دهندگان

- رژیم غذایی

- مختلف

- مستقیما

- بحث و تبادل نظر

- بحث کردیم

- شیرجه رفتن

- تقسیم

- تقسیم می کند

- do

- دکتر

- سند

- مستندات

- اسناد و مدارک

- داری

- نمی کند

- عمل

- دان

- انجام شده

- آیا

- پایین

- به طور چشمگیری

- دو

- در طی

- پویا

- e

- هر

- پیش از آن

- به آسانی

- آسان برای استفاده

- به طور موثر

- بهره وری

- موثر

- موثر

- تلاش

- هر دو

- عناصر

- جاسازی کردن

- به کار گرفته شده

- توانمندسازی

- قادر ساختن

- را قادر می سازد

- را قادر می سازد

- پایان

- مهندسی

- بالا بردن

- افزایش

- افزایش

- اطمینان حاصل شود

- حصول اطمینان از

- تمام

- اشخاص

- موجودیت

- مجهز بودن

- خطاهای

- ضروری است

- حتی

- مثال

- جز

- استثنا

- موجود

- تجربه

- تخصص

- توضیح دهید

- توضیح داده شده

- توضیح می دهد

- توضیح

- به صراحت

- بیان

- گسترش

- گسترش

- وسیع

- عصاره

- استخراج

- عصاره ها

- سقوط

- غلط

- بسیار

- خستگی

- زمینه

- شکل

- نهایی

- سرانجام

- مالی

- بخش مالی

- نام خانوادگی

- مناسب

- تمرکز

- تمرکز

- به دنبال

- به دنبال

- پیروی

- به دنبال آن است

- برای

- قالب

- اشکال

- یافت

- پایه

- چارچوب

- رایگان

- غالبا

- از جانب

- مرز

- کامل

- کاملا

- بیشتر

- آینده

- سوالات عمومی

- تولید می کنند

- تولید

- تولید می کند

- مولد

- نسل

- مولد

- هوش مصنوعی مولد

- دریافت کنید

- دادن

- داده

- جهانی

- دستور زبان

- فهم

- بیشتر

- گروه

- راهنمایی

- دست

- دسته

- رخ دادن

- اتفاق می افتد

- سخت افزار

- آیا

- هدر

- بهداشت و درمان

- به شدت

- کمک

- مفید

- کمک

- کمک می کند

- او

- اینجا کلیک نمایید

- در سطح بالا

- با عملکرد بالا

- بالاتر

- دارای

- بیمارستان

- چگونه

- چگونه

- اما

- HTML

- HTTPS

- انسان

- i

- ID

- شناسایی

- if

- نشان می دهد

- تصویر

- بی اندازه

- تأثیر

- واردات

- مهم

- واردات

- تحمیل

- بهبود

- in

- از جمله

- شاخص

- صنعت

- اطلاعات

- عصر اطلاعات

- ابداع

- ورودی

- بینش

- نمونه

- دستورالعمل

- بیمه

- ادغام

- یکپارچه

- ادغام

- ادغام

- اطلاعات

- هوشمند

- پردازش هوشمند اسناد

- مورد نظر

- داخلی

- به

- پیچیدگی ها

- معرفی

- معرفی

- معرفی می کند

- IT

- ITS

- جکسون

- جان

- جون خونه

- جان

- JPG

- json

- تنها

- کلید

- کلید

- دانستن

- دانش

- شناخته شده

- زبان

- بزرگ

- طرح

- رهبری

- رهبر

- برجسته

- یادگیری

- ترک

- کتابخانه

- پسندیدن

- احتمالا

- محدودیت

- محدودیت

- فهرست

- LLM

- بار

- بارکننده

- منطق

- نگاه کنيد

- خیلی

- دستگاه

- فراگیری ماشین

- ساخت

- مدیریت

- قابل کنترل

- اداره می شود

- مدیریت

- کتابچه راهنمای

- تولید

- علامت گذاری شده

- ریاضیات

- ممکن است..

- me

- معنی

- معنی دار

- به معنی

- مکانیزم

- مکانیسم

- ملاقات ها

- حافظه

- متا

- متاداده

- روش

- روش

- قدرت

- ذهن

- از دست

- اشتباهات

- ML

- مدل

- مدل

- ماژول ها

- بیش

- وام مسکن

- اکثر

- چندگانه

- نام

- نام

- طبیعی

- پردازش زبان طبیعی

- لازم

- نیاز

- ضروری

- نیازهای

- جدید

- بعد

- هفته بعد

- nlp

- دفتر یادداشت

- اکنون

- تفاوت های ظریف

- عدد

- هدف

- اشیاء

- of

- پیشنهادات

- غالبا

- on

- ONE

- فقط

- منبع باز

- عملیات

- فرصت

- بهینه

- گزینه

- or

- سازمان های

- اصلی

- دیگر

- در غیر این صورت

- ما

- خارج

- نتیجه

- تولید

- خروجی

- خارج از

- روی

- مروری

- بسته

- با ما

- صفحات

- درد

- زوج

- جفت

- بخش

- ویژه

- عبور

- گذشت

- عبور

- احساساتی

- مسیر

- بیمار

- الگو

- الگوهای

- برای

- انجام

- کارایی

- انجام

- انجام

- انجام می دهد

- فاز

- دکترا

- عبارات

- خط لوله

- برنامه

- افلاطون

- هوش داده افلاطون

- PlatoData

- لطفا

- ذات الریه

- نقطه

- محبوب

- ممکن

- پست

- پتانسیل

- قدرت

- صفحه اصلی

- قوی

- شیوه های

- دقیقا

- دقت

- مرجح

- در حال حاضر

- قبلا

- در درجه اول

- چاپ

- چاپ

- مشکل

- مشکلات

- روند

- فرآوری شده

- در حال پردازش

- تولید کردن

- وعده

- مناسب

- ارائه

- ارائه

- ارائه دهنده

- فراهم می کند

- پــایتــون

- پرسش و پاسخ

- کیفیت

- سوال

- سریع

- به سرعت

- خام

- مطالعه

- شناختن

- کاهش

- مراجعه

- مرجع

- اشاره

- روابط

- مربوط

- تکیه

- تکیه بر

- قابل توجه

- گزارش

- نشان دادن

- نمایندگی

- ضروری

- نیاز

- به ترتیب

- پاسخ

- محدودیت های

- نتیجه

- نتیجه

- نتایج

- خرده فروشی

- نگه داشتن

- حفظ

- بازده

- غنی

- اتاق

- قوانین

- دویدن

- اجرا می شود

- s

- با خیال راحت

- همان

- گفتن

- مقیاس

- سناریوها

- برنامه ریزی

- جستجو

- دوم

- بخش

- بخش

- بخش

- دیدن

- بخش ها

- انتخاب شد

- ارشد

- جمله

- سلسله

- خدمت

- خدمت

- سرویس

- خدمات

- تنظیم

- شدید

- او

- کوتاه

- باید

- نشان داده شده

- نشان می دهد

- قابل توجه

- تنها

- کوچک

- کوچکتر

- قطعه

- So

- فقط

- مزایا

- حل

- برخی از

- منبع

- فضا

- صحبت می کند

- متخصص

- خاص

- به طور خاص

- مشخص شده

- هجی

- انشعاب

- مراحل

- استاندارد سازی

- شروع

- آغاز شده

- وضعیت هنر

- بیانیه

- گام

- مراحل

- هنوز

- opbevare

- ذخیره شده

- پرده

- نقاط قوت

- رشته

- ساختاری

- ساختار

- ساخت یافته

- مبارزه

- متعاقب

- متعاقبا

- چنین

- نشان می دهد

- خلاصه کردن

- خلاصه

- عرضه

- زنجیره تامین

- پشتیبانی

- پشتیبانی از

- همکاری

- سیستم های

- جدول

- گرفتن

- طول می کشد

- کار

- وظایف

- تیم

- تکنیک

- تکنیک

- تکنسین

- پیشرفته

- قالب

- قوانین و مقررات

- متن

- متن

- نسبت به

- که

- La

- جهان

- شان

- آنها

- سپس

- آنجا.

- از این رو

- اینها

- آنها

- این

- فکر

- سه

- از طریق

- تیتان

- به

- امروز

- امروز

- با هم

- رمز

- نشانه

- TONE

- ابزار

- بالا

- جمع

- سنتی

- عقبی

- آموزش

- معاملات

- دگرگون کردن

- تحولات

- درست

- امتحان

- دو

- نوع

- انواع

- فهمیدن

- درک

- بر خلاف

- آشکار شدن

- URL

- استفاده کنید

- مورد استفاده

- استفاده

- کاربران

- استفاده

- با استفاده از

- استفاده

- با استفاده از

- v1

- ارزش

- ارزشها

- متغیر

- مختلف

- وسیع

- همه کاره

- نسخه

- از طريق

- چشم انداز

- جلد

- خرید

- می خواهم

- بود

- مسیر..

- we

- وب

- خدمات وب

- هفته

- خوب

- چی

- چه زمانی

- که

- در حین

- WHO

- اراده

- با

- در داخل

- بدون

- شاهد

- کلمه

- کلمات

- مهاجرت کاری

- گردش کار

- گردش کار

- کارگر

- با این نسخهها کار

- جهان

- خواهد بود

- کتبی

- X

- سال

- شما

- زفیرنت