پردازش اسناد چیست؟

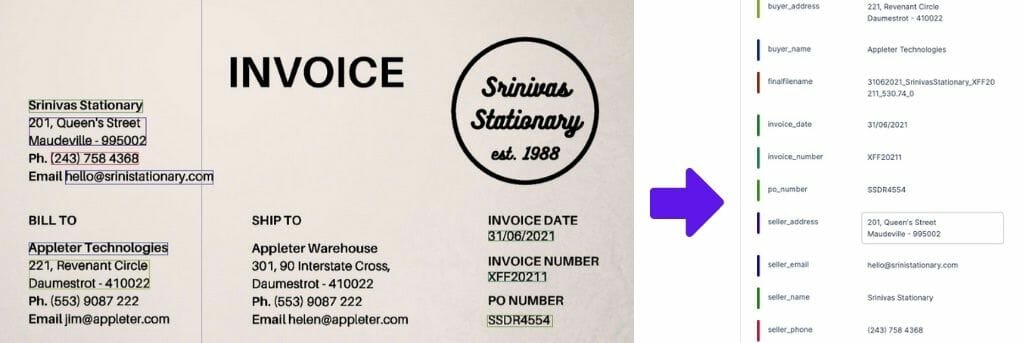

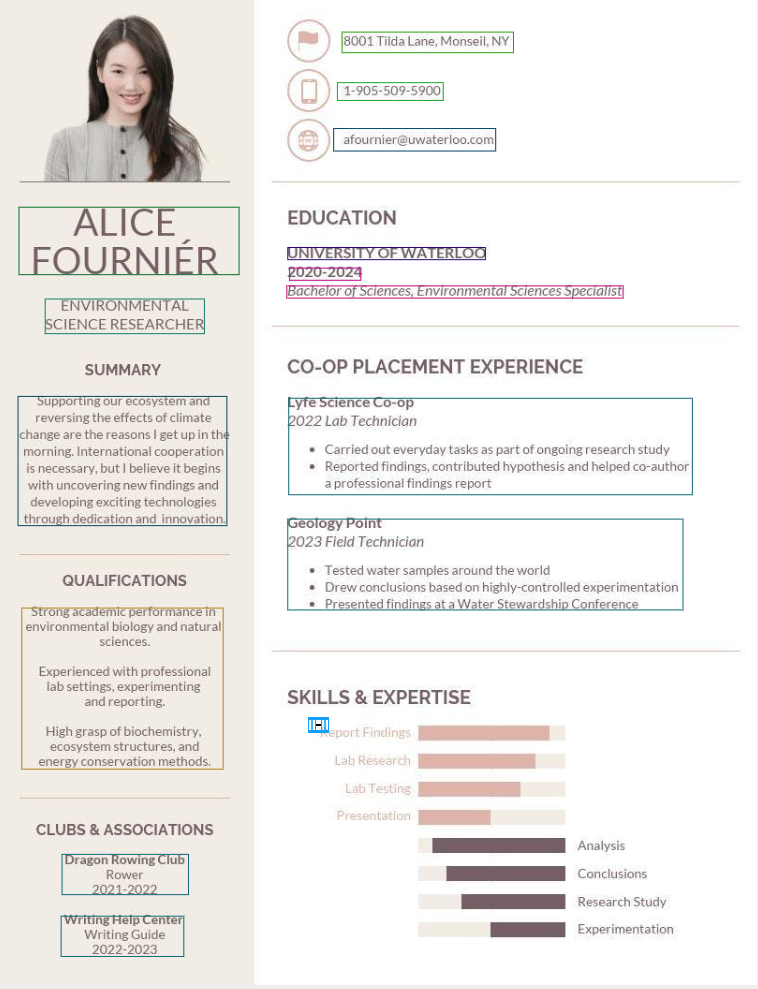

پردازش اسناد، فرآیند استخراج خودکار داده های ساختاریافته از اسناد است. این می تواند برای هر مدرکی باشد، مثلاً فاکتور، رزومه، کارت شناسایی و غیره. بخش چالش برانگیز در اینجا فقط OCR نیست. گزینه های زیادی با هزینه کم وجود دارد که می تواند متن را استخراج کرده و موقعیت مکانی را به شما بدهد. چالش واقعی برچسب گذاری دقیق و خودکار این تکه های متن است.

تأثیر تجاری پردازش اسناد

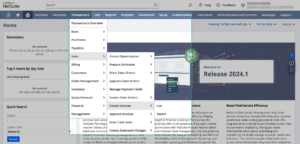

چندین صنعت به شدت به پردازش اسناد برای عملیات روزانه خود متکی هستند. این فهرست ادامه مییابد، سازمانهای مالی نیاز به دسترسی به پروندههای SEC، پروندههای بیمه دارند، یک شرکت تجارت الکترونیک یا زنجیره تامین ممکن است نیاز به دسترسی به فاکتورهایی داشته باشد که استفاده میشوند. دقت این اطلاعات به اندازه زمان ذخیره شده مهم است، به همین دلیل است که ما همیشه توصیه می کنیم از روش های پیشرفته یادگیری عمیق استفاده کنید که بیشتر تعمیم می دهند و دقیق تر هستند.

بر اساس این گزارش توسط PwC، [پیوند] حتی ابتدایی ترین مقدار استخراج داده های ساخت یافته می تواند به صرفه جویی 30 تا 50 درصد از زمان صرف شده برای کپی دستی و چسباندن داده ها از فایل های PDF به صفحات گسترده اکسل کمک کند. مدل هایی مانند LayoutLM مطمئناً ابتدایی نیستند، آنها به عنوان عوامل بسیار هوشمندی ساخته شده اند که قادر به استخراج داده های دقیق در مقیاس، در موارد مختلف استفاده هستند. حتی با بسیاری از مشتریان خودمان، زمان مورد نیاز برای استخراج داده ها به صورت دستی را از 20 دقیقه در هر سند به کمتر از 10 ثانیه کاهش داده ایم. این یک جابجایی عظیم است که کارگران را قادر میسازد تا بازدهی بیشتری داشته باشند و به طور کلی توان عملیاتی بالاتری داشته باشند.

بنابراین در کجا می توان هوش مصنوعی مشابه LayoutLM را اعمال کرد؟ در Nanonets، ما از چنین فناوری استفاده کرده ایم

و بسیاری موارد استفاده دیگر

چرا LayoutLM؟

چگونه یک مدل یادگیری عمیق میفهمد که یک قطعه متن داده شده، شرح مورد در فاکتور است یا شماره فاکتور؟ به بیان ساده، چگونه یک مدل یاد می گیرد که چگونه برچسب ها را به درستی اختصاص دهد؟

یکی از روشها استفاده از جاسازیهای متنی از یک مدل زبانی عظیم مانند BERT یا GPT-3 و اجرای آن از طریق یک طبقهبندیکننده است – اگرچه این کار چندان مؤثری نیست. اطلاعات زیادی وجود دارد که نمی توان آنها را صرفاً با استفاده از متن اندازه گیری کرد. یا می توان از اطلاعات مبتنی بر تصویر استفاده کرد. این با استفاده از مدل های R-CNN و Faster R-CNN به دست آمد. با این حال، این هنوز به طور کامل از اطلاعات موجود در اسناد استفاده نمی کند. یکی دیگر از رویکردهای مورد استفاده، شبکههای عصبی کانولوشن گراف بود که اطلاعات مکانی و متنی را با هم ترکیب میکرد، اما اطلاعات تصویر را در نظر نمیگرفت.

پس چگونه از هر سه بعد اطلاعات یعنی متن، تصویر و مکان متن داده شده نیز استفاده کنیم؟ اینجاست که مدلهایی مانند LayoutLM وارد میشوند. علیرغم اینکه LayoutLM سالها قبل یک حوزه تحقیقاتی فعال بود، یکی از اولین مدلهایی بود که با ترکیب قطعات برای ایجاد یک مدل منحصر به فرد به موفقیت دست یافت که برچسبگذاری را با استفاده از اطلاعات موقعیتی، اطلاعات مبتنی بر متن انجام میداد. و همچنین اطلاعات تصویری

آموزش LayoutLM

این مقاله فرض می کند که شما می دانید مدل زبان چیست. اگر نه، نگران نباشید، ما یک مقاله در مورد آن نیز نوشتیم! اگر میخواهید در مورد مدلهای ترانسفورماتور و توجه به آن بیشتر بدانید، اینجا مقاله ای شگفت انگیز از جی آلمار است.

با فرض اینکه این موارد را از سر راه برداشته ایم، بیایید با آموزش شروع کنیم. ما از مقاله LayoutLM اصلی به عنوان مرجع اصلی استفاده خواهیم کرد.

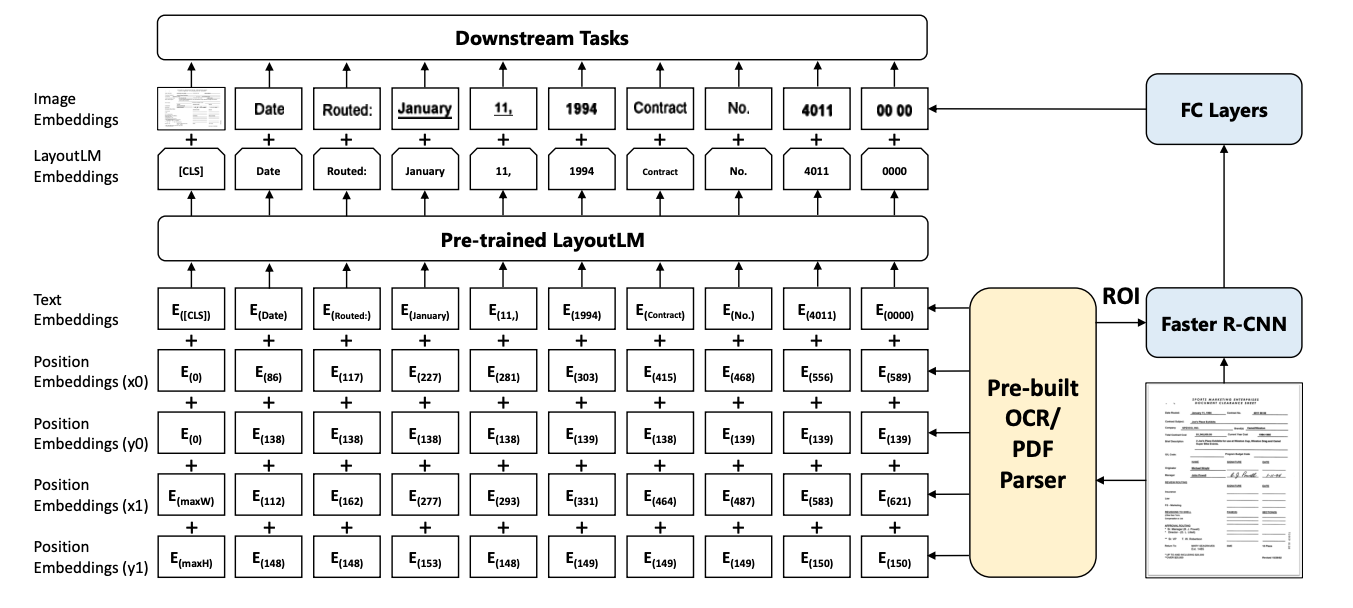

استخراج متن OCR

اولین کاری که ما با یک سند انجام می دهیم این است که اطلاعات مبتنی بر متن را از سند استخراج کنیم و مکان های مربوط به آنها را پیدا کنیم. از نظر مکان، ما به چیزی به نام "جعبه مرزی" اشاره می کنیم. کادر محصور مستطیلی است که تکه متن روی صفحه را محصور می کند.

در بیشتر موارد، فرض بر این است که جعبه مرزی در گوشه بالا سمت چپ منشاء دارد و محور x مثبت از مبدا به سمت راست صفحه هدایت میشود و محور مثبت y از مبدا به سمت راست هدایت میشود. پایین صفحه، با یک پیکسل که واحد اندازه گیری در نظر گرفته می شود.

جاسازی زبان و مکان

در مرحله بعد، از پنج لایه جاسازی مختلف استفاده می کنیم. یکی، رمزگذاری اطلاعات مربوط به زبان - یعنی جاسازی متن است.

چهار مورد دیگر برای جاسازی مکان رزرو شده اند. با فرض اینکه مقادیر xmin، ymin، xmax و ymax را بدانیم، میتوانیم کل کادر مرزی را تعیین کنیم. (اگر نمی توانید آن را تجسم کنید، در اینجا یک لینک برای شما است). این مختصات از لایه های تعبیه شده مربوطه عبور داده می شوند تا اطلاعات مکان را رمزگذاری کنند.

پنج جاسازی - یکی برای متن و چهار برای مختصات - سپس برای ایجاد ارزش نهایی جاسازی که از طریق LayoutLM منتقل می شود، جمع می شوند. خروجی به عنوان جاسازی LayoutLM نامیده می شود.

جاسازی های تصویر

بسیار خوب، بنابراین ما موفق شدهایم اطلاعات مربوط به متن و مکان را با ترکیب جاسازیهای آنها و عبور آن از یک مدل زبانی پیدا کنیم. حال چگونه میتوانیم فرآیند ترکیب اطلاعات مربوط به تصویر را در آن مرور کنیم؟

در حالی که اطلاعات متن و چیدمان در حال کدگذاری هستند، به طور موازی، از Faster R-CNN برای استخراج مناطق متن مربوط به سند استفاده می کنیم. سریعتر R-CNN یک مدل تصویری است که برای تشخیص اشیا استفاده می شود. در مورد ما، ما از آن برای شناسایی قطعات مختلف متن استفاده میکنیم (با فرض اینکه هر عبارت یک شی است) و سپس تصاویر بخشبندی شده را از یک لایه کاملاً متصل عبور میدهیم تا به ایجاد جاسازی برای تصاویر نیز کمک کنیم.

تعبیههای LayoutLM و همچنین جاسازیهای تصویر برای ایجاد یک جاسازی نهایی ترکیب میشوند که سپس میتوان از آن برای انجام پردازش پاییندستی استفاده کرد.

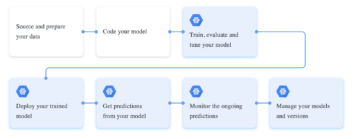

LayoutLM قبل از آموزش

همه موارد فوق تنها در صورتی معنا پیدا می کند که روش آموزش LayoutLM را درک کنیم. به هر حال، مهم نیست که چه نوع ارتباطی در یک شبکه عصبی برقرار می کنیم، تا زمانی که با هدف یادگیری درست آموزش داده نشود، کاملاً هوشمند نیست. نویسندگان LayoutLM میخواستند روشی مشابه آنچه برای پیشآموزش BERT استفاده میشد، دنبال کنند.

مدل زبان بصری ماسک شده (MVLM)

به منظور کمک به مدل در یادگیری اینکه چه متنی میتوانست در یک مکان خاص وجود داشته باشد، نویسندگان بهطور تصادفی چند نشانه از متن را در حالی که اطلاعات مربوط به مکان و جاسازیها را حفظ میکردند، پنهان کردند. این LayoutLM را قادر ساخت تا فراتر از مدلسازی زبان ماسکشده ساده برود و به همراه کردن جاسازیهای متن با روشهای مربوط به مکان نیز کمک کرد.

طبقه بندی اسناد چند برچسبی (MDC)

استفاده از تمام اطلاعات موجود در سند برای طبقه بندی آن به دسته ها به مدل کمک می کند تا بفهمد چه اطلاعاتی به دسته خاصی از اسناد مربوط می شود. با این حال، نویسندگان خاطرنشان می کنند که برای مجموعه داده های بزرگتر، داده های مربوط به کلاس های سند ممکن است به راحتی در دسترس نباشند. از این رو، آنها اساس نتایج را هم آموزش MVLM به تنهایی و هم آموزش MVLM + MDC ارائه کرده اند.

تنظیم دقیق LayoutLM برای کارهای پایین دست

چندین کار پایین دستی وجود دارد که می توان با LayoutLM اجرا کرد. ما در مورد مواردی که نویسندگان متعهد شده اند بحث خواهیم کرد.

تفاهم فرم

این کار مستلزم پیوند یک نوع برچسب به یک قطعه متن داده شده است. با استفاده از این، می توانیم داده های ساختار یافته را از هر نوع سندی استخراج کنیم. با توجه به خروجی نهایی، یعنی جاسازیهای LayouLM + جاسازیهای تصویر، آنها از یک لایه کاملاً متصل عبور داده میشوند و سپس از یک softmax برای پیشبینی احتمالات کلاس برای برچسب یک قطعه متن داده شده عبور میکنند.

درک رسید

در این کار، چندین اسلات اطلاعات روی رسیدها خالی می ماندند و مدل باید قطعات متن را به درستی در اسلات مربوطه خود قرار می داد.

طبقه بندی تصویر سند

اطلاعات متن و تصویر سند برای کمک به درک کلاس سند با عبور دادن آن از یک لایه softmax ترکیب می شود.

Huggingface LayoutLM

یکی از دلایل اصلی که LayoutLM بسیار مورد بحث قرار می گیرد این است که این مدل مدتی پیش منبع باز بود. این است موجود در Hugging Face، بنابراین استفاده از LayoutLM در حال حاضر بسیار ساده تر است.

قبل از اینکه به جزئیات نحوه تنظیم دقیق LayoutLM برای نیازهای خود بپردازیم، چند نکته وجود دارد که باید در نظر گرفته شود.

نصب کتابخانه ها

برای اجرای LayoutLM، به کتابخانه Transformers از Hugging Face نیاز دارید که به نوبه خود به کتابخانه PyTorch وابسته است. برای نصب آنها (اگر قبلا نصب نشده اند)، دستورات زیر را اجرا کنید

در جعبه های مرزبندی

برای ایجاد یک طرح جاسازی یکنواخت بدون توجه به اندازه تصویر، مختصات جعبه مرزی در مقیاس 1000 نرمال می شوند.

پیکر بندی

با استفاده از کلاس transformers.LayoutLMConfig، می توانید اندازه مدل را مطابق با نیازهای خود تنظیم کنید، زیرا این مدل ها معمولاً سنگین هستند و به قدرت محاسباتی کمی نیاز دارند. تنظیم آن بر روی یک مدل کوچکتر ممکن است به شما کمک کند آن را به صورت محلی اجرا کنید. تو می توانی در اینجا درباره کلاس بیشتر بدانید.

LayoutLM برای طبقه بندی اسناد (ارتباط دادن)

اگر می خواهید طبقه بندی اسناد را انجام دهید، به ترانسفورماتورهای کلاس نیاز دارید.LayoutLMForSequenceClassification. دنباله در اینجا دنباله ای از متن از سندی است که شما استخراج کرده اید. در اینجا یک نمونه کد کوچک از Hugging Face.co آمده است که نحوه استفاده از آن را توضیح می دهد

LayoutLM برای برچسب گذاری متن (ارتباط دادن)

برای انجام برچسبگذاری معنایی، به عنوان مثال برچسبها را به قسمتهای مختلف متن در سند اختصاص دهید، به کلاس transformers نیاز دارید. LayoutLMForTokenClassification. شما ممکن است جزئیات بیشتری در مورد پیدا کنید اینجا هم همینطوردر اینجا یک نمونه کد کوچک برای شما آورده شده است تا ببینید چگونه می تواند برای شما کار کند

چند نکته در مورد چیدمان صورت در آغوش گرفتن LM

- در حال حاضر، مدل Hugging Face LayoutLM از کتابخانه متن باز Tesseract برای استخراج متن استفاده می کند که خیلی دقیق نیست. ممکن است بخواهید از ابزار OCR متفاوت و پولی مانند AWS Textract یا Google Cloud Vision استفاده کنید

- مدل موجود فقط مدل زبان را ارائه میکند، یعنی جاسازیهای LayoutLM، و نه لایههای نهایی که ویژگیهای بصری را ترکیب میکنند. LayoutLMv2 (در بخش بعدی مورد بحث قرار گرفته است) از کتابخانه Detectron برای فعال کردن جاسازی ویژگی های بصری نیز استفاده می کند.

- طبقهبندی برچسبها در سطح کلمه اتفاق میافتد، بنابراین واقعاً به موتور استخراج متن OCR بستگی دارد که مطمئن شود همه کلمات در یک فیلد در یک توالی پیوسته قرار دارند، یا ممکن است یک فیلد به صورت دو قسمتی پیشبینی شود.

LayoutLMv2

LayoutLM به عنوان انقلابی در نحوه استخراج داده ها از اسناد به وجود آمد. با این حال، تا آنجا که تحقیقات یادگیری عمیق پیش میرود، مدلها با گذشت زمان بیشتر و بیشتر بهبود مییابند. LayoutLM به طور مشابه توسط LayoutLMv2 جایگزین شد، جایی که نویسندگان تغییرات مهمی را در نحوه آموزش مدل ایجاد کردند.

از جمله جاسازیهای فضایی 1 بعدی و جاسازیهای نشانه بصری

LayoutLMv2 شامل اطلاعات مربوط به مکان نسبی 1-D و همچنین اطلاعات کلی مربوط به تصویر بود. دلیل اهمیت این موضوع به دلیل اهداف آموزشی جدید است که اکنون در مورد آنها بحث خواهیم کرد

اهداف آموزشی جدید

LayoutLMv2 شامل برخی از اهداف آموزشی اصلاح شده است. این موارد به شرح زیر است:

- Masked Visual Language Modelling: این شبیه به LayoutLM است

- تراز تصویر متن: متن به طور تصادفی از تصویر پوشانده شد، در حالی که نشانه های متن در اختیار مدل قرار گرفت. برای هر نشانه، مدل باید یاد می گرفت که آیا متن داده شده پوشش داده شده است یا خیر. از این طریق، مدل قادر به ترکیب اطلاعات از هر دو حالت تصویری و متنی بود

- مطابقت تصویر متن: از مدل خواسته می شود بررسی کند که آیا تصویر داده شده با متن داده شده مطابقت دارد یا خیر. نمونههای منفی یا بهعنوان تصاویر نادرست تغذیه میشوند، یا اصلاً هیچ جاسازی تصویری ارائه نمیشود. این کار برای اطمینان از اینکه مدل درباره نحوه ارتباط متن و تصاویر بیشتر میآموزد انجام میشود.

با استفاده از این روشها و جاسازیهای جدید، این مدل توانست تقریباً در تمام مجموعههای داده آزمایشی بهعنوان LayoutLM به نمرات F1 بالاتری دست یابد.

- درباره ما

- دسترسی

- حساب

- دقیق

- دست

- در میان

- فعال

- پیشرفته

- عاملان

- AI

- معرفی

- قبلا

- هر چند

- مقدار

- دیگر

- روش

- محدوده

- دور و بر

- مقاله

- نویسندگان

- در دسترس

- AWS

- اساس

- بودن

- بهترین

- بیت

- جعبه

- کارت ها

- موارد

- به چالش

- طبقه بندی

- ابر

- رمز

- ترکیب شده

- شرکت

- محاسبه

- پیکر بندی

- اتصالات

- توجه

- هزینه

- میتوانست

- مشتریان

- داده ها

- روز

- با وجود

- کشف

- DID

- مختلف

- اسناد و مدارک

- پایین

- تجارت الکترونیک

- موثر

- را قادر می سازد

- ایجاد

- اکسل

- چهره

- سریعتر

- ویژگی

- امکانات

- تغذیه

- مالی

- نام خانوادگی

- پیروی

- تولید می کنند

- GitHub

- گوگل

- کمک

- کمک می کند

- اینجا کلیک نمایید

- چگونه

- چگونه

- HTTPS

- تصویر

- تأثیر

- مهم

- بهبود

- مشمول

- لوازم

- اطلاعات

- بیمه

- هوشمند

- IT

- برچسب

- برچسب ها

- زبان

- بزرگتر

- یاد گرفتن

- یادگیری

- سطح

- کتابخانه

- ارتباط دادن

- فهرست

- به صورت محلی

- محل

- مکان

- دستی

- عظیم

- مطابق

- ماده

- مدل

- مدل

- اکثر

- شبکه

- شبکه

- باز کن

- منبع باز

- عملیات

- گزینه

- سفارش

- سازمان های

- دیگر

- پرداخت

- مقاله

- قطعه

- قدرت

- روند

- فراهم می کند

- PWC

- دلایل

- توصیه

- گزارش

- ضروری

- مورد نیاز

- تحقیق

- نتایج

- ادامه

- دویدن

- مقیاس

- طرح

- SEC

- حس

- تنظیم

- محیط

- تغییر

- قابل توجه

- مشابه

- ساده

- اندازه

- کوچک

- هوشمند

- So

- چیزی

- آغاز شده

- موفقیت

- عرضه

- زنجیره تامین

- وظایف

- پیشرفته

- آزمون

- از طریق

- زمان

- رمز

- نشانه

- بالا

- آموزش

- فهمیدن

- استفاده کنید

- استفاده کنید

- ارزش

- چی

- چه

- کلمات

- مهاجرت کاری

- کارگران

- سال