استقرار سیستمهای هوش مصنوعی قدرتمند، درک ما از ایمنی و استفاده نادرست را بسیار بیشتر از آنچه که تنها از طریق تحقیق امکانپذیر بود، غنی کرده است. به ویژه:

- استفاده نادرست از مدل زبان مبتنی بر API اغلب به شکل های متفاوتی از آنچه ما بیشتر از آن می ترسیدیم وجود دارد.

- ما محدودیتهایی را در ارزیابیهای مدل زبان موجود شناسایی کردهایم که با معیارها و طبقهبندیکنندههای جدید به آن میپردازیم.

- تحقیقات ایمنی پایه مزایای قابل توجهی را برای کاربرد تجاری سیستم های هوش مصنوعی ارائه می دهد.

در اینجا، ما آخرین تفکر خود را به امید کمک به سایر توسعه دهندگان هوش مصنوعی برای رفع ایمنی و استفاده نادرست از مدل های مستقر شرح می دهیم.

Oنسبت به دو سال گذشته، ما چیزهای زیادی در مورد نحوه استفاده و سوء استفاده از مدل های زبان آموخته ایم - بینش هایی که بدون تجربه استقرار در دنیای واقعی نمی توانستیم به دست آوریم. در ژوئن 2020، ما شروع به دسترسی به توسعه دهندگان و محققان به آن کردیم AI API را باز کنید، یک رابط برای دسترسی و ساخت برنامه های کاربردی در بالای مدل های جدید هوش مصنوعی توسعه یافته توسط OpenAI. استقرار مدلهای GPT-3، Codex و سایر مدلها به گونهای که خطرات آسیب را کاهش میدهد، چالشهای فنی و سیاستی مختلفی را ایجاد کرده است.

مروری بر رویکرد استقرار مدل ما

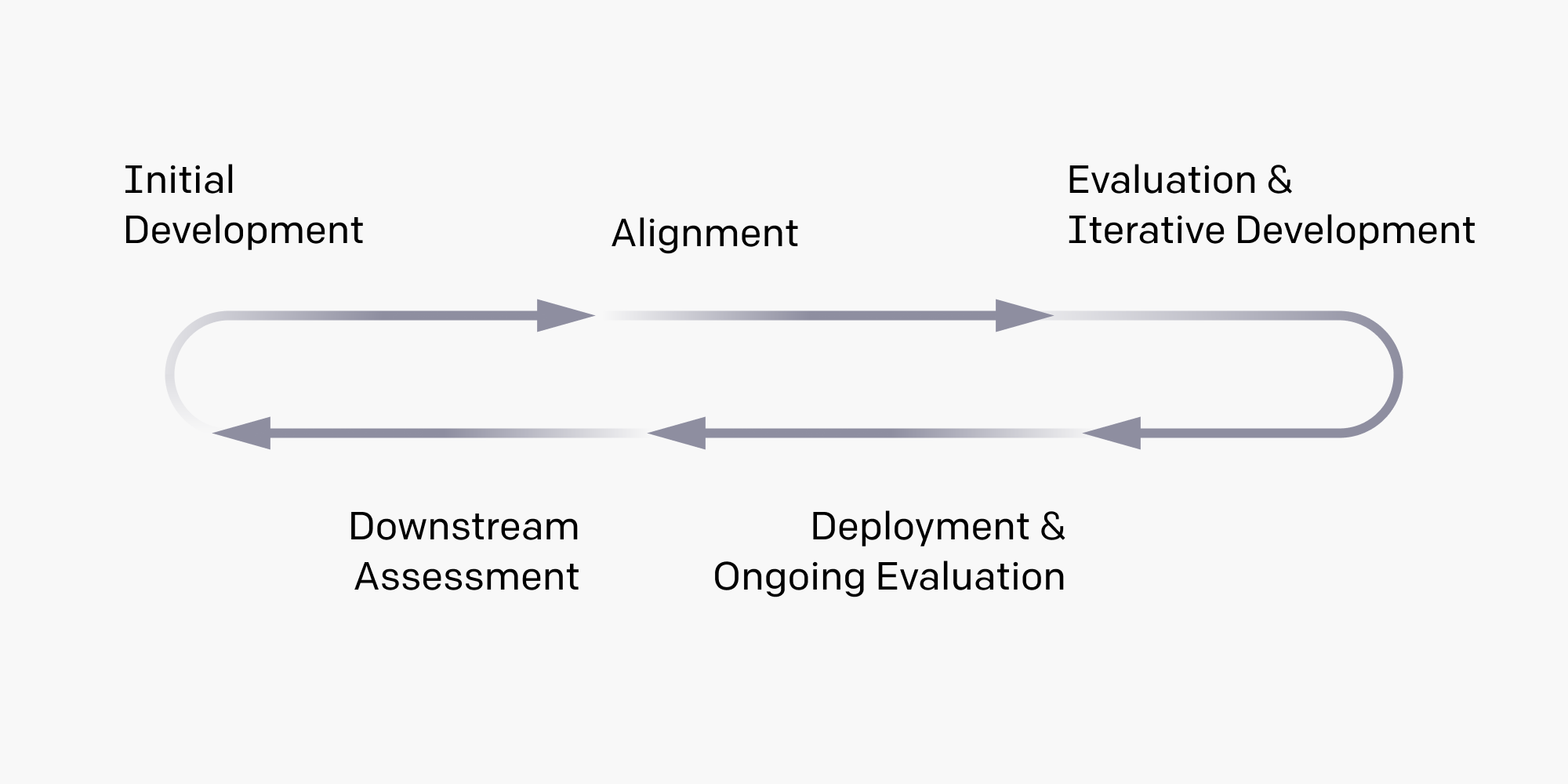

مدل های زبان بزرگ اکنون قادر به انجام یک طیف بسیار گسترده ای از وظایف، اغلب خارج از جعبه. پروفایل ریسک، کاربردهای بالقوه و اثرات گسترده تر آنها بر جامعه ماندن ضعیف فهمید. در نتیجه، رویکرد استقرار ما بر تکرار مداوم تأکید دارد و از استراتژیهای زیر با هدف به حداکثر رساندن مزایای استقرار و در عین حال کاهش خطرات مرتبط استفاده میکند:

- تجزیه و تحلیل ریسک قبل از استقرار، استفاده از مجموعه رو به رشدی از ارزیابیهای ایمنی و ابزارهای تیم قرمز (به عنوان مثال، ما InstructGPT خود را برای هرگونه تخریب ایمنی با استفاده از ارزیابیها بررسی کردیم. در زیر بحث شده است)

- شروع با یک پایگاه کاربر کوچک (به عنوان مثال، GPT-3 و ما InstructGPT سری به عنوان نسخه بتا خصوصی شروع شد)

- مطالعه نتایج آزمایشی موارد استفاده جدید (به عنوان مثال، بررسی شرایطی که تحت آن میتوانیم با خیال راحت تولید محتوای طولانی را فعال کنیم، کار با تعداد کمی از مشتریان)

- اجرای فرآیندهایی که به حفظ نبض در استفاده کمک می کند (به عنوان مثال، بررسی موارد استفاده، سهمیه توکن، و محدودیت نرخ)

- انجام بررسی های گذشته نگر دقیق (به عنوان مثال، حوادث ایمنی و استقرار عمده)

توجه داشته باشید که این نمودار به منظور انتقال بصری نیاز به حلقه های بازخورد در روند مستمر توسعه و استقرار مدل و این واقعیت است که ایمنی باید در هر مرحله یکپارچه شود. هدف از آن ارائه تصویری کامل یا ایده آل از فرآیند ما یا هر سازمان دیگری نیست.

هیچ گلوله نقرهای برای استقرار مسئولانه وجود ندارد، بنابراین ما سعی میکنیم در هر مرحله از توسعه و استقرار، محدودیتهای مدلهای خود و راههای بالقوه سوء استفاده را بیاموزیم و به آنها رسیدگی کنیم. این رویکرد به ما امکان میدهد تا آنجا که میتوانیم درباره مسائل ایمنی و سیاستگذاری در مقیاس کوچک بیاموزیم و آن بینشها را قبل از راهاندازی استقرار در مقیاس بزرگتر به کار ببریم.

اگرچه جامع نیست، برخی از زمینههایی که تاکنون در آن سرمایهگذاری کردهایم عبارتند از[1]:

- قبل از آموزش داده ها کیوریشن و فیلترینگ

- تنظیم دقیق مدل ها برای بهتر شدن دستورالعمل را دنبال کن

- تجزیه و تحلیل ریسک استقرارهای بالقوه

- ارائه کاربر دقیق مستندات

- بنا ابزار برای نمایش خروجی های مدل مضر

- بررسی موارد استفاده علیه ما سیاست

- نظارت بر علائم سوء استفاده

- مطالعه کردن تاثیرات مدل های ما

از آنجایی که هر مرحله از مداخله دارای محدودیت هایی است، یک رویکرد کل نگر ضروری است.

بخش هایی وجود دارد که می توانستیم کارهای بیشتری انجام دهیم و هنوز جای پیشرفت داریم. برای مثال، زمانی که برای اولین بار روی GPT-3 کار میکردیم، آن را بهعنوان یک مصنوع تحقیقاتی داخلی بهجای یک سیستم تولیدی مینگریم و در فیلتر کردن دادههای آموزشی سمی به اندازهای که ممکن بود در غیر این صورت تهاجمی نبودیم. ما بیشتر روی تحقیق و حذف چنین موادی برای مدلهای بعدی سرمایهگذاری کردهایم. ما برای رسیدگی به برخی از موارد سوء استفاده در مواردی که سیاستهای روشنی در مورد این موضوع نداشتیم و در تکرار آن سیاستها بهتر شدهایم، زمان بیشتری را صرف کردهایم. و ما به تکرار بسته ای از الزامات ایمنی ادامه می دهیم که در پرداختن به خطرات حداکثر موثر باشد، در حالی که به طور واضح به توسعه دهندگان اطلاع داده شده و اصطکاک بیش از حد را به حداقل می رساند.

با این حال، ما معتقدیم که رویکرد ما ما را قادر میسازد تا انواع مختلف آسیبهای ناشی از استفاده از مدل زبانی را در مقایسه با رویکرد دستآمیزتر اندازهگیری و کاهش دهیم، در حالی که در عین حال طیف گستردهای از کاربردهای علمی، هنری و تجاری را امکانپذیر میکنیم. مدل ها.[2]

بسیاری از اشکال و اندازه های استفاده نادرست از مدل زبان

OpenAI از زمان کار اولیه ما در مورد خطرات سوء استفاده از هوش مصنوعی فعال بوده است استفاده مخرب از هوش مصنوعی در 2018 و در GPT-2 در سال 2019، و ما به سیستمهای هوش مصنوعی که عملیات نفوذ را تقویت میکنند، توجه ویژهای داشتهایم. ما داریم کار با کارشناسان خارجی برای توسعه شواهد مفهوم و ارتقاء یافت دقیق تحلیل چنین خطراتی توسط اشخاص ثالث. ما همچنان متعهد به پرداختن به خطرات مرتبط با عملیات تأثیرگذاری مبتنی بر مدل زبان هستیم و اخیراً یک کارگاه آموزشی در این زمینه برگزار کردیم.[3]

با این حال، ما صدها بازیگری را شناسایی کردهایم که تلاش میکنند از GPT-3 برای اهداف بسیار گستردهتری نسبت به تولید اطلاعات نادرست برای عملیات نفوذ، از جمله به روشهایی که یا پیشبینی نمیکردیم یا پیشبینی میکردیم، استفاده نادرست کنند، متوقف کنیم. بسیار رایج است[4] از دستورالعمل های موردی استفاده کنید, دستورالعمل های محتواو زیرساخت شناسایی و پاسخ داخلی در ابتدا به سمت خطراتی بود که ما بر اساس تحقیقات داخلی و خارجی پیشبینی میکردیم، مانند تولید محتوای سیاسی گمراهکننده با GPT-3 یا تولید بدافزار با Codex. تلاشهای شناسایی و پاسخ ما در طول زمان در پاسخ به موارد واقعی سوءاستفادهای که «در طبیعت» با آن مواجه شدهاند، تکامل یافتهاند که بهاندازه عملیاتهای تأثیرگذار در ارزیابیهای اولیه خطر ما برجسته نبودهاند. به عنوان مثال می توان به تبلیغات هرزنامه برای محصولات پزشکی مشکوک و نقش آفرینی فانتزی های نژادپرستانه اشاره کرد.

برای حمایت از مطالعه استفاده نادرست از مدل زبان و کاهش آن، ما به طور فعال در حال بررسی فرصتهایی برای به اشتراک گذاشتن آمار در مورد حوادث ایمنی در سال جاری هستیم تا بحثها را در مورد سوء استفاده از مدل زبان مشخص کنیم.

دشواری اندازهگیری ریسک و تأثیر

بسیاری از جنبههای خطرات و تأثیرات مدلهای زبانی به سختی قابل اندازهگیری هستند و بنابراین نظارت، به حداقل رساندن و افشای آن به شیوهای پاسخگو دشوار است. ما فعالانه از معیارهای آکادمیک موجود برای ارزیابی مدل زبان استفاده کردهایم و مشتاقیم که بر روی کار خارجی ادامه دهیم، اما همچنین دریافتهایم که مجموعه دادههای معیار موجود اغلب منعکسکننده خطرات ایمنی و سوءاستفادهای که در عمل میبینیم نیستند.[5]

چنین محدودیتهایی نشان دهنده این واقعیت است که مجموعه دادههای دانشگاهی به ندرت برای هدف صریح اطلاعرسانی استفاده تولیدی از مدلهای زبان ایجاد میشوند و از تجربه بهدستآمده از بکارگیری چنین مدلهایی در مقیاس بهره نمیبرند. در نتیجه، ما در حال توسعه مجموعه دادهها و چارچوبهای ارزیابی جدید برای اندازهگیری ایمنی مدلهایمان هستیم که قصد داریم به زودی آنها را منتشر کنیم. به طور خاص، ما معیارهای ارزیابی جدیدی را برای اندازهگیری سمیت در خروجیهای مدل ایجاد کردهایم و همچنین طبقهبندیکنندههای داخلی را برای شناسایی محتوایی که ما را نقض میکند توسعه دادهایم. خط مشی محتوامانند محتوای وابسته به عشق شهوانی، سخنان مشوق نفرت، خشونت، آزار و اذیت و خودآزاری. هر دوی این موارد نیز به نوبه خود برای بهبود داده های قبل از تمرین ما مورد استفاده قرار گرفته اند[6]- به طور خاص، با استفاده از طبقه بندی کننده ها برای فیلتر کردن محتوا و معیارهای ارزیابی برای اندازه گیری اثرات مداخلات مجموعه داده.

طبقهبندی مطمئن خروجیهای مدل در ابعاد مختلف دشوار است و اندازهگیری تأثیر اجتماعی آنها در مقیاس OpenAI API حتی سختتر است. ما چندین مطالعه داخلی را به منظور ایجاد یک عضله سازمانی برای چنین اندازهگیری انجام دادهایم، اما اینها اغلب سوالات بیشتری را نسبت به پاسخ ایجاد کردهاند.

ما به ویژه علاقه مند به درک بهتر تأثیر اقتصادی مدل های خود و توزیع آن تأثیرات هستیم. ما دلایل خوبی برای این باور داریم که تأثیرات بازار کار ناشی از استقرار مدلهای فعلی ممکن است به صورت مطلق در حال حاضر قابل توجه باشد و با افزایش قابلیتها و دسترسی مدلهای ما، این تأثیرات رشد خواهند کرد. ما تا به امروز از انواع تأثیرات محلی، از جمله بهبودهای بهره وری عظیم در وظایف موجود انجام شده توسط افراد مانند نوشتن و خلاصه سازی (که گاهی به جابجایی و ایجاد شغل کمک می کند) و همچنین مواردی که API برنامه های جدیدی را که قبلا غیرممکن بودند، باز می کند، آموخته ایم. ، مانند سنتز بازخورد کیفی در مقیاس بزرگ. اما ما درک خوبی از اثرات خالص نداریم.

ما معتقدیم که برای کسانی که در حال توسعه و به کارگیری فناوری های هوش مصنوعی قدرتمند هستند، مهم است که به اثرات مثبت و منفی کار خود توجه کنند. ما در بخش پایانی این پست به چند قدم در این راستا می پردازیم.

رابطه بین ایمنی و سودمندی سیستمهای هوش مصنوعی

در ما منشورمنتشر شده در سال 2018، ما می گوییم که "نگران هستیم که توسعه AGI در مراحل پایانی تبدیل به یک مسابقه رقابتی بدون زمان برای اقدامات احتیاطی ایمنی کافی شود." سپس ما منتشر شده تجزیه و تحلیل دقیق توسعه هوش مصنوعی رقابتی، و ما از نزدیک دنبال کرده ایم متعاقب پژوهش. در عین حال، استقرار سیستمهای هوش مصنوعی از طریق OpenAI API نیز درک ما را از همافزایی بین ایمنی و ابزار عمیقتر کرده است.

برای مثال، توسعهدهندگان بهطور عمده مدلهای InstructGPT ما را ترجیح میدهند – که برای پیروی از اهداف کاربر بهخوبی تنظیم شدهاند.[7]- بر روی مدل های پایه GPT-3. با این حال، قابل توجه است که مدلهای InstructGPT در اصل با ملاحظات تجاری انگیزه نداشتند، بلکه هدفشان پیشرفت در درازمدت بود. مشکلات هم ترازی. از نظر عملی، این بدان معناست که مشتریان، شاید تعجب آور نباشد، مدل هایی را ترجیح می دهند که در کار خود باقی می مانند و هدف کاربر را درک می کنند، و مدل هایی که احتمال کمتری برای تولید خروجی های مضر یا نادرست دارند.[8] سایر تحقیقات بنیادی، مانند کار ما روی اعمال نفوذ اطلاعات بازیابی شده از اینترنت به منظور پاسخگویی صادقانه تر به سؤالات، همچنین دارای پتانسیل بهبود سودمندی تجاری سیستم های هوش مصنوعی است.[9]

این هم افزایی همیشه رخ نخواهد داد. به عنوان مثال، سیستمهای قدرتمندتر اغلب زمان بیشتری را برای ارزیابی و همسویی مؤثر میطلبند و فرصتهای فوری برای کسب سود را از بین میبرند. و ابزار کاربر و جامعه ممکن است به دلیل عوامل خارجی منفی در یک راستا قرار نگیرند - کپی رایتینگ کاملاً خودکار را در نظر بگیرید، که می تواند برای سازندگان محتوا مفید باشد اما برای اکوسیستم اطلاعات به طور کلی مضر است.

دیدن موارد هم افزایی قوی بین ایمنی و ابزار دلگرم کننده است، اما ما متعهد به سرمایه گذاری در تحقیقات ایمنی و سیاست گذاری هستیم حتی زمانی که آنها با ابزار تجاری معاوضه می کنند.

راه هایی برای درگیر شدن

هر یک از درسهای بالا سؤالات جدیدی را برای خود ایجاد میکند. چه نوع حوادث ایمنی ممکن است هنوز در شناسایی و پیش بینی ناکام باشیم؟ چگونه می توانیم خطرات و اثرات را بهتر اندازه گیری کنیم؟ چگونه میتوانیم به بهبود ایمنی و کاربرد مدلهایمان ادامه دهیم و در صورت بروز معاوضههای بین این دو را دنبال کنیم؟

ما فعالانه درباره بسیاری از این مسائل با سایر شرکتهایی که مدلهای زبانی را به کار میگیرند، بحث میکنیم. اما ما همچنین میدانیم که هیچ سازمان یا مجموعهای از سازمانها همه پاسخها را ندارند، و میخواهیم راههایی را برجسته کنیم که خوانندگان میتوانند بیشتر در درک و شکلدهی به استقرار سیستمهای هوش مصنوعی پیشرفته ما مشارکت کنند.

اول، کسب تجربه دست اول در تعامل با سیستم های پیشرفته هوش مصنوعی برای درک توانایی ها و مفاهیم آنها بسیار ارزشمند است. ما اخیراً پس از ایجاد اطمینان بیشتر در توانایی خود برای شناسایی مؤثر و پاسخ به سوء استفاده، به لیست انتظار API پایان دادیم. افراد در کشورها و مناطق مورد حمایت می توانید با ثبت نام به سرعت به OpenAI API دسترسی پیدا کنید اینجا کلیک نمایید.

دوم، محققانی که روی موضوعات مورد علاقه ما مانند سوگیری و سوء استفاده کار می کنند و کسانی که از حمایت مالی بهره مند می شوند، می توانند با استفاده از اعتبارات API یارانه ای درخواست دهند. این فرم. تحقیقات بیرونی برای آگاهی دادن به درک ما از این سیستمهای چندوجهی و همچنین درک عمومی گستردهتر حیاتی است.

در نهایت، امروز ما در حال انتشار یک برنامه تحقیقاتی بررسی تأثیرات بازار کار مرتبط با خانواده مدلهای Codex ما، و درخواست برای همکاران خارجی برای انجام این تحقیق. ما هیجان زده هستیم که با محققان مستقل کار کنیم تا اثرات فناوری های خود را مطالعه کنیم تا مداخلات سیاستی مناسب را اطلاع دهیم و در نهایت تفکر خود را از تولید کد به سایر روش ها گسترش دهیم.

اگر علاقه مند به کار برای استقرار مسئولانه فناوری های پیشرفته هوش مصنوعی هستید، درخواست برای کار در OpenAI!

- 2019

- 2020

- 7

- 9

- درباره ما

- مطلق

- دسترسی

- فعال

- نشانی

- خطاب به

- مزایای

- AI

- معرفی

- قبلا

- تقویت

- تحلیل

- API

- مربوط

- کاربرد

- برنامه های کاربردی

- روش

- هنر

- خودکار

- بودن

- محک

- مزایای

- برکلی

- جعبه

- ساختن

- بنا

- صدا

- کمبریج

- می توانید دریافت کنید

- قابلیت های

- حمل

- موارد

- به چالش

- چالش ها

- رمز

- تجاری

- شرکت

- مقایسه

- جزء

- اعتماد به نفس

- ظرف

- محتوا

- ادامه دادن

- کنترل

- هزینه

- میتوانست

- کشور

- سازندگان

- اعتبار

- جاری

- مشتریان

- لبه برش

- داده ها

- گسترش

- استقرار

- گسترش

- شناسایی شده

- کشف

- توسعه

- توسعه

- توسعه دهنده

- توسعه دهندگان

- در حال توسعه

- پروژه

- DID

- متفاوت است

- مختلف

- بعد

- بحث و تبادل نظر

- توزیع

- در اوایل

- اقتصادی

- اثر اقتصادی

- اکوسیستم

- اثر

- موثر

- اثرات

- توانمندسازی

- را قادر می سازد

- دلگرم کننده

- نامزدی

- غنی شده

- مثال

- گسترش

- انتظار

- مخارج

- تجربه

- کارشناسان

- شکست

- خانواده

- ویژگی

- باز خورد

- مالی

- نام خانوادگی

- تمرکز

- متمرکز شده است

- به دنبال

- پیروی

- فرم

- اشکال

- یافت

- کامل

- جنس

- دادن

- خوب

- شدن

- در حال رشد

- سلامتی

- کمک

- مفید

- نماد

- چگونه

- چگونه

- HTTPS

- صدها نفر

- تأثیر

- مهم

- بهبود

- شامل

- مشمول

- از جمله

- فرد

- نفوذ

- اطلاعات

- شالوده

- بینش

- سازمانی

- یکپارچه

- قصد

- علاقه

- رابط

- اینترنت

- سرمایه گذاری

- گرفتار

- مسائل

- IT

- کار

- برچسب

- کار

- زبان

- آخرین

- راه اندازی

- یاد گرفتن

- آموخته

- درس های آموخته شده

- کوچک

- محلی

- طولانی

- عمده

- ساخت

- نرم افزارهای مخرب

- دستی

- بازار

- عظیم

- اندازه

- پزشکی

- سلامت روان

- متریک

- مدل

- مدل

- اکثر

- خالص

- پیشنهادات

- باز کن

- منبع باز

- عملیات

- فرصت ها

- سفارش

- کدام سازمان ها

- سازمان های

- دیگر

- در غیر این صورت

- پرداخت

- مردم

- شاید

- چشم انداز

- تصویر

- خلبان

- سیاست

- سیاست

- سیاسی

- ممکن

- قوی

- خصوصی

- روند

- فرآیندهای

- تولید کردن

- تولید

- بهره وری

- محصولات

- پروفایل

- سود

- عمومی

- انتشار

- هدف

- اهداف

- به سرعت

- نژاد

- افزایش

- محدوده

- RE

- خوانندگان

- كاهش دادن

- کاهش

- بازتاب

- ارتباط

- آزاد

- مورد نیاز

- تحقیق

- پاسخ

- مسئوليت

- محدودیت های

- نتایج

- این فایل نقد می نویسید:

- بررسی

- خطر

- خطرات

- ایمنی

- صرفه جویی کردن

- مقیاس

- پرده

- به دنبال

- سلسله

- تنظیم

- اشکال

- اشتراک گذاری

- قابل توجه

- نشانه ها

- نقره

- کوچک

- So

- آگاهی

- جامعه

- فضا

- اسپم

- به طور خاص

- صحنه

- دولت

- ارقام

- ماندن

- استراتژی ها

- قوی

- مطالعات

- مهاجرت تحصیلی

- سبک

- پشتیبانی

- سیستم

- سیستم های

- وظایف

- فنی

- فن آوری

- تفکر

- اشخاص ثالث

- از طریق

- زمان

- امروز

- رمز

- ابزار

- بالا

- تاپیک

- تجارت

- آموزش

- دگرگون کردن

- فهمیدن

- us

- استفاده کنید

- کاربران

- سودمندی

- چی

- WHO

- بدون

- مهاجرت کاری

- مشغول به کار

- کارگر

- نوشته

- سال