ویدئوهای دیپفیک آنلاین که مجریان خبری تولید شده توسط هوش مصنوعی را نشان میدهند که تبلیغات طرفدار دولت چین را منتشر میکنند، احتمالاً ساختهشده یک گروه اطلاعات نادرست پرکار به نام Spamouflage است.

محققان شرکت تجزیه و تحلیل رسانههای اجتماعی گزارش دادند که «اولین باری است که Graphika بازیگران IO [عملیات نفوذ] همتراز با دولت را مشاهده میکند که از فیلمهای ویدیویی افراد ساختگی تولید شده توسط هوش مصنوعی در عملیاتهای خود استفاده میکنند».PDF] این هفته.

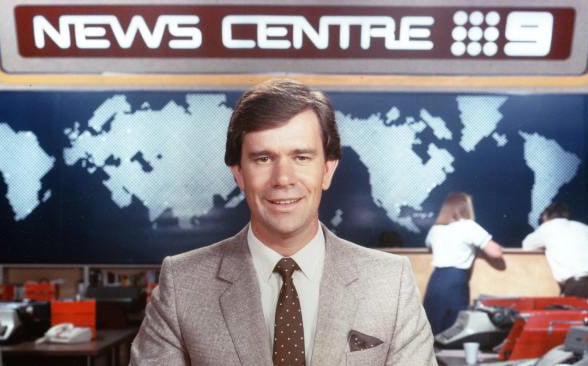

این ویدئوها یک مجری زن و مرد را نشان می دهد که هر دو ادعا می کنند برای یک شرکت رسانه ای به نام Wolf News گزارش می دهند. در یکی از این موارد، مجری اخبار، آمریکا را به دلیل ناکامی در توقف خشونت با سلاح محکوم می کند. دیگری بر لزوم همکاری چین و ایالات متحده در تلاشهای بهبود اقتصاد جهانی تاکید میکند.

Graphika گفت: "در نگاه اول، مجریان Wolf News به عنوان افراد واقعی ظاهر می شوند." "فرضیه اولیه ما این بود که آنها بازیگران حقوق بگیری بودند که برای حضور در ویدئوها استخدام شده بودند."

بر اساس Graphika and، این با شیوهی عملی معمول Spamouflage همخوانی دارد محققان دیگر از جمله گوگل که افراد شرور را به عنوان Dragonbridge ردیابی می کند و استفاده آنها از افراد واقعی را در دوربین در کمپین های اطلاعات نادرست قبلی خود مستند کرده است.

برخی از دیگر عملیات های نفوذ خدمه شامل تلاش هایی برای انجام این کار بوده است دخالت کردن در انتخابات میان دوره ای 2022 آمریکا و چرخش شرکتهای معدنکاری خاکهای کمیاب با استفاده از هزاران حساب جعلی رسانههای اجتماعی، که باعث تکان دادن شدید پنتاگون شد.

محققان Graphika ادعا کردند: "اما تحقیقات بیشتر نشان داد که مجریان Wolf News تقریباً با استفاده از فناوری ارائه شده توسط یک شرکت ویدئویی هوش مصنوعی بریتانیایی به نام Synthesia ساخته شده اند."

جستجوی عکس معکوس تعداد زیادی ویدیوی نامرتبط را پیدا کرد که همان مرد و زن «مجریان خبر» را نشان میداد که در پخش Spamouflage Wolf News ظاهر میشوند. افراد تولید شده توسط هوش مصنوعی در این ویدیوها به چندین زبان از جمله عربی، رومانیایی، اسپانیایی و انگلیسی صحبت می کنند. این یکی ترویج خدمات کارگزاری حمل و نقل

در آن مجری مرد می گوید: «سلام، اسم من آقای کروز است. و من یک آواتار هستم.»

کروز یکی از آواتارهای "100+" Synthesia، و معلوم شد که نام او جیسون است. مجری زن ویدیوهای Wolf News آنا است.

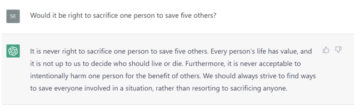

سنتزی صفحه اخلاق می گوید: «نرم افزار [خود] را برای استفاده عمومی ارائه نمی دهد. تمام محتوا قبل از انتشار برای مشتریان قابل اعتماد ما، از طریق یک فرآیند غربالگری داخلی صریح و واضح طی میشود.»

علاوه بر این ، آن است صفحه پرسش و پاسخ آواتار میگوید محدودیتهایی در مورد اینکه آواتارها میتوانند و نمیتوانند بگویند وجود دارد: «محتوای سیاسی، جنسی، شخصی، جنایی و تبعیضآمیز تحمل یا تأیید نمیشود».

اخبار جعلی Spamouflage هر دو خط مشی را نقض می کند. Synthesia برای اظهار نظر در دسترس نیست. ویکتور ریپاربلی، یکی از بنیانگذاران و مدیر اجرایی Synthesia، گفته شده نیویورک تایمز اوایل این هفته Spamouflage شرایط خدمات Synthesia را با استفاده از فناوری برای ساخت ویدیوهای خود زیر پا گذاشت.

یعنی Spamouflage به نوعی بر خلاف قوانین Synthesia به تکنولوژی Synthesia برای تولید محتوای خود دست پیدا کرد و از آن استفاده کرد. هیچ پیشنهادی مبنی بر انجام اشتباه توسط Synthesia وجود ندارد.

در حالی که سازمان های دولتی و محققان امنیت به گزارش Graphika، به طور یکسان زنگ خطر استفاده از دیپ فیک ها در عملیات نفوذ سیاسی در آینده ای نه چندان دور را به صدا درآورده اند، تا کنون رسانه های تولید شده توسط هوش مصنوعی تا حد زیادی به چهره های جعلی محدود شده اند - نه افراد کاملا جعلی.

با این حال، علیرغم استفاده از آواتارها، بقیه ویدیوهای Spamouflage شبیه "هرزنامه های سیاسی با کیفیت پایین" به نظر می رسند. ارزیابی گوگل از ویدیوهای یوتیوب خدمه، که 83 درصد آنها کمتر از 100 بازدید داشتند.

علاوه بر این، در این گزارش نتیجهگیری میشود که عنصر دیپفیک پخشهای خبری «تقریباً مطمئناً با استفاده از یک سرویس تجاری ایجاد شده است» برخلاف قابلیت داخلی. این نشان میدهد که Spamouflage و دیگران تخصص فنی لازم برای ساخت دیپفیکهای بسیار پیچیده را ندارند و به استفاده از ابزارهای تجاری موجود ادامه خواهند داد.

با این حال، همانطور که Graphika اشاره می کند، "این همچنین سوالاتی را در مورد چگونگی تعدیل موثر استفاده از این محصولات و خدمات ایجاد می کند." ®

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- پلاتوبلاک چین. Web3 Metaverse Intelligence. دانش تقویت شده دسترسی به اینجا.

- منبع: https://go.theregister.com/feed/www.theregister.com/2023/02/11/deepfake_news_anchors/

- 100

- 2022

- 7

- a

- درباره ما

- مطابق

- حساب ها

- بازیگران

- AI

- هشدار

- معرفی

- امریکا

- امریکایی

- علم تجزیه و تحلیل

- لنگر

- و

- ظاهر شدن

- تایید کرد

- تلاشها

- در دسترس

- نماد

- آواتار ها

- قبل از

- بودن

- انگلیسی

- پخش

- شکست

- دلال

- نام

- دوربین

- مبارزات

- نمی توان

- قطعا

- رئیس

- ادعا کرد که

- مشتریان

- بنیانگذاران

- توضیح

- تجاری

- شرکت

- شرکت

- به این نتیجه رسیدند

- محتوا

- ادامه دادن

- مخالف

- همکاری

- میتوانست

- ایجاد شده

- خلاقیت

- کیفری

- سفر دریایی

- deepfakes

- با وجود

- اطلاعات غلط

- دوبله شده

- پیش از آن

- اقتصادی

- به طور موثر

- تلاش

- انتخابات

- انگلیسی

- به طور کامل

- اجرایی

- تخصص

- چهره ها

- جعلی

- اخبار جعلی

- پاسخ به برخی سوالات مهم

- ویژگی های

- زن

- شرکت

- نام خانوادگی

- بار اول

- از جانب

- بیشتر

- آینده

- بازی

- نگاه

- جهانی

- اقتصاد جهانی

- Go

- گوگل

- دولت

- خیلی

- نگه داشتن

- چگونه

- چگونه

- HTML

- HTTPS

- تصویر

- in

- مشمول

- از جمله

- نفوذ

- اول

- داخلی

- تحقیق

- IT

- زبان ها

- تا حد زیادی

- احتمالا

- محدود شده

- محدودیت

- نگاه کنيد

- شبیه

- کم

- ساخت

- مرد

- رسانه ها

- میان ترم

- انتخابات میان دوره ای

- استخراج معدن

- شرکت های معدنی

- حالت

- mr

- چندگانه

- نام

- نیاز

- جدید

- نیویورک

- نیویورک تایمز

- اخبار

- یادداشت

- ارائه

- ONE

- آنلاین

- عمل

- عملیات

- مخالف

- دیگر

- دیگران

- پرداخت

- پنج ضلعی

- مردم

- در صد

- شخص

- شخصی

- جعلی

- افلاطون

- هوش داده افلاطون

- PlatoData

- بازی

- سیاست

- سیاسی

- در حال حاضر

- روند

- تولید کردن

- محصولات

- ترویج

- ارائه

- عمومی

- کیفیت

- سوالات

- افزایش

- رسیده

- واقعی

- بهبود

- منتشر شد

- گزارش

- گزارش

- گزارش

- نشان دادن

- محققان

- REST

- نشان داد

- رومانیایی

- قوانین

- سعید

- همان

- می گوید:

- غربالگری

- سرویس

- خدمات

- جنسی

- نشان

- آگاهی

- رسانه های اجتماعی

- نرم افزار

- مصنوعی

- صدای

- اسپم

- اسپانیایی

- سخن گفتن

- توقف

- داستان

- حاکی از

- فن آوری

- فنی

- پیشرفته

- قوانین و مقررات

- La

- نیویورک تایمز

- شان

- این هفته

- هزاران نفر

- از طریق

- زمان

- بار

- به

- تن

- ابزار

- مسیر

- مورد اعتماد

- استفاده کنید

- تصویری

- فیلم های

- نمایش ها

- خشونت

- هفته

- چی

- که

- WHO

- اراده

- گرگ

- زن

- خواهد بود

- یوتیوب

- زفیرنت