پنومونی یک عفونت ریه بالقوه کشنده است که به سرعت پیشرفت می کند. بیماران مبتلا به علائم ذات الریه - مانند سرفه های خشک، هک کننده، مشکلات تنفسی و تب بالا - معمولاً یک معاینه گوشی پزشکی از ریه ها دریافت می کنند و پس از آن برای تأیید تشخیص، عکس رادیوگرافی قفسه سینه انجام می شود. با این حال، تمایز بین پنومونی باکتریایی و ویروسی همچنان یک چالش است، زیرا هر دو تظاهرات بالینی مشابهی دارند.

مدلسازی ریاضی و هوش مصنوعی میتواند به بهبود دقت تشخیص بیماری از تصاویر رادیوگرافی کمک کند. یادگیری عمیق به طور فزاینده ای برای طبقه بندی تصاویر پزشکی رایج شده است و چندین مطالعه استفاده از مدل های شبکه عصبی کانولوشنال (CNN) را برای شناسایی خودکار ذات الریه از تصاویر اشعه ایکس قفسه سینه مورد بررسی قرار داده اند. با این حال، ایجاد مدلهای کارآمدی که بتواند تعداد زیادی از تصاویر پزشکی را بدون نگاتیو کاذب تجزیه و تحلیل کند، بسیار مهم است.

در حال حاضر، KM Abubeker و S Baskar در آکادمی آموزش عالی کارپاگام در هند یک چارچوب یادگیری ماشینی جدید برای طبقه بندی ذات الریه تصاویر اشعه ایکس قفسه سینه بر روی یک واحد پردازش گرافیکی (GPU) ایجاد کرده اند. آنها استراتژی خود را در یادگیری ماشینی: علم و فناوری.

بهینه سازی داده های آموزشی

عملکرد یک طبقهبندیکننده یادگیری عمیق هم به مدل شبکه عصبی و هم به کیفیت دادههای مورد استفاده برای آموزش شبکه متکی است. برای تصویربرداری پزشکی، فقدان یک مجموعه داده به اندازه کافی بزرگ دلیل اصلی عملکرد پایین است. برای رفع این کمبود، محققان از تقویت دادهها استفاده کردند که در آن دادههای آموزشی جدید از دادههای موجود (به عنوان مثال از طریق چرخش تصویر، جابجایی و برش) ترکیب میشوند تا مجموعه داده جامعتر و متنوعتر شود.

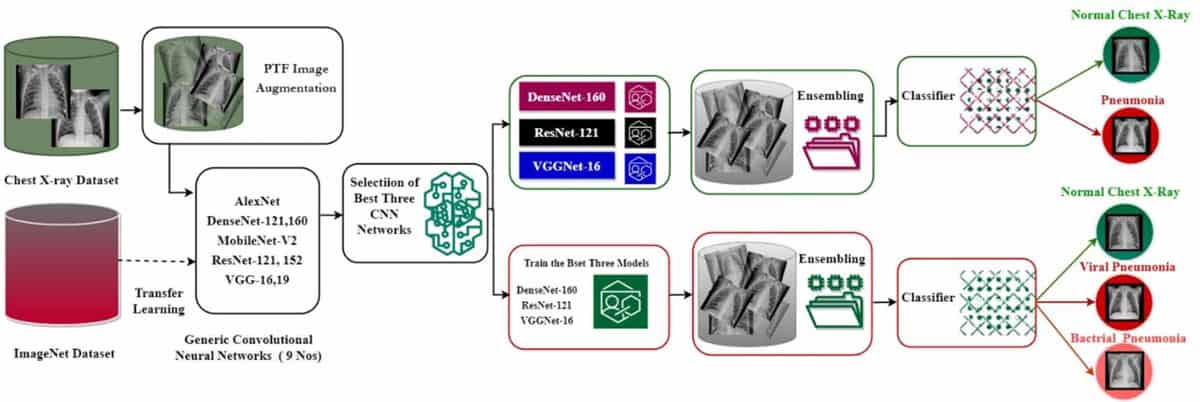

روش دیگری که برای رفع کمبود دادههای آموزشی مناسب استفاده میشود، یادگیری انتقالی است – بهبود ظرفیت مدل برای یادگیری یک کار جدید با استفاده از دانش موجود بهدستآمده در حین انجام یک کار مرتبط. ابوبکر و بسکار در مرحله اول مطالعه خود از یادگیری انتقالی برای آموزش نه مدل پیشرفته CNN عصبی برای ارزیابی اینکه آیا اشعه ایکس قفسه سینه ذات الریه را به تصویر می کشد یا خیر، استفاده کردند.

برای آزمایشها، آنها از تصاویر اشعه ایکس قفسه سینه از مجموعه دادههای عمومی RSNA Kaggle، از جمله تصاویر برای تمرین (1341 به عنوان طبیعی، 1678 به عنوان پنومونی باکتریایی و 2197 به عنوان پنومونی ویروسی)، آزمایش (234 نرمال، 184 پنومونی باکتریایی، 206 پنومونی ویروسی استفاده کردند. ) و اعتبارسنجی (76 پنومونی طبیعی، 48 پنومونی باکتریایی، 56 پنومونی ویروسی). اعمال تقویت هندسی در مجموعه داده، آن را به 2571 تصویر طبیعی، 2019 باکتریایی و 2625 تصویر پنومونی ویروسی گسترش داد.

بر اساس معیارهای عملکرد از جمله دقت، یادآوری و مساحت زیر منحنی ROC (AUROC، یک متریک خلاصهکننده عملکرد در چند آستانه)، محققان سه مدل برتر CNN را انتخاب کردند - DenseNet-160، ResNet-121، و VGGNet-16 - برای بازآموزی با استفاده از تکنیک گروه.

استراتژی گروه

به جای تکیه بر یک مدل واحد یادگیری ماشینی، مدلهای مجموعه نتایج چندین مدل را برای افزایش معیارهای عملکرد و به حداقل رساندن خطاها ترکیب میکنند. محققان یک استراتژی مجموعه مبتنی بر یادگیری انتقالی به نام B2-Net توسعه دادند و از آن با سه CNN منتخب برای ایجاد یک مدل نهایی استفاده کردند. آنها مدل نهایی B2-Net را بر روی یک کامپیوتر NVIDIA Jetson Nano GPU پیاده سازی کردند.

آنها خاطرنشان می کنند که در طول تمرین، برخی از مدل ها در شناسایی تصاویر طبیعی اشعه ایکس عملکرد بهتری داشتند، در حالی که برخی دیگر در شناسایی نمونه های پنومونی ویروسی و باکتریایی عملکرد بهتری داشتند. استراتژی گروه از یک تکنیک رأی گیری وزنی برای ارائه درجه خاصی از قدرت بر اساس معیارهای از پیش تعریف شده برای هر طبقه بندی کننده استفاده می کند.

مدلهای بازآموزی شده پیشرفتهای قابلتوجهی در دقت تشخیصی نسبت به مدلهای پایه نشان دادند. آزمایش مدلها روی یک مجموعه داده متعادل نشان داد که DenseNet-160، ResNet-121 و VGGNet-16 به ترتیب به مقادیر AUROC 0.9801، 0.9822 و 0.9955 دست یافتند. با این حال، رویکرد گروه B2-Net پیشنهادی، با AUROC 0.9977، از هر سه عملکرد بهتری داشت.

محققان B2-Net و سه مدل دیگر را با استفاده از زیرمجموعه ای از حدود 600 تصویر اشعه ایکس قفسه سینه از مجموعه داده های تلفیقی ارزیابی و اعتبارسنجی کردند. DenseNet-160 سه مورد از تصاویر تست پنومونی را اشتباه شناسایی کرد، در حالی که VGGNet-16 و ResNet-121 هر کدام یک تصویر اشعه ایکس را اشتباه تشخیص دادند. به طور کلی، رویکرد B2-Net پیشنهادی از همه مدلهای دیگر بهتر عمل کرد، و بین موارد عادی، ذاتالریه باکتریایی و ذاتالریه ویروسی در تصاویر اشعه ایکس قفسه سینه با دقت 97.69 درصد و نرخ فراخوان (نسبت مثبتهای واقعی در میان تعداد کل موارد مثبت) تمایز قائل شد. از 100%

هوش مصنوعی سی تی اسکن ها را برای COVID-19 بررسی می کند

ابوبکر و بسکار توضیح میدهند که در حالی که نرخ منفی کاذب حیاتیترین معیار برای طبقهبندیکننده تصویر پزشکی است، مدل B2-Net پیشنهادی بهترین جایگزین را برای کاربردهای بالینی بلادرنگ ارائه میکند. آنها می نویسند: "این رویکرد، به ویژه در طول شیوع جهانی COVID-19 فعلی، می تواند به رادیولوژیست ها در تشخیص سریع و مطمئن ذات الریه کمک کند و امکان درمان زودهنگام را فراهم کند."

در مرحله بعد، آنها قصد دارند مدل خود را برای طبقه بندی بیشتر اختلالات ریوی، از جمله انواع سل و کووید-19 گسترش دهند.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoAiStream. Web3 Data Intelligence دانش تقویت شده دسترسی به اینجا.

- ضرب کردن آینده با آدرین اشلی. دسترسی به اینجا.

- منبع: https://physicsworld.com/a/machine-learning-framework-classifies-pneumonia-on-chest-x-rays/

- : دارد

- :است

- :نه

- 10

- 2019

- a

- دانشگاه

- دقت

- دست

- نشانی

- معرفی

- اجازه دادن

- جایگزین

- در میان

- an

- تحلیل

- و

- برنامه های کاربردی

- با استفاده از

- روش

- مناسب

- هستند

- محدوده

- دور و بر

- مصنوعی

- هوش مصنوعی

- AS

- همکاری

- At

- بطور خودکار

- مستقر

- خط مقدم

- شدن

- بهترین

- بهتر

- میان

- بالا بردن

- هر دو

- تنفس

- by

- نام

- CAN

- ظرفیت

- موارد

- علت

- مرکز

- به چالش

- چک

- را انتخاب

- طبقه بندی

- طبقه بندی کنید

- کلیک

- بالینی

- CNN

- جامع

- کامپیوتر

- تکرار

- میتوانست

- Covid-19

- ایجاد

- ایجاد شده

- ضوابط

- بحرانی

- محصولات

- منحنی

- داده ها

- مجموعه داده ها

- عمیق

- یادگیری عمیق

- درجه

- نشان

- توصیف

- توسعه

- مشکلات

- مرض

- اختلالات

- مختلف

- خشک

- در طی

- هر

- در اوایل

- موثر

- کافی

- خطاهای

- ارزیابی

- مثال

- مثال ها

- موجود

- گسترش

- منبسط

- توضیح دهید

- کشف

- غلط

- نهایی

- نام خانوادگی

- به دنبال

- برای

- چارچوب

- از جانب

- عموما

- GPU

- گرافیک

- هک

- آیا

- کمک

- زیاد

- بالاتر

- اما

- HTTPS

- شناسایی

- شناسایی

- تصویر

- طبقه بندی تصویر

- تصاویر

- تصویربرداری

- اجرا

- بهبود

- ارتقاء

- بهبود

- in

- از جمله

- به طور فزاینده

- هندوستان

- اطلاعات

- اطلاعات

- موضوع

- IT

- JPG

- دانش

- عدم

- بزرگ

- یاد گرفتن

- یادگیری

- ساخت

- حداکثر عرض

- معیارهای

- پزشکی

- روش

- متری

- متریک

- مدل

- مدل سازی

- مدل

- بیش

- اکثر

- نانو

- منفی

- شبکه

- شبکه های عصبی

- جدید

- طبیعی

- رمان

- عدد

- تعداد

- کارت گرافیک Nvidia

- به دست آمده

- of

- on

- ONE

- باز کن

- بهینه سازی

- or

- دیگر

- دیگران

- روی

- به طور کلی

- ویژه

- pacientes

- کارایی

- انجام

- فاز

- برنامه

- افلاطون

- هوش داده افلاطون

- PlatoData

- ذات الریه

- استخر

- محبوب

- تصویر می کند

- بالقوه

- قدرت

- در حال حاضر

- ارائه

- اصلی

- در حال پردازش

- نسبت

- پیشنهاد شده

- ارائه

- فراهم می کند

- عمومی

- کیفیت

- سریعا

- نرخ

- زمان واقعی

- گرفتن

- مربوط

- بقایای

- نمایندگی

- محققان

- به ترتیب

- نشان داد

- s

- SCI

- علم

- انتخاب شد

- چند

- شیفت

- کمبود

- قابل توجه

- مشابه

- تنها

- برخی از

- خاص

- وضعیت هنر

- استراتژی

- مطالعات

- مهاجرت تحصیلی

- چنین

- نشانه ها

- کار

- آزمون

- تست

- نسبت به

- که

- La

- محوطه

- شان

- آنها

- این

- سه

- کوچک

- به

- بالا

- جمع

- قطار

- آموزش

- انتقال

- رفتار

- درست

- زیر

- واحد

- استفاده کنید

- استفاده

- با استفاده از

- تایید شده

- اعتبار سنجی

- ارزشها

- از طريق

- رای گیری

- چه

- که

- در حین

- با

- بدون

- در سرتاسر جهان

- نوشتن

- اشعه ایکس

- زفیرنت