تعدیل محتوا فرآیند غربالگری و نظارت بر محتوای تولید شده توسط کاربر به صورت آنلاین است. برای ارائه یک محیط امن هم برای کاربران و هم برای برندها، پلتفرمها باید محتوا را تعدیل کنند تا اطمینان حاصل شود که در چارچوب دستورالعملهای از پیش تعیینشده رفتار قابل قبولی است که مختص پلتفرم و مخاطبان آن است.

هنگامی که یک پلتفرم محتوا را تعدیل می کند، محتوای قابل قبول تولید شده توسط کاربر (UGC) را می توان ایجاد کرد و با سایر کاربران به اشتراک گذاشت. رفتارهای نامناسب، سمی یا ممنوعه بسته به ابزارها و روشهای تعدیل محتوا که پلتفرم در اختیار دارد، میتواند از رفتارهای نامناسب، سمی یا ممنوع جلوگیری شود، بلادرنگ مسدود شوند، یا بعد از این واقعیت حذف شوند.

شما می توانید تعدیل محتوای شناسایی آمازون برای شناسایی محتوای نامناسب، ناخواسته یا توهینآمیز، برای ایجاد تجربه کاربری ایمنتر، ارائه تضمینهای ایمنی برند به تبلیغکنندگان، و مطابقت با مقررات محلی و جهانی.

در این پست، عناصر کلیدی مورد نیاز برای ارزیابی جنبه عملکرد یک سرویس تعدیل محتوا از نظر معیارهای مختلف دقت را مورد بحث قرار میدهیم و مثالی را با استفاده از شناسایی آمازون ارائه میکنیم. Content Moderation APIs.

چه چیزی را ارزیابی کنیم

هنگام ارزیابی یک سرویس تعدیل محتوا، مراحل زیر را توصیه می کنیم.

قبل از اینکه بتوانید عملکرد API را در موارد استفاده خود ارزیابی کنید، باید یک مجموعه داده آزمایشی نماینده تهیه کنید. در زیر برخی از دستورالعمل های سطح بالا آورده شده است:

- مجموعه - نمونه تصادفی (تصاویر یا فیلمها) به اندازه کافی بزرگ از دادههایی که میخواهید در نهایت از طریق آمازون Rekognition اجرا شوند، بگیرید. به عنوان مثال، اگر قصد دارید تصاویر آپلود شده توسط کاربر را تعدیل کنید، می توانید تصاویر کاربر به ارزش یک هفته را برای آزمون بگیرید. ما توصیه میکنیم مجموعهای را انتخاب کنید که تصاویر کافی داشته باشد بدون اینکه پردازش آنها زیاد باشد (مانند 1,000 تا 10,000 عکس)، اگرچه مجموعههای بزرگتر بهتر هستند.

- تعریف - از دستورالعمل های محتوای برنامه خود استفاده کنید تا تصمیم بگیرید کدام نوع محتوای ناامن را می خواهید از Amazon Rekognition شناسایی کنید. طبقه بندی مفاهیم اعتدال. برای مثال، شما ممکن است علاقه مند به تشخیص انواع برهنگی های صریح و خشونت تصویری یا گور باشید.

- حاشیه نویسی - اکنون برای مجموعه آزمایشی خود با استفاده از برچسب های انتخابی به یک حقیقت زمینی تولید شده توسط انسان نیاز دارید تا بتوانید پیش بینی های ماشین را با آنها مقایسه کنید. این بدان معنی است که هر تصویر برای حضور یا عدم وجود مفاهیم انتخابی شما حاشیه نویسی می شود. برای حاشیه نویسی داده های تصویر خود، می توانید استفاده کنید Amazon SageMaker Ground Truth (GT)برای مدیریت حاشیه نویسی تصویر. می توانید مراجعه کنید GT برای برچسب گذاری تصویر, ادغام حاشیه نویسی و پردازش خروجی حاشیه نویسی.

با آمازون Rekognition پیش بینی هایی را در مجموعه داده آزمایشی خود دریافت کنید

در مرحله بعد، می خواهید پیش بینی هایی را در مجموعه داده آزمایشی خود دریافت کنید.

اولین مرحله تصمیم گیری در مورد حداقل امتیاز اطمینان (مقدار آستانه، مانند 50٪) است که در آن می خواهید نتایج را اندازه گیری کنید. آستانه پیشفرض ما روی 50 تنظیم شده است که تعادل خوبی بین بازیابی مقادیر زیادی از محتوای ناامن بدون پیشبینیهای نادرست زیاد در مورد محتوای ایمن ارائه میدهد. با این حال، پلتفرم شما ممکن است نیازهای تجاری متفاوتی داشته باشد، بنابراین باید در صورت نیاز این آستانه اطمینان را سفارشی کنید. می توانید استفاده کنید MinConfidence پارامتر در درخواست های API شما برای ایجاد تعادل بین تشخیص محتوا (یادآوری) در مقابل دقت تشخیص (دقت). اگر کم کنید MinConfidence، احتمالاً بیشتر محتوای نامناسب را تشخیص می دهید، اما احتمالاً محتوایی را انتخاب می کنید که واقعاً نامناسب نیست. اگر افزایش دهید MinConfidence احتمالاً مطمئن می شوید که تمام محتوای شناسایی شده شما واقعاً نامناسب است اما ممکن است برخی از محتواها برچسب گذاری نشوند. پیشنهاد می کنیم با چند مورد آزمایش کنید MinConfidence مقادیر موجود در مجموعه داده شما و از نظر کمی بهترین مقدار را برای دامنه داده خود انتخاب کنید.

سپس، هر نمونه (تصویر یا ویدیو) از مجموعه آزمایشی خود را از طریق API تعدیل شناسایی آمازون اجرا کنید (DetectModerationLabels).

اندازه گیری دقت مدل در تصاویر

شما می توانید دقت یک مدل را با مقایسه حاشیه نویسی های حقیقت زمینی تولید شده توسط انسان با پیش بینی های مدل ارزیابی کنید. این مقایسه را برای هر تصویر به طور مستقل تکرار میکنید و سپس کل مجموعه آزمایشی را جمع میکنید:

- نتایج هر تصویر - پیش بینی مدل به عنوان جفت تعریف می شود

{label_name, confidence_score}(که در آن نمره اطمینان >= آستانه ای که قبلا انتخاب کرده اید). برای هر تصویر، یک پیشبینی درست در نظر گرفته میشود که با حقیقت زمین (GT) مطابقت داشته باشد. پیشبینی یکی از گزینههای زیر است:- مثبت واقعی (TP): هم پیش بینی و هم GT "ناامن" هستند

- منفی واقعی (TN): هم پیش بینی و هم GT "ایمن" هستند

- مثبت کاذب (FP): پیشبینی میگوید "ناامن"، اما GT "ایمن" است

- منفی کاذب (FN): پیشبینی "ایمن" است، اما GT "ناامن" است

- نتایج جمع آوری شده روی همه تصاویر - در مرحله بعد، می توانید این پیش بینی ها را در نتایج سطح داده جمع آوری کنید:

- نرخ مثبت کاذب (FPR) – این درصدی از تصاویر در مجموعه آزمایشی است که به اشتباه توسط مدل به عنوان حاوی محتوای ناامن پرچمگذاری شدهاند: (FP): FP / (TN+FP).

- نرخ منفی کاذب (FNR) – این درصدی از تصاویر ناامن در مجموعه آزمایشی است که توسط مدل از دست رفته است: (FN): FN / (FN+TP).

- نرخ مثبت واقعی (TPR) – همچنین Recall نامیده می شود، این درصد محتوای ناامن (حقیقت زمین) را که به درستی توسط مدل کشف یا پیش بینی شده است محاسبه می کند: TP / (TP + FN) = 1 – FNR.

- دقت - این درصد پیش بینی های صحیح (محتوای ناامن) را با توجه به تعداد کل پیش بینی های انجام شده محاسبه می کند: TP / (TP+FP).

بیایید یک مثال را بررسی کنیم. بیایید فرض کنیم که مجموعه آزمایشی شما شامل 10,000 تصویر است: 9,950 تصویر سالم و 50 تصویر ناامن. این مدل به درستی 9,800 تصویر از 9,950 تصویر را ایمن و 45 از 50 تصویر را ناامن پیشبینی میکند:

- TP = 45

- TN = 9800

- FP = 9950 - 9800 = 150

- FN = 50 - 45 = 5

- RPF = 150 / (9950 + 150) = 0.015 = 1.5٪

- FNR = 5 / (5 + 45) = 0.1 = 10٪

- TPR / فراخوان = 45 / (45 + 5) = 0.9 = 90٪

- دقت = 45 / (45 + 150) = 0.23 = 23٪

اندازه گیری دقت مدل در ویدئوها

اگر میخواهید عملکرد ویدیوها را ارزیابی کنید، چند مرحله اضافی لازم است:

- از هر ویدیو زیر مجموعه ای از فریم ها را نمونه بگیرید. ما نمونه برداری یکنواخت با نرخ 0.3-1 فریم در ثانیه (fps) را پیشنهاد می کنیم. به عنوان مثال، اگر ویدیویی با سرعت 24 فریم در ثانیه رمزگذاری شده است و می خواهید هر 3 ثانیه یک فریم (0.3 فریم در ثانیه) نمونه برداری کنید، باید هر 72 فریم یکی را انتخاب کنید.

- این فریم های نمونه را از طریق تعدیل محتوای شناسایی آمازون اجرا کنید. میتوانید از API ویدیوی ما استفاده کنید، که قبلاً فریمها را برای شما نمونهبرداری میکند (با سرعت 3 فریم در ثانیه)، یا از API تصویر استفاده کنید، در این صورت میخواهید نمونهبرداری پراکندهتری داشته باشید. ما گزینه دوم را با توجه به اطلاعات اضافی در ویدیوها توصیه می کنیم (فریم های متوالی بسیار شبیه به هم هستند).

- نتایج هر فریم را همانطور که در بخش قبل توضیح داده شد (نتایج هر تصویر) محاسبه کنید.

- نتایج را در کل مجموعه آزمایش جمع کنید. در اینجا بسته به نوع نتیجه ای که برای کسب و کار شما مهم است، دو گزینه دارید:

- نتایج در سطح فریم - این همه فریم های نمونه برداری شده را به عنوان تصاویر مستقل در نظر می گیرد و نتایج را دقیقاً همانطور که قبلاً برای تصاویر توضیح داده شد (FPR، FNR، یادآوری، دقت) جمع می کند. اگر برخی از ویدیوها به طور قابل توجهی طولانی تر از سایرین باشند، فریم های بیشتری را به تعداد کل کمک می کنند و مقایسه را نامتعادل می کنند. در آن صورت، پیشنهاد میکنیم استراتژی نمونهگیری اولیه را به تعداد ثابتی فریم در هر ویدیو تغییر دهید. برای مثال، میتوانید ۵۰ تا ۱۰۰ فریم در هر ویدیو را بهطور یکنواخت نمونه برداری کنید (با فرض اینکه ویدیوها حداقل ۲ تا ۳ دقیقه طول بکشند).

- نتایج در سطح ویدیو – برای برخی موارد استفاده، فرقی نمیکند که مدل بتواند 50 درصد یا 99 درصد فریمهای یک ویدیو را به درستی پیشبینی کند. حتی یک پیشبینی ناامن اشتباه روی یک فریم میتواند باعث ارزیابی پایین دستی انسان شود و فقط ویدیوهایی با پیشبینیهای 100٪ درست واقعاً به درستی در نظر گرفته میشوند. اگر این مورد استفاده شماست، پیشنهاد می کنیم FPR/FNR/TPR را روی فریم های هر ویدیو محاسبه کنید و ویدیو را به صورت زیر در نظر بگیرید:

| شناسه ویدئو | دقت | دسته بندی هر ویدیو |

| نتایج جمعآوری شده روی همه فریمهای ID ویدیو |

کل FP = 0 مجموع FN = 0 |

پیش بینی های کامل |

| . | کل FP > 0 | مثبت کاذب (FP) |

| . | مجموع FN > 0 | منفی کاذب (FN) |

پس از اینکه این موارد را برای هر ویدیو به طور مستقل محاسبه کردید، سپس می توانید تمام معیارهایی را که قبلا معرفی کردیم محاسبه کنید:

- درصد ویدیوهایی که به اشتباه پرچم گذاری شده اند (FP) یا از دست رفته (FN)

- دقت و یادآوری

اندازه گیری عملکرد در برابر اهداف

در نهایت، باید این نتایج را در چارچوب اهداف و قابلیت های خود تفسیر کنید.

ابتدا نیازهای کسب و کار خود را با توجه به موارد زیر در نظر بگیرید:

- داده ها - در مورد داده های خود (حجم روزانه، نوع داده ها و غیره) و توزیع محتوای ناامن خود در مقابل محتوای امن بیاموزید. به عنوان مثال، آیا تعادل (50/50)، اریب (10/90) یا بسیار کج (1/99، یعنی فقط 1٪ ناامن است) است؟ درک چنین توزیعی می تواند به شما در تعیین اهداف متریک واقعی کمک کند. به عنوان مثال، تعداد محتوای ایمن اغلب یک مرتبه بزرگتر از محتوای ناامن است (بسیار اریب) و این تقریباً یک مشکل تشخیص غیرعادی است. در این سناریو، تعداد موارد مثبت کاذب ممکن است از تعداد مثبتهای واقعی بیشتر باشد، و شما میتوانید از اطلاعات دادههای خود (چولگی توزیع، حجم دادهها و غیره) برای تصمیمگیری FPR که میتوانید با آن کار کنید، استفاده کنید.

- اهداف متریک - مهمترین جنبه های کسب و کار شما چیست؟ کاهش FPR اغلب به قیمت FNR بالاتر (و بالعکس) تمام می شود و مهم است که تعادل مناسب را پیدا کنید که برای شما مناسب باشد. اگر نمی توانید هیچ محتوای ناامنی را از دست بدهید، احتمالاً نزدیک به 0٪ FNR (100٪ فراخوان) می خواهید. با این حال، این بیشترین تعداد مثبت کاذب را به همراه خواهد داشت، و شما باید بر اساس خط لوله پس از پیش بینی خود، هدف (حداکثر) FPR را که می توانید با آن کار کنید، تعیین کنید. ممکن است بخواهید اجازه دهید برخی از سطوح منفی کاذب بتوانید تعادل بهتری پیدا کنید و FPR خود را کاهش دهید: برای مثال، پذیرش FNR 5٪ به جای 0٪ می تواند FPR را از 2٪ به 0.5٪ کاهش دهد، به طور قابل توجهی تعداد را کاهش می دهد. از محتویات پرچم گذاری شده

سپس از خود بپرسید که از چه مکانیسم هایی برای تجزیه تصاویر پرچمدار استفاده خواهید کرد. اگرچه ممکن است API 0٪ FPR و FNR ارائه نکند، اما همچنان می تواند صرفه جویی و مقیاس زیادی را به همراه داشته باشد (به عنوان مثال، تنها با پرچم گذاری 3٪ از تصاویر خود، شما قبلاً 97٪ از محتوای خود را فیلتر کرده اید). وقتی API را با مکانیسمهای پاییندستی جفت میکنید، مانند نیروی انسانی که محتوای پرچمگذاری شده را بررسی میکند، میتوانید به راحتی به اهداف خود برسید (مثلاً 0.5٪ محتوای پرچمگذاری شده). توجه داشته باشید که چگونه این جفت شدن به طور قابل توجهی ارزان تر از بررسی انسانی در 100٪ محتوای شما است.

هنگامی که در مورد مکانیسم های پایین دستی خود تصمیم گرفتید، به شما پیشنهاد می کنیم توان عملیاتی را که می توانید پشتیبانی کنید، ارزیابی کنید. برای مثال، اگر نیروی کاری دارید که فقط میتواند ۲ درصد از محتوای روزانه شما را تأیید کند، هدف شما از API تعدیل محتوا، نرخ پرچم (FPR+TPR) ۲ درصد است.

در نهایت، اگر دستیابی به حاشیهنویسیهای واقعی خیلی سخت یا گران است (مثلاً حجم دادههای شما خیلی زیاد است)، پیشنهاد میکنیم تعداد کمی از تصاویر پرچمگذاری شده توسط API را حاشیهنویسی کنید. اگرچه این امکان ارزیابی FNR را نمی دهد (زیرا داده های شما حاوی منفی کاذب نیستند)، همچنان می توانید TPR و FPR را اندازه گیری کنید.

در قسمت زیر راه حلی برای ارزیابی تعدیل تصویر ارائه می دهیم. شما می توانید رویکرد مشابهی را برای ارزیابی تعدیل ویدیو اتخاذ کنید.

بررسی اجمالی راه حل

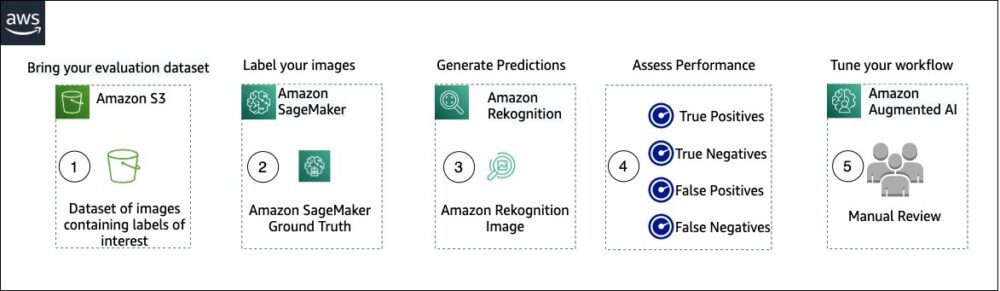

نمودار زیر خدمات مختلف AWS را نشان می دهد که می توانید برای ارزیابی عملکرد تعدیل محتوای شناسایی آمازون در مجموعه داده آزمایشی خود از آنها استفاده کنید.

ارزیابی تعدیل محتوا دارای مراحل زیر است:

- مجموعه داده ارزیابی خود را در آن آپلود کنید سرویس ذخیره سازی ساده آمازون (Amazon S3).

- از Ground Truth برای اختصاص برچسب های تعدیل حقیقت پایه استفاده کنید.

- برچسبهای تعدیل پیشبینیشده را با استفاده از API تعدیلشده از پیش آموزشدیده Amazon Rekognition با استفاده از چند مقدار آستانه ایجاد کنید. (مثلاً 70%، 75% و 80%).

- عملکرد را برای هر آستانه با محاسبه مثبت درست، منفی درست، مثبت کاذب و منفی کاذب ارزیابی کنید. مقدار آستانه بهینه را برای مورد استفاده خود تعیین کنید.

- به صورت اختیاری، می توانید اندازه نیروی کار را بر اساس موارد مثبت درست و نادرست تنظیم کنید و از آن استفاده کنید هوش مصنوعی آمازون افزوده شده است (Amazon A2I) تا به طور خودکار تمام محتوای پرچمدار را برای بررسی دستی به نیروی کار تعیین شده خود ارسال کند.

بخشهای زیر قطعههای کد مراحل 1، 2 و 3 را ارائه میدهند. برای کد منبع کامل، به موارد ارائه شده مراجعه کنید. دفترچه ژوپیتر.

پیش نیازها

قبل از شروع، مراحل زیر را برای راه اندازی نوت بوک Jupyter انجام دهید:

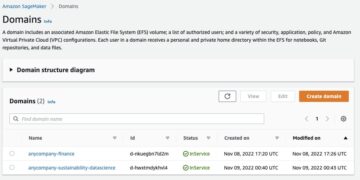

- یک نمونه نوت بوک ایجاد کنید in آمازون SageMaker.

- وقتی نوت بوک فعال است، را انتخاب کنید ژوپیتر را باز کنید.

- در داشبورد Jupyter، را انتخاب کنید جدید، و انتخاب کنید پایانه.

- در ترمینال کد زیر را وارد کنید:

- دفترچه یادداشت این پست را باز کنید:

content-moderation-evaluation/Evaluating-Amazon-Rekognition-Content-Moderation-Service.ipynb. - مجموعه داده ارزیابی خود را آپلود کنید سرویس ذخیره سازی ساده آمازون (Amazon S3).

اکنون مراحل 2 تا 4 را در نوت بوک Jupyter طی می کنیم.

از Ground Truth برای اختصاص برچسب های تعدیل استفاده کنید

برای اختصاص برچسب ها در Ground Truth، مراحل زیر را انجام دهید:

- یک فایل ورودی مانیفست ایجاد کنید برای کار Ground Truth خود و آن را در آمازون S3 آپلود کنید.

- پیکربندی برچسبگذاری را ایجاد کنید، که حاوی تمام برچسبهای تعدیل مورد نیاز برای کار برچسبگذاری Ground Truth است. برای بررسی محدودیت تعداد دستههای برچسبی که میتوانید استفاده کنید، به سهمیه های دسته بندی برچسب. در قطعه کد زیر، از پنج برچسب استفاده می کنیم (رجوع کنید به طبقه بندی سلسله مراتبی مورد استفاده در آمازون Rekognition برای جزئیات بیشتر) به اضافه یک برچسب (

Safe_Content) که محتوا را به عنوان امن علامت گذاری می کند: - یک الگوی کار سفارشی کارگر ایجاد کنید تا دستورالعملهای برچسبگذاری را به نیروی کار Ground Truth ارائه کنید و آن را در Amazon S3 آپلود کنید.

کار برچسب Ground Truth به عنوان یک کار طبقه بندی تصویر (چند برچسب) تعریف می شود. برای دستورالعملهای سفارشیسازی الگوی دستورالعمل، به کد منبع مراجعه کنید. - تصمیم بگیرید که از کدام نیروی کاری می خواهید برای تکمیل کار Ground Truth استفاده کنید. شما دو گزینه دارید (برای جزئیات به کد منبع مراجعه کنید):

- استفاده نیروی کار خصوصی در سازمان خود برای برچسب گذاری مجموعه داده ارزیابی.

- استفاده نیروی کار عمومی برای برچسب گذاری مجموعه داده ارزیابی

- یک کار برچسبگذاری Ground Truth ایجاد و ارسال کنید. همچنین می توانید کد زیر را برای پیکربندی تنظیم کنید برچسب زدن پارامترهای شغلی برای برآوردن نیازهای تجاری خاص شما برای دستورالعمل های کامل در مورد ایجاد و پیکربندی کار Ground Truth به کد منبع مراجعه کنید.

پس از ارسال کار، باید خروجی مشابه زیر را مشاهده کنید:

منتظر بمانید تا کار برچسب زدن روی مجموعه داده ارزیابی با موفقیت تکمیل شود، سپس به مرحله بعدی ادامه دهید.

برای ایجاد برچسبهای تعدیل پیشبینیشده از Amazon Rekognition moderation API استفاده کنید.

قطعه کد زیر نحوه استفاده از آمازون Rekognition را نشان می دهد moderation API برای تولید برچسب های تعدیل:

عملکرد را ارزیابی کنید

شما ابتدا برچسبهای تعدیل حقیقت پایه را از نتایج شغل برچسبگذاری Ground Truth برای مجموعه داده ارزیابی بازیابی کردید، سپس API تعدیل شناسایی آمازون را برای دریافت برچسبهای تعدیل پیشبینیشده برای همان مجموعه داده اجرا کردید. از آنجایی که این یک مشکل طبقه بندی باینری است (محتوای ایمن در مقابل ناامن)، معیارهای زیر را محاسبه می کنیم (با فرض مثبت بودن محتوای ناامن):

ما همچنین معیارهای ارزیابی مربوطه را محاسبه می کنیم:

قطعه کد زیر نحوه محاسبه این معیارها را نشان می دهد:

نتیجه

این پست عناصر کلیدی مورد نیاز برای ارزیابی جنبه عملکرد سرویس تعدیل محتوای شما را از نظر معیارهای مختلف دقت مورد بحث قرار میدهد. با این حال، دقت تنها یکی از ابعاد متعددی است که هنگام انتخاب یک سرویس تعدیل محتوای خاص باید ارزیابی کنید. بسیار مهم است که پارامترهای دیگری مانند مجموعه ویژگیهای کلی سرویس، سهولت استفاده، ادغامهای موجود، حریم خصوصی و امنیت، گزینههای سفارشیسازی، پیامدهای مقیاسپذیری، خدمات مشتری و قیمتگذاری را نیز لحاظ کنید. برای کسب اطلاعات بیشتر در مورد تعدیل محتوا در آمازون Rekognition، مراجعه کنید تعدیل محتوای شناسایی آمازون.

درباره نویسندگان

آمیت گوپتا یک معمار ارشد راه حل های خدمات هوش مصنوعی در AWS است. او مشتاق است که مشتریان را با راهحلهای یادگیری ماشینی با معماری خوب در مقیاس قادر سازد.

آمیت گوپتا یک معمار ارشد راه حل های خدمات هوش مصنوعی در AWS است. او مشتاق است که مشتریان را با راهحلهای یادگیری ماشینی با معماری خوب در مقیاس قادر سازد.

دیوید مودولو مدیر علوم کاربردی در آزمایشگاه های هوش مصنوعی AWS است. او دارای مدرک دکترای بینایی کامپیوتر از دانشگاه ادینبورگ (بریتانیا) است و مشتاق توسعه راه حل های علمی جدید برای مشکلات مشتریان در دنیای واقعی است. خارج از محل کار از مسافرت و انجام هر نوع ورزشی به خصوص فوتبال لذت می برد.

دیوید مودولو مدیر علوم کاربردی در آزمایشگاه های هوش مصنوعی AWS است. او دارای مدرک دکترای بینایی کامپیوتر از دانشگاه ادینبورگ (بریتانیا) است و مشتاق توسعه راه حل های علمی جدید برای مشکلات مشتریان در دنیای واقعی است. خارج از محل کار از مسافرت و انجام هر نوع ورزشی به خصوص فوتبال لذت می برد.

جیان وو یک معمار ارشد راه حل های سازمانی در AWS است. او به مدت 6 سال با AWS کار می کند و با مشتریانی در هر اندازه ای کار می کند. او مشتاق کمک به مشتریان برای نوآوری سریعتر از طریق استفاده از Cloud و AI/ML است. قبل از پیوستن به AWS، جیان بیش از 10 سال را بر روی توسعه نرم افزار، پیاده سازی سیستم و مدیریت زیرساخت تمرکز کرد. جدای از کار، او از فعال ماندن و گذراندن وقت با خانواده لذت می برد.

جیان وو یک معمار ارشد راه حل های سازمانی در AWS است. او به مدت 6 سال با AWS کار می کند و با مشتریانی در هر اندازه ای کار می کند. او مشتاق کمک به مشتریان برای نوآوری سریعتر از طریق استفاده از Cloud و AI/ML است. قبل از پیوستن به AWS، جیان بیش از 10 سال را بر روی توسعه نرم افزار، پیاده سازی سیستم و مدیریت زیرساخت تمرکز کرد. جدای از کار، او از فعال ماندن و گذراندن وقت با خانواده لذت می برد.

- پیشرفته (300)

- AI

- آی هنر

- مولد هنر ai

- ربات ai

- شناسایی آمازون

- هوش مصنوعی

- گواهی هوش مصنوعی

- هوش مصنوعی در بانکداری

- ربات هوش مصنوعی

- ربات های هوش مصنوعی

- نرم افزار هوش مصنوعی

- آموزش ماشین AWS

- بلاکچین

- کنفرانس بلاک چین ai

- coingenius

- هوش مصنوعی محاوره ای

- کنفرانس کریپتو ai

- دل-ه

- یادگیری عمیق

- گوگل ai

- فراگیری ماشین

- افلاطون

- افلاطون آی

- هوش داده افلاطون

- بازی افلاطون

- PlatoData

- بازی پلاتو

- مقیاس Ai

- نحو

- زفیرنت