علیرغم پذیرش به ظاهر غیرقابل توقف LLM ها در صنایع، آنها یکی از اجزای یک اکوسیستم فناوری گسترده تر هستند که موج جدید هوش مصنوعی را تقویت می کند. بسیاری از موارد استفاده از هوش مصنوعی محاورهای به LLMهایی مانند Llama 2، Flan T5 و Bloom نیاز دارند تا به سؤالات کاربر پاسخ دهند. این مدل ها برای پاسخ به سوالات بر دانش پارامتریک تکیه می کنند. مدل این دانش را در طول آموزش یاد می گیرد و آن را در پارامترهای مدل رمزگذاری می کند. برای به روز رسانی این دانش، ما باید LLM را دوباره آموزش دهیم که زمان و هزینه زیادی را می طلبد.

خوشبختانه، ما همچنین می توانیم از دانش منبع برای اطلاع رسانی به LLM های خود استفاده کنیم. دانش منبع اطلاعاتی است که از طریق یک اعلان ورودی به LLM وارد می شود. یکی از رویکردهای رایج برای ارائه دانش منبع، بازیابی نسل افزوده (RAG) است. با استفاده از RAG، اطلاعات مربوطه را از یک منبع داده خارجی بازیابی می کنیم و آن اطلاعات را به LLM وارد می کنیم.

در این پست وبلاگ، نحوه استقرار LLM هایی مانند Llama-2 را با استفاده از Amazon Sagemaker JumpStart و به روز نگه داشتن LLM های خود با اطلاعات مرتبط از طریق Retrieval Augmented Generation (RAG) با استفاده از پایگاه داده برداری Pinecone به منظور جلوگیری از توهم AI بررسی خواهیم کرد. .

بازیابی نسل افزوده (RAG) در آمازون SageMaker

Pinecone جزء بازیابی RAG را مدیریت می کند، اما شما به دو جزء حیاتی دیگر نیاز دارید: جایی برای اجرای استنتاج LLM و جایی برای اجرای مدل تعبیه.

Amazon SageMaker Studio یک محیط توسعه یکپارچه (IDE) است که یک رابط بصری مبتنی بر وب را فراهم می کند که در آن می توانید به ابزارهای ساخته شده برای انجام تمام توسعه یادگیری ماشین (ML) دسترسی داشته باشید. SageMaker JumpStart را ارائه می دهد که یک مرکز مدل است که در آن کاربران می توانند یک مدل خاص را در حساب SageMaker خود بیابند، پیش نمایش کنند و راه اندازی کنند. مدل های از پیش آموزش دیده، در دسترس عموم و اختصاصی را برای طیف وسیعی از انواع مشکلات، از جمله مدل های بنیادی، ارائه می دهد.

Amazon SageMaker Studio محیط ایده آلی را برای توسعه خطوط لوله LLM با RAG فراهم می کند. ابتدا با استفاده از کنسول AWS به Amazon SageMaker بروید و یک دامنه SageMaker Studio ایجاد کنید و یک نوت بوک Jupyter Studio را باز کنید.

پیش نیازها

مراحل پیش نیاز زیر را کامل کنید:

- Amazon SageMaker Studio را راه اندازی کنید.

- ورود به دامنه Amazon SageMaker.

- برای پایگاه داده وکتور Pinecone سطح رایگان ثبت نام کنید.

- کتابخانه های پیش نیاز: SageMaker Python SDK، Pinecone Client

راه حل

با استفاده از نوت بوک SageMaker Studio، ابتدا باید کتابخانه های پیش نیاز را نصب کنیم:

استقرار یک LLM

در این پست، دو رویکرد برای استقرار یک LLM مورد بحث قرار میدهیم. اولین مورد از طریق HuggingFaceModel هدف - شی. شما می توانید از این هنگام استقرار LLM (و جاسازی مدل ها) به طور مستقیم از هاب مدل Hugging Face استفاده کنید.

به عنوان مثال، می توانید یک پیکربندی قابل استقرار برای آن ایجاد کنید google/flan-t5-xl مدلی که در تصویر زیر نشان داده شده است:

هنگام استقرار مدلها مستقیماً از Hugging Face، مقدار اولیه را تنظیم کنید my_model_configuration با موارد زیر:

- An

envconfig به ما می گوید که از کدام مدل و برای چه کاری می خواهیم استفاده کنیم. - اجرای SageMaker ما

roleبه ما اجازه می دهد تا مدل خود را به کار بگیریم. - An

image_uriیک پیکربندی تصویر به طور خاص برای استقرار LLM ها از Hugging Face است.

از طرف دیگر، SageMaker مجموعهای از مدلها را دارد که مستقیماً با مدلهای سادهتر سازگار هستند JumpStartModel هدف - شی. بسیاری از LLM های محبوب مانند Llama 2 توسط این مدل پشتیبانی می شوند، که می تواند همانطور که در تصویربرداری صفحه زیر نشان داده شده است مقداردهی اولیه شود:

برای هر دو نسخه از my_model، آنها را همانطور که در تصویربرداری صفحه زیر نشان داده شده است، مستقر کنید:

با نقطه پایانی اولیه LLM ما، می توانید پرس و جو را شروع کنید. قالب درخواست های ما ممکن است متفاوت باشد (مخصوصاً بین LLM های مکالمه و غیرمکالمه ای)، اما روند به طور کلی یکسان است. برای مدل Hagging Face به صورت زیر عمل کنید:

شما می توانید راه حل را در مخزن GitHub.

پاسخی که ما در اینجا دریافت می کنیم چندان منطقی نیست - این یک توهم است.

ارائه متن اضافی به LLM

Llama 2 سعی می کند به سؤال ما فقط بر اساس دانش پارامتریک داخلی پاسخ دهد. واضح است که پارامترهای مدل دانشی را در مورد اینکه کدام نمونه ها را می توانیم با آموزش نقطه مدیریت شده در SageMaker ذخیره کنیم.

برای پاسخ صحیح به این سوال باید از دانش منبع استفاده کنیم. یعنی اطلاعات اضافی را از طریق اعلان به LLM می دهیم. بیایید آن اطلاعات را مستقیماً به عنوان زمینه اضافی برای مدل اضافه کنیم.

اکنون پاسخ صحیح سوال را می بینیم. آن آسان بود! با این حال، کاربر بعید است که زمینه ها را در پیام های خود وارد کند، آنها از قبل پاسخ سؤال خود را می دانند.

به جای درج دستی یک زمینه واحد، به طور خودکار اطلاعات مرتبط را از یک پایگاه داده گسترده تر از اطلاعات شناسایی کنید. برای آن، به Retrieval Augmented Generation نیاز دارید.

بازیابی نسل افزوده

با Retrieval Augmented Generation، می توانید پایگاه داده ای از اطلاعات را در فضای برداری رمزگذاری کنید که نزدیکی بین بردارها نشان دهنده ارتباط/شباهت معنایی آنهاست. با استفاده از این فضای برداری به عنوان پایگاه دانش، می توانید یک پرس و جو کاربر جدید را تبدیل کنید، آن را به همان فضای برداری رمزگذاری کنید، و مرتبط ترین رکوردهایی که قبلاً فهرست شده اند را بازیابی کنید.

پس از بازیابی این سوابق مرتبط، تعدادی از آنها را انتخاب کنید و آنها را در اعلان LLM به عنوان زمینه اضافی بگنجانید و دانش منبع بسیار مرتبط را در اختیار LLM قرار دهید. این یک فرآیند دو مرحله ای است که در آن:

- نمایه سازی نمایه برداری را با اطلاعات یک مجموعه داده پر می کند.

- بازیابی در طول یک پرس و جو اتفاق می افتد و جایی است که ما اطلاعات مربوطه را از نمایه برداری بازیابی می کنیم.

هر دو مرحله نیاز به یک مدل جاسازی برای ترجمه متن ساده قابل خواندن توسط انسان به فضای برداری معنایی دارند. همانطور که در تصویر زیر نشان داده شده است، از ترانسفورماتور جمله MiniLM بسیار کارآمد از Hugging Face استفاده کنید. این مدل یک LLM نیست و بنابراین به همان روش مدل Llama 2 ما مقداردهی اولیه نمی شود.

در hub_config، شناسه مدل را همانطور که در تصویر بالا نشان داده شده است مشخص کنید، اما برای کار، از استخراج ویژگی استفاده کنید زیرا ما در حال ایجاد جاسازی های برداری هستیم نه متنی مانند LLM خود. به دنبال این، پیکربندی مدل را با مقداردهی اولیه کنید HuggingFaceModel مانند قبل، اما این بار بدون تصویر LLM و با برخی پارامترهای نسخه.

شما می توانید مدل را دوباره با deploy، با استفاده از نمونه کوچکتر (فقط CPU). ml.t2.large. مدل MiniLM کوچک است، بنابراین به حافظه زیادی نیاز ندارد و به GPU نیاز ندارد زیرا می تواند به سرعت جاسازی ها را حتی بر روی CPU ایجاد کند. در صورت تمایل، می توانید مدل را سریعتر روی GPU اجرا کنید.

برای ایجاد جاسازی، از predict روش و ارسال لیستی از زمینه ها برای کدگذاری از طریق inputs کلید مطابق شکل:

دو زمینه ورودی ارسال می شود، که دو جاسازی بردار زمینه را همانطور که نشان داده شده است برمی گرداند:

len(out)

2

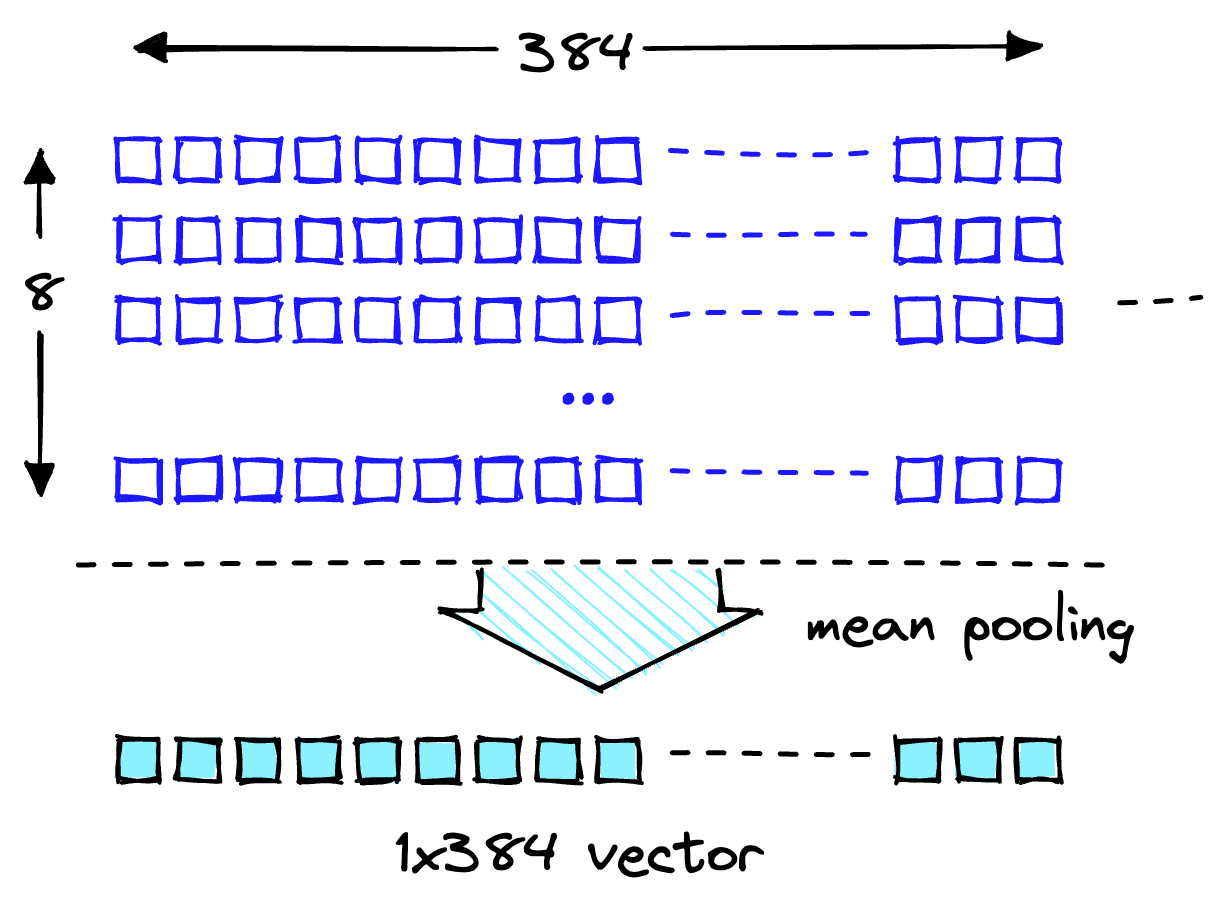

ابعاد تعبیه شده در مدل MiniLM است 384 به این معنی که هر برداری که خروجی های MiniLM را تعبیه می کند باید ابعادی برابر با 384. با این حال، با نگاهی به طول تعبیههای ما، موارد زیر را مشاهده خواهید کرد:

len(out[0]), len(out[1])

(8, 8)

دو لیست هر کدام شامل هشت مورد است. MiniLM ابتدا متن را در مرحله توکن سازی پردازش می کند. این توکنسازی متن ساده قابل خواندن توسط انسان را به لیستی از شناسههای توکن قابل خواندن توسط مدل تبدیل میکند. در ویژگی های خروجی مدل، می توانید تعبیه های سطح نشانه را مشاهده کنید. یکی از این تعبیهها ابعاد مورد انتظار را نشان میدهد 384 همانطور که نشان داده شده است:

len(out[0][0])

384

همانطور که در تصویر زیر نشان داده شده است، این جاسازیهای سطح نشانه را با استفاده از مقادیر میانگین در هر بعد برداری، به جاسازیهای سطح سند تبدیل کنید.

میانگین عملیات ادغام برای به دست آوردن یک بردار 384 بعدی.

با دو جاسازی برداری 384 بعدی، یکی برای هر متن ورودی. برای آسانتر کردن زندگیمان، فرآیند رمزگذاری را در یک عملکرد واحد بپیچید، همانطور که در تصویر زیر نشان داده شده است:

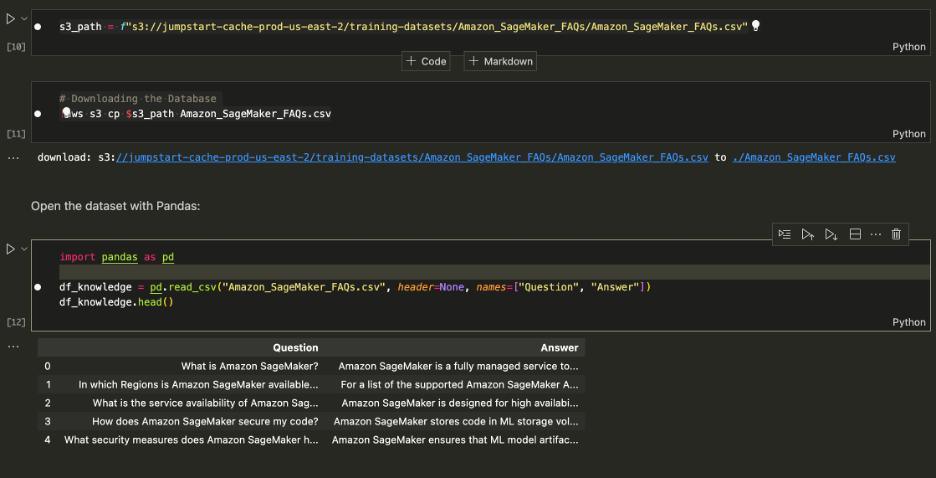

دانلود مجموعه داده

پرسشهای متداول Amazon SageMaker را بهعنوان پایگاه دانش برای دریافت دادههایی که شامل ستونهای پرسش و پاسخ است، دانلود کنید.

سوالات متداول Amazon SageMaker را دانلود کنید

هنگام انجام جستجو، فقط به دنبال پاسخ ها بگردید تا بتوانید ستون سؤال را رها کنید. برای جزئیات بیشتر به دفترچه یادداشت مراجعه کنید.

مجموعه داده ما و خط لوله جاسازی آماده است. اکنون تنها چیزی که ما نیاز داریم جایی برای ذخیره آن جاسازی ها است.

نمایه سازی

پایگاه داده برداری Pinecone جاسازی های برداری را ذخیره می کند و آنها را به طور موثر در مقیاس جستجو می کند. برای ایجاد یک پایگاه داده، به یک کلید API رایگان از Pinecone نیاز دارید.

پس از اتصال به پایگاه داده برداری Pinecone، یک نمایه برداری واحد ایجاد کنید (شبیه به جدول در DB های سنتی). شاخص را نام ببرید retrieval-augmentation-aws و شاخص را تراز کنید dimension و metric پارامترهایی با پارامترهای مورد نیاز مدل تعبیه شده (در این مورد MiniLM).

برای شروع درج داده ها، موارد زیر را اجرا کنید:

می توانید پرس و جوی فهرست را با سوالی که قبلا در این پست مطرح کرده بودید آغاز کنید.

خروجی بالا نشان میدهد که ما در حال بازگرداندن زمینههای مرتبط برای کمک به پاسخ به سؤال خود هستیم. از زمانی که ما top_k = 1, index.query نتیجه بالا را در کنار فراداده ای که خوانده می شود برگرداند Managed Spot Training can be used with all instances supported in Amazon.

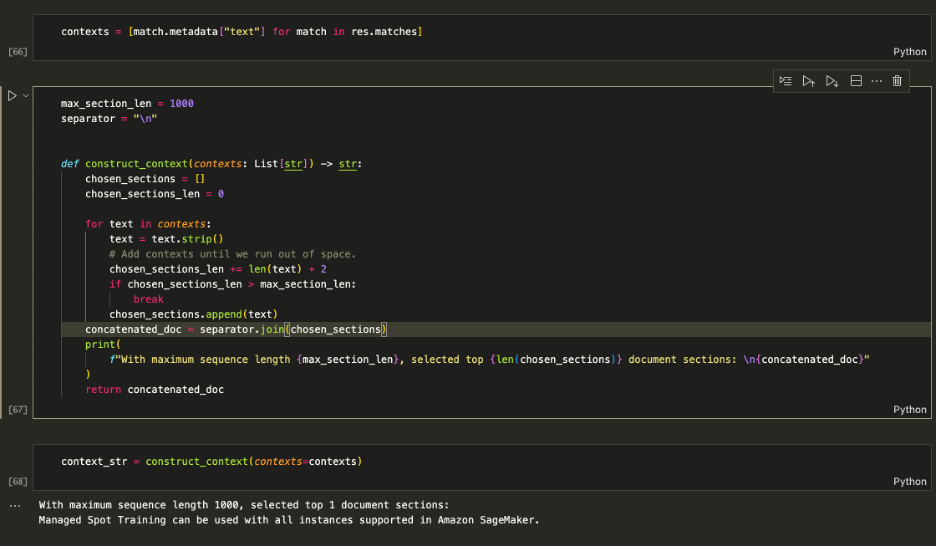

افزایش درخواست

از زمینه های بازیابی شده برای تقویت درخواست و تصمیم گیری در مورد حداکثر مقدار زمینه برای تغذیه به LLM استفاده کنید. استفاده کنید 1000 کاراکترها محدود به اضافه کردن مکرر هر زمینه بازگشتی به درخواست تا زمانی که از طول محتوا تجاوز کنید.

افزایش درخواست

تغذیه context_str همانطور که در تصویربرداری صفحه زیر نشان داده شده است، به اعلان LLM وارد شوید:

[ورودی]: کدام نمونه ها را می توانم با آموزش نقطه مدیریت شده در SageMaker استفاده کنم؟ [خروجی]: بر اساس زمینه ارائه شده، می توانید از آموزش نقطه مدیریت شده با همه نمونه های پشتیبانی شده در Amazon SageMaker استفاده کنید. بنابراین، پاسخ این است: همه نمونه ها در Amazon SageMaker پشتیبانی می شوند.

منطق کار می کند، بنابراین آن را در یک تابع واحد بپیچید تا همه چیز تمیز بماند.

اکنون می توانید سوالاتی مانند آنچه در زیر نشان داده شده است بپرسید:

پاک کردن

برای جلوگیری از تحمیل هزینههای ناخواسته، مدل و نقطه پایانی را حذف کنید.

نتیجه

در این پست شما را با RAG با LLM های دسترسی باز در SageMaker آشنا کردیم. همچنین نحوه استقرار مدلهای Amazon SageMaker Jumpstart با Llama 2، Hugging Face LLM با Flan T5 و جاسازی مدلها با MiniLM را نشان دادیم.

ما یک خط لوله RAG کامل از سرتاسر را با استفاده از مدلهای دسترسی باز و شاخص برداری Pinecone پیادهسازی کردیم. با استفاده از این، ما نشان دادیم که چگونه توهمات را به حداقل برسانیم، و دانش LLM را به روز نگه داریم، و در نهایت تجربه کاربر و اعتماد به سیستم هایمان را افزایش دهیم.

برای اجرای این مثال به تنهایی، این مخزن GitHub را شبیه سازی کنید و مراحل قبلی را با استفاده از نوت بوک پاسخگویی به سوالات در GitHub.

درباره نویسندگان

ودان جین یک متخصص AI/ML Sr. است که روی ابتکارات استراتژیک هوش مصنوعی مولد کار می کند. قبل از پیوستن به AWS، Vedant سمتهای تخصصی ML/Data Science را در شرکتهای مختلفی مانند Databricks، Hortonworks (اکنون Cloudera) و JP Morgan Chase داشته است. خارج از کارش، ودانت علاقه زیادی به ساخت موسیقی، صخره نوردی، استفاده از علم برای داشتن زندگی معنادار و کاوش در غذاهای سراسر جهان دارد.

ودان جین یک متخصص AI/ML Sr. است که روی ابتکارات استراتژیک هوش مصنوعی مولد کار می کند. قبل از پیوستن به AWS، Vedant سمتهای تخصصی ML/Data Science را در شرکتهای مختلفی مانند Databricks، Hortonworks (اکنون Cloudera) و JP Morgan Chase داشته است. خارج از کارش، ودانت علاقه زیادی به ساخت موسیقی، صخره نوردی، استفاده از علم برای داشتن زندگی معنادار و کاوش در غذاهای سراسر جهان دارد.

جیمز بریگز یک مدافع توسعه دهنده کارکنان در Pinecone است که در جستجوی برداری و AI/ML تخصص دارد. او توسعه دهندگان و مشاغل را در توسعه راه حل های GenAI خود از طریق آموزش آنلاین راهنمایی می کند. قبل از Pinecone، جیمز روی هوش مصنوعی برای استارتآپهای کوچک فناوری برای شرکتهای مالی تأسیس شده کار میکرد. جیمز خارج از محل کار، علاقه زیادی به سفر و پذیرش ماجراجوییهای جدید دارد، از موجسواری و غواصی گرفته تا موی تای و بیجیجی.

جیمز بریگز یک مدافع توسعه دهنده کارکنان در Pinecone است که در جستجوی برداری و AI/ML تخصص دارد. او توسعه دهندگان و مشاغل را در توسعه راه حل های GenAI خود از طریق آموزش آنلاین راهنمایی می کند. قبل از Pinecone، جیمز روی هوش مصنوعی برای استارتآپهای کوچک فناوری برای شرکتهای مالی تأسیس شده کار میکرد. جیمز خارج از محل کار، علاقه زیادی به سفر و پذیرش ماجراجوییهای جدید دارد، از موجسواری و غواصی گرفته تا موی تای و بیجیجی.

شین هوانگ یک دانشمند کاربردی ارشد برای آمازون SageMaker JumpStart و آمازون SageMaker الگوریتم های داخلی است. او بر توسعه الگوریتمهای یادگیری ماشینی مقیاسپذیر تمرکز دارد. علایق تحقیقاتی او در زمینه پردازش زبان طبیعی، یادگیری عمیق قابل توضیح بر روی داده های جدولی، و تجزیه و تحلیل قوی خوشه بندی ناپارامتری فضا-زمان است. او مقالات زیادی را در کنفرانسهای ACL، ICDM، KDD، و انجمن آماری سلطنتی: سری A منتشر کرده است.

شین هوانگ یک دانشمند کاربردی ارشد برای آمازون SageMaker JumpStart و آمازون SageMaker الگوریتم های داخلی است. او بر توسعه الگوریتمهای یادگیری ماشینی مقیاسپذیر تمرکز دارد. علایق تحقیقاتی او در زمینه پردازش زبان طبیعی، یادگیری عمیق قابل توضیح بر روی داده های جدولی، و تجزیه و تحلیل قوی خوشه بندی ناپارامتری فضا-زمان است. او مقالات زیادی را در کنفرانسهای ACL، ICDM، KDD، و انجمن آماری سلطنتی: سری A منتشر کرده است.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- PlatoHealth. هوش بیوتکنولوژی و آزمایشات بالینی. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/mitigate-hallucinations-through-retrieval-augmented-generation-using-pinecone-vector-database-llama-2-from-amazon-sagemaker-jumpstart/

- : دارد

- :است

- :نه

- :جایی که

- $UP

- 1

- 10

- 100

- 11

- 12

- 14

- ٪۱۰۰

- 16

- 17

- 19

- 23

- 32

- 7

- 8

- 9

- a

- درباره ما

- بالاتر

- دسترسی

- مطابق

- حساب

- در میان

- اضافه کردن

- اضافی

- اطلاعات اضافی

- اتخاذ

- ماجراهای

- مدافع

- از نو

- AI

- موارد استفاده ai

- AI / ML

- الگوریتم

- تراز

- معرفی

- در امتداد

- قبلا

- همچنین

- آمازون

- آمازون SageMaker

- Amazon SageMaker JumpStart

- Amazon SageMaker Studio

- آمازون خدمات وب

- مقدار

- an

- تحلیل

- و

- پاسخ

- پاسخ

- هر

- API

- نرم افزار

- اعمال می شود

- روش

- رویکردها

- هستند

- محدوده

- دور و بر

- AS

- پرسیدن

- At

- تلاشها

- تقویت کردن

- افزوده شده

- خودکار

- بطور خودکار

- در دسترس

- AWS

- پایه

- مستقر

- BE

- زیرا

- قبل از

- شروع

- میان

- بلاگ

- شکوفه

- هر دو

- گسترده تر

- ساختن

- ساخته شده در

- کسب و کار

- اما

- by

- CAN

- گرفتن

- مورد

- موارد

- کاراکتر

- بار

- تعقیب

- تمیز

- به وضوح

- بالا رونده

- Cloudera

- خوشه بندی

- ستون

- ستون ها

- شرکت

- سازگار

- کامل

- جزء

- اجزاء

- همایش ها

- متصل

- کنسول

- شامل

- شامل

- محتوا

- زمینه

- زمینه ها

- محاورهای

- هوش مصنوعی محاوره ای

- تبدیل

- شرکت ها

- اصلاح

- به درستی

- ایجاد

- بحرانی

- در حال حاضر

- داده ها

- پایگاه داده

- تاریخ

- DBS

- تصمیم گیری

- عمیق

- یادگیری عمیق

- گسترش

- استقرار

- توسعه دهنده

- توسعه دهندگان

- در حال توسعه

- پروژه

- بعد

- مستقیما

- بحث و تبادل نظر

- do

- میکند

- ندارد

- نمی کند

- دامنه

- دان

- قطره

- در طی

- هر

- پیش از آن

- آسان تر

- اکوسیستم

- آموزش

- موثر

- موثر

- تعبیه کردن

- در آغوش گرفتن

- پشتیبانی می کند

- پایان

- پشت سر هم

- نقطه پایانی

- بالا بردن

- محیط

- تاسیس

- حتی

- مثال

- تجاوز

- اعدام

- انتظار می رود

- تجربه

- اکتشاف

- بررسی

- وسیع

- خارجی

- عصاره

- چهره

- سریعتر

- امکانات

- تغذیه

- کمی از

- سرمایه گذاری

- پیدا کردن

- پایان

- نام خانوادگی

- شناور

- تمرکز

- پیروی

- برای

- قالب

- پایه

- رایگان

- از جانب

- تابع

- عموما

- تولید

- مولد

- نسل

- مولد

- هوش مصنوعی مولد

- دریافت کنید

- GitHub

- دادن

- داده

- می دهد

- Go

- می رود

- GPU

- راهنما

- دسته

- اتفاق می افتد

- آیا

- he

- برگزار شد

- کمک

- اینجا کلیک نمایید

- خیلی

- خود را

- چگونه

- چگونه

- اما

- HTTPS

- huang

- قطب

- صورت در آغوش گرفته

- قابل خواندن انسان است

- i

- ID

- دلخواه

- شناسایی

- شناسه

- if

- تصویر

- اجرا

- واردات

- in

- شامل

- از جمله

- افزایش

- شاخص

- نمایه شده

- لوازم

- اطلاع دادن

- اطلاعات

- ابتکارات

- ورودی

- ورودی

- نصب

- نمونه

- یکپارچه

- منافع

- رابط

- داخلی

- به

- معرفی

- IT

- اقلام

- جیمز

- پیوستن

- jp

- جی پی مورگان

- جی پی مورگان چیس

- JPG

- نگاه داشتن

- کلید

- دانستن

- دانش

- زبان

- بزرگ

- بزرگتر

- راه اندازی

- رهبری

- یادگیری

- می آموزد

- طول

- کتابخانه ها

- زندگی

- پسندیدن

- محدود

- فهرست

- لیست

- زندگی

- پشم لاما

- LLM

- منطق

- نگاه کنيد

- به دنبال

- خیلی

- دستگاه

- فراگیری ماشین

- ساخت

- ساخت

- اداره می شود

- دستی

- بسیاری

- مسابقه

- کبریت

- بیشترین

- بیشترین مقدار

- ممکن است..

- متوسط

- معنی دار

- به معنی

- حافظه

- متاداده

- روش

- کاهش

- ML

- مدل

- مدل

- پول

- بیش

- مورگان

- اکثر

- بسیار

- چندگانه

- موسیقی

- باید

- نام

- طبیعی

- پردازش زبان طبیعی

- نیاز

- نیازهای

- جدید

- بعد

- nlp

- دفتر یادداشت

- اکنون

- بی حس

- هدف

- of

- on

- ONE

- آنلاین

- فقط

- باز کن

- عمل

- or

- سفارش

- OS

- در غیر این صورت

- ما

- خارج

- تولید

- خروجی

- خارج از

- خود

- اوراق

- پارامترهای

- ویژه

- ویژه

- عبور

- گذشت

- شور

- احساساتی

- انجام

- انجام

- مجوز

- تصویر

- خط لوله

- ساده

- افلاطون

- هوش داده افلاطون

- PlatoData

- محبوب

- موقعیت

- پست

- برق

- پیش گویی

- پیش بینی

- پیشگو

- مرجح

- جلوگیری از

- پیش نمایش

- قبلی

- قبلا

- قبلا

- مشکل

- روند

- فرآیندهای

- در حال پردازش

- مشخصات

- پرسیدن

- اختصاصی

- ارائه

- فراهم می کند

- ارائه

- عمومی

- منتشر شده

- پــایتــون

- مارماهی

- نمایش ها

- سوال

- سوالات

- به سرعت

- محدوده

- اعم

- اماده

- دریافت

- سوابق

- مناطق

- مربوط

- تکیه

- مخزن

- نشان دهنده

- نیاز

- ضروری

- تحقیق

- پاسخ

- نتیجه

- نتایج

- برگشت

- عودت

- تنومند

- سنگ

- نقش

- سلطنتی

- دویدن

- اجرا می شود

- حکیم ساز

- همان

- گفتن

- مقیاس پذیر

- مقیاس

- علم

- دانشمند

- نمره

- پرده

- sdk

- جستجو

- جستجو

- دیدن

- ظاهرا

- را انتخاب کنید

- ارشد

- حس

- جمله

- سلسله

- سری A

- خدمات

- تنظیم

- باید

- نشان

- نشان داد

- نشان داده شده

- نشان می دهد

- طرف

- مشابه

- ساده تر

- پس از

- تنها

- اندازه

- کوچک

- کوچکتر

- So

- جامعه

- فقط

- راه حل

- مزایا

- برخی از

- یک جایی

- منبع

- فضا

- متخصص

- متخصص

- تخصص

- به طور خاص

- Spot

- کارکنان

- نوپا

- آماری

- گام

- مراحل

- توقف

- opbevare

- پرده

- استراتژیک

- رشته

- استودیو

- چنین

- پشتیبانی

- پشتیبانی

- پشتیبانی از

- سیستم

- سیستم های

- جدول

- طول می کشد

- کار

- فن آوری

- راه اندازی فن آوری

- پیشرفته

- می گوید

- متن

- تایلندی

- نسبت به

- که

- La

- محوطه

- جهان

- شان

- آنها

- از این رو

- اینها

- آنها

- اشیاء

- این

- کسانی که

- از طریق

- زمان

- به

- رمز

- از Tokenization

- هم

- ابزار

- بالا

- سنتی

- آموزش

- ترانسفورماتور

- ترانسفورماتور

- تبدیل می شود

- ترجمه کردن

- سفر

- اعتماد

- دو

- انواع

- در نهایت

- بعید

- بي وقفه.

- تا

- ناخواسته

- بروزرسانی

- us

- استفاده کنید

- استفاده

- کاربر

- سابقه کاربر

- کاربران

- با استفاده از

- ارزشها

- مختلف

- نسخه

- نسخه

- از طريق

- بصری

- صبر کنيد

- خرید

- می خواهم

- بود

- موج

- مسیر..

- we

- وب

- خدمات وب

- مبتنی بر وب

- چی

- چه زمانی

- که

- در حین

- وسیع

- دامنه گسترده

- اراده

- با

- بدون

- مهاجرت کاری

- مشغول به کار

- کارگر

- با این نسخهها کار

- جهان

- خواهد بود

- بسته بندی کردن

- X

- بله

- شما

- شما

- زفیرنت