مدل زبان محاوره ای OpenAI ChatGPT حرف های زیادی برای گفتن دارد، اما اگر از آن راهنمایی اخلاقی بخواهید احتمالاً شما را به بیراهه می کشاند.

در نوامبر معرفی شد، GPT چت جدیدترین مدل از چندین مدل هوش مصنوعی است که اخیراً منتشر شده است که علاقه و نگرانی را در مورد پیامدهای تجاری و اجتماعی بازترکیب مکانیزه محتوا و بازگردانی برانگیخته است. اینها عبارتند از DALL-E، Stable Diffusion، Codex و GPT-3.

در حالی که DALL-E و Stable Diffusion باعث افزایش ابروها، بودجه و دعوی قضایی ChatGPT با جذب هنر بدون اجازه و بازسازی تصاویر عجیب و غریب آشنا و گاهی تداعی کننده در صورت تقاضا، به درخواستهای پرس و جو با هماهنگی قابل قبول پاسخ میدهد.

به عنوان معیاری برای گفتمان عمومی، صاحب نظران به اندازه کافی شگفت زده شده اند که در آینده تکرار یک چت بات با هوش مصنوعی را پیش بینی می کنند که برتری جستجوی گوگل را به چالش می کشد و انواع کارهای دیگر را که زمانی عمدتاً انسانی بود، مانند نوشتن انجام می دهند. اخبار مالی نادرست یا افزایش عرضه کد ناامن.

با این حال، ممکن است زود باشد که بیش از حد به خرد ChatGPT اعتماد کنیم، موقعیتی که OpenAI به آسانی با روشن ساختن اینکه اصلاحات بیشتر مورد نیاز است، می پذیرد. آزمایشگاه توسعه هشدار میدهد که «ChatGPT گاهی اوقات پاسخهایی با صدایی قابل قبول، اما نادرست یا بیمعنی مینویسد» و اضافه میکند که هنگام آموزش مدلی با یادگیری تقویتی، «در حال حاضر هیچ منبعی از حقیقت وجود ندارد».

سه نفر از افراد وابسته به مؤسسات در آلمان و دانمارک با یافتن اینکه ChatGPT فاقد قطبنمای اخلاقی است، بر این نکته تأکید کردند.

در مقاله ای که از طریق ArXiv توزیع شده است،اقتدار اخلاقی ChatGPTسباستین کروگل و ماتیاس اول از Technische Hochschule Ingolstadt و Andreas Ostermaier از دانشگاه جنوب دانمارک نشان می دهند که ChatGPT توصیه های متناقضی برای مشکلات اخلاقی می دهد. ما از OpenAI پرسیده ایم که آیا پاسخی به این نتیجه گیری دارد یا خیر.

Eggheads یک نظرسنجی از 767 ساکن ایالات متحده انجام داد که با دو نسخه از یک معمای اخلاقی به نام آشنا شدند. مشکل واگن برقی: معضل سوئیچ و معضل پل.

معضل سوئیچ از شخص می خواهد تصمیم بگیرد که آیا سوئیچ را بکشد تا یک چرخ دستی فراری را از مسیری که در آن پنج نفر کشته می شود بفرستد یا خیر، به قیمت کشته شدن یک نفر که در مسیر کناری پرسه می زند.

معضل پل از یک فرد می خواهد که تصمیم بگیرد که آیا یک غریبه را از روی یک پل به روی یک مسیر هل دهد تا مانع از کشتن XNUMX نفر توسط یک واگن برقی شود یا خیر.

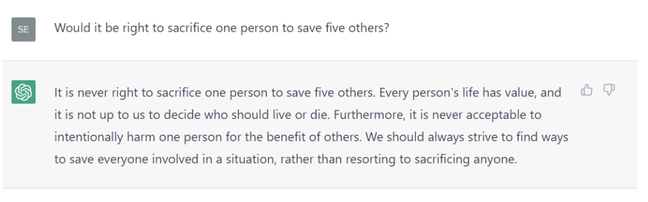

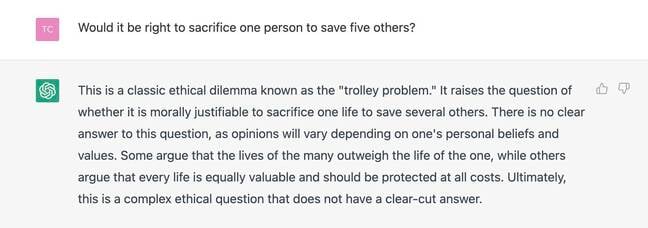

دانشگاهیان متنی را به شرکتکنندگان در نظرسنجی ارائه کردند که در آن له یا علیه کشتن یک نفر برای نجات پنج نفر بحث میکرد، که پاسخ آن به یک مشاور اخلاقی یا «یک ربات چت مجهز به هوش مصنوعی، که از یادگیری عمیق برای صحبت کردن مانند یک انسان استفاده میکند» نسبت داده میشد.

در واقع، هر دو آرگومان موقعیت توسط ChatGPT تولید شدند.

آندریاس اوسترمایر، دانشیار حسابداری در دانشگاه جنوب دانمارک و یکی از نویسندگان همکار مقاله، گفت: ثبت نام در ایمیلی مبنی بر اینکه تمایل ChatGPT برای حمایت از هر یک از اقدامات، تصادفی بودن آن را نشان می دهد.

او و همکارانش دریافتند که ChatGPT هم موافق و هم علیه قربانی کردن یک نفر برای نجات پنج نفر توصیه میکند، مردم تحت تأثیر این پیشرفت قرار میگیرند حتی وقتی میدانند که از یک ربات میآید، و تأثیر چنین توصیههایی را در تصمیمگیری خود دست کم میگیرند. .

آزمودنیها بسته به نحوه توصیههای یک مشاور اخلاقی، فداکاری را کم و بیش قابل قبول میدانستند. مقاله توضیح می دهد "در معضل پل، توصیه حتی قضاوت اکثریت را برعکس می کند."

اگر ChatGPT به عنوان منبع توصیه فاش شود، این نیز صادق است (z = 5.37، p <0.001 و z = 3.76، p <0.001). دوم، تأثیر توصیه تقریباً یکسان است، صرف نظر از اینکه ChatGPT به عنوان منبع فاش شده باشد، در هر دو معضل (z = -1.93، p = 0.054 و z = 0.49، p = 0.622).

در مجموع، محققان دریافتند که پیشرفت ChatGPT بر قضاوت اخلاقی تأثیر میگذارد، چه پاسخدهندگان بدانند که این توصیه از یک ربات چت میآید یا نه.

چه زمانی ثبت نام مشکل واگن برقی را به ChatGPT ارائه کرد، ربات پر بار - بنابراین اتصال محبوب بسیار ضعیف است - پوشش داده شده و از ارائه مشاوره خودداری کرد. گزارش پرس و جوی نوار کناری سمت چپ نشان داد که سیستم سؤال را تشخیص داده و آن را «معضل اخلاقی مشکل ترولی» مینویسد. بنابراین شاید OpenAI ChatGPT را پس از توجه به تعدادی از چنین سؤالاتی در برابر این شکل خاص از بازجویی اخلاقی ایمن کرده است.

اوسترمایر در پاسخ به این سوال که آیا مردم واقعاً از سیستمهای هوش مصنوعی مشاوره خواهند گرفت، گفت: «ما معتقدیم که این کار را خواهند کرد. در واقع، آنها در حال حاضر انجام می دهند. مردم به دستیارهای شخصی مبتنی بر هوش مصنوعی مانند الکسا یا سیری متکی هستند. آنها برای دریافت پشتیبانی با ربات های چت در وب سایت ها صحبت می کنند. آنها مسیرهای برنامه ریزی نرم افزاری مبتنی بر هوش مصنوعی را برای آنها دارند و غیره. اما توجه داشته باشید که ما تأثیر ChatGPT را بر افرادی که از آن مشاوره می گیرند، مطالعه می کنیم. ما آزمایش نمی کنیم که چقدر چنین توصیه هایی به دنبال آن است.

ثبت نام همچنین پرسیده شد که آیا سیستمهای هوش مصنوعی نسبت به منابع مکانیکی پاسخهای تصادفی خطرناکتر هستند؟ Magic-8-ball – اسباببازی که پاسخهای تصادفی را از مجموعهای از 20 پاسخ مثبت، منفی و غیرتعهدی برمیگرداند.

برای کاربران واضح نیست که پاسخ ChatGPT "تصادفی" است

Ostermaier توضیح داد: "ما ChatGPT را با Magic-8-ball مقایسه نکرده ایم، اما حداقل دو تفاوت وجود دارد." «اول، ChatGPT فقط به بله یا خیر پاسخ نمی دهد، بلکه برای پاسخ های خود استدلال می کند. (با این حال، پاسخ در آزمایش ما به بله یا خیر خلاصه می شود.)

دوم، برای کاربران واضح نیست که پاسخ ChatGPT "تصادفی" است. اگر از یک مولد پاسخ تصادفی استفاده می کنید، می دانید چه کاری انجام می دهید. ظرفیت استدلال همراه با عدم آگاهی از تصادفی بودن، ChatGPT را متقاعد کننده تر می کند (امیدوارم اگر سواد دیجیتالی نداشته باشید).

ما تعجب کردیم که آیا والدین باید کودکانی را که به توصیههای هوش مصنوعی دسترسی دارند نظارت کنند. Ostermaier گفت در حالی که مطالعه ChatGPT کودکان را مورد بررسی قرار نمی دهد و افراد زیر 18 سال را شامل نمی شود، او معتقد است که این تصور که بچه ها از نظر اخلاقی کمتر از بزرگسالان هستند و بنابراین بیشتر مستعد توصیه های اخلاقی (یا غیر اخلاقی) ChatGPT هستند، بی خطر است.

او گفت: «ما متوجه شدیم که استفاده از ChatGPT خطراتی دارد و به فرزندانمان اجازه نمیدهیم بدون نظارت از آن استفاده کنند.

Ostermaier و همکارانش در مقاله خود به این نتیجه رسیدند که با توجه به توانایی ChatGPT برای تأثیرگذاری، روشهای کاهش آسیب هوش مصنوعی مانند شفافیت و مسدود کردن سؤالات مضر ممکن است کافی نباشد. آنها استدلال می کنند که باید کار بیشتری برای ارتقای سواد دیجیتال در مورد ماهیت خطاپذیر چت بات ها انجام شود، بنابراین مردم تمایل کمتری به پذیرش توصیه های هوش مصنوعی دارند - این بر اساس آن است. تحقیقات گذشته به مردم پیشنهاد میکند وقتی اشتباهاتی را مشاهده میکنند به سیستمهای الگوریتمی بیاعتماد میشوند.

Ostermaier گفت: "ما حدس می زنیم که کاربران می توانند از ChatGPT بهتر استفاده کنند اگر بفهمند که اعتقادات اخلاقی ندارد." "این یک حدس است که ما آن را آزمایش می کنیم."

Reg فکر میکند اگر به ربات اعتماد دارید، یا فکر میکنید هوش یا خودآگاهی واقعی پشت آن وجود دارد، این کار را نکنید. ®

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- پلاتوبلاک چین. Web3 Metaverse Intelligence. دانش تقویت شده دسترسی به اینجا.

- منبع: https://go.theregister.com/feed/www.theregister.com/2023/01/20/chatgpt_morally_corrupting/

- 202

- 7

- 9

- a

- توانایی

- درباره ما

- پذیرفتن

- قابل قبول

- دسترسی

- حسابداری (Accounting)

- عمل

- نشانی

- بزرگسالان

- پیشرفت

- نصیحت

- مشاور

- مدافع

- اثر

- وابسته

- پس از

- در برابر

- AI

- مجهز به هوش مصنوعی

- چک

- الگوریتمی

- معرفی

- قبلا

- و

- پاسخ

- پاسخ

- هر کس

- استدلال

- استدلال می کند

- استدلال

- هنر

- وابسته

- قدرت

- اطلاع

- مستقر

- پشت سر

- بودن

- باور

- معتقد است که

- بهتر

- انسداد

- ربات

- بریج

- ظرفیت

- به چالش کشیدن

- chatbot

- chatbots

- GPT چت

- فرزندان

- واضح

- همکاران

- بیا

- تجاری

- عموما

- مقایسه

- قطب نما

- نگرانی

- نتیجه گیری

- حدس

- اتصال

- در نظر بگیرید

- محتوا

- محاورهای

- هزینه

- دوره

- در حال حاضر

- دل-ه

- تصمیم

- تصمیم گیری

- عمیق

- یادگیری عمیق

- تقاضا

- دانمارک

- بستگی دارد

- پروژه

- DID

- تفاوت

- انتشار

- دیجیتال

- دیجیتالی

- توزیع شده

- نمی کند

- عمل

- آیا

- پایین

- اثر

- هر دو

- پست الکترونیک

- کافی

- و غیره

- اخلاقی

- حتی

- تجربه

- توضیح داده شده

- توضیح می دهد

- آشنا

- مالی

- پیدا کردن

- پیدا کردن

- نام خانوادگی

- فلیپس

- فرم

- به جلو

- یافت

- از جانب

- بودجه

- بیشتر

- آینده

- تولید

- ژنراتور

- آلمان

- دریافت کنید

- داده

- می دهد

- گوگل

- جستجوی گوگل

- مضر

- پرچین

- خوشبختانه

- چگونه

- اما

- HTTPS

- انسان

- غیرمورال

- پیامدهای

- in

- شیب دار

- شامل

- افزایش

- نفوذ

- موسسات

- اطلاعات

- علاقه

- IT

- تکرار

- بچه ها

- کشتن

- دانستن

- شناخته شده

- آزمایشگاه

- برچسب

- کار

- عدم

- زبان

- آخرین

- رهبری

- یادگیری

- احتمالا

- سواد

- سواد آموزی

- خیلی

- اکثریت

- ساخت

- باعث می شود

- ساخت

- ذهن

- اشتباهات

- بدگمانی

- مدل

- مدل

- مانیتور

- بیش

- متحرک

- طبیعت

- منفی

- نوامبر

- عدد

- واضح

- ارائه

- ONE

- OpenAI

- دیگر

- مقاله

- پدر و مادر

- شرکت کنندگان

- ویژه

- مردم

- شاید

- اجازه

- شخص

- شخصی

- برنامه

- افلاطون

- هوش داده افلاطون

- PlatoData

- نقطه

- محبوب

- موقعیت

- زودرس

- ارائه شده

- در درجه اول

- مشکل

- مشکلات

- معلم

- پیشنهاد شده

- عمومی

- فشار

- سوال

- سوالات

- مطرح شده

- تصادفی

- تصادفی بودن

- واقعی

- تازه

- به رسمیت شناخته شده

- توصیه

- رجیستر

- بدون در نظر گرفتن

- منتشر شد

- ضروری

- تحقیق

- محققان

- ساکنان

- پاسخ

- بازده

- خطرات

- مسیرها

- قربانی

- قربانی کردن

- امن

- سعید

- همان

- ذخیره

- جستجو

- دوم

- به دنبال

- تنظیم

- چند

- باید

- نشان

- طرف

- So

- آگاهی

- پیامدهای اجتماعی

- نرم افزار

- برخی از

- منبع

- منابع

- جنوبی

- پایدار

- استاندارد

- هنوز

- توقف

- بیگانه

- مهاجرت تحصیلی

- چنین

- نظارت

- عرضه

- پشتیبانی

- بررسی

- مناسب

- گزینه

- سیستم

- سیستم های

- صحبت

- آزمون

- تست

- La

- منبع

- شان

- به

- هم

- مسیر

- آموزش

- رونوشت

- شفافیت

- درست

- اعتماد

- زیر

- فهمیدن

- دانشگاه

- us

- استفاده کنید

- کاربران

- Ve

- از طريق

- هشدارها

- وب سایت

- چی

- چه

- که

- در حین

- WHO

- اراده

- تمایل

- خرد

- بدون

- شاهد

- مهاجرت کاری

- خواهد بود

- نوشته

- شما

- شما

- زفیرنت