موفقیت برنامههای هوش مصنوعی مولد در طیف گستردهای از صنایع، توجه و علاقه شرکتهایی را در سراسر جهان به خود جلب کرده است که به دنبال بازتولید و پیشی گرفتن از دستاوردهای رقبا یا حل موارد استفاده جدید و هیجانانگیز هستند. این مشتریان به دنبال مدل های پایه مانند TII Falcon، Stable Diffusion XL یا GPT-3.5 OpenAI هستند، به عنوان موتورهایی که نوآوری مولد هوش مصنوعی را تامین می کنند.

مدلهای بنیادی، دستهای از مدلهای هوش مصنوعی مولد هستند که به لطف حجم وسیعی از دادههای بدون ساختار که روی آنها آموزش دیدهاند، قادر به درک و تولید محتوای مشابه انسان هستند. این مدلها انقلابی در وظایف مختلف بینایی کامپیوتر (CV) و پردازش زبان طبیعی (NLP) از جمله تولید تصویر، ترجمه و پاسخگویی به سؤالات ایجاد کردهاند. آنها به عنوان بلوک های ساختمانی برای بسیاری از برنامه های کاربردی هوش مصنوعی عمل می کنند و به یک جزء حیاتی در توسعه سیستم های هوشمند پیشرفته تبدیل شده اند.

با این حال، استقرار مدلهای پایه میتواند با چالشهای مهمی همراه باشد، بهویژه از نظر هزینه و نیاز به منابع. این مدلها به دلیل اندازهشان شناخته میشوند که اغلب از صدها میلیون تا میلیاردها پارامتر متغیر است. اندازه بزرگ آنها به منابع محاسباتی گسترده ای از جمله سخت افزار قدرتمند و ظرفیت حافظه قابل توجه نیاز دارد. در واقع، استقرار مدلهای پایه معمولاً به حداقل یک (اغلب بیشتر) GPU نیاز دارد تا بار محاسباتی را به طور مؤثر مدیریت کند. به عنوان مثال، مدل TII Falcon-40B Instruct به حداقل یک نمونه ml.g5.12xlarge نیاز دارد تا با موفقیت در حافظه بارگذاری شود، اما بهترین عملکرد را با نمونه های بزرگتر دارد. در نتیجه، بازگشت سرمایه (ROI) از استقرار و نگهداری این مدلها میتواند برای اثبات ارزش کسبوکار بسیار کم باشد، بهویژه در طول چرخههای توسعه یا برای بارهای کاری شدید. این به دلیل هزینههای جاری داشتن نمونههای مجهز به GPU برای جلسات طولانی، احتمالاً 24/7 است.

اوایل سال جاری اعلام کردیم بستر آمازون، یک API بدون سرور برای دسترسی به مدل های پایه آمازون و شرکای هوش مصنوعی ما. اگرچه در حال حاضر در پیشنمایش خصوصی است، API بدون سرور آن به شما امکان میدهد از مدلهای پایه آمازون، Anthropic، Stability AI و AI21 استفاده کنید، بدون اینکه نیازی به استقرار هیچ نقطه پایانی داشته باشید. با این حال، مدلهای منبع باز از جوامعی مانند Hugging Face بسیار رشد کردهاند و هر یک از آنها از طریق Amazon Bedrock در دسترس قرار نگرفتهاند.

در این پست، ما این موقعیت ها را هدف قرار می دهیم و با استقرار مدل های فونداسیون بزرگ، مشکل ریسک هزینه های بالا را حل می کنیم. آمازون SageMaker نقاط انتهایی ناهمزمان از جانب Amazon SageMaker JumpStart. این میتواند به کاهش هزینههای معماری کمک کند، و به نقطه پایانی اجازه میدهد فقط زمانی که درخواستها در صف هستند و برای مدت کوتاهی اجرا میشوند، در حالی که وقتی هیچ درخواستی منتظر سرویس نیست، به صفر میرسد. این برای بسیاری از موارد استفاده عالی به نظر می رسد. با این حال، نقطه پایانی که به صفر کاهش یافته است، قبل از ارائه استنتاج، زمان شروع سرد را معرفی می کند.

بررسی اجمالی راه حل

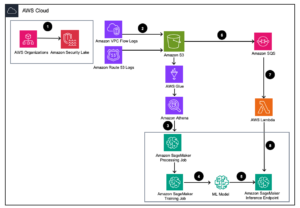

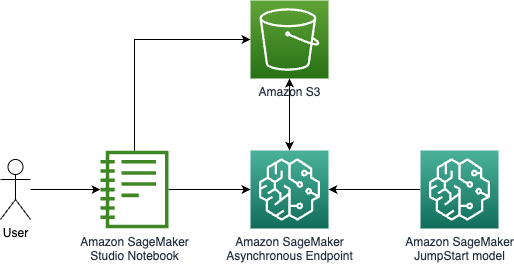

نمودار زیر معماری راه حل ما را نشان می دهد.

معماری ما بسیار ساده است:

- رابط کاربری یک نوت بوک است که می تواند با یک رابط کاربری وب ساخته شده بر روی Streamlit یا فناوری مشابه جایگزین شود. در مورد ما، نوت بوک یک Amazon SageMaker Studio نوت بوک، که روی یک نمونه ml.m5.large با هسته CPU PyTorch 2.0 Python 3.10 اجرا می شود.

- این نوت بوک به سه طریق نقطه پایانی را جستجو می کند: SageMaker Python SDK، AWS SDK برای Python (Boto3) و LangChain.

- نقطه پایانی به صورت ناهمزمان در SageMaker اجرا می شود، و در نقطه پایانی، مدل Falcon-40B Instruct را مستقر می کنیم. این در حال حاضر از نظر مدلهای آموزشی پیشرفته است و در SageMaker JumpStart موجود است. یک فراخوانی API به ما امکان می دهد مدل را در نقطه پایانی مستقر کنیم.

استنتاج ناهمزمان SageMaker چیست

استنتاج ناهمزمان SageMaker یکی از چهار گزینه استقرار در SageMaker به همراه نقاط پایانی بلادرنگ، استنتاج دسته ای و استنتاج بدون سرور است. برای کسب اطلاعات بیشتر در مورد گزینه های مختلف استقرار، مراجعه کنید استقرار مدل ها برای استنتاج.

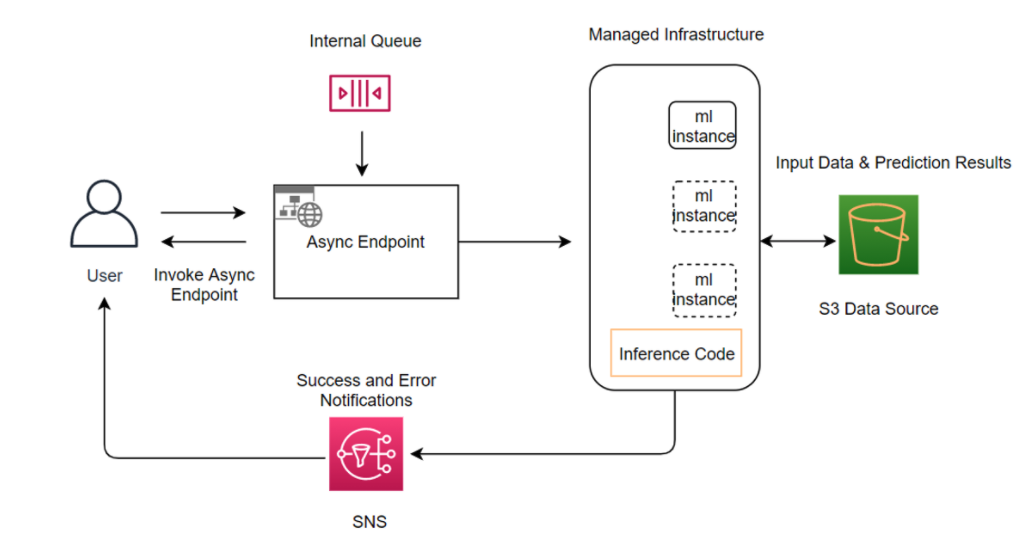

استنتاج ناهمزمان SageMaker درخواستهای دریافتی را صف میکشد و آنها را بهصورت ناهمزمان پردازش میکند، که این گزینه را برای درخواستهایی با حجم بار بزرگ تا 1 گیگابایت، زمانهای پردازش طولانی و الزامات تأخیر در زمان واقعی ایدهآل میکند. با این حال، مزیت اصلی که هنگام برخورد با مدلهای فونداسیون بزرگ، بهویژه در حین اثبات مفهوم (POC) یا در حین توسعه، ارائه میکند، قابلیت پیکربندی استنتاج ناهمزمان برای مقیاسپذیری تا تعداد نمونههای صفر در زمانی است که هیچ درخواستی وجود ندارد. فرآیند، در نتیجه صرفه جویی در هزینه ها. برای اطلاعات بیشتر در مورد استنتاج ناهمزمان SageMaker، به استنتاج ناهمزمان. نمودار زیر این معماری را نشان می دهد.

برای استقرار یک نقطه پایانی استنتاج ناهمزمان، باید یک یک ایجاد کنید AsyncInferenceConfig هدف - شی. اگر ایجاد کنید AsyncInferenceConfig بدون مشخص کردن آرگومان های آن، پیش فرض است S3OutputPath خواهد بود s3://sagemaker-{REGION}-{ACCOUNTID}/async-endpoint-outputs/{UNIQUE-JOB-NAME} و S3FailurePath خواهد بود s3://sagemaker-{REGION}-{ACCOUNTID}/async-endpoint-failures/{UNIQUE-JOB-NAME}.

SageMaker JumpStart چیست؟

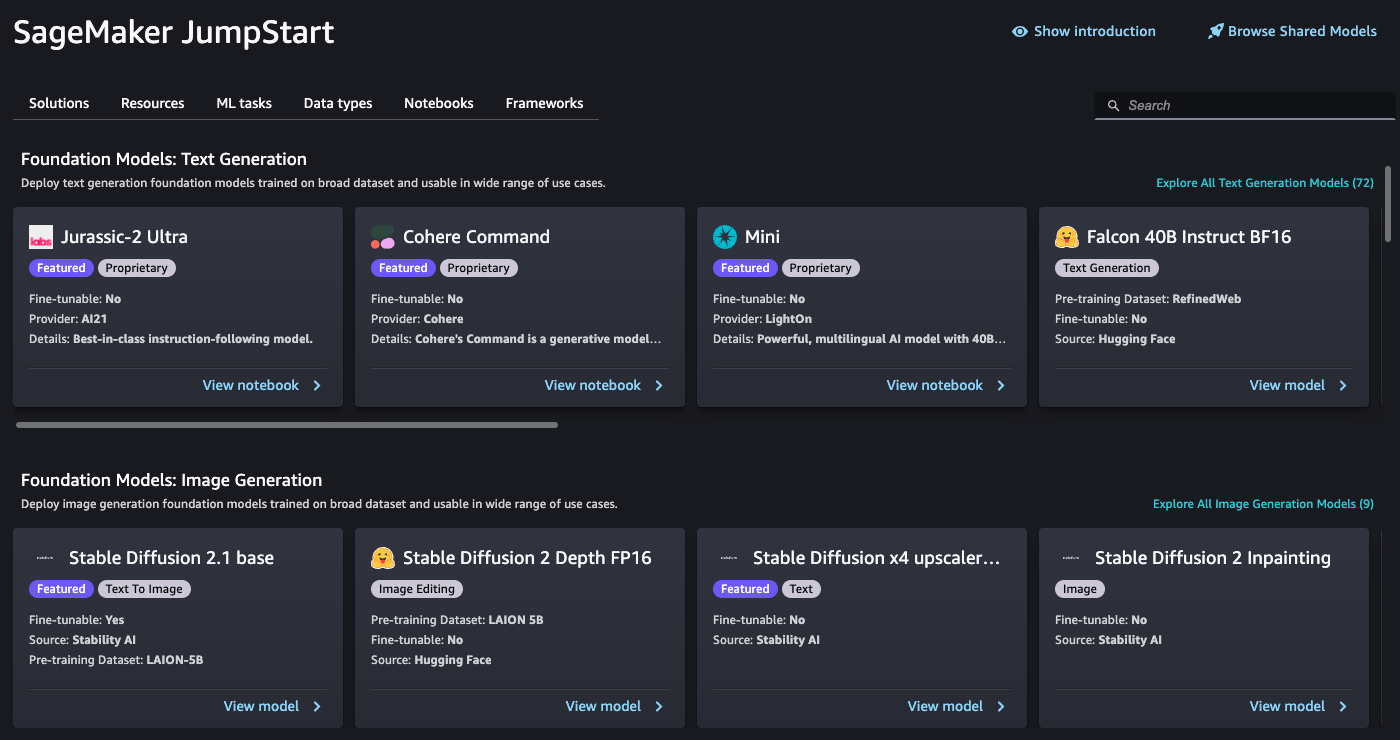

مدل ما از SageMaker JumpStart، یکی از ویژگی های SageMaker که با ارائه مدل های از پیش آموزش دیده، الگوهای راه حل، و نمونه نوت بوک ها، سفر یادگیری ماشین (ML) را تسریع می بخشد. این امکان دسترسی به طیف گسترده ای از مدل های از پیش آموزش دیده را برای انواع مختلف مشکلات فراهم می کند و به شما این امکان را می دهد تا وظایف ML خود را با یک پایه محکم شروع کنید. SageMaker JumpStart همچنین الگوهای راه حلی را برای موارد استفاده رایج و نوت بوک های نمونه برای یادگیری ارائه می دهد. با SageMaker JumpStart، می توانید زمان و تلاش لازم برای شروع پروژه های ML خود را با راه اندازی راه حل های یک کلیک و منابع جامع برای تجربه عملی ML کاهش دهید.

تصویر زیر نمونه ای از برخی از مدل های موجود در SageMaker JumpStart UI را نشان می دهد.

مدل را مستقر کنید

اولین قدم ما این است که مدل را در SageMaker مستقر کنیم. برای انجام این کار، میتوانیم از رابط کاربری SageMaker JumpStart یا SageMaker Python SDK استفاده کنیم که یک API ارائه میکند که میتوانیم از آن برای استقرار مدل در نقطه پایانی ناهمزمان استفاده کنیم:

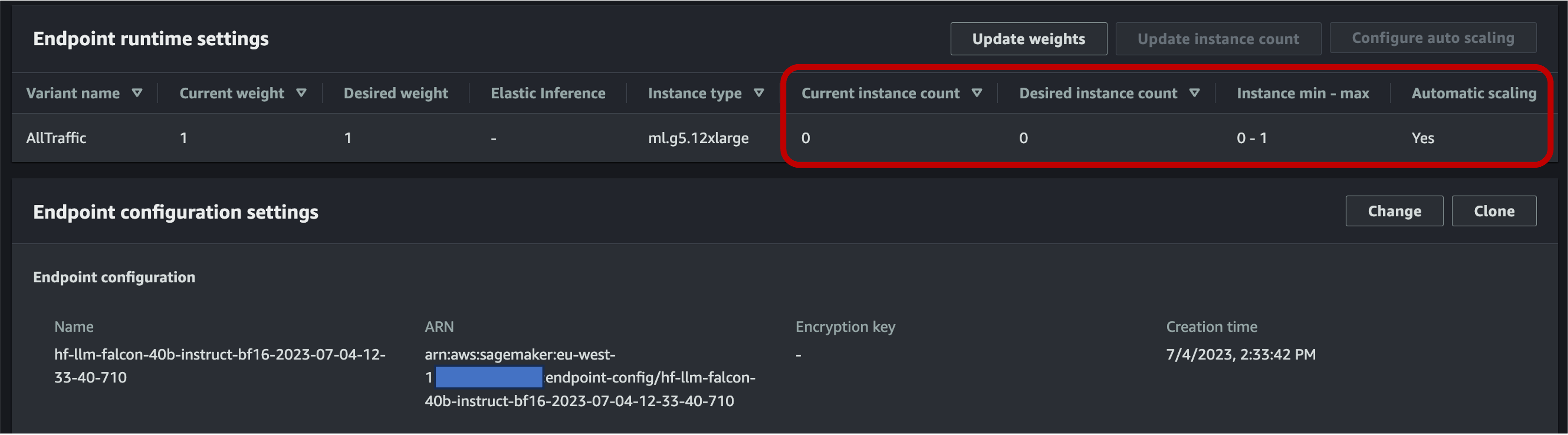

تکمیل این تماس تقریباً 10 دقیقه طول می کشد. در طول این مدت، نقطه پایانی چرخش میشود، ظرف به همراه آرتیفکتهای مدل به نقطه پایانی دانلود میشوند، پیکربندی مدل از SageMaker JumpStart بارگیری میشود، سپس نقطه پایانی ناهمزمان از طریق یک نقطه پایانی DNS در معرض دید قرار میگیرد. برای اطمینان از اینکه نقطه پایانی ما می تواند به صفر برسد، باید مقیاس خودکار را در نقطه پایانی ناهمزمان با استفاده از مقیاس خودکار برنامه پیکربندی کنیم. ابتدا باید نوع نقطه پایانی خود را با Application Auto Scaling ثبت کنید، یک خط مشی مقیاس بندی تعریف کنید و سپس خط مشی مقیاس بندی را اعمال کنید. در این پیکربندی، ما از یک متریک سفارشی استفاده می کنیم CustomizedMetricSpecification، به نام ApproximateBacklogSizePerInstance، همانطور که در کد زیر نشان داده شده است. برای یک لیست دقیق از CloudWatch آمازون معیارهای موجود با نقطه پایان استنتاج ناهمزمان شما، مراجعه کنید نظارت با CloudWatch.

میتوانید با رفتن به کنسول SageMaker، تأیید کنید که این خطمشی با موفقیت تنظیم شده است نقاط پایان زیر استنباط در صفحه ناوبری، و به دنبال نقطه پایانی که به تازگی مستقر کرده ایم می گردیم.

نقطه پایانی ناهمزمان را فراخوانی کنید

برای فراخوانی نقطه پایانی، باید بار درخواست را در آن قرار دهید سرویس ذخیره سازی ساده آمازون (Amazon S3) و یک اشاره گر به این محموله به عنوان بخشی از InvokeEndpointAsync درخواست. پس از فراخوانی، SageMaker درخواست را برای پردازش در صف قرار می دهد و یک شناسه و مکان خروجی را به عنوان پاسخ برمی گرداند. پس از پردازش، SageMaker نتیجه را در محل آمازون S3 قرار می دهد. شما می توانید به صورت اختیاری انتخاب کنید که اعلان های موفقیت یا خطا را دریافت کنید سرویس اطلاع رسانی ساده آمازون (Amazon SNS).

SageMaker Python SDK

پس از تکمیل استقرار، آن را برمی گرداند AsyncPredictor هدف - شی. برای انجام استنتاج ناهمزمان، باید داده ها را در Amazon S3 آپلود کنید و از آن استفاده کنید predict_async() روش با S3 URI به عنوان ورودی. آن را برمی گرداند AsyncInferenceResponse شی، و شما می توانید نتیجه را با استفاده از get_response() روش.

از طرف دیگر، اگر می خواهید نتیجه را به صورت دوره ای بررسی کنید و پس از تولید آن را برگردانید، از آن استفاده کنید predict() روش. ما از این روش دوم در کد زیر استفاده می کنیم:

Boto3

حال بیایید به بررسی آن بپردازیم invoke_endpoint_async روش از Boto3 sagemaker-runtime مشتری. این برنامه توسعه دهندگان را قادر می سازد تا به صورت ناهمزمان یک نقطه پایانی SageMaker را فراخوانی کنند و رمزی برای ردیابی پیشرفت و بازیابی پاسخ در آینده ارائه کنند. Boto3 راهی برای انتظار برای تکمیل استنتاج ناهمزمان مانند SageMaker Python SDK ارائه نمی دهد. get_result() عمل. بنابراین، ما از این واقعیت استفاده می کنیم که Boto3 خروجی استنتاج را در آمازون S3 ذخیره می کند response["OutputLocation"]. ما می توانیم از تابع زیر برای صبر کردن برای نوشتن فایل استنتاج در Amazon S3 استفاده کنیم:

با این تابع، اکنون می توانیم نقطه پایانی را پرس و جو کنیم:

LangChain

LangChain یک چارچوب متن باز است که در اکتبر 2022 توسط هریسون چیس راه اندازی شد. توسعه برنامه های کاربردی با استفاده از مدل های زبان بزرگ (LLM) را با ارائه یکپارچه سازی با سیستم ها و منابع داده های مختلف ساده می کند. LangChain امکان تجزیه و تحلیل اسناد، خلاصه سازی، ایجاد چت بات، تجزیه و تحلیل کد و موارد دیگر را فراهم می کند. با مشارکت صدها توسعهدهنده و سرمایهگذاری قابل توجه از سوی شرکتهای مخاطرهآمیز، محبوبیت پیدا کرده است. LangChain اتصال LLM ها را با منابع خارجی امکان پذیر می کند و ایجاد برنامه های کاربردی پویا و پاسخگو به داده ها را ممکن می سازد. این کتابخانه ها، API ها و اسناد را برای ساده کردن فرآیند توسعه ارائه می دهد.

LangChain کتابخانه ها و مثال هایی را برای استفاده از نقاط پایانی SageMaker با چارچوب خود ارائه می دهد و استفاده از مدل های ML میزبانی شده در SageMaker را به عنوان "مغز" زنجیره آسان تر می کند. برای کسب اطلاعات بیشتر در مورد نحوه ادغام LangChain با SageMaker، به ادامه مطلب مراجعه کنید SageMaker Endpoint در مستندات LangChain.

یکی از محدودیتهای اجرای فعلی LangChain این است که از نقاط پایانی ناهمزمان به صورت بومی پشتیبانی نمیکند. برای استفاده از یک نقطه پایانی ناهمزمان برای LangChain، باید یک کلاس جدید تعریف کنیم. SagemakerAsyncEndpoint، که گسترش می دهد SagemakerEndpoint کلاس در حال حاضر در LangChain موجود است. علاوه بر این، ما اطلاعات زیر را ارائه می دهیم:

- سطل و پیشوند S3 که در آن استنتاج ناهمزمان ورودی ها (و خروجی ها) را ذخیره می کند.

- حداکثر تعداد ثانیه برای انتظار قبل از اتمام زمان

- An

updated _call()تابع برای پرس و جو نقطه پایانی باinvoke_endpoint_async()بجایinvoke_endpoint() - راهی برای بیدار کردن نقطه پایانی ناهمزمان در صورت شروع سرد (مقیاس شده تا صفر)

برای بررسی جدید ایجاد شده SagemakerAsyncEndpoint، می توانید بررسی کنید sagemaker_async_endpoint.py پرونده در GitHub موجود است.

پاک کردن

وقتی آزمایش تولید استنتاج از نقطه پایانی را تمام کردید، به خاطر داشته باشید که برای جلوگیری از تحمیل هزینه اضافی، نقطه پایانی را حذف کنید:

نتیجه

هنگام استقرار مدل های فونداسیون بزرگ مانند TII Falcon، بهینه سازی هزینه بسیار مهم است. این مدل ها به سخت افزار قدرتمند و ظرفیت حافظه قابل توجهی نیاز دارند که منجر به هزینه های زیرساختی بالایی می شود. استنتاج ناهمزمان SageMaker، یک گزینه استقرار که درخواستها را به صورت ناهمزمان پردازش میکند، با صفر کردن تعداد نمونهها در زمانی که هیچ درخواست معلقی وجود ندارد، هزینهها را کاهش میدهد. در این پست، نحوه استقرار مدل های بنیادی بزرگ SageMaker JumpStart را در نقاط انتهایی ناهمزمان SageMaker نشان دادیم. ما نمونههای کدی را با استفاده از SageMaker Python SDK، Boto3 و LangChain برای نشان دادن روشهای مختلف برای فراخوانی نقاط پایانی ناهمزمان و بازیابی نتایج ارائه کردیم. این تکنیکها توسعهدهندگان و محققان را قادر میسازد تا ضمن استفاده از قابلیتهای مدلهای پایه برای سیستمهای پیشرفته درک زبان، هزینهها را بهینه کنند.

برای کسب اطلاعات بیشتر در مورد استنتاج ناهمزمان و SageMaker JumpStart، پست های زیر را بررسی کنید:

درباره نویسنده

دیوید گالیتلی یک معمار راه حل های تخصصی برای AI/ML در منطقه EMEA است. او در بروکسل مستقر است و از نزدیک با مشتریان در سرتاسر بنلوکس کار می کند. او از زمانی که خیلی جوان بود یک توسعه دهنده بوده و از سن ۷ سالگی شروع به کدنویسی کرد. او یادگیری AI/ML را در دانشگاه شروع کرد و از آن زمان عاشق آن شد.

دیوید گالیتلی یک معمار راه حل های تخصصی برای AI/ML در منطقه EMEA است. او در بروکسل مستقر است و از نزدیک با مشتریان در سرتاسر بنلوکس کار می کند. او از زمانی که خیلی جوان بود یک توسعه دهنده بوده و از سن ۷ سالگی شروع به کدنویسی کرد. او یادگیری AI/ML را در دانشگاه شروع کرد و از آن زمان عاشق آن شد.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. خودرو / خودروهای الکتریکی، کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- PlatoHealth. هوش بیوتکنولوژی و آزمایشات بالینی. دسترسی به اینجا.

- ChartPrime. بازی معاملاتی خود را با ChartPrime ارتقا دهید. دسترسی به اینجا.

- BlockOffsets. نوسازی مالکیت افست زیست محیطی. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/optimize-deployment-cost-of-amazon-sagemaker-jumpstart-foundation-models-with-amazon-sagemaker-asynchronous-endpoints/

- : دارد

- :است

- :نه

- :جایی که

- $UP

- 1

- 10

- 100

- 12

- 13

- ٪۱۰۰

- 1M

- 2022

- 25

- 7

- a

- قادر

- درباره ما

- تسریع می شود

- قبول می کند

- دسترسی

- دستاوردهای

- در میان

- فعالیت

- علاوه بر این

- پیشرفته

- مزیت - فایده - سود - منفعت

- پس از

- سن

- AI

- مدل های هوش مصنوعی

- AI / ML

- اجازه دادن

- اجازه می دهد تا

- قبلا

- همچنین

- هر چند

- آمازون

- آمازون SageMaker

- Amazon SageMaker JumpStart

- آمازون خدمات وب

- مقدار

- مقدار

- an

- تحلیل

- و

- اعلام کرد

- دیگر

- آنتروپیک

- هر

- API

- رابط های برنامه کاربردی

- کاربرد

- برنامه های کاربردی

- درخواست

- معماری

- هستند

- استدلال

- هنر

- AS

- At

- توجه

- مجذوب

- خودکار

- در دسترس

- میانگین

- اجتناب از

- AWS

- مستقر

- BE

- شدن

- بوده

- قبل از

- بودن

- بهترین

- بزرگتر

- میلیاردها

- بلاک ها

- بدن

- شکستن

- بروکسل

- بنا

- ساخته

- کسب و کار

- اما

- by

- صدا

- نام

- CAN

- قابلیت های

- قابلیت

- توانا

- ظرفیت

- مورد

- موارد

- زنجیر

- زنجیر

- چالش ها

- بار

- تعقیب

- chatbot

- بررسی

- را انتخاب کنید

- انتخاب

- کلاس

- مشتری

- نزدیک

- رمز

- سرد

- بیا

- می آید

- مشترک

- جوامع

- شرکت

- رقبای

- کامل

- تکمیل شده

- تکمیل شده

- جزء

- جامع

- کامپیوتر

- چشم انداز کامپیوتر

- مفهوم

- پیکر بندی

- ارتباط

- کنسول

- ظرف

- محتوا

- مشارکت

- هزینه

- هزینه

- ایجاد

- ایجاد شده

- ایجاد

- بسیار سخت

- جاری

- در حال حاضر

- سفارشی

- مشتریان

- برش

- کاهش هزینه ها

- چرخه

- داده ها

- معامله

- به طور پیش فرض

- تعريف كردن

- خواسته

- نشان

- گسترش

- مستقر

- استقرار

- گسترش

- دقیق

- برنامه نویس

- توسعه دهنده

- توسعه دهندگان

- پروژه

- DICT

- مختلف

- انتشار

- ابعاد

- غیر فعال

- دی ان اس

- do

- سند

- مستندات

- نمی کند

- انجام شده

- پایین

- دو

- در طی

- پویا

- e

- آسان تر

- موثر

- تلاش

- دیگر

- EMEA

- قادر ساختن

- را قادر می سازد

- نقطه پایانی

- موتورهای حرفه ای

- کافی

- خطا

- به خصوص

- هر

- مثال

- مثال ها

- جز

- استثنا

- مهیج

- مخارج

- تجربه

- اکتشاف

- قرار گرفتن در معرض

- گسترش می یابد

- وسیع

- خارجی

- اضافی

- چهره

- واقعیت

- افتادن

- غلط

- ویژگی

- پرونده

- شرکت ها

- نام خانوادگی

- پیروی

- برای

- پایه

- چهار

- چارچوب

- از جانب

- تابع

- بودجه

- به دست آورد

- تولید

- مولد

- نسل

- مولد

- هوش مصنوعی مولد

- GitHub

- خوب

- GPU ها

- بزرگ

- در حال رشد

- دسته

- سخت افزار

- آیا

- داشتن

- he

- کمک

- اینجا کلیک نمایید

- زیاد

- میزبانی

- چگونه

- چگونه

- اما

- HTML

- HTTP

- HTTPS

- صدها نفر

- صدها میلیون

- دلخواه

- شناسه

- if

- نشان می دهد

- تصویر

- پیاده سازی

- واردات

- in

- از جمله

- وارد شونده

- نشان می دهد

- لوازم

- اطلاعات

- شالوده

- ابداع

- ورودی

- ورودی

- نمونه

- در عوض

- ادغام

- یکپارچگی

- هوشمند

- علاقه

- رابط

- به

- معرفی

- سرمایه گذاری

- IT

- ITS

- سفر

- JPG

- json

- تنها

- شناخته شده

- زبان

- بزرگ

- تاخیر

- بعد

- راه اندازی

- راه اندازی

- برجسته

- یاد گرفتن

- یادگیری

- کمترین

- کتابخانه ها

- پسندیدن

- محدودیت

- فهرست

- بار

- محل

- طولانی

- به دنبال

- خیلی

- عشق

- کم

- دستگاه

- فراگیری ماشین

- ساخته

- اصلی

- حفظ

- ساخت

- ساخت

- بسیاری

- حداکثر

- بیشترین

- حافظه

- روش

- روش

- متری

- متریک

- میلیون ها نفر

- دقیقه

- ML

- مدل

- مدل

- بیش

- نام

- طبیعی

- پردازش زبان طبیعی

- پیمایش

- جهت یابی

- نیاز

- جدید

- به تازگی

- بعد

- nlp

- نه

- دفتر یادداشت

- اخطار

- اطلاعیه ها

- اکنون

- عدد

- هدف

- اکتبر

- of

- ارائه

- ارائه

- پیشنهادات

- غالبا

- on

- ONE

- فقط

- منبع باز

- عمل

- بهینه سازی

- بهینه سازی

- گزینه

- گزینه

- or

- ما

- خارج

- تولید

- قطعه

- پارامترهای

- بخش

- ویژه

- شرکای

- انتظار

- انجام

- انجام می دهد

- تصویر

- محل

- اماکن

- افلاطون

- هوش داده افلاطون

- PlatoData

- پوک

- سیاست

- محبوبیت

- ممکن

- پست

- پست ها

- بالقوه

- قدرت

- قوی

- عملی

- پیش گویی

- پیشگو

- پیش نمایش

- چاپ

- خصوصی

- مشکل

- روند

- فرآیندهای

- در حال پردازش

- پیشرفت

- پروژه ها

- اثبات

- اثبات مفهوم

- ثابت كردن

- ارائه

- ارائه

- فراهم می کند

- ارائه

- پــایتــون

- مارماهی

- نمایش ها

- سوال

- بالا بردن

- محدوده

- اعم

- خواندن

- اماده

- زمان واقعی

- گرفتن

- كاهش دادن

- را کاهش می دهد

- منطقه

- ثبت نام

- به یاد داشته باشید

- برداشتن

- جایگزین

- درخواست

- درخواست

- نیاز

- ضروری

- مورد نیاز

- نیاز

- محققان

- منابع

- منابع

- پاسخ

- نتیجه

- نتایج

- برگشت

- بازده

- این فایل نقد می نویسید:

- انقلابی

- خطرناک است

- ROI

- دویدن

- در حال اجرا

- حکیم ساز

- صرفه جویی کردن

- مقیاس پذیر

- مقیاس

- مقیاس گذاری

- sdk

- دوم

- ثانیه

- خود

- خدمت

- بدون سرور

- سرویس

- خدمات

- جلسات

- تنظیم

- کوتاه

- نشان داده شده

- نشان می دهد

- قابل توجه

- مشابه

- ساده

- پس از

- تنها

- شرایط

- اندازه

- اندازه

- جامد

- راه حل

- مزایا

- حل

- برخی از

- منابع

- متخصص

- چرخید

- ثبات

- پایدار

- شروع

- آغاز شده

- راه افتادن

- دولت

- گام

- توقف

- ذخیره سازی

- opbevare

- ساده

- ساده کردن

- قابل توجه

- موفقیت

- موفقیت

- چنین

- پشتیبانی

- پشتیبانی از

- مطمئن

- پیش افتادن از

- سیستم های

- گرفتن

- هدف

- وظایف

- تکنیک

- پیشرفته

- قالب

- قوانین و مقررات

- تست

- با تشکر

- که

- La

- دولت

- شان

- آنها

- سپس

- آنجا.

- در نتیجه

- از این رو

- اینها

- آنها

- این

- در این سال

- سه

- از طریق

- سراسر

- زمان

- بار

- زمان

- به

- با هم

- رمز

- هم

- پیگردی

- آموزش دیده

- ترجمه

- درست

- امتحان

- انواع

- ui

- زیر

- درک

- دانشگاه

- تا

- بر

- us

- استفاده کنید

- کاربر

- رابط کاربری

- با استفاده از

- معمولا

- ارزش

- نوع دیگر

- مختلف

- وسیع

- ریسک

- بررسی

- بسیار

- از طريق

- دید

- صبر کنيد

- منتظر

- بیداری

- از خواب بیدار

- می خواهم

- بود

- مسیر..

- راه

- we

- وب

- خدمات وب

- چه زمانی

- چه

- که

- در حین

- WHO

- وسیع

- دامنه گسترده

- اراده

- با

- بدون

- برنده شد

- با این نسخهها کار

- در سرتاسر جهان

- خواهد بود

- کتبی

- سال

- شما

- جوان

- شما

- خودت

- زفیرنت

- صفر