مهندسان یادگیری ماشین (ML) به طور سنتی بر ایجاد تعادل بین آموزش مدل و هزینه استقرار در مقابل عملکرد تمرکز کردهاند. به طور فزاینده ای، پایداری (بهره وری انرژی) به یک هدف اضافی برای مشتریان تبدیل می شود. این مهم است زیرا آموزش مدلهای ML و سپس استفاده از مدلهای آموزشدیده برای پیشبینی (استنتاج) میتواند کارهای بسیار پر انرژی باشد. علاوه بر این، برنامههای کاربردی بیشتری در اطراف ما با ML آمیخته شدهاند و هر روز برنامههای جدید مبتنی بر ML ایجاد میشوند. یک مثال محبوب ChatGPT OpenAI است که توسط یک مدل پیشرفته زبان بزرگ (LMM) طراحی شده است. برای مرجع، GPT-3، نسل قبلی LLM دارای 175 میلیارد پارامتر است و نیاز به ماه ها آموزش بی وقفه روی خوشه ای متشکل از هزاران پردازنده شتابدار دارد. این مطالعه کربن ردیاب تخمین میزند که آموزش GPT-3 از ابتدا ممکن است تا 85 تن معادل CO2 با استفاده از خوشههایی از شتابدهندههای سختافزاری تخصصی منتشر کند.

راههای مختلفی وجود دارد که AWS به پزشکان ML این امکان را میدهد تا تأثیر محیطی بار کاری خود را کاهش دهند. یک راه از طریق ارائه است راهنمایی تجویزی در مورد معماری بارهای کاری AI/ML خود برای پایداری. راه دیگر ارائه خدمات آموزش ML مدیریت شده و ارکستراسیون مانند Amazon SageMaker Studio، که به طور خودکار منابع ML را در صورت عدم استفاده از بین می برد و بزرگ می کند و مجموعه ای از ابزارهای خارج از جعبه را فراهم می کند که در هزینه و منابع صرفه جویی می کند. یکی دیگر از عوامل مهم توسعه است شتاب دهنده های کارآمد انرژی، با کارایی بالا و هدفمند برای آموزش و استقرار مدل های ML.

تمرکز این پست بر روی سخت افزار به عنوان اهرمی برای ML پایدار است. ما نتایج آزمایشهای عملکرد و توان مصرفی اخیر انجامشده توسط AWS را ارائه میکنیم که مزایای بهرهوری انرژی را که میتوانید در هنگام انتقال بارهای کاری یادگیری عمیق خود از دیگر برنامههای تسریعشده بهینهشده با استنباط و آموزش انتظار داشته باشید، کمّی میکند. ابر محاسبه الاستیک آمازون (Amazon EC2) نمونه هایی به استنتاج AWS و AWS Trainium. Inferentia و Trainium هستند اضافه شدن اخیر AWS به مجموعه شتاب دهنده های هدفمند خود به طور خاص توسط آمازون طراحی شده است آزمایشگاه آناپورنا برای استنتاج ML و بارهای کاری آموزشی.

AWS Inferentia و AWS Trainium برای ML پایدار

برای ارائه اعداد واقع بینانه از پتانسیل صرفه جویی انرژی AWS Inferentia و AWS Trainium در یک برنامه دنیای واقعی، چندین آزمایش معیار استخراج نیرو انجام داده ایم. ما این معیارها را با در نظر گرفتن معیارهای کلیدی زیر طراحی کرده ایم:

- ابتدا، ما میخواستیم مطمئن شویم که مصرف انرژی مستقیم را که به حجم کار آزمایشی نسبت داده میشود، شامل نه تنها شتابدهنده ML، بلکه محاسبات، حافظه و شبکه نیز میشود. بنابراین، در راه اندازی آزمایشی خود، مصرف توان را در آن سطح اندازه گیری کردیم.

- دوم، هنگام اجرای بارهای آموزشی و استنتاج، اطمینان حاصل کردیم که همه نمونه ها در محدودیت های سخت افزاری فیزیکی مربوطه خود کار می کنند و تنها پس از رسیدن به آن حد برای اطمینان از مقایسه، اندازه گیری ها را انجام دادیم.

- در نهایت، ما میخواستیم مطمئن باشیم که صرفهجویی در مصرف انرژی که در این پست گزارش شده است را میتوان در یک برنامه کاربردی در دنیای واقعی به دست آورد. بنابراین، ما از موارد استفاده رایج ML الهام گرفته از مشتری برای محک زدن و آزمایش استفاده کردیم.

نتایج در بخش های زیر گزارش شده است.

آزمایش استنتاج: درک اسناد بلادرنگ با LayoutLM

استنتاج، بر خلاف آموزش، یک حجم کاری مستمر و نامحدود است که نقطه تکمیل مشخصی ندارد. بنابراین بخش بزرگی از مصرف منابع در طول عمر بار کاری ML را تشکیل می دهد. استنتاج صحیح کلید دستیابی به عملکرد بالا، هزینه کم و پایداری (بهره وری انرژی بهتر) در طول چرخه عمر کامل ML است. با وظایف استنتاج، مشتریان معمولاً علاقه مند به دستیابی به یک نرخ استنتاج معین برای همگام شدن با تقاضای دریافتی هستند.

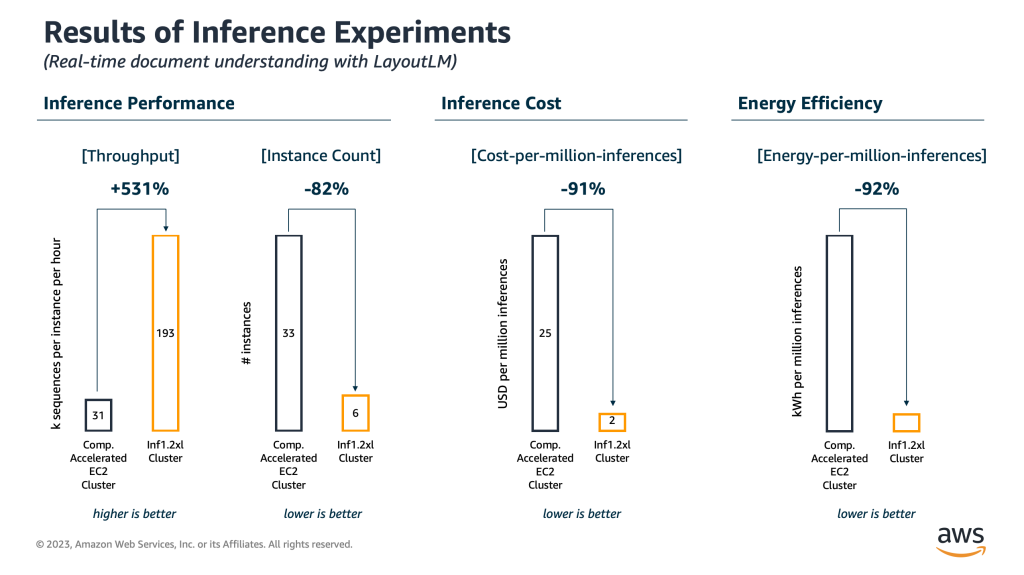

آزمایش ارائه شده در این پست از یک مورد استفاده درک سند بلادرنگ الهام گرفته شده است، که یک کاربرد رایج در صنایعی مانند بانکداری یا بیمه است (به عنوان مثال، برای رسیدگی به مطالبات یا فرم درخواست). به طور خاص، ما انتخاب می کنیم LayoutLM، یک مدل ترانسفورماتور از پیش آموزش دیده مورد استفاده برای پردازش تصویر سند و استخراج اطلاعات. ما یک SLA هدف 1,000,000،XNUMX،XNUMX استنتاج در ساعت، مقداری که اغلب به عنوان زمان واقعی در نظر گرفته میشود، تعیین میکنیم، و سپس دو پیکربندی سختافزاری را مشخص میکنیم که قادر به برآورده کردن این نیاز است: یکی با استفاده از نمونه های آمازون EC2 Inf1، دارای AWS Inferentia، و یکی با استفاده از نمونه های EC2 تسریع شده قابل مقایسه که برای وظایف استنتاج بهینه شده است. در طول آزمایش، چندین شاخص را برای اندازهگیری عملکرد استنتاج، هزینه و کارایی انرژی هر دو پیکربندی سختافزاری دنبال میکنیم. نتایج در شکل زیر ارائه شده است.

نتایج عملکرد، هزینه و کارایی انرژی معیارهای استنتاج

AWS Inferentia 6.3 برابر توان استنتاج بالاتری ارائه می دهد. در نتیجه، با Inferentia، میتوانید همان حجم کار درک سند مبتنی بر LayoutLM را در زمانهای کمتری اجرا کنید (6 نمونه AWS Inferentia در مقابل 33 نمونه EC2 تسریعشده بهینهسازی شده دیگر، معادل 82 درصد کاهش)، کمتر استفاده کنید. بیش از یک دهم (-92٪) انرژی در فرآیند، همه در حالی که هزینه هر استنتاج به طور قابل توجهی کمتر است (2 USD در مقابل 25 USD در هر میلیون استنتاج، معادل 91٪ کاهش هزینه).

آزمایش تمرینی: آموزش BERT Large از ابتدا

آموزش، برخلاف استنتاج، فرآیندی محدود است که بسیار کمتر تکرار می شود. مهندسان ML معمولاً علاقه مند به عملکرد خوشه بالا برای کاهش زمان آموزش و در عین حال تحت کنترل نگه داشتن هزینه هستند. بهره وری انرژی یک نگرانی ثانویه (در عین حال رو به رشد) است. با AWS Trainium، هیچ تصمیم مبادلهای وجود ندارد: مهندسان ML میتوانند از عملکرد آموزشی بالا بهره ببرند و در عین حال هزینه را بهینه کنند و اثرات زیست محیطی را کاهش دهند.

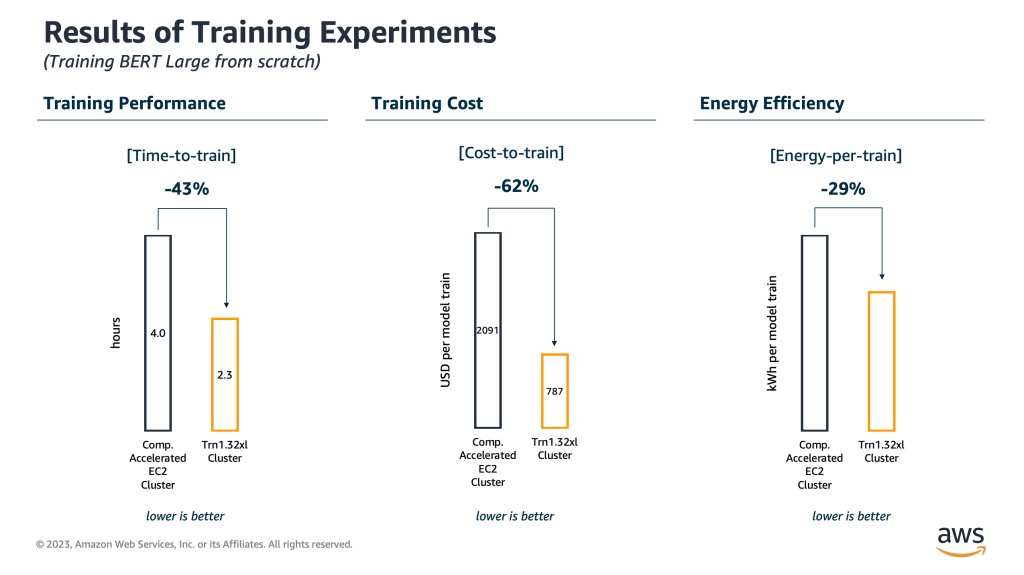

برای نشان دادن این موضوع، انتخاب می کنیم برت بزرگ، یک مدل زبان محبوب که برای درک زبان طبیعی استفاده می شود از مواردی مانند پاسخ به سؤال مبتنی بر چت و پیش بینی پاسخ مکالمه استفاده می کند. آموزش یک مدل BERT Large با عملکرد خوب از ابتدا معمولاً به 450 میلیون دنباله نیاز دارد تا پردازش شود. ما دو پیکربندی خوشهای را با هم مقایسه میکنیم که هر کدام با اندازه ثابت 16 نمونه و قادر به آموزش BERT Large از ابتدا (450 میلیون دنباله پردازش شده) در کمتر از یک روز هستند. اولی از نمونههای EC2 شتابدار سنتی استفاده میکند. راه اندازی دوم استفاده می کند نمونه های آمازون EC2 Trn1 دارای AWS Trainium. مجدداً، ما هر دو پیکربندی را از نظر عملکرد آموزشی، هزینه و تأثیر زیست محیطی (بهره وری انرژی) محک می زنیم. نتایج در شکل زیر نشان داده شده است.

نتایج عملکرد، هزینه و کارایی انرژی معیارهای آموزشی

در آزمایشها، نمونههای مبتنی بر AWS Trainium با ضریب 2 از نظر توالیهای پردازششده در ساعت، از نمونههای EC1.7 شتابدار بهینهسازی شده برای تمرین بهتر عمل کردند و کل زمان تمرین را تا 43 درصد کاهش دادند (2.3 ساعت در مقابل 4 ساعت در نمونههای شتابدار EC2 قابل مقایسه). . در نتیجه، هنگام استفاده از یک خوشه نمونه مبتنی بر Trainium، کل مصرف انرژی برای تمرین BERT Large از ابتدا تقریباً 29٪ کمتر در مقایسه با یک خوشه هم اندازه از نمونه های EC2 شتاب یافته مشابه است. باز هم، این مزایای عملکرد و بهره وری انرژی با بهبودهای هزینه قابل توجهی همراه است: هزینه آموزش برای بار کاری BERT ML در نمونه های Trainium تقریباً 62٪ کمتر است (787 دلار آمریکا در مقابل 2091 دلار در هر دوره آموزشی کامل).

شروع کار با شتاب دهنده های هدفمند AWS برای ML

اگرچه آزمایشهای انجامشده در اینجا همگی از مدلهای استاندارد از حوزه پردازش زبان طبیعی (NLP) استفاده میکنند، AWS Inferentia و AWS Trainium با بسیاری از معماریهای مدل پیچیده دیگر از جمله LLM و چالشبرانگیزترین آنها برتری دارند. هوش مصنوعی مولد معماری هایی که کاربران می سازند (مانند GPT-3). این شتابدهندهها بهویژه با مدلهایی با بیش از 10 میلیارد پارامتر یا مدلهای بینایی کامپیوتری مانند انتشار پایدار خوب عمل میکنند (نگاه کنید به دستورالعمل های مناسب معماری مدل برای جزئیات بیشتر). در واقع، بسیاری از مشتریان ما در حال حاضر از Inferentia و Trainium برای طیف گسترده ای از موارد استفاده می کنند موارد استفاده از ML.

برای اجرای بارهای کاری یادگیری عمیق سرتاسر خود در نمونه های مبتنی بر AWS Inferentia و AWS Trainium، می توانید از نورون AWS. Neuron یک کیت توسعه نرم افزاری (SDK) است که شامل یک کامپایلر یادگیری عمیق، زمان اجرا و ابزارهایی است که به طور بومی در محبوب ترین چارچوب های ML مانند TensorFlow و PyTorch ادغام شده اند. می توانید از Neuron SDK استفاده کنید تا به راحتی بارهای کاری ML یادگیری عمیق TensorFlow یا PyTorch خود را به Inferentia و Trainium منتقل کنید و با استفاده از همان چارچوب های شناخته شده ML شروع به ساخت مدل های جدید کنید. برای راه اندازی آسان تر، از یکی از ما استفاده کنید تصاویر ماشین آمازون (AMI) برای یادگیری عمیق، که با بسیاری از بسته ها و وابستگی های مورد نیاز همراه است. حتی ساده تر: می توانید از Amazon SageMaker Studio استفاده کنید، که به طور بومی از TensorFlow و PyTorch در Inferentia و Trainium پشتیبانی می کند. aws-samples مخزن GitHub برای مثال).

یک نکته پایانی: در حالی که Inferentia و Trainium برای بارهای کاری یادگیری عمیق ساخته شده اند، بسیاری از الگوریتم های ML کمتر پیچیده می توانند در نمونه های مبتنی بر CPU عملکرد خوبی داشته باشند (به عنوان مثال، XGBoost و LightGBM و حتی برخی از CNN ها). در این موارد مهاجرت به AWS Graviton3 ممکن است تأثیر محیطی بارهای کاری ML شما را به میزان قابل توجهی کاهش دهد. نمونههای مبتنی بر AWS Graviton تا 60٪ انرژی کمتری برای عملکرد یکسان نسبت به نمونههای EC2 شتابدهنده مشابه مصرف میکنند.

نتیجه

یک تصور غلط رایج وجود دارد که اجرای بارهای کاری ML به شیوه ای پایدار و کم مصرف به معنای قربانی کردن عملکرد یا هزینه است. با شتابدهندههای هدفمند AWS برای یادگیری ماشین، مهندسان ML نیازی به این مبادله ندارند. در عوض، آنها میتوانند بارهای کاری یادگیری عمیق خود را بر روی سختافزار یادگیری عمیق هدفمند بسیار تخصصی، مانند AWS Inferentia و AWS Trainium اجرا کنند، که عملکرد قابلتوجهی از انواع نمونههای شتابدار EC2 قابل مقایسه دارد، هزینه کمتر، عملکرد بالاتر و بازده انرژی بهتر را ارائه میکند. 90٪ - همه در یک زمان. برای شروع اجرای بارهای کاری ML خود در Inferentia و Trainium، این را بررسی کنید مستندات AWS Neuron یا یکی از آنها را بچرخانید نمونه دفترچه یادداشت. همچنین میتوانید سخنرانی AWS re:Invent 2022 را تماشا کنید پایداری و سیلیکون AWS (SUS206)، که بسیاری از موضوعات مورد بحث در این پست را پوشش می دهد.

درباره نویسنده

کارستن شروئر یک معمار راه حل در AWS است. او از مشتریان در استفاده از دادهها و فناوری برای ایجاد پایداری زیرساختهای فناوری اطلاعات و ایجاد راهحلهای مبتنی بر دادهها که عملیات پایدار در بخشهای عمودی مربوطه را قادر میسازد، پشتیبانی میکند. کارستن پس از تحصیل در مقطع دکترا در زمینه یادگیری ماشین کاربردی و مدیریت عملیات به AWS پیوست. او واقعاً مشتاق راه حل های مبتنی بر فناوری برای چالش های اجتماعی است و دوست دارد عمیقاً در روش ها و معماری های کاربردی که زیربنای این راه حل ها هستند غوطه ور شود.

کارستن شروئر یک معمار راه حل در AWS است. او از مشتریان در استفاده از دادهها و فناوری برای ایجاد پایداری زیرساختهای فناوری اطلاعات و ایجاد راهحلهای مبتنی بر دادهها که عملیات پایدار در بخشهای عمودی مربوطه را قادر میسازد، پشتیبانی میکند. کارستن پس از تحصیل در مقطع دکترا در زمینه یادگیری ماشین کاربردی و مدیریت عملیات به AWS پیوست. او واقعاً مشتاق راه حل های مبتنی بر فناوری برای چالش های اجتماعی است و دوست دارد عمیقاً در روش ها و معماری های کاربردی که زیربنای این راه حل ها هستند غوطه ور شود.

کامران خان مدیر محصول فنی Sr. در آزمایشگاه AWS Annapurna است. او از نزدیک با مشتریان AI/ML همکاری میکند تا نقشه راه نوآوریهای سیلیکونی هدفمند AWS را که از آزمایشگاههای Annapurna آمازون بیرون میآیند، شکل دهد. تمرکز ویژه او بر روی تراشه های یادگیری عمیق شتاب یافته از جمله AWS Trainium و AWS Inferentia است. کامران 18 سال سابقه کار در صنعت نیمه هادی دارد. کامران بیش از یک دهه تجربه در کمک به توسعه دهندگان برای دستیابی به اهداف ML خود دارد.

کامران خان مدیر محصول فنی Sr. در آزمایشگاه AWS Annapurna است. او از نزدیک با مشتریان AI/ML همکاری میکند تا نقشه راه نوآوریهای سیلیکونی هدفمند AWS را که از آزمایشگاههای Annapurna آمازون بیرون میآیند، شکل دهد. تمرکز ویژه او بر روی تراشه های یادگیری عمیق شتاب یافته از جمله AWS Trainium و AWS Inferentia است. کامران 18 سال سابقه کار در صنعت نیمه هادی دارد. کامران بیش از یک دهه تجربه در کمک به توسعه دهندگان برای دستیابی به اهداف ML خود دارد.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- EVM Finance. رابط یکپارچه برای امور مالی غیرمتمرکز دسترسی به اینجا.

- گروه رسانه ای کوانتومی. IR/PR تقویت شده دسترسی به اینجا.

- PlatoAiStream. Web3 Data Intelligence دانش تقویت شده دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/reduce-energy-consumption-of-your-machine-learning-workloads-by-up-to-90-with-aws-purpose-built-accelerators/

- : دارد

- :است

- :نه

- $UP

- 000

- 1

- 10

- 100

- 16

- 2022

- 25

- 7

- a

- درباره ما

- تسریع شد

- شتاب دهنده

- شتاب دهنده ها

- رسیدن

- دست

- دستیابی به

- اضافه

- اضافی

- پس از

- از نو

- AI / ML

- الگوریتم

- معرفی

- در امتداد

- قبلا

- همچنین

- آمازون

- آمازون EC2

- آمازون SageMaker

- Amazon SageMaker Studio

- آمازون خدمات وب

- an

- و

- دیگر

- کاربرد

- برنامه های کاربردی

- اعمال می شود

- تقریبا

- معماری

- هستند

- ARM

- دور و بر

- AS

- At

- بطور خودکار

- AWS

- استنتاج AWS

- AWS دوباره: اختراع

- برج میزان

- بانکداری

- BE

- زیرا

- شدن

- تبدیل شدن به

- محک

- معیار

- معیار

- سود

- مزایای

- بهتر

- میان

- بیلیون

- هر دو

- ساختن

- بنا

- ساخته

- اما

- by

- CAN

- توانا

- اسیر

- مورد

- موارد

- معین

- چالش ها

- به چالش کشیدن

- GPT چت

- بررسی

- چیپس

- ادعای

- نزدیک

- خوشه

- بیا

- آینده

- مشترک

- قابل مقایسه

- مقايسه كردن

- مقایسه

- اتمام

- پیچیده

- محاسبه

- کامپیوتر

- چشم انداز کامپیوتر

- تصور می شود

- نگرانی

- انجام

- در نظر گرفته

- مصرف

- مداوم

- کنترل

- محاورهای

- هزینه

- کاهش هزینه

- میتوانست

- را پوشش می دهد

- ضوابط

- مشتریان

- برش

- داده ها

- داده محور

- روز

- دهه

- تصمیم

- عمیق

- یادگیری عمیق

- مشخص

- تحویل

- ارائه

- تقاضا

- استقرار

- گسترش

- طراحی

- جزئیات

- توسعه دهندگان

- پروژه

- انتشار

- مستقیم

- بحث کردیم

- do

- سند

- نمی کند

- دامنه

- آیا

- پایین

- قرعه کشی

- راندن

- هر

- پیش از آن

- آسان تر

- به آسانی

- بهره وری

- موثر

- قادر ساختن

- توانمندساز

- را قادر می سازد

- پشت سر هم

- انرژی

- مصرف انرژی

- مورد تأیید

- اطمینان حاصل شود

- محیطی

- معادل

- تخمین می زند

- حتی

- هر

- هر روز

- مثال

- اکسل

- موجود

- انتظار

- تجربه

- تجربه

- آزمایش

- عامل

- روش

- ویژگی های

- کمتر

- شکل

- نهایی

- نام خانوادگی

- مناسب

- ثابت

- تمرکز

- متمرکز شده است

- پیروی

- برای

- فرم

- چارچوب

- غالبا

- از جانب

- کامل

- نسل

- گرفتن

- GitHub

- اهداف

- در حال رشد

- راهنمایی

- سخت افزار

- آیا

- he

- کمک

- اینجا کلیک نمایید

- زیاد

- عملکرد بالا

- بالاتر

- خیلی

- خود را

- میزبان

- ساعت

- HTML

- HTTP

- HTTPS

- تصویر

- تصاویر

- تأثیر

- مهم

- ارتقاء

- in

- شامل

- از جمله

- به طور فزاینده

- شاخص ها

- لوازم

- صنعت

- اطلاعات

- استخراج اطلاعات

- شالوده

- نوآوری

- الهام بخش

- نمونه

- در عوض

- بیمه

- یکپارچه

- علاقه مند

- به

- IT

- ITS

- پیوست

- تنها

- نگاه داشتن

- نگهداری

- کلید

- کیت (SDK)

- آزمایشگاه

- زبان

- بزرگ

- یادگیری

- کمتر

- سطح

- بهره برداری

- wifecycwe

- عمر

- پسندیدن

- محدود

- محدودیت

- دوست دارد

- کم

- کاهش

- دستگاه

- فراگیری ماشین

- عمده

- ساخت

- باعث می شود

- اداره می شود

- مدیریت

- مدیر

- بسیاری

- ممکن است..

- به معنی

- اندازه

- اندازه گیری

- نشست

- حافظه

- روش

- متری

- مهاجرت

- مهاجرت

- میلیون

- ذهن

- ML

- مدل

- مدل

- ماه

- بیش

- اکثر

- محبوبترین

- بسیار

- طبیعی

- پردازش زبان طبیعی

- شبکه

- جدید

- nlp

- نه

- تعداد

- هدف

- of

- ارائه

- غالبا

- on

- ONE

- فقط

- عملیاتی

- عملیات

- مخالف

- بهینه

- بهینه سازی

- or

- تنظیم و ارکستراسیون

- دیگر

- ما

- خارج

- عملکرد بهتر

- روی

- بسته

- پارامترهای

- ویژه

- احساساتی

- انجام

- کارایی

- فیزیکی

- افلاطون

- هوش داده افلاطون

- PlatoData

- نقطه

- محبوب

- مقام

- بخشی

- پست

- پتانسیل

- قدرت

- صفحه اصلی

- عملی

- پیش گویی

- پیش بینی

- در حال حاضر

- ارائه شده

- روند

- فرآوری شده

- در حال پردازش

- پردازنده ها

- محصول

- مدیر تولید

- ارائه

- فراهم می کند

- ارائه

- هدف

- مارماهی

- سوال

- نرخ

- RE

- رسیده

- واقعی

- دنیای واقعی

- زمان واقعی

- واقع بینانه

- اخیر

- كاهش دادن

- کاهش

- کاهش

- مکرر

- گزارش

- ضروری

- نیاز

- نیاز

- منابع

- منابع

- قابل احترام

- پاسخ

- نتیجه

- نتایج

- راست

- نقشه راه

- دویدن

- در حال اجرا

- قربانی کردن

- حکیم ساز

- همان

- پس انداز

- مقیاس ها

- خراش

- sdk

- دوم

- ثانوی

- بخش

- دیدن

- نیمه هادی

- خدمات

- تنظیم

- برپایی

- چند

- شکل

- نشان داده شده

- قابل توجه

- به طور قابل توجهی

- سیلیکون

- اندازه

- اجتماعی

- نرم افزار

- توسعه نرم افزار

- بسته توسعه نرم افزار

- مزایا

- تخصصی

- خاص

- به طور خاص

- چرخش

- پایدار

- استاندارد

- شروع

- آغاز شده

- وضعیت هنر

- مطالعات

- استودیو

- چنین

- پشتیبانی از

- پایداری

- قابل تحمل

- صحبت

- هدف

- وظایف

- فنی

- پیشرفته

- جریان تنسور

- قوانین و مقررات

- آزمون

- تست

- نسبت به

- که

- La

- شان

- سپس

- آنجا.

- از این رو

- اینها

- آنها

- این

- هزاران نفر

- از طریق

- سراسر

- توان

- زمان

- بار

- به

- لحن

- در زمان

- ابزار

- تاپیک

- جمع

- مسیر

- سنتی

- به طور سنتی

- قطار

- آموزش دیده

- آموزش

- ترانسفورماتور

- صادقانه

- دو

- انواع

- به طور معمول

- زیر

- زمینه جیزی بودن

- درک

- us

- دلار آمریکا

- استفاده کنید

- مورد استفاده

- استفاده

- کاربران

- استفاده

- با استفاده از

- معمولا

- ارزش

- تنوع

- در مقابل

- عمودی

- دید

- vs

- خواسته

- بود

- تماشا کردن

- مسیر..

- راه

- we

- وب

- خدمات وب

- خوب

- معروف

- بود

- چه زمانی

- که

- در حین

- وسیع

- با

- با این نسخهها کار

- سال

- هنوز

- شما

- شما

- زفیرنت