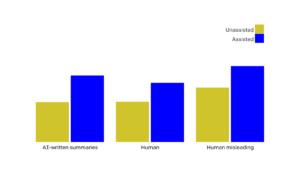

امروز، ما در حال اجرای یک تکنیک جدید هستیم تا DALL·E تصاویری از مردم تولید کند که تنوع جمعیت جهان را با دقت بیشتری منعکس کند. این تکنیک در سطح سیستم زمانی اعمال میشود که به DALL·E درخواستی داده میشود که در آن فردی که نژاد یا جنسیت را مشخص نمیکند، مانند «آتشنشان» توصیف میکند.

بر اساس ارزیابی داخلی ما، کاربران ۱۲ برابر احتمال بیشتری داشتند که بگویند تصاویر DALL·E پس از استفاده از این تکنیک شامل افرادی با زمینههای مختلف است. ما قصد داریم این تکنیک را در طول زمان با جمع آوری داده ها و بازخوردهای بیشتر بهبود دهیم.

تولید

در ماه آوریل، پیشنمایش تحقیقات DALL·E 2 را برای تعداد محدودی از افراد آغاز کردیم که به ما این امکان را داد که تواناییها و محدودیتهای سیستم را بهتر درک کنیم و سیستمهای ایمنی خود را بهبود بخشیم.

در طول این مرحله پیش نمایش، کاربران اولیه تصاویر حساس و مغرضانه را علامت گذاری کرده اند که به اطلاع رسانی و ارزیابی این کاهش جدید کمک کرده است.

ما همچنان به تحقیق در مورد اینکه چگونه سیستمهای هوش مصنوعی، مانند DALL·E، ممکن است سوگیریها را در دادههای آموزشی خود و راههای مختلفی که میتوانیم به آنها رسیدگی کنیم، منعکس میکنند، ادامه میدهیم.

در طول پیشنمایش تحقیق، ما گامهای دیگری را برای بهبود سیستمهای ایمنی خود برداشتهایم، از جمله:

- به حداقل رساندن خطر سوء استفاده از DALL·E برای ایجاد محتوای فریبنده با رد بارگذاری تصاویر حاوی چهرههای واقعی و تلاش برای ایجاد شباهت به شخصیتهای عمومی، از جمله افراد مشهور و چهرههای سیاسی برجسته.

- فیلترهای محتوای خود را دقیقتر کنیم تا در مسدود کردن درخواستها و آپلود تصاویری که ما را نقض میکنند مؤثرتر باشند. خط مشی محتوا در حالی که همچنان به بیان خلاق اجازه می دهد.

- پالایش سیستمهای نظارت خودکار و انسانی برای محافظت در برابر سوء استفاده.

این بهبودها به ما کمک کرده است تا در توانایی دعوت از کاربران بیشتر به تجربه DALL·E اطمینان پیدا کنیم.

گسترش دسترسی بخش مهمی از ما است استقرار سیستم های هوش مصنوعی مسئولانه زیرا این امکان را به ما می دهد تا در مورد استفاده در دنیای واقعی بیشتر بیاموزیم و به تکرار سیستم های ایمنی خود ادامه دهیم.

- AI

- آی هنر

- مولد هنر ai

- ربات ai

- اطلاعیه ها

- هوش مصنوعی

- گواهی هوش مصنوعی

- هوش مصنوعی در بانکداری

- ربات هوش مصنوعی

- ربات های هوش مصنوعی

- نرم افزار هوش مصنوعی

- بلاکچین

- کنفرانس بلاک چین ai

- coingenius

- هوش مصنوعی محاوره ای

- کنفرانس کریپتو ai

- دل-ه

- یادگیری عمیق

- گوگل ai

- فراگیری ماشین

- OpenAI

- افلاطون

- افلاطون آی

- هوش داده افلاطون

- بازی افلاطون

- PlatoData

- بازی پلاتو

- مقیاس Ai

- نحو

- زفیرنت