پیشرفتهای اخیر در یادگیری عمیق منجر به مدلهای بزرگتر مانند GPT-3، BLOOM و OPT شده است که برخی از آنها در حال حاضر بیش از 100 میلیارد پارامتر دارند. اگرچه مدل های بزرگتر قوی تر هستند، آموزش چنین مدل هایی به منابع محاسباتی قابل توجهی نیاز دارد. حتی با استفاده از کتابخانههای آموزشی توزیعشده پیشرفته مانند FSDP و DeepSpeed، معمولاً برای مشاغل آموزشی به صدها دستگاه شتابدهنده برای چندین هفته یا چند ماه در یک زمان نیاز است.

در اواخر سال 2022، AWS در دسترس بودن عمومی را اعلام کرد نمونه های آمازون EC2 Trn1 طراحی توسط AWS Trainium- یک شتابدهنده یادگیری ماشینی (ML) ساخته شده بهینه شده برای ارائه یک پلت فرم با کارایی بالا، مقرون به صرفه و بسیار مقیاس پذیر برای آموزش مدل های یادگیری عمیق در فضای ابری. نمونههای Trn1 در اندازههای مختلفی در دسترس هستند (جدول زیر را ببینید)، با حداکثر 16 شتابدهنده Trainium در هر نمونه.

| اندازه نمونه | شتاب دهنده های Trainium | حافظه شتاب دهنده (GB) | vCPU ها | حافظه نمونه (GiB) | پهنای باند شبکه (Gbps) |

| trn1.2xlarge | 1 | 32 | 8 | 32 | تا 12.5 |

| trn1.32xlarge | 16 | 512 | 128 | 512 | 800 |

| trn1n.32xlarge (به زودی) | 16 | 512 | 128 | 512 | 1600 |

نمونههای Trn1 میتوانند بهعنوان نمونههای مستقل برای کارهای آموزشی کوچکتر یا در فراخوشههای بسیار مقیاسپذیر که از آموزش توزیع شده در دهها هزار شتابدهنده Trainium پشتیبانی میکنند، استفاده شوند. همه نمونههای Trn1 از پیکربندی مستقل پشتیبانی میکنند، در حالی که اولترخوشههای Trn1 به نمونههای trn1.32xlarge یا trn1n.32xlarge نیاز دارند. در یک Ultracluster، چندین نمونه Trn1 در یک منطقه در دسترس AWS معین قرار میگیرند و با شبکه آداپتور فابریک الاستیک (EFA) با سرعت بالا، تأخیر کم وصل میشوند که 800 گیگابیت بر ثانیه پهنای باند شبکه غیرمسدود کننده را در هر نمونه برای عملیات محاسباتی جمعی فراهم میکند. . نوع نمونه trn1n.32xlarge که در اوایل سال 2023 راه اندازی شد، این پهنای باند را به 1600 گیگابیت بر ثانیه در هر نمونه افزایش می دهد.

بسیاری از مشتریان سازمانی انتخاب میکنند تا بارهای کاری یادگیری عمیق خود را با استفاده از Kubernetes - استاندارد واقعی برای هماهنگی کانتینر در فضای ابری - به کار گیرند. مشتریان AWS اغلب با استفاده از این بارهای کاری استفاده می کنند سرویس الاستیک کوبرنتز آمازون (Amazon EKS). Amazon EKS یک سرویس Kubernetes مدیریت شده است که ایجاد، پیکربندی، چرخه حیات و نظارت بر خوشههای Kubernetes را ساده میکند و در عین حال انعطافپذیری کامل Kubernetes بالادستی را ارائه میدهد.

امروز، ما مشتاقیم که پشتیبانی رسمی از مشاغل آموزشی توزیع شده با استفاده از نمونه های Amazon EKS و EC2 Trn1 را اعلام کنیم. با این اعلامیه، اکنون می توانید به راحتی مشاغل آموزشی کانتینری در مقیاس بزرگ را در آمازون EKS اجرا کنید و در عین حال از مزایای کامل قیمت، مقیاس پذیری و سهولت استفاده ارائه شده توسط نمونه های Trn1 استفاده کنید.

همراه با این اطلاعیه، ما همچنین یک آموزش مفصل را منتشر می کنیم که شما را در مراحل مورد نیاز برای اجرای یک کار آموزشی توزیع شده چند نمونه ای (پیش آموزشی BERT فاز 1) با استفاده از نمونه های آمازون EKS و Trn1 راهنمایی می کند. در این پست با معماری راه حل آشنا می شوید و چندین مرحله کلیدی از آموزش را مرور می کنید. رجوع به مخزن رسمی آموزش برای گردش کار کامل انتها به انتها.

برای ادامه، آشنایی گسترده با خدمات اصلی AWS مانند ابر محاسبه الاستیک آمازون (Amazon EC2) و Amazon EKS ضمنی است و آشنایی اولیه با یادگیری عمیق و PyTorch مفید خواهد بود.

معماری راه حل

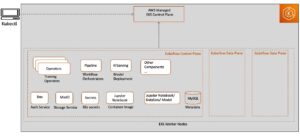

نمودار زیر معماری راه حل را نشان می دهد.

راه حل شامل اجزای اصلی زیر است:

- یک خوشه EKS

- یک گروه گره EKS متشکل از نمونه های trn1.32xlarge

- La نورون AWS SDK

- پلاگین های EKS برای Neuron و EFA

- An رجیستری ظروف الاستیک آمازون (Amazon ECR) Repository

- تصویر ظرف آموزشی

- An آمازون FSx برای Luster سیستم فایل

- یک زمانبندی دسته ای آتشفشان و سرور etcd

- راه اندازی کار جهانی TorchX

- ماژول TorchX DDP برای Trainium

در قلب راه حل، یک خوشه EKS است که از طریق یک نقطه پایانی سرویس EKS، عملکرد اصلی مدیریت Kubernetes را در اختیار شما قرار می دهد. یکی از مزایای آمازون EKS این است که این سرویس به طور فعال صفحه کنترل را بر اساس بار نظارت و مقیاس می کند که عملکرد بالا را برای بارهای کاری بزرگ مانند آموزش توزیع شده تضمین می کند. در داخل خوشه EKS یک گروه گره متشکل از دو یا چند نمونه trn1.32xlarge مبتنی بر Trainium وجود دارد که در همان منطقه دسترسی ساکن هستند.

Neuron SDK پشته نرم افزاری است که درایور، کامپایلر، زمان اجرا، ادغام چارچوب (به عنوان مثال PyTorch Neuron) و ابزارهای کاربری را فراهم می کند که به شما امکان دسترسی به مزایای شتاب دهنده های Trainium را می دهد. درایور دستگاه Neuron مستقیماً روی گرههای EKS (نمونههای Trn1) اجرا میشود و دسترسی به تراشههای Trainium را از داخل کانتینرهای آموزشی که روی گرهها راهاندازی میشوند، فراهم میکند. پلاگینهای Neuron و EFA در خوشه EKS نصب شدهاند تا دسترسی به تراشههای Trainium و دستگاههای شبکه EFA مورد نیاز برای آموزش توزیعشده را فراهم کنند.

یک مخزن ECR برای ذخیره تصاویر کانتینر آموزشی استفاده می شود. این تصاویر حاوی Neuron SDK (به استثنای درایور Neuron که مستقیماً روی نمونههای Trn1 اجرا میشود)، اسکریپت آموزشی PyTorch و وابستگیهای مورد نیاز است. هنگامی که یک کار آموزشی در خوشه EKS راه اندازی می شود، ابتدا تصاویر کانتینر از آمازون ECR روی گره های EKS کشیده می شوند و سپس کانتینرهای کارگر PyTorch از تصاویر نمونه سازی می شوند.

فضای ذخیره سازی مشترک با استفاده از یک سیستم فایل FSx برای Luster با کارایی بالا ارائه می شود که در همان منطقه در دسترس بودن نمونه های trn1.32xlarge وجود دارد. ایجاد و پیوست فایل سیستم FSx for Luster به خوشه EKS توسط درایور آمازون FSx برای Luster CSI. در این راه حل، ذخیره سازی مشترک برای ذخیره مجموعه داده های آموزشی و هر گونه گزارش یا مصنوع ایجاد شده در طول فرآیند آموزش استفاده می شود.

راه حل از کار پرتاب جهانی TorchX برای راه اندازی مشاغل آموزشی توزیع شده در آمازون EKS. TorchX دو وابستگی مهم دارد: زمانبندی دسته ای Volcano و سرور etcd. Volcano زمانبندی و صفبندی مشاغل آموزشی را انجام میدهد، در حالی که سرور etcd یک فروشگاه با ارزش کلیدی است که توسط TorchElastic برای همگامسازی و کشف همتا در هنگام راهاندازی کار استفاده میشود.

هنگامی که یک کار آموزشی با استفاده از TorchX راهاندازی میشود، دستور راهاندازی از ماژول DDP توزیعشده TorchX برای Trainium استفاده میکند تا کار آموزشی کلی را پیکربندی کند و سپس دستورات torchrun مناسب را روی هر یک از غلافهای کارگر PyTorch اجرا کند. هنگامی که یک کار در حال اجرا است، می توان آن را با استفاده از ابزارهای استاندارد Kubernetes (مانند kubectl) یا از طریق مجموعه ابزارهای استاندارد ML مانند TensorBoard نظارت کرد.

بررسی اجمالی راه حل

بیایید به مراحل مهم این راه حل نگاه کنیم. در سراسر این مرور کلی، ما به با استفاده از TorchX و EKS یک کار آموزش چند گره PyTorch Neuron در Trainium راه اندازی کنید آموزش در GitHub.

یک خوشه EKS ایجاد کنید

برای شروع کار آموزشی توزیع شده در آمازون EKS با نمونههای Trn1، ابتدا یک خوشه EKS ایجاد کنید که در قسمت مشخص شده است. آموزش در GitHub. ایجاد خوشه را می توان با استفاده از ابزارهای استانداردی مانند eksctl و AWS CloudFormation.

یک گروه گره EKS ایجاد کنید

در مرحله بعد، باید یک گروه گره EKS حاوی دو یا چند نمونه trn1.32xlarge در منطقه پشتیبانی شده ایجاد کنیم. در آموزش، AWS CloudFormation برای ایجاد یک الگوی راه اندازی EC2 مخصوص Trainium استفاده می شود، که تضمین می کند نمونه های Trn1 با تصویر ماشین آمازون مناسب (AMI) و پیکربندی صحیح شبکه EFA مورد نیاز برای پشتیبانی از آموزش توزیع شده راه اندازی می شوند. AMI همچنین شامل درایور دستگاه Neuron است که از تراشه های شتاب دهنده Trainium پشتیبانی می کند. با eksctl ابزار مدیریت آمازون EKS، میتوانید به راحتی یک گروه گره Trainium با استفاده از یک مانیفست اصلی YAML ایجاد کنید که به الگوی راهاندازی تازه ایجاد شده ارجاع میدهد. مثلا:

در مانیفست قبلی، چندین ویژگی پیکربندی شده اند تا امکان استفاده از نمونه های Trn1 در خوشه EKS را فراهم کنند. اولین، metadata.region روی یکی از مناطقی تنظیم شده است که از نمونه های Trn1 پشتیبانی می کند (در حال حاضر us-east-1 و us-west-2). در مرحله بعد، برای در دسترس بودن مناطق، آمازون EKS نیاز دارد که دو منطقه دسترسی مشخص شود. یکی از این مناطق دسترسی باید از استفاده از نمونه های Trn1 پشتیبانی کند، در حالی که دیگری می تواند به صورت تصادفی انتخاب شود. آموزش نشان می دهد که چگونه تعیین کنید که کدام مناطق دسترسی به موارد Trn1 در حساب AWS شما اجازه می دهد. همان منطقه در دسترس بودن پشتیبان Trn1 نیز باید با استفاده از آن مشخص شود availabiltyZones ویژگی مرتبط با گروه گره EKS. efaEnabled تنظیم شده است true برای پیکربندی گره ها با پیکربندی شبکه EFA مناسب که برای آموزش توزیع شده مورد نیاز است. در نهایت، launchTemplate.id ویژگی مرتبط با گروه گره به الگوی راه اندازی EC2 که از طریق AWS CloudFormation در مرحله قبلی ایجاد شده است اشاره می کند.

با فرض اینکه قبلاً قالب CloudFormation را اعمال کرده اید و آن را نصب کرده اید eksctl ابزار مدیریت، می توانید با اجرای کد زیر یک گروه گره EKS با قابلیت Trainium ایجاد کنید:

پلاگین های Kubernetes را برای دستگاه های Trainium و EFA نصب کنید

با وجود گروه گره، گام بعدی نصب پلاگین های Kubernetes است که از شتاب دهنده های Trainium (از طریق پلاگین Neuron) و دستگاه های EFA (از طریق پلاگین EFA) پشتیبانی می کنند. این افزونه ها را می توان به راحتی با استفاده از استاندارد بر روی کلاستر نصب کرد kubectl ابزار مدیریت همانطور که در آموزش نشان داده شده است.

برای استفاده از پرتاب کننده PyTorch جهانی TorchX برای راه اندازی مشاغل آموزشی توزیع شده، دو پیش نیاز لازم است: زمانبندی دسته ای Volcano و سرور etcd. بسیار شبیه پلاگین های Neuron و EFA، ما می توانیم از آن استفاده کنیم kubectl ابزاری برای نصب Volcano و سرور etcd روی خوشه EKS.

فضای ذخیرهسازی مشترک را به خوشه EKS وصل کنید

در این آموزش، از FSx for Luster برای ارائه یک سیستم فایل مشترک با کارایی بالا استفاده می شود که می تواند توسط EKS Worker pods های مختلف قابل دسترسی باشد. این ذخیره سازی مشترک برای میزبانی از مجموعه داده های آموزشی و همچنین هرگونه مصنوع و گزارش ایجاد شده در طول فرآیند آموزش استفاده می شود. این آموزش نحوه ایجاد و پیوست کردن فضای ذخیرهسازی مشترک به خوشه را با استفاده از درایور آمازون FSx برای Luster CSI.

یک تصویر ظرف آموزشی ایجاد کنید

در مرحله بعد، باید یک تصویر محفظه آموزشی ایجاد کنیم که شامل اسکریپت آموزشی PyTorch به همراه هر وابستگی باشد. یک نمونه Dockerfile در این آموزش گنجانده شده است که اسکریپت پیشآموزشی BERT را به همراه وابستگیهای نرمافزاری آن در خود جای داده است. از Dockerfile برای ساختن تصویر کانتینر آموزشی استفاده میشود، و سپس تصویر به یک مخزن ECR هدایت میشود که کارگران PyTorch میتوانند از آن تصویر را هنگامی که یک کار آموزشی در خوشه راهاندازی میشود بیرون بکشند.

داده های آموزشی را تنظیم کنید

قبل از راه اندازی یک کار آموزشی، داده های آموزشی ابتدا در حجم ذخیره سازی مشترک در FSx برای Lustre کپی می شوند. این آموزش نحوه ایجاد یک پاد موقت Kubernetes را که به حجم ذخیره سازی مشترک دسترسی دارد، تشریح می کند و نحوه ورود به پاد را برای دانلود و استخراج مجموعه داده آموزشی با استفاده از دستورات پوسته استاندارد لینوکس نشان می دهد.

با وجود زیرساخت ها و پیش نیازهای نرم افزاری مختلف، اکنون می توانیم روی جنبه های Trainium راه حل تمرکز کنیم.

مدل خود را از قبل کامپایل کنید

Neuron SDK از PyTorch از طریق یک لایه ادغام به نام پشتیبانی می کند PyTorch Neuron. بهطور پیشفرض، PyTorch Neuron با کامپایلسازی بهموقع کار میکند، جایی که نمودارهای محاسباتی شبکه عصبی مختلف در یک کار آموزشی، همانطور که در طول فرآیند آموزش با آنها مواجه میشوند، کامپایل میشوند. برای مدل های بزرگتر، استفاده از مدل ارائه شده راحت تر است neuron_parallel_compile ابزاری برای از پیش کامپایل و کش کردن نمودارهای محاسباتی مختلف از قبل به طوری که از جمع آوری نمودار در زمان آموزش جلوگیری شود. قبل از راهاندازی کار آموزشی در کلاستر EKS، این آموزش نشان میدهد که چگونه ابتدا یک کار پیشکامپایل را از طریق TorchX با استفاده از neuron_parallel_compile ابزار پس از اتمام کار پیشکامپایل، کامپایلر Neuron تمام نمودارهای محاسباتی شبکه عصبی را شناسایی و کامپایل میکند، و آنها را در حافظه ذخیرهسازی مشترک ذخیره میکند تا بعداً در طول کار پیشآموزشی BERT واقعی استفاده شود.

کار آموزشی توزیع شده را راه اندازی کنید

پس از تکمیل پیشکامپایل، TorchX برای راهاندازی یک کار آموزشی توزیع شده با 64 کارگر در دو نمونه trn1.32x بزرگ، با 32 کارگر در هر نمونه استفاده میشود. ما در هر نمونه از 32 کارگر استفاده می کنیم زیرا هر نمونه trn1.32xlarge شامل 16 شتاب دهنده Trainium است که هر شتاب دهنده 2 شتاب دهنده دارد. هسته های عصبی. هر NeuronCore را می توان به عنوان یک منحصر به فرد در دسترس قرار داد دستگاه PyTorch XLA در فیلمنامه آموزشی یک مثال دستور راه اندازی TorchX از آموزش شبیه کد زیر است:

آرگومان های مختلف خط فرمان در دستور قبلی TorchX به تفصیل در آموزش توضیح داده شده است. با این حال، آرگومان های زیر در پیکربندی کار آموزشی مهم ترین هستند:

- -cfg queue=test - صف آتشفشان را برای استفاده در کار آموزشی مشخص می کند

- -cfg image_repo - مخزن ECR را برای استفاده برای تصاویر ظرف TorchX مشخص می کند

- –script_args – هر گونه آرگومان را که باید به اسکریپت آموزشی PyTorch ارسال شود را مشخص می کند

- –nnodes و –nproc_per_node - تعداد نمونه ها و کارگران در هر نمونه که برای کار آموزشی استفاده می شود

- –نویس – نام اسکریپت آموزشی PyTorch برای راه اندازی در کانتینر آموزشی

- –تصویر – مسیر تصویر ظرف آموزشی در آمازون ECR

- –bf16 – فعال کردن نوع داده BF16 یا خیر

نظارت بر کار آموزشی

پس از راهاندازی شغل آموزشی، راههای مختلفی وجود دارد که میتوان از طریق آن کار را نظارت کرد. این آموزش نحوه نظارت بر معیارهای اسکریپت آموزشی پایه را در خط فرمان با استفاده از آن نشان می دهد kubectl، نحوه نظارت بصری پیشرفت اسکریپت آموزشی در TensorBoard (به تصویر زیر مراجعه کنید) و نحوه نظارت بر استفاده از شتاب دهنده Trainium با استفاده از neuron-top ابزاری از Neuron SDK.

محیط را تمیز کنید یا دوباره از آن استفاده کنید

هنگامی که کار آموزشی کامل شد، خوشه را می توان مجدداً مورد استفاده قرار داد یا مجدداً برای کارهای آموزشی اضافی پیکربندی کرد. به عنوان مثال، گروه گره EKS را می توان به سرعت با استفاده از مقیاس بزرگ کرد eksctl فرمان به منظور پشتیبانی از مشاغل آموزشی که به نمونه های Trn1 اضافی نیاز دارند. به طور مشابه، دستورات راه اندازی Dockerfile و TorchX ارائه شده را می توان به راحتی تغییر داد تا از مدل های یادگیری عمیق اضافی و توزیع توپولوژی های آموزشی پشتیبانی کند.

اگر کلاستر دیگر مورد نیاز نباشد، آموزش همچنین شامل تمام مراحل مورد نیاز برای حذف زیرساخت EKS و منابع مرتبط است.

نتیجه

در این پست، بررسی کردیم که چگونه نمونههای Trn1 و Amazon EKS یک پلتفرم مدیریت شده برای آموزش توزیعشده با کارایی بالا، مقرونبهصرفه و مقیاسپذیر گسترده مدلهای یادگیری عمیق ارائه میکنند. ما همچنین یک آموزش جامع را به اشتراک گذاشتیم که نشان میدهد چگونه میتوان یک کار آموزشی چند نمونهای در دنیای واقعی را در آمازون EKS با استفاده از نمونههای Trn1 اجرا کرد، و چندین مرحله و مؤلفههای کلیدی در راهحل را برجسته کردیم. این محتوای آموزشی را می توان به راحتی برای مدل ها و بارهای کاری دیگر تطبیق داد و راه حلی اساسی برای آموزش توزیع شده مدل های یادگیری عمیق در AWS در اختیار شما قرار می دهد.

برای کسب اطلاعات بیشتر در مورد نحوه شروع کار با نمونههای Trn1 مجهز به Trainium، به بخش مراجعه کنید مستندات نورون.

درباره نویسنده

اسکات پری یک معمار راه حل در تیم شتاب دهنده Annapurna ML در AWS است. او که در کانادا مستقر است، به مشتریان کمک میکند تا با استفاده از AWS Inferentia و AWS Trainium، آموزشهای یادگیری عمیق و حجمهای کاری استنتاج را گسترش داده و بهینه کنند. علایق او شامل مدل های زبان بزرگ، یادگیری تقویتی عمیق، اینترنت اشیا و ژنومیک است.

اسکات پری یک معمار راه حل در تیم شتاب دهنده Annapurna ML در AWS است. او که در کانادا مستقر است، به مشتریان کمک میکند تا با استفاده از AWS Inferentia و AWS Trainium، آموزشهای یادگیری عمیق و حجمهای کاری استنتاج را گسترش داده و بهینه کنند. علایق او شامل مدل های زبان بزرگ، یادگیری تقویتی عمیق، اینترنت اشیا و ژنومیک است.

لورآ آریزابالاگا یک معمار Solutions است که با بخش عمومی بریتانیا هماهنگ است، جایی که به مشتریان کمک می کند راه حل های ML را با Amazon SageMaker طراحی کنند. او همچنین بخشی از انجمن حوزه فنی است که به شتاب سختافزار اختصاص دارد و به آزمایش و محک زدن بارهای کاری AWS Inferentia و AWS Trainium کمک میکند.

لورآ آریزابالاگا یک معمار Solutions است که با بخش عمومی بریتانیا هماهنگ است، جایی که به مشتریان کمک می کند راه حل های ML را با Amazon SageMaker طراحی کنند. او همچنین بخشی از انجمن حوزه فنی است که به شتاب سختافزار اختصاص دارد و به آزمایش و محک زدن بارهای کاری AWS Inferentia و AWS Trainium کمک میکند.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- پلاتوبلاک چین. Web3 Metaverse Intelligence. دانش تقویت شده دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/scaling-distributed-training-with-aws-trainium-and-amazon-eks/

- 1

- 100

- 11

- 2022

- 2023

- 7

- a

- قادر

- درباره ما

- شتاب دهنده

- شتاب دهنده ها

- دسترسی

- قابل دسترسی است

- دست

- در میان

- فعالانه

- اضافی

- پیشرفت

- پیشرفته

- مزیت - فایده - سود - منفعت

- هم راستا

- معرفی

- قبلا

- هر چند

- آمازون

- آمازون EC2

- آمازون SageMaker

- و

- اعلام

- اعلام کرد

- خبر

- اعمال می شود

- مناسب

- معماری

- استدلال

- جنبه

- مرتبط است

- ضمیمه کردن

- خواص

- دسترس پذیری

- در دسترس

- AWS

- AWS CloudFormation

- استنتاج AWS

- پهنای باند

- مستقر

- اساسی

- زیرا

- قبل از

- معیار

- مزایای

- بیلیون

- شکوفه

- پهن

- ساختن

- مخزن

- نام

- Canada

- چیپس

- را انتخاب کنید

- برگزیده

- ابر

- خوشه

- رمز

- Collective - Dubai Hills Estate

- آینده

- به زودی

- مشترک

- انجمن

- کامل

- اتمام

- اجزاء

- جامع

- محاسبه

- پیکر بندی

- متصل

- شامل

- ظرف

- ظروف

- شامل

- محتوا

- کنترل

- مناسب

- هسته

- مقرون به صرفه

- ایجاد

- ایجاد شده

- ایجاد

- ایجاد

- CSI

- در حال حاضر

- مشتریان

- داده ها

- DDP

- اختصاصی

- عمیق

- یادگیری عمیق

- به طور پیش فرض

- گسترش

- مستقر

- شرح داده شده

- طرح

- جزئیات

- دقیق

- تحولات

- دستگاه

- دستگاه ها

- مستقیما

- کشف

- توزیع شده

- آموزش توزیع شده

- توزیع

- دانلود

- راننده

- در طی

- هر

- پیش از آن

- در اوایل

- راحتی در استفاده

- به آسانی

- هر دو

- قادر ساختن

- پشت سر هم

- نقطه پایانی

- تضمین می کند

- سرمایه گذاری

- حتی

- مثال

- برانگیخته

- به استثنای

- وجود دارد

- کشف

- عصاره

- پارچه

- آشنایی

- رشته

- پرونده

- نام خانوادگی

- انعطاف پذیری

- تمرکز

- به دنبال

- پیروی

- چارچوب

- از جانب

- کامل

- قابلیت

- سوالات عمومی

- ژنومیک

- دریافت کنید

- GitHub

- داده

- گراف

- نمودار ها

- گروه

- راهنما

- دستگیره

- سخت افزار

- قلب

- مفید

- کمک می کند

- زیاد

- عملکرد بالا

- برجسته

- خیلی

- میزبان

- چگونه

- چگونه

- اما

- HTML

- HTTPS

- صدها نفر

- ID

- شناسایی

- تصویر

- تصاویر

- ضمنی

- مهم

- in

- شامل

- مشمول

- شامل

- افزایش

- به طور فزاینده

- شالوده

- نصب

- نصب شده

- نمونه

- ادغام

- منافع

- اینترنت اشیا

- IT

- کار

- شغل ها

- کلید

- نوع

- زبان

- بزرگ

- در مقیاس بزرگ

- بزرگتر

- دیر

- راه اندازی

- راه اندازی

- راه اندازی

- لایه

- یاد گرفتن

- یادگیری

- رهبری

- کتابخانه ها

- لاین

- لینوکس

- بار

- دیگر

- نگاه کنيد

- مطالب

- دستگاه

- فراگیری ماشین

- اصلی

- اداره می شود

- مدیریت

- انبوه

- حافظه

- متاداده

- متریک

- ML

- مدل

- اصلاح شده

- ماژول ها

- مانیتور

- نظارت

- نظارت بر

- مانیتور

- ماه

- بیش

- اکثر

- چندگانه

- نام

- نیاز

- شبکه

- شبکه

- شبکه های عصبی

- بعد

- گره

- گره

- عدد

- ارائه شده

- ارائه

- رسمی

- ONE

- عمل می کند

- عملیات

- بهینه سازی

- بهینه

- تنظیم و ارکستراسیون

- سفارش

- دیگر

- مشخص شده

- نمای کلی

- به طور کلی

- مروری

- پارامترهای

- بخش

- گذشت

- مسیر

- همکار

- کارایی

- فاز

- محل

- سکو

- افلاطون

- هوش داده افلاطون

- PlatoData

- پلاگین

- پلاگین ها

- نقطه

- پست

- صفحه اصلی

- قوی

- پیش نیازها

- روند

- پیشرفت

- ارائه

- ارائه

- فراهم می کند

- ارائه

- عمومی

- انتشار

- تحت فشار قرار دادند

- مارماهی

- به سرعت

- تصادفی

- دنیای واقعی

- منابع

- منطقه

- مناطق

- مربوط

- برداشتن

- مخزن

- نیاز

- ضروری

- نیاز

- منابع

- این فایل نقد می نویسید:

- دویدن

- در حال اجرا

- حکیم ساز

- همان

- مقیاس پذیری

- مقیاس پذیر

- مقیاس ها

- مقیاس گذاری

- sdk

- بخش

- سرویس

- خدمات

- تنظیم

- چند

- به اشتراک گذاشته شده

- صدف

- باید

- نشان داده شده

- نشان می دهد

- قابل توجه

- به طور مشابه

- اندازه

- کوچکتر

- So

- نرم افزار

- راه حل

- مزایا

- برخی از

- مشخص شده

- پشته

- مستقل

- استاندارد

- آغاز شده

- شروع

- گام

- مراحل

- هنوز

- ذخیره سازی

- opbevare

- چنین

- پشتیبانی

- پشتیبانی

- پشتیبانی از

- هماهنگ سازی

- سیستم

- جدول

- مصرف

- تیم

- فنی

- قالب

- موقت

- تست

- La

- انگلستان

- شان

- هزاران نفر

- از طریق

- سراسر

- زمان

- به

- ابزار

- ابزار

- آموزش

- درست

- آموزش

- Uk

- منحصر به فرد

- جهانی

- استفاده کنید

- کاربر

- مختلف

- نسخه

- از طريق

- حجم

- راه

- هفته

- چه

- که

- در حین

- اراده

- در داخل

- کارگر

- کارگران

- خواهد بود

- یامل

- شما

- شما

- زفیرنت

- مناطق