باغ وحش دیجیتال خدمات رسانه ای و محلی سازی سرتاسری را برای تطبیق محتوای اصلی تلویزیون و فیلم با زبان ها، مناطق و فرهنگ های مختلف ارائه می دهد. جهانی شدن را برای بهترین تولیدکنندگان محتوا آسان تر می کند. ZOO Digital که مورد اعتماد بزرگترین نامهای سرگرمی است، خدمات بومیسازی و رسانهای با کیفیت بالا را در مقیاس، از جمله دوبله، زیرنویس، اسکریپتنویسی و سازگاری ارائه میکند.

گردشهای کاری محلیسازی معمولی نیاز به تنظیم دستی بلندگو دارند، که در آن یک جریان صوتی بر اساس هویت بلندگو تقسیمبندی میشود. این فرآیند زمانبر باید قبل از دوبله شدن محتوا به زبان دیگری تکمیل شود. با روشهای دستی، محلیسازی یک قسمت 30 دقیقهای بین 1 تا 3 ساعت طول میکشد. از طریق اتوماسیون، ZOO Digital قصد دارد در کمتر از 30 دقیقه به محلی سازی دست یابد.

در این پست، ما در مورد استقرار مدلهای یادگیری ماشینی مقیاسپذیر (ML) برای دیاری کردن محتوای رسانهای با استفاده از آن بحث میکنیم آمازون SageMaker، با تمرکز بر روی WhisperX مدل.

زمینه

چشم انداز ZOO Digital ارائه یک چرخش سریعتر از محتوای محلی است. این هدف به دلیل ماهیت فشرده دستی تمرین که با نیروی کار کوچک افراد ماهر که می توانند محتوا را به صورت دستی بومی سازی کنند، در تنگنا قرار می گیرد. ZOO Digital با بیش از 11,000 فریلنسر کار می کند و تنها در سال 600 بیش از 2022 میلیون کلمه را بومی سازی کرده است. با این حال، عرضه افراد ماهر به دلیل تقاضای فزاینده برای محتوا پیشی گرفته است و به اتوماسیون برای کمک به گردشهای کاری بومیسازی نیاز دارد.

با هدف تسریع در محلیسازی جریانهای کاری محتوا از طریق یادگیری ماشینی، ZOO Digital Prototyping AWS را درگیر کرد، یک برنامه سرمایهگذاری توسط AWS برای ایجاد بار کاری مشترک با مشتریان. این تعامل بر ارائه یک راه حل کاربردی برای فرآیند بومی سازی متمرکز بود، در حالی که آموزش عملی به توسعه دهندگان ZOO Digital در SageMaker ارائه می داد. آمازون رونوشتو ترجمه آمازون.

چالش مشتری

پس از رونویسی یک عنوان (فیلم یا قسمتی از یک سریال تلویزیونی)، گویندگان باید به هر بخش از گفتار اختصاص داده شوند تا بتوان آنها را به درستی به صداپیشگانی که برای بازی شخصیت ها انتخاب شده اند، اختصاص داد. به این فرآیند دیاریزاسیون گوینده می گویند. ZOO Digital در عین حال که از نظر اقتصادی مقرون به صرفه است، با چالش دیارینگ محتوا در مقیاس مواجه است.

بررسی اجمالی راه حل

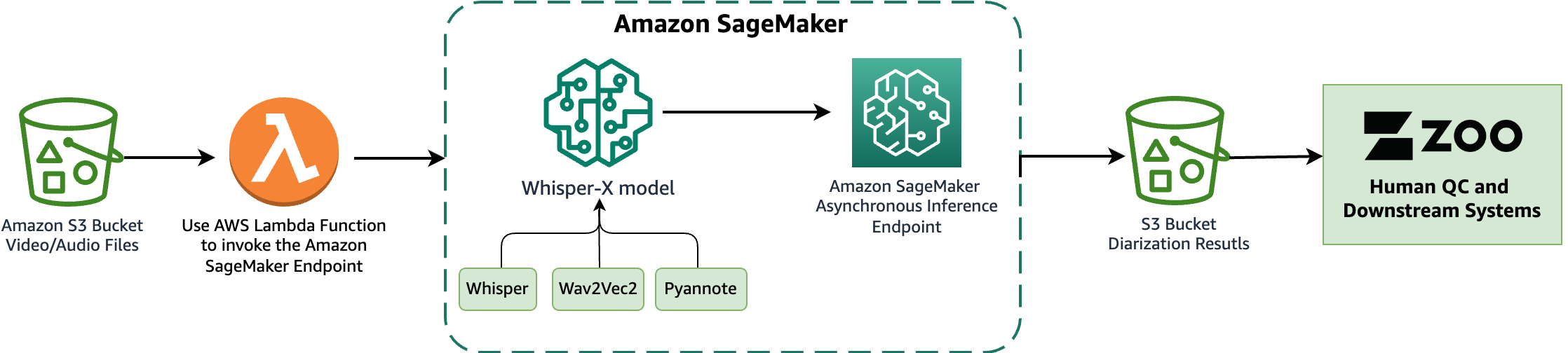

در این نمونه اولیه، ما فایل های رسانه ای اصلی را در یک مکان مشخص ذخیره می کنیم سرویس ذخیره سازی ساده آمازون سطل (Amazon S3). این سطل S3 به گونهای پیکربندی شده است که وقتی فایلهای جدید در آن شناسایی میشوند، رویدادی را منتشر میکند و باعث ایجاد یک AWS لامبدا تابع. برای دستورالعمل های مربوط به پیکربندی این ماشه، به آموزش مراجعه کنید استفاده از تریگر آمازون S3 برای فراخوانی تابع Lambda. متعاقباً، تابع Lambda نقطه پایانی SageMaker را برای استنتاج با استفاده از آن فراخوانی کرد کلاینت Boto3 SageMaker Runtime.

La WhisperX مدل، بر اساس Whisper OpenAI، رونویسی و دیاریزاسیون را برای دارایی های رسانه ای انجام می دهد. این بر اساس ساخته شده است زمزمه سریعتر پیاده سازی مجدد، ارائه رونویسی تا چهار برابر سریعتر با ترازبندی مهر زمانی بهبود یافته در سطح کلمه در مقایسه با Whisper. علاوه بر این، دیاریزاسیون بلندگو را معرفی می کند که در مدل اصلی Whisper وجود ندارد. WhisperX از مدل Whisper برای رونویسی استفاده می کند WAV2VEC2 مدلی برای افزایش تراز مهر زمانی (حصول اطمینان از همگام سازی متن رونویسی شده با مهرهای زمانی صوتی) و پیانوت مدلی برای دیاریزاسیون FFmpeg به برای بارگیری صدا از رسانه منبع، پشتیبانی از انواع مختلف استفاده می شود فرمت های رسانه ای معماری مدل شفاف و مدولار امکان انعطاف پذیری را فراهم می کند، زیرا هر جزء از مدل را می توان در صورت نیاز در آینده تعویض کرد. با این حال، ذکر این نکته ضروری است که WhisperX فاقد ویژگی های مدیریت کامل است و محصولی در سطح سازمانی نیست. بدون نگهداری و پشتیبانی، ممکن است برای استقرار تولید مناسب نباشد.

در این همکاری، WhisperX را در SageMaker با استفاده از یک مستقر و ارزیابی کردیم نقطه پایان استنتاج ناهمزمان برای میزبانی مدل نقاط پایانی ناهمزمان SageMaker از اندازههای آپلود تا 1 گیگابایت پشتیبانی میکنند و ویژگیهای مقیاس خودکار را در خود جای میدهند که به طور کارآمدی افزایش ترافیک را کاهش میدهد و در زمانهای غیر اوج مصرف هزینهها را کاهش میدهد. نقاط پایانی ناهمزمان به ویژه برای پردازش فایلهای بزرگ، مانند فیلمها و سریالهای تلویزیونی مورد استفاده ما، مناسب هستند.

نمودار زیر عناصر اصلی آزمایشهایی را که ما در این همکاری انجام دادیم، نشان میدهد.

در بخشهای بعدی، به جزئیات استقرار مدل WhisperX در SageMaker میپردازیم و عملکرد diarization را ارزیابی میکنیم.

دانلود مدل و اجزای آن

WhisperX سیستمی است که شامل چندین مدل برای رونویسی، هم ترازی اجباری و دیاریزاسیون است. برای عملکرد روان SageMaker بدون نیاز به واکشی مصنوعات مدل در حین استنتاج، لازم است که همه مصنوعات مدل را از قبل دانلود کنید. سپس این مصنوعات در حین شروع در ظرف سرو SageMaker بارگذاری می شوند. از آنجایی که این مدلها مستقیماً در دسترس نیستند، ما توضیحات و کد نمونه را از منبع WhisperX ارائه میکنیم و دستورالعملهایی را برای دانلود مدل و اجزای آن ارائه میکنیم.

WhisperX از شش مدل استفاده می کند:

اکثر این مدل ها را می توان از در آغوش کشیدن صورت با استفاده از کتابخانه huggingface_hub. ما از موارد زیر استفاده می کنیم download_hf_model() عملکرد برای بازیابی این مصنوعات مدل. یک نشانه دسترسی از Hugging Face که پس از پذیرفتن قراردادهای کاربر برای مدلهای pyannote زیر ایجاد شده است، مورد نیاز است:

import huggingface_hub

import yaml

import torchaudio

import urllib.request

import os CONTAINER_MODEL_DIR = "/opt/ml/model"

WHISPERX_MODEL = "guillaumekln/faster-whisper-large-v2"

VAD_MODEL_URL = "https://whisperx.s3.eu-west-2.amazonaws.com/model_weights/segmentation/0b5b3216d60a2d32fc086b47ea8c67589aaeb26b7e07fcbe620d6d0b83e209ea/pytorch_model.bin"

WAV2VEC2_MODEL = "WAV2VEC2_ASR_BASE_960H"

DIARIZATION_MODEL = "pyannote/speaker-diarization" def download_hf_model(model_name: str, hf_token: str, local_model_dir: str) -> str: """ Fetches the provided model from HuggingFace and returns the subdirectory it is downloaded to :param model_name: HuggingFace model name (and an optional version, appended with @[version]) :param hf_token: HuggingFace access token authorized to access the requested model :param local_model_dir: The local directory to download the model to :return: The subdirectory within local_modeL_dir that the model is downloaded to """ model_subdir = model_name.split('@')[0] huggingface_hub.snapshot_download(model_subdir, token=hf_token, local_dir=f"{local_model_dir}/{model_subdir}", local_dir_use_symlinks=False) return model_subdir

مدل VAD از آمازون S3 و مدل Wav2Vec2 از ماژول torchaudio.pipelines بازیابی شده است. بر اساس کد زیر، میتوانیم تمام آرتیفکتهای مدلها، از جمله نمونههایی از Hugging Face را بازیابی کنیم و آنها را در پوشه مدل محلی مشخص شده ذخیره کنیم:

def fetch_models(hf_token: str, local_model_dir="./models"): """ Fetches all required models to run WhisperX locally without downloading models every time :param hf_token: A huggingface access token to download the models :param local_model_dir: The directory to download the models to """ # Fetch Faster Whisper's Large V2 model from HuggingFace download_hf_model(model_name=WHISPERX_MODEL, hf_token=hf_token, local_model_dir=local_model_dir) # Fetch WhisperX's VAD Segmentation model from S3 vad_model_dir = "whisperx/vad" if not os.path.exists(f"{local_model_dir}/{vad_model_dir}"): os.makedirs(f"{local_model_dir}/{vad_model_dir}") urllib.request.urlretrieve(VAD_MODEL_URL, f"{local_model_dir}/{vad_model_dir}/pytorch_model.bin") # Fetch the Wav2Vec2 alignment model torchaudio.pipelines.__dict__[WAV2VEC2_MODEL].get_model(dl_kwargs={"model_dir": f"{local_model_dir}/wav2vec2/"}) # Fetch pyannote's Speaker Diarization model from HuggingFace download_hf_model(model_name=DIARIZATION_MODEL, hf_token=hf_token, local_model_dir=local_model_dir) # Read in the Speaker Diarization model config to fetch models and update with their local paths with open(f"{local_model_dir}/{DIARIZATION_MODEL}/config.yaml", 'r') as file: diarization_config = yaml.safe_load(file) embedding_model = diarization_config['pipeline']['params']['embedding'] embedding_model_dir = download_hf_model(model_name=embedding_model, hf_token=hf_token, local_model_dir=local_model_dir) diarization_config['pipeline']['params']['embedding'] = f"{CONTAINER_MODEL_DIR}/{embedding_model_dir}" segmentation_model = diarization_config['pipeline']['params']['segmentation'] segmentation_model_dir = download_hf_model(model_name=segmentation_model, hf_token=hf_token, local_model_dir=local_model_dir) diarization_config['pipeline']['params']['segmentation'] = f"{CONTAINER_MODEL_DIR}/{segmentation_model_dir}/pytorch_model.bin" with open(f"{local_model_dir}/{DIARIZATION_MODEL}/config.yaml", 'w') as file: yaml.safe_dump(diarization_config, file) # Read in the Speaker Embedding model config to update it with its local path speechbrain_hyperparams_path = f"{local_model_dir}/{embedding_model_dir}/hyperparams.yaml" with open(speechbrain_hyperparams_path, 'r') as file: speechbrain_hyperparams = file.read() speechbrain_hyperparams = speechbrain_hyperparams.replace(embedding_model_dir, f"{CONTAINER_MODEL_DIR}/{embedding_model_dir}") with open(speechbrain_hyperparams_path, 'w') as file: file.write(speechbrain_hyperparams)

ظرف مناسب یادگیری عمیق AWS را برای ارائه مدل انتخاب کنید

پس از اینکه مصنوعات مدل با استفاده از کد نمونه قبلی ذخیره شدند، می توانید از پیش ساخته شده را انتخاب کنید ظروف یادگیری عمیق AWS (DLC) از موارد زیر GitHub repo. هنگام انتخاب تصویر Docker، تنظیمات زیر را در نظر بگیرید: چارچوب (Hugging Face)، وظیفه (استنتاج)، نسخه Python و سخت افزار (به عنوان مثال، GPU). توصیه می کنیم از تصویر زیر استفاده کنید: 763104351884.dkr.ecr.[REGION].amazonaws.com/huggingface-pytorch-inference:2.0.0-transformers4.28.1-gpu-py310-cu118-ubuntu20.04 این تصویر دارای تمام بسته های سیستمی لازم مانند ffmpeg از پیش نصب شده است. به یاد داشته باشید که [REGION] را با منطقه AWS که استفاده می کنید جایگزین کنید.

برای سایر بسته های پایتون مورد نیاز، a را ایجاد کنید requirements.txt فایل با لیستی از بسته ها و نسخه های آنها. این بسته ها زمانی نصب می شوند که DLC AWS ساخته شود. در زیر بسته های اضافی مورد نیاز برای میزبانی مدل WhisperX در SageMaker آمده است:

یک اسکریپت استنتاج برای بارگذاری مدل ها و اجرای استنتاج ایجاد کنید

بعد، یک سفارشی ایجاد می کنیم inference.py اسکریپتی برای تشریح نحوه بارگذاری مدل WhisperX و اجزای آن در ظرف و نحوه اجرای فرآیند استنتاج. اسکریپت شامل دو عملکرد است: model_fn و transform_fn. model_fn تابع برای بارگذاری مدل ها از مکان های مربوطه فراخوانی می شود. پس از آن، این مدل ها به transform_fn عملکرد در طول استنتاج، که در آن رونویسی، تراز، و فرآیندهای diarization انجام می شود. در زیر یک نمونه کد برای inference.py:

import io

import json

import logging

import tempfile

import time import torch

import whisperx DEVICE = 'cuda' if torch.cuda.is_available() else 'cpu' def model_fn(model_dir: str) -> dict: """ Deserialize and return the models """ logging.info("Loading WhisperX model") model = whisperx.load_model(whisper_arch=f"{model_dir}/guillaumekln/faster-whisper-large-v2", device=DEVICE, language="en", compute_type="float16", vad_options={'model_fp': f"{model_dir}/whisperx/vad/pytorch_model.bin"}) logging.info("Loading alignment model") align_model, metadata = whisperx.load_align_model(language_code="en", device=DEVICE, model_name="WAV2VEC2_ASR_BASE_960H", model_dir=f"{model_dir}/wav2vec2") logging.info("Loading diarization model") diarization_model = whisperx.DiarizationPipeline(model_name=f"{model_dir}/pyannote/speaker-diarization/config.yaml", device=DEVICE) return { 'model': model, 'align_model': align_model, 'metadata': metadata, 'diarization_model': diarization_model } def transform_fn(model: dict, request_body: bytes, request_content_type: str, response_content_type="application/json") -> (str, str): """ Load in audio from the request, transcribe and diarize, and return JSON output """ # Start a timer so that we can log how long inference takes start_time = time.time() # Unpack the models whisperx_model = model['model'] align_model = model['align_model'] metadata = model['metadata'] diarization_model = model['diarization_model'] # Load the media file (the request_body as bytes) into a temporary file, then use WhisperX to load the audio from it logging.info("Loading audio") with io.BytesIO(request_body) as file: tfile = tempfile.NamedTemporaryFile(delete=False) tfile.write(file.read()) audio = whisperx.load_audio(tfile.name) # Run transcription logging.info("Transcribing audio") result = whisperx_model.transcribe(audio, batch_size=16) # Align the outputs for better timings logging.info("Aligning outputs") result = whisperx.align(result["segments"], align_model, metadata, audio, DEVICE, return_char_alignments=False) # Run diarization logging.info("Running diarization") diarize_segments = diarization_model(audio) result = whisperx.assign_word_speakers(diarize_segments, result) # Calculate the time it took to perform the transcription and diarization end_time = time.time() elapsed_time = end_time - start_time logging.info(f"Transcription and Diarization took {int(elapsed_time)} seconds") # Return the results to be stored in S3 return json.dumps(result), response_content_type

در دایرکتوری مدل، در کنار requirements.txt فایل، از وجود آن اطمینان حاصل کنید inference.py در یک زیر شاخه کد این models دایرکتوری باید شبیه موارد زیر باشد:

یک تاربال از مدل ها ایجاد کنید

پس از ایجاد مدلها و دایرکتوریهای کد، میتوانید از خطوط فرمان زیر برای فشردهسازی مدل به یک tarball (فایل tar.gz) و آپلود آن در Amazon S3 استفاده کنید. در زمان نگارش مقاله، با استفاده از مدل V2 بزرگ با زمزمه سریعتر، تاربال حاصل که مدل SageMaker را نشان میدهد، 3 گیگابایت حجم دارد. برای اطلاعات بیشتر مراجعه کنید الگوهای میزبانی مدل در آمازون SageMaker، قسمت 2: شروع به کار با استقرار مدل های زمان واقعی در SageMaker.

یک مدل SageMaker ایجاد کنید و یک نقطه پایانی را با یک پیش بینی ناهمزمان مستقر کنید

اکنون می توانید مدل SageMaker، پیکربندی نقطه پایانی و نقطه پایانی ناهمزمان را با آن ایجاد کنید AsyncPredictor با استفاده از مدل تربال ایجاد شده در مرحله قبل. برای دستورالعمل، مراجعه کنید یک نقطه پایانی استنتاج ناهمزمان ایجاد کنید.

ارزیابی عملکرد دیاریزاسیون

برای ارزیابی عملکرد diarization مدل WhisperX در سناریوهای مختلف، ما سه قسمت را از بین دو عنوان انگلیسی انتخاب کردیم: یک عنوان درام شامل قسمتهای 30 دقیقهای و یک عنوان مستند شامل قسمتهای 45 دقیقهای. ما از جعبه ابزار متریک pyannote استفاده کردیم، pyannote.metrics، برای محاسبه میزان خطای دیاریزاسیون (DER). در ارزیابی، رونوشتهای رونویسیشده و روزانهشده ارائهشده توسط ZOO به عنوان حقیقت اصلی عمل کردند.

ما DER را به صورت زیر تعریف کردیم:

جمع طول ویدئو حقیقت زمین است. FA (False Alarm) طول بخش هایی است که در پیش بینی ها به عنوان گفتار در نظر گرفته می شود، اما در حقیقت زمینی نیست. از دست دادن طول بخش هایی است که در حقیقت زمینی به عنوان گفتار در نظر گرفته می شود، اما در پیش بینی نیست. خطانیز نامیده می شود گیجی، طول بخش هایی است که در پیش بینی و حقیقت زمینه به گویندگان مختلف اختصاص داده می شود. تمام واحدها در ثانیه اندازه گیری می شوند. مقادیر معمولی برای DER می تواند بسته به کاربرد خاص، مجموعه داده و کیفیت سیستم دیاریزاسیون متفاوت باشد. توجه داشته باشید که DER می تواند بزرگتر از 1.0 باشد. DER کمتر بهتر است.

برای اینکه بتوانیم DER را برای یک قطعه رسانه محاسبه کنیم، یک دیاریزاسیون حقیقت زمین و همچنین خروجی های WhisperX رونویسی و دیاری شده مورد نیاز است. اینها باید تجزیه شوند و منجر به فهرستی از تاپل ها شوند که حاوی برچسب بلندگو، زمان شروع بخش گفتار و زمان پایان بخش گفتار برای هر بخش از گفتار در رسانه باشد. برچسبهای بلندگو نیازی به مطابقت بین WhisperX و Diarizations حقیقت زمینی ندارند. نتایج بیشتر بر اساس زمان بخش ها است. pyannote.metrics این چند تا از دیاریزاسیون های حقیقت پایه و دیاریزاسیون های خروجی را می گیرد (که در اسناد pyannote.metrics به آن اشاره می شود مرجع و فرضیه) برای محاسبه DER. جدول زیر نتایج ما را خلاصه می کند.

| نوع فیلم | از | درست | از دست دادن | خطا | هشدار غلط |

| درام | 0.738 | ٪۱۰۰ | ٪۱۰۰ | ٪۱۰۰ | ٪۱۰۰ |

| مستند | 1.29 | ٪۱۰۰ | ٪۱۰۰ | ٪۱۰۰ | ٪۱۰۰ |

| میانگین | 0.901 | ٪۱۰۰ | ٪۱۰۰ | ٪۱۰۰ | ٪۱۰۰ |

این نتایج تفاوت عملکرد قابل توجهی را بین عناوین درام و مستند نشان میدهد، با این مدل که به نتایج قابلتوجهی بهتر (با استفاده از DER به عنوان معیار مجموع) برای قسمتهای درام در مقایسه با عنوان مستند دست مییابد. تجزیه و تحلیل دقیقتر عناوین بینشهایی را در مورد عوامل بالقوه مؤثر در این شکاف عملکرد ارائه میکند. یکی از عوامل کلیدی میتواند حضور مکرر موسیقی پسزمینه با گفتار در عنوان مستند باشد. اگرچه پیش پردازش رسانه برای افزایش دقت دیاریزاسیون، مانند حذف نویز پسزمینه برای جداسازی گفتار، فراتر از محدوده این نمونه اولیه بود، اما راههایی را برای کارهای آینده باز میکند که به طور بالقوه میتواند عملکرد WhisperX را افزایش دهد.

نتیجه

در این پست، مشارکت مشترک بین AWS و ZOO Digital را بررسی کردیم، با استفاده از تکنیکهای یادگیری ماشین با SageMaker و مدل WhisperX برای افزایش گردش کار diarization. تیم AWS نقشی اساسی در کمک به ZOO در نمونهسازی، ارزیابی و درک استقرار موثر مدلهای ML سفارشی، که مخصوصاً برای دیاریزاسیون طراحی شدهاند، ایفا کرد. این شامل ترکیب مقیاس خودکار برای مقیاس پذیری با استفاده از SageMaker بود.

استفاده از هوش مصنوعی برای diarization منجر به صرفه جویی قابل توجهی در هزینه و زمان هنگام تولید محتوای محلی برای باغ وحش می شود. این فناوری با کمک به رونویسکنندگان در ایجاد و شناسایی سریع و دقیق بلندگوها، به ماهیت سنتی زمانبر و مستعد خطای کار میپردازد. فرآیند مرسوم اغلب شامل چندین گذر از طریق ویدئو و مراحل کنترل کیفیت اضافی برای به حداقل رساندن خطاها است. اتخاذ AI برای diarization رویکرد هدفمندتر و کارآمدتر را امکان پذیر می کند، در نتیجه بهره وری را در یک بازه زمانی کوتاه تر افزایش می دهد.

ما مراحل کلیدی را برای استقرار مدل WhisperX در نقطه پایانی ناهمزمان SageMaker بیان کردهایم و شما را تشویق میکنیم خودتان آن را با استفاده از کد ارائه شده امتحان کنید. برای اطلاعات بیشتر در مورد خدمات و فناوری ZOO Digital، مراجعه کنید سایت رسمی ZOO Digital. برای جزئیات در مورد استقرار مدل OpenAI Whisper در SageMaker و گزینههای مختلف استنتاج، مراجعه کنید میزبانی مدل Whisper در Amazon SageMaker: کاوش گزینههای استنتاج. با خیال راحت نظرات خود را در نظرات به اشتراک بگذارید.

درباره نویسنده

یانگ هو، دکترا، یک معمار نمونه سازی یادگیری ماشین در AWS است. زمینه های اصلی مورد علاقه او شامل یادگیری عمیق، با تمرکز بر GenAI، Computer Vision، NLP، و پیش بینی داده های سری زمانی است. او در اوقات فراغت خود از گذراندن لحظات با کیفیت با خانواده، غرق شدن در رمان ها و پیاده روی در پارک های ملی بریتانیا لذت می برد.

یانگ هو، دکترا، یک معمار نمونه سازی یادگیری ماشین در AWS است. زمینه های اصلی مورد علاقه او شامل یادگیری عمیق، با تمرکز بر GenAI، Computer Vision، NLP، و پیش بینی داده های سری زمانی است. او در اوقات فراغت خود از گذراندن لحظات با کیفیت با خانواده، غرق شدن در رمان ها و پیاده روی در پارک های ملی بریتانیا لذت می برد.

اتان کامبرلند مهندس تحقیقات هوش مصنوعی در ZOO Digital است که در آنجا روی استفاده از هوش مصنوعی و یادگیری ماشین به عنوان فناوری های کمکی برای بهبود گردش کار در گفتار، زبان و بومی سازی کار می کند. او سابقه ای در مهندسی نرم افزار و تحقیق در حوزه امنیت و پلیس دارد، با تمرکز بر استخراج اطلاعات ساختاریافته از وب و استفاده از مدل های متن باز ML برای تجزیه و تحلیل و غنی سازی داده های جمع آوری شده.

اتان کامبرلند مهندس تحقیقات هوش مصنوعی در ZOO Digital است که در آنجا روی استفاده از هوش مصنوعی و یادگیری ماشین به عنوان فناوری های کمکی برای بهبود گردش کار در گفتار، زبان و بومی سازی کار می کند. او سابقه ای در مهندسی نرم افزار و تحقیق در حوزه امنیت و پلیس دارد، با تمرکز بر استخراج اطلاعات ساختاریافته از وب و استفاده از مدل های متن باز ML برای تجزیه و تحلیل و غنی سازی داده های جمع آوری شده.

گاوراو کایلا تیم نمونه سازی AWS را برای انگلستان و ایرلند رهبری می کند. تیم او با مشتریان در صنایع مختلف برای ایدهپردازی و توسعه بارهای کاری حیاتی تجاری با دستوری برای تسریع پذیرش خدمات AWS کار میکند.

گاوراو کایلا تیم نمونه سازی AWS را برای انگلستان و ایرلند رهبری می کند. تیم او با مشتریان در صنایع مختلف برای ایدهپردازی و توسعه بارهای کاری حیاتی تجاری با دستوری برای تسریع پذیرش خدمات AWS کار میکند.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- PlatoHealth. هوش بیوتکنولوژی و آزمایشات بالینی. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/streamline-diarization-using-ai-as-an-assistive-technology-zoo-digitals-story/

- : دارد

- :است

- :نه

- :جایی که

- $UP

- 000

- 1

- 10

- 100

- 11

- 140

- 2022

- 220

- 28

- 30

- 350

- 600

- 7

- 8

- a

- قادر

- شتاب دادن

- پذیرش

- دسترسی

- در دسترس

- دقت

- رسیدن

- دستیابی به

- در میان

- وفق دادن

- اضافی

- علاوه بر این

- آدرس

- اتخاذ

- پس از

- تجمیع

- موافقت نامه

- AI

- تحقیق ai

- هدف

- اهداف

- هشدار

- تراز

- تراز کردن

- هم ترازی

- معرفی

- اجازه می دهد تا

- تنها

- در کنار

- همچنین

- هر چند

- آمازون

- آمازون SageMaker

- آمازون خدمات وب

- an

- تجزیه و تحلیل

- تحلیل

- و

- دیگر

- کاربرد

- روش

- مناسب

- معماری

- هستند

- مناطق

- هنرمندان

- AS

- ارزیابی کنید

- دارایی

- اختصاص داده

- همکاری

- کمک کردن

- At

- سمعی

- مجاز

- خودکار

- اتوماسیون

- راه ها

- AWS

- زمینه

- مستقر

- BE

- زیرا

- بوده

- قبل از

- بودن

- بهترین

- بهتر

- میان

- خارج از

- بزرگترین

- BIN

- هر دو

- ساخته

- کسب و کار

- اما

- by

- محاسبه

- نام

- CAN

- مورد

- به چالش

- کاراکتر

- را انتخاب کنید

- نزدیک

- رمز

- همکاری

- مشترک

- نظرات

- مقایسه

- تکمیل شده

- انطباق

- جزء

- اجزاء

- ترکیب شده

- کامپیوتر

- چشم انداز کامپیوتر

- انجام

- پیکربندی

- پیکربندی

- در نظر بگیرید

- در نظر گرفته

- شامل

- ظرف

- شامل

- محتوا

- سازندگان محتوا

- کمک

- کنترل

- معمولی

- هسته

- به درستی

- هزینه

- هزینه

- میتوانست

- ایجاد

- ایجاد شده

- ایجاد

- سازندگان

- بحرانی

- فرهنگ

- سفارشی

- مشتریان

- داده ها

- عمیق

- یادگیری عمیق

- مشخص

- تحویل

- ارائه

- غرق کردن

- تقاضا

- بستگی دارد

- گسترش

- مستقر

- استقرار

- گسترش

- طراحی

- جزئیات

- شناسایی شده

- توسعه دهندگان

- دستگاه

- نمودار

- DICT

- تفاوت

- مختلف

- دیجیتال

- ارقام

- مستقیما

- دایرکتوری

- فهرست راهنما

- بحث و تبادل نظر

- مختلف

- کارگر بارانداز

- مستند

- مستندات

- دامنه

- آیا

- دانلود

- دانلود

- درام

- دوبله شده

- در طی

- هر

- آسان تر

- موثر

- موثر

- موثر

- عناصر

- دیگر

- تعبیه کردن

- استخدام

- را قادر می سازد

- شامل

- تشویق

- پایان

- پشت سر هم

- نقطه پایانی

- مشغول

- نامزدی

- مهندس

- مهندسی

- انگلیسی

- بالا بردن

- غنی سازی

- اطمینان حاصل شود

- حصول اطمینان از

- در سطح سازمانی

- سرگرمی

- قسمت

- خطا

- خطاهای

- ضروری است

- ارزیابی

- ارزیابی

- ارزیابی

- ارزیابی

- واقعه

- هر

- مثال

- ورزش

- آزمایش

- کشف

- بررسی

- چهره

- چهره ها

- عامل

- عوامل

- غلط

- خانواده

- سریعتر

- امکانات

- احساس

- وصله

- پرونده

- فایل ها

- انعطاف پذیری

- تمرکز

- متمرکز شده است

- تمرکز

- پیروی

- به دنبال آن است

- برای

- مجبور

- چهار

- چارچوب

- رایگان

- مکرر

- از جانب

- کامل

- تابع

- تابعی

- توابع

- بیشتر

- آینده

- شکاف

- جنایی

- تولید

- مولد

- گرفتن

- GitHub

- جهانی شدن

- هدف

- GPU

- زمین

- دست

- سخت افزار

- he

- او

- با کیفیت بالا

- خود را

- میزبان

- میزبانی وب

- ساعت ها

- چگونه

- اما

- HTML

- HTTP

- HTTPS

- صورت در آغوش گرفته

- شناسایی

- هویت

- if

- نشان می دهد

- تصویر

- واردات

- بهبود

- بهبود یافته

- in

- مشمول

- شامل

- از جمله

- ترکیب کردن

- گنجاندن

- افزایش

- لوازم

- اطلاعات

- شروع

- بینش

- نصب شده

- دستورالعمل

- علاقه

- به

- معرفی می کند

- سرمایه گذاری

- استناد کرد

- شامل

- ایرلند

- IT

- ITS

- JPG

- json

- کلید

- عامل کلیدی

- برچسب

- برچسب ها

- زبان

- زبان ها

- بزرگ

- بزرگتر

- رهبری

- منجر می شود

- یادگیری

- طول

- بهره برداری

- کتابخانه

- خطوط

- فهرست

- لیست

- بار

- بارگیری

- محلی

- بومی سازی

- به صورت محلی

- مکان

- ورود به سیستم

- ورود به سیستم

- طولانی

- کاهش

- دستگاه

- فراگیری ماشین

- نگهداری

- باعث می شود

- مدیریت

- حکم

- کتابچه راهنمای

- دستی

- مسابقه

- ممکن است..

- رسانه ها

- متاداده

- روش

- متری

- متریک

- میلیون

- به حداقل رساندن

- دقیقه

- کاهش

- ML

- مدل

- مدل

- پیمانهای

- ماژول ها

- لحظه

- بیش

- اغلب

- سینما

- فیلم ها

- چندگانه

- موسیقی

- باید

- نام

- نام

- ملی

- طبیعت

- لازم

- نیاز

- ضروری

- جدید

- nlp

- سر و صدا

- به ویژه

- توجه داشته باشید

- به دست آمده

- of

- ارائه

- ارائه

- رسمی

- غالبا

- on

- ONE

- منبع باز

- OpenAI

- باز می شود

- عمل

- گزینه

- or

- اصلی

- OS

- دیگر

- ما

- خارج

- طرح کلی

- مشخص شده

- تولید

- خروجی

- روی

- بسته

- بخش

- ویژه

- همکاری

- گذشت

- عبور می کند

- مسیر

- راه ها

- الگوهای

- مردم

- انجام

- کارایی

- انجام

- انجام می دهد

- قطعه

- خط لوله

- محوری

- افلاطون

- هوش داده افلاطون

- PlatoData

- بازی

- بازی

- پلیس

- پست

- پتانسیل

- بالقوه

- ماقبل

- دقیقا

- پیش گویی

- پیش بینی

- حضور

- در حال حاضر

- قبلی

- اصلی

- روند

- فرآیندهای

- در حال پردازش

- محصول

- تولید

- بهره وری

- برنامه

- نمونه اولیه

- نمونه سازی

- ارائه

- ارائه

- فراهم می کند

- ارائه

- پــایتــون

- کیفیت

- R

- نرخ

- خواندن

- واقعی

- زمان واقعی

- توصیه

- مراجعه

- اشاره

- منطقه

- مناطق

- به یاد داشته باشید

- از بین بردن

- جایگزین کردن

- نمایندگی

- درخواست

- نیاز

- ضروری

- مورد نیاز

- تحقیق

- قابل احترام

- نتیجه

- نتیجه

- نتایج

- برگشت

- بازده

- فاش کردن

- نقش

- دویدن

- در حال اجرا

- زمان اجرا

- s

- حکیم ساز

- نمونه

- ذخیره

- نگهداری می شود

- پس انداز

- مقیاس پذیری

- مقیاس پذیر

- مقیاس

- مقیاس گذاری

- سناریوها

- حوزه

- خط

- ثانیه

- بخش

- تیم امنیت لاتاری

- بخش

- تقسیم بندی

- بخش ها

- انتخاب شد

- انتخاب

- سلسله

- خدمت کرده است

- خدمات

- خدمت

- تنظیمات

- اشتراک گذاری

- او

- باید

- قابل توجه

- ساده

- شش

- اندازه

- اندازه

- ماهر

- کوچک

- هموار کردن

- So

- نرم افزار

- مهندسی نرم افزار

- راه حل

- منبع

- گوینده

- سخنرانان

- خاص

- به طور خاص

- مشخص شده

- سخنرانی - گفتار

- هزینه

- سنبله ها

- شروع

- آغاز شده

- گام

- مراحل

- ذخیره سازی

- ذخیره شده

- داستان

- جریان

- ساده کردن

- ساخت یافته

- متعاقبا

- قابل توجه

- چنین

- مناسب

- عرضه

- پشتیبانی

- حمایت از

- تعویض شده

- به سرعت

- هماهنگ سازی

- سیستم

- جدول

- گرفتن

- طول می کشد

- هدف قرار

- کار

- تیم

- تکنیک

- فن آوری

- پیشرفته

- موقت

- متن

- نسبت به

- که

- La

- آینده

- انگلستان

- شان

- آنها

- سپس

- در نتیجه

- اینها

- آنها

- این

- کسانی که

- سه

- از طریق

- زمان

- سری زمانی

- زمان بر

- دوره زمانی

- بار

- برچسب زمان

- زمان بندی ها

- عنوان

- عناوین

- به

- رمز

- در زمان

- ابزار

- مشعل

- به طور سنتی

- ترافیک

- آموزش

- شفاف

- ماشه

- راه اندازی

- مورد اعتماد

- حقیقت

- امتحان

- آموزش

- tv

- دو

- نوعی

- Uk

- زیر

- در طول 30

- درک

- واحد

- بروزرسانی

- بر

- استفاده کنید

- مورد استفاده

- استفاده

- کاربر

- استفاده

- با استفاده از

- استفاده

- استفاده می کند

- ارزشها

- مختلف

- متفاوت

- نسخه

- نسخه

- قابل اعتماد

- تصویری

- دید

- بازدید

- صدا

- W

- بود

- we

- وب

- خدمات وب

- خوب

- چه زمانی

- در حین

- نجوا

- اراده

- با

- در داخل

- بدون

- کلمات

- مهاجرت کاری

- گردش کار

- گردش کار

- نیروی کار

- با این نسخهها کار

- جهان

- نوشته

- یامل

- شما

- شما

- خودت

- زفیرنت

- ZOO