- ژانویه 20، 2014

- واسیلیس ورینیوتس

- . 5 نظر

در طبقهبندی متن، انتخاب ویژگی فرآیند انتخاب زیرمجموعه خاصی از عبارات مجموعه آموزشی و استفاده از آنها در الگوریتم طبقهبندی است. فرآیند انتخاب ویژگی قبل از آموزش طبقه بندی کننده انجام می شود.

به روز رسانی: چارچوب یادگیری ماشین Datumbox اکنون منبع باز و رایگان است دانلود. برای مشاهده پیادهسازی روشهای Chi-square و Mutual Information Feature Selection در جاوا، بسته com.datumbox.framework.machinelearning.featureselection را بررسی کنید.

مزیت اصلی استفاده از الگوریتمهای انتخاب ویژگی این واقعیت است که ابعاد دادههای ما را کاهش میدهد، آموزش را سریعتر میکند و میتواند با حذف ویژگیهای نویز، دقت را بهبود بخشد. در نتیجه، انتخاب ویژگی می تواند به ما کمک کند تا از برازش بیش از حد جلوگیری کنیم.

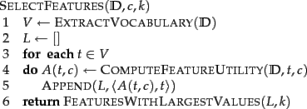

الگوریتم اصلی انتخاب برای انتخاب k بهترین ویژگی در زیر ارائه شده است (منینگ و همکاران، 2008):

در بخشهای بعدی دو الگوریتم انتخاب ویژگی متفاوت ارائه میکنیم: اطلاعات متقابل و مربع چی.

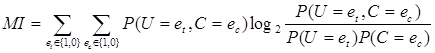

اطلاعات متقابل

یکی از رایج ترین روش های انتخاب ویژگی، اطلاعات متقابل ترم t در کلاس c (منینگ و همکاران، 2008). این اندازه گیری می کند که وجود یا عدم وجود یک اصطلاح خاص چقدر اطلاعاتی را در تصمیم گیری صحیح طبقه بندی در c کمک می کند. اطلاعات متقابل را می توان با استفاده از فرمول زیر محاسبه کرد:

[1]

[1]

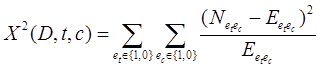

در محاسبات خود، از آنجایی که از تخمین حداکثر احتمالات استفاده می کنیم، می توانیم از معادله زیر استفاده کنیم:

![]() [2]

[2]

جایی که N تعداد کل اسناد است، Ntcتعداد اسنادی هستند که مقادیر e را دارندt (وجود عبارت t در سند؛ مقدار 1 یا 0 را می گیرد) و ec(رویداد سند در کلاس c؛ مقدار 1 یا 0 را می گیرد) که با دو زیرنویس نشان داده شده است، ![]() و

و ![]() . در نهایت باید توجه داشته باشیم که تمامی متغیرهای فوق دارای مقادیر غیر منفی هستند.

. در نهایت باید توجه داشته باشیم که تمامی متغیرهای فوق دارای مقادیر غیر منفی هستند.

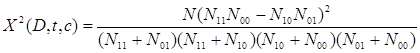

میدان چی

یکی دیگر از روش های رایج انتخاب ویژگی، این است میدان چی. x2 آزمون از جمله در آمار برای آزمایش استقلال دو رویداد استفاده می شود. به طور خاص در انتخاب ویژگی از آن برای آزمایش اینکه آیا وقوع یک عبارت خاص و وقوع یک کلاس خاص مستقل هستند استفاده می کنیم. بنابراین مقدار زیر را برای هر ترم تخمین زده و آنها را بر اساس امتیاز آنها رتبه بندی می کنیم:

[3]

[3]

نمرات بالا در x2 نشان می دهد که فرضیه صفر (H0) استقلال را باید رد کرد و بدین ترتیب وقوع اصطلاح و طبقه وابسته است. اگر آنها وابسته هستند، ویژگی را برای طبقه بندی متن انتخاب می کنیم.

فرمول فوق را می توان به صورت زیر بازنویسی کرد:

[4]

[4]

اگر از روش Chi Square استفاده می کنیم، باید فقط تعدادی از ویژگی های از پیش تعریف شده را انتخاب کنیم که دارای تبر هستند2 نمره آزمون بزرگتر از 10.83 که نشان دهنده معناداری آماری در سطح 0.001 است.

در نهایت باید توجه داشته باشیم که از نظر آماری، انتخاب ویژگی مربع چی نادرست است، به دلیل یک درجه آزادی و تصحیح یتس باید به جای آن استفاده شود (که دستیابی به اهمیت آماری را دشوارتر می کند). بنابراین باید انتظار داشته باشیم که از مجموع ویژگی های انتخاب شده، بخش کوچکی از آنها مستقل از کلاس باشند). بنابراین باید انتظار داشته باشیم که از مجموع ویژگی های انتخاب شده، بخش کوچکی از آنها مستقل از کلاس باشند. با این وجود به عنوان منینگ و همکاران (2008) نشان داد، این ویژگی های نویز به طور جدی بر دقت کلی طبقه بندی کننده ما تأثیر نمی گذارد.

حذف ویژگی های نویز/نادر

روش دیگری که می تواند به ما در جلوگیری از برازش بیش از حد، کاهش مصرف حافظه و بهبود سرعت کمک کند، حذف تمام اصطلاحات نادر از واژگان است. برای مثال، میتوان تمام عباراتی را که فقط یک بار در همه دستهها رخ دادهاند حذف کرد. حذف این عبارات می تواند استفاده از حافظه را به میزان قابل توجهی کاهش دهد و سرعت تجزیه و تحلیل را بهبود بخشد. در نهایت ما نباید این تکنیک را در ارتباط با الگوریتم های انتخاب ویژگی فوق استفاده کنیم.

آیا مقاله را دوست داشتید؟ لطفا یک دقیقه وقت بگذارید و آن را در توییتر به اشتراک بگذارید. 🙂

- AI

- آی هنر

- مولد هنر ai

- ربات ai

- هوش مصنوعی

- گواهی هوش مصنوعی

- ربات هوش مصنوعی

- ربات های هوش مصنوعی

- نرم افزار هوش مصنوعی

- بلاکچین

- کنفرانس بلاک چین ai

- coingenius

- هوش مصنوعی محاوره ای

- کنفرانس کریپتو ai

- دل-ه

- Datumbox

- یادگیری عمیق

- گوگل ai

- فراگیری ماشین

- یادگیری ماشین و آمار

- افلاطون

- افلاطون آی

- هوش داده افلاطون

- بازی افلاطون

- PlatoData

- بازی پلاتو

- مقیاس Ai

- نحو

- زفیرنت