Haitallisen syvän väärennösten luomisen vitsaus on levinnyt kauas julkkisten ja julkisuuden henkilöiden valtakunnan ulkopuolelle, ja uudessa ei-konsensuaalista intiimikuvaa (NCII) koskevassa raportissa havaitaan, että käytäntö vain kasvaa kuvageneraattoreiden kehittyessä ja lisääntyessä.

"AI riisuminen" on nousussa, a raportti sosiaalisen median analytiikkayritys Graphika sanoi perjantaina kuvaillessaan käytäntöä käyttämisenä generatiivinen tekoäly työkalut, jotka on hienosäädetty poistamaan vaatteet käyttäjien lataamista kuvista.

Peli- ja Twitch-suoratoistoyhteisö kamppaili ongelman kanssa aiemmin tänä vuonna, kun kuuluisa lähetystoiminnan harjoittaja Brandon 'Atrioc' Ewing paljasti vahingossa katsoneensa tekoälyn luomaa syvää fake-pornoa naissuorapelaajista, jota hän kutsui ystävikseen. raportti by Kotaku.

Ewing palasi alustalle maaliskuussa katuneena ja kertoen viikkojen työstä, jonka hän oli tehnyt vähentääkseen aiheuttamiaan vahinkoja. Mutta tapaus avasi patruunan koko verkkoyhteisölle.

Graphikan raportin mukaan tapaus oli vain pisara ämpäriin.

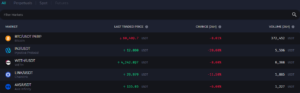

"Käyttäen Meltwaterin toimittamia tietoja mittasimme Redditissä ja X:ssä olevien kommenttien ja viestien määrän, jotka sisältävät viittauslinkkejä 34 verkkosivustolle ja 52 Telegram-kanavalle, jotka tarjoavat synteettisiä NCII-palveluita", Graphikan tiedusteluanalyytikko Santiago Lakatos kirjoitti. "Vuonna 1,280 niitä oli yhteensä 2022 32,100, kun tänä vuonna niitä oli yli 2,408 XNUMX, mikä merkitsee XNUMX XNUMX prosentin volyymin kasvua edellisvuoteen verrattuna."

New Yorkissa toimiva Graphika sanoo, että NCII:n räjähdys osoittaa, että työkalut ovat siirtyneet niche-keskustelupalstalta mökkiteollisuuteen.

"Näiden mallien avulla useat palveluntarjoajat voivat helposti ja halvalla luoda fotorealistisia NCII-tiedostoja mittakaavassa", Graphika sanoi. "Ilman tällaisia palveluntarjoajia heidän asiakkaidensa olisi isännöitävä, ylläpidettävä ja ajettava omia mukautettuja kuvanhajautusmallejaan – aikaa vievä ja joskus kallis prosessi."

Graphika varoittaa, että tekoälyn riisuutumistyökalujen suosion kasvu voi johtaa paitsi väärennöksiin pornografinen materiaalia, mutta myös kohdennettua häirintää, seksikipua ja lasten seksuaalista hyväksikäyttöä koskevan materiaalin (CSAM) luomista.

Graphikan mukaan raportti, tekoälyn riisuutumistyökalujen kehittäjät mainostavat sosiaalisessa mediassa ohjatakseen mahdollisia käyttäjiä verkkosivustoilleen, yksityiselle Telegram-chatille tai Discord-palvelimille, joista työkalut löytyvät.

"Jotkut palveluntarjoajat ovat avoimia toimissaan ja ilmoittavat tarjoavansa "riisumispalveluita" ja julkaisevat todisteeksi kuvia ihmisistä, joiden väittävät olevan "riisuttu", Graphika kirjoitti. "Toiset ovat vähemmän yksiselitteisiä ja esittävät itsensä tekoälyn taidepalveluina tai Web3-kuvagallerioina, mutta sisältävät synteettiseen NCII:hen liittyvät keskeiset termit profiileihinsa ja viesteihinsä."

Vaikka riisuva tekoäly keskittyy yleensä kuviin, tekoälyä on käytetty myös luomiseen video- syväväärennöksiä, joissa käytetään julkkisten, mukaan lukien YouTuben persoonallisuutta Herra Peto ja ikoninen Hollywood-näyttelijä Tom Hanks.

Jotkut näyttelijät pitävät Scarlett Johansson ja intialainen näyttelijä Anil Kapoor ryhtyvät oikeusjärjestelmään torjuakseen jatkuvaa tekoälyn syväväärennösten uhkaa. Vaikka valtavirran viihdyttäjät voivat saada enemmän mediahuomiota, aikuiset viihdyttäjät sanovat, että heidän äänensä kuullaan harvoin.

"Se on todella vaikeaa", legendaarinen aikuinen esiintyjä ja Star Factoryn PR:n johtaja Tanya Tate, kertoi Pura aikaisemmin. "Jos joku kuuluu valtavirtaan, se on varmasti paljon helpompaa."

Jopa ilman tekoälyn ja deepfake-teknologian nousua, Tate selitti, että sosiaalinen media on jo täynnä väärennettyjä tilejä, jotka käyttävät hänen todennäköisyyttään ja sisältöään. Seksityöntekijöiden jatkuva leimautuminen ei auta, mikä pakottaa heidät ja heidän faninsa pysymään varjoissa.

Lokakuussa Yhdistyneessä kuningaskunnassa toimiva Internet Watch Foundation (IWF) totesi erillisessä raportissaan, että yli 20,254 XNUMX kuvaa lasten hyväksikäytöstä löytyi yhdeltä darkweb-foorumilta vain kuukauden aikana. IWF varoitti, että tekoälyn tuottama lapsipornografia voi "musertaa”internetistä.

Generatiivisen tekoälykuvantamisen ansiosta IWF varoittaa siitä deepfake pornografia on edennyt siihen pisteeseen, että tekoälyn luomien kuvien ja aitojen kuvien eron erottaminen on tullut yhä monimutkaisemmaksi, jolloin lainvalvontaviranomaiset jahtaavat online-haamuja todellisten hyväksikäytön uhrien sijaan.

"Joten siellä on se jatkuva asia, ettet voi luottaa siihen, ovatko asiat todellisia vai eivät", Internet Watch Foundationin teknologiajohtaja Dan Sexton sanoi. Purkaat. "Asiat, jotka kertovat meille, ovatko asiat todellisia vai eivät, eivät ole 100%, ja siksi niihinkään ei voi luottaa."

Mitä tulee Ewingiin, Kotaku kertoi, että streamer palasi sanomalla, että hän työskenteli toimittajien, tekniikkojen, tutkijoiden ja naisten kanssa, joihin tapaus vaikutti hänen rikkomuksensa jälkeen. tammikuu. Ewing sanoi myös lähettäneensä varoja Ryan Morrisonin Los Angelesissa sijaitsevalle lakitoimistolle, Morrison Cooper, tarjotakseen oikeudellisia palveluita kaikille Twitch-naisille, jotka tarvitsivat heidän apuaan tehdäkseen poistoilmoituksia sivustoille, jotka julkaisevat heistä kuvia.

Ewing lisäsi, että hän sai tutkimuksen syvän fake-ongelman syvyydestä salaperäiseltä deepfake-tutkijalta Genevieve Ohilta.

"Yritin löytää "kirkkaita kohtia" taistelussa tämäntyyppistä sisältöä vastaan", Ewing sanoi.

Muokannut Ryan Ozawa.

Pysy ajan tasalla kryptouutisista, saat päivittäiset päivitykset postilaatikkoosi.

- SEO-pohjainen sisällön ja PR-jakelu. Vahvista jo tänään.

- PlatoData.Network Vertical Generatiivinen Ai. Vahvista itseäsi. Pääsy tästä.

- PlatoAiStream. Web3 Intelligence. Tietoa laajennettu. Pääsy tästä.

- PlatoESG. hiili, CleanTech, energia, ympäristö, Aurinko, Jätehuolto. Pääsy tästä.

- PlatonHealth. Biotekniikan ja kliinisten kokeiden älykkyys. Pääsy tästä.

- Lähde: https://decrypt.co/209181/ai-undressing-deepfake-nude-services-skyrocket-in-popularity