Tänään ilmoitamme Amazonin uusimman tekniikan julkisesta saatavuudesta Alexa Teacher Model 20 miljardilla parametrilla (AlexaTM 20B) läpi Amazon SageMaker JumpStart, SageMakerin koneoppimiskeskus. AlexaTM 20B on Amazonin kehittämä monikielinen laajamittainen sekvenssistä sekvenssiin (seq2seq) kielimalli. Voit käyttää AlexaTM 20B:tä monenlaisiin teollisuuden käyttötapauksiin talousraporttien yhteenvedosta asiakaspalvelun chatbottien kysymyksiin vastaamiseen. Sitä voidaan soveltaa, vaikka koulutusesimerkkejä olisi vain muutama tai ei ollenkaan. AlexaTM 20B päihittää 175 miljardia GPT-3 malli zero-shot-oppimistehtävissä, kuten SuperGLUE, ja näyttää huippuluokan suorituskyvyn monikielisissä zero-shot-tehtävissä, kuten XNLI.

Tässä viestissä annamme yleiskatsauksen AlexaTM 20B -mallin käyttöönotosta ja päätelmien suorittamisesta ohjelmallisesti JumpStart-sovellusliittymien kautta, jotka ovat saatavilla SageMaker Python SDK. Esittelemme esimerkin, kuinka voit käyttää tätä mallia kääntääksesi useiden kielten välillä, tehdäksesi yhteenvedon pitkästä tekstistä, vastataksesi kysymyksiin tietyn kontekstin perusteella ja luodaksesi tekstiä, jota ei voi erottaa ihmisen kirjoittamasta tekstistä.

AlexaTM 20B ja kontekstiopetus

Amazon Alexa AI:n Alexa Teacher Model (AlexaTM) -ohjelma on suunniteltu rakentamaan laajamittaisia, monikielisiä syväoppimismalleja (pääasiassa Transformer-pohjaisia), joiden tavoitteena on parantaa yleistämistä ja tietojen niukkuuden käsittelyä jatkotehtävissä. Laajan esikoulutuksen avulla opettajamallit voivat yleistää hyvin oppiakseen uusia tehtäviä harvasta datasta ja auttaa kehittäjiä parantamaan loppupään tehtävien suorituskykyä. AlexaTM 20B on osoittanut kilpailukykyinen suorituskyky yleisistä luonnollisen kielen käsittelyn (NLP) vertailuarvoista ja tehtävistä, kuten konekäännös, tiedon generointi ja yhteenveto.

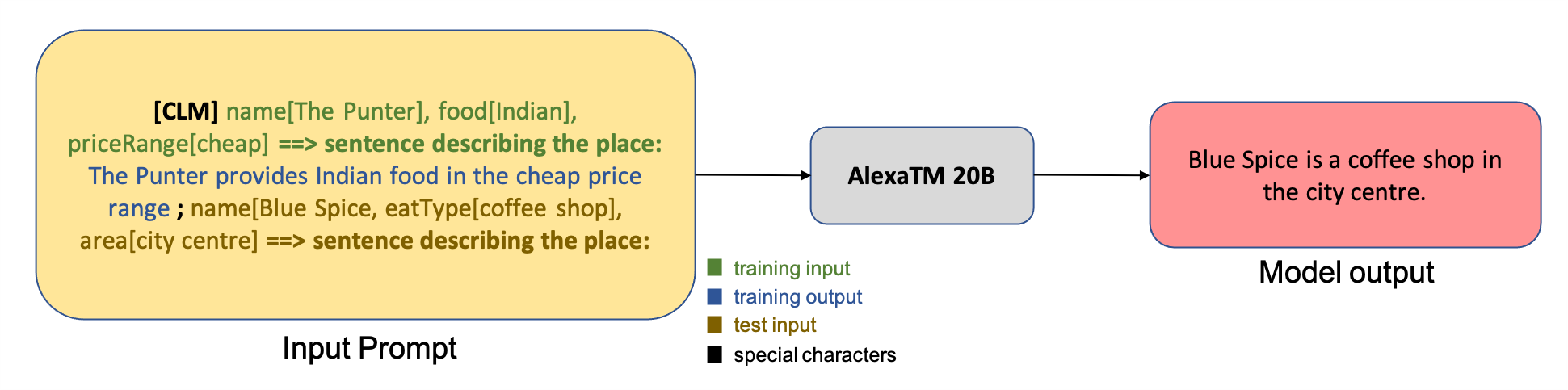

Perusmallien, kuten AlexaTM 20B, käyttö vähentää kalliiden mallien esikoulutuksen tarvetta ja tarjoaa huippuluokan lähtökohdan tehtävämallien kehittämiseen pienemmällä vaivalla ja vähemmän tehtäväkohtaisia harjoitustietoja. Yksi perusmallien keskeisistä ominaisuuksista on, että voimme opettaa mallin suorittamaan uusia tehtäviä, kuten kysymystä ja vastaamista eri kielillä, erittäin pienillä määrillä syöttöesimerkkejä, eikä hienosäätöä tai gradienttipäivityksiä tarvita. Tämä tunnetaan nimellä kontekstissa oppimista. Vain muutama esimerkki uudesta tehtävästä on annettu päättelyn kontekstina, joten AlexaTM 20B -malli voi siirtää tietoa siitä, mitä on opittu laajamittaisessa esikoulutuksessa, jopa kielten välillä. Tätä kutsutaan muutaman laukauksen oppiminen. Joissakin tapauksissa malli voi toimia hyvin ilman harjoitusdataa, vain selittämällä, mitä pitäisi ennustaa. Tätä kutsutaan nolla-ammuttu oppiminen. Oletetaan esimerkiksi, että käytämme AlexaTM 20B:tä kertaluonteiseen luonnollisen kielen luomiseen. Mallille välitetty syöte on koulutusesimerkki attribuutti-arvo-parien muodossa ja sitä vastaava tulostekstikertomus. Testiesimerkki liitetään sitten muodostamaan täydellinen syöttökehote, kuten seuraavassa kuvassa näkyy.

Jos haluat lisätietoja mallista, tutustu 20B-parametrinen Alexa-malli asettaa uudet pisteet muutaman laukauksen oppimiseen tai alkuperäinen paperi.

AlexaTM 20B:n käyttö on saatavilla ei-kaupalliseen käyttöön, ja se kattaa sen Alexa Teacher Model License -sopimus.

Ratkaisun yleiskatsaus

Seuraavat osiot tarjoavat vaiheittaisen esittelyn mallin käyttöönotosta, päätelmien suorittamisesta ja konteksti-oppimisesta pienten oppimistehtävien ratkaisemiseksi.

Huomaa, että seuraava osa sisältää koodinpätkät; koko koodi kaikkine tämän esittelyn vaiheineen on saatavilla mukana tulevassa muistikirjassa: Kontekstioppiminen AlexaTM 20B:llä SageMaker JumpStartissa.

Ota käyttöön malli

Jos haluat käyttää suurta kielimallia SageMakerissa, tarvitset mallikohtaisen päättelykomentosarjan, joka sisältää vaiheita, kuten mallin lataaminen, rinnastaminen ja paljon muuta. Sinun on myös luotava päästä päähän -testejä komentosarjoille, mallille ja halutuille ilmentymätyypeille varmistaaksesi, että kaikki kolme toimivat yhdessä. JumpStart poistaa tämän vaivan tarjoamalla käyttövalmiita komentosarjoja, jotka on testattu vankasti.

SageMaker antaa sinulle mahdollisuuden käyttää Docker-säiliöitä laajasti harjoittelua ja päätelmiä varten. JumpStart käyttää näitä saatavilla olevia kehyskohtaisia SageMaker Deep Learning -säiliöt (DLC:t). Aloitamme hakemalla optimoidun DLC:n (deploy_image_uri) käyttämällä model_id. Sitten haetaan model_uri joka sisältää malliparametrit sekä päätelmien käsittelykomentosarjat ja kaikki niihin liittyvät riippuvuudet. Seuraavaksi luomme a malliesimerkki SageMakerissa ja ota se käyttöön reaaliaikaiseen päätepisteeseen. Katso seuraava koodi:

AlexaTM 20B:n käyttöönotto vaatii grafiikkasuorittimen tukeman ilmentymän, jossa on vähintään 50 Gt CPU-muistia ja vähintään 42 Gt GPU-muistia. SageMaker tarjoaa monia tällaisia tapauksia, jotka tukevat reaaliaikaista päättelyä. Testasimme tätä ratkaisua kolmessa tapauksessa: ml.g4dn.12xlarge, ml.p3.8xlarge, ml.p3.16xlarge. Katso seuraava koodi:

Seuraavaksi otamme mallin käyttöön reaaliaikaiseen SageMaker-päätepisteeseen:

AlexaTM 20B vaatii 40 Gt levytilaa johtopäätössäiliössä. ml.g4dn.12xlarge ilmentymä täyttää tämän vaatimuksen. Esimerkiksi tyypeille ml.p3.8xlarge ja ml.p3.16xlarge liitetään an Amazonin elastisten lohkojen myymälä (Amazon EBS) -tilavuus suuren mallikoon käsittelemiseksi. Siksi asetimme volume_size = None kun otetaan käyttöön ml.g4dn.12xlarge and volume_size=256 kun käytössä on ml.p3.8xlarge tai ml.p3.16xlarge.

Mallin käyttöönotto voi kestää jopa 10 minuuttia. Kun malli on otettu käyttöön, voimme saada siitä ennusteita reaaliajassa!

Suorita johtopäätös

AlexaTM 20B on tekstinmuodostusmalli, joka osittaisen sekvenssin (lauseen tai tekstinpalan) perusteella luo seuraavan sanajoukon. Seuraava koodinpätkä antaa sinulle välähdyksen siitä, kuinka voit kysyä käyttöönottamamme päätepisteen ja jäsentää tulosteet automaattista täydennystehtävää varten. Käytämme UTF-8-muotoon koodattua JSON-sanakirjaa lähettääksemme pyyntöjä käyttöön otettuun malliin. Päätepisteen vastaus on JSON-objekti, joka sisältää luettelon luoduista teksteistä.

Seuraavaksi teemme kyselyn päätepisteestä ja jäsennämme vastauksen esimerkkisyöttötekstillä:

AlexaTM 20B tukee tällä hetkellä 10 tekstin luontiparametria päättelyn aikana: max_length, num_return_sequences, num_beams, no_repeat_ngram_size, temperature, early_stopping, do_sample, top_k, top_pja seed. Katso tarkemmat tiedot kunkin parametrin kelvollisista arvoista ja niiden vaikutuksesta lähtöön mukana tulevasta muistikirjasta: Kontekstioppiminen AlexaTM 20B:llä SageMaker JumpStartissa.

Kontekstin sisäinen oppiminen

Kontekstin sisäisellä oppimisella tarkoitetaan seuraavaa: tarjoamme kielimallille kehotteen, joka koostuu tehtävää esittelevistä opetuspanos-tulospareista. Liitämme kehotteeseen testisyötteen ja annamme kielimallin tehdä ennusteita ehdottamalla kehotteen ja ennustamalla seuraavat merkit tai sanat. Tämä on erittäin tehokas tekniikka muutamien pikaoppimisongelmien ratkaisemiseen, jossa opimme tehtävän muutamasta harjoitusnäytteestä.

Seuraavaksi näytämme, kuinka voit käyttää AlexaTM 20B:tä useisiin 1- ja zero-shot-tehtäviin kontekstin sisäisen oppimisen kautta. Toisin kuin aikaisemmissa sekvenssistä sekvenssiin -malleissa, AlexaTM 20B on koulutettu kausaalisen kielen mallintamiseen kohinanpoiston lisäksi, mikä tekee siitä hyvän mallin kontekstin sisäiseen oppimiseen.

Yhden otoksen tekstiyhteenveto

Tekstin yhteenveto on tehtävä lyhentää tietoja ja luoda tiivistelmä, joka edustaa alkuperäisen tekstin tärkeimpiä tietoja. Yhden otoksen tekstin yhteenveto viittaa asetukseen, jossa opimme tiivistämään tekstin yhden harjoitusnäytteen perusteella. Seuraava koodi on esimerkki tekstin yhteenvedosta XSUM-tietojoukko:

Käytämme seuraavaa kehotetta yhteenvedon tekemiseen, kun tarjotaan vain yksi koulutusnäyte. Mallista luotu teksti tulkitaan testiartikkelin ennustetuksi yhteenvedoksi.

Tuotos on seuraava:

Yhden laukauksen luonnollisen kielen sukupolvi

Luonnollisen kielen sukupolven tehtävänä on tuottaa tekstin kertomuksia syötetyn tekstin perusteella. Seuraava esimerkki näyttää harjoitusnäytteen E2E-tietojoukko:

Käytämme seuraavaa kehotetta luonnollisen kielen luomiseen, kun tarjotaan vain yksi harjoitusnäyte (1-shot). Mallista luotu teksti tulkitaan testisyötteen ennustetuksi tekstiksi (test_inp).

Tuotos on seuraava:

Yhden laukauksen konekäännös

Konekäännös on tekstin kääntäminen kielestä toiseen. Seuraava esimerkki näyttää harjoitusnäytteen WMT19-tietojoukko jossa meidän on käännettävä saksasta englanniksi:

Käytämme seuraavaa kehotetta konekääntämiseen, kun tarjotaan vain yksi harjoitusnäyte (1-shot). Mallista luotu teksti tulkitaan testisyötteen käännökseksi (test_inp).

Tuotos on seuraava:

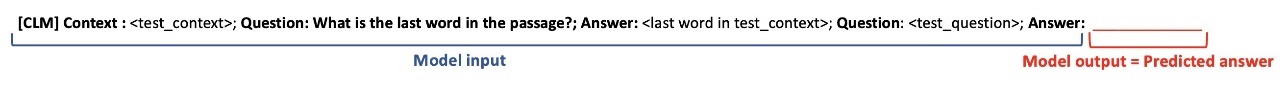

Nolla-shot poimivan kysymyksen vastaus

Poimiva kysymykseen vastaaminen on tehtävä löytää vastaus kysymykseen kontekstikappaleesta. Seuraavassa on esimerkki kontekstista ja kysymyksestä SQuAD v2 -tietojoukko:

Huomaa, että meillä ei ole harjoitusnäytteitä tehtäväämme varten. Sen sijaan luomme tyhjän kysymyksen kehotteen viimeisestä sanasta test_context (nukke-laukaus). Siksi vastaamme itse asiassa tyhjentävästi kysymyksiin.

Käytämme seuraavaa kehotetta poimivaan kysymykseen vastaamiseen, kun koulutusnäytettä ei toimiteta. Mallista luotu teksti tulkitaan vastaukseksi testikysymykseen.

Tuotos on seuraava:

Nopea suunnittelu

Nopea suunnittelu voi joskus olla taidetta. Pienetkin muutokset kehotemalliin voivat johtaa merkittäviin muutoksiin mallin suorituskyvyssä tietyssä tehtävässä. Seuraavassa on muutamia neuvoja hyvien kehotepohjien kirjoittamiseen. Ensinnäkin on tärkeää muistaa, että malli on koulutettu oppimaan todellisten lauseiden rakennetta (kausaalikielimallinnus). Siksi on parasta varmistaa, että kehotemallisi on kieliopillisesti ja rakenteellisesti oikea luonnollisella kielellä. Toiseksi tämä malli hyötyy valelaukauksista, jotka auttavat opettamaan sille vastauksessa odotetun rakenteen, kuten yllä on osoitettu. Kolmanneksi on aina suositeltavaa tutkia tehtävien suorituskykyä useissa ehdokaskehotemalleissa. Pikalähde ja Luonnolliset ohjeet ovat kaksi avoimen lähdekoodin viitekehystä kehotemallien standardointiin, ja ne tarjoavat erilaisia esimerkkikehotteita, joita käytetään olemassa oleviin mallinnustehtäviin. Lisäksi, liite B AlexaTM 20B paperi tarjoaa kehotemalleja, joita käytetään paperissa esitettyjen tulosten luomiseen. On kasvava alakenttä, joka on omistettu tehtävän parhaiden kehotteiden automaattiselle luomiselle ja oppimiselle, mukaan lukien sekä luonnolliset kielet että jatkuvat kehotteet. Tämä ei kuulu tämän opetusohjelman piiriin.

Yhteenveto

Tässä viestissä näytimme, kuinka AlexaTM 20B -malli otetaan käyttöön SageMaker-päätepisteessä ja suoritetaan päättely. Voit käyttää AlexaTM 20B -mallia konteksti-oppimiseen erilaisissa muutaman otoksen oppimistehtävissä. Lisätietoja AlexaTM 20B:stä on osoitteessa 20B-parametrinen Alexa-malli asettaa uudet pisteet muutaman laukauksen oppimiseen tai alkuperäinen paperi.

Kirjoittajat haluavat kiittää Maciej Rudnickin, Jakub Debskin, Ashish Khetanin, Anastasiia Dubininan, Vitaliy Korolevin, Karl Albertsenin, Saleh Soltanin ja Mariusz Momotkon teknisestä panoksesta tämän julkaisun mahdollistamisessa.

Tietoja JumpStartista

JumpStart on Amazon SageMakerin koneoppimiskeskus (ML), joka tarjoaa yli 350 valmiiksi koulutettua mallia, sisäänrakennettuja algoritmeja ja valmiita ratkaisumalleja, joiden avulla pääset nopeasti alkuun ML:n kanssa. JumpStart isännöi huippuluokan malleja suosituista mallikeskittymistä, kuten TensorFlow, PyTorch, Hugging Face ja MXNet, jotka tukevat suosittuja ML-tehtäviä, kuten objektien havaitsemista, tekstin luokittelua ja tekstin luomista. ML-tutkijayhteisö on tehnyt paljon vaivaa saattaakseen suurimman osan äskettäin kehitetyistä malleista julkisesti saataville. JumpStart pyrkii auttamaan sinua löytämään oikeat ML-mallit ja -algoritmit ja aloittamaan mallien rakentamisen välittömästi. Erityisesti JumpStart tarjoaa seuraavat edut:

- Helppo pääsy käyttöliittymän ja SDK:n avulla – Voit käyttää JumpStartin malleja ja algoritmeja ohjelmallisesti käyttämällä SageMaker Python SDK:ta tai Amazon SageMaker Studion JumpStart-käyttöliittymän kautta. Tällä hetkellä AlexaTM 20B on käytettävissä vain SageMaker Python SDK:n kautta.

- SageMakerin sisäänrakennetut algoritmit – JumpStart tarjoaa yli 350 sisäänrakennettua algoritmia ja esiopetettua mallia sekä vastaavat harjoitusskriptit (jos tuetut), päättelykomentosarjat ja esimerkkimuistikirjat. Skriptit on optimoitu jokaiselle kehykselle ja tehtävälle, ja ne tarjoavat ominaisuuksia, kuten GPU-tuen, automaattisen mallin virityksen ja asteittaisen harjoittelun. Skriptit testataan myös SageMaker-instanssien ja -ominaisuuksien suhteen, jotta et törmää yhteensopivuusongelmiin.

- Valmiiksi rakennetut ratkaisut – JumpStart tarjoaa joukon 23 ratkaisua yleisiin ML-käyttötapauksiin, kuten kysynnän ennustamiseen sekä teollisuus- ja taloussovelluksiin, jotka voit ottaa käyttöön vain muutamalla napsautuksella. Ratkaisut ovat päästä päähän ML-sovelluksia, jotka yhdistävät erilaisia AWS-palveluita tietyn yrityskäyttötilanteen ratkaisemiseksi. He käyttävät AWS CloudFormation -malleja ja viitearkkitehtuureja nopeaan käyttöönottoon, mikä tarkoittaa, että ne ovat täysin muokattavissa.

- Tuki – SageMaker tarjoaa monenlaista tukea, kuten päivitettyjen versioiden ylläpitämisen, kun uusia SageMaker-ominaisuuksia tai Deep Learning Container -versioita julkaistaan, ja dokumenttien luomista JumpStart-sisällön käyttämisestä SageMaker-ympäristössä.

Saat lisätietoja JumpStartista ja siitä, kuinka voit käyttää avoimen lähdekoodin esikoulutettuja malleja moniin muihin ML-tehtäviin, tutustu seuraavaan AWS re:Invent 2020 -video.

Tietoja Tekijät

Tohtori Vivek Madan on soveltuva tutkija Amazon SageMaker JumpStart -tiimin kanssa. Hän sai tohtorin tutkinnon Illinoisin yliopistosta Urbana-Champaignissa ja oli tutkijatohtorina Georgia Techissä. Hän on aktiivinen koneoppimisen ja algoritmisuunnittelun tutkija ja julkaissut julkaisuja EMNLP-, ICLR-, COLT-, FOCS- ja SODA-konferensseissa.

Tohtori Vivek Madan on soveltuva tutkija Amazon SageMaker JumpStart -tiimin kanssa. Hän sai tohtorin tutkinnon Illinoisin yliopistosta Urbana-Champaignissa ja oli tutkijatohtorina Georgia Techissä. Hän on aktiivinen koneoppimisen ja algoritmisuunnittelun tutkija ja julkaissut julkaisuja EMNLP-, ICLR-, COLT-, FOCS- ja SODA-konferensseissa.

Jack FitzGerald on vanhempi sovellettu tutkija Alexa AI:ssä, jossa hän keskittyy tällä hetkellä laajan kielen mallintamiseen, monikielisen tekstin mallintamiseen ja koneoppimistoimintoihin.

Jack FitzGerald on vanhempi sovellettu tutkija Alexa AI:ssä, jossa hän keskittyy tällä hetkellä laajan kielen mallintamiseen, monikielisen tekstin mallintamiseen ja koneoppimistoimintoihin.

João Moura on AI/ML Specialist Solutions -arkkitehti Amazon Web Servicesissä. Hän keskittyy enimmäkseen NLP-käyttötapauksiin ja auttaa asiakkaita optimoimaan syvän oppimismallin koulutusta ja käyttöönottoa. Hän on myös aktiivinen matalan koodin ML-ratkaisujen ja ML-spesifisten laitteistojen kannattaja.

João Moura on AI/ML Specialist Solutions -arkkitehti Amazon Web Servicesissä. Hän keskittyy enimmäkseen NLP-käyttötapauksiin ja auttaa asiakkaita optimoimaan syvän oppimismallin koulutusta ja käyttöönottoa. Hän on myös aktiivinen matalan koodin ML-ratkaisujen ja ML-spesifisten laitteistojen kannattaja.

Kesäkuu voitti on tuotepäällikkö, jolla on SageMaker JumpStart ja sisäänrakennetut algoritmit. Hän keskittyy tekemään ML-sisällöt helposti löydettävissä ja käyttökelpoisiksi SageMaker-asiakkaille.

Kesäkuu voitti on tuotepäällikkö, jolla on SageMaker JumpStart ja sisäänrakennetut algoritmit. Hän keskittyy tekemään ML-sisällöt helposti löydettävissä ja käyttökelpoisiksi SageMaker-asiakkaille.

Pulkit Kapur on Alexa Teacher Model -ohjelman tuotepäällikkö Alexa AI:n kanssa, ja se keskittyy Alexan multitask-multimodaalisten perusmallien yleiseen älykkyyteen ja sovelluksiin.

Pulkit Kapur on Alexa Teacher Model -ohjelman tuotepäällikkö Alexa AI:n kanssa, ja se keskittyy Alexan multitask-multimodaalisten perusmallien yleiseen älykkyyteen ja sovelluksiin.

- AI

- ai taide

- ai taiteen generaattori

- ai robotti

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- tekoäly

- tekoälyn sertifiointi

- tekoäly pankkitoiminnassa

- tekoäly robotti

- tekoälyrobotit

- tekoälyohjelmisto

- AWS-koneoppiminen

- blockchain

- blockchain-konferenssi ai

- coingenius

- keskustelullinen tekoäly

- kryptokonferenssi ai

- dall's

- syvä oppiminen

- Perusteet (100)

- google ai

- koneoppiminen

- Platon

- plato ai

- Platonin tietotieto

- Platon peli

- PlatonData

- platopeliä

- mittakaava ai

- syntaksi

- zephyrnet