Cohere, OpenAI ja AI21 Labs ovat kehittäneet alustavan joukon parhaita käytäntöjä, joita voidaan soveltaa kaikkiin organisaatioihin, jotka kehittävät tai ottavat käyttöön suuria kielimalleja. Täällä on tietokoneita, jotka osaavat lukea ja kirjoittaa, ja niillä on mahdollisuus vaikuttaa olennaisesti jokapäiväiseen elämään. Ihmisen ja koneen vuorovaikutuksen tulevaisuus on täynnä mahdollisuuksia ja lupauksia, mutta mikä tahansa tehokas tekniikka vaatii huolellista käyttöönottoa.

Alla oleva yhteinen lausunto on askel kohti yhteisön rakentamista vastaamaan tekoälyn kehityksen aiheuttamiin globaaleihin haasteisiin, ja kannustamme muita organisaatioita, jotka haluavat osallistua, ottamaan yhteyttä.

Yhteinen suositus kielimallin käyttöönotosta

Suosittelemme useita keskeisiä periaatteita auttaaksemme suurten kielimallien (LLM) tarjoajia vähentämään tämän tekniikan riskejä, jotta se saavuttaisi täyden lupauksensa lisätä ihmisen kykyjä.

Vaikka nämä periaatteet on kehitetty nimenomaan kokemuksemme perusteella LLM:iden tarjoamisesta API:n kautta, toivomme, että niistä on hyötyä julkaisustrategiasta (kuten avoimesta lähdekoodista tai yrityksen sisäisestä käytöstä) riippumatta. Odotamme näiden suositusten muuttuvan merkittävästi ajan myötä, koska LLM:n kaupallinen käyttö ja siihen liittyvät turvallisuusnäkökohdat ovat uusia ja kehittyviä. Opimme aktiivisesti LLM:n rajoituksista ja väärinkäytöksistä ja käsittelemme niitä, ja päivitämme näitä periaatteita ja käytäntöjä yhteistyössä laajemman yhteisön kanssa ajan myötä.

Jaamme nämä periaatteet siinä toivossa, että muut LLM-palveluntarjoajat voivat oppia niistä ja omaksua ne sekä edistää julkista keskustelua LLM:n kehittämisestä ja käyttöönotosta.

Estä väärinkäyttö

Julkaise käyttöohjeet ja käyttöehdot LLM:t tavalla, joka kieltää aineellisen haitan yksilöille, yhteisöille ja yhteiskunnalle, kuten roskapostin, petosten tai astroturfin kautta. Käyttöohjeissa tulee myös määritellä alueet, joilla LLM-käyttö vaatii erityistä tarkastelua, ja kieltää riskialttiit käyttötapaukset, jotka eivät ole tarkoituksenmukaisia, kuten ihmisten luokittelu suojattujen ominaisuuksien perusteella.

Rakenna järjestelmiä ja infrastruktuuria käyttöohjeiden noudattamiseksi. Tämä voi sisältää nopeusrajoituksia, sisällön suodatusta, sovelluksen hyväksyntää ennen tuotantokäyttöä, poikkeavien toimintojen tarkkailua ja muita lievennyksiä.

Vähennä tahatonta vahinkoa

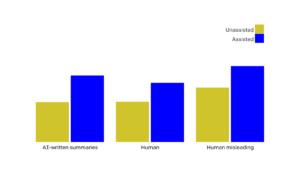

Vähennä ennakoivasti haitallista mallikäyttäytymistä. Parhaat käytännöt sisältävät kattavan mallin arvioinnin rajoitusten asianmukaiseksi arvioimiseksi, mahdollisten harhalähteiden minimoimisen koulutuskorpuissa ja tekniikat vaarallisen käytöksen minimoimiseksi, kuten ihmispalautteesta oppimisen avulla.

Dokumentoi tunnetut heikkoudet ja haavoittuvuudet, kuten harhaa tai kykyä tuottaa epävarmaa koodia, koska joissakin tapauksissa mikään ennaltaehkäisevä toiminta ei pysty täysin poistamaan tahattoman haitan mahdollisuutta. Dokumentaation tulee sisältää myös malli- ja käyttötapauskohtaisia parhaita turvallisuuskäytäntöjä.

Tee harkittua yhteistyötä sidosryhmien kanssa

Rakenna tiimejä erilaisilla taustoilla ja pyydä laajaa palautetta. Erilaisia näkökulmia tarvitaan luonnehtimaan ja käsittelemään sitä, kuinka kielimallit toimivat todellisen maailman monimuotoisuudessa. Jos niitä ei valvota, ne voivat vahvistaa ennakkoluuloja tai epäonnistua joidenkin ryhmien kohdalla.

Julkaise LLM-turvallisuudesta ja väärinkäytöstä saadut kokemukset mahdollistaakseen laajan käyttöönoton ja auttaakseen parhaiden käytäntöjen eri toimialojen iteraatiossa.

Kohtele kaikkea työvoimaa kielimallin toimitusketjussa kunnioittavasti. Esimerkiksi palveluntarjoajilla tulisi olla korkeat standardit niiden työoloille, jotka tarkastelevat mallin tuotoksia talon sisällä, ja toimittajat noudattavat tarkasti määriteltyjä standardeja (esim. varmistamalla, että merkinnät voivat kieltäytyä tietyn tehtävän suorittamisesta).

LLM-palveluntarjoajina näiden periaatteiden julkaiseminen on ensimmäinen askel turvallisemman laajan kielimallin kehittämisen ja käyttöönoton ohjaamisessa yhteistyössä. Jatkamme innolla yhteistyötä toistemme ja muiden osapuolten kanssa löytääksemme muita mahdollisuuksia vähentää tahattomia haittoja ja estää kielimallien haitallista käyttöä.

Muiden organisaatioiden tuki

"Vaikka LLM:illä on paljon lupauksia, heillä on merkittäviä luontaisia turvallisuusongelmia, joita on työstettävä. Nämä parhaat käytännöt ovat tärkeä askel näiden mallien haittojen minimoinnissa ja niiden mahdollisten hyötyjen maksimoimisessa."

– Antrooppinen

”Kun suurista kielimalleista (LLM) on tullut yhä voimakkaampia ja ilmaisuvoimaisempia, riskien vähentämisestä tulee entistä tärkeämpää. Suhtaudumme myönteisesti näihin ja muihin pyrkimyksiin pyrkiä ennakoivasti lieventämään haittoja ja tuomaan käyttäjille erityistä huolellisuutta vaativia alueita. Tässä hahmotellut periaatteet ovat tärkeä panos maailmanlaajuiseen keskusteluun."

-John Bansemer, CyberAI-projektin johtaja ja vanhempi tutkija, Center for Security and Emerging Technology (CSET)

"Google vahvistaa kattavien strategioiden tärkeyden malli- ja koulutustietojen analysoinnissa haittojen, harhaanjohtamisen ja harhaanjohtamisen riskien vähentämiseksi. Se on näiden tekoälyn tarjoajien harkittu askel edistääkseen tekoälyn turvallisuutta koskevia periaatteita ja dokumentaatiota."

– Google Cloud Platform (GCP)

”Perusmallien, kuten suurten kielimallien, turvallisuus on kasvava yhteiskunnallinen huolenaihe. Kiitämme Cohere-, OpenAI- ja AI21 Labsia siitä, että ne ovat ottaneet ensimmäisen askeleen hahmotellakseen vastuullisen kehityksen ja käyttöönoton korkean tason periaatteet mallinkehittäjien näkökulmasta. Työtä on vielä paljon, ja uskomme, että on välttämätöntä saada enemmän ääniä korkeakoulujen, teollisuuden ja kansalaisyhteiskunnan edustajilta yksityiskohtaisempien periaatteiden ja yhteisön normien kehittämiseksi. Kuten toteamme tuoreessa blogi, ei vain lopputulos, vaan prosessin legitimiteetti ratkaisee."

-Percy Liang, Stanfordin perusmallien tutkimuskeskuksen (CRFM) johtaja

Osallistu

Jos kehität kielimalleja tai pyrit vähentämään niiden riskejä, keskustelemme mielellämme kanssasi. Ota yhteyttä osoitteeseen bestpractices@openai.com.

- kyky

- Meistä

- pääsy

- Saavuttaa

- Toiminta

- toiminta

- osoite

- käsitellään

- Hyväksyminen

- edistää

- AI

- Kaikki

- api

- sovelletaan

- Hakemus

- sopiva

- koska

- tulevat

- alle

- Hyödyt

- PARAS

- parhaat käytännöt

- Rakentaminen

- kyvyt

- tapauksissa

- ketju

- haasteet

- muuttaa

- pilvi

- Pilvialusta

- koodi

- tehdä yhteistyötä

- yhteistyö

- kaupallinen

- yhteisöjen

- yhteisö

- yritys

- täysin

- kattava

- tietokoneet

- olosuhteet

- näkökohdat

- Kontti

- pitoisuus

- jatkaa

- Keskustelu

- tiedot

- levityspinnalta

- käyttöönotto

- yksityiskohtainen

- kehittää

- kehitetty

- kehittäjille

- kehittämällä

- Kehitys

- ahkeruus

- Johtaja

- Monimuotoisuus

- verkkotunnuksia

- ponnisteluja

- poistaa

- syntymässä

- mahdollistaa

- kannustaa

- sitoutua

- varmistamalla

- olennainen

- arviointi

- kehittyvä

- esimerkki

- innoissaan

- odottaa

- experience

- ilmeikäs

- palaute

- suodatus

- Etunimi

- perusta

- petos

- koko

- pohjimmiltaan

- tulevaisuutta

- Global

- Ryhmän

- Kasvava

- suuntaviivat

- auttaa

- tätä

- Korkea

- suuri riski

- Korostaa

- pitää

- toivoo

- Miten

- HTTPS

- ihmisen

- tunnistaa

- Vaikutus

- merkitys

- tärkeä

- sisältää

- yhä useammin

- henkilöt

- teollisuus

- Infrastruktuuri

- luontainen

- panos

- vuorovaikutus

- kysymykset

- IT

- avain

- tunnettu

- työ

- Labs

- Kieli

- suuri

- OPPIA

- oppinut

- oppiminen

- oikeutus

- Lessons Learned

- rakkaus

- kone

- materiaali

- Matters

- malli

- mallit

- seuranta

- lisää

- tarpeet

- käyttää

- Mahdollisuudet

- tilata

- organisaatio

- organisaatioiden

- Muut

- osallistua

- Ihmiset

- näkökulma

- näkökulmia

- foorumi

- mahdollisuus

- mahdollinen

- voimakas

- prosessi

- tuottaa

- tuotanto

- projekti

- lupaus

- edistää

- suojattu

- tarjoamalla

- julkinen

- Julkaiseminen

- RE

- tavoittaa

- todellinen maailma

- suositella

- vähentää

- suhteen

- vapauta

- edustaa

- Vaatii

- tutkimus

- vastuullinen

- Riski

- riskit

- turvallisempaa

- Turvallisuus

- turvallisuus

- setti

- useat

- jakaminen

- merkittävä

- sosiaalinen

- yhteiskunta

- jonkin verran

- spam

- erityisesti

- standardit

- Osavaltio

- Lausunto

- strategiat

- Strategia

- toimittaa

- toimitusketju

- järjestelmät

- ottaen

- Puhua

- tekniikat

- Elektroniikka

- ehdot

- -

- Kautta

- aika

- kosketa

- kohti

- koulutus

- Päivitykset

- käyttää

- Käytä koteloita

- Käyttäjät

- myyjät

- ÄÄNTÄ

- tervetuloa

- vaikka

- KUKA

- laajalle levinnyt

- sisällä

- Referenssit

- työskenteli

- työskentely

- maailman-

- olisi