Toimialojen, kuten vähittäiskaupan, pankkitoiminnan, rahoituksen, terveydenhuollon, tuotannon ja luotonannon, organisaatiot joutuvat usein käsittelemään valtavia määriä jäsentelemättömiä tekstidokumentteja, jotka tulevat eri lähteistä, kuten uutisista, blogeista, tuotearvosteluista, asiakastukikanavista ja sosiaalisessa mediassa. Nämä asiakirjat sisältävät tärkeitä tietoja, jotka ovat avainasemassa tärkeiden liiketoimintapäätösten tekemisessä. Organisaation kasvaessa on haaste saada kriittistä tietoa näistä asiakirjoista. Luonnollisen kielenkäsittelyn (NLP) ja koneoppimistekniikoiden (ML) edistymisen ansiosta voimme löytää näistä tekstidokumenteista nopeasti ja tarkasti arvokkaita oivalluksia ja yhteyksiä, mikä auttaa yrityksiä tekemään laadukkaita liiketoimintapäätöksiä ajoissa. Täysin hallitut NLP-palvelut ovat myös nopeuttaneet NLP:n käyttöönottoa. Amazonin käsitys on täysin hallittu palvelu, jonka avulla voit rakentaa tarpeitasi vastaavia mukautettuja NLP-malleja ilman ML-asiantuntemusta.

Tässä postauksessa näytämme, kuinka hyödynnetään huippuluokan ML-tekniikoita viiden erilaisen NLP-tehtävän ratkaisemiseen: dokumenttien yhteenveto, tekstin luokittelu, kysymyksiin vastaaminen, nimettyjen entiteettien tunnistus ja suhteiden purkaminen. Näytämme kunkin NLP-tehtävän käytön Amazon Sage Maker suorittaaksesi seuraavat toiminnot:

- Ota käyttöön ja suorita johtopäätös esiopetetulla mallilla

- Hienosäädä esikoulutettu malli uudella mukautetulla tietojoukolla

- Paranna hienosäätösuorituskykyä edelleen Automaattinen SageMaker-viritys

- Arvioi mallin suorituskykyä pitkitystestidatan perusteella erilaisten arviointimittojen avulla

Vaikka käsittelemme tässä viestissä viittä erityistä NLP-tehtävää, voit käyttää tätä ratkaisua mallina yleistääksesi esikoulutettujen mallien hienosäätöä omalla tietojoukollasi ja suorittaaksesi sen jälkeen hyperparametrien optimoinnin tarkkuuden parantamiseksi.

JumpStart-ratkaisumallit

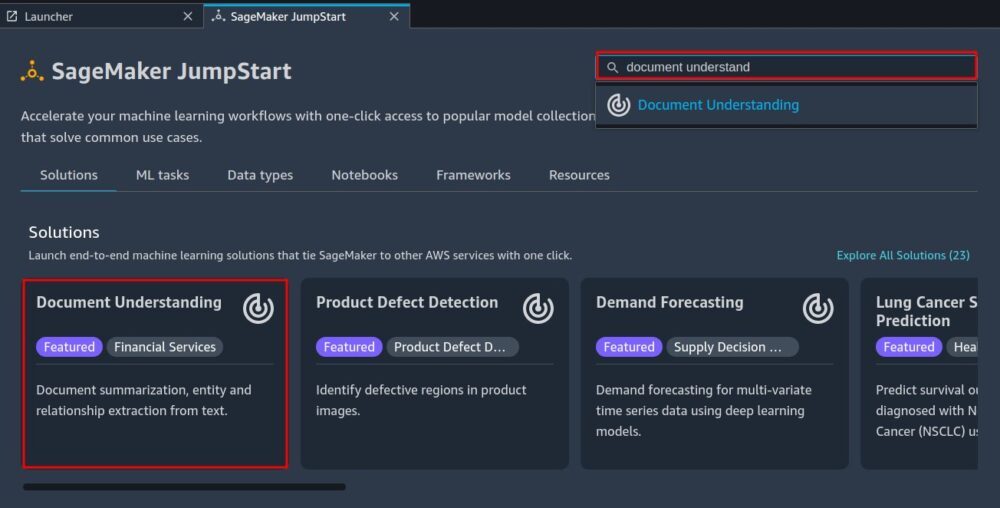

Amazon SageMaker JumpStart tarjoaa yhden napsautuksen, päästä päähän -ratkaisuja moniin yleisiin ML-käyttötapauksiin. Tutustu seuraaviin käyttötapauksiin saadaksesi lisätietoja käytettävissä olevista ratkaisumalleista:

JumpStart-ratkaisumallit kattavat erilaisia käyttötapauksia, joista jokaisen alla on tarjolla useita erilaisia ratkaisumalleja (tämä Document Understanding -ratkaisu on "Poimi ja analysoi dataa asiakirjoista" käyttötapauksen alla).

Valitse JumpStart-aloitussivulta ratkaisumalli, joka sopii parhaiten käyttötilanteeseesi. Lisätietoja yksittäisistä ratkaisuista kussakin käyttötapauksessa ja JumpStart-ratkaisun käynnistämisestä on kohdassa Ratkaisumallit.

Ratkaisun yleiskatsaus

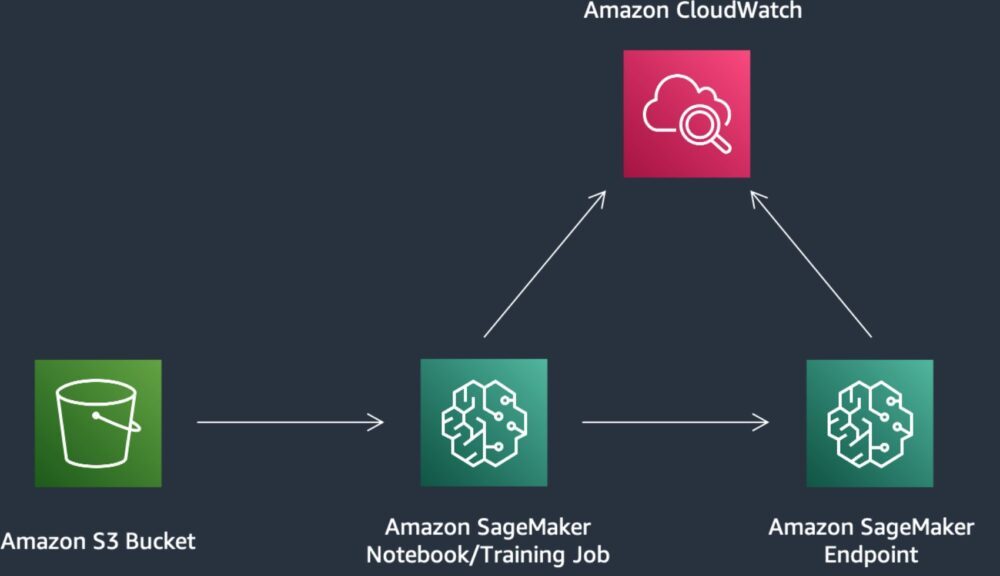

Seuraava kuva näyttää, kuinka voit käyttää tätä ratkaisua SageMaker-komponenttien kanssa. SageMaker-koulutustehtäviä käytetään erilaisten NLP-mallien kouluttamiseen, ja SageMaker-päätepisteitä käytetään mallien käyttöönottoon kussakin vaiheessa. Käytämme Amazonin yksinkertainen tallennuspalvelu (Amazon S3) yhdessä SageMakerin kanssa harjoitustietojen ja malliesineiden tallentamiseen ja amazonin pilvikello koulutuksen ja päätepisteiden tulosten kirjaamiseen.

Avaa Asiakirjan ymmärtäminen -ratkaisu

Siirry Document Understanding -ratkaisuun JumpStartissa.

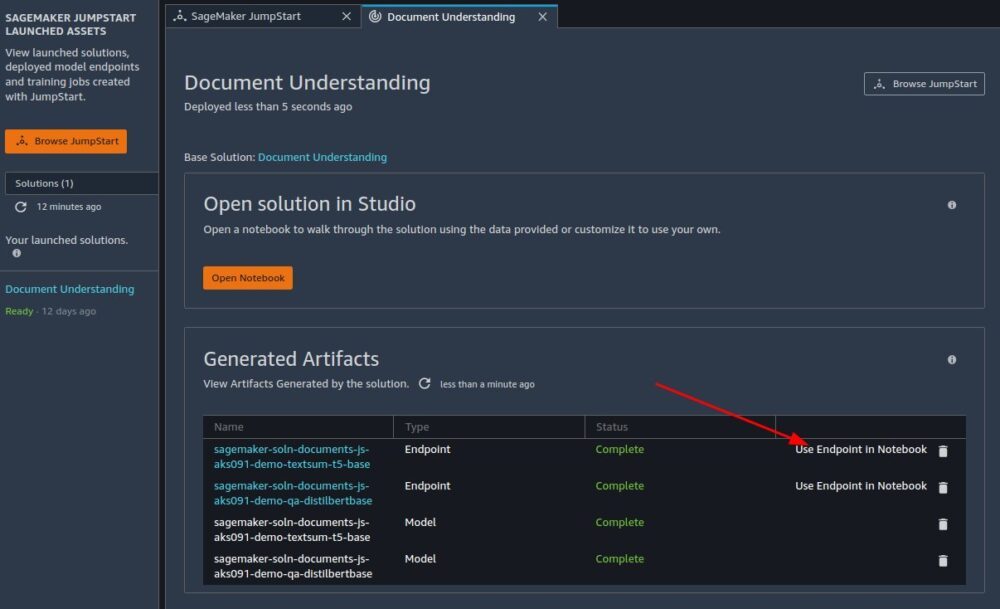

Nyt voimme tarkastella lähemmin joitain tähän ratkaisuun sisältyviä resursseja, alkaen esittelymuistikirjasta.

Demo muistikirja

Voit käyttää esittelymuistikirjaa esimerkkitietojen lähettämiseen jo käyttöön otettuihin mallipäätepisteisiin asiakirjan yhteenveto- ja kysymyksiin vastaamista varten. Esittelymuistikirjan avulla saat nopeasti käytännön kokemusta kyselemällä esimerkkitietoja.

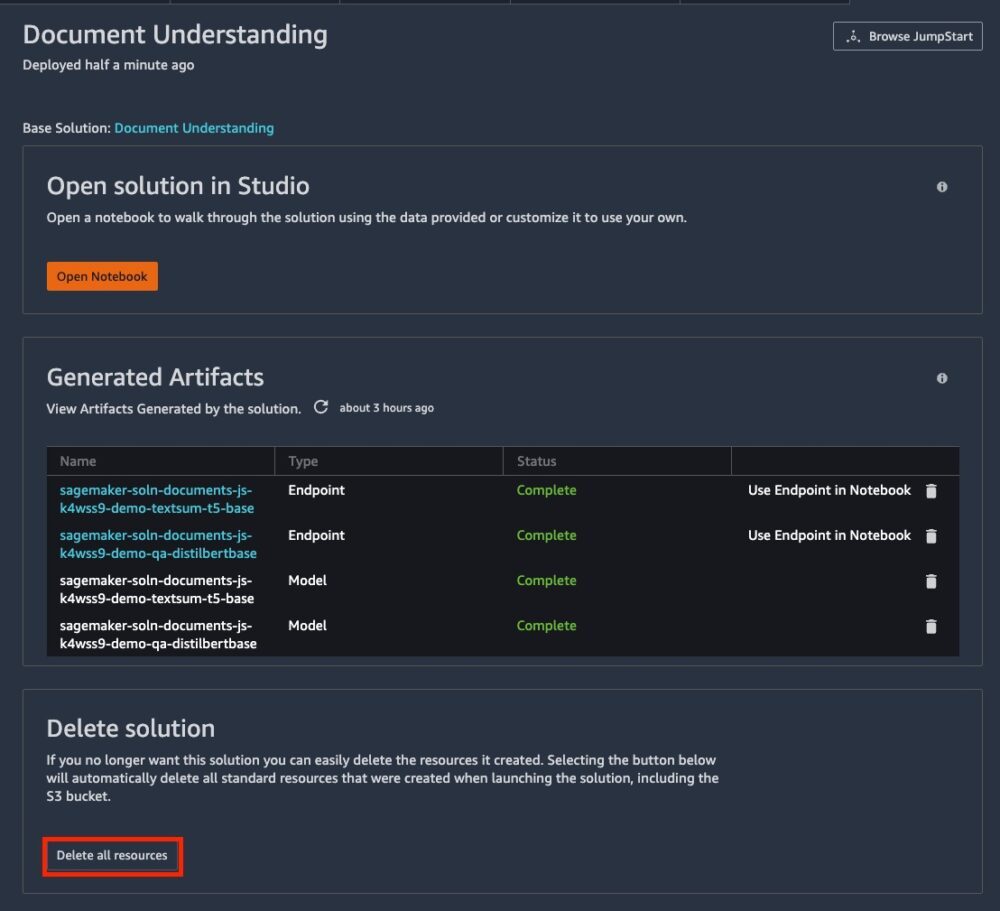

Kun olet käynnistänyt Document Understanding -ratkaisun, avaa esittelymuistikirja valitsemalla Käytä päätepistettä Notebookissa.

Sukellaan syvemmälle tämän ratkaisun viiteen päämuistikirjaan.

Edellytykset

In Amazon SageMaker Studio, varmista, että käytät PyTorch 1.10 Python 3.8 CPU Optimized image/ydin avataksesi muistikirjat. Koulutuksessa käytetään viittä ml.g4dn.2xsuuria esiintymää, joten sinun tulee nostaa a palvelurajan korotuspyyntö jos tilisi vaatii korotettuja rajoja tälle tyypille.

Tekstiluokittelu

Tekstin luokittelu tarkoittaa syötelauseen luokittelua johonkin harjoitustietojoukon luokkatunnisteista. Tämä muistikirja näyttää kuinka käyttää JumpStart API tekstin luokittelua varten.

Ota käyttöön ja suorita päättely esikoulutetulla mallilla

Tekstin luokittelumalli, jonka olemme päättäneet käyttää, perustuu tekstin upotukseen (tensorflow-tc-bert-en-uncased-L-12-H-768-A-12-2) malli alkaen TensorFlow -napa, joka on esikoulutettu Wikipedia- ja BookCorpus-tietosarjoihin.

Käytössä oleva malli luodaan liittämällä binäärinen luokituskerros tekstin upotusmallin tulosteeseen ja hienosäätämällä sitten koko mallia SST-2 tietojoukko, joka koostuu positiivisista ja negatiivisista elokuva-arvosteluista.

Jotta voimme tehdä päätelmiä tässä mallissa, meidän on ensin ladattava päättelysäilö (deploy_image_uri), johtopäätös (deploy_source_uri) ja esikoulutettu malli (base_model_uri). Välitämme ne sitten parametreina SageMaker-malliobjektin luomiseksi, jonka voimme sitten ottaa käyttöön:

Seuraava koodi näyttää vastauksemme:

Hienosäädä esikoulutettu malli mukautetussa tietojoukossa

Kävelimme juuri läpi juoksevan päättelyn esikoulutetulla BERT-mallilla, joka oli hienosäädetty SST-2 aineisto.

Seuraavaksi keskustelemme mallin hienosäätämisestä mukautetussa tietojoukossa, jossa on useita luokkia. Tietojoukko, jota käytämme hienosäätöön, on edelleen SST-2 tietojoukko. Voit korvata tämän tietojoukon millä tahansa sinua kiinnostavalla tietojoukolla.

Haemme koulutus Docker-säilön, koulutusalgoritmin lähteen ja esikoulutetun mallin:

Algoritmikohtaisten hyperparametrien osalta aloitamme hakemalla Python-sanakirjan harjoitushyperparametreistä, jotka algoritmi hyväksyy oletusarvoillaan. Voit ohittaa ne mukautetuilla arvoilla seuraavan koodin osoittamalla tavalla:

Tietojoukko (SST-2) on jaettu koulutus-, validointi- ja testisarjoihin, joissa harjoitusjoukkoa käytetään mallin sopimiseen, validointijoukkoa käytetään HPO:lle käytettävien arviointimittojen laskemiseen ja testijoukkoa käytetään pidätystietona mallin suorituskyvyn arvioimiseksi. Seuraavaksi juna- ja validointitietojoukko ladataan Amazon S3:een ja sitä käytetään harjoitustyön hienosäätötyön käynnistämiseen:

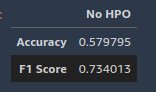

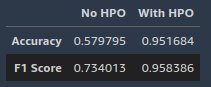

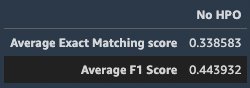

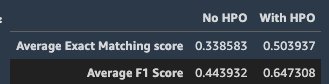

Kun hienosäätötyö on valmis, otamme mallin käyttöön, teemme johtopäätöksen kestotestitietojoukosta ja laskemme arviointimitat. Koska se on binääriluokitustehtävä, käytämme tarkkuuspisteet ja F1 pisteet arviointimittareina. Suurempi arvo tarkoittaa parempaa suorituskykyä. Seuraava kuvakaappaus näyttää tuloksemme.

Paranna hienosäätösuorituskykyä SageMakerin automaattisen mallin virityksen avulla

Tässä vaiheessa näytämme, kuinka voit parantaa mallin suorituskykyä entisestään hienosäätämällä mallia SageMakerin automaattisella mallivirityksellä. Automaattinen mallin viritys, joka tunnetaan myös nimellä hyperparametrioptimointi (HPO), löytää mallin parhaan version suorittamalla useita koulutustöitä tietojoukossasi määrittämiesi hyperparametrien avulla. Sitten se valitsee hyperparametriarvot, jotka johtavat malliin, joka toimii parhaiten valitsemasi mittarin mukaan validointitietojoukossa.

Ensin asetimme tavoitteeksi validointitietojen tarkkuuspisteet (val_accuracy) ja määritteli viritystyölle mittareita määrittämällä tavoitemittarin nimen ja säännöllisen lausekkeen (regex). Säännöllistä lauseketta käytetään vastaamaan algoritmin lokitulostusta ja keräämään mittareiden numeeriset arvot. Seuraavaksi määritämme hyperparametrialueet, joista valitaan parhaat hyperparametriarvot. Asetamme viritystöiden kokonaismääräksi kuusi ja jaamme nämä työt kolmelle eri kohdalle Amazonin elastinen laskentapilvi (Amazon EC2) -esiintymät rinnakkaisten viritystöiden suorittamiseen. Katso seuraava koodi:

Välitämme nämä arvot luodaksemme SageMaker Estimator -objektin, samalla tavalla kuin teimme edellisessä hienosäätövaiheessa. Sen sijaan, että soittaisit fit toiminto Estimator esine, ohitamme Estimator objekti parametrina Hyperparametri Viritin rakentaja ja soita fit sen toiminto viritystöiden käynnistämiseksi:

Kun viritystyöt on suoritettu, otamme käyttöön mallin, joka antaa validointitietojoukon parhaan arviointimittarin pistemäärän, teemme johtopäätökset samalle viivästystestitietojoukolle, jota teimme edellisessä osiossa, ja laskemme arviointimittarit.

Tulokset osoittavat, että automaattisella mallivirityksellä valittu malli on huomattavasti parempi kuin edellisessä osiossa hienosäädetty malli pitotestiaineistossa.

Nimetty kokonaisuuden tunnistus

Nimettyjen entiteettien tunnistus (NER) on prosessi, jossa nimetyt entiteetit havaitaan ja luokitellaan ennalta määritettyihin luokkiin, kuten henkilöiden, organisaatioiden, sijaintien ja määrien nimiin. NER:lle on olemassa monia todellisia käyttötapauksia, kuten suositusmoottorit, asiakastukikorttien luokittelu ja osoittaminen oikealle osastolle, olennaisten tietojen poimiminen terveydenhuollon potilasraporteista sekä sisällön luokittelu uutisista ja blogeista.

Ota käyttöön ja suorita päättely esikoulutetulla mallilla

Käytämme En_core_web_md malli spacy kirjasto. spaCy on avoimen lähdekoodin NLP-kirjasto, jota voidaan käyttää erilaisiin tehtäviin ja jossa on sisäänrakennetut menetelmät NER:lle. Käytämme AWS PyTorch Deep Learning Containeria (DLC) komentosarjatilassa ja asennamme spaCy-kirjaston riippuvuutena säilön päälle.

Seuraavaksi aloituskohta skriptille (argumentti entry_point.py) on määritetty, joka sisältää kaiken koodin lataamista ja lataamista varten En_core_web_md mallintaa ja tehdä päätelmiä päätepisteeseen lähetettävistä tiedoista. Lopuksi meidän on vielä tarjottava model_data esikoulutettuna mallina päättelylle. Koska esikoulutettu En_core_web_md malli ladataan lennossa, mikä on määritelty merkintäskriptissä, tarjoamme tyhjän arkistotiedoston. Kun päätepiste on otettu käyttöön, voit kutsua päätepisteen suoraan muistikirjasta SageMaker Python SDK:n avulla. Predictor. Katso seuraava koodi:

Mallin syöttödata on tekstidokumentti. Nimetty entiteettimalli poimii tekstidokumentista substantiivikappaleet ja nimetyt entiteetit ja luokittelee ne useisiin eri tyyppeihin (kuten ihmiset, paikat ja organisaatiot). Esimerkkitulo ja -lähtö näkyvät seuraavassa koodissa. The start_char parametri osoittaa merkkipoikkeaman jakson alussa, ja end_char osoittaa jalan loppua.

Hienosäädä esikoulutettu malli mukautetussa tietojoukossa

Tässä vaiheessa näytämme, kuinka voit hienosäätää valmiiksi koulutettuja NER-kielimalleja omassa tietojoukossasi. Hienosäätövaihe päivittää mallin parametrit omien tietojesi ominaispiirteiden tallentamiseksi ja tarkkuuden parantamiseksi. Käytämme WikiANN (PAN-X) -tietojoukon hienosäätääksesi DistilBERT-pohjainen koteloton Hugging Face muuntajamalli.

Tietojoukko on jaettu koulutus-, validointi- ja testijoukkoon.

Seuraavaksi määritämme mallin hyperparametrit ja käytämme AWS Hugging Face DLC:tä komentosarjatilassa (argumentti entry_point) käynnistääksesi hienosäätötyön:

Kun hienosäätötyö on valmis, otamme käyttöön päätepisteen ja teemme kyselyn siitä päätepisteestä pitotestitiedoilla. Päätepisteen kyselyä varten jokainen tekstimerkkijono on muunnettava yhdeksi tai useaksi tokeniksi ja lähetettävä muuntajamalliin. Jokainen merkki saa ennustetun nimetyn entiteettitunnisteen. Koska jokainen tekstimerkkijono voidaan jakaa yhdeksi tai useaksi tunnisteeksi, meidän on kopioitava merkkijonon perustotuukseksi nimetty entiteettitagi kaikkiin siihen liittyviin merkkeihin. Mukana toimitettu muistikirja opastaa sinua tämän saavuttamiseksi.

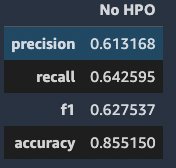

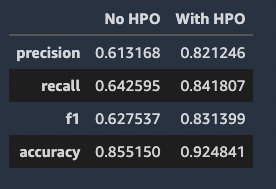

Lopuksi käytämme Hugging Facen sisäänrakennettuja arviointimittareita peräkkäinen laskea arviointipisteitä pitotestin tiedoista. Käytetyt arviointimittarit ovat yleinen tarkkuus, yleinen palautus, yleinen F1 ja tarkkuus. Seuraava kuvakaappaus näyttää tuloksemme.

Paranna hienosäätösuorituskykyä SageMakerin automaattisen mallin virityksen avulla

Tekstiluokituksen tapaan näytämme, kuinka voit parantaa mallin suorituskykyä entisestään hienosäätämällä mallia SageMakerin automaattisella mallivirityksellä. Viritystyön suorittamiseksi meidän on määritettävä objektiivinen mittari, jota haluamme käyttää mallin suorituskyvyn arvioimiseen validointitietojoukossa (tässä tapauksessa F1-pisteet), hyperparametrialueet parhaiden hyperparametriarvojen valitsemiseksi sekä viritystyön kokoonpanot, kuten esim. viritystöiden enimmäismäärä ja samanaikaisesti käynnistettävien rinnakkaisten töiden määrä:

Kun viritystyöt on suoritettu, otamme käyttöön mallin, joka antaa validointitietojoukon parhaan arviointimittarin pistemäärän, teemme johtopäätökset samalle viivästystestitietojoukolle, jota teimme edellisessä osiossa, ja laskemme arviointimittarit.

Näemme, että HPO-mallilla saavutetaan huomattavasti parempi suorituskyky kaikilla mittareilla.

Kysymykseen vastaaminen

Kysymyksiin vastaaminen on hyödyllistä, kun haluat kysyä suuresta tekstimäärästä tiettyä tietoa. Sen avulla käyttäjä voi ilmaista kysymyksen luonnollisella kielellä ja saada välittömän ja lyhyen vastauksen. NLP:llä toimivia kysymyksiin vastausjärjestelmiä voidaan käyttää hakukoneissa ja puhelinkeskusteluliitännöissä.

Ota käyttöön ja suorita päättely esikoulutetulla mallilla

Valmiiksi koulutettu mallimme on EQA (Extractive Question Response) -malli bert-large-uncased-koko-sana-masking-finetuned-squad rakennettu Hugging Facen Transformer-malliin. Käytämme AWS PyTorch DLC:tä komentosarjatilassa ja asennamme muuntajat kirjasto kontin päällä olevana riippuvuutena. Kuten NER-tehtävässä, tarjoamme argumentissa tyhjän arkistotiedoston model_data koska esikoulutettu malli ladataan lennossa. Kun päätepiste on otettu käyttöön, voit kutsua päätepisteen suoraan muistikirjasta SageMaker Python SDK:n avulla. Predictor. Katso seuraava koodi:

Meidän tarvitsee vain rakentaa sanakirjaobjekti kahdella avaimella. context on teksti, josta haluamme hakea tietoja. question on luonnollisen kielen kysely, joka määrittää, mitä tietoja olemme kiinnostuneita poimimaan. Me kutsumme predict ennustajallamme, ja meidän pitäisi saada vastaus päätepisteestä, joka sisältää todennäköisimpiä vastauksia:

Meillä on vastaus, ja voimme tulostaa todennäköisimmin edellisestä tekstistä poimitut vastaukset. Jokaisella vastauksella on luotettavuuspiste, jota käytetään luokitteluun (mutta tätä pistettä ei pidä tulkita todelliseksi todennäköisyydeksi). Kirjaimellisen vastauksen lisäksi saat myös vastauksen alku- ja loppumerkkiindeksit alkuperäisestä kontekstista:

Nyt hienosäädämme tätä mallia omalla mukautetulla tietojoukollamme saadaksemme parempia tuloksia.

Hienosäädä esikoulutettu malli mukautetussa tietojoukossa

Tässä vaiheessa näytämme, kuinka voit hienosäätää valmiiksi koulutettuja kielimalleja EQA:lle omassa tietojoukossasi. Hienosäätövaihe päivittää mallin parametrit omien tietojesi ominaispiirteiden tallentamiseksi ja tarkkuuden parantamiseksi. Käytämme SQUAD2.0 tietojoukko tekstin upotusmallin hienosäätämiseksi bert-base-uncased Hugging Facesta. Hienosäätöön käytettävissä oleva malli liittää tekstin upotusmalliin vastauksen poimivan kerroksen ja alustaa kerroksen parametrit satunnaisiin arvoihin. Hienosäätövaihe hienosäätää kaikki mallin parametrit minimoimaan ennustusvirheen tulodatassa ja palauttaa hienosäädetyn mallin.

Kuten tekstin luokittelutehtävä, tietojoukko (SQuAD2.0) on jaettu koulutukseen, validointiin ja testijoukkoon.

Seuraavaksi määritämme mallin hyperparametrit ja käytämme JumpStart API hienosäätötyön käynnistäminen:

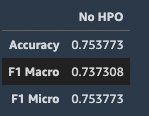

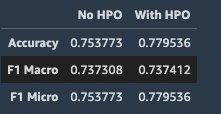

Kun hienosäätötyö on valmis, otamme mallin käyttöön, teemme johtopäätöksen kestotestitietojoukosta ja laskemme arviointimitat. Käytetyt arviointimittarit ovat keskimääräinen tarkka vastaavuuspiste ja keskimääräinen F1-pistemäärä. Seuraava kuvakaappaus näyttää tulokset.

Paranna hienosäätösuorituskykyä SageMakerin automaattisen mallin virityksen avulla

Edellisten osioiden tapaan käytämme a HyperparameterTuner vastustaa viritystöiden käynnistämistä:

Kun viritystyöt on suoritettu, otamme käyttöön mallin, joka antaa validointitietojoukon parhaan arviointimittarin pistemäärän, teemme johtopäätökset samalle viivästystestitietojoukolle, jota teimme edellisessä osiossa, ja laskemme arviointimittarit.

Näemme, että HPO:lla varustettu malli näyttää huomattavasti paremman suorituskyvyn pitotestidatalla.

Suhteen purkaminen

Suhteiden purkaminen on tehtävä poimia tekstistä semanttisia suhteita, joita yleensä esiintyy kahden tai useamman entiteetin välillä. Suhteiden poimiminen on tärkeä rooli jäsennellyn tiedon poimimisessa jäsentämättömistä lähteistä, kuten raakatekstistä. Tässä muistikirjassa esittelemme kaksi käyttötapausta suhteen poimimiseen.

Hienosäädä esikoulutettu malli mukautetussa tietojoukossa

Käytämme suhteen poimintamallia, joka on rakennettu a BERT-pohjainen koteloton malli, jossa käytetään muuntajia Hugging Face muuntajat kirjasto. Hienosäätömalli liittää lineaarisen luokittelukerroksen, joka ottaa tekstin upotusmallin tulostaman merkkiupotusten parin ja alustaa kerroksen parametrit satunnaisiin arvoihin. Hienosäätövaihe hienosäätää kaikki mallin parametrit minimoimaan ennustusvirheen tulodatassa ja palauttaa hienosäädetyn mallin.

Aineisto, jonka mallia hienosäädämme, on SemEval-2010 Tehtävä 8. Hienosäädöllä palautettua mallia voidaan käyttää edelleen päätelmiä varten.

Tietojoukko sisältää koulutus-, validointi- ja testisarjat.

Käytämme AWS PyTorch DLC:tä SageMaker Python SDK:n komentosarjatilan kanssa, jossa transformers kirjasto asennetaan riippuvuutena säilön päälle. Määrittelemme SageMakerin PyTorch estimaattori ja joukko hyperparametrejä, kuten esiopetettu malli, oppimisnopeus ja epookkiluvut hienosäädön suorittamiseksi. Suhteen erotusmallin hienosäätökoodi on määritelty kohdassa entry_point.py. Katso seuraava koodi:

Paranna hienosäätösuorituskykyä SageMakerin automaattisen mallin virityksen avulla

Edellisten osioiden tapaan käytämme a HyperparameterTuner objekti vuorovaikutuksessa SageMakerin hyperparametrien virityssovellusliittymien kanssa. Voimme aloittaa hyperparametrien viritystyön soittamalla fit menetelmä:

Kun hyperparametrien viritystyö on valmis, teemme päättelyn ja tarkistamme arviointipisteet.

Voimme nähdä, että malli, jossa on HPO, näyttää paremman suorituskyvyn pitotestitiedoissa.

Asiakirjan yhteenveto

Asiakirjan tai tekstin yhteenveto on tehtävä tiivistää suuria määriä tekstidataa pienemmäksi osajoukoksi merkityksellisiä lauseita, jotka edustavat alkuperäisen sisällön tärkeintä tai oleellisinta tietoa. Asiakirjan yhteenveto on hyödyllinen tekniikka tärkeiden tietojen tislaamiseen suurista tekstidatamääristä muutamaan lauseeseen. Tekstin yhteenvetoa käytetään monissa käyttötapauksissa, kuten asiakirjojen käsittelyssä ja tiedon poimimisessa blogeista, artikkeleista ja uutisista.

Tämä muistikirja esittelee asiakirjan yhteenvetomallin käyttöönoton T5-pohja mistä Hugging Face muuntajat kirjasto. Testaamme myös käyttöönotettuja päätepisteitä tekstiartikkelin avulla ja arvioimme tuloksia käyttämällä sisäänrakennettua Hugging Face -arviointimittaria RED.

Kuten kysymysvastaamiseen ja NER-muistikirjoihin, käytämme PyTorchModel SageMaker Python SDK:sta yhdessä an entry_point.py komentosarja, joka lataa T5-perusmallin HTTPS-päätepisteeseen. Kun päätepiste on otettu käyttöön onnistuneesti, voimme lähettää tekstiartikkelin päätepisteeseen saadaksemme ennustevastauksen:

Seuraavaksi arvioimme ja vertaamme tekstiartikkelia ja yhteenvetotulosta ROUGE-mittarin avulla. Lasketaan kolme arviointimittaria: rougeN, rougeLja rougeLsum. rougeN mittaa vastaavuuksien määrää n-grams mallin luoman tekstin (yhteenvedon tulos) ja a. välillä reference (sijoita teksti). Mittarit rougeL ja rougeLsum mittaa pisimmät vastaavat sanasekvenssit etsimällä pisimpiä yhteisiä osamerkkijonoja luoduista ja viiteyhteenvedoista. Jokaiselle mittarille lasketaan tarkkuuden, muistamisen ja F1-pisteiden luottamusvälit.Katso seuraava koodi:

Puhdistaa

Tälle ratkaisulle luodut resurssit voidaan poistaa käyttämällä Poista kaikki resurssit -painiketta SageMaker Studio IDE:stä. Jokaisessa muistikirjassa on myös puhdistusosio, jossa on koodi päätepisteiden poistamista varten.

Yhteenveto

Tässä viestissä osoitimme, kuinka käyttää huippuluokan ML-tekniikoita viiden erilaisen NLP-tehtävän ratkaisemiseen: dokumenttien yhteenveto, tekstin luokittelu, kysymykset ja vastaukset, nimettyjen entiteettien tunnistus ja suhteiden purkaminen Jumpstartilla. Aloita Jumpstartilla nyt!

Tietoja Tekijät

Tohtori Xin Huang on Amazon SageMaker JumpStartin ja Amazon SageMakerin sisäänrakennettujen algoritmien soveltava tutkija. Hän keskittyy skaalautuvien koneoppimisalgoritmien kehittämiseen. Hänen tutkimusintressiään ovat luonnollisen kielen prosessointi, selitettävissä oleva syvä oppiminen taulukkotiedoista ja ei-parametrisen aika-avaruusklusteroinnin robusti analyysi. Hän on julkaissut monia artikkeleita ACL-, ICDM-, KDD-konferensseissa ja Royal Statistical Society: Series A -lehdessä.

Tohtori Xin Huang on Amazon SageMaker JumpStartin ja Amazon SageMakerin sisäänrakennettujen algoritmien soveltava tutkija. Hän keskittyy skaalautuvien koneoppimisalgoritmien kehittämiseen. Hänen tutkimusintressiään ovat luonnollisen kielen prosessointi, selitettävissä oleva syvä oppiminen taulukkotiedoista ja ei-parametrisen aika-avaruusklusteroinnin robusti analyysi. Hän on julkaissut monia artikkeleita ACL-, ICDM-, KDD-konferensseissa ja Royal Statistical Society: Series A -lehdessä.

Vivek Gangasani on vanhempi koneoppimisratkaisuarkkitehti Amazon Web Servicesissä. Hän auttaa startup-yrityksiä rakentamaan ja toteuttamaan AI/ML-sovelluksia. Hän keskittyy tällä hetkellä yhdistämään taustansa Containers- ja Machine Learning -alalla tarjotakseen ratkaisuja MLOps-, ML-päätelmä- ja matalan koodin ML:ssä. Vapaa-ajallaan hän nauttii uusien ravintoloiden kokeilemisesta ja uusien tekoälyn ja syväoppimisen trendien tutkimisesta.

Vivek Gangasani on vanhempi koneoppimisratkaisuarkkitehti Amazon Web Servicesissä. Hän auttaa startup-yrityksiä rakentamaan ja toteuttamaan AI/ML-sovelluksia. Hän keskittyy tällä hetkellä yhdistämään taustansa Containers- ja Machine Learning -alalla tarjotakseen ratkaisuja MLOps-, ML-päätelmä- ja matalan koodin ML:ssä. Vapaa-ajallaan hän nauttii uusien ravintoloiden kokeilemisesta ja uusien tekoälyn ja syväoppimisen trendien tutkimisesta.

Geremy Cohen on AWS-ratkaisuarkkitehti, jossa hän auttaa asiakkaita rakentamaan huippuluokan pilvipohjaisia ratkaisuja. Vapaa-ajallaan hän nauttii lyhyistä kävelyretkistä rannalla, tutustu lahden alueeseen perheensä kanssa, korjaa asiat talon ympäri, rikkoo talon ympärillä ja grillaa.

Geremy Cohen on AWS-ratkaisuarkkitehti, jossa hän auttaa asiakkaita rakentamaan huippuluokan pilvipohjaisia ratkaisuja. Vapaa-ajallaan hän nauttii lyhyistä kävelyretkistä rannalla, tutustu lahden alueeseen perheensä kanssa, korjaa asiat talon ympäri, rikkoo talon ympärillä ja grillaa.

Neelam Koshiya on AWS: n yritysratkaisuarkkitehti. Hänen nykyinen painopiste on auttaa yritysasiakkaita heidän pilvipalvelumatkalla strategisten liiketoimintatulosten saavuttamiseksi. Vapaa-ajallaan hän nauttii lukemisesta ja ulkona olemisesta.

Neelam Koshiya on AWS: n yritysratkaisuarkkitehti. Hänen nykyinen painopiste on auttaa yritysasiakkaita heidän pilvipalvelumatkalla strategisten liiketoimintatulosten saavuttamiseksi. Vapaa-ajallaan hän nauttii lukemisesta ja ulkona olemisesta.

- Lisäasetukset (300)

- AI

- ai taide

- ai taiteen generaattori

- ai robotti

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- tekoäly

- tekoälyn sertifiointi

- tekoäly pankkitoiminnassa

- tekoäly robotti

- tekoälyrobotit

- tekoälyohjelmisto

- AWS-koneoppiminen

- blockchain

- blockchain-konferenssi ai

- coingenius

- keskustelullinen tekoäly

- kryptokonferenssi ai

- dall's

- syvä oppiminen

- Asiantuntija (400)

- google ai

- koneoppiminen

- Platon

- plato ai

- Platonin tietotieto

- Platon peli

- PlatonData

- platopeliä

- mittakaava ai

- syntaksi

- zephyrnet