By Kenna Hughes-Castleberry julkaistu 02

Tekniikan kehityksen ansiosta on yhä vaikeampaa sanoa, mikä on totta ja mikä ei. Deepfake-teknologian käyttö pahentaa tätä ongelmaa.ääntä ja videoita jotka käyttävät tekoälyä korvaamaan yksilöitä tai heidän ääniään. Vaikka monia syväväärennöksiä on käytetty menestyksekkäästi viihteeseen (kuten jos Nicholas Cage oli Raiders of the Lost Ark) tai pelaamista (kuten sisään FIFA-urheilijat), suuri osa niistä on luotu enemmän ikäviä syitä. Koska näiden kaarettujen videoiden luominen helpottuu, monet asiantuntijat toivovat, että kvanttilaskenta voi auttaa voittamaan tämän nousevan tekniikan mahdolliset uhat.

Kuinka Deepfake-tekniikka toimii?

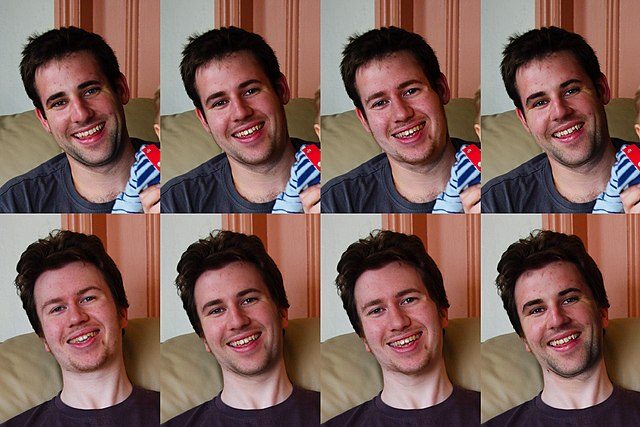

Jotta voit luoda onnistuneen deepfake-videon, tarvitset koneoppiminen algoritmeja. "Syväoppimisalgoritmit opettavat itsensä ratkaisemaan ongelmia suurista tietojoukoista, ja sitten niitä käytetään vaihtamaan kasvoja videon ja muun digitaalisen sisällön välillä", selitti. Kvantinjälkeinen CEO Andersen Cheng. Post-Quantum on johtava kyberturvallisuusyritys, jonka painopiste on kvanttiresistentti turvallisuus, mukaan lukien syväväärennöksiä vastaan. "Näiden syväväärennösten luomiseen on useita menetelmiä", Cheng totesi, "mutta suosituin on käyttää syvän neuroverkkoja, joissa on mukana automaattinen kooderi. An automaattinen kooderi on syväoppiva tekoälyohjelma, joka tutkii videoleikkeitä ymmärtääkseen, miltä ihminen näyttää useista eri näkökulmista ja ympäröivästä ympäristöstä, ja kartoittaa sitten henkilön yksilöön etsimällä yhteisiä piirteitä."

Deepfake-tekniikka perustettu (PC Wikimedia Commons)

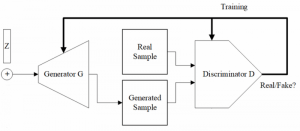

Jotta automaattinen kooderi toimii onnistuneesti, useita videoleikkeitä kohteen kasvoista on analysoitava, jotta saadaan suurempi tietovarasto. Sitten automaattinen kooderi voi auttaa luomaan yhdistelmävideon vaihtamalla alkuperäisen henkilön uuteen aiheeseen. Toinen koneoppimistyyppi, nimeltään General Adversarial Network (GAN) havaitsee ja parantaa uuden yhdistelmävideon puutteet. Mukaan a 2022 artikkeli: "GAN:t kouluttavat "generaattorin" luomaan uusia kuvia lähdekuvan piilevasta esityksestä ja "eristäjän" arvioimaan luotujen materiaalien realistisuutta." Tämä prosessi tapahtuu useita kertoja, kunnes erottaja ei voi tietää, onko video kaarettu ja syväväärennös on valmis.

Deepfake-teknologian uhka

Tällä hetkellä on olemassa monia avoimen lähdekoodin ohjelmistoja tai ilmaisia sovelluksia, joita ihmiset voivat käyttää syväväärennösten luomiseen. Vaikka tämä saattaa tuntua hyödylliseltä monille, erityisesti viihdeteollisuuden toimijoille, se on johtanut vakaviin, jopa rikollisiin ongelmiin. Mukaan a Deeptrace-raportti, 96 % netissä vuonna 2019 olevista deepfake-videoista oli, ei yllättävää, pornografiaa. Vaikka monet näistä laittomista videoista tehtiin kostaakseen exille, toisia käytettiin naisjulkkiksille ja jopa poliitikoille skandaalien luomiseen. Vuonna 2018 Deepfake-video julkaistiin a Belgian poliittinen puolue näyttää silloisen presidentin Trumpin keskustelemassa Pariisin ilmastosopimuksista. Koska valeuutisista on jo tulossa suuren yleisön ongelma, syväfake-videot voivat olla pilli, joka katkaisee kamelin selän. Jopa syvä-ääni on aiheuttamassa tuhoa, koska yksi toistettu äänitiedosto CEO teknologiayrityksen auttoi tekemään petoksen. Chengille tämäntyyppiset tiedotusvälineet voivat kuluttaa yleisön luottamuksen melko nopeasti. "Meillä on laajempi kysymys yhteiskunnallisesta luottamuksesta - kuinka yleisö pystyy erottamaan sen välillä, mikä on todellista ja mikä on väärennös", Cheng lisäsi. "Kuten olemme nähneet, on jopa todisteita siitä, että syväväärennöksiä käytetään ohittamaan suojatoimenpiteet, kuten biometrinen todennus." Näiden kasvavien huolenaiheiden vuoksi Cheng ja hänen tiiminsä Post-Quantumissa uskovat, että heillä on ratkaisu Nomidio, erikoistunut erittäin suojattu ohjelmisto.

Valmistautuminen DeepFake-teknologian uhkiin

Tarkastellessaan kvanttilaskennan ja syväväärennösten aiheuttamia useita uhkia Cheng ja tämä tiimi loivat Nomidion varmistaakseen, että kirjautumistunnukset ja jopa biometrinen todennus pysyvät turvassa. "Nomidio on biometrinen, salasanaton monitekijäbiometrinen (MFB) -palvelu, joka mahdollistaa turvallisen todennuksen yksinkertaisella ja intuitiivisella käyttökokemuksella", Cheng sanoi. "Se korvaa käyttäjätunnukseen/salasanaan perustuvan kirjautumisen ja kertakirjautumisen, jolloin käyttäjät todennetaan heidän biometrisen profiilinsa perusteella monitekijätodennuksella (MFA) kulissien takana." Koska Cheng on ollut kyberturvallisuuden asiantuntija useiden vuosien ajan, hän varmisti, että Nomidio voi olla suojattu myös syväväärennöksiä vastaan. "Ydinfilosofiamme sitä luodessaan oli käyttää mahdollisimman paljon lisäsyöttöä ja todellista monitekijätodennusta (eli useammalla kuin kahdella tekijällä), joten se on itse asiassa ihanteellinen ratkaisu kaikenlaiseen deepfake-teknologian tulevaan kehitykseen. Tämä johtuu viime kädessä siitä, että perinteinen MFA ei riitä, mutta MFB voi tehdä reaaliaikaisista hyökkäyksistä käytännössä mahdottomaksi. Toisin sanoen esimerkiksi äänen, kasvojen ja PIN-koodin yhdistelmä on erittäin turvallinen, koska mikä tahansa yksittäinen tekijä voi olla mahdollista väärentää, mutta kaikkien kolmen väärentäminen samassa tapauksessa on käytännössä mahdotonta. Nomidion avulla ääni- ja kasvojen biometriikan, puheentunnistuksen, kontekstiriippuvaisen datan ja jopa käyttäytymisanalyysin yhdistelmä voidaan yhdistää yhdeksi todennusjärjestelmäksi. ”

Vaikka Nomidio itse ei hyödynnä kvanttilaskentaa syvän väärennösuhkien voittamiseksi, kvanttitietokoneet voivat mahdollisesti toimia näitä väärennettyjä mediatiedostoja vastaan. Kuten kvantitietokoneet usein valjastaa koneoppimisalgoritmeja toimimaan nopeammin ja tehokkaammin, ne saattavat pystyä havaitsemaan vääriä videoita tai äänitiedostoja nopeammin. Vaikka tekniikkaa kehitetään edelleen, ja harvat katsovat syväväärennöksiä mahdollisena käyttötapana kvanttitietokoneille, näitä seuraavan tason koneita voitaisiin käyttää tulevaisuudessa tekemään mediastamme totuudenmukaisempia ja tarkempia.

Deepfake-teknologian uhkien tullessa yhä selvemmiksi, monet hallitukset ja yritykset yrittävät jo löytää tapoja torjua sitä. Vuonna 2021 Facebook lanseerasi Deepfake Detection Challenge500,000 XNUMX dollarin palkinnolla niille, jotka luovat uutta teknologiaa syväväärennösten havaitsemiseksi. Yhdysvalloissa Kalifornian, Texasin ja Virginian kaltaisissa osavaltioissa on lakeja, jotka kieltävät syvän väärennösten käytön sekä pornografiassa että politiikassa. The Euroopan parlamentti vahvisti myös lisää säännöksiä syväväärennösten ympärille ja muutti digitaalisten palveluiden lakia määräämään tarrojen käyttämisestä deepfake-videoissa. Vaikka tämä lainsäädäntö tulee voimaan vasta vuonna 2024, se osoittaa syvän väärennösteknologian uhan vakavuuden.

Kenna Hughes-Castleberry on Inside Quantum Technologyn ja JILAn Science Communicatorin (kumppanuus Colorado Boulderin yliopiston ja NISTin välillä) kirjoittaja. Hänen kirjoitustyylinsä sisältävät syväteknologiaa, metaversumia ja kvanttitekniikkaa.