IA générative les applications pilotées par des modèles fondamentaux (FM) permettent aux organisations d'avoir une valeur commerciale significative en termes d'expérience client, de productivité, d'optimisation des processus et d'innovations. Cependant, l'adoption de ces FM implique de relever certains défis clés, notamment la qualité des résultats, la confidentialité des données, la sécurité, l'intégration avec les données de l'organisation, le coût et les compétences à fournir.

Dans cet article, nous explorons différentes approches que vous pouvez adopter lors de la création d'applications utilisant l'IA générative. Avec l’évolution rapide des FM, c’est une période passionnante pour exploiter leur puissance, mais également cruciale pour comprendre comment les utiliser correctement pour obtenir des résultats commerciaux. Nous fournissons un aperçu des principales approches d'IA générative, notamment l'ingénierie rapide, la génération augmentée par récupération (RAG) et la personnalisation des modèles. Lors de l’application de ces approches, nous discutons des considérations clés concernant les hallucinations potentielles, l’intégration avec les données de l’entreprise, la qualité des résultats et le coût. À la fin, vous disposerez de directives solides et d'un organigramme utile pour déterminer la meilleure méthode pour développer vos propres applications FM, fondées sur des exemples réels. Qu'il s'agisse de créer un chatbot ou un outil de synthèse, vous pouvez créer de puissants FM adaptés à vos besoins.

IA générative avec AWS

L’émergence des FM crée à la fois des opportunités et des défis pour les organisations qui cherchent à utiliser ces technologies. L’un des principaux défis consiste à garantir des résultats cohérents et de haute qualité qui correspondent aux besoins de l’entreprise, plutôt qu’aux hallucinations ou aux fausses informations. Les organisations doivent également gérer soigneusement les risques en matière de confidentialité et de sécurité des données qui découlent du traitement de données exclusives avec les FM. Les compétences nécessaires pour intégrer, personnaliser et valider correctement les FM dans les systèmes et données existants sont rares. La création de grands modèles linguistiques (LLM) à partir de zéro ou la personnalisation de modèles pré-entraînés nécessite des ressources de calcul substantielles, des data scientists experts et des mois de travail d'ingénierie. Le coût de calcul à lui seul peut facilement atteindre des millions de dollars pour entraîner des modèles avec des centaines de milliards de paramètres sur des ensembles de données massifs utilisant des milliers de GPU ou de TPU. Au-delà du matériel, le nettoyage et le traitement des données, la conception d'architecture de modèle, le réglage des hyperparamètres et le développement de pipelines de formation nécessitent des compétences spécialisées en apprentissage automatique (ML). Le processus de bout en bout est complexe, long et d’un coût prohibitif pour la plupart des organisations sans l’infrastructure et l’investissement en talents requis. Les organisations qui ne parviennent pas à gérer ces risques de manière adéquate peuvent subir des impacts négatifs sur la réputation de leur marque, la confiance de leurs clients, leurs opérations et leurs revenus.

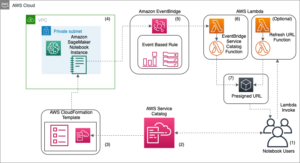

Socle amazonien est un service entièrement géré qui offre un choix de modèles de base (FM) hautes performances provenant de grandes sociétés d'IA telles que AI21 Labs, Anthropic, Cohere, Meta, Mistral AI, Stability AI et Amazon via une seule API. Avec l'expérience sans serveur Amazon Bedrock, vous pouvez démarrer rapidement, personnaliser les FM en privé avec vos propres données, puis les intégrer et les déployer dans vos applications à l'aide des outils AWS sans avoir à gérer d'infrastructure. Amazon Bedrock est éligible HIPAA et vous pouvez utiliser Amazon Bedrock conformément au RGPD. Avec Amazon Bedrock, votre contenu n'est pas utilisé pour améliorer les modèles de base et n'est pas partagé avec des fournisseurs de modèles tiers. Vos données dans Amazon Bedrock sont toujours chiffrées en transit et au repos, et vous pouvez éventuellement chiffrer les ressources à l'aide de vos propres clés. Vous pouvez utiliser Lien privé AWS avec Amazon Bedrock pour établir une connectivité privée entre vos FM et votre VPC sans exposer votre trafic à Internet. Avec Bases de connaissances pour Amazon Bedrock, vous pouvez fournir aux responsables des finances et aux agents des informations contextuelles provenant des sources de données privées de votre entreprise afin que RAG puisse fournir des réponses plus pertinentes, précises et personnalisées. Vous pouvez personnaliser les FM en privé avec vos propres données via une interface visuelle sans écrire de code. En tant que service entièrement géré, Amazon Bedrock offre une expérience de développement simple pour travailler avec une large gamme de FM hautes performances.

Lancé en 2017, Amazon Sage Maker est un service entièrement géré qui facilite la création, la formation et le déploiement de modèles ML. De plus en plus de clients créent leurs propres FM à l'aide de SageMaker, notamment Stability AI, AI21 Labs, Hugging Face, Perplexity AI, Hippocratic AI, LG AI Research et Technology Innovation Institute. Pour vous aider à démarrer rapidement, Amazon SageMaker JumpStart propose un hub ML où vous pouvez explorer, former et déployer une large sélection de FM publics, tels que les modèles Mistral, les modèles LightOn, RedPajama, Mosiac MPT-7B, FLAN-T5/UL2, GPT-J-6B/Neox-20B , et Bloom/BloomZ, en utilisant des outils SageMaker spécialement conçus tels que des expériences et des pipelines.

Approches courantes de l’IA générative

Dans cette section, nous discutons des approches courantes pour mettre en œuvre des solutions d'IA générative efficaces. Nous explorons les techniques d'ingénierie rapides populaires qui vous permettent de réaliser des tâches plus complexes et intéressantes avec les FM. Nous discutons également de la façon dont des techniques telles que RAG et la personnalisation des modèles peuvent améliorer davantage les capacités des FM et surmonter des défis tels que les données limitées et les contraintes informatiques. Avec la bonne technique, vous pouvez créer des solutions d’IA générative puissantes et percutantes.

Ingénierie rapide

L'ingénierie des invites consiste à concevoir soigneusement des invites pour exploiter efficacement les capacités des FM. Cela implique l'utilisation d'invites, qui sont de courts morceaux de texte qui guident le modèle pour générer des réponses plus précises et pertinentes. Avec une ingénierie rapide, vous pouvez améliorer les performances des FM et les rendre plus efficaces pour une variété d'applications. Dans cette section, nous explorons des techniques telles que les invites à tir zéro et à quelques tirs, qui adaptent rapidement les FM à de nouvelles tâches avec seulement quelques exemples, et les invites de chaîne de pensée, qui décomposent un raisonnement complexe en étapes intermédiaires. Ces méthodes démontrent comment une ingénierie rapide peut rendre les FM plus efficaces sur des tâches complexes sans nécessiter de recyclage du modèle.

Invite de tir zéro

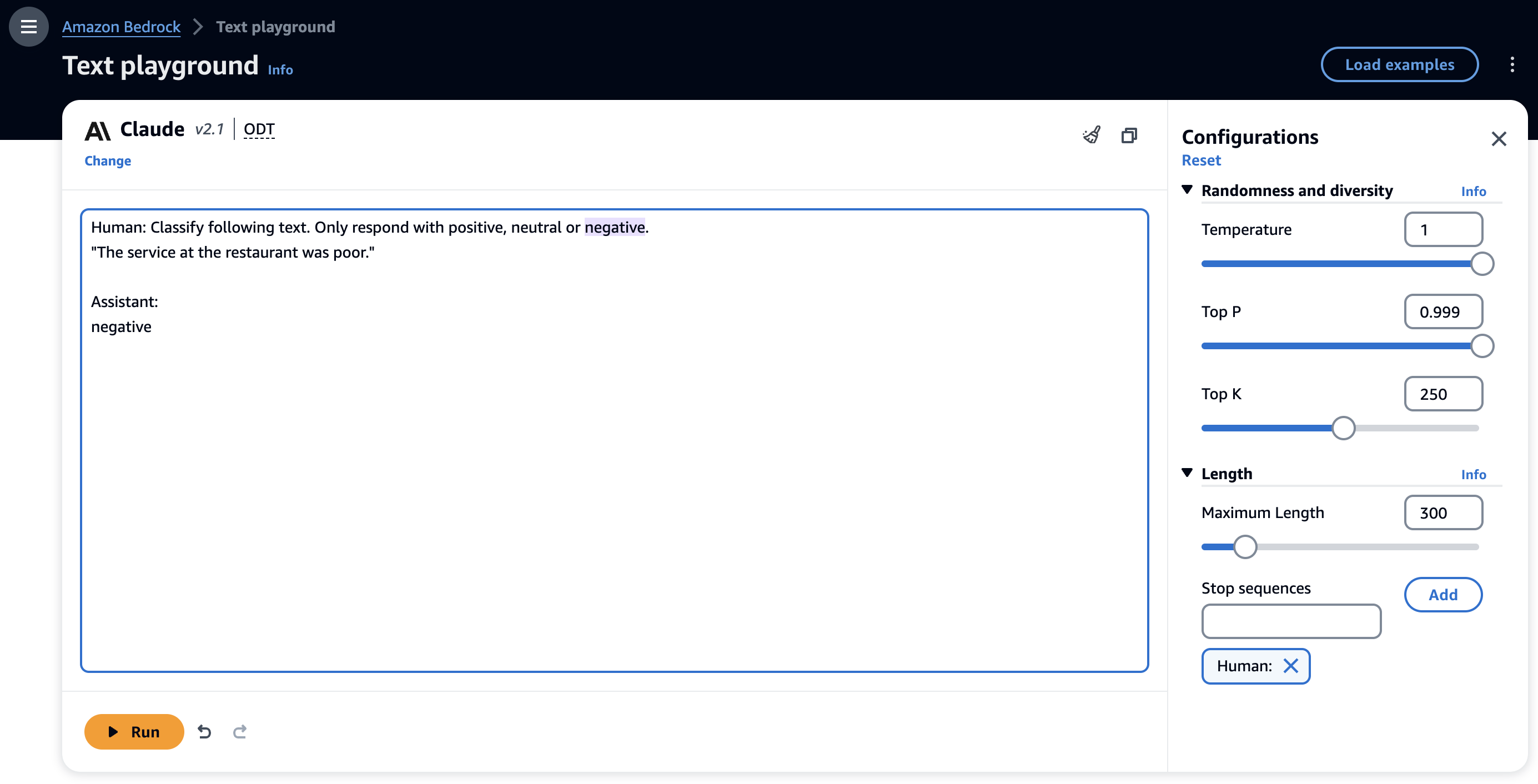

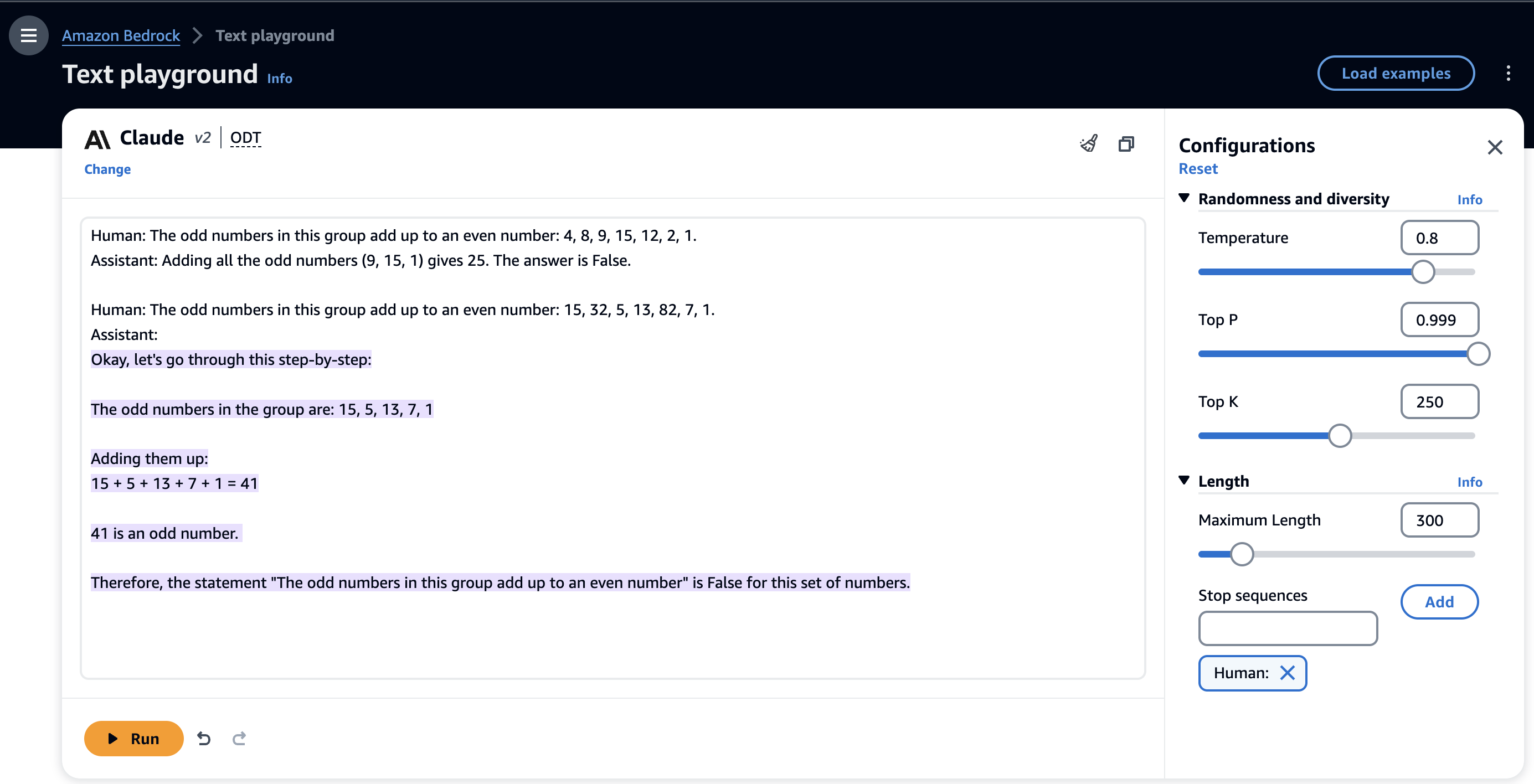

Une technique d'invite sans tir nécessite que les FM génèrent une réponse sans fournir d'exemples explicites du comportement souhaité, en s'appuyant uniquement sur sa pré-formation. La capture d'écran suivante montre un exemple d'invite de tir zéro avec le modèle Anthropic Claude 2.1 sur la console Amazon Bedrock.

Dans ces instructions, nous n'avons fourni aucun exemple. Cependant, le modèle peut comprendre la tâche et générer un résultat approprié. Les invites Zero-shot sont la technique d'invite la plus simple pour commencer lors de l'évaluation d'un FM pour votre cas d'utilisation. Cependant, bien que les FM soient remarquables avec leurs invites de tir zéro, ils ne donnent pas toujours les résultats précis ou souhaités pour des tâches plus complexes. Lorsque les invites de tir zéro échouent, il est recommandé de fournir quelques exemples dans l'invite (invites de quelques tirs).

Invite à quelques tirs

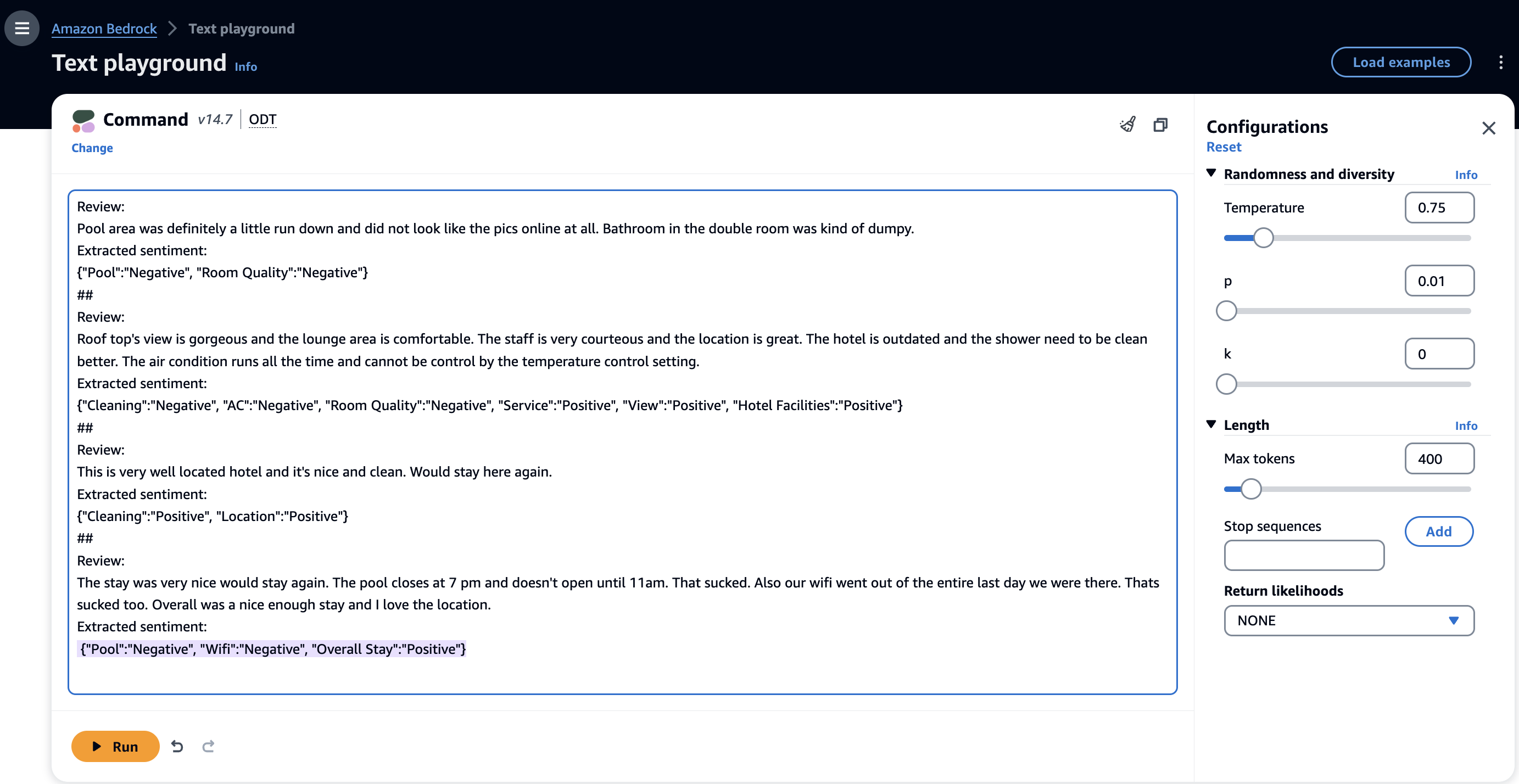

La technique des invites en quelques coups permet aux FM d'effectuer un apprentissage en contexte à partir des exemples contenus dans les invites et d'effectuer la tâche avec plus de précision. Avec seulement quelques exemples, vous pouvez rapidement adapter les FM à de nouvelles tâches sans grands ensembles de formation et les guider vers le comportement souhaité. Voici un exemple d'invite en quelques étapes avec le modèle Cohere Command sur la console Amazon Bedrock.

Dans l'exemple précédent, le FM a pu identifier les entités à partir du texte saisi (avis) et extraire les sentiments associés. Les invites en quelques étapes constituent un moyen efficace d'aborder des tâches complexes en fournissant quelques exemples de paires entrée-sortie. Pour les tâches simples, vous pouvez donner un exemple (1 plan), tandis que pour les tâches plus difficiles, vous devez fournir trois (3 plans) à cinq (5 plans). Min et coll. (2022) a publié des résultats sur l'apprentissage en contexte qui peuvent améliorer les performances de la technique d'incitation en quelques coups. Vous pouvez utiliser les invites en quelques étapes pour diverses tâches, telles que l'analyse des sentiments, la reconnaissance d'entités, la réponse aux questions, la traduction et la génération de code.

Invite de chaîne de pensée

Malgré leur potentiel, les invites en quelques tirs présentent des limites, en particulier lorsqu'il s'agit de tâches de raisonnement complexes (telles que des tâches arithmétiques ou logiques). Ces tâches nécessitent de décomposer le problème en étapes, puis de le résoudre. Wei et coll. (2022) a introduit la technique d'incitation à la chaîne de pensée (CoT) pour résoudre des problèmes de raisonnement complexes à travers des étapes de raisonnement intermédiaires. Vous pouvez combiner CoT avec des invites en quelques étapes pour améliorer les résultats sur des tâches complexes. Voici un exemple de tâche de raisonnement utilisant des invites CoT en quelques étapes avec le modèle Anthropic Claude 2 sur la console Amazon Bedrock.

Kojima et coll. (2022) a introduit une idée de CoT zéro tir en utilisant les capacités zéro tir inexploitées des FM. Leurs recherches indiquent que le CoT zéro tir, utilisant le même modèle d'invite unique, surpasse considérablement les performances FM zéro tir sur diverses tâches de raisonnement de référence. Vous pouvez utiliser l'invite CoT sans tir pour des tâches de raisonnement simples en ajoutant « Pensons étape par étape » à l'invite d'origine.

Réagir

Les invites CoT peuvent améliorer les capacités de raisonnement des FM, mais elles dépendent toujours des connaissances internes du modèle et ne prennent en compte aucune base de connaissances ou environnement externe pour recueillir plus d'informations, ce qui peut conduire à des problèmes tels que des hallucinations. L'approche ReAct (raisonnement et action) comble cette lacune en étendant CoT et en permettant un raisonnement dynamique utilisant un environnement externe (tel que Wikipédia).

Intégration

Les FM ont la capacité de comprendre les questions et de fournir des réponses en utilisant leurs connaissances pré-formées. Cependant, ils n'ont pas la capacité de répondre aux requêtes nécessitant l'accès aux données privées d'une organisation ou la capacité d'effectuer des tâches de manière autonome. RAG et les agents sont des méthodes permettant de connecter ces applications génératives basées sur l'IA aux ensembles de données d'entreprise, leur permettant de donner des réponses qui tiennent compte des informations organisationnelles et de permettre l'exécution d'actions basées sur les demandes.

Récupération Génération Augmentée

La génération augmentée de récupération (RAG) vous permet de personnaliser les réponses d'un modèle lorsque vous souhaitez que le modèle prenne en compte de nouvelles connaissances ou des informations à jour. Lorsque vos données changent fréquemment, comme l'inventaire ou les prix, il n'est pas pratique d'affiner et de mettre à jour le modèle pendant qu'il répond aux requêtes des utilisateurs. Pour équiper le FM d'informations propriétaires à jour, les organisations se tournent vers RAG, une technique qui consiste à récupérer des données à partir des sources de données de l'entreprise et à enrichir l'invite avec ces données pour fournir des réponses plus pertinentes et plus précises.

Il existe plusieurs cas d'utilisation dans lesquels RAG peut contribuer à améliorer les performances FM :

- Question répondant – Les modèles RAG aident les applications de réponse aux questions à localiser et à intégrer des informations provenant de documents ou de sources de connaissances pour générer des réponses de haute qualité. Par exemple, une application de réponse aux questions pourrait récupérer des passages sur un sujet avant de générer une réponse récapitulative.

- Chatbots et agents conversationnels – RAG permet aux chatbots d’accéder à des informations pertinentes provenant de vastes sources de connaissances externes. Cela rend les réponses du chatbot plus informées et plus naturelles.

- Aide à la rédaction – RAG peut suggérer du contenu, des faits et des points de discussion pertinents pour vous aider à rédiger plus efficacement des documents tels que des articles, des rapports et des e-mails. Les informations récupérées fournissent un contexte et des idées utiles.

- Récapitulation – RAG peut trouver des documents sources, des passages ou des faits pertinents pour améliorer la compréhension d'un modèle de synthèse sur un sujet, lui permettant ainsi de générer de meilleurs résumés.

- Écriture créative et narration – RAG peut extraire des idées d’intrigue, des personnages, des décors et des éléments créatifs d’histoires existantes pour inspirer des modèles de génération d’histoires IA. Cela rend la sortie plus intéressante et plus fondée.

- Traduction – RAG peut trouver des exemples de la façon dont certaines phrases sont traduites entre les langues. Cela fournit un contexte au modèle de traduction, améliorant ainsi la traduction des phrases ambiguës.

- Personnalisation – Dans les chatbots et les applications de recommandation, RAG peut extraire le contexte personnel comme les conversations passées, les informations de profil et les préférences pour rendre les réponses plus personnalisées et pertinentes.

Il y a plusieurs avantages à utiliser un framework RAG :

- Hallucinations réduites – La récupération d’informations pertinentes permet d’ancrer le texte généré dans des faits et des connaissances du monde réel, plutôt que dans un texte hallucinant. Cela favorise des réponses plus précises, factuelles et dignes de confiance.

- Couverture – La récupération permet à un FM de couvrir un plus large éventail de sujets et de scénarios au-delà de ses données de formation en extrayant des informations externes. Cela permet de résoudre les problèmes de couverture limités.

- Efficacité – La récupération permet au modèle de concentrer sa génération sur les informations les plus pertinentes, plutôt que de tout générer à partir de zéro. Cela améliore l’efficacité et permet d’utiliser des contextes plus larges.

- Sécurité – La récupération des informations à partir des sources de données requises et autorisées peut améliorer la gouvernance et le contrôle de la génération de contenu nuisible et inexact. Cela favorise une adoption plus sûre.

- Évolutivité – L’indexation et la récupération à partir de grands corpus permettent à l’approche de mieux évoluer par rapport à l’utilisation du corpus complet lors de la génération. Cela vous permet d'adopter des FM dans des environnements aux ressources plus limitées.

RAG produit des résultats de qualité, grâce à l'augmentation du contexte spécifique au cas d'utilisation directement à partir des magasins de données vectorisées. Par rapport à l’ingénierie rapide, elle produit des résultats considérablement améliorés avec des risques d’hallucinations extrêmement faibles. Vous pouvez créer des applications basées sur RAG sur les données de votre entreprise à l'aide de Amazone Kendra. RAG est plus complexe que l'ingénierie rapide, car vous devez posséder des compétences en codage et en architecture pour mettre en œuvre cette solution. Cependant, les bases de connaissances pour Amazon Bedrock offrent une expérience RAG entièrement gérée et le moyen le plus simple de démarrer avec RAG dans Amazon Bedrock. Les bases de connaissances pour Amazon Bedrock automatisent le flux de travail RAG de bout en bout, y compris l'ingestion, la récupération et l'augmentation des invites, vous évitant ainsi d'avoir à écrire du code personnalisé pour intégrer les sources de données et gérer les requêtes. La gestion du contexte de session est intégrée afin que votre application puisse prendre en charge les conversations à plusieurs tours. Les réponses de la base de connaissances sont accompagnées de citations de sources pour améliorer la transparence et minimiser les hallucinations. Le moyen le plus simple de créer un assistant alimenté par l'IA générative consiste à utiliser Amazon Q, qui dispose d'un système RAG intégré.

RAG offre le plus haut degré de flexibilité en matière de modifications de l'architecture. Vous pouvez modifier le modèle d'intégration, le magasin de vecteurs et FM indépendamment avec un impact minimal à modéré sur les autres composants. Pour en savoir plus sur l'approche RAG avec Service Amazon OpenSearch et Amazon Bedrock, reportez-vous à Créez des flux de travail RAG évolutifs et sans serveur avec un moteur vectoriel pour les modèles Amazon OpenSearch Serverless et Amazon Bedrock Claude. Pour savoir comment implémenter RAG avec Amazon Kendra, reportez-vous à Exploiter la puissance des données d'entreprise avec l'IA générative : informations d'Amazon Kendra, LangChain et de grands modèles linguistiques.

Agents

Les FM peuvent comprendre et répondre aux requêtes sur la base de leurs connaissances pré-formées. Cependant, ils ne sont pas en mesure d’accomplir seuls des tâches réelles, comme réserver un vol ou traiter un bon de commande. En effet, ces tâches nécessitent des données et des flux de travail spécifiques à l'organisation qui nécessitent généralement une programmation personnalisée. Des cadres comme LangChaîne et certains FM tels que les modèles Claude offrent des capacités d'appel de fonctions pour interagir avec les API et les outils. Cependant, Agents pour le substrat rocheux d’Amazonie, une nouvelle fonctionnalité d'IA entièrement gérée d'AWS, vise à permettre aux développeurs de créer plus facilement des applications à l'aide de FM de nouvelle génération. En quelques clics, il peut automatiquement décomposer les tâches et générer la logique d'orchestration requise, sans avoir besoin de codage manuel. Les agents peuvent se connecter en toute sécurité aux bases de données de l'entreprise via des API, ingérer et structurer les données pour la consommation des machines, et les compléter avec des détails contextuels pour produire des réponses plus précises et répondre aux demandes. Parce qu'il gère l'intégration et l'infrastructure, Agents for Amazon Bedrock vous permet d'exploiter pleinement l'IA générative pour les cas d'utilisation professionnels. Les développeurs peuvent désormais se concentrer sur leurs applications principales plutôt que sur la plomberie de routine. Le traitement automatisé des données et les appels API permettent également à FM de fournir des réponses mises à jour et personnalisées et d'effectuer des tâches réelles en utilisant des connaissances exclusives.

Personnalisation du modèle

Les modèles Foundation sont extrêmement performants et permettent d'excellentes applications, mais ce qui vous aidera à stimuler votre entreprise est une IA générative qui sait ce qui est important pour vos clients, vos produits et votre entreprise. Et cela n’est possible que lorsque vous surchargez les modèles avec vos données. Les données sont la clé pour passer d’applications génériques à des applications d’IA générative personnalisées qui créent une réelle valeur pour vos clients et votre entreprise.

Dans cette section, nous discutons des différentes techniques et avantages de la personnalisation de vos FM. Nous expliquons comment la personnalisation du modèle implique une formation supplémentaire et la modification des poids du modèle pour améliorer ses performances.

Réglage fin

Le réglage fin est le processus consistant à prendre un FM pré-entraîné, tel que Llama 2, et à le former davantage sur une tâche en aval avec un ensemble de données spécifique à cette tâche. Le modèle pré-entraîné fournit des connaissances linguistiques générales et un réglage fin lui permet de se spécialiser et d'améliorer les performances sur une tâche particulière telle que la classification de texte, la réponse à des questions ou la génération de texte. Avec un réglage fin, vous fournissez des ensembles de données étiquetés, annotés avec un contexte supplémentaire, pour entraîner le modèle sur des tâches spécifiques. Vous pouvez ensuite adapter les paramètres du modèle pour la tâche spécifique en fonction de votre contexte métier.

Vous pouvez mettre en œuvre un réglage fin sur les FM avec Amazon SageMaker JumpStart et le substrat rocheux amazonien. Pour plus de détails, reportez-vous à Déployez et affinez les modèles de base dans Amazon SageMaker JumpStart avec deux lignes de code ainsi que les Personnalisez les modèles dans Amazon Bedrock avec vos propres données à l'aide d'un réglage fin et d'une pré-formation continue.

Pré-formation continue

La pré-formation continue dans Amazon Bedrock vous permet d'enseigner à un modèle préalablement formé sur des données supplémentaires similaires à ses données d'origine. Cela permet au modèle d'acquérir des connaissances linguistiques plus générales plutôt que de se concentrer sur une seule application. Avec une pré-formation continue, vous pouvez utiliser vos ensembles de données non étiquetés, ou vos données brutes, pour améliorer la précision du modèle de base de votre domaine en ajustant les paramètres du modèle. Par exemple, une entreprise de soins de santé peut continuer à pré-entraîner son modèle à l’aide de revues médicales, d’articles et de documents de recherche pour mieux connaître la terminologie du secteur. Pour plus de détails, reportez-vous à Expérience de développeur Amazon Bedrock.

Avantages de la personnalisation du modèle

La personnalisation du modèle présente plusieurs avantages et peut aider les organisations dans les domaines suivants :

- Adaptation spécifique au domaine – Vous pouvez utiliser un FM à usage général, puis le former davantage sur les données d'un domaine spécifique (tel que biomédical, juridique ou financier). Cela adapte le modèle au vocabulaire, au style, etc. de ce domaine.

- Ajustement spécifique à la tâche – Vous pouvez prendre un FM pré-formé et l'affiner sur les données pour une tâche spécifique (telle que l'analyse des sentiments ou la réponse aux questions). Cela spécialise le modèle pour cette tâche particulière.

- Personnalisation – Vous pouvez personnaliser un FM sur les données d'un individu (e-mails, textes, documents qu'il a rédigés) pour adapter le modèle à son style unique. Cela peut permettre des applications plus personnalisées.

- Optimisation des langues à faibles ressources – Vous pouvez recycler uniquement les couches supérieures d’un FM multilingue sur une langue à faibles ressources pour mieux l’adapter à cette langue.

- Correction des défauts – Si certains comportements inattendus sont découverts dans un modèle, la personnalisation des données appropriées peut aider à mettre à jour le modèle afin de réduire ces défauts.

La personnalisation du modèle permet de surmonter les défis suivants en matière d'adoption de FM :

- Adaptation à de nouveaux domaines et tâches – Les FM pré-formés sur des corpus de textes généraux doivent souvent être affinés sur des données spécifiques à une tâche pour bien fonctionner pour les applications en aval. Le réglage fin adapte le modèle à de nouveaux domaines ou tâches pour lesquels il n'a pas été initialement formé.

- Surmonter les préjugés – Les FM peuvent présenter des biais par rapport à leurs données de formation originales. La personnalisation d'un modèle sur de nouvelles données peut réduire les biais indésirables dans les résultats du modèle.

- Améliorer l'efficacité des calculs – Les FM pré-entraînés sont souvent très volumineux et coûteux en termes de calcul. La personnalisation du modèle peut permettre de réduire la taille du modèle en éliminant les paramètres sans importance, rendant ainsi le déploiement plus réalisable.

- Gérer des données cibles limitées – Dans certains cas, les données réelles disponibles pour la tâche cible sont limitées. La personnalisation du modèle utilise les poids pré-entraînés appris sur des ensembles de données plus volumineux pour surmonter cette rareté des données.

- Améliorer la performance des tâches – Le réglage fin améliore presque toujours les performances sur les tâches cibles par rapport à l’utilisation des poids pré-entraînés d’origine. Cette optimisation du modèle pour son utilisation prévue vous permet de déployer avec succès des FM dans des applications réelles.

La personnalisation du modèle est plus complexe que l'ingénierie rapide et RAG, car le poids et les paramètres du modèle sont modifiés via des scripts de réglage, ce qui nécessite une expertise en science des données et en ML. Cependant, Amazon Bedrock simplifie la tâche en vous offrant une expérience gérée pour personnaliser les modèles avec réglage fin or poursuite de la pré-formation. La personnalisation du modèle fournit des résultats très précis avec une qualité de sortie comparable à celle de RAG. Étant donné que vous mettez à jour les pondérations du modèle sur des données spécifiques à un domaine, le modèle produit des réponses plus contextuelles. Par rapport à RAG, la qualité peut être légèrement meilleure selon le cas d'utilisation. Il est donc important de procéder à une analyse de compromis entre les deux techniques. Vous pouvez potentiellement implémenter RAG avec un modèle personnalisé.

Recyclage ou formation à partir de zéro

Construire votre propre modèle d'IA de base plutôt que d'utiliser uniquement des modèles publics pré-entraînés permet un meilleur contrôle, des performances améliorées et une personnalisation selon les cas d'utilisation et les données spécifiques de votre organisation. Investir dans la création d’un FM sur mesure peut offrir une meilleure adaptabilité, des mises à niveau et un meilleur contrôle des capacités. La formation distribuée permet l'évolutivité nécessaire pour former de très grands FM sur des ensembles de données massifs sur de nombreuses machines. Cette parallélisation rend réalisables des modèles avec des centaines de milliards de paramètres entraînés sur des milliards de jetons. Les modèles plus grands ont une plus grande capacité d’apprentissage et de généralisation.

La formation à partir de zéro peut produire des résultats de haute qualité, car le modèle s'entraîne à partir de données spécifiques à un cas d'utilisation, les risques d'hallucinations sont rares et la précision du résultat peut être parmi les plus élevées. Cependant, si votre ensemble de données évolue constamment, vous pouvez toujours rencontrer des problèmes d’hallucinations. La formation à partir de zéro présente la complexité de mise en œuvre et le coût les plus élevés. Cela nécessite le plus d'efforts car cela nécessite de collecter une grande quantité de données, de les conserver et de les traiter, ainsi que de former un FM assez important, ce qui nécessite une expertise approfondie en science des données et en ML. Cette approche prend du temps (cela peut généralement prendre des semaines, voire des mois).

Vous devriez envisager de former un FM à partir de zéro lorsqu'aucune des autres approches ne fonctionne pour vous, et vous avez la possibilité de créer un FM avec une grande quantité de données tokenisées bien organisées, un budget sophistiqué et une équipe d'experts en ML hautement qualifiés. . AWS fournit l'infrastructure cloud la plus avancée pour former et exécuter des LLM et autres FM alimentés par des GPU et la puce de formation ML spécialement conçue, Formation AWS, et accélérateur d'inférence ML, Inférence AWS. Pour plus de détails sur la formation des LLM sur SageMaker, reportez-vous à Formation de grands modèles de langage sur Amazon SageMaker : bonnes pratiques ainsi que les HyperPod SageMaker.

Choisir la bonne approche pour développer des applications d’IA générative

Lors du développement d’applications d’IA générative, les organisations doivent soigneusement prendre en compte plusieurs facteurs clés avant de sélectionner le modèle le plus adapté à leurs besoins. Divers aspects doivent être pris en compte, tels que le coût (pour garantir que le modèle sélectionné s'aligne sur les contraintes budgétaires), la qualité (pour fournir des résultats cohérents et factuellement précis), l'intégration transparente avec les plates-formes et flux de travail d'entreprise actuels, et la réduction des hallucinations ou de la génération de fausses informations. . Avec de nombreuses options disponibles, prendre le temps d’évaluer minutieusement ces aspects aidera les organisations à choisir le modèle d’IA générative qui répond le mieux à leurs besoins et priorités spécifiques. Vous devez examiner attentivement les facteurs suivants :

- Intégration avec les systèmes d'entreprise – Pour que les FM soient vraiment utiles dans un contexte d'entreprise, ils doivent s'intégrer et interagir avec les systèmes et flux de travail commerciaux existants. Cela peut impliquer l'accès aux données des bases de données, des progiciels de gestion intégrés (ERP) et de la gestion de la relation client (CRM), ainsi que le déclenchement d'actions et de flux de travail. Sans une bonne intégration, le FM risque de devenir un outil isolé. Les systèmes d'entreprise comme l'ERP contiennent des données commerciales clés (clients, produits, commandes). Le FM doit être connecté à ces systèmes pour utiliser les données de l'entreprise plutôt que de travailler sur son propre graphique de connaissances, qui peut être inexact ou obsolète. Cela garantit l’exactitude et une source unique de vérité.

- Hallucinations – Les hallucinations se produisent lorsqu’une application d’IA génère de fausses informations qui semblent factuelles. Ces problèmes doivent être soigneusement abordés avant que les FM ne soient largement adoptés. Par exemple, un chatbot médical conçu pour fournir des suggestions de diagnostic pourrait halluciner des détails sur les symptômes ou les antécédents médicaux d'un patient, l'amenant à proposer un diagnostic inexact. Il sera essentiel de prévenir de telles hallucinations nuisibles grâce à des solutions techniques et à la conservation d'ensembles de données pour garantir que ces FM soient fiables pour des applications sensibles telles que les soins de santé, la finance et le droit. Des tests approfondis et une transparence sur les données de formation d'un FM et les failles restantes devront accompagner les déploiements.

- Compétences et ressources – L’adoption réussie des FM dépendra fortement de la possession des compétences et des ressources appropriées pour utiliser efficacement la technologie. Les organisations ont besoin d'employés possédant de solides compétences techniques pour mettre en œuvre, personnaliser et maintenir correctement les FM en fonction de leurs besoins spécifiques. Ils nécessitent également d’importantes ressources informatiques, comme du matériel avancé et des capacités de cloud computing, pour exécuter des FM complexes. Par exemple, une équipe marketing souhaitant utiliser un FM pour générer des textes publicitaires et des publications sur les réseaux sociaux a besoin d'ingénieurs qualifiés pour intégrer le système, de créatifs pour fournir des invites et évaluer la qualité du résultat, et d'une puissance de cloud computing suffisante pour déployer le modèle de manière rentable. Investir dans le développement de l’expertise et de l’infrastructure technique permettra aux organisations de tirer une réelle valeur commerciale de l’application des FM.

- Qualité de sortie – La qualité des résultats produits par les FM sera essentielle pour déterminer leur adoption et leur utilisation, en particulier dans les applications destinées aux consommateurs comme les chatbots. Si les chatbots alimentés par FM fournissent des réponses inexactes, absurdes ou inappropriées, les utilisateurs seront rapidement frustrés et cesseront d'interagir avec eux. Par conséquent, les entreprises qui cherchent à déployer des chatbots doivent tester rigoureusement les FM qui les animent pour s'assurer qu'ils génèrent systématiquement des réponses de haute qualité, utiles, pertinentes et appropriées pour offrir une bonne expérience utilisateur. La qualité du résultat englobe des facteurs tels que la pertinence, l'exactitude, la cohérence et l'adéquation, qui contribuent tous à la satisfaction globale des utilisateurs et feront ou détruiront l'adoption de FM comme ceux utilisés pour les chatbots.

- Prix – La puissance de calcul élevée requise pour former et exécuter de grands modèles d’IA comme les FM peut entraîner des coûts substantiels. De nombreuses organisations peuvent ne pas disposer des ressources financières ou de l’infrastructure cloud nécessaires pour utiliser des modèles aussi massifs. De plus, l'intégration et la personnalisation des FM pour des cas d'utilisation spécifiques augmentent les coûts d'ingénierie. Les dépenses considérables nécessaires à l’utilisation des FM pourraient dissuader une adoption généralisée, en particulier parmi les petites entreprises et les startups aux budgets limités. Évaluer le retour sur investissement potentiel et peser les coûts par rapport aux avantages des FM est essentiel pour les organisations qui envisagent leur application et leur utilité. La rentabilité sera probablement un facteur décisif pour déterminer si et comment ces modèles puissants mais gourmands en ressources peuvent être déployés de manière réalisable.

Décision de conception

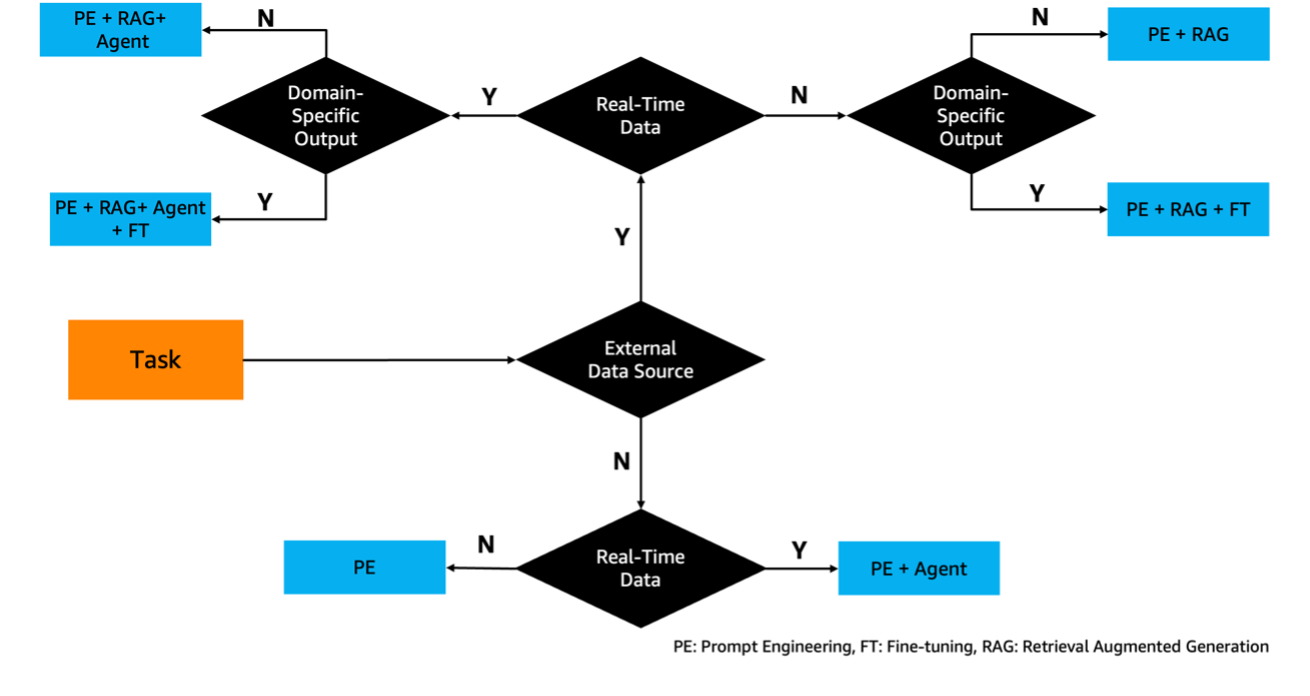

Comme nous l'avons expliqué dans cet article, de nombreuses techniques d'IA différentes sont actuellement disponibles, telles que l'ingénierie rapide, le RAG et la personnalisation des modèles. Ce large éventail de choix rend difficile pour les entreprises de déterminer l’approche optimale pour leur cas d’utilisation particulier. La sélection du bon ensemble de techniques dépend de divers facteurs, notamment l'accès à des sources de données externes, les flux de données en temps réel et la spécificité du domaine de l'application envisagée. Pour vous aider à identifier la technique la plus appropriée en fonction du cas d'utilisation et des considérations impliquées, nous parcourons l'organigramme suivant, qui présente des recommandations pour faire correspondre les besoins et contraintes spécifiques avec les méthodes appropriées.

Pour bien comprendre, parcourons l'organigramme de décision de conception à l'aide de quelques exemples illustratifs :

- Recherche d'entreprise – Un employé cherche à demander un congé à son organisation. Pour apporter une réponse alignée sur les politiques RH de l'organisation, le FM a besoin de plus de contexte au-delà de ses propres connaissances et capacités. Plus précisément, le FM a besoin d'accéder à des sources de données externes qui fournissent des lignes directrices et des politiques pertinentes en matière de ressources humaines. Compte tenu de ce scénario de demande d'un employé qui nécessite de faire référence à des données externes spécifiques au domaine, l'approche recommandée selon l'organigramme est l'ingénierie rapide avec RAG. RAG aidera à fournir les données pertinentes provenant des sources de données externes comme contexte au FM.

- Recherche d'entreprise avec sortie spécifique à l'organisation – Supposons que vous disposiez de dessins techniques et que vous souhaitiez en extraire la nomenclature, en formatant la sortie selon les normes de l'industrie. Pour ce faire, vous pouvez utiliser une technique qui combine une ingénierie rapide avec RAG et un modèle de langage affiné. Le modèle affiné serait formé pour produire des nomenclatures lorsque des dessins techniques seraient fournis en entrée. RAG aide à trouver les dessins techniques les plus pertinents à partir des sources de données de l'organisation pour alimenter le contexte du FM. Dans l'ensemble, cette approche extrait les nomenclatures des dessins techniques et structure le résultat de manière appropriée pour le domaine de l'ingénierie.

- Recherche générale – Imaginez que vous vouliez trouver l’identité du 30e président des États-Unis. Vous pouvez utiliser une ingénierie rapide pour obtenir la réponse d'un FM. Étant donné que ces modèles sont formés sur de nombreuses sources de données, ils peuvent souvent fournir des réponses précises à des questions factuelles comme celle-ci.

- Recherche générale avec les événements récents – Si vous souhaitez déterminer le cours actuel de l’action Amazon, vous pouvez utiliser l’approche d’ingénierie rapide avec un agent. L'agent fournira au FM le cours de l'action le plus récent afin qu'il puisse générer une réponse factuelle.

Conclusion

L'IA générative offre aux organisations un énorme potentiel pour stimuler l'innovation et augmenter la productivité dans une variété d'applications. Cependant, pour adopter avec succès ces technologies d’IA émergentes, il faut tenir compte de considérations clés concernant l’intégration, la qualité des résultats, les compétences, les coûts et les risques potentiels tels que les hallucinations nuisibles ou les vulnérabilités de sécurité. Les organisations doivent adopter une approche systématique pour évaluer les exigences et les contraintes de leurs cas d'utilisation afin de déterminer les techniques les plus appropriées pour adapter et appliquer les FM. Comme souligné dans cet article, l'ingénierie rapide, le RAG et les méthodes efficaces de personnalisation des modèles ont chacune leurs propres forces et faiblesses qui conviennent à différents scénarios. En mappant les besoins des entreprises aux capacités de l'IA à l'aide d'un cadre structuré, les organisations peuvent surmonter les obstacles à la mise en œuvre et commencer à tirer profit des FM tout en créant des garde-fous pour gérer les risques. Grâce à une planification réfléchie fondée sur des exemples concrets, les entreprises de tous les secteurs peuvent tirer une immense valeur de cette nouvelle vague d’IA générative. En savoir plus sur IA générative sur AWS.

À propos des auteurs

Jay Rao est architecte de solutions principal chez AWS. Il se concentre sur les technologies IA/ML avec un vif intérêt pour l’IA générative et la vision par ordinateur. Chez AWS, il aime fournir des conseils techniques et stratégiques aux clients et les aider à concevoir et mettre en œuvre des solutions qui génèrent des résultats commerciaux. Il est auteur de livres (Computer Vision on AWS), publie régulièrement des blogs et des exemples de code, et a donné des conférences lors de conférences techniques telles qu'AWS re:Invent.

Jay Rao est architecte de solutions principal chez AWS. Il se concentre sur les technologies IA/ML avec un vif intérêt pour l’IA générative et la vision par ordinateur. Chez AWS, il aime fournir des conseils techniques et stratégiques aux clients et les aider à concevoir et mettre en œuvre des solutions qui génèrent des résultats commerciaux. Il est auteur de livres (Computer Vision on AWS), publie régulièrement des blogs et des exemples de code, et a donné des conférences lors de conférences techniques telles qu'AWS re:Invent.

Babu Kariyaden Parambath est un spécialiste senior de l'IA/ML chez AWS. Chez AWS, il aime travailler avec les clients pour les aider à identifier le bon cas d'utilisation commerciale avec une valeur commerciale et à le résoudre à l'aide des solutions et services AWS AI/ML. Avant de rejoindre AWS, Babu était un évangéliste de l'IA avec 20 ans d'expérience diversifiée dans l'industrie, offrant une valeur commerciale basée sur l'IA aux clients.

Babu Kariyaden Parambath est un spécialiste senior de l'IA/ML chez AWS. Chez AWS, il aime travailler avec les clients pour les aider à identifier le bon cas d'utilisation commerciale avec une valeur commerciale et à le résoudre à l'aide des solutions et services AWS AI/ML. Avant de rejoindre AWS, Babu était un évangéliste de l'IA avec 20 ans d'expérience diversifiée dans l'industrie, offrant une valeur commerciale basée sur l'IA aux clients.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/best-practices-to-build-generative-ai-applications-on-aws/

- :possède

- :est

- :ne pas

- :où

- 1

- 100

- 116

- 20

- 20 ans

- 2017

- 2022

- 30ème

- 7

- a

- capacité

- Capable

- Qui sommes-nous

- accélérateur

- accès

- accès

- vous accompagne

- Selon

- Compte

- précision

- Avec cette connaissance vient le pouvoir de prendre

- avec précision

- atteindre

- à travers

- intérim

- actes

- présenter

- adapter

- adaptation

- s'adapter

- s'adapte

- ajoutant

- Supplémentaire

- En outre

- propos

- adressé

- adresses

- adresser

- Ajoute

- adéquatement

- adopter

- adopté

- L'adoption d'

- Adoption

- Avancée

- avancement

- avantages

- Numérique

- Agent

- agents

- AI

- Modèles AI

- recherche ai

- Alimenté par l'IA

- AI / ML

- Aide

- vise

- AL

- aligner

- aligné

- Aligne

- Tous

- permettre

- Permettre

- permet

- presque

- seul

- aussi

- Bien que

- toujours

- Amazon

- Amazone Kendra

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- Amazon Web Services

- parmi

- parmi

- montant

- an

- selon une analyse de l’Université de Princeton

- ainsi que les

- et infrastructure

- répondre

- répondre

- réponses

- Anthropique

- tous

- api

- Apis

- appli

- apparaît

- Application

- applications

- Application

- une approche

- approches

- approprié

- de manière appropriée

- architecture

- SONT

- survenir

- autour

- sur notre blog

- AS

- aspects

- Evaluer

- Assistante gérante

- associé

- At

- augmenter

- augmentée

- auteur

- Automatisation

- Automates

- automatiquement

- de manière autonome

- disponibles

- AWS

- AWS re: Invent

- base

- basé

- BE

- car

- devenez

- before

- commencer

- humain

- comportements

- va

- référence

- avantages.

- LES MEILLEURS

- les meilleures pratiques

- Améliorée

- jusqu'à XNUMX fois

- Au-delà

- biais

- Projet de loi

- milliards

- Billets

- biomédical

- blogue

- livre

- Réserver

- renforcer

- tous les deux

- brand

- Pause

- Rupture

- pauses

- vaste

- plus large

- budget

- budgets

- construire

- Développement

- construit

- intégré

- la performance des entreprises

- entreprises

- mais

- by

- appel

- CAN

- Peut obtenir

- capacités

- aptitude

- capable

- Compétences

- prudemment

- porter

- maisons

- cas

- certaines

- challenge

- globaux

- difficile

- chances

- Change

- modifié

- Modifications

- en changeant

- caractères

- Graphique

- Chatbot

- Chatbots

- puce

- le choix

- choix

- Selectionnez

- classification

- Nettoyage

- clair

- étroitement

- le cloud

- le cloud computing

- infrastructure de cloud

- code

- Codage

- COHÉRENT

- Collecte

- combiner

- moissonneuses-batteuses

- comment

- vient

- Commun

- Sociétés

- Société

- De l'entreprise

- comparable

- par rapport

- complet

- complexe

- complexité

- conformité

- composants électriques

- comprendre

- calcul

- puissance de calcul

- informatiquement

- calcul

- ordinateur

- Vision par ordinateur

- informatique

- Puissance de calcul

- Conduire

- conférences

- NOUS CONTACTER

- connecté

- Connectivité

- Considérer

- considérable

- considérations

- considéré

- considérant

- régulièrement

- Console

- constamment

- contraintes

- consommation

- contiennent

- contenu

- Génération de contenu

- contexte

- contextes

- contextuel

- continuer

- a continué

- contribuer

- des bactéries

- de la conversation

- conversations

- copier

- Core

- Prix

- Costs

- pourriez

- couverture

- couverture

- couvert

- engendrent

- La création

- Conception

- créatifs

- critique

- CRM

- crucial

- curating

- curation

- Courant

- Lecture

- Customiser

- des clients

- expérience client

- Clients

- personnalisation

- personnaliser

- sont adaptées

- données

- confidentialité des données

- Confidentialité et sécurité des données

- informatique

- science des données

- bases de données

- ensembles de données

- traitement

- Décider

- décision

- profond

- Degré

- livrer

- livré

- livrer

- Demande

- démontrer

- dépendre

- Selon

- dépend

- déployer

- déployé

- déploiement

- déploiements

- Conception

- un

- conception

- voulu

- détails

- Déterminer

- détermination

- développer

- Développeur

- mobiles

- développement

- Développement

- diagnostic

- différent

- difficile

- directement

- découvert

- discuter

- distribué

- formation distribuée

- plusieurs

- do

- INSTITUTIONNELS

- Ne fait pas

- dollars

- domaine

- domaines

- down

- Dessins

- motivation

- entraîné

- deux

- pendant

- Dynamic

- E & T

- chacun

- même

- Efficace

- de manière efficace

- efficace

- efficace

- efficacement

- effort

- éléments

- admissibles

- l'élimination

- emails

- enrobage

- émergence

- économies émergentes.

- Employés

- employés

- l'autonomisation des

- permettre

- permet

- permettant

- englobe

- crypter

- crypté

- fin

- end-to-end

- engageant

- Moteur

- ENGINEERING

- Les ingénieurs

- de renforcer

- enrichissant

- assurer

- Assure

- assurer

- Entreprise

- entités

- entité

- Environment

- environnements

- équiper

- ERP

- notamment

- établir

- évaluer

- évaluer

- Évangéliste

- Chaque

- peut

- évolution

- examiner

- exemple

- exemples

- passionnant

- exposer

- existant

- dépenses

- cher

- d'experience

- expériences

- expert

- nous a permis de concevoir

- de santé

- explorez

- extension

- externe

- extrait

- Extraits

- extrêmement

- Visage

- facteur

- facteurs

- réalités

- FAIL

- équitablement

- Automne

- non

- réalisable

- few

- finance

- la traduction de documents financiers

- Trouvez

- résultats

- cinq

- défauts

- Flexibilité

- vol

- flux

- Focus

- se concentre

- Abonnement

- Pour

- Fondation

- Fondationale

- Framework

- cadres

- fréquemment

- de

- frustré

- Remplir

- plein

- d’étiquettes électroniques entièrement

- plus

- Gain

- écart

- recueillir

- RGPD

- Général

- à usage général

- générer

- généré

- génère

- générateur

- génération

- génératif

- IA générative

- obtenez

- Donner

- donné

- Go

- Bien

- gouvernance

- GPU

- graphique

- l'

- plus grand

- Sol

- mis à la terre

- l'orientation

- guide

- lignes directrices

- Poignées

- Matériel

- nuisible

- harnais

- Vous avez

- ayant

- he

- la médecine

- fortement

- vous aider

- utile

- aider

- aide

- Haute

- haute performance

- de haute qualité

- augmentation

- le plus élevé

- plus haut degré

- Surbrillance

- très

- Histoire

- Comment

- How To

- Cependant

- hr

- HTML

- HTTPS

- Moyeu

- Des centaines

- Haies

- Réglage des hyperparamètres

- idée

- et idées cadeaux

- identifier

- identifier

- Identite

- if

- image

- immense

- Impact

- percutants

- Impacts

- Mettre en oeuvre

- la mise en oeuvre

- important

- améliorer

- amélioré

- améliore

- l'amélioration de

- in

- inexacte

- Y compris

- indépendamment

- indique

- industrie

- normes de l'industrie

- d'information

- Infrastructure

- Innovation

- innovations

- contribution

- idées.

- inspirer

- Institut

- Des instructions

- intégrer

- Intégration

- l'intégration

- prévu

- interagir

- intérêt

- intéressant

- Interfaces

- interne

- Internet

- interopérer

- développement

- introduit

- inventaire

- sueñortiendo

- un investissement

- impliquer

- impliqué

- implique

- isolé

- vous aider à faire face aux problèmes qui vous perturbent

- IT

- SES

- joindre

- juste

- Vif

- ACTIVITES

- clés

- spécialisées

- Graphique connaissances

- sait

- Labs

- Peindre

- langue

- Langues

- gros

- plus importantes

- poules pondeuses

- conduire

- conduisant

- APPRENTISSAGE

- savant

- apprentissage

- Laisser

- Légal

- Allons-y

- LG

- comme

- Probable

- limites

- limité

- lignes

- Flamme

- logique

- logique

- recherchez-

- Faible

- click

- machine learning

- Les machines

- maintenir

- a prendre une

- FAIT DU

- Fabrication

- gérer

- gérés

- gestion

- Manuel

- de nombreuses

- cartographie

- Stratégie

- massif

- massivement

- assorti

- matières premières.

- Mai..

- Médias

- médical

- Découvrez

- Meta

- méthode

- méthodes

- pourrait

- des millions

- minimiser

- ML

- modèle

- numériques jumeaux (digital twin models)

- mois

- PLUS

- (en fait, presque toutes)

- en mouvement

- must

- Nature

- nécessaire

- Besoin

- nécessaire

- besoin

- Besoins

- négatif

- Nouveauté

- La prochaine génération

- Aucun

- maintenant

- of

- de rabais

- Offres Speciales

- souvent

- on

- ONE

- uniquement

- Opérations

- Opportunités

- optimaux

- à mettre en œuvre pour gérer une entreprise rentable. Ce guide est basé sur trois décennies d'expérience

- Options

- or

- orchestration

- de commander

- passer commande

- organisation

- organisationnel

- organisations

- original

- initialement

- Autre

- ande

- les résultats

- désuet

- grandes lignes

- Surperforme

- sortie

- sorties

- plus de

- global

- Overcome

- vue d'ensemble

- propre

- paires

- papiers

- paramètres

- particulier

- particulièrement

- des billets

- passé

- Effectuer

- performant

- performances

- personnel

- Personnalisé

- les expressions clés

- pièces

- pipeline

- et la planification de votre patrimoine

- Plateformes

- Platon

- Intelligence des données Platon

- PlatonDonnées

- parcelle

- des notes bonus

- politiques

- Populaire

- possible

- Post

- Poteaux

- défaillances

- l'éventualité

- power

- alimenté

- solide

- Méthode

- pratique

- pratiques

- précédant

- préférences

- président

- prévention

- précédemment

- prix

- établissement des prix

- Directeur

- Avant

- la confidentialité

- Confidentialité et sécurité

- Privé

- Problème

- d'ouvrabilité

- processus

- traitement

- produire

- Produit

- produit

- productivité

- Produits

- Profil

- Programmation

- favorise

- instructions

- correct

- correctement

- proposer

- propriétaire

- fournir

- fournisseurs

- fournit

- aportando

- public

- publié

- Publie

- tirant

- achat

- bon de commande

- qualité

- requêtes

- question

- fréquemment posées

- vite.

- chiffon

- gamme

- Nos tests de diagnostic produisent des résultats rapides et précis sans nécessiter d'équipement de laboratoire complexe et coûteux,

- rapidement

- RARE

- plutôt

- raw

- RE

- Réagir

- réal

- valeur réelle

- monde réel

- en temps réel

- données en temps réel à grande vitesse.

- réalisation

- récent

- reconnaissance

- Recommandation

- recommandations

- recommandé

- réduire

- réduire

- reportez-vous

- régulièrement

- relation amoureuse

- pertinence

- pertinent

- s'appuyer

- restant

- remarquables

- Rapports

- réputation

- nécessaire

- demandes

- exigent

- conditions

- Exigences

- a besoin

- requis

- un article

- ressource

- gourmande en ressources

- Resources

- Réagir

- réponse

- réponses

- REST

- Résultats

- récupération

- retourner

- recettes

- Avis

- bon

- risques

- routine

- Courir

- pour le running

- plus sûre

- sagemaker

- même

- client

- Évolutivité

- évolutive

- Escaliers intérieurs

- Rareté

- scénario

- scénarios

- Sciences

- scientifiques

- gratter

- scripts

- fluide

- Rechercher

- Section

- en toute sécurité

- sécurité

- risques de sécurité

- choisi

- la sélection

- sélection

- supérieur

- sensible

- sentiment

- des sentiments

- Sans serveur

- sert

- service

- Services

- service

- Session

- set

- Sets

- Paramétres

- plusieurs

- Forme

- commun

- Shorts

- devrait

- Spectacles

- significative

- de façon significative

- similaires

- étapes

- unique

- qualifié

- compétences

- faibles

- So

- Réseaux sociaux

- réseaux sociaux

- Publications sur les réseaux sociaux

- uniquement

- solide

- sur mesure

- Solutions

- RÉSOUDRE

- Résoudre

- quelques

- sophistiqué

- Identifier

- Sources

- spécialiste

- spécialiser

- spécialisé

- spécialise

- groupe de neurones

- spécifiquement

- spécificité

- Stabilité

- Utilisation d'un

- Normes

- Commencer

- j'ai commencé

- Startups

- États

- étapes

- Étapes

- Encore

- stock

- Arrêter

- Boutique

- STORES

- Stories

- Histoire

- simple

- Stratégique

- forces

- STRONG

- structure

- structuré

- structures

- Catégorie

- Ces

- réussi

- Avec succès

- tel

- suffisant

- suggérer

- Combinaison

- convient

- Surchargez

- la quantité

- Support

- Les soutiens

- sûr

- Symptômes

- combustion propre

- Système

- tacle

- Prenez

- prise

- Talent

- parlant

- Talks

- Exploiter

- Target

- Tâche

- tâches

- équipe

- technologie

- Technique

- compétences techniques

- technique

- techniques

- Les technologies

- Technologie

- Innovation technologique

- modèle

- terminologie

- tester

- Essais

- texte

- Classification du texte

- que

- qui

- Les

- les informations

- leur

- Les

- puis

- Là.

- donc

- Ces

- l'ont

- penser

- des tiers.

- this

- approfondi

- complètement

- ceux

- milliers

- trois

- Avec

- fiable

- long

- à

- tokenisé

- Tokens

- outil

- les outils

- top

- sujet

- Les sujets

- vers

- circulation

- Train

- qualifié

- Formation

- transit

- Traduction

- Transparence

- énorme

- déclenchement

- trillions

- vraiment

- La confiance

- confiance

- digne de confiance

- Vérité

- réglage

- TOUR

- peaufinage

- deux

- typiquement

- incapable

- comprendre

- compréhension

- expérience unique et authentique

- Uni

- États-Unis

- ouvrir

- inexploité

- indésirable

- mise à jour

- Mises à jour

- a actualisé

- la mise à jour

- mises à jour

- utilisé

- cas d'utilisation

- d'utiliser

- incontournable

- Utilisateur

- Expérience utilisateur

- utilisateurs

- Usages

- en utilisant

- utilitaire

- VALIDER

- Plus-value

- variété

- divers

- Vaste

- énormément

- très

- via

- vision

- visuel

- vs

- vulnérabilités

- marcher

- souhaitez

- vouloir

- était

- Vague

- Façon..

- we

- faiblesses

- web

- services Web

- Semaines

- pesée

- poids

- WELL

- Quoi

- quand

- Les

- que

- qui

- tout en

- large

- Large gamme

- largement

- répandu

- Wikipédia

- sera

- comprenant

- dans les

- sans

- activités principales

- workflow

- workflows

- de travail

- pourra

- écrire

- écriture

- code écrit

- années

- Rendement

- Vous n'avez

- Votre

- zéphyrnet