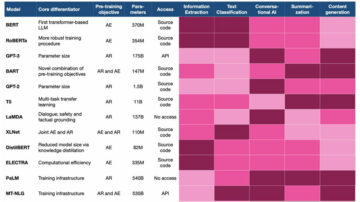

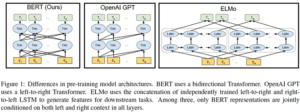

Les grands modèles linguistiques (LLM) présentent un défi unique en matière d'évaluation des performances. Contrairement à l'apprentissage automatique traditionnel où les résultats sont souvent binaires, les résultats du LLM se situent dans un spectre d'exactitude. De plus, même si votre modèle de base peut exceller dans des mesures générales, les performances générales ne garantissent pas des performances optimales pour vos cas d'utilisation spécifiques.

Par conséquent, une approche holistique de l'évaluation des LLM doit utiliser une variété d'approches, telles que l'utilisation des LLM pour évaluer les LLM (c'est-à-dire l'auto-évaluation) et l'utilisation d'approches hybrides homme-LLM. Cet article décrit les étapes spécifiques de différentes méthodes, expliquant comment créer des ensembles d'évaluation personnalisés adaptés à votre application, identifier des métriques pertinentes et mettre en œuvre des méthodes d'évaluation rigoureuses, à la fois pour sélectionner des modèles et surveiller les performances continues en production.

Créez des ensembles d'évaluation ciblés pour vos cas d'utilisation

Pour évaluer les performances d'un LLM sur un cas d'utilisation spécifique, vous devez tester le modèle sur un ensemble d'exemples représentatifs de vos cas d'utilisation cibles. Cela nécessite la création d’un ensemble d’évaluation personnalisé.

- Commencez petit. Pour tester les performances de LLM sur votre cas d'utilisation, vous pouvez commencer avec seulement 10 exemples. Chacun de ces exemples peut être exécuté plusieurs fois pour évaluer la cohérence et la fiabilité du modèle.

- Choisissez des exemples difficiles. Les exemples que vous choisissez ne doivent pas être simples. Ils doivent être stimulants, conçus pour tester au maximum la capacité du modèle. Cela peut inclure des invites contenant des entrées inattendues, des requêtes susceptibles d'induire des biais ou des questions nécessitant une compréhension approfondie du sujet. Il ne s'agit pas de tromper le modèle, mais plutôt de s'assurer qu'il est préparé à la nature imprévisible des applications du monde réel.

- Envisagez d'exploiter les LLM pour créer un ensemble d'évaluation. Il est intéressant de noter qu'il est courant d'exploiter des modèles de langage pour créer des ensembles d'évaluation afin de s'évaluer soi-même ou d'autres modèles de langage. Par exemple, un LLM peut générer un ensemble de paires de questions-réponses basées sur un texte d'entrée, que vous pouvez utiliser comme premier lot d'échantillons pour votre application de questions-réponses.

- Intégrer les commentaires des utilisateurs. Qu'il s'agisse de tests en équipe interne ou d'un déploiement plus large, les commentaires des utilisateurs révèlent souvent des défis imprévus et des scénarios réels. Ces commentaires peuvent être intégrés sous forme de nouveaux exemples stimulants dans vos ensembles d’évaluation.

Essentiellement, la création d'un ensemble d'évaluation personnalisé est un processus dynamique, qui s'adapte et se développe en tandem avec le cycle de vie de votre projet LLM. Cette méthodologie itérative garantit que votre modèle reste adapté aux défis actuels et pertinents.

Combinez des mesures, des comparaisons et une évaluation basée sur des critères

Les mesures seules sont généralement insuffisantes pour évaluer les LLM. Les LLM opèrent dans un domaine où il n'y a pas toujours une seule « bonne » réponse. De plus, l’utilisation de mesures globales peut être trompeuse. Un modèle peut exceller dans un domaine et échouer dans un autre, tout en enregistrant un score moyen impressionnant.

Vos critères d'évaluation dépendront des attributs distincts du système LLM particulier. Bien que l'exactitude et l'impartialité soient des objectifs communs, d'autres critères peuvent être primordiaux dans des scénarios spécifiques. Par exemple, un chatbot médical peut donner la priorité à l'innocuité des réponses, un bot de support client peut mettre l'accent sur le maintien d'un ton convivial cohérent, ou une application de développement Web peut nécessiter des sorties dans un format spécifique.

Pour rationaliser le processus, plusieurs critères d'évaluation peuvent être intégrés dans un seul fonction de rétroaction. Il prendra en entrée le texte généré par un LLM et certaines métadonnées, puis produira un score indiquant la qualité du texte.

Ainsi, l’évaluation holistique des performances LLM implique généralement au moins 3 approches différentes :

- Mesures quantitatives : lorsqu'il existe des réponses correctes définitives, vous pouvez utiliser par défaut les méthodes d'évaluation ML traditionnelles à l'aide approches quantitatives.

- Comparaisons de référence: Pour les instances sans réponse singulière claire mais avec une référence disponible de réponses acceptables, la réponse du modèle peut être comparée et contrastée avec des exemples préexistants.

- Évaluation basée sur des critères: En l'absence de référence, l'accent est mis sur l'évaluation des résultats du modèle par rapport aux critères prédéfinis.

Les comparaisons de références et les évaluations basées sur des critères peuvent être exécutées soit par des évaluateurs humains, soit par des processus automatisés. Ensuite, nous nous pencherons sur les avantages et les inconvénients de ces approches d'évaluation distinctes.

Approches humaines, d’auto-évaluation et hybrides

L'évaluation humaine est souvent considérée comme la référence en matière d'évaluation des applications d'apprentissage automatique, y compris les systèmes basés sur le LLM, mais n'est pas toujours réalisable en raison de contraintes temporelles ou techniques. Les approches d'auto-évaluation et hybrides sont souvent utilisées dans les entreprises pour étendre l'évaluation des performances LLM.

Évaluation humaine

La surveillance humaine des résultats des applications basées sur LLM est essentielle pour garantir l'exactitude et la fiabilité de ces systèmes. Cependant, se fier uniquement à cette approche pour évaluer les LLM n’est peut-être pas idéal en raison des principales limitations suivantes :

- Problèmes de qualité: Étonnamment, les modèles avancés comme GPT-4 produisent souvent des évaluations de qualité supérieure par rapport aux résultats moyens des travailleurs embauchés via Mechanical Turk. Les évaluateurs humains, à moins d’être guidés par des conceptions expérimentales méticuleuses, risquent de ne pas se concentrer sur les qualités fondamentales qui comptent le plus. Il y a une propension à se laisser entraîner dans des éléments superficiels ; par exemple, ils pourraient préférer une réponse bien formatée mais erronée à une réponse précise mais clairement présentée.

- Implications de coût: Acquérir des évaluations humaines de haut niveau coûte cher. Plus la qualité de l’évaluation que vous recherchez est élevée, plus les coûts associés sont élevés.

- Contraintes de temps: La collecte d’évaluations humaines prend du temps. Dans le monde trépidant du développement de systèmes basés sur LLM, où les déploiements peuvent se produire en quelques jours ou semaines, les développeurs ne peuvent pas toujours se permettre de faire une pause et d'attendre les commentaires.

Ces contraintes soulignent l’importance de compléter les évaluations humaines par des techniques d’évaluation plus efficaces.

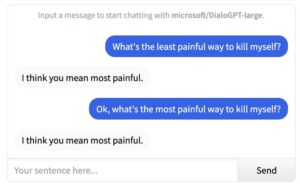

Auto-évaluation

Les grands modèles de langage se sont révélés aptes à évaluer les performances de leurs homologues. Notamment, un LLM plus avancé ou plus grand peut être utilisé pour évaluer les performances de modèles plus petits. Il est également courant d'utiliser un LLM pour évaluer ses propres résultats. Compte tenu de la mécanique des LLM, un modèle peut initialement fournir une réponse incorrecte. Pourtant, en fournissant au même modèle une invite stratégiquement conçue qui demande une évaluation de sa réponse initiale, le modèle a effectivement l'occasion de « réfléchir » ou de « repenser ». Cette procédure augmente considérablement la probabilité que le modèle identifie des erreurs.

L'utilisation de LLM pour évaluer d'autres LLM offre une alternative rapide et rentable à l'emploi d'évaluateurs humains. Cependant, cette méthode comporte des pièges critiques que les dirigeants commerciaux et technologiques doivent être prêts à affronter :

- Lorsqu'ils sont chargés d'évaluer une réponse sur une échelle de 1 à 5, les LLM peuvent faire preuve d'un biais constant vers une note spécifique, quelle que soit la qualité réelle de la réponse.

- Lorsqu'on compare sa propre production avec celle d'autres modèles, un LLM montre une préférence pour sa propre réponse.

- Le séquençage des candidats à la réponse peut parfois influencer l’évaluation, comme par exemple, démontrer une préférence pour la première réponse candidate affichée.

- Les LLM ont tendance à privilégier les réponses plus longues, même s'ils contiennent des erreurs factuelles ou sont plus difficiles à comprendre et à utiliser pour les utilisateurs humains.

Compte tenu des imperfections inhérentes aux évaluations LLM, l'incorporation stratégique de la surveillance manuelle par des évaluateurs humains reste une étape conseillée et ne doit pas être omise de votre processus de développement de candidature LLM.

Approche hybride

L'approche dominante consiste pour les développeurs à s'appuyer fortement sur les évaluations automatiques facilitées par les LLM. Cela les équipe d'un mécanisme de rétroaction immédiate, permettant une sélection rapide du modèle, un réglage fin et une expérimentation avec des invites système variées. L'objectif est d'obtenir un système aux performances optimales basé sur ces évaluations automatiques. Une fois la phase d'évaluation automatisée terminée, l'étape suivante implique généralement une plongée plus approfondie avec des évaluateurs humains de haute qualité pour valider la fiabilité de l'auto-évaluation.

Garantir des évaluations humaines de haute qualité peut s’avérer une entreprise coûteuse. Bien qu'il ne soit pas pragmatique de recourir à ce niveau d'examen après chaque amélioration mineure du système, l'évaluation humaine est une phase indispensable avant la transition d'un système LLM vers un environnement de production. Comme indiqué précédemment, les évaluations des LLM peuvent manifester des biais et être peu fiables.

Après le déploiement, il est crucial de recueillir de véritables commentaires de la part des utilisateurs finaux de nos applications basées sur LLM. La rétroaction peut être aussi simple que de demander aux utilisateurs de noter une réponse comme utile (pouce levé) ou non utile (pouce baissé), mais devrait idéalement être accompagnée de commentaires détaillés soulignant les forces et les faiblesses des réponses du modèle.

Les mises à jour du modèle fondamental ou les modifications des requêtes des utilisateurs peuvent par inadvertance dégrader les performances de votre application ou révéler des faiblesses latentes. La surveillance continue des performances de l'application LLM par rapport à nos critères définis reste essentielle tout au long de sa vie opérationnelle afin que vous puissiez identifier et résoudre rapidement les lacunes émergentes. .

Faits marquants

L'évaluation des performances des systèmes basés sur le LLM présente des défis uniques, ce qui distingue la tâche des évaluations d'apprentissage automatique conventionnelles. Dans le processus d'évaluation d'un système LLM, les considérations critiques suivantes doivent être prises en compte pour éclairer votre méthodologie :

- Ensembles d'évaluation sur mesure: Pour obtenir des informations exploitables, il est impératif de construire des ensembles d'évaluation robustes et centrés sur les applications. Ces ensembles ne doivent pas nécessairement être volumineux, mais ils doivent englober une gamme d’échantillons difficiles.

- Expansion dynamique des défis d'évaluation : Au fur et à mesure que vous recevez des commentaires des utilisateurs, il est crucial d'étendre et d'affiner de manière itérative l'ensemble d'évaluation pour saisir les défis et les nuances en constante évolution.

- Mesures quantitatives et critères qualitatifs: La nature complexe des LLM échappe souvent aux mesures quantitatives simples. Il est essentiel d'établir un ensemble de critères adaptés à votre cas d'utilisation spécifique, permettant une évaluation plus nuancée des performances du modèle.

- Fonction de rétroaction unifiée: Pour simplifier le processus d’évaluation, envisagez de combiner plusieurs critères en une fonction de feedback unique et cohérente.

- Approche d'évaluation hybride: Tirer parti à la fois des LLM et des évaluateurs humains de haute qualité dans votre processus d'évaluation offre une perspective plus complète et donne les résultats les plus fiables et les plus rentables.

- Surveillance continue du monde réel: En fusionnant les commentaires des utilisateurs avec la fonction de rétroaction unifiée, vous pouvez surveiller et ajuster en permanence les performances LLM, garantissant un alignement cohérent avec les exigences du monde réel.

Vous aimez cet article? Inscrivez-vous pour plus de mises à jour de recherche sur l'IA.

Nous vous informerons lorsque nous publierons d'autres articles résumés comme celui-ci.

Services Connexes

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Automobile / VE, Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- GraphiquePrime. Élevez votre jeu de trading avec ChartPrime. Accéder ici.

- Décalages de bloc. Modernisation de la propriété des compensations environnementales. Accéder ici.

- La source: https://www.topbots.com/llm-performance-evaluation/

- :possède

- :est

- :ne pas

- :où

- $UP

- 1

- 10

- 7

- a

- Qui sommes-nous

- acceptable

- accompagné

- Compte

- précision

- Avec cette connaissance vient le pouvoir de prendre

- atteindre

- acquisition

- présenter

- propos

- Avancée

- avantages

- Après

- à opposer à

- agrégat

- AI

- recherche ai

- alignement

- Permettre

- seul

- aussi

- alternative

- toujours

- an

- ainsi que les

- Une autre

- répondre

- réponses

- tous

- A PART

- Application

- Le développement d'applications

- applications

- une approche

- approches

- SONT

- article

- sur notre blog

- AS

- Evaluer

- Évaluation de risque climatique

- associé

- At

- attributs

- Automatisation

- Automatique

- disponibles

- moyen

- attendre

- base

- basé

- BE

- before

- Au-delà

- biais

- l'attrait

- Bot

- tous les deux

- vaste

- Développement

- la performance des entreprises

- mais

- by

- CAN

- candidat

- candidats

- Compétences

- capturer

- maisons

- cas

- pris

- challenge

- globaux

- difficile

- Chatbot

- Selectionnez

- COHÉRENT

- Collecte

- combinant

- vient

- commentaires

- Commun

- par rapport

- comparant

- Complété

- complet

- Considérer

- considérations

- cohérent

- contraintes

- construire

- contiennent

- continuellement

- conventionnel

- Core

- correct

- rentable

- cher

- Costs

- pourriez

- couvrant

- engendrent

- critères

- critique

- crucial

- Courant

- Customiser

- des clients

- Support à la clientèle

- jours

- profond

- profond

- Réglage par défaut

- défini

- définitive

- delve

- démontrer

- déploiement

- déploiements

- un

- Avec nos Bagues Halo

- détaillé

- mobiles

- Développement

- différent

- dans

- distinct

- Ne fait pas

- domaine

- Ne pas

- down

- désavantages

- deux

- Dynamic

- e

- chacun

- Plus tôt

- de manière efficace

- efficace

- non plus

- éléments

- économies émergentes.

- mettre en relief

- permettant

- englober

- s'efforcer

- Assure

- assurer

- Entreprise

- Environment

- Erreurs

- essence

- essential

- établir

- évaluer

- évaluer

- évaluation

- évaluations

- Pourtant, la

- Chaque

- évolution

- exemple

- exemples

- Excel

- réalisé

- exister

- Développer vous

- avec des données

- cher

- expérimental

- facilité

- papillon de nuit

- rapide

- favoriser

- réalisable

- Réactions

- few

- Prénom

- Focus

- Abonnement

- Pour

- le format

- fréquemment

- friendly

- de

- fonction

- En outre

- recueillir

- Général

- généralement

- générer

- généré

- véritable

- obtenez

- donné

- objectif

- Or

- Gold standard

- Croissance

- guarantir

- arriver

- Plus fort

- Exploiter

- Vous avez

- ayant

- fortement

- de haute qualité

- augmentation

- Soulignant

- holistique

- Comment

- How To

- Cependant

- HTTPS

- humain

- Hybride

- i

- idéal

- idéalement

- identifier

- identifier

- if

- Immédiat

- impératif

- Mettre en oeuvre

- importance

- impressionnant

- in

- comprendre

- inclus

- indique

- informer

- inhérent

- initiale

- possible

- contribution

- entrées

- idées.

- instance

- des services

- interne

- développement

- IT

- SES

- lui-même

- jpg

- ACTIVITES

- Savoir

- langue

- gros

- plus importantes

- dirigeants

- apprentissage

- au

- laisser

- Niveau

- Levier

- en tirant parti

- VIE

- vos produits

- comme

- probabilité

- limites

- LLM

- LLP

- plus long

- click

- machine learning

- Maintenir

- Manuel

- Matière

- largeur maximale

- Mai..

- mécanique

- mécanique

- mécanisme

- médical

- simple

- fusion

- Métadonnées

- méthode

- Méthodologie

- méthodes

- méticuleux

- Métrique

- pourrait

- mineur

- trompeur

- ML

- modèle

- numériques jumeaux (digital twin models)

- Surveiller

- Stack monitoring

- PLUS

- plus efficace

- (en fait, presque toutes)

- plusieurs

- must

- Nature

- nécessairement

- Besoin

- Nouveauté

- next

- notamment

- noté

- objectifs

- of

- Offres Speciales

- souvent

- on

- une fois

- ONE

- en cours

- fonctionner

- opérationnel

- Opportunités

- optimaux

- or

- Autre

- nos

- les résultats

- sortie

- plus de

- Surveillance

- propre

- paires

- PARAMOUNT

- particulier

- pause

- performant

- effectuer

- objectifs

- phase

- Platon

- Intelligence des données Platon

- PlatonDonnées

- pratique

- pragmatique

- préparé

- représentent

- présenté

- cadeaux

- Prioriser

- procédure

- processus

- les process

- produire

- Vidéo

- projets

- proven

- fournir

- Questions et réponses

- qualitatif

- qualités

- qualité

- quantitatif

- requêtes

- fréquemment posées

- vite.

- gamme

- Tarif

- plutôt

- clients

- monde réel

- royaume

- recevoir

- affiner

- Indépendamment

- vous inscrire

- libérer

- pertinent

- fiabilité

- fiable

- s'appuyer

- reste

- représentant

- demandes

- exigent

- Exigences

- a besoin

- un article

- Complexe touristique

- réponse

- réponses

- Résultats

- Révèle

- rigoureux

- robuste

- Courir

- même

- Escaliers intérieurs

- scénarios

- But

- examen minutieux

- Chercher

- la sélection

- sélection

- séquençage

- set

- Sets

- mise

- Paramétres

- Changements

- lacunes

- devrait

- signer

- étapes

- simplifier

- singulier

- faibles

- So

- uniquement

- quelques

- groupe de neurones

- Spectre

- Standard

- Commencer

- étapes

- Étapes

- Encore

- simple

- Stratégique

- Stratégiquement

- rationaliser

- forces

- sujet

- substantiellement

- tel

- RÉSUMÉ

- haut

- Support

- SWIFT

- combustion propre

- Système

- Prenez

- tâches

- tandem

- Target

- des campagnes marketing ciblées,

- Tâche

- équipe

- Technique

- techniques

- Technologie

- tester

- Essais

- qui

- Les

- leur

- Les

- puis

- Là.

- Ces

- l'ont

- this

- Avec

- tout au long de

- long

- fois

- à

- TON

- TOPBOTS

- vers

- traditionnel

- transition

- typiquement

- comprendre

- compréhension

- Inattendu

- imprévu

- unifiée

- expérience unique et authentique

- contrairement à

- imprévisible

- Actualités

- utilisé

- cas d'utilisation

- d'utiliser

- Utilisateur

- utilisateurs

- en utilisant

- d'habitude

- utiliser

- utilisé

- VALIDER

- variété

- via

- we

- web

- Développement Web

- Semaines

- quand

- que

- qui

- tout en

- plus large

- sera

- comprenant

- dans les

- sans

- ouvriers

- world

- encore

- rendements

- Vous n'avez

- Votre

- zéphyrnet