Temps de lecture: 5 minutes

Explorer l'efficacité de chatGPT dans l'audit de contrat intelligent

C'était le 30 novembre 2022, lorsque ChatGPT a été lancé. Il n'a pas fallu longtemps pour prendre le monde d'assaut. Quels que soient les médias sociaux que vous utilisez, il y a des messages, des mèmes, des articles informatifs et ainsi de suite sur chatGPT. Non seulement cela, le chatGPT était le sujet de conversation des médias grand public. Il n'y a pas de doute quand je dis que tout le monde a parlé de chatGPT et de sa puissance.

Dans ce blog, discutons de la façon dont chatGPT est utilisé ou peut être utilisé dans l'audit de contrat intelligent ou la cybersécurité Web3. Commençons d'abord par ce qu'est exactement chatGPT.

Qu'est-ce que ChatGPT ?

ChatGPT est un chatbot interactif qui accepte les invites et renvoie des réponses en fonction de ses données formées. Il a une capacité remarquable à communiquer dans un dialogue conversationnel et à fournir des réponses qui peuvent sembler étonnamment humaines.

En dehors de cela, l'une des choses qui le rendent plus intelligent est sa capacité unique à continuer à apprendre des données d'entrée de l'utilisateur ; ceci est implémenté dans une couche d'apprentissage par renforcement avec rétroaction humaine (RLHF), ce qui l'aide à renvoyer des réponses satisfaisantes pour les humains.

Données d'entraînement

Chaque modèle d'IA n'est rien d'autre qu'une machine formée qui donne des réponses en fonction de son apprentissage et des résultats des données de formation. Les données de formation peuvent être n'importe quoi, des vidéos au texte qui alimente un modèle qui apprend ces données, et lorsqu'un problème est proposé à ce modèle, basé sur son apprentissage à partir des données de formation, il donne des réponses.

Le chatGPT a été formé sur les données collectées sur Internet, y compris des sources telles que les discussions Reddit, pour aider ChatGPT à apprendre le dialogue et à obtenir un style de réponse de type humain. chatGPT est également formé au feedback humain. Cette technique s'appelle Reinforcement Learning with Human Feedback afin que l'IA apprenne ce que les gens attendent lorsqu'ils posent une question.

ChatGPT peut trouver des vulnérabilités

Longtemps après sa sortie, les gens ont commencé à expérimenter les capacités de chatGPT dans divers cas d'utilisation et scénarios. Cette expérimentation a également été faite dans la sécurité des contrats intelligents.

Et chatGPT ne nous a certainement pas fait défaut. Cependant, il peut encore être amélioré, mais il s'est avéré utile et d'une aide significative pour les auditeurs et les personnes traitant des contrats intelligents. En ce qui concerne les hacks bien connus et certains hacks qui sont dans le système depuis un certain temps maintenant, il est très utile de les attraper.

Certaines des vulnérabilités courantes que chatGPT trouve avec un peu de précision sont : -

- Attaque de location : Il s'agit d'une vulnérabilité courante dans laquelle un attaquant peut appeler à plusieurs reprises une fonction dans un contrat intelligent avant la fin de l'exécution précédente, ce qui entraîne un comportement inattendu ou malveillant.

- Dépassement/sous-dépassement d'entier : Les contrats intelligents reposent souvent sur des calculs d'entiers, et si ces calculs ne sont pas correctement vérifiés, ils peuvent entraîner un comportement inattendu ou incorrect.

- Valeurs de retour non cochées : Un contrat peut ne pas gérer correctement les valeurs de retour inattendues des appels externes, ce qui peut entraîner une vulnérabilité potentielle et causer des dommages.

- Fonctions non protégées: Un contrat peut ne pas disposer d'un contrôle d'accès adéquat, ce qui entraîne un accès non autorisé à des fonctions sensibles. Ce qui peut entraîner de lourdes pertes.

Il existe d'autres vulnérabilités et problèmes que chatGPT peut identifier avec les contrats intelligents, et vous serez sûrement surpris de les voir. Pourtant, grâce à nos tests, nous avons découvert que vous receviez souvent une fausse alerte, et il y a une énorme possibilité que certains bogues cruciaux soient manqués.

chatGPT peut-il trouver toutes les vulnérabilités ?

Bien que chatGPT soit un outil utile et une percée de l'IA pour les masses, il est encore loin d'être parfait et ne peut être laissé pour sécuriser complètement les contrats intelligents.

Notre test a révélé que le chatGPT a déclenché une fausse alerte pour un attaque de rentrée, qui était déjà gardé et testé. En dehors de cela, il y a eu d'autres fausses alarmes et, plus important encore, le bogue critique que notre équipe a trouvé a été complètement ignoré par chatGPT. Discutons de certaines des choses que chatGPT est susceptible de manquer.

- Logique spécifique au projet:- L'épine dorsale du projet est sa logique et la façon dont les choses sont interconnectées, mais chatGPT semble le manquer. Au cours des tests, il a été constaté que chatGPT était souvent incapable de trouver le bogue critique, qui était spécifique à la logique. En raison de la complexité de l'infrastructure sous-jacente du protocole, chatGPT passe à côté des vulnérabilités critiques qui surviennent en raison de l'interconnexion des contrats pour répondre à l'exigence logique du projet.

- Calculs mathématiques et modèles statistiques imprécis:- En ce qui concerne les projets, qu'il s'agisse d'un projet de jeu, d'un projet DeFi ou de n'importe quoi, cela implique principalement des calculs et des relations mathématiques. Ces formules sont souvent laissées non vérifiées et non surveillées par le chatGPT, et des bogues potentiels sont manqués.

- Irrégularités dans la conception et la mise en œuvre prévues:- Plusieurs fois, la mise en œuvre par les développeurs n'est pas aussi correcte qu'elle devrait l'être, ce qui entraîne des problèmes de sécurité. Cela a été exploité dans le passé et continue d'être l'un des secteurs essentiels qui peuvent être améliorés, et chatGPT est également un peu ignorant sur ce front.

Conclusion

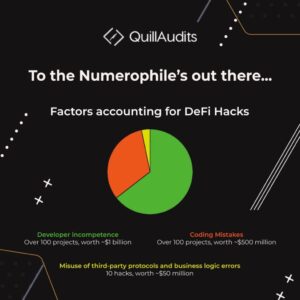

En matière de sécurité et d'audit Web3, les outils d'IA sont une aide, cela ne fait aucun doute, mais la question est, est-ce suffisant ? la réponse est un grand "NON". Comme indiqué, certaines des vulnérabilités cruciales peuvent facilement être ignorées, et il existe une énorme possibilité de fausses alarmes. Ces fausses alarmes créent un faux sentiment que chatGPT peut identifier tous les bogues et amener l'utilisateur à y croire, mais la réalité est différente et peut être dure si nous devenons dépendants uniquement des outils d'IA.

L'IA peut devenir très efficace, mais nous avons encore un long chemin à parcourir. La meilleure façon d'améliorer la sécurité est d'utiliser à la fois l'IA et la couverture manuelle des aspects de sécurité des contrats intelligents.

Concernant sécurité des contrats intelligents, rien ne remplace les audits. Il est de la plus haute nécessité de faire un audit, et sans audit, il ne peut jamais y avoir de confiance entre les utilisateurs, car les rapports d'audit signifient beaucoup. De nombreux utilisateurs recherchent le rapport d'audit avant de faire confiance aux projets. L'un des principaux cabinets de services d'audit est QuillAudits. Avec plus de 700 projets sécurisés et bien d'autres à venir, nous assurons la sécurité totale des protocoles. Consultez notre site Web dès maintenant et faites auditer votre projet.

20 Vues

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- Platoblockchain. Intelligence métaverse Web3. Connaissance Amplifiée. Accéder ici.

- La source: https://blog.quillhash.com/2023/04/03/beyond-the-hype-chatgpt-and-smart-contract-auditing/

- :est

- 2022

- a

- capacité

- A Propos

- accès

- précision

- atteindre

- Après

- AI

- alarme

- Tous

- déjà

- parmi

- et les

- répondre

- réponses

- A PART

- SONT

- sur notre blog

- AS

- aspects

- attaquer

- audit

- vérifié

- audit

- vérificateurs

- audits

- Colonne vertébrale

- basé

- BE

- devenez

- before

- CROYONS

- LES MEILLEURS

- Au-delà

- Big

- Bit

- Blog

- percée

- Punaise

- bogues

- by

- calculs

- Appelez-nous

- appelé

- Appels

- CAN

- ne peut pas

- capacités

- cas

- Causes

- Chatbot

- ChatGPT

- vérifier

- Venir

- Commun

- communiquer

- complet

- Complété

- complètement

- complexité

- continue

- contrat

- contrats

- des bactéries

- de la conversation

- couverture

- engendrent

- critique

- crucial

- cyber

- la cyber-sécurité

- données

- traitement

- DeFi

- dépendant

- Conception

- mobiles

- Dialogue

- DID

- différent

- découvert

- discuter

- discuté

- discussions

- doute

- pendant

- même

- Efficace

- efficacité

- assez

- assurer

- essential

- tout le monde

- exactement

- exécution

- attendre

- Exploités

- externe

- FAIL

- Fed

- Réactions

- Trouvez

- trouve

- entreprises

- Prénom

- Pour

- trouvé

- De

- avant

- fonction

- fonctions

- jeux

- obtenez

- donne

- Go

- hacks

- manipuler

- Vous avez

- lourd

- vous aider

- aide

- Comment

- Cependant

- HTTPS

- majeur

- humain

- Les êtres humains

- Hype

- i

- identifier

- la mise en oeuvre

- mis en œuvre

- améliorer

- amélioré

- amélioration

- in

- Y compris

- informatif

- Infrastructure

- contribution

- Interactif

- interconnecté

- Internet

- vous aider à faire face aux problèmes qui vous perturbent

- IT

- SES

- XNUMX éléments à

- lancé

- couche

- conduire

- conduisant

- APPRENTISSAGE

- apprentissage

- Probable

- logique

- Location

- Style

- perte

- Lot

- click

- Courant dominant

- les médias traditionnels

- a prendre une

- Manuel

- de nombreuses

- masses

- math

- mathématique

- Matière

- Médias

- mèmes

- manque

- modèle

- PLUS

- (en fait, presque toutes)

- Novembre

- of

- on

- ONE

- Autre

- passé

- Personnes

- parfaite

- Platon

- Intelligence des données Platon

- PlatonDonnées

- possibilité

- Poteaux

- défaillances

- power

- précédent

- Problème

- Projet

- projets

- correct

- correctement

- proposé

- protocole

- protocoles

- prouvé

- fournir

- question

- Quillhasch

- collectés

- Réalité

- recevoir

- rapports

- libérer

- remarquables

- À PLUSIEURS REPRISES

- rapport

- Rapports

- exigence

- réponse

- résultat

- retourner

- Retours

- Salle

- Sécurité

- scénarios

- Deuxièmement

- Secteurs

- sécurisé

- sécurisé

- sécurité

- semble

- sens

- sensible

- Services

- devrait

- significative

- smart

- contrat intelligent

- Sécurité des contrats intelligents

- Contrats intelligents

- plus intelligents

- So

- Réseaux sociaux

- réseaux sociaux

- quelques

- Sources

- groupe de neurones

- Commencer

- j'ai commencé

- statistique

- Encore

- tempête

- Catégorie

- tel

- sûrement

- surpris

- combustion propre

- Prenez

- prend

- discutons-en

- équipe

- tester

- tests

- qui

- Le

- Les projets

- le monde

- Les

- Ces

- des choses

- Avec

- fiable

- fois

- à

- outil

- les outils

- qualifié

- Formation

- La confiance

- sous-jacent

- Inattendu

- expérience unique et authentique

- us

- utilisé

- Utilisateur

- utilisateurs

- Valeurs

- divers

- Vidéos

- vulnérabilités

- vulnérabilité

- Façon..

- Web3

- Site Web

- WELL

- bien connu

- Quoi

- que

- qui

- sera

- comprenant

- dans les

- sans

- world

- pourra

- Vous n'avez

- Votre

- zéphyrnet