Il est essentiel d'améliorer la façon dont les utilisateurs découvrent de nouveaux contenus pour accroître leur engagement et leur satisfaction sur les plateformes médiatiques. La recherche par mot-clé à elle seule a du mal à capturer la sémantique et l'intention de l'utilisateur, ce qui conduit à des résultats manquant de contexte pertinent ; par exemple, trouver des soirées en amoureux ou des films sur le thème de Noël. Cela peut entraîner une baisse des taux de rétention si les utilisateurs ne parviennent pas à trouver de manière fiable le contenu qu'ils souhaitent. Cependant, avec grands modèles de langage (LLM), il existe une opportunité de résoudre ces défis sémantiques et d’intention de l’utilisateur. En combinant plongements qui capturent la sémantique avec une technique appelée Génération augmentée de récupération (RAG), vous pouvez générer des réponses plus pertinentes en fonction du contexte récupéré à partir de vos propres sources de données.

Dans cet article, nous vous montrons comment créer en toute sécurité un chatbot de film en implémentant RAG avec vos propres données en utilisant Bases de connaissances en Socle amazonien. Nous utilisons l'ensemble de données IMDb et Box Office Mojo pour simuler un catalogue destiné aux clients des médias et du divertissement et montrer comment vous pouvez créer votre propre solution RAG en quelques étapes seulement.

Vue d'ensemble de la solution

La IMDb et Box Office Mojo Films/TV/OTT un ensemble de données sous licence fournit une large gamme de métadonnées de divertissement, y compris plus d'un milliard d'évaluations d'utilisateurs ; des crédits pour plus de 1.6 millions de membres de la distribution et de l'équipe ; 13 millions de titres de films, de télévision et de divertissement ; et des données de rapports sur le box-office mondial de plus de 10 pays. De nombreux clients de médias et de divertissement d'AWS autorisent les données IMDb via Échange de données AWS pour améliorer la découverte de contenu et accroître l'engagement et la fidélisation des clients.

Introduction aux bases de connaissances pour Amazon Bedrock

Pour équiper un LLM d'informations propriétaires à jour, les organisations utilisent RAG, une technique qui consiste à récupérer des données à partir des sources de données de l'entreprise et à enrichir l'invite avec ces données pour fournir des réponses plus pertinentes et plus précises. Les bases de connaissances pour Amazon Bedrock offrent une fonctionnalité RAG entièrement gérée qui vous permet de personnaliser les réponses LLM avec des données contextuelles et pertinentes de l'entreprise. Les bases de connaissances automatisent le flux de travail RAG de bout en bout, y compris l'ingestion, la récupération, l'augmentation des invites et les citations, vous éliminant ainsi le besoin d'écrire du code personnalisé pour intégrer les sources de données et gérer les requêtes. Les bases de connaissances pour Amazon Bedrock permettent également des conversations à plusieurs tours afin que le LLM puisse répondre aux requêtes complexes des utilisateurs avec la bonne réponse.

Nous utilisons les services suivants dans le cadre de cette solution :

Nous suivons les étapes de haut niveau suivantes :

- Prétraitez les données IMDb pour créer des documents à partir de chaque enregistrement de film et téléchargez les données dans un Service de stockage simple Amazon (Amazon S3) seau.

- Créez une base de connaissances.

- Synchronisez votre base de connaissances avec votre source de données.

- Utilisez la base de connaissances pour répondre aux requêtes sémantiques sur le catalogue de films.

Pré-requis

Les données IMDb utilisées dans cet article nécessitent une licence de contenu commercial et un abonnement payant au package de licence IMDb et Box Office Mojo Movies/TV/OTT sur AWS Data Exchange. Pour vous renseigner sur une licence et accéder à des exemples de données, visitez développeur.imdb.com. Pour accéder à l'ensemble de données, reportez-vous à Recommandation de puissance et recherche à l'aide d'un graphe de connaissances IMDb - Partie 1 et suivre la Accéder aux données IMDb .

Prétraiter les données IMDb

Avant de créer une base de connaissances, nous devons prétraiter l'ensemble de données IMDb dans des fichiers texte et les télécharger dans un compartiment S3. Dans cet article, nous simulons un catalogue client à l'aide de l'ensemble de données IMDb. Nous prenons 10,000 XNUMX films populaires de l’ensemble de données IMDb pour le catalogue et construisons l’ensemble de données.

Utilisez le suivant cahier pour créer l'ensemble de données avec des informations supplémentaires telles que les noms des acteurs, des réalisateurs et des producteurs. Nous utilisons le code suivant pour créer un fichier unique pour un film avec toutes les informations stockées dans le fichier dans un texte non structuré pouvant être compris par les LLM :

Une fois que vous disposez des données au format .txt, vous pouvez télécharger les données dans Amazon S3 à l'aide de la commande suivante :

Créer la base de connaissances IMDb

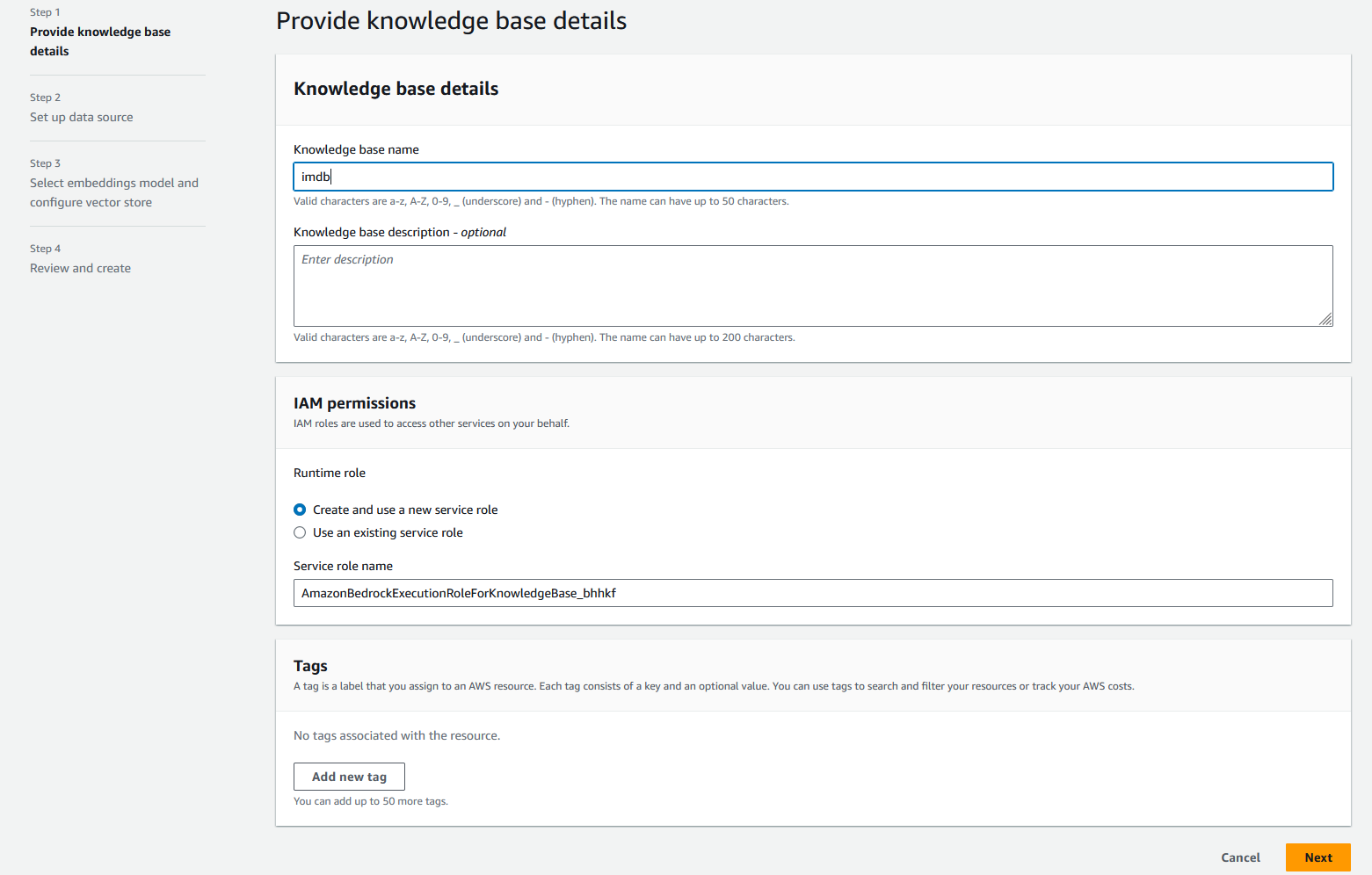

Effectuez les étapes suivantes pour créer votre base de connaissances :

- Sur la console Amazon Bedrock, choisissez Base de connaissances dans le volet de navigation.

- Selectionnez Créer une base de connaissances.

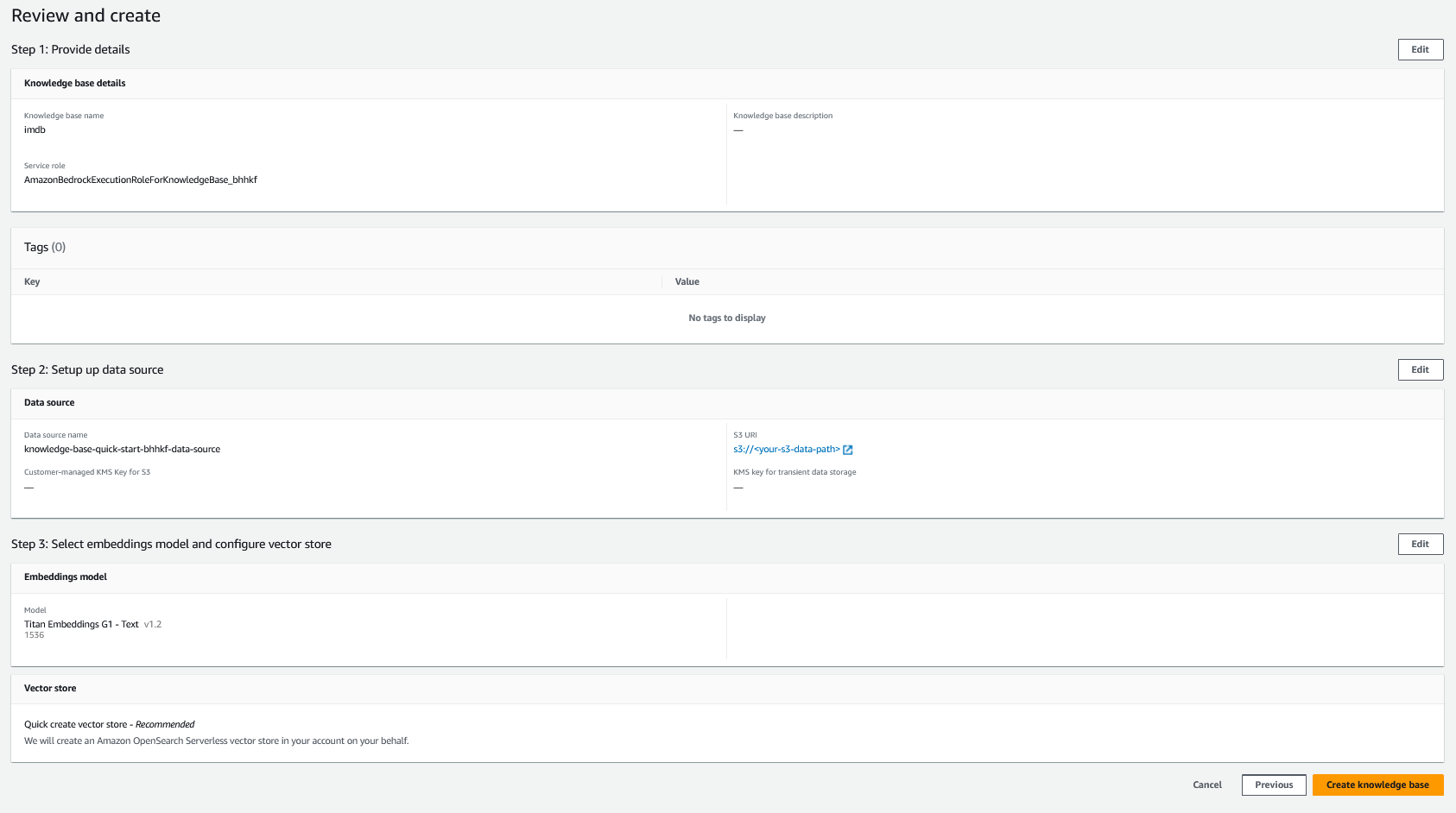

- Pour Nom de la base de connaissances, Entrer

imdb. - Pour Description de la base de connaissances, saisissez une description facultative, telle que Base de connaissances pour l'ingestion et le stockage des données imdb.

- Pour Autorisations IAM, sélectionnez Créer et utiliser un nouveau rôle de service, puis saisissez un nom pour votre nouveau rôle de service.

- Selectionnez Suivant.

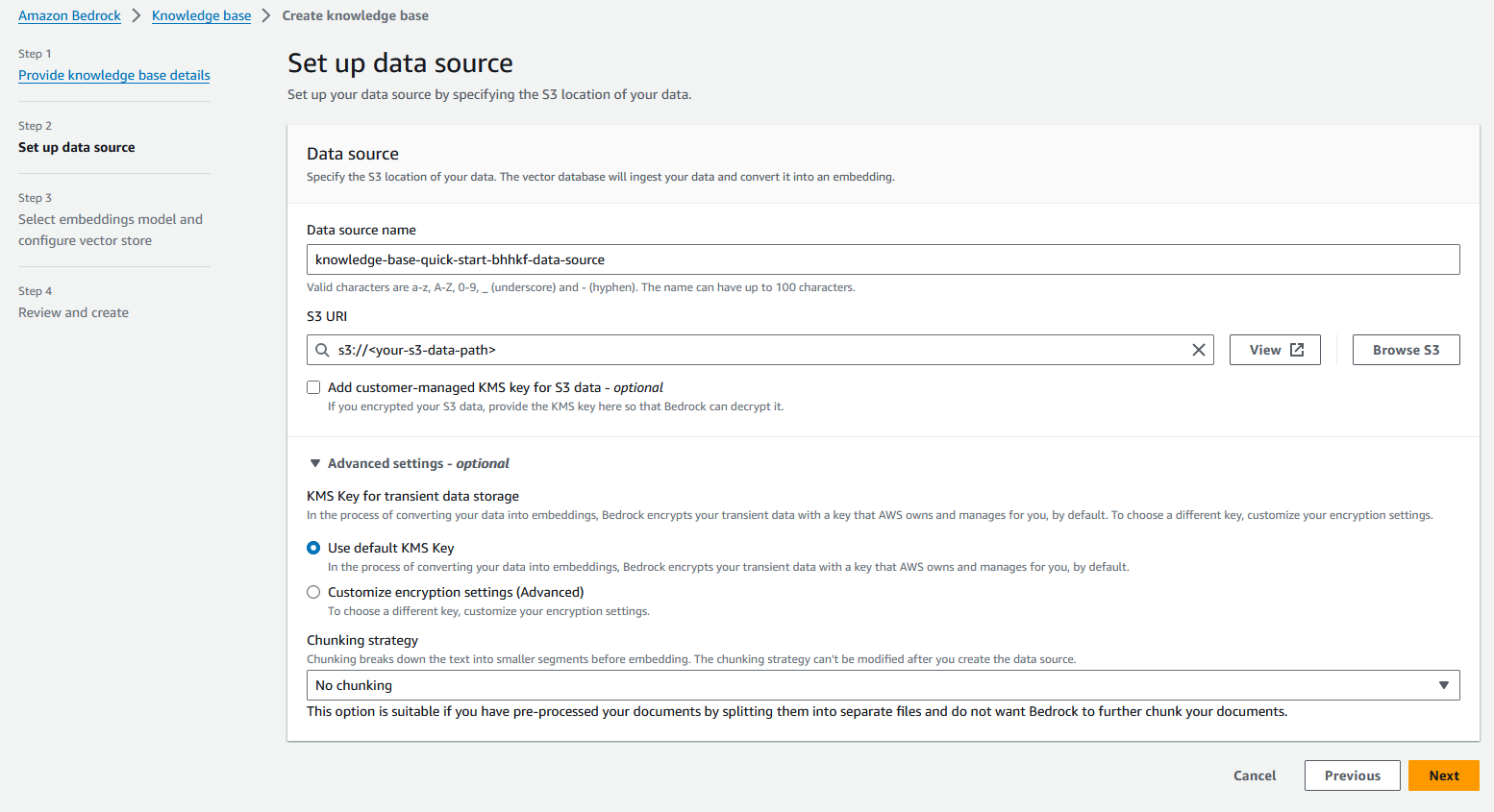

- Pour Nom de la source de données, Entrer

imdb-s3. - Pour URI S3, saisissez l'URI S3 vers lequel vous avez téléchargé les données.

- Dans le Paramètres avancés – facultatif section, pour Stratégie de regroupement, choisissez Pas de découpage.

- Selectionnez Suivant.

Les bases de connaissances vous permettent de diviser vos documents en segments plus petits pour faciliter le traitement de documents volumineux. Dans notre cas, nous avons déjà regroupé les données dans un document de plus petite taille (un par film).

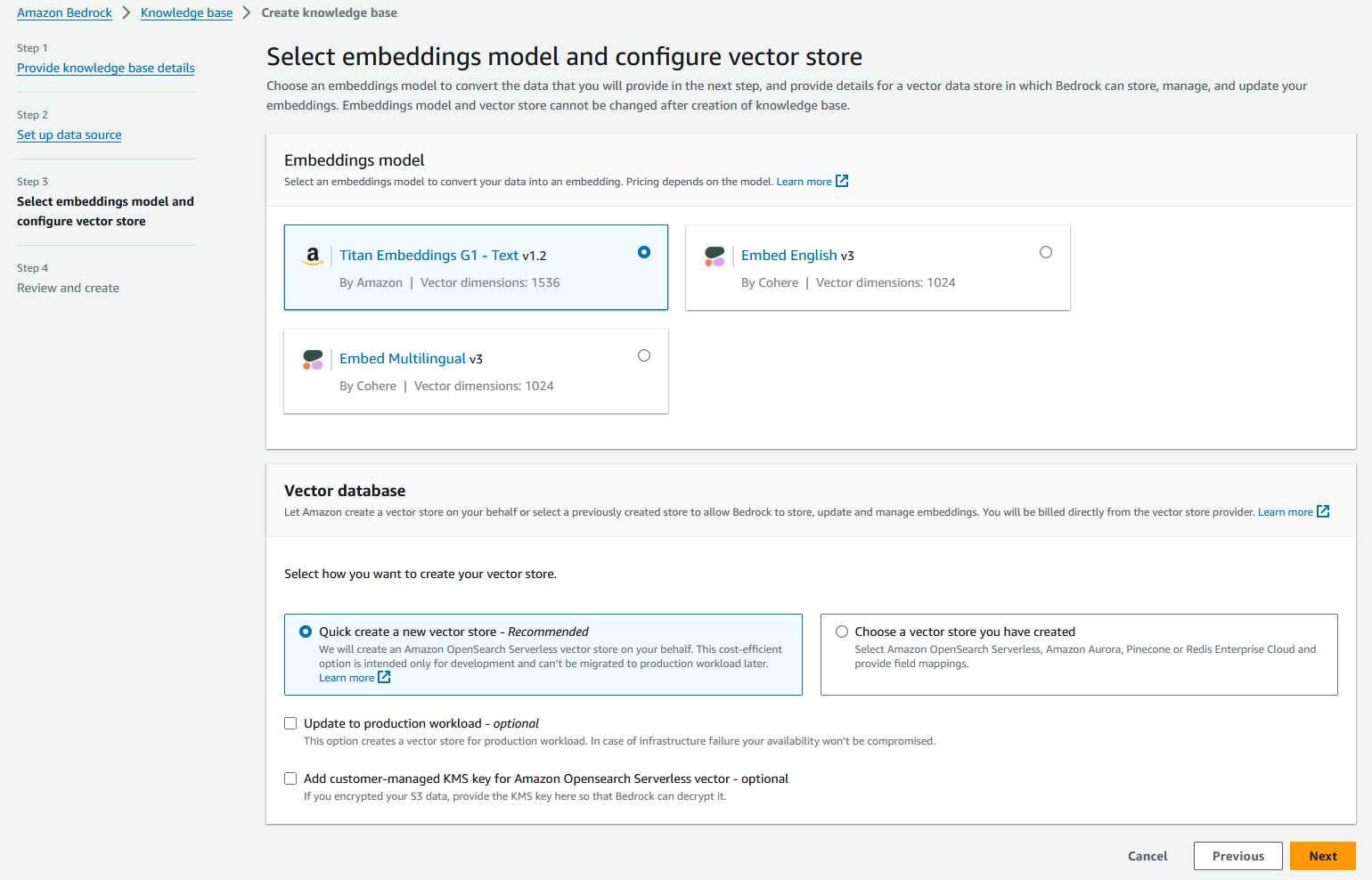

- Dans le Base de données vectorielle section, sélectionnez Créez rapidement un nouveau magasin de vecteurs.

Amazon Bedrock créera automatiquement une collection de recherche vectorielle OpenSearch Serverless entièrement gérée et configurera les paramètres d'intégration de vos sources de données à l'aide du modèle d'intégration de texte Titan Embedding G1 choisi.

- Selectionnez Suivant.

- Vérifiez vos paramètres et choisissez Créer une base de connaissances.

Synchronisez vos données avec la base de connaissances

Maintenant que vous avez créé votre base de connaissances, vous pouvez synchroniser la base de connaissances avec vos données.

- Sur la console Amazon Bedrock, accédez à votre base de connaissances.

- Dans le La source de données section, choisissez Sync.

Une fois la source de données synchronisée, vous êtes prêt à interroger les données.

Améliorer la recherche à l'aide de résultats sémantiques

Effectuez les étapes suivantes pour tester la solution et améliorer votre recherche à l'aide de résultats sémantiques :

- Sur la console Amazon Bedrock, accédez à votre base de connaissances.

- Sélectionnez votre base de connaissances et choisissez Tester la base de connaissances.

- Selectionnez Sélectionnez le modèleet choisissez Anthropique Claude v2.1.

- Selectionnez Appliquer.

Vous êtes maintenant prêt à interroger les données.

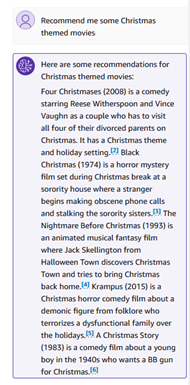

Nous pouvons poser des questions sémantiques, telles que « Recommandez-moi des films sur le thème de Noël ».

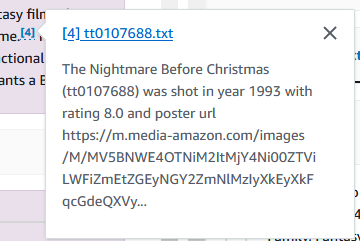

Les réponses de la base de connaissances contiennent des citations que vous pouvez explorer pour vérifier l'exactitude et la factualité des réponses.

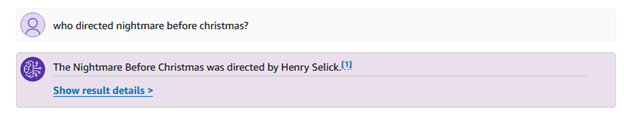

Vous pouvez également accéder à toutes les informations dont vous avez besoin sur ces films. Dans l'exemple suivant, nous demandons « qui a réalisé Cauchemar avant Noël ? »

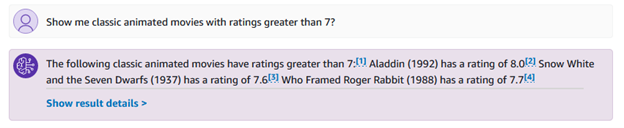

Vous pouvez également poser des questions plus spécifiques liées aux genres et aux notes, telles que « montre-moi des films d'animation classiques avec une note supérieure à 7 ? »

Augmentez votre base de connaissances avec des agents

Agents pour le substrat rocheux d’Amazonie vous aider à automatiser des tâches complexes. Les agents peuvent diviser la requête utilisateur en tâches plus petites et appeler des API personnalisées ou des bases de connaissances pour compléter les informations nécessaires à l'exécution des actions. Avec Agents for Amazon Bedrock, les développeurs peuvent intégrer des agents intelligents dans leurs applications, accélérant ainsi la livraison d'applications basées sur l'IA et économisant des semaines de temps de développement. Avec les agents, vous pouvez augmenter votre base de connaissances en ajoutant davantage de fonctionnalités telles que les recommandations de Amazon Personnaliser pour des recommandations spécifiques à l'utilisateur ou pour effectuer des actions telles que le filtrage de films en fonction des besoins de l'utilisateur.

Conclusion

Dans cet article, nous avons montré comment créer un chatbot de film conversationnel à l'aide d'Amazon Bedrock en quelques étapes pour répondre à la recherche sémantique et aux expériences conversationnelles basées sur vos propres données et l'ensemble de données sous licence IMDb et Box Office Mojo Movies/TV/OTT. Dans le prochain article, nous passons en revue le processus d'ajout de fonctionnalités supplémentaires à votre solution à l'aide des agents pour Amazon Bedrock. Pour démarrer avec les bases de connaissances sur Amazon Bedrock, reportez-vous à Bases de connaissances pour Amazon Bedrock.

À propos des auteurs

Gaurav Relé est Senior Data Scientist au Generative AI Innovation Center, où il travaille avec des clients AWS dans différents secteurs verticaux pour accélérer leur utilisation de l'IA générative et des services AWS Cloud afin de résoudre leurs défis commerciaux.

Gaurav Relé est Senior Data Scientist au Generative AI Innovation Center, où il travaille avec des clients AWS dans différents secteurs verticaux pour accélérer leur utilisation de l'IA générative et des services AWS Cloud afin de résoudre leurs défis commerciaux.

Divya Bhargavi est responsable scientifique appliquée principale au Generative AI Innovation Center, où elle résout des problèmes commerciaux à grande valeur ajoutée pour les clients AWS à l'aide de méthodes d'IA générative. Elle travaille sur la compréhension et la récupération d'images/vidéos, les grands modèles de langage augmentés par des graphes de connaissances et les cas d'utilisation de la publicité personnalisée.

Divya Bhargavi est responsable scientifique appliquée principale au Generative AI Innovation Center, où elle résout des problèmes commerciaux à grande valeur ajoutée pour les clients AWS à l'aide de méthodes d'IA générative. Elle travaille sur la compréhension et la récupération d'images/vidéos, les grands modèles de langage augmentés par des graphes de connaissances et les cas d'utilisation de la publicité personnalisée.

Suren Gunturu est un Data Scientist travaillant au Generative AI Innovation Center, où il travaille avec divers clients AWS pour résoudre des problèmes commerciaux de grande valeur. Il se spécialise dans la création de pipelines ML à l'aide de grands modèles linguistiques, principalement via Amazon Bedrock et d'autres services Cloud AWS.

Suren Gunturu est un Data Scientist travaillant au Generative AI Innovation Center, où il travaille avec divers clients AWS pour résoudre des problèmes commerciaux de grande valeur. Il se spécialise dans la création de pipelines ML à l'aide de grands modèles linguistiques, principalement via Amazon Bedrock et d'autres services Cloud AWS.

Vidya Sagar Ravipati est responsable scientifique au Generative AI Innovation Center, où il met à profit sa vaste expérience des systèmes distribués à grande échelle et sa passion pour l'apprentissage automatique pour aider les clients AWS de différents secteurs industriels à accélérer leur adoption de l'IA et du cloud.

Vidya Sagar Ravipati est responsable scientifique au Generative AI Innovation Center, où il met à profit sa vaste expérience des systèmes distribués à grande échelle et sa passion pour l'apprentissage automatique pour aider les clients AWS de différents secteurs industriels à accélérer leur adoption de l'IA et du cloud.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/build-a-movie-chatbot-for-tv-ott-platforms-using-retrieval-augmented-generation-in-amazon-bedrock/

- :possède

- :est

- :où

- 10 millions de dollars

- 000

- 1

- 10

- 100

- 11

- 118

- 12

- 13

- 360

- 385

- 60

- 7

- a

- A Propos

- accélérer

- accélérer

- accès

- Avec cette connaissance vient le pouvoir de prendre

- à travers

- actes

- acteurs

- ajoutant

- Supplémentaire

- Adoption

- Numérique

- agents

- AI

- Alimenté par l'IA

- Tous

- permet

- seul

- déjà

- aussi

- Amazon

- Amazon Web Services

- an

- ainsi que le

- répondre

- réponses

- tous

- Apis

- applications

- appliqué

- applications

- SONT

- AS

- demander

- At

- augmenter

- augmentée

- automatiser

- automatiquement

- AWS

- Échange de données AWS

- base

- basé

- BE

- before

- Milliards

- Box

- box-office

- Pause

- construire

- Développement

- la performance des entreprises

- by

- Appelez-nous

- appelé

- CAN

- aptitude

- capturer

- Capturer

- maisons

- cas

- catalogue

- Canaux centraux

- globaux

- Chatbot

- Selectionnez

- choisi

- Noël

- classiques

- le cloud

- adoption du cloud

- services de cloud computing

- code

- collection

- combinant

- commercial

- Société

- complexe

- Console

- contiennent

- contenu

- contexte

- contextuel

- de la conversation

- conversations

- correct

- d'exportation

- Couples

- engendrent

- créée

- Crédits

- équipage

- critique

- Customiser

- des clients

- L'engagement des clients

- Clients

- personnaliser

- données

- D'échange de données

- Data Scientist

- Date

- livrer

- page de livraison.

- la description

- détails

- mobiles

- Développement

- différent

- dirigé

- Directeur

- Administration

- découvrez

- découverte

- distribué

- systèmes distribués

- document

- INSTITUTIONNELS

- down

- motivation

- l'élimination

- enrobage

- permettre

- end-to-end

- participation

- enrichissant

- Entrer

- Divertissement

- Chaque

- exemple

- échange

- d'experience

- Expériences

- explorez

- few

- Déposez votre dernière attestation

- Fichiers

- filtration

- Trouvez

- trouver

- suivre

- Abonnement

- Pour

- le format

- De

- d’étiquettes électroniques entièrement

- g1

- générer

- génération

- génératif

- IA générative

- genres

- obtenez

- Global

- Go

- graphique

- plus grand

- Vous avez

- he

- vous aider

- de haut niveau

- sa

- Comment

- How To

- Cependant

- HTML

- http

- HTTPS

- if

- la mise en œuvre

- améliorer

- in

- Y compris

- Améliore

- industrie

- info

- d'information

- Innovation

- renseigner

- intégrer

- Intelligent

- intention

- développement

- implique

- IT

- jpg

- juste

- spécialisées

- Graphique connaissances

- Peindre

- langue

- gros

- grande échelle

- conduire

- conduisant

- apprentissage

- les leviers

- Licence

- Autorisé

- Licence

- comme

- LLM

- locales

- emplacement

- baisser

- click

- machine learning

- a prendre une

- gérer

- gérés

- manager

- de nombreuses

- me

- Médias

- Membres

- Métadonnées

- méthodes

- million

- ML

- modèle

- numériques jumeaux (digital twin models)

- PLUS

- film

- Films

- prénom

- noms

- NAVIGUER

- Navigation

- Besoin

- Besoins

- Nouveauté

- next

- nuit

- of

- Bureaux

- on

- ONE

- Opportunités

- or

- organisations

- Autre

- nos

- plus de

- propre

- paquet

- page

- payé

- pain

- partie

- passion

- chemin

- /

- effectuer

- Personnalisé

- Plateformes

- Platon

- Intelligence des données Platon

- PlatonDonnées

- parcelle

- Populaire

- Post

- qui se déroulent

- d'ouvrabilité

- processus

- producteur

- Nos producteurs

- propriétaire

- fournit

- requêtes

- question

- fréquemment posées

- chiffon

- gamme

- Tarifs

- clients

- votes

- solutions

- recommander

- Recommandation

- recommandations

- record

- reportez-vous

- en relation

- pertinent

- Rapports

- a besoin

- réponse

- réponses

- Résultats

- rétention

- récupération

- retourner

- Rôle

- RANGÉE

- pour le running

- client

- économie

- Sciences

- Scientifique

- Rechercher

- Section

- en toute sécurité

- segments

- Sélectionner

- sémantique

- sémantique

- supérieur

- Sans serveur

- service

- Services

- Paramétres

- elle

- coup

- montrer

- vitrine

- montré

- étapes

- simuler

- unique

- Taille

- faibles

- So

- sur mesure

- RÉSOUDRE

- Résout

- quelques

- Identifier

- Sources

- spécialise

- groupe de neurones

- j'ai commencé

- Étapes

- storage

- Boutique

- stockée

- stockage

- simple

- abonnement

- tel

- complément

- synchroniser.

- Système

- Prenez

- tâches

- technique

- tester

- texte

- que

- qui

- La

- les informations

- leur

- Les

- À thème

- puis

- Là.

- Ces

- l'ont

- this

- Avec

- fiable

- Titan

- titres

- à

- tv

- compréhension

- compris

- déstructuré

- mise à jour

- téléchargé

- URL

- utilisé

- d'utiliser

- Utilisateur

- utilisateurs

- en utilisant

- divers

- Vaste

- verticales

- Visiter

- W

- marcher

- souhaitez

- était

- we

- web

- services Web

- Semaines

- large

- Large gamme

- sera

- comprenant

- workflow

- de travail

- vos contrats

- écrire

- X

- an

- Vous n'avez

- Votre

- zéphyrnet